JP2006099614A - Living body discrimination apparatus and living body discrimination method - Google Patents

Living body discrimination apparatus and living body discrimination method Download PDFInfo

- Publication number

- JP2006099614A JP2006099614A JP2004287237A JP2004287237A JP2006099614A JP 2006099614 A JP2006099614 A JP 2006099614A JP 2004287237 A JP2004287237 A JP 2004287237A JP 2004287237 A JP2004287237 A JP 2004287237A JP 2006099614 A JP2006099614 A JP 2006099614A

- Authority

- JP

- Japan

- Prior art keywords

- living body

- image

- detected

- biological

- living

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Pending

Links

- 238000012850 discrimination method Methods 0.000 title claims description 14

- 238000001514 detection method Methods 0.000 claims description 49

- 210000000746 body region Anatomy 0.000 claims description 30

- 238000005286 illumination Methods 0.000 claims description 28

- 238000009826 distribution Methods 0.000 claims description 17

- 238000003384 imaging method Methods 0.000 claims description 10

- 230000001678 irradiating effect Effects 0.000 claims description 2

- 230000008512 biological response Effects 0.000 abstract 1

- 210000001508 eye Anatomy 0.000 description 19

- 238000000034 method Methods 0.000 description 15

- 238000010586 diagram Methods 0.000 description 12

- 210000003462 vein Anatomy 0.000 description 10

- 230000007257 malfunction Effects 0.000 description 7

- 230000001815 facial effect Effects 0.000 description 6

- 230000003287 optical effect Effects 0.000 description 6

- 210000001525 retina Anatomy 0.000 description 6

- 238000005516 engineering process Methods 0.000 description 5

- 238000005259 measurement Methods 0.000 description 4

- 230000002207 retinal effect Effects 0.000 description 4

- 238000000605 extraction Methods 0.000 description 3

- 238000009434 installation Methods 0.000 description 3

- 210000000554 iris Anatomy 0.000 description 3

- 238000012545 processing Methods 0.000 description 3

- 210000003128 head Anatomy 0.000 description 2

- 238000012986 modification Methods 0.000 description 2

- 230000004048 modification Effects 0.000 description 2

- 238000007796 conventional method Methods 0.000 description 1

- 230000007423 decrease Effects 0.000 description 1

- 239000004973 liquid crystal related substance Substances 0.000 description 1

- 239000000463 material Substances 0.000 description 1

- 210000000214 mouth Anatomy 0.000 description 1

- 230000005693 optoelectronics Effects 0.000 description 1

- 210000001747 pupil Anatomy 0.000 description 1

Images

Landscapes

- Collating Specific Patterns (AREA)

- Measurement Of The Respiration, Hearing Ability, Form, And Blood Characteristics Of Living Organisms (AREA)

Abstract

Description

本発明は、たとえば、人物の虹彩、網膜、静脈、顔の特徴、手の状態など、生体情報の特徴や状態を取得することで、その生体情報そのものを記録する装置や、生体的な特徴の動きなどを検知したユーザインタフェース装置、その生体情報を基に本人であるか否かを判定する生体認証装置などにおいて、生体情報を取得する対象物が生体(本当の人物)であるか非生体(人物以外の物体)であるかを判別する生体判別装置および生体判別方法に関する。 The present invention, for example, is a device that records biometric information itself, such as the iris, retina, veins, facial features, and hand status of a person, and records the biometric information itself. In a user interface device that detects movement or the like, a biometric authentication device that determines whether or not the person is the person based on the biometric information, the target for acquiring the biometric information is a living body (real person) or a non-living body ( The present invention relates to a biological discrimination device and a biological discrimination method for discriminating whether an object other than a person).

最近、たとえば、人物の虹彩、網膜、静脈、顔の特徴、手の状態など、生体情報の特徴や状態を取得することで、その生体情報そのものを記録する装置や、生体的な特徴の動きなどを検知したユーザインタフェース装置、その生体情報を基に本人であるか否かを判定する生体認証装置など、生体情報を対象とした各種技術が開発されている。 Recently, for example, a device that records biometric information itself, such as the iris, retina, veins, facial features, hand status, etc. Various techniques for biometric information have been developed, such as a user interface device that detects a biometric information and a biometric authentication device that determines whether or not the user is the person based on the biometric information.

それらのうち、人物の生体情報を撮影して得られる特徴情報や状態を利用する生体認証装置において、撮影対象領域に生体情報が写された写真や絵の印刷物、あるいは、映像表示機器によって非生体の画像が撮影されてしまった場合、前述の機器で望まれた動作ができずに誤動作や誤判別をしてしまう問題がある。 Among them, in a biometric authentication device that uses feature information and state obtained by photographing a person's biometric information, a non-biological object is printed by a photograph or picture printed on the area to be photographed or a picture display device. If the image is taken, there is a problem that the desired operation cannot be performed by the above-described device, and the malfunction or the erroneous determination is caused.

そこで、最近、これらの問題を解決する手段として、撮影対象となる生体情報を保持する人物に対して特殊な生体反応動作をさせたり、その生体情報を保持する人物に対して所定の動作を要求したりする方法が考えられている(たとえば、特許文献1、特許文献2、特許文献3参照)。

しかしながら、上記した従来の方法では、撮影対象となる生体情報を保持する人物に対して特殊な生体反応動作をさせたり、その生体情報を保持する人物に対して所定の動作を要求したりするなど、利用者にとって負担が必要とされてしまうものが多い。

また、眼の瞳孔の変化を計測したり、顔の凹凸を区別できるような精密な計測機器が必要となり、通常の機器に対して付加する機器が複雑かつ高価になってしまうという問題がある。

However, in the conventional method described above, a special biological reaction operation is performed on the person holding the biological information to be imaged, or a predetermined operation is requested from the person holding the biological information. There are many cases where a burden is required for the user.

In addition, there is a problem that a precise measuring device that can measure a change in the pupil of the eye and distinguish the unevenness of the face is required, and a device added to a normal device becomes complicated and expensive.

そこで、本発明は、たとえば、人物の生体情報を撮影して得られる特徴情報や状態を利用する装置において、人物に対して特殊な生体反応や操作を要求することなく、写真、絵、映像表示機器などが撮影範囲内に存在した場合でも、誤動作や誤判別などをせずに所望の制御を行なうことができる生体判別装置および生体判別方法を提供することを目的とする。 Therefore, the present invention, for example, in an apparatus that uses characteristic information and state obtained by photographing biological information of a person, displays pictures, pictures, and images without requiring a special biological reaction or operation to the person. An object of the present invention is to provide a living body discriminating apparatus and a living body discriminating method capable of performing desired control without malfunction or misjudgment even when a device or the like is present in the imaging range.

本発明の生体判別装置は、生体情報を取得する対象物が生体であるか非生体であるかを判別する生体判別装置であって、対象物の生体情報を含む画像を取得する画像取得手段と、この画像取得手段により取得された画像から生体領域を検出する生体検出手段と、この生体検出手段により検出された生体領域の画像特徴を、あらかじめ求められた正常な対象物が所定の位置に存在したときに得られる生体領域の画像特徴と比較し、両画像特徴の間に所定値以上の差があると判断したときに当該対象物は非生体であると判別する生体判別手段と、この生体判別手段の判別結果に基づき、出力先として接続された機器に対して出力する内容を変化させる出力制御手段とを具備している。 The living body discriminating apparatus of the present invention is a living body discriminating apparatus that discriminates whether a target for acquiring biological information is a living body or a non-living body, and an image acquiring unit that acquires an image including the biological information of the target object. A living body detecting means for detecting a living body area from the image acquired by the image acquiring means, and a normal object obtained in advance for the image features of the living body area detected by the living body detecting means at a predetermined position. A living body discriminating means for discriminating that the object is non-living when it is determined that there is a difference of a predetermined value or more between the image features of the living body region obtained when Output control means for changing contents to be output to a device connected as an output destination based on the determination result of the determination means.

また、本発明の生体判別装置は、生体情報を取得する対象物が生体であるか非生体であるかを判別する生体判別装置であって、対象物の生体情報を含む画像を取得する画像取得手段と、この画像取得手段により取得された画像から生体領域を検出する生体検出手段と、前記画像取得手段により取得された画像内において、前記生体検出手段により検出された生体領域以外の領域に生体以外の物体が存在するか否かを検知し、生体以外の物体の存在を検知したときに当該対象物は非生体であると判別する生体判別手段と、この生体判別手段の判別結果に基づき、出力先として接続された機器に対して出力する内容を変化させる出力制御手段とを具備している。 Further, the living body discrimination device of the present invention is a living body discrimination device that discriminates whether a target for which biological information is acquired is a living body or a non-living body, and acquires an image including biological information of the target. Means, a living body detecting means for detecting a living body area from the image acquired by the image acquiring means, and a living body in an area other than the living body area detected by the living body detecting means in the image acquired by the image acquiring means. Based on the determination result of the living body determining means, and the living body determining means for determining whether the target object is non-living when detecting the presence of an object other than the living body, Output control means for changing contents to be output to a device connected as an output destination.

また、本発明の生体判別方法は、生体情報を取得する対象物が生体であるか非生体であるかを判別する生体判別方法であって、対象物の生体情報を含む画像を取得し、この取得された画像から生体領域を検出し、この検出された生体領域の画像特徴を、あらかじめ求められた正常な対象物が所定の位置に存在したときに得られる生体領域の画像特徴と比較し、両画像特徴の間に所定値以上の差があると判断したときに当該対象物は非生体であると判別する。 Further, the living body discrimination method of the present invention is a living body discrimination method for discriminating whether an object for obtaining biological information is a living body or a non-living body, and acquires an image including the biological information of the object. A living body region is detected from the acquired image, and the image feature of the detected living body region is compared with the image feature of the living body region obtained when a normal object obtained in advance is present at a predetermined position; When it is determined that there is a difference greater than or equal to a predetermined value between the two image features, the object is determined to be non-living.

さらに、本発明の生体判別方法は、生体情報を取得する対象物が生体であるか非生体であるかを判別する生体判別方法であって、対象物の生体情報を含む画像を取得し、この取得された画像から生体領域を検出し、前記取得された画像内において、前記検出された生体領域以外の領域に生体以外の物体が存在するか否かを検知し、生体以外の物体の存在を検知したときに当該対象物は非生体であると判別する。 Further, the living body discrimination method of the present invention is a living body discrimination method for discriminating whether an object for obtaining biological information is a living body or a non-living body, and acquires an image including the biological information of the object. A living body region is detected from the acquired image, and it is detected whether an object other than the living body is present in a region other than the detected living body region in the acquired image, and the presence of an object other than the living body is detected. When detected, the object is determined to be non-living.

本発明によれば、たとえば、人物の生体情報を撮影して得られる特徴情報や状態を利用する装置において、人物に対して特殊な生体反応や操作を要求することなく、写真、絵、映像表示機器などが撮影範囲内に存在した場合でも、誤動作や誤判別などをせずに所望の制御を行なうことができる生体判別装置および生体判別方法を提供できる。 According to the present invention, for example, in an apparatus that uses characteristic information and a state obtained by photographing biological information of a person, a photograph, a picture, and a video are displayed without requiring a special biological reaction or operation from the person. It is possible to provide a living body determination apparatus and a living body determination method capable of performing desired control without malfunction or erroneous determination even when a device or the like is present in the imaging range.

以下、本発明の実施の形態について図面を参照して説明する。

まず、第1の実施の形態について説明する。

以下の説明では、撮影対象(生体情報を取得する対象物)を人物の顔としてカメラにより画像入力し、顔の領域を検出して撮影対象が本当の人物(生体)であるか人物以外の物体(非生体)であるかを判別することによって、接続される機器への制御信号を変更する生体判別装置を例として述べるが、本発明は対象物が人物の顔に限定されるものでなく、さまざまな生体情報を含む画像を入力して生体判別を行なうものに適用でき、たとえば、虹彩情報、網膜情報、手や指の静脈情報、指紋情報、目や口の状態などを用いた生体判別にも適用可能である。

Hereinafter, embodiments of the present invention will be described with reference to the drawings.

First, the first embodiment will be described.

In the following description, an image is input by a camera as a person to be imaged (object from which biometric information is acquired), a face area is detected, and the object to be imaged is a real person (living body) or an object other than a person An example of a biological discrimination device that changes a control signal to a connected device by determining whether it is (non-living), but the present invention is not limited to a human face, It can be applied to those that perform biometric discrimination by inputting images containing various biometric information. For example, biometric discrimination using iris information, retinal information, vein information of hands and fingers, fingerprint information, eye and mouth status, etc. Is also applicable.

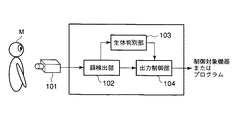

図1は、第1の実施の形態に係る生体判別装置の構成を概略的に示すものである。この生体判別装置は、撮影対象となる人物(以下、撮影対象、対象物ともいう)Mの顔画像(少なくとも顔を含んでいる画像)を撮影して入力する画像取得手段としてのカメラ101、カメラ101から得られた人物の顔画像から顔および目、鼻などの顔部位の位置を検出する生体検出手段としての顔検出部102、顔検出部102により検出された顔領域の画像特徴により撮影対象Mが本当の生体によるものか写真や絵などの印刷物や映像表示機器によるものであるかを判別する生体判別手段としての生体判別部103、カメラ101により撮影されている人物Mの顔画像や顔検出部102により検出された顔領域の検出結果、生体判別部103の判別結果に応じて、接続される機器や動作している出力信号やプログラムの制御手段を変更する出力制御手段としての出力制御部104から構成されている。

FIG. 1 schematically shows a configuration of a living body discrimination apparatus according to the first embodiment. The biometric discrimination device includes a

カメラ101は、人物Mの顔画像を撮像して入力するもので、たとえば、CCDセンサなどの撮像素子を用いたテレビジョンカメラなどを主体に構成されていて、撮像した顔画像をA/D変換してデジタル化した後、顔検出部102へ送る。

The

顔検出部102は、まず、カメラ101で入力された画像から人物Mの顔領域を検出する。たとえば、カメラ101からの入力画像内において、あらかじめ用意されたテンプレートを画像内で移動させながら相関値を求めることにより、最も高い相関値を与える位置を顔領域とする。なお、その他に、固有空間法や部分空間法を利用した顔領域抽出法などの顔検出手段でもよい。

First, the

顔検出部102は、次に、検出された顔領域の部分の中から、目、鼻、口といった顔部位の位置を検出する。その検出方法としては、たとえば、文献(福井和広、山口修:「形状抽出とパターン照合の組合せによる顔特徴点抽出」、電子情報通信学会論文誌(D),vol.J80−D−II,No.8,pp2170−2177(1997))に開示されている方法などを用いてよい。

Next, the

なお、本実施の形態では、顔領域の特徴を利用する例を記述したが、たとえば、虹彩、網膜、目の画像を対象として生体であるか非生体であるかを判別する場合にも、上記処理によって検出された目の領域を基にカメラをズーム動作させることなどで検出が可能となる。 In the present embodiment, an example in which the feature of the face area is used has been described. However, for example, in the case of determining whether the subject is an iris, a retina, or an eye image, whether it is a living body or a non-living body, The detection can be performed by zooming the camera based on the eye area detected by the processing.

また、上記目、鼻の検出の他に口領域の検出については、たとえば、文献(湯浅真由美、中島朗子:「高精度顔特徴点検出に基づくデジタルメイクシステム」第10回画像センシングシンポジウム予稿集,pp219−224(2004))の技術を利用することで容易に実現が可能である。 In addition to the above eye and nose detection, the detection of the mouth area is described, for example, in the literature (Mayumi Yuasa, Akiko Nakajima: “Digital Make System Based on High-Precision Facial Feature Point Detection” Proc. It can be easily realized by using the technology of pp219-224 (2004).

また、指紋や静脈のパターンについても、たとえば、文献(財団法人光産業技術振興協会(http://www.oitda.or.jp/index−j.html):2003年度光技術動向調査「15−003−1 光技術動向調査報告書」,5章「ヒューマンインターフェース」(2003))に記述された入力手段や技術を利用することで実現が可能である。いずれの場合でも、2次元配列状の画像として取扱える情報を取得し、その中から生体特徴の領域を検出することが可能である。 As for fingerprints and vein patterns, for example, literature (Optoelectronic Industry and Technology Promotion Association (http://www.oitda.or.jp/index-j.html): 2003 Optical Technology Trend Survey “15- This can be realized by using the input means and technology described in “003-1 Optical Technology Trend Survey Report”, Chapter 5 “Human Interface” (2003)). In any case, it is possible to acquire information that can be handled as a two-dimensional array image and detect a region of the biometric feature from the acquired information.

生体判別部103は、人物が平均的に立つ位置、あるいは、あらかじめガイドなどに基づき人物が所定の位置に立った場合に得られる顔領域の画像的な特徴情報(画像特徴)をあらかじめ求めておき、その分布をもとめる。その画像特徴とは、たとえば、両目の距離、両目の距離と目鼻の距離をかけた面積などといった顔画像のサイズでもよいし、顔領域内の平均輝度、輝度の中間値などを利用した輝度分布を示す特徴でもよいし、顔領域内の画像の微分値の総和やFFTをかけた高周波成分の割合などのコントラストを示す値などが利用可能である。

The

生体判別部103は、カメラ101により入力されたときの生体特徴から前述の画像特徴を再度取得して、あらかじめ求められた通常の人物で得られる画像特徴の分布と比較し、通常の人物で得られる範囲を示す所定の閾値以外の値が得られたときに非生体であると判別する。

The

図2(a)は、通常の人物の顔画像が入力されたときの顔領域Aの輝度分布を示しており、図2(b)は、顔画像を有する印刷物の画像が入力されたときの顔領域Bの輝度分布を示している。図から明らかなように、光反射率の違いやカメラ101の位置からの距離の違いなどにより輝度分布が異なる。そこで、図2(c)のグラフで示すように、下限閾値TLから上限閾値TUの範囲に顔の平均輝度分布が入っていれば通常の人物(生体)と判別するが、図2(b)の輝度分布のように平均輝度がavgの値となった場合、下限閾値TLよりも小さい値となっていることから、この場合は通常の人物ではなく、非生体による入力であると判別する。なお、この差を強調するために、補助照明光を顔領域に向けて照射することによって、より判別精度を向上させることも可能である。なお、図2(a)は通常の人物の場合、図3(d)は印刷物の場合、をそれぞれ示している。

FIG. 2A shows the luminance distribution of the face area A when a normal human face image is input, and FIG. 2B shows the case where a printed image having the face image is input. The luminance distribution of the face area B is shown. As is apparent from the figure, the luminance distribution varies depending on the difference in light reflectance and the distance from the position of the

また、同様に顔のサイズを用いる場合には、図3(a),(b)に示すように、両目間の距離L1,L2が顔のサイズを示すため、その距離L1,L2が通常の人物を撮像したときのサイズの分布の範囲外になった場合に非生体による入力であると判別する。 Similarly, when the face size is used, as shown in FIGS. 3A and 3B, the distances L1 and L2 between the eyes indicate the size of the face. Therefore, the distances L1 and L2 are normal. If it is outside the range of the size distribution when the person is imaged, it is determined that the input is from a non-biological body.

さらに、同様に顔領域のコントラストを用いる場合には、図3(a),(c)に示すように、カメラ101までの距離の違いなどによるピントのぼけなどから顔領域A,Bのコントラストが変化するため、そのコントラストが通常の人物を撮像したときのコントラストの分布の範囲外になった場合に非生体による入力であると判別する。コントラストを示す指標としては、たとえば、顔領域A,B内の微分画像を作成し、微分値の絶対値の平均値をとることや、顔領域A,B内の画像をフーリエ変換することによりコントラストが低下すると失われる高周波成分の値を比較する手段などでも実現が可能である。

このように、通常の人物から得られる顔領域の画像特徴と入力された顔領域の画像特徴とを比較することで、格別に特殊な機器を用いることなく生体判別処理が行なえる。

Further, when the contrast of the face area is used in the same manner, the contrast of the face areas A and B is caused by a blurring due to a difference in distance to the

In this way, by comparing the image feature of the face area obtained from a normal person with the image feature of the input face area, it is possible to perform the biometric determination process without using a special device.

また、生体判別部103において、画像情報だけでなく距離センサを併用することでより判別精度を向上させることが可能である。第1の実施の形態に距離計測手段としての距離センサ105を追加した場合の生体判別装置を例として説明し、その構成図を図4に示す。

Further, in the

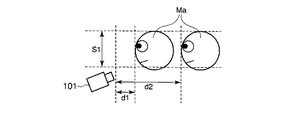

単純に距離センサ105からの情報を用いることにより、通常の位置に生体が存在することでないことを判別することは容易であり、さらに図5に示すようにカメラ101から人物Mの顔Maまでの距離がd1,d2と変化した場合でも、人物Mの平均的な顔サイズS1がわかっているため、距離に応じて入力される顔画像のサイズが計算可能である。

By simply using the information from the

すなわち、人物Mの顔サイズと異なるものが掲示されている場合を距離と顔サイズとの比率から簡単に求めることができ、所定の比率の範囲外となった場合に非生体と判別できる。

同様に、輝度の分布も距離に応じて事前に変化することがわかっていれば、距離センサ105からの距離情報と輝度情報との関係をあらかじめ求めておくことで比較が可能であり、コントラストについても同様であることがわかる。この場合には、生体情報を読取る手段が生体と接触する接触式の場合では利用できないため、指紋では実現が難しいが、顔、虹彩、網膜、目、口、静脈などといった非接触で生体情報を取得する場合には有効な手段となる。

In other words, a case where a thing different from the face size of the person M is posted can be easily obtained from the ratio between the distance and the face size, and can be determined to be non-living when it falls outside the range of the predetermined ratio.

Similarly, if it is known that the luminance distribution also changes in advance according to the distance, a comparison can be made by obtaining the relationship between the distance information from the

出力制御部104は、カメラ101で入力される入力画像、顔検出部102から得られる顔領域や特徴情報、生体判別部103の判別結果といった情報そのものを出力先となる機器に向けて出力するとともに、生体判別部103の判別結果に基づき制御信号の内容を変更する。

The

最も簡単な例では、得られた画像や顔領域を単純に記録する撮影装置において、非生体と判別したときには出力手段から画像出力を行なわないように出力を制御することが可能となる。同様に、音声出力やメッセージの表示が行なえる機器を接続して、生体であることを判別したときには挨拶の音声メッセージなどを出力する一方で、非生体と判別したときには反応をさせないように制御することも可能である。その逆に、非生体の場合にはアラームをならしてもよい。この場合、生体判別装置を内蔵した機器そのもので音声やメッセージ出力をする以外にも、ネットワークなどで接続された遠隔地の機器への音声やメッセージ表示といったことも実現可能である。 In the simplest example, in an imaging device that simply records the obtained image or face area, it is possible to control the output so that no image is output from the output means when it is determined that the image is non-living. Similarly, a device capable of outputting voice and displaying a message is connected, and when it is determined that it is a living body, a greeting voice message is output, while when it is determined that it is a non-living body, it is controlled not to react. It is also possible. Conversely, an alarm may be generated in the case of a non-living body. In this case, in addition to outputting voice and messages with the device itself incorporating the biometric discrimination device, it is also possible to realize voice and message display to a remote device connected via a network or the like.

また、接続された機器を制御する信号を出力するといったことも行なえるようにすることができることは明らかである。たとえば、所定の条件を満たす顔画像が入力されたら通行を許可する通行制御装置などの場合、非生体と判断した場合には通行制御装置への出力そのものを行なわなくすることで、生体情報が正しく入力されたときのみ通行許可するといったことが可能となる。 Obviously, it is also possible to output a signal for controlling the connected device. For example, in the case of a traffic control device that permits passage when a face image that satisfies a predetermined condition is input, if it is determined that the face image is non-living, the biometric information is correctly output by not performing output to the traffic control device itself. It is possible to allow traffic only when input.

また、生体判別手段を組込まれたプログラムの場合には、出力制御部104の出力結果は所定の処理を行なうか行なわないか制御させることに相当し、プログラムで管理された所定のデータへのアクセスを許可するかしないかといった切換えも可能となる。

Further, in the case of a program incorporating a living body discrimination means, the output result of the

また、図6に示すようなテーブルデータに基づき生体判別部104の判別結果にあわせて曜日や時間ごとに動作を変更するようなことも設定可能であり、たとえば、非生体による撮影が平日の昼間に行なわれたときには履歴には記録するが直ぐには警報や通知は行なわず、何度も繰り返すようであれば警報を行なって管理者に通知する。一方で、人通りの少なくなる夜間や休日は直ぐに警報を行なって通知するなどと切換えて管理するといった、前述の実施の形態の複合した装置の実現も容易に可能となる。

Further, it is possible to set the operation to be changed for each day of the week or time according to the determination result of the

以上説明したように第1の実施の形態によれば、人物の生体情報を撮影して得られる特徴情報や状態を利用する装置において、利用者に対して特殊な生体反応や操作を要求することなく、写真、絵、映像表示機器などが撮影範囲内に存在した場合でも、誤動作や誤判別などをせずに所望の制御を行なうことができる。 As described above, according to the first embodiment, a special biological reaction or operation is requested from a user in an apparatus that uses characteristic information or a state obtained by photographing biological information of a person. In addition, even when a photograph, a picture, a video display device, or the like exists within the shooting range, desired control can be performed without malfunction or misjudgment.

次に、第2の実施の形態について説明する。

以下の説明では、撮影対象(生体情報を取得する対象物)を人物の顔としてカメラにより画像入力し、顔の領域を検出して撮影対象が本当の人物(生体)であるか人物以外の物体(非生体)であるかを判別することによって、接続される機器への制御信号を変更する生体判別装置を例として述べるが、本発明は対象物が人物の顔に限定されるものでなく、さまざまな生体情報を含む画像を入力して生体判別を行なうものに適用でき、たとえば、虹彩情報、網膜情報、手や指の静脈情報、目や口の状態などを用いた生体判別にも適用可能である。なお、指紋情報については、画像取得手段として光学式センサを用いた場合には、本実施の形態により生体判別を行なうことが可能となる。

Next, a second embodiment will be described.

In the following description, an image is input by a camera as a person to be imaged (object from which biometric information is acquired), a face area is detected, and the object to be imaged is a real person (living body) or an object other than a person An example of a biological discrimination device that changes a control signal to a connected device by determining whether it is (non-living), but the present invention is not limited to a human face, It can be applied to those that perform biometric discrimination by inputting images containing various biometric information. For example, it can also be applied to biometric discrimination using iris information, retinal information, vein information of hands and fingers, eye and mouth status, etc. It is. For fingerprint information, when an optical sensor is used as an image acquisition unit, biometric discrimination can be performed according to the present embodiment.

図7は、第2の実施の形態に係る生体判別装置の構成を概略的に示すものである。この生体判別装置は、撮影対象となる人物(以下、撮影対象、対象物ともいう)Mの顔画像(少なくとも顔を含んでいる画像)を撮影して入力する画像取得手段としてのカメラ201、カメラ201から得られた人物の顔画像から顔および目、鼻などの顔部位の位置を検出する生体検出手段としての顔検出部202、顔検出部202により検出された顔領域の画像特徴により撮影対象Mが本当の生体によるものか写真や絵などの印刷物や映像表示機器によるものであるかを判別する生体判別手段としての生体判別部203、カメラ201により撮影されている人物Mの顔画像や顔検出部202により検出された顔領域の検出結果、生体判別部203の判別結果に応じて、接続される機器や動作している出力信号やプログラムの制御手段を変更する出力制御手段としての出力制御部204から構成されている。

FIG. 7 schematically shows a configuration of a living body discrimination apparatus according to the second embodiment. The biometric discrimination device includes a

なお、カメラ201、顔検出部202、出力制御部204は、前述した第1の実施の形態におけるそれと同一であるため説明は省略し、第1の実施の形態と異なる生体判別部203について説明する。

Since the

生体判別部203は、生体情報が存在する領域以外に動きや枠、背景画像の変動、奥行きを遮るものといった人物以外の物体が存在することを検知して生体であるか非生体であるかを判別する。

The

まず、人物の生体領域以外に動きがあることを検知する手法から説明をする。本実施の形態では、生体領域として顔領域を検出していることから、顔領域から一定距離以上離れた位置に変動があった場合に非生体であると判別する。たとえば、図8(a),(b)に示すように、通常の人物が存在した場合で仮に人物が動かなければ、1フレーム前の画像と現在の入力画像との差はなく、それらの差分画像を求めることにより変動がないことが示される。また、仮に人物が動いた場合でも、人物領域付近でしか変動が起きないことを想定できる。 First, a method for detecting that there is a movement outside the human body region will be described. In the present embodiment, since the face area is detected as the living body area, it is determined that the body is non-living when there is a change in the position away from the face area by a certain distance or more. For example, as shown in FIGS. 8A and 8B, if a normal person exists and the person does not move, there is no difference between the image one frame before and the current input image, and the difference between them. Finding the image shows no variation. In addition, even if a person moves, it can be assumed that fluctuations occur only near the person area.

そこで、図8(c)に示すように、人物輪郭Cおよび顔領域Dの付近から所定の距離離れた位置を背景領域Eと設定し、その背景領域E内に差分画像で変動が存在した場合に非生体と判別する。変動量についても、所定値以上の輝度変化があった画素について総数を計算したり、連結領域の面積の大きさを計測したり、直線状に並んでいることを検出したりすることで、誤検知なく検知することも可能となる。顔領域については、顔検出部202で求められているため、顔領域の左領域、上領域、右領域は背景領域と設定することも可能であり、容易に背景領域の差分情報を検知可能である。たとえば、写真などを掲示している場合には、人物部分だけでなく背景領域にも変動が起きることが予想されるためである。

Therefore, as shown in FIG. 8C, when a position that is a predetermined distance away from the vicinity of the person outline C and the face area D is set as the background area E, and there is a variation in the difference image in the background area E Is determined to be non-living. Regarding the amount of variation, it is possible to calculate the total number of pixels that have changed in luminance by more than a predetermined value, measure the size of the area of the connected region, or detect that the pixels are arranged in a straight line. It is also possible to detect without detection. Since the face area is obtained by the

次に、別の手法として、顔検出部202で検出された生体領域から所定の距離離れ、かつ、通常は物体が存在しない背景領域において、当該生体領域の周辺に矩形状あるいは曲線や多角形などで当該生体領域を囲う物体を検出したときに非生体であると判別する。

Next, as another method, in a background area that is a predetermined distance away from the living body area detected by the

たとえば、図9(a)に示すような顔領域が存在する写真、あるいは、図9(b)に示すような手領域が存在する写真については、写真の縁と背景との差を検知することで、顔領域の周囲を囲う矩形F、あるいは、手領域の周囲を囲う矩形Gが検出可能となる。その検出手法としては、たとえば、ハフ変換による線分検出、ソベル(Sobel)フィルタによる直線成分強調画像に対する縦横それぞれの射影処理などで検出が可能であるが、他にも直線や閉曲線、多角形を検出する手法により生体領域を囲う形状を検出する手法であれば、同様のことが実現可能である。 For example, for a photo with a face region as shown in FIG. 9A or a photo with a hand region as shown in FIG. 9B, the difference between the edge of the photo and the background is detected. Thus, the rectangle F surrounding the face area or the rectangle G surrounding the hand area can be detected. As the detection method, for example, line segment detection by Hough transform, vertical and horizontal projection processing for a linear component emphasized image by a Sobel filter can be detected, but other straight lines, closed curves, and polygons can be used. The same can be realized as long as the shape surrounding the living body region is detected by the detection method.

次に、さらに別の手法として、あらかじめ人物Mが存在しない状態で撮像した画像を背景画像として保存しておき、入力された画像との差分画像を求め、顔検出部202で検出された生体領域から所定の距離離れた背景領域において、背景画像と所定値以上の輝度変化がある画素が一定数以上または所定の形状で検出された場合に非生体であると判別する。

Next, as yet another method, an image captured in a state where the person M does not exist is stored as a background image in advance, a difference image from the input image is obtained, and the biological region detected by the

たとえば、図10に示すように、図10(a)の人物不在時画像に対して人物存在時には図10(b)のような差分画像となり、斜線で示す範囲Hが背景領域との変化領域となる。ここでは顔領域が検出されているため、顔領域から所定の距離だけ離れた左、上、右の領域は背景領域であり、人物不在時の画像との変化が存在しないはずである。 For example, as shown in FIG. 10, when a person is present, the difference image as shown in FIG. 10B is obtained with respect to the image when no person is present in FIG. 10A, and a hatched range H is a change area from the background area. Become. Since the face area is detected here, the left, top, and right areas that are separated from the face area by a predetermined distance are the background areas, and there should be no change from the image when no person is present.

同様に、虹彩や網膜などのように、顔の部位を利用するものであれば、広角に人物の顔画像を撮影することで同様の比較ができ、手の静脈パターンについては図10(c)の差分画像のような手の形状が抽出可能となる。しかし、図10(d)のようになんらかの印刷物や映像表示機器を掲示された場合には、人物の形状と異なる差分画像になるため、背景領域にも変化が生じる。この領域の画素をチェックすることで、生体であるか非生体であるかを判別することができる。 Similarly, if a facial part such as an iris or retina is used, a similar comparison can be made by photographing a human face image at a wide angle, and the vein pattern of the hand is shown in FIG. It is possible to extract a hand shape such as a difference image. However, when any printed matter or video display device is posted as shown in FIG. 10D, the difference image is different from the shape of the person, and the background region also changes. By checking the pixels in this area, it is possible to determine whether it is a living body or a non-living body.

また、生体判別部203において、画像情報だけでなく距離センサを併用することも可能である。第2の実施の形態に距離計測手段としての距離センサ205を追加した場合の生体判別装置を例として説明し、その構成図を図11に示す。

Further, in the

距離センサ205は、通常人物が立った場合に人物が背景を遮らない位置、すなわち、たとえば、図12に示すように、顔検出部202で検出された顔領域から所定の距離離れ、かつ、通常は物体が存在しない領域に相当する位置K1,K2,K3を測定対象としており、少なくとも1つ以上(この例の場合、3つ)設置する。

The

生体判別部203では、人物が存在しない状態で計測した各距離計測値と、人物が存在した状態で計測した各距離計測値とを比較し、両距離計測値に所定値以上の差があったときに非生体であると判別する。距離の計測箇所としては、入力画像中の左上部(K1)や右上部(K3)、その中間部(K2)などが最も簡単に計測できる。

The

以上説明したように第2の実施の形態によれば、人物の生体情報を撮影して得られる特徴情報や状態を利用する装置において、利用者に対して特殊な生体反応や操作を要求することなく、写真、絵、映像表示機器などが撮影範囲内に存在した場合でも、誤動作や誤判別などをせずに所望の制御を行なうことができる。 As described above, according to the second embodiment, a special biological reaction or operation is requested from a user in an apparatus that uses feature information or a state obtained by photographing biological information of a person. In addition, even when a photograph, a picture, a video display device, or the like exists within the shooting range, desired control can be performed without malfunction or misjudgment.

次に、第3の実施の形態について説明する。

以下の説明では、撮影対象(生体情報を取得する対象物)を人物の顔としてカメラにより画像入力し、顔の領域を検出して撮影対象が本当の人物(生体)であるか人物以外の物体(非生体)であるかを判別することによって、接続される機器への制御信号を変更する生体判別装置を例として述べるが、本発明は対象物が人物の顔に限定されるものでなく、さまざまな生体情報を含む画像を入力して生体判別を行なうものに適用でき、たとえば、虹彩情報、網膜情報、目や口の状態については顔領域までを含めた広角画像を取得することで適用可能であり、手や指の静脈情報を用いた場合では、画像取得手段として静電容量式の接触センサを用いた場合は適用困難であるが、画像取得手段として光学式センサやカメラによる非接触式を用いた場合には、本実施の形態により生体判別を行なうことが可能となる。

Next, a third embodiment will be described.

In the following description, an image is input by a camera as a person to be imaged (object from which biometric information is acquired), a face area is detected, and the object to be imaged is a real person (living body) or an object other than a person An example of a biological discrimination device that changes a control signal to a connected device by determining whether it is (non-living), but the present invention is not limited to a human face, It can be applied to those that perform biometric discrimination by inputting images containing various biological information. For example, iris information, retinal information, and eye and mouth states can be applied by acquiring a wide-angle image including the face area. In the case of using hand or finger vein information, it is difficult to apply when a capacitive contact sensor is used as the image acquisition means, but a non-contact type using an optical sensor or camera as the image acquisition means. When using The, it is possible to perform biometric determination by this embodiment.

図13は、第3の実施の形態に係る生体判別装置の構成を概略的に示すものである。この生体判別装置は、撮影対象となる人物(以下、撮影対象、対象物ともいう)Mの顔画像(少なくとも顔を含んでいる画像)を撮影して入力する画像取得手段としてのカメラ301、カメラ301から得られた人物の顔画像から顔および目、鼻などの顔部位の位置を検出する生体検出手段としての顔検出部302、顔検出部302により検出された顔領域の画像特徴により撮影対象Mが本当の生体によるものか写真や絵などの印刷物や映像表示機器によるものであるかを判別する生体判別手段としての生体判別部303、カメラ301により撮影されている人物Mの顔画像や顔検出部302により検出された顔領域の検出結果、生体判別部303の判別結果に応じて、接続される機器や動作している出力信号やプログラムの制御手段を変更する出力制御手段としての出力制御部304、生体領域に向けて照明光を照射することが可能な照明手段としての照明部305から構成されている。

FIG. 13 schematically shows the configuration of the living body discrimination apparatus according to the third embodiment. This living body discrimination apparatus includes a

なお、カメラ301、顔検出部302、出力制御部304は、前述した第1の実施の形態におけるそれと同一であるため説明は省略し、第1の実施の形態と異なる照明部305および生体判別部203について説明する。

Since the

照明部305は、撮影対象となる人物Mの顔部分に向けて照明光を照射する照明装置で構成されており、たとえば、通常の白熱灯や蛍光灯、冷陰極管、LED照明灯など各種照明装置で実現が可能である。また、撮影対象としている生体に応じては、可視光ではなく近赤外光であったり遠赤外光であってもよく、撮影側でその照明光による差がわかるように撮影が可能な組合わせであればかまわない。

The

また、照明部305は、消灯、点灯が任意のタイミングで切換えられるものとし、後述する生体判別部303によって制御しながら消灯した状態での画像をカメラ301により取得するとともに点灯した状態でも再度画像を取得できるよう制御されるものとする。

The

生体判別部303は、上述のように照明部305を制御して照明光を照射をした画像と照明光を照射しない画像をそれぞれ取得するようにする。照明光が照射された対象物Mが人物や手などといった生体であった場合、自ら発光する物体ではないことから、照明光のオン、オフにより生体領域の平均輝度が所定の値以上変化するはずである。

The living

たとえば、本実施の形態で説明しているように、顔の画像であれば、図14(a)に示す画像が照明光照射時で、図14(b)に示す画像が照明光未照射時となり、照明光未照射時の顔領域が暗くなることがわかる。一方で、CRT表示器や液晶表示器といった自らが発光する映像表示機器が撮像範囲内に存在した場合には、照明光の変化にそれほど影響を受けず、照明光がオフされた状態でも所定の輝度をもった映像が表示されるため、照明光照射時とそうでないときの顔領域における輝度の差が小さくなる。図14の(c),(d)に輝度の変化が少なくなっている画像例を示している。 For example, as described in this embodiment, in the case of a face image, the image shown in FIG. 14A is when illumination light is irradiated, and the image shown in FIG. 14B is when illumination light is not irradiated. Thus, it can be seen that the face area when the illumination light is not irradiated becomes dark. On the other hand, when an image display device that emits light such as a CRT display or a liquid crystal display is present in the imaging range, the image display device is not significantly affected by the change in illumination light, and the predetermined display even when the illumination light is turned off. Since an image with luminance is displayed, the difference in luminance in the face area between when illumination light is irradiated and when it is not is reduced. FIGS. 14C and 14D show examples of images in which the change in luminance is small.

このように、照明光の照射時と未照射時の顔領域の輝度差が所定値未満であったときに撮像対象Mが非生体であると判別することができる。なお、対象物が顔の部位であった場合にも顔の部位周辺を広角に撮像することで実現可能であり、対象物が手であっても適用可能なのは明らかである。 In this way, it is possible to determine that the imaging target M is non-living when the brightness difference between the face area when irradiated with illumination light and when it is not irradiated is less than a predetermined value. It should be noted that even when the target object is a facial part, it can be realized by imaging the periphery of the facial part at a wide angle, and it is clear that the present invention can be applied even if the target object is a hand.

以上説明したように第3の実施の形態によれば、人物の生体情報を撮影して得られる特徴情報や状態を利用する装置において、利用者に対して特殊な生体反応や操作を要求することなく、写真、絵、映像表示機器などが撮影範囲内に存在した場合でも、誤動作や誤判別などをせずに所望の制御を行なうことができる。 As described above, according to the third embodiment, a special biological reaction or operation is requested from a user in an apparatus that uses characteristic information or a state obtained by photographing biological information of a person. In addition, even when a photograph, a picture, a video display device, or the like exists within the shooting range, desired control can be performed without malfunction or misjudgment.

次に、第4の実施の形態について説明する。

以下の説明では、撮影対象(生体情報を取得する対象物)を人物の顔としてカメラにより画像入力し、顔の領域を検出して撮影対象が本当の人物(生体)であるか人物以外の物体(非生体)であるかを判別することによって、接続される機器への制御信号を変更する生体判別装置を例として述べるが、本発明は対象物が人物の顔に限定されるものでなく、さまざまな生体情報を含む画像を入力して生体判別を行なうものに適用でき、たとえば、虹彩情報、網膜情報、目や口の状態については顔領域までを含めた広角画像を取得することで適用可能であり、手や指の静脈情報を用いた場合では、画像取得手段として静電容量式の接触センサを用いた場合は適用困難であるが、画像取得手段として光学式センサやカメラによる非接触式を用いた場合には、本実施の形態により生体判別を行なうことが可能となる。

Next, a fourth embodiment will be described.

In the following description, an image is input by a camera as a person to be imaged (object from which biometric information is acquired), a face area is detected, and the object to be imaged is a real person (living body) or an object other than a person An example of a biological discrimination device that changes a control signal to a connected device by determining whether it is (non-living), but the present invention is not limited to a human face, It can be applied to those that perform biometric discrimination by inputting images containing various biological information. For example, iris information, retinal information, and eye and mouth states can be applied by acquiring a wide-angle image including the face area. In the case of using hand or finger vein information, it is difficult to apply when a capacitive contact sensor is used as the image acquisition means, but a non-contact type using an optical sensor or camera as the image acquisition means. When using The, it is possible to perform biometric determination by this embodiment.

図15は、第4の実施の形態に係る生体判別装置の構成を概略的に示すものである。この生体判別装置は、撮影対象となる人物(以下、撮影対象、対象物ともいう)Mの顔画像(少なくとも顔を含んでいる画像)を複数の方向から撮影して入力する画像取得手段としての複数のカメラ401、カメラ401から得られた人物の顔画像から顔および目、鼻などの顔部位の位置を検出する生体検出手段としての顔検出部402、顔検出部402により検出された顔領域の画像特徴により撮影対象Mが本当の生体によるものか写真や絵などの印刷物や映像表示機器によるものであるかを判別する生体判別手段としての生体判別部403、カメラ401により撮影されている人物Mの顔画像や顔検出部402により検出された顔領域の検出結果、生体判別部403の判別結果に応じて、接続される機器や動作している出力信号やプログラムの制御手段を変更する出力制御手段としての出力制御部404から構成されている。

FIG. 15 schematically shows a configuration of a living body discrimination apparatus according to the fourth embodiment. This living body discrimination device is an image acquisition unit that captures and inputs a face image (an image including at least a face) of a person (hereinafter also referred to as a shooting target or an object) M to be shot from a plurality of directions. A plurality of

なお、顔検出部402および出力制御部404は、前述した第1の実施の形態におけるそれと同一であるため説明は省略し、第1の実施の形態と異なるカメラ401および生体判別部403について説明する。

Note that the

カメラ401は、たとえば、図16(a)に示すように、2つのカメラ401a,401bからなり、カメラ401aは人物Mの正面から顔画像を撮像する位置に設置され、カメラ401bは正面以外の向きで人物Mを撮影する位置、すなわち、人物Mの上方から人物Mの頭部を見下ろす角度に設置される。このようにカメラ401a,401bを設置することにより、人物Mの正面の顔画像と上部からの人物像を撮影することができる。

For example, as shown in FIG. 16A, the

なお、カメラ401a,401bの設置方向は、図16(a)の向きに限らず人物Mの正面以外のカメラ401bは人物Mの横方向や下方向など正面以外の角度に設置することが可能である。

The installation directions of the

さらに、たとえば、図16(b)に示すように、カメラ401bを人物Mの前方でカメラ401aの上部に設置するとともに、カメラ401bと相対向する人物Mの上部に平面状のミラー405を所定の角度で設置することにより、人物Mの違う角度からの画像を得ることができる。この場合、カメラ401a,401bを含めた生体判別装置400は壁面に設置するだけでよく、ミラー405を任意の場所に設置することができ、設置が容易となる。

Further, for example, as shown in FIG. 16 (b), the

また、たとえば、図16(c)に示すように、ミラーを曲面状のミラー406にすることによって、できるかぎり多くの方向からの人物像を撮影することが可能である。本実施の形態では上から下を見下ろす角度に設置した例で説明を続ける。

Further, for example, as shown in FIG. 16C, by using a

なお、撮影対象となる生体がの顔以外の場合、たとえば虹彩や網膜、目や口の場合には、広角に画像を撮像できるようにすることで、顔の場合と同様の画像で処理ができる。また、指紋の場合には光学式センサを複数設置すること、手の静脈パターンであれば手を複数の方向から撮影することで同様のことが実現可能である。 In addition, when the living body to be imaged is other than a face, for example, in the case of an iris, retina, eyes, or mouth, processing can be performed with an image similar to that for a face by enabling an image to be captured at a wide angle. . In the case of a fingerprint, the same can be realized by installing a plurality of optical sensors, and in the case of a hand vein pattern, the hand can be photographed from a plurality of directions.

生体判別部406は、前述の複数の角度で得られた人物画像から撮影対象Mが生体であるか非生体であるかを判別する。たとえば、複数の角度で得られた各画像において、あらかじめ求めておいた人物が不在時の画像との差分画像を作成し、それを縦方向および横方向にそれぞれ射影値をとった結果を比較することによって実現が可能である。

The living

図16(a)のように、人物Mの正面にカメラ401a、上部から見下ろす角度にカメラ401bが設置されている場合、カメラ401aからの画像に対し図17(a)に示すような生体領域の形状に合わせた縦方向の背景差分射影値P11および横方向の背景差分射影値P12が得られ、カメラ401bからの画像に対し図17(a)に示すような生体領域の形状に合わせた縦方向の背景差分射影値P21および横方向の背景差分射影値P22が得られる。

As shown in FIG. 16A, when the

一方、印刷物などをかざしている場合には、カメラ401aからの画像に対し図18(a)に示すような縦方向の背景差分射影値P31および横方向の背景差分射影値P32が得られ、カメラ401bからの画像に対し図18(a)に示すような縦方向の背景差分射影値P41および横方向の背景差分射影値P42が得られる。これらの図からも明らかなように、図17の生体領域の射影値とは大きく異なる値となり、この射影値の最大値、最小値、平均値、分散値、面積値などの指標を比較することで生体か非生体かを判別することが可能である。

On the other hand, when holding a printed matter or the like, a vertical background differential projection value P31 and a horizontal background differential projection value P32 as shown in FIG. 18A are obtained for the image from the

これ以外にも、それぞれ人物の顔を検出するパターンを正面向きから、頭頂からの人物パターンを事前に学習により求めておいて、いずれの画像からも人物パターンが検出された場合だけ生体と判別するといった方法でも実現可能である。同様に、手の領域については、正面と上でなく、正面と横から撮影する場合を例にとると、カメラ401aからの画像に対し図19(a)に示すような縦方向の背景差分射影値P51および横方向の背景差分射影値P52が得られ、カメラ401bからの画像に対し図19(a)に示すような縦方向の背景差分射影値P61および横方向の背景差分射影値P62が得られるため、同様に印刷物や映像表示機器などとの区別が実現可能となる。

In addition to this, a pattern for detecting a person's face is determined from the front direction, and a person pattern from the top of the head is obtained by learning in advance, and only when a person pattern is detected from any image, it is determined as a living body. This method can also be realized. Similarly, with respect to the hand region, taking the case of shooting from the front and side instead of the front and top, for example, the vertical background differential projection as shown in FIG. 19A with respect to the image from the

以上説明したように第4の実施の形態によれば、人物の生体情報を撮影して得られる特徴情報や状態を利用する装置において、利用者に対して特殊な生体反応や操作を要求することなく、写真、絵、映像表示機器などが撮影範囲内に存在した場合でも、誤動作や誤判別などをせずに所望の制御を行なうことができる。 As described above, according to the fourth embodiment, a special biological reaction or operation is requested from a user in an apparatus that uses characteristic information or a state obtained by photographing biological information of a person. In addition, even when a photograph, a picture, a video display device, or the like exists within the shooting range, desired control can be performed without malfunction or misjudgment.

M…撮影対象、人物、対象物、101,201,301,401,401a,401b…カメラ(画像取得手段)、102,202,302,402…顔検出部(生体検出手段)、103,203,303,403…生体判別部(生体判別手段)、104,204,304,404…出力制御部(出力制御手段)、105,205…距離計測部(距離計測手段)、305…照明部(照明手段)。

M ... Shooting target, person,

Claims (17)

対象物の生体情報を含む画像を取得する画像取得手段と、

この画像取得手段により取得された画像から生体領域を検出する生体検出手段と、

この生体検出手段により検出された生体領域の画像特徴を、あらかじめ求められた正常な対象物が所定の位置に存在したときに得られる生体領域の画像特徴と比較し、両画像特徴の間に所定値以上の差があると判断したときに当該対象物は非生体であると判別する生体判別手段と、

この生体判別手段の判別結果に基づき、出力先として接続された機器に対して出力する内容を変化させる出力制御手段と、

を具備したことを特徴とする生体判別装置。 A biological discrimination device for discriminating whether an object for acquiring biological information is a living body or a non-living body,

Image acquisition means for acquiring an image including biological information of the object;

A living body detecting means for detecting a living body region from the image acquired by the image acquiring means;

The image feature of the living body region detected by the living body detection means is compared with the image feature of the living body region obtained when a normal object obtained in advance is present at a predetermined position, A living body discriminating means for discriminating that the object is non-living when it is determined that there is a difference greater than

Based on the determination result of this biological determination means, output control means for changing the content to be output to the device connected as the output destination;

A living body discrimination device characterized by comprising:

対象物の生体情報を含む画像を取得する画像取得手段と、

この画像取得手段により取得された画像から生体領域を検出する生体検出手段と、

前記画像取得手段から対象物までの距離を計測する距離計測手段と、

前記生体検出手段により検出された生体領域の画像特徴と前記距離計測手段により計測された距離との関係を、あらかじめ求められた正常な対象物から得られる生体領域の画像特徴と正常な対象物が所定の位置に存在したときに得られる当該対象物と前記画像取得手段との距離との関係と比較し、両関係の間に所定値以上の差があると判断したときに当該対象物は非生体であると判別する生体判別手段と、

この生体判別手段の判別結果に基づき、出力先として接続された機器に対して出力する内容を変化させる出力制御手段と、

を具備したことを特徴とする生体判別装置。 A biological discrimination device for discriminating whether an object for acquiring biological information is a living body or a non-living body,

Image acquisition means for acquiring an image including biological information of the object;

A living body detecting means for detecting a living body region from the image acquired by the image acquiring means;

Distance measuring means for measuring the distance from the image acquisition means to the object;

The relationship between the image feature of the living body area detected by the living body detecting means and the distance measured by the distance measuring means is the relationship between the image feature of the living body area obtained from the normal object obtained in advance and the normal object. Compared with the relationship between the object obtained when present at a predetermined position and the distance between the image acquisition means, and when it is determined that there is a difference greater than a predetermined value between the two objects, the object is not A living body discriminating means for discriminating that it is a living body,

Based on the determination result of this biological determination means, output control means for changing the content to be output to the device connected as the output destination;

A living body discrimination device characterized by comprising:

対象物の生体情報を含む画像を取得する画像取得手段と、

この画像取得手段により取得された画像から生体領域を検出する生体検出手段と、

前記画像取得手段により取得された画像内において、前記生体検出手段により検出された生体領域以外の領域に生体以外の物体が存在するか否かを検知し、生体以外の物体の存在を検知したときに当該対象物は非生体であると判別する生体判別手段と、

この生体判別手段の判別結果に基づき、出力先として接続された機器に対して出力する内容を変化させる出力制御手段と、

を具備したことを特徴とする生体判別装置。 A biological discrimination device for discriminating whether an object for acquiring biological information is a living body or a non-living body,

Image acquisition means for acquiring an image including biological information of the object;

A living body detecting means for detecting a living body region from the image acquired by the image acquiring means;

When it is detected whether an object other than a living body exists in an area other than the living body area detected by the living body detecting means in the image acquired by the image acquiring means, and the presence of an object other than the living body is detected And a living body discriminating means for discriminating that the object is non-living,

Based on the determination result of this biological determination means, output control means for changing the content to be output to the device connected as the output destination;

A living body discrimination device characterized by comprising:

対象物の生体情報を含む画像を取得する画像取得手段と、

この画像取得手段により取得された画像から生体領域を検出する生体検出手段と、

前記画像取得手段により取得された画像とあらかじめ対象物が存在しない状態で取得した画像との差分画像を求めることにより、前記生体検出手段により検出された生体領域から所定の距離離れた位置において、所定値以上の輝度の変化がある領域が所定数以上あるいは所定の形状で検出された場合に当該対象物は非生体であると判別する生体判別手段と、

この生体判別手段の判別結果に基づき、出力先として接続された機器に対して出力する内容を変化させる出力制御手段と、

を具備したことを特徴とする生体判別装置。 A biological discrimination device for discriminating whether an object for acquiring biological information is a living body or a non-living body,

Image acquisition means for acquiring an image including biological information of the object;

A living body detecting means for detecting a living body region from the image acquired by the image acquiring means;

By obtaining a difference image between an image acquired by the image acquisition unit and an image acquired in advance in the absence of an object, a predetermined distance from the biological region detected by the biological detection unit is determined. A living body discriminating means for discriminating that the object is non-living when an area having a luminance change of more than a value is detected in a predetermined number or more or in a predetermined shape;

Based on the determination result of this biological determination means, output control means for changing the content to be output to the device connected as the output destination;

A living body discrimination device characterized by comprising:

対象物の生体情報を含む画像を取得する画像取得手段と、

この画像取得手段により取得された画像から生体領域を検出する生体検出手段と、

この生体検出手段により検出された生体領域から所定の距離離れ、かつ、通常は対象物が存在しない領域に相当する位置を計測対象とする距離計測手段と、

この距離計測手段により対象物が存在しない状態で計測された距離と対象物が存在した状態で計測された距離とを比較し、両距離の間に所定値以上の差があるときに当該対象物は非生体であると判別する生体判別手段と、

この生体判別手段の判別結果に基づき、出力先として接続された機器に対して出力する内容を変化させる出力制御手段と、

を具備したことを特徴とする生体判別装置。 A biological discrimination device for discriminating whether an object for acquiring biological information is a living body or a non-living body,

Image acquisition means for acquiring an image including biological information of the object;

A living body detecting means for detecting a living body region from the image acquired by the image acquiring means;

A distance measuring unit that is a predetermined distance away from the living body region detected by the living body detecting unit, and that normally corresponds to a region where no object exists,

The distance measured by the distance measuring means in the absence of the object is compared with the distance measured in the presence of the object, and when there is a difference of a predetermined value or more between the distances, the object Is a living body discriminating means for discriminating that it is non-living,

Based on the determination result of this biological determination means, output control means for changing the content to be output to the device connected as the output destination;

A living body discrimination device characterized by comprising:

対象物の生体情報を含む画像を撮影して取得する画像取得手段と、

この画像取得手段による撮影時に対象物に対し照明光を照射する照明手段と、

前記画像取得手段により取得された画像から生体領域を検出する生体検出手段と、

前記画像取得手段により前記照明手段で照明光を照射した状態で取得した画像および前記照明手段で照明光を照射しない状態で取得した画像に対し、前記生体検出手段により検出された生体領域における輝度分布をそれぞれ求め、この求めた両輝度分布の差が所定値未満であったときに当該対象物は非生体であると判別する生体判別手段と、

この生体判別手段の判別結果に基づき、出力先として接続された機器に対して出力する内容を変化させる出力制御手段と、

を具備したことを特徴とする生体判別装置。 A biological discrimination device for discriminating whether an object for acquiring biological information is a living body or a non-living body,

Image acquisition means for capturing and acquiring an image including biological information of the object;

Illuminating means for irradiating the object with illumination light during photographing by the image obtaining means;

A living body detecting means for detecting a living body region from the image acquired by the image acquiring means;

Luminance distribution in a living body region detected by the living body detecting unit with respect to an image acquired by the image acquiring unit in a state in which illumination light is irradiated by the illuminating unit and an image acquired in a state in which illumination light is not irradiated by the illuminating unit. A living body discriminating means for discriminating that the object is non-living when the difference between the obtained luminance distributions is less than a predetermined value;

Based on the determination result of this biological determination means, output control means for changing the content to be output to the device connected as the output destination;

A living body discrimination device characterized by comprising:

対象物の生体情報を含む画像を複数の方向から取得する画像取得手段と、

この画像取得手段により取得された複数の画像からそれぞれ生体領域を検出する生体検出手段と、

この生体検出手段により、前記画像取得手段により取得された複数の画像すべてから生体領域が検出されたか否か、あるいは、検出された生体領域の形状が所定の形状であるか否かを確認し、複数の画像すべてから生体領域が検出されたこと、あるいは、検出された生体領域の形状が所定の形状であることが確認されたときだけ当該対象物は生体であると判別し、それ以外の場合には当該対象物は非生体であると判別する生体判別手段と、

この生体判別手段の判別結果に基づき、出力先として接続された機器に対して出力する内容を変化させる出力制御手段と、

を具備したことを特徴とする生体判別装置。 A biological discrimination device for discriminating whether an object for acquiring biological information is a living body or a non-living body,

Image acquisition means for acquiring an image including biological information of an object from a plurality of directions;

A living body detecting means for detecting a living body region from each of the plurality of images acquired by the image acquiring means;

By this living body detection means, it is confirmed whether or not the living body area has been detected from all of the plurality of images acquired by the image acquiring means, or whether or not the shape of the detected living body area is a predetermined shape, It is determined that the target object is a living body only when the living body area is detected from all of a plurality of images, or when the shape of the detected living body area is confirmed to be a predetermined shape. A biological discrimination means for discriminating that the object is non-living,

Based on the determination result of this biological determination means, output control means for changing the content to be output to the device connected as the output destination;

A living body discrimination device characterized by comprising:

Priority Applications (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2004287237A JP2006099614A (en) | 2004-09-30 | 2004-09-30 | Living body discrimination apparatus and living body discrimination method |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2004287237A JP2006099614A (en) | 2004-09-30 | 2004-09-30 | Living body discrimination apparatus and living body discrimination method |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| JP2006099614A true JP2006099614A (en) | 2006-04-13 |

| JP2006099614A5 JP2006099614A5 (en) | 2007-11-15 |

Family

ID=36239330

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2004287237A Pending JP2006099614A (en) | 2004-09-30 | 2004-09-30 | Living body discrimination apparatus and living body discrimination method |

Country Status (1)

| Country | Link |

|---|---|

| JP (1) | JP2006099614A (en) |

Cited By (26)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2006259923A (en) * | 2005-03-15 | 2006-09-28 | Omron Corp | Object authentication device, face authentication device, cellular phone, object authentication unit, object authentication method, and object authentication program |

| JP2007280367A (en) * | 2006-03-14 | 2007-10-25 | Omron Corp | Face matching device |

| JP2008090452A (en) * | 2006-09-29 | 2008-04-17 | Omron Corp | Detection apparatus, method and program |

| JP2008262475A (en) * | 2007-04-13 | 2008-10-30 | Nec Saitama Ltd | Mobile terminal device, its authentication method, and program |

| JP2010225118A (en) * | 2009-03-25 | 2010-10-07 | Toshiba Corp | Image processing device, method and program |

| WO2012042631A1 (en) * | 2010-09-30 | 2012-04-05 | 富士通フロンテック株式会社 | Registration program, registration device, and registration method |

| JP2012113687A (en) * | 2010-11-26 | 2012-06-14 | Hyundai Motor Co Ltd | Method of authenticating driver's face in vehicle |

| KR101450247B1 (en) * | 2012-12-31 | 2014-10-15 | 기초과학연구원 | Method for authenticating based on finger vein using SIFT keypoint |

| JP2015082195A (en) * | 2013-10-22 | 2015-04-27 | 株式会社東芝 | Personal authentication system |

| JP2017027379A (en) * | 2015-07-23 | 2017-02-02 | 富士通株式会社 | Subject discrimination method, program, and subject discrimination apparatus |

| JP2017167667A (en) * | 2016-03-14 | 2017-09-21 | Kddi株式会社 | Living body detection method, living body detection device, and living body detection program |

| WO2019163065A1 (en) * | 2018-02-22 | 2019-08-29 | 日本電気株式会社 | Spoofing detector, spoofing detection method, and computer-readable recording medium |

| WO2019163066A1 (en) * | 2018-02-22 | 2019-08-29 | 日本電気株式会社 | Impersonation detection device, impersonation detection method, and computer-readable storage medium |

| JP2020502602A (en) * | 2016-09-30 | 2020-01-23 | アリババ・グループ・ホールディング・リミテッドAlibaba Group Holding Limited | Authentication based on face recognition |

| JP2020523665A (en) * | 2018-05-18 | 2020-08-06 | ベイジン センスタイム テクノロジー デベロップメント カンパニー, リミテッド | Biological detection method and device, electronic device, and storage medium |

| US10956714B2 (en) | 2018-05-18 | 2021-03-23 | Beijing Sensetime Technology Development Co., Ltd | Method and apparatus for detecting living body, electronic device, and storage medium |

| WO2021082562A1 (en) * | 2019-10-31 | 2021-05-06 | 上海商汤智能科技有限公司 | Spoofing detection method and apparatus, electronic device, storage medium and program product |

| CN112883758A (en) * | 2019-11-29 | 2021-06-01 | 杭州海康威视数字技术股份有限公司 | Living body detection method and device |

| CN113177437A (en) * | 2017-06-13 | 2021-07-27 | 阿里巴巴集团控股有限公司 | Face recognition method and device |

| JP2021144578A (en) * | 2020-03-13 | 2021-09-24 | マツダ株式会社 | Driver state estimation device |

| WO2022024739A1 (en) * | 2020-07-28 | 2022-02-03 | 株式会社サイバーウェア | Image determination method and image determination device |

| JP2022028850A (en) * | 2018-02-22 | 2022-02-16 | 日本電気株式会社 | Spoofing detection device, spoofing detection method, and program |

| JP2022031456A (en) * | 2018-02-22 | 2022-02-18 | 日本電気株式会社 | Impersonation detection device, impersonation detection method, and program |

| JP2022066540A (en) * | 2016-06-03 | 2022-04-28 | マジック リープ, インコーポレイテッド | Augmented reality identity verification |

| WO2022172430A1 (en) | 2021-02-15 | 2022-08-18 | 富士通株式会社 | Determination method, determination program, and information processing device |

| WO2023007586A1 (en) | 2021-07-27 | 2023-02-02 | 富士通株式会社 | Determination method, determination program, and information processing device |

Citations (5)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JPH11339048A (en) * | 1998-05-29 | 1999-12-10 | Omron Corp | Individual identifying device and method and recording medium for recording individual identification program |

| JP2001126091A (en) * | 1999-10-27 | 2001-05-11 | Toshiba Corp | Occupant face picture processing system and toll receiving system |

| JP2003178306A (en) * | 2001-12-12 | 2003-06-27 | Toshiba Corp | Personal identification device and personal identification method |

| JP2003242491A (en) * | 2002-02-14 | 2003-08-29 | Omron Corp | Image discriminating device and personal authentication device |

| JP2004192378A (en) * | 2002-12-12 | 2004-07-08 | Toshiba Corp | Face image processor and method therefor |

-

2004

- 2004-09-30 JP JP2004287237A patent/JP2006099614A/en active Pending

Patent Citations (5)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JPH11339048A (en) * | 1998-05-29 | 1999-12-10 | Omron Corp | Individual identifying device and method and recording medium for recording individual identification program |

| JP2001126091A (en) * | 1999-10-27 | 2001-05-11 | Toshiba Corp | Occupant face picture processing system and toll receiving system |

| JP2003178306A (en) * | 2001-12-12 | 2003-06-27 | Toshiba Corp | Personal identification device and personal identification method |

| JP2003242491A (en) * | 2002-02-14 | 2003-08-29 | Omron Corp | Image discriminating device and personal authentication device |

| JP2004192378A (en) * | 2002-12-12 | 2004-07-08 | Toshiba Corp | Face image processor and method therefor |

Cited By (43)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2006259923A (en) * | 2005-03-15 | 2006-09-28 | Omron Corp | Object authentication device, face authentication device, cellular phone, object authentication unit, object authentication method, and object authentication program |

| JP2007280367A (en) * | 2006-03-14 | 2007-10-25 | Omron Corp | Face matching device |

| JP2008090452A (en) * | 2006-09-29 | 2008-04-17 | Omron Corp | Detection apparatus, method and program |

| JP2008262475A (en) * | 2007-04-13 | 2008-10-30 | Nec Saitama Ltd | Mobile terminal device, its authentication method, and program |

| JP2010225118A (en) * | 2009-03-25 | 2010-10-07 | Toshiba Corp | Image processing device, method and program |

| WO2012042631A1 (en) * | 2010-09-30 | 2012-04-05 | 富士通フロンテック株式会社 | Registration program, registration device, and registration method |

| CN103003840A (en) * | 2010-09-30 | 2013-03-27 | 富士通先端科技株式会社 | Registration program, registration device, and registration method |

| JPWO2012042631A1 (en) * | 2010-09-30 | 2014-02-03 | 富士通フロンテック株式会社 | Registration program, registration apparatus, and registration method |

| JP2012113687A (en) * | 2010-11-26 | 2012-06-14 | Hyundai Motor Co Ltd | Method of authenticating driver's face in vehicle |

| KR101450247B1 (en) * | 2012-12-31 | 2014-10-15 | 기초과학연구원 | Method for authenticating based on finger vein using SIFT keypoint |

| JP2015082195A (en) * | 2013-10-22 | 2015-04-27 | 株式会社東芝 | Personal authentication system |

| US9817982B2 (en) | 2013-10-22 | 2017-11-14 | Kabushiki Kaisha Toshiba | Identity authentication system |

| JP2017027379A (en) * | 2015-07-23 | 2017-02-02 | 富士通株式会社 | Subject discrimination method, program, and subject discrimination apparatus |

| JP2017167667A (en) * | 2016-03-14 | 2017-09-21 | Kddi株式会社 | Living body detection method, living body detection device, and living body detection program |

| JP2022066540A (en) * | 2016-06-03 | 2022-04-28 | マジック リープ, インコーポレイテッド | Augmented reality identity verification |

| US11551482B2 (en) | 2016-09-30 | 2023-01-10 | Alibaba Group Holding Limited | Facial recognition-based authentication |

| JP2020502602A (en) * | 2016-09-30 | 2020-01-23 | アリババ・グループ・ホールディング・リミテッドAlibaba Group Holding Limited | Authentication based on face recognition |

| US10762368B2 (en) | 2016-09-30 | 2020-09-01 | Alibaba Group Holding Limited | Facial recognition-based authentication |

| US10997445B2 (en) | 2016-09-30 | 2021-05-04 | Alibaba Group Holding Limited | Facial recognition-based authentication |

| CN113177437A (en) * | 2017-06-13 | 2021-07-27 | 阿里巴巴集团控股有限公司 | Face recognition method and device |

| JPWO2019163066A1 (en) * | 2018-02-22 | 2021-02-18 | 日本電気株式会社 | Spoofing detection device, spoofing detection method, and program |

| JP7207506B2 (en) | 2018-02-22 | 2023-01-18 | 日本電気株式会社 | Spoofing detection device, spoofing detection method, and program |

| JPWO2019163065A1 (en) * | 2018-02-22 | 2021-01-07 | 日本電気株式会社 | Spoofing detection device, spoofing detection method, and program |

| US11694475B2 (en) | 2018-02-22 | 2023-07-04 | Nec Corporation | Spoofing detection apparatus, spoofing detection method, and computer-readable recording medium |

| US11620860B2 (en) | 2018-02-22 | 2023-04-04 | Nec Corporation | Spoofing detection apparatus, spoofing detection method, and computer-readable recording medium |

| WO2019163065A1 (en) * | 2018-02-22 | 2019-08-29 | 日本電気株式会社 | Spoofing detector, spoofing detection method, and computer-readable recording medium |

| WO2019163066A1 (en) * | 2018-02-22 | 2019-08-29 | 日本電気株式会社 | Impersonation detection device, impersonation detection method, and computer-readable storage medium |

| US11200436B2 (en) | 2018-02-22 | 2021-12-14 | Nec Corporation | Spoofing detection apparatus, spoofing detection method, and computer-readable recording medium |

| US11222221B2 (en) | 2018-02-22 | 2022-01-11 | Nec Corporation | Spoofing detection apparatus, spoofing detection method, and computer-readable recording medium |

| JP2022031456A (en) * | 2018-02-22 | 2022-02-18 | 日本電気株式会社 | Impersonation detection device, impersonation detection method, and program |

| JP2022028850A (en) * | 2018-02-22 | 2022-02-16 | 日本電気株式会社 | Spoofing detection device, spoofing detection method, and program |

| JP2020523665A (en) * | 2018-05-18 | 2020-08-06 | ベイジン センスタイム テクノロジー デベロップメント カンパニー, リミテッド | Biological detection method and device, electronic device, and storage medium |

| US10956714B2 (en) | 2018-05-18 | 2021-03-23 | Beijing Sensetime Technology Development Co., Ltd | Method and apparatus for detecting living body, electronic device, and storage medium |

| WO2021082562A1 (en) * | 2019-10-31 | 2021-05-06 | 上海商汤智能科技有限公司 | Spoofing detection method and apparatus, electronic device, storage medium and program product |

| CN112883758A (en) * | 2019-11-29 | 2021-06-01 | 杭州海康威视数字技术股份有限公司 | Living body detection method and device |

| CN112883758B (en) * | 2019-11-29 | 2023-08-25 | 杭州海康威视数字技术股份有限公司 | Living body detection method and device |

| JP2021144578A (en) * | 2020-03-13 | 2021-09-24 | マツダ株式会社 | Driver state estimation device |

| JP7441417B2 (en) | 2020-03-13 | 2024-03-01 | マツダ株式会社 | Driver state estimation device |

| JP2022024721A (en) * | 2020-07-28 | 2022-02-09 | 株式会社サイバーウェア | Image determination method and image determination device |

| WO2022024739A1 (en) * | 2020-07-28 | 2022-02-03 | 株式会社サイバーウェア | Image determination method and image determination device |

| WO2022172430A1 (en) | 2021-02-15 | 2022-08-18 | 富士通株式会社 | Determination method, determination program, and information processing device |

| JP7524980B2 (en) | 2021-02-15 | 2024-07-30 | 富士通株式会社 | Determination method, determination program, and information processing device |

| WO2023007586A1 (en) | 2021-07-27 | 2023-02-02 | 富士通株式会社 | Determination method, determination program, and information processing device |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP2006099614A (en) | Living body discrimination apparatus and living body discrimination method | |

| US9398848B2 (en) | Eye gaze tracking | |

| US7912252B2 (en) | Time-of-flight sensor-assisted iris capture system and method | |

| KR100580630B1 (en) | Person identification device and method using infrared ray | |

| EP2434427A2 (en) | Controlled access to functionality of a wireless device | |

| US8565495B2 (en) | Iris deblurring method based on global and local iris image statistics | |

| JP6984724B2 (en) | Spoofing detection device, spoofing detection method, and program | |

| JP5076563B2 (en) | Face matching device | |

| CN107949863A (en) | Use the authentication device and authentication method of Biont information | |

| JP4976156B2 (en) | Image identification method | |

| CN109074483A (en) | Multi-modal biological identification | |

| CN113557519A (en) | Information processing apparatus, information processing system, information processing method, and recording medium | |

| JP5254897B2 (en) | Hand image recognition device | |

| KR101635602B1 (en) | Method and apparatus for iris scanning | |

| JP2005287878A (en) | Biometric device, authentication device, and biometric method | |

| US20240314426A1 (en) | Electronic apparatus for obtaining biometric information of companion animal, and operation method thereof | |

| JP2020181305A (en) | Biodiscrimination device, biodiscrimination method, and personal authentication method | |

| JP2009080706A (en) | Personal authentication device | |

| JP2009205203A (en) | Iris authentication device | |

| KR100434370B1 (en) | Focusing distance measurement in iris recognition system | |

| JP2006318374A (en) | Glasses discrimination device, authentication device, and glasses discrimination method | |

| US11256939B2 (en) | Methods, systems and computer program products for eye based spoof detection | |

| TW528989B (en) | Method and apparatus for discriminating latent fingerprint in optical fingerprint input apparatus | |

| JP7207506B2 (en) | Spoofing detection device, spoofing detection method, and program | |

| KR102567390B1 (en) | Apparatus and Method for Recognizing Fake Iris By Detecting Movements of the Pupil of User's Eye |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A521 | Written amendment |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20070928 |

|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20070928 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20100518 |

|

| A02 | Decision of refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A02 Effective date: 20101012 |