JP2005294932A - Image processing method, image processing apparatus and image processing program - Google Patents

Image processing method, image processing apparatus and image processing program Download PDFInfo

- Publication number

- JP2005294932A JP2005294932A JP2004103069A JP2004103069A JP2005294932A JP 2005294932 A JP2005294932 A JP 2005294932A JP 2004103069 A JP2004103069 A JP 2004103069A JP 2004103069 A JP2004103069 A JP 2004103069A JP 2005294932 A JP2005294932 A JP 2005294932A

- Authority

- JP

- Japan

- Prior art keywords

- image processing

- parameter

- image

- input

- parameters

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Granted

Links

Images

Landscapes

- Apparatus For Radiation Diagnosis (AREA)

- Image Processing (AREA)

- Transforming Light Signals Into Electric Signals (AREA)

- Image Analysis (AREA)

Abstract

Description

本発明は放射線画像を処理する際の画像処理方法および画像処理装置ならびに画像処理プログラムに関し、さらに詳しくは、平易な操作によって診断等に適した放射線画像を得ることができる画像処理方法および画像処理装置ならびに画像処理プログラムに関する。 The present invention relates to an image processing method, an image processing apparatus, and an image processing program for processing a radiographic image, and more specifically, an image processing method and an image processing apparatus capable of obtaining a radiographic image suitable for diagnosis or the like by a simple operation. And an image processing program.

近年、放射線画像を直接デジタル画像として撮影できる装置が開発されている。たとえば、被写体に照射された放射線量を検出し、その検出量に対応して形成される放射線画像を電気信号として得る装置としては、輝尽性蛍光体を用いたディテクタを用いる方法が特開昭55-12429号公報、特開昭63-189853号公報など、多数開示されている。 In recent years, an apparatus capable of directly capturing a radiographic image as a digital image has been developed. For example, as a device for detecting a radiation dose applied to a subject and obtaining a radiographic image formed in accordance with the detected dose as an electrical signal, a method using a detector using a stimulable phosphor is disclosed in JP Many publications such as 55-12429 and JP 63-189853 are disclosed.

このような装置では、シート状の基板に輝尽性蛍光体を塗布、あるいは蒸着等によって固着したディテクタに、いったん被写体を透過した放射線を照射して輝尽性蛍光体に放射線を吸収させる。 In such an apparatus, a stimulable phosphor is applied to a sheet-like substrate or fixed to the detector by vapor deposition or the like, and once irradiated with radiation transmitted through the subject, the stimulable phosphor absorbs the radiation.

その後、この輝尽性蛍光体を光または熱エネルギ−で励起することにより、この輝尽性蛍光体が上記吸収によって蓄積している放射線エネルギ−を蛍光として放射させ、この蛍光を光電変換して画像信号を得るようにしている。 Thereafter, the stimulable phosphor is excited by light or heat energy, and the stimulating phosphor emits radiation energy accumulated by the absorption as fluorescence, and the fluorescence is photoelectrically converted. An image signal is obtained.

一方、照射された放射線の強度に応じた電荷を光導電層に生成し、生成された電荷を二次元的に配列された複数のコンデンサに蓄積し、それら蓄積された電荷を取り出すことにより得られる放射線画像検出装置が提案されている。 On the other hand, a charge corresponding to the intensity of irradiated radiation is generated in the photoconductive layer, the generated charge is accumulated in a plurality of capacitors arranged two-dimensionally, and the accumulated charges are taken out. A radiation image detection apparatus has been proposed.

このような放射線画像検出装置では、フラットパネルディテクタ(FPD)と呼ばれるものを使用している。この種のFPDは、特開平9-90048号公報に記載されているように、照射された放射線強度に応じた蛍光を発する蛍光体と、蛍光体から発する蛍光を直接または縮小光学系を介して受光して光電変換を行うフォトダイオードやCCDのような光電変換素子の組み合わせによって実現されるものが知られている。 Such a radiation image detection apparatus uses what is called a flat panel detector (FPD). As described in JP-A-9-90048, this type of FPD includes a phosphor that emits fluorescence corresponding to the intensity of irradiated radiation, and fluorescence emitted from the phosphor directly or through a reduction optical system. Known is a combination of a photodiode that receives light and performs photoelectric conversion, or a combination of photoelectric conversion elements such as a CCD.

また特開平6-342098号公報に記載されているように、照射された放射を直接電荷に変換するものも知られている。

これらの放射線画像検出装置では、取得した画像に対して、診断に適した画像となるよう、階調変換処理やエッジ強調処理などの画像処理を行うのが一般的である。

In addition, as described in Japanese Patent Laid-Open No. 6-342098, there is also known one that directly converts irradiated radiation into electric charges.

In these radiological image detection apparatuses, it is common to perform image processing such as gradation conversion processing and edge enhancement processing on an acquired image so that the image is suitable for diagnosis.

なお、このようにして得られた画像データに基づく放射線画像を表示したり出力する場合、撮影条件の変動を受けることなく見やすい放射線画像となるように画像処理が行われている。 Note that when displaying or outputting a radiographic image based on the image data obtained in this way, image processing is performed so that the radiographic image is easy to see without being subjected to fluctuations in imaging conditions.

このため、放射線画像の所望の領域内の画像データの累積ヒストグラムを求めたのち、この累積ヒストグラムが所定の割合となるデータレベルを基準信号値と設定して画像処理を行うことが、以下の特許文献1に記載されている。

Therefore, after obtaining a cumulative histogram of image data in a desired region of a radiographic image, image processing is performed by setting a data level at which the cumulative histogram is a predetermined ratio as a reference signal value. It is described in

また、高信号値領域と低信号値領域の分布状態に基づいて、画像処理条件を定めて、適切な画像処理を行うことが、以下の特許文献2に記載されている。

例えば、従来処理での胸部画像の画像処理条件は以下のように決定される。ここで例えば、閾値であるTr,Tlを決定するk1,k2を変更可能にすることで認識する胸郭の左右端の位置を調整することができる。また、例えば累積ヒストグラムから基準信号値を決定するための閾値であるm1,m2を変更可能にすることで検出する肺野内の信号値を変えることが可能となる。また、例えば階調処理や周波数処理を行う場合、所望のコントラストを得ようとすれば、階調特性のコントラストをあげることで得ることも可能であるし、周波数処理でコントラストを得ることもできる。画像の可視範囲においても、階調特性を低くすることで可視範囲を広げることも可能であるし、イコライゼーション処理により可視範囲を広げることも可能である。 For example, the image processing condition of the chest image in the conventional process is determined as follows. Here, for example, the positions of the left and right ends of the rib cage to be recognized can be adjusted by making k1 and k2 that determine the threshold values Tr and Tl changeable. Further, for example, by making it possible to change the threshold values m1 and m2 for determining the reference signal value from the cumulative histogram, the signal value in the lung field to be detected can be changed. For example, when performing gradation processing or frequency processing, if a desired contrast is to be obtained, it can be obtained by increasing the contrast of the gradation characteristics, or the contrast can be obtained by frequency processing. Also in the visible range of the image, it is possible to widen the visible range by lowering the gradation characteristics, and it is also possible to widen the visible range by equalization processing.

このように同様な目的に対して複数のパラメータによる調整が必要な場合はオペレータが実際に画像を出力して、比較した結果、オペレータの判断により最終的なパラメータが決定されていた。 As described above, when adjustment with a plurality of parameters is necessary for the same purpose, the operator actually outputs an image, and as a result of comparison, the final parameter is determined by the operator's judgment.

しかし、従来の方法では変更するためのパラメータは処理を行うためのアルゴリズムあるいはプログラミング的な要素から決定されるため、直感的には非常に分かりづらい。

例えば、上記ですでに触れたように、画像コントラストを調整する機能として階調処理によるLUTの平均的な傾きを表すγ値を変更する方法がある。一方、画像の鮮鋭度を調整する機能として周波数強調処理が考えられるが周波数強調処理は画像のコントラストへの影響を与える。とくに低周波成分からの強調を行った場合は画像の大きな成分のレスポンスを操作することになり、画像コントラストへの影響は少なくない。したがってオペレータが画像のコントラストをγ値で調整した後に鮮鋭度の調整として、周波数強調処理を操作した場合、画像コントラストにまで影響を及ぼすことになり、所望の画像処理パラメータを得るまでに幾度も両方の処理を調整しなければならないという問題が生じる。

However, in the conventional method, the parameter to be changed is determined from an algorithm for performing the process or a programming element, and thus it is difficult to intuitively understand.

For example, as already mentioned above, as a function for adjusting the image contrast, there is a method of changing the γ value representing the average slope of the LUT by gradation processing. On the other hand, frequency enhancement processing can be considered as a function for adjusting the sharpness of an image. However, frequency enhancement processing affects the contrast of an image. In particular, when emphasizing from low-frequency components, the response of a large component of the image is manipulated, and the influence on the image contrast is not small. Therefore, if the operator adjusts the image contrast with the γ value and then manipulates the frequency enhancement process to adjust the sharpness, it will affect the image contrast and both times until the desired image processing parameters are obtained. The problem arises that the processing of the above must be adjusted.

このため、画像処理内容を詳しく知らない場合、適切な値への変更は非常に難しいものであった。また、複数のパラメータが互いに独立ではなく、お互いを適切な値に調整することで最適なパラメータが得られる場合、画像処理内容を熟知していないと適切値を得ることはほとんど不可能であった。 For this reason, if the details of the image processing are not known in detail, it has been very difficult to change to an appropriate value. In addition, when multiple parameters are not independent of each other and the optimum parameters can be obtained by adjusting each other to an appropriate value, it is almost impossible to obtain an appropriate value unless the image processing content is fully understood. .

本発明は以上のような課題に鑑みてなされたものであって、画像処理内容の詳細を知らない場合であっても、簡易な操作で適切な処理パラメータによって画像処理することが可能な画像処理方法および画像処理装置ならびに画像処理プログラムを実現することを目的とする。 The present invention has been made in view of the problems as described above, and can perform image processing with appropriate processing parameters with a simple operation even when details of image processing contents are not known. It is an object to realize a method, an image processing apparatus, and an image processing program.

すなわち、前記した課題を解決は、以下に列記する発明により解決される。

(1)請求項1記載の発明は、被写体を透過した放射線の照射線量に応じた信号を有する放射線画像の画像データに対し、画像処理パラメータによって画像処理を行う画像処理方法であって、画像処理パラメータとは異なる尺度に基づいて予め定められた1または複数の入力パラメータの入力を受け付けるパラメータ入力ステップと、前記パラメータ入力ステップで入力された入力パラメータを予め定められた関係に基づいて画像処理に使用する1または複数の画像処理パラメータに変換するパラメータ変換ステップと、前記パラメータ変換ステップで変換された1または複数の画像処理パラメータを用いて画像処理を実行する画像処理ステップと、を有することを特徴とする画像処理方法である。

That is, the above-described problems can be solved by the inventions listed below.

(1) The invention according to

(2)請求項2記載の発明は、前記入力パラメータは、撮影部位、撮影体位、照射野の形状、照射野の広さ、画像中央の重要度、画像内特定領域の重要度、画像内高周波成分の重要度、画像内領域での粒状の重要度、画像内領域における平均濃度の指定値からの差、のうち少なくとも一つを含む1又は複数のパラメータである、ことを特徴とする請求項1記載の画像処理方法である。

(2) In the invention described in

(3)請求項3記載の発明は、前記画像処理パラメータは、コントラスト調整パラメータ、階調処理パラメータ、周波数強調処理パラメータ、イコライゼーション処理パラメータ、のうち少なくとも一つを含む1又は複数のパラメータである、ことを特徴とする請求項1または請求項2のいずれかに記載の画像処理方法である。

(3) In the invention according to

(4)請求項4記載の発明は、前記パラメータ変換ステップでは、意思決定理論に基づいて入力パラメータから画像処理パラメータへの変換が実行される、ことを特徴とする請求項1乃至請求項3のいずれかに記載の画像処理方法である。

(4) The invention according to

(5)請求項5記載の発明は、前記パラメータ変換ステップでの意思決定理論に基づく入力パラメータから画像処理パラメータへの変換は、ファジィ積分に基づいて実行される、ことを特徴とする請求項4記載の画像処理方法である。

(5) The invention described in

(6)請求項6記載の発明は、被写体を透過した放射線の照射線量に応じた信号を有する放射線画像の画像データに対し、画像処理パラメータによって画像処理を行う画像処理装置であって、画像処理パラメータとは異なる尺度に基づいて予め定められた1または複数の入力パラメータの入力を受け付けるパラメータ入力手段と、前記パラメータ入力手段で入力された入力パラメータを予め定められた関係に基づいて画像処理に使用する1または複数の画像処理パラメータに変換するパラメータ変換手段と、前記パラメータ変換手段で変換された1または複数の画像処理パラメータを用いて画像処理を実行する画像処理手段と、を有することを特徴とする画像処理装置である。

(6) The invention according to

(7)請求項7記載の発明は、前記パラメータ入力手段で入力される前記入力パラメータは、撮影部位、撮影体位、照射野の形状、照射野の広さ、画像中央の重要度、画像内特定領域の重要度、画像内高周波成分の重要度、画像内領域での粒状の重要度、画像内領域における平均濃度の指定値からの差、のうち少なくとも一つを含む1又は複数のパラメータである、ことを特徴とする請求項6記載の画像処理装置である。

(7) In the invention according to claim 7, the input parameters input by the parameter input means are: an imaging region, an imaging body position, an irradiation field shape, an irradiation field width, an importance at the center of an image, and an in-image specification One or more parameters including at least one of the importance of the area, the importance of the high-frequency component in the image, the importance of the granularity in the area in the image, and the difference from the specified value of the average density in the area in the image The image processing apparatus according to

(8)請求項8記載の発明は、前記パラメータ変換手段で変換される前記画像処理パラメータは、コントラスト調整パラメータ、階調処理パラメータ、周波数強調処理パラメータ、イコライゼーション処理パラメータ、のうち少なくとも一つを含む1又は複数のパラメータである、ことを特徴とする請求項6または請求項7のいずれかに記載の画像処理装置である。

(8) In the invention according to

(9)請求項9記載の発明は、前記パラメータ変換手段では、意思決定理論に基づいて入力パラメータから画像処理パラメータへの変換が実行される、ことを特徴とする請求項6乃至請求項8のいずれかに記載の画像処理装置である。

(9) The invention according to

(10)請求項10記載の発明は、前記パラメータ変換手段での意思決定理論に基づく入力パラメータから画像処理パラメータへの変換は、ファジィ積分に基づいて実行される、ことを特徴とする請求項9記載の画像処理装置である。 (10) The invention described in claim 10 is characterized in that the conversion from the input parameter to the image processing parameter based on the decision making theory in the parameter conversion means is executed based on fuzzy integration. It is an image processing apparatus of description.

(11)請求項11記載の発明は、被写体を透過した放射線の照射線量に応じた信号を有する放射線画像の画像データに対し、画像処理パラメータによって画像処理を行う画像処理プログラムであって、画像処理パラメータとは異なる尺度に基づいて予め定められた1または複数の入力パラメータの入力を受け付けるパラメータ入力ルーチンと、前記パラメータ入力ルーチンで入力された入力パラメータを予め定められた関係に基づいて画像処理に使用する1または複数の画像処理パラメータに変換するパラメータ変換ルーチンと、前記パラメータ変換ルーチンで変換された1または複数の画像処理パラメータを用いて画像処理を実行する画像処理ルーチンと、を有することを特徴とする画像処理プログラムである。 (11) The invention according to claim 11 is an image processing program for performing image processing on image data of a radiographic image having a signal corresponding to an irradiation dose of radiation that has passed through a subject, using image processing parameters. A parameter input routine for accepting input of one or more predetermined input parameters based on a scale different from the parameters, and the input parameters input in the parameter input routine are used for image processing based on a predetermined relationship A parameter conversion routine for converting into one or a plurality of image processing parameters to be performed, and an image processing routine for performing image processing using the one or a plurality of image processing parameters converted by the parameter conversion routine. This is an image processing program.

(12)請求項12記載の発明は、前記入力パラメータは、撮影部位、撮影体位、照射野の形状、照射野の広さ、画像中央の重要度、画像内特定領域の重要度、画像内高周波成分の重要度、画像内領域での粒状の重要度、画像内領域における平均濃度の指定値からの差、のうち少なくとも一つを含む1又は複数のパラメータである、ことを特徴とする請求項11記載の画像処理プログラムである。 (12) In the invention according to claim 12, the input parameters are the imaging region, the body position, the shape of the irradiation field, the width of the irradiation field, the importance of the center of the image, the importance of the specific area in the image, and the high frequency in the image. The one or more parameters including at least one of the importance of the component, the importance of the granularity in the area in the image, and the difference from the specified value of the average density in the area in the image. 11 is an image processing program.

(13)請求項13記載の発明は、前記画像処理パラメータは、コントラスト調整パラメータ、階調処理パラメータ、周波数強調処理パラメータ、イコライゼーション処理パラメータ、のうち少なくとも一つを含む1又は複数のパラメータである、ことを特徴とする請求項11または請求項12のいずれかに記載の画像処理プログラムである。 (13) In the invention described in claim 13, the image processing parameter is one or a plurality of parameters including at least one of a contrast adjustment parameter, a gradation processing parameter, a frequency enhancement processing parameter, and an equalization processing parameter. 13. An image processing program according to claim 11, wherein the image processing program is any one of claims 11 and 12.

(14)請求項14記載の発明は、前記パラメータ変換ルーチンでは、意思決定理論に基づいて入力パラメータから画像処理パラメータへの変換が実行される、ことを特徴とする請求項11乃至請求項13のいずれかに記載の画像処理プログラムである。 (14) In the invention described in claim 14, in the parameter conversion routine, conversion from an input parameter to an image processing parameter is executed based on a decision making theory. Any one of the image processing programs.

(15)請求項15記載の発明は、前記パラメータ変換ルーチンでの意思決定理論に基づく入力パラメータから画像処理パラメータへの変換は、ファジィ積分に基づいて実行される、ことを特徴とする請求項14記載の画像処理プログラムである。 (15) The invention described in claim 15 is characterized in that the conversion from the input parameter to the image processing parameter based on the decision making theory in the parameter conversion routine is executed based on fuzzy integration. It is an image processing program of description.

本願発明によれば、以下に列記するような効果が得られる。

(1)この発明では、被写体を透過した放射線の照射線量に応じた信号を有する放射線画像の画像データに対し、画像処理パラメータによって画像処理を行う際に、画像処理パラメータとは異なる尺度に基づいて予め定められた1または複数の入力パラメータの入力を受け付け、前記パラメータ入力ステップで入力された入力パラメータを予め定められた関係に基づいて画像処理に使用する1または複数の画像処理パラメータに変換し、前記パラメータ変換ステップで変換された1または複数の画像処理パラメータを用いて画像処理を実行する。

According to the present invention, the effects listed below can be obtained.

(1) In the present invention, when image processing is performed on image data of a radiographic image having a signal corresponding to the radiation dose transmitted through the subject using the image processing parameter, based on a scale different from the image processing parameter. Receiving input of one or more predetermined input parameters, converting the input parameters input in the parameter input step into one or more image processing parameters used for image processing based on a predetermined relationship; Image processing is executed using one or more image processing parameters converted in the parameter conversion step.

このように、画像処理パラメータを直接入力するのではなく、画像処理パラメータとは異なる尺度に基づいて予め定められた1または複数の入力パラメータの入力を受け付け、入力パラメータから画像処理パラメータに変換するようにしていることで、画像処理内容の詳細を知らない場合であっても、簡易な操作で適切な処理パラメータによって画像処理することが可能になる。 As described above, instead of directly inputting the image processing parameter, one or a plurality of input parameters determined in advance based on a scale different from the image processing parameter is received, and the input parameter is converted into the image processing parameter. By doing so, even when the details of the image processing contents are not known, it is possible to perform image processing with appropriate processing parameters with a simple operation.

(2)画像処理パラメータを直接入力するのではなく、画像処理パラメータとは異なる尺度に基づいて予め定められた1または複数の入力パラメータとして、撮影部位、撮影体位、照射野の形状、照射野の広さ、画像中央の重要度、画像内特定領域の重要度、画像内高周波成分の重要度、画像内領域での粒状の重要度、画像内領域における平均濃度の指定値からの差、のうち少なくとも一つを含む1又は複数のパラメータの入力を受け付け、入力パラメータから画像処理パラメータに変換するようにしている。これにより、画像処理内容の詳細を知らない場合であっても、把握しやすい簡易な入力パラメータの入力操作によって、適切な処理パラメータによって画像処理することが可能になる。 (2) Rather than directly inputting image processing parameters, as one or a plurality of input parameters determined in advance based on a scale different from the image processing parameters, the imaging region, imaging position, irradiation field shape, irradiation field Of the width, the importance of the center of the image, the importance of the specific area in the image, the importance of the high frequency component in the image, the importance of the granularity in the area in the image, the difference from the specified value of the average density in the area in the image An input of one or a plurality of parameters including at least one is received, and the input parameters are converted into image processing parameters. As a result, even if the details of the image processing contents are not known, it is possible to perform image processing with appropriate processing parameters by a simple input parameter input operation that is easy to grasp.

(3)このように、画像処理パラメータを直接入力するのではなく、画像処理パラメータとは異なる尺度に基づいて予め定められた1または複数の入力パラメータの入力を受け付け、入力パラメータから、コントラスト調整パラメータ、階調処理パラメータ、周波数強調処理パラメータ、イコライゼーション処理パラメータ、のうち少なくとも一つを含む1又は複数の画像処理パラメータに変換するようにしていることで、画像処理内容の詳細を知らない場合であっても、簡易な操作で適切な処理パラメータによって画像処理することが可能になる。 (3) As described above, instead of directly inputting the image processing parameter, the input of one or more input parameters determined in advance based on a scale different from the image processing parameter is received, and the contrast adjustment parameter is received from the input parameter. This is a case where the details of the image processing contents are not known by converting to one or a plurality of image processing parameters including at least one of tone processing parameters, frequency enhancement processing parameters, and equalization processing parameters. However, it is possible to perform image processing with appropriate processing parameters with a simple operation.

(4)入力パラメータから画像処理パラメータへのパラメータ変換では、意思決定理論に基づいて変換が実行されるため、複数の入力パラメータから変換、あるいは、複数の画像処理パラメータへの変換の際の組み合わせを考慮した変換が可能になる。 (4) In the parameter conversion from the input parameter to the image processing parameter, since the conversion is executed based on the decision making theory, a combination at the time of conversion from a plurality of input parameters or conversion to a plurality of image processing parameters is performed. Conversion in consideration is possible.

(5)入力パラメータから画像処理パラメータへの意思決定理論を用いたパラメータ変換では、ファジィ積分に基づいて変換が実行されるため、複数の入力パラメータから変換、あるいは、複数の画像処理パラメータへの変換の際の組み合わせを考慮した変換が可能になる。 (5) In parameter conversion using decision-making theory from input parameters to image processing parameters, conversion is executed based on fuzzy integration. Therefore, conversion from a plurality of input parameters or conversion to a plurality of image processing parameters is performed. Conversion in consideration of the combination at the time is possible.

以下、図面を参照して本発明の実施をするための最良の形態を詳細に説明する。

本発明の実施をするための最良の形態の画像処理方法および画像処理装置ならびに画像処理プログラムの好適な実施の形態について説明する。なお、これにより本発明が限定されるものではない。

The best mode for carrying out the present invention will be described below in detail with reference to the drawings.

BEST MODE FOR CARRYING OUT THE INVENTION Preferred embodiments of an image processing method, an image processing apparatus, and an image processing program of the best mode for carrying out the present invention will be described. Note that the present invention is not limited thereby.

なお、本実施例の形態例の各手段は、ハードウェアやファームウェア、またはソフトウェアで構成することが可能である。

このため、画像処理方法の各ステップ,画像処理装置の各手段,画像処理プログラムの各ルーチンの処理手順に沿った機能ブロック図としての図1を示す。

Note that each means of the embodiment of the present embodiment can be configured by hardware, firmware, or software.

For this reason, FIG. 1 is shown as a functional block diagram in accordance with the processing procedure of each step of the image processing method, each means of the image processing apparatus, and each routine of the image processing program.

以下、本発明の実施するための最良の形態の構成および動作について、図1のブロック図、図2のフローチャート、および、その他の説明図を参照しつつ詳細に説明する。なお、図1における各手段は、画像形成装置の各手段を示すだけでなく、画像処理方法の各ステップ、画像処理プログラムの各ルーチンを示すものである。 Hereinafter, the configuration and operation of the best mode for carrying out the present invention will be described in detail with reference to the block diagram of FIG. 1, the flowchart of FIG. 2, and other explanatory diagrams. Each unit in FIG. 1 represents not only each unit of the image forming apparatus but also each step of the image processing method and each routine of the image processing program.

〈全体構成および処理の流れ〉

(ア)全体構成:

放射線発生装置30、放射線画像読取器40、画像処理装置100が、図1に示されるように構成されている。

<Overall configuration and processing flow>

(A) Overall configuration:

The

また、画像処理装置100内部には、各部を制御する制御部101、操作入力を受け付ける操作部102、画像データを生成する画像データ生成部110、画像データに基づいて重み付けを行う重み付け部120、複数の重み付けの統合を行う重み付け統合部130、入力パラメータから画像処理パラメータへの変換を行うパラメータ変換部140、画像処理パラメータに基づいて画像処理を実行する画像処理部160、画像処理された画像データや各種状態の表示を行う表示部170が、図1に示すように構成される。なお、図1では重み付け部120内に複数N個の重み付け部121〜12Nが設けられた例を示している。

The image processing apparatus 100 includes a

なお、操作入力部102は、画像処理に直接的に用いられる画像処理パラメータとは異なる尺度に基づいて予め定められた1または複数の入力パラメータの入力を受け付けるパラメータ入力手段を構成している。

The

また、パラメータ変換部140は、操作入力部102で入力された入力パラメータを、予め定められた関係に基づいて、画像処理部160で画像処理に使用する1または複数の画像処理パラメータに変換するパラメータ変換手段を構成している。

The

(イ)処理の流れ:

・制御部101は、放射線画像撮影・読み取り、重み付け、重み付け統合、入力パラメータの受け付け、入力パラメータから画像処理パラメータへのパラメータ変換、および、画像処理パラメータに基づく画像処理、に伴う各種処理についての制御を行う。

・操作部102を介してオペレータによる各種操作、各種設定を制御部101が受け付ける。この段階では、撮影(放射線発生)に関する各種操作、各種設定を受け付ける。

・放射線発生装置30からの放射線は被写体5を透過し、この被写体5を透過した放射線は放射線画像読取器40により読み取られる。放射線発生装置30での放射線発生および放射線画像読取器40における読み取りの際は、制御部101からの制御に基づいて実行される。

・放射線画像読取器40により読み取られた信号は、画像データ生成部110で画像データに変換される(図2S1)。

・重み付け部120は、放射線画像データの所定の取り決めに基づいて画素毎に重みを付与する(図2S2)。なお、付与する重みが単独であれば(図2S2でY)、1種類の重みを生成して付与する(図2S3)。

・重み付け統合部130は、付与される重みが複数であれば(図2S2でN)、複数の重みについて、所定の取り決めに従い統合する(図2S5)。

・操作入力部102を介して、画像処理に直接的に用いられる画像処理パラメータとは異なる尺度に基づいて予め定められた1または複数の入力パラメータの入力を、制御部101が受け付ける(図2S6)。

・パラメータ変換部140は、重み付け部120からの重みを参照し、操作入力部102を介して入力されている1または複数の入力パラメータを、予め定められた関係に基づいて、画像処理に使用する1または複数の画像処理パラメータに変換する(図2S7)。

・画像処理部160は、画像データ生成部110からの画像データについて、パラメータ変換部140で変換された画像処理パラメータに従って、画像処理を実行する(図2S8)。

・画像表示する必要があれば(図2S9でY)、与えられた重みと、変換された画像処理パラメータを、画像処理済みの放射線画像に重畳して表示する(図2S10)。また、必要があれば、画像処理パラメータを生成する元となる入力パラメータを、画像処理済みの放射線画像に重畳して表示する。

・以上の各処理が完了した後、制御部101の制御に基づいて、処理済み画像データを外部に出力する(図2S11)。

(B) Process flow:

The

The

The radiation from the

The signal read by the radiation image reader 40 is converted into image data by the image data generation unit 110 (S1 in FIG. 2).

The weighting unit 120 assigns a weight to each pixel based on a predetermined agreement of the radiation image data (S2 in FIG. 2). If the weight to be given is single (Y in FIG. 2), one kind of weight is generated and given (S3 in FIG. 2).

If there are a plurality of weights to be given (N in FIG. 2 S2), the

The

The

The

If it is necessary to display an image (Y in FIG. 2 S9), the given weight and the converted image processing parameter are superimposed on the image-processed radiation image and displayed (S10 in FIG. 2). If necessary, the input parameter that is the source of generating the image processing parameter is displayed superimposed on the image-processed radiation image.

After the above processes are completed, the processed image data is output to the outside based on the control of the control unit 101 (S11 in FIG. 2).

〈各手段、各ステップの詳細内容〉

(1)各部の動作・制御:

制御部101では、まず、撮影部位、撮影体位または撮影方向等の情報をユーザインターフェースである操作入力部102などから取得する。これらの情報は、ユーザが撮影部位や撮影体位等を特定することで行う。例えば、表示部170とタッチパネルなどの操作入力部102とを兼ね備えた当該画像処理装置のユーザインタフェースから、撮影部位や撮影体位が表示されたボタンを押すこと等により入力される。そのほか、磁気カード、バーコード、HIS(病院内情報システム:ネットワークによる情報管理)等を利用しても行われる。

<Details of each means and step>

(1) Operation and control of each part:

In the

(2)放射線画像入力:

放射線発生器30は制御部101によって制御されており、放射線発生器30から放射された放射線は、被写体5を通して放射線画像読取器40の前面に装着されている撮像パネルに照射される。そして、放射線画像読取器40では、被写体5を透過した放射線を検知して、画像信号として取得する。

(2) Radiation image input:

The

具体的な構成例としては、輝尽性蛍光体プレートを用いたものとして、特開平11-142998号公報や特開2002-156716号公報に記載されたものがある。また、フラットパネルディテクタ(FPD)を入力装置として用いるものには、特開平6-342098号公報に記載された、検出したX線を直接電荷に変換し、画像信号として取得するものや、特開平9-90048号公報に記載された、検出したX線を一旦光に変換した後、その光を受光して電荷に変換する、間接方式のものがある。 Specific examples of the configuration include those described in JP-A-11-142998 and JP-A-2002-156716 as using a stimulable phosphor plate. For those using a flat panel detector (FPD) as an input device, those described in Japanese Patent Laid-Open No. 6-342098 that directly convert detected X-rays into charges and obtain them as image signals, There is an indirect system described in Japanese Patent Laid-Open No. 9-90048 in which detected X-rays are once converted into light and then received and converted into electric charges.

なお、放射線画像読取器40は、放射線画像を記録した銀塩フィルムにレーザ、蛍光灯等の光源からの光を照射し、この銀塩フィルムの透過光を光電変換して画像データを生成してもよい。また、放射線量子計数型検出器を用いて放射線エネルギーを直接電気信号に変換して画像データを生成する構成であってもよい。 The radiation image reader 40 irradiates the silver salt film on which the radiation image is recorded with light from a light source such as a laser or a fluorescent lamp, and photoelectrically converts the transmitted light of the silver salt film to generate image data. Also good. Moreover, the structure which converts radiation energy directly into an electrical signal using a radiation quantum counting type detector, and produces | generates image data may be sufficient.

被写体5の放射線画像を得る際には、放射線発生器30と放射線画像読取器40の撮像パネルの間に被写体5が位置するものとされて、放射線発生器30から放射された放射線が被写体5に照射されると共に、被写体5を透過した放射線が撮像パネルに入射される。

When obtaining a radiation image of the subject 5, the

(3)関心領域設定:

ところで、放射線画像の撮影に際しては、例えば診断に必要とされない部分に放射線が照射されないようにするため、あるいは診断に必要とされない部分に放射線が照射されて、この部分で散乱された放射線が診断に必要とされる部分に入射されて分解能が低下することを防止するため、被写体5の一部や放射線発生器30に鉛板等の放射線非透過物質を設置して、被写体5に対する放射線の照射野を制限する照射野絞りが行われる。

(3) Region of interest setting:

By the way, when taking a radiographic image, for example, in order to prevent radiation from being applied to a part that is not required for diagnosis, or to a part that is not required for diagnosis, radiation scattered in this part is used for diagnosis. In order to prevent the resolution from being reduced by being incident on a required portion, a radiation non-transparent material such as a lead plate is installed in a part of the subject 5 or the

この照射野絞りが行われた場合、照射野内領域と照射野外領域の画像データを用いてレベルの変換処理やその後の階調処理を行うものとすると、照射野外領域の画像データによって、照射野内の診断に必要とされる部分の画像処理が適正に行われなくなってしまう。このため、画像データ生成部110では、照射野内領域と照射野外領域を判別する照射野認識が行われる。 When this irradiation field stop is performed, if level conversion processing and subsequent gradation processing are performed using the image data of the irradiation field area and the irradiation field area, the image data in the irradiation field is determined by the image data of the irradiation field area. Image processing of a part required for diagnosis is not performed properly. For this reason, the image data generation unit 110 performs irradiation field recognition for discriminating between the irradiation field area and the irradiation field area.

照射野認識では、例えば特開昭63−259538号で示される方法が用いられて、図3Aに示すように撮像面上の所定の位置Pから撮像面の端部側に向かう線分上の画像データを用いて例えば微分処理が行われる。この微分処理によって得られた微分信号Sdは、図3Bに示すように照射野エッジ部で信号レベルが大きくなるため、微分信号Sdの信号レベルを判別して1つの照射野エッジ候補点EP1が求められる。この照射野エッジ候補点を求める処理を、撮像面上の所定の位置を中心として放射状に行うことにより複数の照射野エッジ候補点EP1〜EPkが求められる。このようにして得られた複数の照射野エッジ候補点EP1〜EPkの隣接するエッジ候補点を直線あるいは曲線で結ぶことにより照射野エッジ部が求められる。 In the irradiation field recognition, for example, a method disclosed in Japanese Patent Laid-Open No. 63-259538 is used, and an image on a line segment from a predetermined position P on the imaging surface toward the end of the imaging surface as shown in FIG. 3A. For example, differential processing is performed using the data. As shown in FIG. 3B, the differential signal Sd obtained by this differentiation process has a signal level that is large at the irradiation field edge portion. Therefore, one signal field edge candidate point EP1 is obtained by determining the signal level of the differential signal Sd. It is done. A plurality of irradiation field edge candidate points EP1 to EPk are obtained by performing the process of obtaining the irradiation field edge candidate points radially about a predetermined position on the imaging surface. An irradiation field edge portion is obtained by connecting adjacent edge candidate points of the plurality of irradiation field edge candidate points EP1 to EPk obtained in this way with straight lines or curves.

また、特開平5−7579号で示される方法を用いることもできる。この方法では、撮像面を複数の小領域に分割したとき、照射野絞りによって放射線の照射が遮られた照射野外の小領域では、略一様に放射線の放射線量が小さくなり画像データの分散値が小さくなる。また、照射野内の小領域では、被写体によって放射線量が変調されることから照射野外に比べて分散値が高くなる。さらに、照射野エッジ部を含む小領域では最も放射線量が小さい部分と被写体によって変調された放射線量の部分が混在することから分散値は最も高くなる。このことから、分散値によって照射野エッジ部を含む小領域が判別される。 Moreover, the method shown by Unexamined-Japanese-Patent No. 5-7579 can also be used. In this method, when the imaging surface is divided into a plurality of small areas, the radiation dose of the radiation is reduced substantially uniformly in the small areas outside the irradiation field where radiation irradiation is blocked by the irradiation field stop. Becomes smaller. In addition, in a small region within the irradiation field, the radiation value is modulated by the subject, so that the dispersion value is higher than that outside the irradiation field. Further, in a small region including the irradiation field edge portion, the portion with the smallest radiation dose and the portion with the radiation dose modulated by the subject coexist, so the dispersion value is the highest. From this, the small area including the irradiation field edge portion is determined by the dispersion value.

また、特開平7−181409号で示される方法を用いることもできる。この方法では、画像データを所定の回転中心に関して回転移動させて、平行状態検出手段によって照射野の境界線が画像上に設定された直交座標の座標軸と平行となるまで回転を行うものとし、平行状態が検出されると、直線方程式算出手段によって回転角度と回転中心から境界線までの距離によって回転前の境界の直線方程式が算出される。その後、複数の境界線に囲まれる領域を直線方程式から決定することで、照射野の領域を判別することができる。また照射野エッジ部が曲線である場合には、境界点抽出手段で画像データに基づき例えば1つの境界点を抽出し、この境界点の周辺の境界候補点群から次の境界点を抽出する。以下同様に、境界点の周辺の境界候補点群から境界点を順次抽出することにより、照射野エッジ部が曲線であっても判別することができる。 Moreover, the method shown by Unexamined-Japanese-Patent No. 7-181409 can also be used. In this method, image data is rotated about a predetermined center of rotation, and rotation is performed until the boundary line of the irradiation field becomes parallel to the coordinate axis of the orthogonal coordinates set on the image by the parallel state detection means. When the state is detected, the linear equation of the boundary before rotation is calculated by the linear equation calculation means based on the rotation angle and the distance from the rotation center to the boundary line. Thereafter, by determining a region surrounded by a plurality of boundary lines from a linear equation, the region of the irradiation field can be determined. When the irradiation field edge portion is a curve, for example, one boundary point is extracted based on the image data by the boundary point extraction means, and the next boundary point is extracted from the boundary candidate point group around this boundary point. Similarly, by sequentially extracting boundary points from the boundary candidate point group around the boundary points, it is possible to determine whether the irradiation field edge portion is a curve.

照射野認識が行われると、放射線画像読取器からの画像データDTの分布を所望のレベルの分布に変換する際に、放射線画像読取器からの画像データDTのレベルの分布を決定するための領域(以下「関心領域」という)の設定を行う。 When the irradiation field recognition is performed, an area for determining the level distribution of the image data DT from the radiation image reader when the distribution of the image data DT from the radiation image reader is converted into a distribution at a desired level. (Hereinafter referred to as “region of interest”).

この関心領域の設定では、たとえば胸部正面画像では診断上重要な領域がすべて含まれるように肺野全体に設定される。

なお、この実施の形態では、照射野認識、関心領域設定は必ずしも必要としない。この場合、以下で行われる重み候補の算出に加えて、一定領域内の画素値の分散値が低い部分に低い重みを与えることで、素抜け部や照射野外の領域を低く、人体領域を高く重み付けした重み候補を考える方法を用いてもよい。なお、この場合分散値を求める一定領域としては画像の1/40〜1/20程度の領域を、照射野外領域あるいは素抜け領域にとることが望ましい。

(4)重み付与:

ここで重み付け部120は、放射線画像の所定の取り決めに基づいて画素毎あるいは画像内の所定の大きさに区切られた各領域に対して重みを付与する。

In the setting of the region of interest, for example, the entire lung field is set so that all regions important for diagnosis are included in the chest front image.

In this embodiment, irradiation field recognition and region of interest setting are not necessarily required. In this case, in addition to the weight candidate calculation performed below, by giving a low weight to a portion where the variance value of the pixel value in the fixed region is low, the region that is not exposed and the region outside the irradiation field are lowered and the human body region is raised A method of considering weighted weight candidates may be used. In this case, it is desirable to take an area of about 1/40 to 1/20 of the image as the fixed field for obtaining the dispersion value as an irradiation field area or a blank area.

(4) Weighting:

Here, the weighting unit 120 assigns a weight to each region divided into pixels or a predetermined size in the image based on a predetermined arrangement of the radiographic image.

(4a)画像領域の所定位置への重み付け:

画像データの重み付けとしては、例えば、画像の所定の位置に関して重みを予め付与する方法が考えられる。これは撮影部位や撮影体位毎にテンプレートのようなものを用意し、診断の重要度に従い画像内の所定位置に所定の重みを付与するものである。例えば胸部正面画像においては図4で示されるAの領域に重要度1をそれ以外の領域には1より小さい重要度を与える方法が考えられる。

(4a) Weighting a predetermined position of the image area:

As the weighting of the image data, for example, a method of giving a weight in advance with respect to a predetermined position of the image can be considered. In this method, a template or the like is prepared for each imaging region or imaging position, and a predetermined weight is given to a predetermined position in the image according to the importance of diagnosis. For example, in the chest front image, a method of giving

(4b)画像領域のエッジ点への重み付け:

また、ラプラシアンフィルタや微分フィルタを用いて画像のエッジ抽出を行い、エッジのコントラストを用いることで診断上重要となる被写体構造を構成する部分のエッジに高い重みを与えることができる。このエッジの検出には上記のフィルタの他にウェーブレットやガウス-ラプラシアンフィルタのような多重解像度を利用することもできる。この部分に関しては、「ウェーブレット解析の基礎理論」、新井康平著、森北出版株式会社、p80、2000年出版を参照することができる。

(4b) Weighting edge points of image area:

Further, by extracting an edge of an image using a Laplacian filter or a differential filter and using the contrast of the edge, it is possible to give a high weight to the edge of the portion constituting the subject structure which is important for diagnosis. In addition to the above-described filter, multi-resolution such as a wavelet or a Gauss-Laplacian filter can be used for the edge detection. Regarding this part, “Basic Theory of Wavelet Analysis”, Kohei Arai, Morikita Publishing Co., Ltd., p80, 2000 publication can be referred to.

すなわち、この重みとして、例えば、画像から上記フィルタを使用して得られたエッジ成分の絶対値をとることができる。また、この他に、図5(a)、図5(b)に示すような関数を使用することで、ノイズのような小さな部分や照射野端などの人工物による大きなエッジの重要度を低くすることができる。 That is, as the weight, for example, the absolute value of the edge component obtained from the image using the filter can be taken. In addition, by using the functions shown in FIGS. 5 (a) and 5 (b), the importance of large edges caused by artifacts such as small portions such as noise and irradiation field edges is reduced. can do.

ここで図5中のαおよびβはそれぞれエッジ最大値信号値の10%、90%程度に設定されることが望ましい。図6(a)は頚椎についてのオリジナル画像、図6(b)は図6(a)の頚椎画像について検出されたエッジを示した様子である。 Here, α and β in FIG. 5 are desirably set to about 10% and 90% of the edge maximum value signal value, respectively. 6A shows the original image of the cervical spine, and FIG. 6B shows the detected edges of the cervical spine image of FIG. 6A.

さらに、エッジ抽出としては、3チャンネルフィルタバンクを用いることでより効率的にエッジの検出が可能となる。この3チャンネルフィルタバンクとは、ディジタルデータに対してフィルタ処理を行うフィルタ処理手段であり、3チャンネルフィルタバンクの形式に構成されており、異なる特性の複数のフィルタによりディジタルデータの分解を行う分解フィルタ部、および、前記分解フィルタ部の分解出力のそれぞれをダウンサンプリングするダウンサンプリング部、並びに、前記ダウンサンプリング部の出力を受けて前記分解されたディジタルデータを再構成する再構成フィルタ部を有する構成であり、前記分解フィルタ部は、ラプラシアンフィルタ及び差分(Sobel)フィルタ並びに単純平均フィルタで構成されている、ものを指している。 Furthermore, for edge extraction, it is possible to detect edges more efficiently by using a three-channel filter bank. The three-channel filter bank is a filter processing means for performing filter processing on digital data, and is configured in the form of a three-channel filter bank, and is a decomposition filter for decomposing digital data by a plurality of filters having different characteristics. And a downsampling unit that downsamples each of the decomposition outputs of the decomposition filter unit, and a reconstruction filter unit that receives the output of the downsampling unit and reconstructs the decomposed digital data. In other words, the decomposition filter unit indicates a Laplacian filter, a difference (Sobel) filter, and a simple average filter.

(4c)画像中央重要度、および、画像端への重み付け:

診断上重要な部分は画像中央に設定されることが多いので、図7に示すように画像中央ほど高い重みを与える方法も有効である。また、逆に端部に行くにしたがって高い重みを与えることもできる。このようにすることで画像端部に被写体が位置することが多い撮影で適した重みを与えることができる。このような部位としては例えば、マンモグラフィーやパントモグラフィーが考えられる。

(4c) Image center importance and image edge weighting:

Since a portion important for diagnosis is often set at the center of the image, a method of giving higher weight to the center of the image as shown in FIG. 7 is also effective. Conversely, a higher weight can be given toward the end. In this way, it is possible to give a weight suitable for shooting in which the subject is often located at the edge of the image. As such a part, for example, mammography or pantomography can be considered.

(4d)照射野端への重み付け:

他にも画像の濃度が著しく高いあるいは低い場合は低い重みを、また、近傍エッジとの連結度を調べ、連結度に従って重みを与えることもできる。具体的にはラプラシアンフィルタなどの閾値以上の値をエッジとして得られたエッジ検出画像に対しハフ変換を用いてパラメータ空間に変換し、このパラメータ空間での投票数が1以上の直線あるいは円形を逆ハフ変換により導き、この直線あるいは円形の上にのる画素の重みを投票数に従い図8(a)のようなグラフにより重みを算出する。このようにすることで照射野エッジなどの不要な点の重みを低くし、それ以外の領域に高い重みを与えることができる。ここで図8(a)のαの値は検出したいエッジの長さにより異なり、撮影部位や撮影体位により変更することが望ましいが、経験的には画像の縦幅あるいは横幅の1/3程度の大きさが望ましい。ここで、ハフ変換については、「画像認識の基礎[II]-特徴抽出、エッジ検出、テクスチャー解析」,森俊二・板倉栂子著、オーム社、1990年出版などを参照することができる。

(4d) Weighting to the field edge:

In addition, when the density of the image is remarkably high or low, a low weight can be checked, and a connection degree with a neighboring edge can be checked, and a weight can be given according to the connection degree. Specifically, the edge detection image obtained as an edge with a value greater than or equal to a threshold value such as a Laplacian filter is converted into a parameter space using Hough transform, and a straight line or circle with one or more votes in this parameter space is reversed. Guided by the Hough transform, the weight of the pixel on the straight line or circle is calculated by a graph as shown in FIG. 8A according to the number of votes. By doing so, it is possible to reduce the weight of an unnecessary point such as an irradiation field edge and to give a high weight to other regions. Here, the value of α in FIG. 8 (a) varies depending on the length of the edge to be detected, and it is desirable to change it depending on the imaging region and imaging position, but empirically, it is about 1/3 of the vertical or horizontal width of the image. Size is desirable. For Hough transform, refer to "Basics of Image Recognition [II]-Feature Extraction, Edge Detection, Texture Analysis", written by Shunji Mori and Reiko Itakura, Ohmsha, 1990 publication, etc.

(4e)統計量(分散値など)に基づいた重み付け:

さらに原画像(図9(a))から判別分析法を利用して2値化処理を行い画像内の素抜け領域や照射野外領域を認識し(図9(b))、これらの領域の平均分散値を調べ、平均分散値に従って重み付けを行うこともできる。この場合重みを図10のようなグラフによる算出される係数を画像全体の重みにかけることで、粒状度の良い画像ほど重い全体の重みを高くすることができる。また、ここでは分散値を用いたがこれ以外の統計量を使用することも可能である。この場合、例えば画素値に関するヒストグラムを作成し、この度数分布に従って重みを与える方法がある。このようにすることで、出現頻度の高い画素値に高い重みを与えることが可能である。

(4e) Weighting based on statistics (such as variance):

Furthermore, binarization processing is performed from the original image (Fig. 9 (a)) using discriminant analysis method to recognize the missing region and the irradiation field region in the image (Fig. 9 (b)), and the average of these regions. It is also possible to examine the dispersion value and weight according to the average dispersion value. In this case, by applying a coefficient calculated by a graph such as that shown in FIG. 10 to the weight of the entire image, the heavier overall weight can be increased for an image having a better granularity. Although the variance value is used here, other statistics can be used. In this case, for example, there is a method of creating a histogram relating to pixel values and giving weights according to this frequency distribution. By doing in this way, it is possible to give a high weight to a pixel value having a high appearance frequency.

さらに、これらの方法によって求めた重みを重み候補とし、後述する重み付け統合を実行することを前提として、いずれか複数の重み付けを組み合わせて並行して実行することも可能である。 Furthermore, on the assumption that the weight obtained by these methods is a weight candidate and weight integration described later is executed, any of a plurality of weights can be combined and executed in parallel.

なお,上記では画素単位で重みを決定する手法を挙げたが、これらの方法はもちろん画像の所定の大きさに区切られた領域に対して決定してもよい。この場合、例えば画像を所定の割合で間引き、間引き画像に上記のような画素単位の重身付けを行った後、オリジナル画像に対応する間引き画素の重みを反映する方法や所定の領域の平均値をその領域の画素値と考え、上記のような重み付けを行うことが考えられる。 In the above description, the method of determining the weight in units of pixels has been described. However, these methods may be determined for a region divided into a predetermined size of the image as a matter of course. In this case, for example, after thinning out the image at a predetermined ratio, weighting the thinned image in units of pixels as described above, and then reflecting the weight of the thinned pixel corresponding to the original image or an average value of the predetermined region Can be considered as the pixel value of the region, and weighting as described above can be performed.

(5)重み付け統合:

ここで重み付け統合部130では、重み付け部120で算出された複数の重みのなかで、より診断に重要な組み合わせが重要視されるように統合される。これにより、診断に必要な領域を重視されるように統合される。これにより、診断に必要な領域を重視した処理が可能となる。

(5) Weighted integration:

Here, the

すなわち、複数の重み付け候補を重み付け統合部130にて、それらの重み付けを利用して最終的な重み付けを決定する。なお、最終的な重みは得られた重みを例えば最大値を1にするなどの正規化を行い、各手法による重み付けの最大あるいは最小値を利用することで、最大値を用いた場合、各画素についてもっとも効果的であった重みを選択でき、最小値を用いた場合、最低でも保証される重要度を選択する最も慎重な重みを与えることが可能となる。

That is, the

この他、次のような意思決定理論で用いられるファジィ積分を使用することで各手法の組み合わせを考慮した重みを与えることが可能になる。

このファジィ積分には例えば、次のようにショケ積分を利用することができる。この手法を用いるにはファジィ積分に必要となるファジィ測度を与える必要がある。ファジィ測度とはルベーグ積分で要求される測度の条件から完全加法性の条件を緩めた測度空間(X、F、μ)のことであり、具体的には以下の条件が通常要求される。

In addition, by using the fuzzy integral used in the following decision making theory, it is possible to give a weight considering the combination of each method.

For this fuzzy integration, for example, the Choquet integration can be used as follows. To use this method, it is necessary to give the fuzzy measure necessary for fuzzy integration. The fuzzy measure is a measure space (X, F, μ) in which the condition of complete additivity is relaxed from the condition of the measure required by Lebesgue integration. Specifically, the following conditions are usually required.

Xを集合,F=2Xとしたとき,,μを次の1〜4のように与える。

1.μ(φ)=0、

2.μ(X)=1、

3.A∈2Xのとき,0≦μ(A)<∞、

4.A,B∈2XとするときA⊆B⊆Xならばμ(A)≦μ(B)、

これはたとえば、重み付け候補が「エッジ強度」、「画像中央度」、「画像濃度」からなる場合、これらの集合をX={エッジ強度,画像中央度,画像濃度}と表せばベキ集合2Xに対して、主観的尺度を考慮した測度を以下のように与えることを意味する。

When X is a set and F = 2X, μ is given as follows.

1.μ (φ) = 0,

2. μ (X) = 1,

3. When A∈2X, 0 ≦ μ (A) <∞,

4. When A, B∈2X, if A⊆B⊆X, μ (A) ≦ μ (B),

For example, if the weighting candidates include “edge strength”, “image medianity”, and “image density”, these sets can be expressed as a power set 2X if X = {edge strength, image medianness, image density}. On the other hand, it means that a measure that takes into account a subjective scale is given as follows.

φ=0.0、

{エッジ強度}=0.6、

{画像中央度}=0.3、

{エッジ強度、画像中央度}=0.8、

{画像濃度}=0.3、

{画像濃度、エッジ強度}=0.7、

{画像濃度、画像中央度}=0.9、

{画像濃度、画像中央度、画像エッジ強度}=1.0、

このようにして決定した測度に対してショケ積分は次のように定義される。

φ = 0.0,

{Edge strength} = 0.6,

{Image centrality} = 0.3,

{Edge strength, image centrality} = 0.8,

{Image density} = 0.3,

{Image density, edge strength} = 0.7,

{Image density, image median} = 0.9,

{Image density, image medianness, image edge strength} = 1.0,

The Choquet integral is defined as follows for the measure thus determined.

上式はXの各要素をその1つでの重み(測度)が小さい順にx_{1},x_{2},・・・とし、A_{1}をXからx_{1}に対応する要素を除いた集合、A_{2}をXからx_{1},x_{2}に対応する要素を除いた集合、...とした場合、

(C)∫hdμ=Σ(x_{I}-x_{i-1})μ(A_{I})(a_{0}=0)、

で計算することである。

In the above equation, each element of X is x_ {1}, x_ {2}, ... in order of increasing weight (measure), and A_ {1} is an element corresponding to X to x_ {1} If A_ {2} is a set excluding the elements corresponding to x_ {1}, x_ {2}, ...

(C) ∫hdμ = Σ (x_ {I} -x_ {i-1}) μ (A_ {I}) (a_ {0} = 0),

It is to calculate with.

これは例えば、対象画素の重み候補がそれぞれ、エッジ強度=0.6、画像中央度=0.5、画像濃度=0.7であった場合、ファジィ積分結果は、

1.0*0.5+0.8*(0.6-0.5)+0.5*(0.7-0.6)=0.63、

となることを意味し、図11の面積を求めたことになる。このようにファジィ積分は主観的尺度を用いた尺度によるその重みにしたがって重ねたものの面積に相当し、主観的な尺度が反映された重みの統合を可能とする。この点に関しては、「ファジィ理論の基礎」、井上洋・天笠美知夫著、朝倉書店、P.89-104,1997年出版を参照することができる。

For example, if the candidate weights of the target pixel are edge strength = 0.6, image medianity = 0.5, and image density = 0.7, respectively, the fuzzy integration result is

1.0 * 0.5 + 0.8 * (0.6-0.5) + 0.5 * (0.7-0.6) = 0.63,

This means that the area of FIG. 11 is obtained. As described above, the fuzzy integral corresponds to the area of the overlapping according to the weight based on the scale using the subjective scale, and enables the integration of the weight reflecting the subjective scale. In this regard, you can refer to “Fuzzy Theory”, Hiroshi Inoue and Michio Amagasa, Asakura Shoten, P.89-104, 1997.

また、複数種類の重み付けを実行し、複数の重み付けによって得られた重み付け候補のうちいずれかについて、操作部102からの操作によって、選択されるようにすることも可能である。この他、菅野積分などの他のファジィ積分を用いることもできる。

It is also possible to execute a plurality of types of weighting and select any one of the weighting candidates obtained by the plurality of weights by an operation from the

(6)パラメータ入力:

ここで、入力パラメータは、画像処理に用いられる画像処理パラメータとは異なる尺度に基づいて、操作入力部102を介して入力されるように予め定められた1または複数のパラメータである。

(6) Parameter input:

Here, the input parameter is one or a plurality of parameters determined in advance to be input via the

具体的には、撮影部位、撮影体位、照射野の形状、照射野の広さ、画像中央の重要度、画像内特定領域の重要度、画像内高周波成分の重要度、画像内領域での粒状の重要度、画像内領域における平均濃度の指定値からの差、のうち少なくとも一つを含む1又は複数のパラメータである。 Specifically, imaging location, imaging position, irradiation field shape, irradiation field width, importance in the center of the image, importance in the specific area in the image, importance in the high-frequency component in the image, granularity in the area in the image Are one or a plurality of parameters including at least one of the importance level and the difference from the specified value of the average density in the image area.

すなわち、操作者が画像処理内容の詳細を知らない場合であっても、操作者が把握しやすい簡易な入力パラメータを、後述する画像処理パラメータに変換可能な対応関係と共に、予め定めておく。このため、主観的尺度に基づいて定められたパラメータを入力パラメータとしてもよい。 That is, even when the operator does not know the details of the image processing contents, simple input parameters that are easy for the operator to grasp are determined in advance together with correspondence relationships that can be converted into image processing parameters described later. For this reason, it is good also considering the parameter defined based on the subjective scale as an input parameter.

なお、画像処理を実行する際のパラメータ(画像処理パラメータ)は、一般的には関数の係数や各要素の重みなどが含まれ、その指標が操作者にとって直感的に理解しやすいものとは限らない。 It should be noted that parameters (image processing parameters) for executing image processing generally include coefficient of function, weight of each element, etc., and the index is not always easy for the operator to understand intuitively. Absent.

そのため、画像処理の調整をする際にそのパラメータの意味を理解していない場合は、適切な調整が行えない。しかし、この問題は次のように直感的に理解できるパラメータ(入力パラメータ)を用意し、それらを画像処理パラメータに変換する手続きを有することで回避が可能である。 Therefore, when adjusting the image processing, if the meaning of the parameter is not understood, appropriate adjustment cannot be performed. However, this problem can be avoided by preparing parameters (input parameters) that can be intuitively understood as follows and having procedures for converting them into image processing parameters.

なお、パラメータは、可能である限り0〜9までの値というように正規化されることが望ましい。このようにすることで調整者は設定値がパラメータの許容範囲のどの程度の値を入力したかを明確に判断することができる。 It should be noted that it is desirable that the parameters are normalized so as to have values from 0 to 9 as much as possible. In this way, the adjuster can clearly determine how much the set value has entered the allowable range of the parameter.

(6a)照射野形状:

入力パラメータを、「1.円形」、「2.四角形」、「3.六角形」、「4.その他の多角形」、などと照射野形状について、あらかじめ、画像処理パラメータとは異なる尺度に基づいて予め定められたパラメータとして設定しておく。

(6a) Irradiation field shape:

Based on a scale different from the image processing parameters in advance for the input field parameters such as “1. Circular”, “2. Square”, “3. Hexagon”, “4. Other polygons”, etc. And set as a predetermined parameter.

(6b)照射野広さ:

入力パラメータを、「0」〜「9」などと正規化された数値で、照射野広さについて、あらかじめ、画像処理パラメータとは異なる尺度に基づいて予め定められたパラメータとして設定しておく。

(6b) Area of irradiation field:

The input parameter is a numerical value normalized as “0” to “9”, and the irradiation field width is set in advance as a parameter determined in advance based on a scale different from the image processing parameter.

(6c)画像中央重要度:

入力パラメータを、「0」〜「9」などと正規化された数値で、画像中央重要度について、あらかじめ、画像処理パラメータとは異なる尺度に基づいて予め定められたパラメータとして設定しておく。

(6c) Image center importance:

The input parameter is a numerical value normalized as “0” to “9”, and the image center importance is set in advance as a predetermined parameter based on a scale different from the image processing parameter.

(6d)特定領域重要度:

入力パラメータを、「1.画像右端側」、「2.画像左端側」、「3.画像上端側」、「4.画像下端側」、「5.その他の領域」、などとして、画像特定領域重要度について、入力値に応じて画像の指定方向側の重要度を高くするように、あらかじめ、画像処理パラメータとは異なる尺度に基づいて予め定められたパラメータとして設定しておく。

(6d) Specific area importance:

The input parameters are set as “1. Image right edge side”, “2. Image left edge side”, “3. Image upper edge side”, “4. Image lower edge side”, “5. Other area”, etc. The importance is set in advance as a parameter determined in advance based on a scale different from the image processing parameter so as to increase the importance on the designated direction side of the image according to the input value.

(6e)画像の高周波成分の重要度:

入力パラメータを、「0」〜「9」などと正規化された数値で、この数値が大きいほど周波数処理の周波数特性を高周波を重視するように、あらかじめ、画像処理パラメータとは異なる尺度に基づいて予め定められたパラメータとして設定しておく。

(6e) Importance of high-frequency components in images:

Based on a scale different from the image processing parameter in advance so that the input parameter is a numerical value normalized from “0” to “9” and the like. It is set as a predetermined parameter.

(6f)画像粒状抑制重要度:

入力パラメータを、「0」〜「9」などと正規化された数値で、この数値が大きいほど周波数処理の強調度を低くするように、あらかじめ、画像処理パラメータとは異なる尺度に基づいて予め定められたパラメータとして設定しておく。

(6f) Image granularity suppression importance:

The input parameter is a numerical value normalized from “0” to “9”, etc., and is determined in advance based on a scale different from the image processing parameter so that the higher the numerical value, the lower the enhancement degree of the frequency processing. Set as a specified parameter.

(6g)画像濃度と指定濃度との差の重要度:

入力パラメータを、「0」〜「9」などと正規化された数値で、この数値が大きいほど領域内の画像ヒストグラム出現頻度が最大になる信号値の出力濃度と理想出力濃度の差の制限を狭くするように、あらかじめ、画像処理パラメータとは異なる尺度に基づいて予め定められたパラメータとして設定しておく。

(6g) Importance of difference between image density and specified density:

The input parameter is a numerical value normalized from “0” to “9”, etc., and the larger the numerical value is, the higher the frequency of appearance of the image histogram in the region is. In order to make it narrower, it is set in advance as a parameter determined in advance based on a scale different from the image processing parameter.

(6h)部位情報:

入力パラメータを、「0」〜「9」などと正規化された数値で、この数値が大きいほど、部位の大きさが大きい状態になるように、あらかじめ、画像処理パラメータとは異なる尺度に基づいて予め定められたパラメータとして設定しておく。具体的には指などでは上記のパラメータを0〜3程度、腹部などでは8〜9程度に設定すればよい。

(6h) Site information:

The input parameter is a numerical value normalized as “0” to “9” and the like, and based on a scale different from the image processing parameter in advance so that the larger the numerical value, the larger the size of the part. It is set as a predetermined parameter. Specifically, the above parameters may be set to about 0 to 3 for a finger or the like, and about 8 to 9 for an abdomen or the like.

(7)パラメータ変換:

ここで、画像処理パラメータは、画像処理部160で画像処理に使用されるパラメータであり、本実施形態では、操作入力部102から入力される入力パラメータとは別のパラメータであり、入力パラメータから画像処理パラメータが変換されるように予め定められたものである。

(7) Parameter conversion:

Here, the image processing parameter is a parameter used for image processing in the

ここで、画像処理パラメータは、コントラスト調整パラメータ、階調処理パラメータ、周波数強調処理パラメータ、イコライゼーション処理パラメータ、のうち少なくとも一つを含む1又は複数のパラメータである。 Here, the image processing parameter is one or more parameters including at least one of a contrast adjustment parameter, a gradation processing parameter, a frequency enhancement processing parameter, and an equalization processing parameter.

なお、画像処理を実行する際のパラメータ(画像処理パラメータ)は、一般的には関数の係数や各要素の重みなどが含まれる。

パラメータ変換部140での、入力パラメータから画像処理パラメータへのパラメータ変換では、意思決定理論に基づいて変換が実行されることが望ましい。ここでは、パラメータ変換部140に意思決定理論に基づいた変換手段を備えることで、複数の入力パラメータから変換、あるいは、複数の画像処理パラメータへの変換の際の組み合わせを考慮した変換が可能になる。

Note that parameters (image processing parameters) for executing image processing generally include a coefficient of a function, a weight of each element, and the like.

In the parameter conversion from the input parameter to the image processing parameter in the

なお、入力パラメータから画像処理パラメータへの意思決定理論を用いたパラメータ変換では、ファジィ積分に基づいて変換が実行されることが更に望ましい。このようにファジィ積分を用いることで、複数の入力パラメータから変換、あるいは、複数の画像処理パラメータへの変換の際の組み合わせを考慮した変換が可能になる。 In the parameter conversion using the decision making theory from the input parameter to the image processing parameter, it is more preferable that the conversion is executed based on fuzzy integration. By using fuzzy integration in this way, it is possible to convert from a plurality of input parameters, or to consider a combination when converting to a plurality of image processing parameters.

そして、このようなパラメータ変換を行うようにしていることで、画像処理内容の詳細を知らない場合であっても、主観的尺度に基づいた簡易な入力操作だけで、実際の画像処理に合致した適切な処理パラメータによって画像処理することが可能になる。 And by performing such parameter conversion, even if you do not know the details of the image processing content, only a simple input operation based on the subjective scale matched the actual image processing Image processing can be performed with appropriate processing parameters.

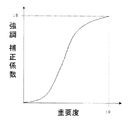

また、入力パラメータの大きさにより変換されるそれぞれの画像処理パラメータは、例えば線形に変換されてもよいし、図12のように非線形な変換テーブルであってもよい。

パラメータ変換の具体例:

なお、このパラメータ変換部140での入力パラメータから画像処理パラメータへのパラメータ変換として、以下のような具体例が考えられる。

・照射野形状→エッジ抽出の際の処理パラメータ、

・照射野広さ→エッジ抽出の際の処理パラメータ、

・画像中央重要度→画像中央に重み付けする際の分散値を求める処理パラメータ、

・画像特定領域重要度→特定領域に重み付けする際の分散値を求める処理パラメータ、

・画像高周波成分重要度→階調処理パラメータ、

・画像粒状抑制重要度→周波数強調処理パラメータ、

・画像濃度と指定濃度と差の重要度→濃度差が大きくならないようにするコントラスト調整パラメータ、

・部位情報(大〜小)→画像領域(画像全体〜画像中央部)への重みパラメータ、

Each image processing parameter to be converted according to the size of the input parameter may be converted linearly, for example, or may be a non-linear conversion table as shown in FIG.

Specific example of parameter conversion:

The following specific example can be considered as the parameter conversion from the input parameter to the image processing parameter in the

・ Irradiation field shape → Processing parameters for edge extraction,

・ Irradiation field size → Processing parameters for edge extraction,

-Image center importance → Processing parameter to obtain the variance value when weighting the image center,

-Image specific area importance → Processing parameter to obtain the variance value when weighting a specific area,

・ Image high frequency component importance → gradation processing parameters,

Image granularity suppression importance → frequency enhancement processing parameters,

The importance of the difference between the image density and the specified density → Contrast adjustment parameter to prevent the density difference from becoming large,

-Body part information (large to small) → weight parameter to image area (whole image to center of image),

(7a)照射野形状:

入力パラメータとして照射野形状(「1.円形」、「2.四角形」、「3.六角形」、「4.その他の多角形」、など)が入力された場合、設定された値をに応じてハフ変換により検出する図形の形状を変更する。具体的にはハフ変換による図形の抽出には、例えば直線抽出においては(はじめての画像処理技術、岡崎 彰夫著、工業調査会、P.100)直線の方程式は曲座標表示の場合、(x,y)を通る直線群はρ=xcosθ+ysinθで表すことができ、このρおよびθを1つ固定すると画像上の直線を1つ決定したことになる。したがって、上記のエッジ抽出などにより抽出されたエッジ点を通る直線群を(ρ,θ)空間にプロットした場合、同一直線上に複数のエッジ点が位置するようであれば、(ρ,θ)空間における複数の曲線が1点で交わることになる(図13参照)。

(7a) Irradiation field shape:

If an irradiation field shape (“1. Circular”, “2. Square”, “3. Hexagon”, “4. Other polygons”, etc.) is input as an input parameter, the set value will be The shape of the figure detected by the Hough transform is changed. Specifically, for the extraction of figures by Hough transform, for example, in straight line extraction (first image processing technology, written by Akio Okazaki, Industrial Research Committee, P. 100) A group of straight lines passing through y) can be expressed by ρ = xcos θ + ysin θ. When one of ρ and θ is fixed, one straight line on the image is determined. Therefore, when a group of straight lines passing through the edge points extracted by the above edge extraction or the like is plotted in the (ρ, θ) space, if a plurality of edge points are located on the same straight line, (ρ, θ) A plurality of curves in the space intersect at one point (see FIG. 13).

この交点における交わる曲線の本数(投票数)が閾値以上の直線を選択することで直線を検出することができる。同様に(c1,c2)を中心とし、半径が(x1,x2)と(c1,c2)の距離をとる円の群は点(x1,x2)を通る円の群となる。この(c1,c2)をパラメータ空間として同様の処理を行えば、円のエッジを検出することが可能になる。このように事前に検出するエッジの形状が分かっていれば、一方の処理のみを行うことで処理時間が早くなるだけでなく、直線に近い大きな弧を直線と誤認識することがなくなり、エッジの抽出精度を上げることができる。そして、操作者はこの形状を入力することで内部のハフ変換のような仕組みを意識することなく、精度のよいエッジ抽出が可能となる。 A straight line can be detected by selecting a straight line in which the number of intersecting curves (number of votes) at the intersection is equal to or greater than a threshold value. Similarly, a group of circles centered at (c1, c2) and having a radius of (x1, x2) and (c1, c2) is a group of circles passing through the point (x1, x2). If the same processing is performed using (c1, c2) as a parameter space, the edge of the circle can be detected. If the shape of the edge to be detected in advance is known in this way, not only the processing time is shortened by performing only one process, but a large arc close to a straight line is not erroneously recognized as a straight line. Extraction accuracy can be increased. Then, by inputting this shape, the operator can extract edges with high accuracy without being aware of the mechanism such as the internal Hough transform.

(7b)照射野広さ:

入力パラメータとして照射野広さ(「0.極めて狭い」〜「9.極めて広い」など)が入力された場合、入力値が大きいほど前述のハフ変換における投票数の閾値を大きくしすることで、より正確に照射野のエッジを抽出することができる。この場合も操作者は装置内部の画像処理動作や画像処理アルゴリズムなどを意識することはなく、照射野の広さという直感的な値(入力パラメータ)を入力すればよい。

(7b) Irradiation field size:

When an irradiation field size (such as “0. very narrow” to “9. extremely wide”) is input as an input parameter, by increasing the threshold value of the number of votes in the Hough transform as the input value increases, The edge of the irradiation field can be extracted more accurately. In this case as well, the operator is not conscious of the image processing operation or image processing algorithm inside the apparatus, and may input an intuitive value (input parameter) of the irradiation field width.

(7c)画像中央重要度:

入力パラメータとして画像中央重要度(「0」〜「9」などと正規化された数値で、画像中央についての重要度)が入力された場合、小さいほど画像全体で均一な重み付け、入力値が大きいほど中央に大きく重み付けする際の計算式の分散値を求める。このようにすることで、小さい値を入れるほど画像全体を重要に考え、大きい値を入れるほど画像中央を重要に考えるように、パラメータが変換されるようになる。

(7c) Image center importance:

When the image center importance (a numerical value normalized as “0” to “9”, etc., the importance for the image center) is input as an input parameter, the smaller the value, the more uniform weighting and the larger the input value. The dispersion value of the calculation formula when weighting the center more greatly is obtained. By doing so, parameters are converted so that the smaller the value, the more important the entire image is, and the larger the value, the more important the image center is.

(7d)特定領域重要度:

入力パラメータとして特定領域重要度(「1.画像右端側」、「2.画像左端側」、「3.画像上端側」、「4.画像下端側」、「5.その他の領域」、など)が入力された場合、入力パラメータに応じた位置で大きく重み付けする際の計算式の分散値を求めるように、パラメータが変換される。

(7d) Specific area importance:

Specific area importance as an input parameter (“1. Image right edge side”, “2. Image left edge side”, “3. Image upper edge side”, “4. Image lower edge side”, “5. Other areas”, etc.) Is input, the parameter is converted so as to obtain the variance value of the calculation formula when the weight is greatly weighted at the position corresponding to the input parameter.

(7e)画像の高周波成分の重要度:

入力パラメータとして高周波成分の重要度(「0」〜「9」などと正規化された数値で、この数値が大きいほど周波数処理の周波数特性を高周波を重視するパラメータ)が入力された場合、この数値が大きいほど周波数処理の周波数特性を高周波を重視するように、周波数強調処理や階調処理のパラメータに変換される。

(7e) Importance of high-frequency components in images:

If the importance of a high frequency component (a numerical value normalized as “0” to “9”, etc., where the higher the numerical value is, the more important the frequency characteristic of the frequency processing is, the higher frequency is important) is input as an input parameter. The larger the is, the more the frequency characteristics of the frequency processing are converted into parameters for frequency enhancement processing and gradation processing so that high frequency is important.

3チャンネルのフィルタをフィルタバンクとして使用する場合、高解像度レベル、具体的には分解レベルの上位1,2番目より得られるエッジ領域の測度が大きなファジィ測度の組み合わせを選択するようにすることで、操作者は内部の処理を意識することなく、高周波成分について最適化された階調処理パラメータを設定することができる。 When using a three-channel filter as a filter bank, by selecting a combination of fuzzy measures with a high measure of the edge area obtained from the high resolution level, specifically, the top and second ones of the decomposition level, An operator can set gradation processing parameters optimized for high-frequency components without being conscious of internal processing.

また、フィルタ処理に使用するマスクのサイズをMとした場合、入力パラメータpにタイして、パラメータ変換のための変換式M=30−3×pを用いることで、入力パラメータの数値が大きいほど高周波成分を強調することが可能になる。 In addition, when the size of the mask used for the filter processing is M, the input parameter p is typed and the conversion formula M = 30−3 × p for parameter conversion is used. High frequency components can be emphasized.

(7f)画像粒状抑制重要度:

入力パラメータとして画像粒状抑制重要度(「0」〜「9」などと正規化された数値)が入力された場合、この数値が大きいほど周波数処理の強調度を低くして粒状を抑制するような周波数処理の画像処理パラメータに変換される。

(7f) Image granularity suppression importance:

When an image granularity suppression importance (a numerical value normalized as “0” to “9”) is input as an input parameter, the larger the numerical value, the lower the frequency processing enhancement level and the lower the granularity. It is converted into an image processing parameter for frequency processing.

具体的には、周波数処理補正値をFHとした場合、入力パラメータpに対して、FH=p/10*2と算出する。そして、γ補正値をGHとした場合、GH=p/10*3と算出する。これらFH、GHを用いて周波数強調補正値および平均出力γ値に掛け合わせることで粒状を抑制した処理を行うことができる。 Specifically, when the frequency processing correction value is FH, FH = p / 10 * 2 is calculated for the input parameter p. When the γ correction value is GH, GH = p / 10 * 3 is calculated. By using these FH and GH to multiply the frequency emphasis correction value and the average output γ value, it is possible to perform processing with suppressed granularity.

(7g)画像濃度と指定濃度との差の重要度:

入力パラメータとして画像濃度と指定濃度との差の重要度(「0」〜「9」などと正規化された数値)が入力された場合、この数値が大きいほど領域内の画像ヒストグラム出現頻度が最大になる信号値の出力濃度と理想出力濃度の差の制限を狭くするように、濃度差が大きくならないようにするコントラスト調整パラメータに変換される。

(7g) Importance of difference between image density and specified density:

When the importance of the difference between the image density and the specified density (a numerical value normalized as “0” to “9”) is input as an input parameter, the larger this numerical value, the more frequently the image histogram appears in the area. In order to narrow the limit of the difference between the output density of the signal value and the ideal output density, it is converted into a contrast adjustment parameter that prevents the density difference from becoming large.

具体的には例えば差の制限値をRとすると、入力パラメータpに対して、R=p*0.3などとするにより制限値Rを算出し、この値より濃度差が大きくならないように処理を制限することで、簡単に常に領域内の濃度が指定範囲から一定の差であるような処理パラメータを設定することができる。 Specifically, for example, when the difference limit value is R, the limit value R is calculated by setting R = p * 0.3 or the like for the input parameter p, and processing is performed so that the density difference does not become larger than this value. By limiting this, it is possible to easily set processing parameters such that the density in the region always has a certain difference from the specified range.

(7h)部位情報:

入力パラメータとして部位情報(「1.指などの最も小さい部位」、「3.掌などの小さい部位」、「9.腹部などの最も大きい部位」などのように、「0」〜「9」などと正規化された数値)が入力された場合、入力された部位に対応する大きさにより、重要度の重みを変更するようなパラメータに変換する。たとえば、指のような小さな部位であれば画像中央度を中央程高い重みが置かれるように設定し、腹部のように大きな部位で画像全体にほぼ均一な重みがかかるようにする。

(7h) Site information:

As input parameters, such as “0” to “9” such as “1. smallest part such as finger”, “3. small part such as palm”, “9. largest part such as abdomen”, etc. And a normalized numerical value) are converted into parameters that change the weight of importance according to the size corresponding to the input part. For example, in the case of a small part such as a finger, the image centrality is set so that a higher weight is placed toward the center, and a substantially uniform weight is applied to the entire image in a large part such as the abdomen.

(7i)複数パラメータが独立でない場合の変換:

また、以上の複数の画像処理パラメータが互いに独立ではなく、お互いを適切な値に調整することで最適なパラメータが得られる場合には、従来であると画像処理内容を熟知していないと適切値を得ることはほとんど不可能であった。しかし、この実施形態では、そのような問題をも解消することができる。

(7i) Conversion when multiple parameters are not independent:

In addition, when the plurality of image processing parameters described above are not independent of each other and optimum parameters can be obtained by adjusting each other to an appropriate value, an appropriate value must be obtained unless the image processing content is well known. It was almost impossible to get. However, in this embodiment, such a problem can be solved.

ここで、互いに独立でない複数の画像処理パラメータとして、たとえば、「画像鮮鋭度」、「画像コントラスト」を考える。

これらの値は正規化された入力パラメータとして、0〜9(大きいほど、鮮鋭度、コントラストが高い)のランクで与えるようにしておく。このとき、例えば周波数強調処理の強調度βと階調処理のγを次の式で決定する。

β=R1*0.3*F、

γ=R2*0.5−β*0.8、

ここで、R1は画像先鋭度の入力パラメータ、R2は画像コントラストの入力パラメータである。また、Fは補正パラメータであって強調する周波数帯域により決定され、強調する周波数帯域が低周波であるほど小さな値を取るように決定される。

Here, for example, “image sharpness” and “image contrast” are considered as a plurality of image processing parameters that are not independent of each other.

These values are given as ranks of 0 to 9 (the higher the value, the higher the sharpness and the contrast) as normalized input parameters. At this time, for example, the enhancement degree β of frequency enhancement processing and γ of gradation processing are determined by the following equations.

β = R1 * 0.3 * F,

γ = R2 * 0.5−β * 0.8,

Here, R1 is an input parameter for image sharpness, and R2 is an input parameter for image contrast. F is a correction parameter and is determined by the frequency band to be emphasized, and is determined so as to take a smaller value as the frequency band to be emphasized is lower.

ここで、例えば、単純平均を用いた周波数強調処理のマスクのサイズをMとすれば、

F=1.1−M/3*0.1、

で与えることができる。

Here, for example, if the size of the mask for frequency emphasis processing using simple average is M,

F = 1.1−M / 3 * 0.1,

Can be given in

このように与えることで、相互に関係するパラメータを内部で変換することでユーザーは2つの独立のパラメータとして操作している状態になる。

このため、複数の画像処理パラメータが互いに独立ではない場合に、画像処理内容を熟知していなくとも、内部での関係するパラメータの変換により、所望の入力パラメータの調整だけで最終的な適切値を得ることが可能になる。

By giving in this way, the user is operating as two independent parameters by internally converting mutually related parameters.

For this reason, when a plurality of image processing parameters are not independent of each other, the final appropriate value can be obtained by adjusting the desired input parameters by converting the related parameters internally, even if the user does not know the details of the image processing. It becomes possible to obtain.

(8)画像処理パラメータに基づいた画像処理:

ここで、画像処理部160における画像処理パラメータを用いた放射線画像に対する画像処理は、階調処理、イコライゼーション処理、周波数強調処理、コントラスト調整処理、などが該当する。

(8) Image processing based on image processing parameters:

Here, the image processing on the radiation image using the image processing parameter in the

(8a)階調処理:

画像データ生成部110からの画像データに対し、パラメータ変換部140で変換された画像処理パラメータや重み付け統合部130で統合された重みにより、画像処理部160では、画像処理の一つとして階調処理が実行される。

(8a) Gradation processing:

The

この階調処理では、以下の評価関数を用いて階調処理条件の決定がなされる。ここで特徴量評価関数は、LUTのシフト値S、回転量Gをパラメータとして次のように設定される。 In this gradation processing, gradation processing conditions are determined using the following evaluation function. Here, the feature amount evaluation function is set as follows using the LUT shift value S and the rotation amount G as parameters.

ここで、f(x)は信号増幅率を補正するための関数、W(i,j)はxijの重みを表す。

具体的には、f(x)は、たとえば、

f(x)=x−1、但しx≧1の場合。

f(x)=−(1/x−1)、但し1>x>−1の場合。

f(x)=−C、但しx=0の場合。

である。

Here, f (x) represents a function for correcting the signal amplification factor, and W (i, j) represents the weight of xij.

Specifically, f (x) is, for example,

f (x) = x-1, where x ≧ 1.

f (x) = − (1 / x−1), where 1>x> −1.

f (x) =-C, where x = 0.

It is.

ここで、Cは、信号が0に変換される際の増幅率とする。このような補正関数を通すことで、増幅率が高い、あるいは、低いものを重点的に加点あるいは減点して評価することができる。s,g値の決定は、このEI(s,g)が最大になる値として決定される。 Here, C is an amplification factor when the signal is converted to zero. By passing through such a correction function, it is possible to evaluate the gains with high or low gains by adding or subtracting points. The s, g value is determined as a value that maximizes EI (s, g).

このようにすることで、画像無いの重みの高い画素を最も効果的にLUTにより増幅されるように変換することができる。なお、以上の各式におけるΔは、3〜5程度にとることが望ましい。 By doing so, it is possible to convert the pixels having no image and having a high weight so as to be most effectively amplified by the LUT. It should be noted that Δ in each of the above formulas is preferably about 3 to 5.

(8b)イコライゼーション処理:

イコライゼーション処理とは、画像のダイナミックレンジを圧縮することで画像内のすべての領域を可視範囲に収めることを可能とする処理であるが、その一方で強くこの処理をかけると画像全体のコントラストが失われる傾向があるため、適切な圧縮を行うことが望ましい。

(8b) Equalization processing:

The equalization process is a process that makes it possible to keep all areas in an image within the visible range by compressing the dynamic range of the image. On the other hand, if this process is applied strongly, the contrast of the entire image is lost. It is desirable to perform appropriate compression.

この適切なダイナミックレンジ圧縮を行うには、

まず、重み付きヒストグラムH(x)を生成する。ここで、xは画像のダイナミックレンジの範囲を値にとる変数であり、12ビット画像であれば、4095≧x≧0となる。このH(x)は、

To achieve this dynamic range compression,

First, a weighted histogram H (x) is generated. Here, x is a variable that takes the range of the dynamic range of the image as a value. For a 12-bit image, 4095 ≧ x ≧ 0. This H (x) is

で定義される。ただし、ここでΣは画像全体を走査し、画素値がxであるときのみ和をとるものとする。

ここで、D(x)は重み付きヒストグラム補正関数であり、たとえば、図14のようにすることで、全体的にイコライゼーション処理としては高信号値の重みを高くするなどの調整ができ、たとえば、皮膚などの描写を重視する際に有効である。

Defined by However, here, Σ scans the entire image and takes the sum only when the pixel value is x.

Here, D (x) is a weighted histogram correction function. For example, by making it as shown in FIG. 14, the overall equalization processing can be adjusted to increase the weight of the high signal value. This is effective when emphasizing the depiction of the skin.

このようなH(x)を考えることで、重みとその画素の個数の両方を加味した評価を行うことができる。

次に、このH(x)を評価する。評価はこのH(x)の値が所定のしきい値よりも大きな値をとる画素は重要な情報を多く含む画素値であるとして、この値をとる画素値に対してのみ行われる。

Considering such H (x), it is possible to perform evaluation in consideration of both the weight and the number of pixels.

Next, this H (x) is evaluated. The evaluation is performed only for the pixel value having this value, assuming that the pixel in which the value of H (x) is larger than the predetermined threshold value is a pixel value containing a lot of important information.

しきい値を超えた画素値xは、階調処理条件として決定したLUTに対して、A(s,g)(x)により増幅率を計算する。このA(s,g)(xij)が所定のしきい値より小さくなる画素が存在する場合には、イコライゼーション処理の度合いを決定するパラメータを強める方向に変更し、イコライゼーション処理の画像に再び同じ評価を行う。この操作をしきい値以下の画素値が無くなるまで、あるいは、あらかじめ定めたパラメータの条件値まで繰り返すことで適切なイコライゼーション処理を行うことが可能になる。 For the pixel value x exceeding the threshold value, the amplification factor is calculated by A (s, g) (x) with respect to the LUT determined as the gradation processing condition. If there is a pixel in which A (s, g) (xij) is smaller than a predetermined threshold, the parameter for determining the degree of equalization processing is changed in a direction to increase and the same evaluation is performed again on the equalization processing image. I do. By repeating this operation until the pixel value equal to or less than the threshold value disappears or until the condition value of a predetermined parameter is set, an appropriate equalization process can be performed.

(8c)周波数強調処理:

周波数強調処理は画像の高周波成分を強調することにより行われ、画像の鮮鋭度を向上させることが可能となる。しかし、一方で必要以上に処理を施した場合、画像の粒状を悪化させる問題があった。この周波数強調処理を重み付き画像により次のように処理する。すなわち、図15のグラフから算出される強調補正係数を、周波数処理の強調度を表す係数にかける。

(8c) Frequency enhancement processing:

The frequency enhancement process is performed by enhancing the high frequency component of the image, and the sharpness of the image can be improved. However, when processing is performed more than necessary, there is a problem of deteriorating the graininess of the image. This frequency enhancement process is performed as follows using a weighted image. That is, the enhancement correction coefficient calculated from the graph of FIG. 15 is applied to a coefficient representing the enhancement degree of frequency processing.

これにより画素毎に重み付けの小さい画素で周波数処理の強調度を小さくすることが可能となり、ノイズや照射野外などの診断上不要な領域を選択的に弱い強調度を与えることもできる。 As a result, it is possible to reduce the enhancement degree of the frequency processing with a pixel having a small weight for each pixel, and it is possible to selectively give a weak enhancement degree to a region unnecessary for diagnosis, such as noise or an irradiation field.

また、この強調補正係数は図16のように重要度の低い画素で負の値を取ることで、その画素値を減弱するようにしてもよい。さらにこの重み付け画像を作成する際に画像粒状度を使用し、粒状度の重みを高く設定する、あるいはファジィ積分による測度を大きくするなどの方法をとれば画像の粒状度を反映した処理が可能であり、粒状の悪い画像では全体的にその処理を抑えることができる。 Further, this enhancement correction coefficient may be attenuated by taking a negative value at a low importance pixel as shown in FIG. Furthermore, processing that reflects the granularity of the image is possible by using image granularity when creating this weighted image and using a method such as setting a high granularity weight or increasing the measure by fuzzy integration. Yes, the overall processing can be suppressed for images with poor graininess.

(8d)コントラスト調整処理:

画像コントラストの調整として、たとえば画像中央度を参照し、この重要度小さな場合は周波数強調度を上げて階調処理のコントラストを下げるなどの方法がある。このときの強調度とγの関係は強調する周波数帯域などに依存しているのですべての場合に適用できるわけではないが、γを0.1下げるのに対して周波数処理の強調度(高周波成分の加算度)を0.1上げるのが良好である。

(8d) Contrast adjustment processing:

As the image contrast adjustment, for example, there is a method of referring to the image centrality and, when the importance is small, increasing the frequency enhancement degree to lower the gradation processing contrast. The relationship between the degree of enhancement and γ at this time depends on the frequency band to be emphasized and is not applicable to all cases. However, the degree of enhancement of frequency processing (high-frequency component) is reduced against γ by 0.1. It is preferable to increase the degree of addition) by 0.1.

(9)表示、出力:

処理済みの画像データについて画像表示部160に画像表示する必要があれば(図2S9でY)、画像処理済みの放射線画像を表示する際に、与えられた重み、入力された入力パラメータ、パラメータ変換により変換された画像処理パラメータ、のいずれかを放射線画像上に重畳した状態で表示する(図2S10)。ここでは、放射線画像の表示に対して、少なくとも、画像処理パラメータを重畳させて画像表示することが望ましい。

(9) Display and output:

If it is necessary to display an image of the processed image data on the image display unit 160 (Y in FIG. 2 S9), when displaying the image processed radiographic image, a given weight, input parameters, parameter conversion Any one of the image processing parameters converted by the above is displayed in a state of being superimposed on the radiation image (S10 in FIG. 2). Here, it is desirable to display an image with at least an image processing parameter superimposed on the display of the radiation image.

このようにすることで、どのような重みが与えられて画像処理がなされたかが明瞭になる。また、このようにすることで、入力パラメータから変換されたどのような画像処理パラメータが与えられて画像処理がなされたかが明瞭になる。また、このようにすることで、入力パラメータと画像処理パラメータとの関係が明らかになり、適切な入力パラメータを入力できたかも明瞭になる。 By doing so, it becomes clear what weight is given and image processing is performed. Further, by doing so, it becomes clear what image processing parameter converted from the input parameter is given and the image processing is performed. Further, by doing so, the relationship between the input parameter and the image processing parameter is clarified, and it becomes clear that an appropriate input parameter has been input.

さらに、複数種類の重み付けを並行して実行し、これら複数の重み付けを参照して入力パラメータに基づいて変換された複数の画像処理パラメータのそれぞれに従い画像処理を実行しておき、複数の画像処理パラメータのそれぞれで実行された放射線画像を順次表示することも可能である。 Further, a plurality of types of weighting are executed in parallel, and image processing is executed in accordance with each of the plurality of image processing parameters converted based on the input parameters with reference to the plurality of weights. It is also possible to sequentially display the radiographic images executed in each of the above.