JP2004342003A - Image processing method and apparatus, and image processing system - Google Patents

Image processing method and apparatus, and image processing system Download PDFInfo

- Publication number

- JP2004342003A JP2004342003A JP2003140378A JP2003140378A JP2004342003A JP 2004342003 A JP2004342003 A JP 2004342003A JP 2003140378 A JP2003140378 A JP 2003140378A JP 2003140378 A JP2003140378 A JP 2003140378A JP 2004342003 A JP2004342003 A JP 2004342003A

- Authority

- JP

- Japan

- Prior art keywords

- image processing

- image

- parameter

- processing

- parameters

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Pending

Links

Images

Abstract

Description

【0001】

【発明の属する技術分野】

本発明は画像処理方法及び装置に係り、特にデジタルカメラやカメラ付き携帯電話機などにより撮影された人物の顔画像を好みの画像に加工する際の操作性の向上に好適な方法及び装置並びにシステムに関する。

【0002】

【従来の技術】

近時、デジタルカメラやカメラ付き携帯電話機などが普及し、手軽な撮影手段の一つとして多くの人に利用されている。また、オリジナルの画像データに対して様々な画像処理を施すことにより、意図する表現の画像に変換することも広く行われている。

【0003】

特許文献1では、関連のある複数コマの特定領域に対して所定の画像処理を施すことができる画像処理方法が提案されている。

【0004】

【特許文献1】

特開平11−275351号公報

【0005】

【発明が解決しようとする課題】

人物の顔写真を画像処理して好みの画像を生成する場合、処理の内容や対象部位の指定など設定項目が多岐にわたり、パラメータの設定操作が複雑である。特に、携帯電話機のような小型のモバイル端末においては、操作ボタンが小さく、その個数も限られていることから、一層複雑な操作が強いられる。

【0006】

本発明はこのような事情に鑑みてなされたもので、人物画像に対する複雑な処理を簡単な操作で実現することができる画像処理方法及び装置並びにシステムを提供することを目的とする。

【0007】

【課題を解決するための手段】

前記目的を達成するために本発明に係る画像処理方法は、原画像から人物の顔パーツを抽出し、抽出した顔パーツに画像処理を施して所望の表現の画像を生成する画像処理方法であって、処理の対象領域に対して定義されている画像処理パラメータをユーザ操作に応じて変更できる構成とし、前回までに実施された画像処理において設定された画像処理パラメータから次の画像処理のデフォルトパラメータを自動的に設定し、その後、画像処理を行う時に前記デフォルトパラメータを反映した画像処理を実施し、該処理により生成された変換画像を表示手段に表示するとともに、前記デフォルトパラメータを基準としてさらにパラメータを変更するパラメータ調整操作を受け付け、前記パラメータ調整操作によってパラメータが変更されると、該変更された画像処理パラメータに従って画像処理を実施することを特徴とする。

【0008】

本発明によれば、人物を含む原画像の中から画像解析によって「目」,「鼻」,「口」などの顔パーツ(顔の部位)を少なくとも1つ(好ましくは複数)抽出し、各パーツ領域に対して画像処理パラメータに従って画像処理を施すことにより、好ましい表現の画像を得ることができる。処理の対象になる領域について画像処理の内容を規定するパラメータが定義されており、ユーザは意図する表現の画像となるようにユーザインターフェースを通じて画像処理パラメータを設定することができる。

【0009】

一度パラメータを設定して画像処理を実施すると、その実績から次回のデフォルトパラメータが自動的に設定され、次回以降はデフォルトパラメータに基づいて画像処理が実施される。デフォルトパラメータに従って生成された変換画像は表示手段に表示されるため、ユーザはその表示を見て処理結果の画像を確認できる。得られた結果が意図するものでなければ、パラメータの調整操作を行う。この調整操作は、現在のデフォルトパラメータを基準としてこれに増減値(変化量)を指定するなど、デフォルトパラメータに対して修正を加えるものである。デフォルトパラメータを基準にパラメータを調整することことにより、所望の条件を簡単に設定することができる。

【0010】

こうして変更されたパラメータに従って画像処理をやり直し、処理結果の変換画像を提供する。なお、修正されたパラメータの情報は、次のデフォルトパラメータの設定に利用される。

【0011】

このように、本発明によれば、過去に実施した画像処理のパラメータに基づいて次の画像処理におけるデフォルトパラメータを自動的に設定し、デフォルトパラメータに基づく処理(デフォルト処理)によって希望する画像が得られなかったときには、そのパラメータを基準にさらなるパラメータの調整を行うようにしたので、所望の画像が得られるまでの処理回数を大幅に減らすことができる。

【0012】

また、本発明によれば、例えば、処理の対象領域が人物全体に及ぶ場合、人物から区別された背景部に及ぶ場合、或いは、頭髪、唇、胴体、衣服、装身具などのパーツに対して、位置、形状特性、濃度特性、色味特性、テクスチャー特性、空間周波数特性から選択される処理についても処理パラメータを記憶し、次回以降の変換に反映させることも可能である。

【0013】

上記方法発明を具現化する装置を提供するため、本発明に係る画像処理装置は、入力された原画像から人物の顔パーツを抽出する顔パーツ抽出手段と、前記顔パーツ抽出手段により抽出される顔パーツを含む処理の対象領域について定義されている画像処理パラメータの設定を変更する操作を行うためのパラメータ変更操作手段と、設定された画像処理パラメータに従って前記原画像の対象領域に画像処理を施し、該パラメータを反映した表現の画像を生成する画像処理手段と、前回までに実施された画像処理において設定された画像処理パラメータから次の画像処理におけるデフォルトパラメータを自動的に設定するデフォルトパラメータ自動設定手段と、前記デフォルトパラメータ自動設定手段によって設定されたデフォルトパラメータに基づいて前記画像処理手段で生成した変換画像を表示する表示手段と、前記デフォルトパラメータを基準としてさらにパラメータを変更するパラメータ調整操作を受け付け、前記パラメータ変更操作手段からパラメータの調整指示が入力されると、該指示に応じて変更された画像処理パラメータに従って前記画像処理手段による画像処理を実施させる画像処理制御手段と、を備えたことを特徴とする。

【0014】

本発明の一態様によれば、前記デフォルトパラメータ自動設定手段は、前回実施された画像処理で使用した画像処理パラメータを記憶する記憶手段を備え、前回の画像処理パラメータを次の画像処理のデフォルトパラメータに設定することを特徴とする。

【0015】

また、前回のパラメータを次回のデフォルトに設定する態様に限らず、過去の処理履歴から設定頻度の高いものをデフォルトに設定したり、過去の履歴から設定値の平均値などを求めてその値をデフォルトに設定したりするなどの態様もあり得る。蓄積された履歴情報からデフォルトの処理が決定される場合には、画像処理の実行回数が増えるほど、そのユーザが好む処理パラメータを正確に次回のデータに反映させることができる。

【0016】

本発明の画像処理装置は、通信回線網に接続する通信手段と、被写体の光学像を電気信号に変換する撮像手段と、前記撮像手段を介して撮影された画像を記録する画像記録手段と、を備えたカメラ付き携帯電話機に搭載される態様がある。

【0017】

カメラ付き携帯電話機に代表される小型のモバイル端末は、操作ボタンが小さいなど操作系に制約があるので、本発明によって操作性の向上が図られることは非常に有益である。なお、本発明の画像処理装置は、カメラ付き携帯電話機のような単独の機器で実現される場合に限定されるものではなく、画像処理装置を構成する一部の手段を備える複数の装置(機器)を組み合わせることにより、全体として本発明の画像処理装置を実現する形態もある。

【0018】

本発明のさらに他の態様は、前記目的を達成する画像処理システムを提供するものである。すなわち、原画像のデータをネットワーク経由で送出する通信手段を備えた通信端末と、前記ネットワークを介して前記通信端末から送られてきた画像データを処理する画像処理サーバと、から構成される画像処理システムであって、前記画像処理サーバは、前記通信端末から取得した原画像から人物の顔パーツを抽出する顔パーツ抽出手段と、前記顔パーツ抽出手段により抽出された顔パーツを含む処理の対象領域に対して、設定されている画像処理パラメータに従って画像処理を施し、該パラメータを反映した表現の画像を生成する画像処理手段と、前記画像処理手段で生成した変換画像を前記ネットワーク経由で前記通信端末に提供する画像提供手段と、を備え、前記通信端末は、前記対象領域について定義されている画像処理パラメータの設定を変更する操作を行うためのパラメータ変更操作手段と、前記画像処理手段により生成された変換画像を表示する表示手段と、前記パラメータ変更操作手段からの指示に応じたパラメータ情報を前記画像処理サーバに提供するパラメータ情報提供手段と、を備え、前記画像処理サーバ又は前記通信端末には、前回までに実施された画像処理において設定された画像処理パラメータから次の画像処理のデフォルトパラメータを自動的に設定するデフォルトパラメータ自動設定手段が設けられており、前記デフォルトパラメータ自動設定手段によって設定されたデフォルトパラメータに従って前記画像処理手段により生成された変換画像を前記表示手段に表示させるとともに、前記デフォルトパラメータを基準としてさらにパラメータを変更するパラメータ調整操作を受け付け、前記パラメータ変更操作手段からパラメータの調整指示が入力されると、該指示に応じたパラメータ情報が前記画像処理サーバに提供され、該調整指示に応じて変更された画像処理パラメータに従って前記画像処理手段による画像処理が実施されることを特徴とする。

【0019】

通信端末側にデフォルトパラメータ自動設定手段が設けられている場合には、画像処理の依頼時に通信端末からデフォルトパラメータの情報を画像処理サーバに提供する。

【0020】

また、画像処理サーバ側にデフォルトパラメータ自動設定手段を備える態様も可能である。この場合、通信端末の操作系で指定されたパラメータ情報が画像処理サーバに送られ、画像処理サーバ内にパラメータ情報が保存される。

【0021】

【発明の実施の形態】

以下添付図面に従って本発明の好ましい実施の形態について詳説する。

【0022】

〔第1の実施形態〕

図1は、本発明の第1の実施形態に係るカメラ付き携帯電話機の一例を示す外観図である。携帯電話機10には、カメラ部12、アンテナ14、ディスプレイ16、受話口17、送話口18及び操作部20が設けられている。操作部20には、ダイヤルボタン21、通話ボタン22、通話切兼用電源ボタン23、十字ボタン24、実行ボタン25その他の各種の操作手段が含まれる。操作部20は、プッシュ式のスイッチ部材に限定されず、ダイヤル部材、レバースイッチなどの構成も可能である。

【0023】

ディスプレイ16は、カラー表示可能な液晶ディスプレイで構成される。もちろん、有機ELなど他の方式の表示装置を適用してもよい。図1中符号27は動画再生時の音声や各種効果音等を出力するためのスピーカである。なお、図1には明示されていないが、この携帯電話機10には動画撮影時の音声を取り込むためのマイク(図2の符号28として記載)が設けられている。

【0024】

図1に示したように、カメラ部12は、携帯電話機10の筐体29に対して回動自在に取り付けられている。カメラ部12を回すことで撮影方向を自由に変更することができ、図示のようにディスプレイ16の表示面側にカメラを向けたり、或いは、ディスプレイ16の背面側にカメラを向けたりすることができる。かかる回転機能付きのカメラ部12に代えて、所定の位置に固設されたカメラ部を搭載する態様も可能であり、また、複数のカメラ部を搭載する態様も可能である。

【0025】

図2は、携帯電話機10の構成を示すブロック図である。同図に示したように、携帯電話機10は、中央演算処理装置(CPU)30、メモリ32、音声処理部34、送受信回路36、受話口17のスピーカ37、送話口18のマイク38といった通常の電話機能を実現するために必要な構成要素を備えている。

【0026】

CPU30は、所定のプログラムに従って携帯電話機10全体の動作を制御する制御部として機能するとともに、各種演算を行う演算装置として機能する。すなわち、CPU30は、操作部20から入力される指令信号に基づいて携帯電話機10内の各回路を制御し、通信制御、撮影動作制御、画像処理制御、ディスプレイ16の表示制御、メモリ32の読み書き制御及び容量管理(空き容量の検出を含む)などを行う。

【0027】

CPU30はバス39を介してメモリ32と接続されている。メモリ32は、CPU30が実行するプログラム及び制御に必要な各種データなどが格納される不揮発性メモリ領域と、プログラムの展開領域及びCPU30の演算作業用領域として利用される揮発性メモリ領域とを含むブロックである。不揮発性メモリ領域は、電話機帳や通話履歴のデータ記憶領域として利用されるとともに、音声や画像の保存領域として利用される。本発明の画像処理機能における処理パラメータの情報は不揮発性メモリ領域に格納される。また、揮発性メモリ領域は、画像データの一時記憶領域としても利用される。

【0028】

音声処理部34は、CPU30と連携して音声信号を処理又は変換する手段である。音声処理部34は、送受信回路36から受入したデータの復号化処理及び送受信回路36を通じて送信するデータの符号化処理を行うとともに、スピーカ27、37への出力信号生成処理、マイク28、38からの入力音声信号の符号化処理などを行う。

【0029】

通話モード(電話機能を使用するモード)において、通信相手との通信接続が確立されると、マイク28から入力される音声は電気信号に変換され、音声処理部34に送られる。音声処理部34はマイク38から入力された音声信号をデジタル信号に変換(A/D変換)した後、所要の信号処理を行い、所定形式の音声データに変換する。音声処理部34で処理された音声データ(送信用のデータ)は、バス39を介して送受信回路36に送られ、所定の送信用信号形式に変換された後、アンテナ14から送信される。

【0030】

また、アンテナ14によって受波された信号は、送受信回路36において復調され、音声処理部34に送られる。音声処理部34は、送受信回路36から受入した音声信号を所定形式の音声データに変換する。音声処理部34で生成された音声データ(受信データ)は、アナログ音声信号に変換(D/A変換)された後、スピーカ37に送られる。こうして、通話相手の音声がスピーカ37から可聴出力される。もちろん、携帯電話機10は、音声データのみならず、電子メール機能やインターネットのブラウザ機能などを利用して画像データ、文書データ、プログラムデータなど種々のデータを送受信することが可能である。

【0031】

さらに、携帯電話機10は、撮影レンズ40とCCDイメージセンサ(以下、CCDという。)42を有し、CCD42から得られる画像信号を処理するためのアナログ処理部44、A/D変換器45、画像処理部46、圧縮伸張部47を備えている。なお、本例では撮像素子としてCCDを用いるが、CCD型に限らず、CMOS型など他の方式によるデバイスを用いてもよい。

【0032】

撮影レンズ40を通過した光はCCD42の受光面の上に焦点を結ぶ。CCD42の受光面には多数のフォトセンサ(受光素子)が平面的に配列され、各フォトセンサに対応して赤(R)、緑(G)、青(B)の原色カラーフィルタが所定の配列構造で配置されている。RGBカラーフィルタに代えて、CMY等のカラーフィルタを用いることもできる。

【0033】

CCD42の受光面に結像された被写体像は、各フォトセンサによって入射光量に応じた量の信号電荷に変換される。CCD42は、シャッタゲートパルスのタイミングによって各フォトセンサの電荷蓄積時間(シャッタスピード)を制御する電子シャッタ機能を有している。

【0034】

CCD42の各フォトセンサに蓄積された信号電荷は、CPU30の指令に従いタイミングジェネレータ(TG)48から与えられるパルス(水平駆動パルスφH,垂直駆動パルスφV,オーバーフロードレインパルス)に基づいて信号電荷に応じた電圧信号(画像信号)として順次読み出される。CCD42から出力された画像信号は、アナログ処理部44に送られ、相関二重サンプリング(CDS)処理やゲイン調整などの所要の処理が施された後、A/D変換器45によってデジタル信号に変換される。デジタル化された画像データは画像処理部46に送られる。

【0035】

画像処理部46は、同時化回路(単板CCDのカラーフィルタ配列に伴う色信号の空間的なズレを補間して各点の色を計算する処理回路)、輝度・色差信号生成回路、ガンマ補正回路、輪郭補正回路、ホワイトバランス補正回路等を含むデジタル画像信号処理手段であり、CPU30からのコマンドに従ってメモリ32を活用しながら画像信号を処理する。

【0036】

画像処理部46において、ホワイトバランス調整処理、ガンマ変換処理、輝度信号(Y信号)及び色差信号(Cr,Cb 信号)への変換処理(YC処理)など、所定の処理が施されて生成された画像データはメモリ32に一時的に記憶される。ここで、撮影中の映像をディスプレイ16に表示させる場合には、このメモリ32の内容を読み出して表示回路50に送り、表示回路50において表示用の信号形式に変換した後、ディスプレイ16に供給する。これにより、CCD42が捉えているリアルタイム映像(スルー画)がディスプレイ16に表示され、撮影者はディスプレイ16の表示映像によって撮影画角(構図)を確認できる。

【0037】

操作部20の撮影ボタン(例えば、実行ボタン25で兼用)が押されると、CPU30はこれを検知して、記録用の撮影動作を実行する。すなわち、撮影ボタンの押下に応動してCCD42の露光制御及び電荷の読み出し制御が行われる。こうして取り込まれた記録用の画像データは、画像処理部46においてYC処理その他の所定の信号処理を経た後、圧縮伸張部47に送られ、ここで所定の圧縮フォーマット(例えば、JPEG形式) に従って圧縮される。圧縮された画像データは、メモリ32の画像保存領域に格納される。

【0038】

動画撮影モードが選択されている場合には、撮影ボタンの押下によって録画動作がスタートし、その後もう一度撮影ボタンを押下すると動画記録作が停止する。なお、撮影ボタンの押下継続中に録画動作を行い、押下解除により録画を停止するようにしてもよい。

【0039】

動画撮影時の音声は、マイク28によって検出され、その検出信号(音声信号)は、音声処理部34において所定の信号形式に変換される。この音声データは、画像データとともに圧縮伸張部47において所定の圧縮フォーマット(例えば、MP4形式)に従って圧縮処理された後メモリ32に記録される。

【0040】

画像再生時には、ユーザのファイル選択操作に応じて、または自動的にメモリ32から画像ファイルのデータが読み出される。メモリ32から読み出された圧縮データは、圧縮伸張部47によって伸張され、表示回路50を介して表示用の信号に変換された後、ディスプレイに出力される。これにより、当該ファイルの画像内容がディスプレイ上に表示される。

【0041】

図3は、携帯電話機10に搭載されている画像処理装置の要部を示す機能ブロック図である。

【0042】

図示のように画像処理装置52は、顔領域抽出部54と、顔パーツ抽出部55と、画像変換部56と、パラメータデータ記憶部57と、を備えている。画像処理装置52は、ハードウエアとソフトウエアとの適宜の組み合わせによって実現され得る。本例の場合、顔領域抽出部54,顔パーツ抽出部55,画像変換部56は図2の画像処理部46に含まれ、パラメータデータ記憶部57は図2のメモリ32に含まれる。

【0043】

図3に示したとおり、顔画像を含む原画像(被処理画像)60のデータは画像処理装置52に入力され、顔領域抽出部54及び顔パーツ抽出部55に送られる。顔領域抽出部54は、入力された画像データを解析して画像中から顔領域を抽出する。顔パーツ抽出部55は目、鼻、口、眉などの顔パーツを抽出する。

【0044】

原画像60からの顔領域の抽出方法としては、例えば、原画像内の目、鼻、口等の顔パーツを抽出するために特徴抽出処理を行う。特徴抽出処理では、ウェーブレット変換を行い適切な位置と周波数のウェーブレット係数を取り出して量子化する。予め多数のサンプル画像から同様の特徴抽出処理を行い作成しておいた顔パーツ辞書データとの間でマッチング処理を行い、顔パーツを抽出する。

【0045】

顔パーツが抽出された位置を顔と判定し、色、テクスチャーによる分割処理が施される。これは、似た色やテクスチャーの領域をまとめて分割する処理を行い、例えば、目の座標を含む肌色領域を顔領域としたり、目の座標のやや上にあり黒、茶色の領域を髪領域としたりして人物領域を抽出する。また、目の位置および人物と背景の境界線の平均的な位置関係を示す人物領域辞書データと、原画像から得られた人物領域と背景領域との境界線とのマッチング処理を行い、人物領域と背景領域との境界線を求める。

【0046】

また、原画像60内の高周波成分から人物と背景の境界線を抽出するフィルタ処理を施し、原画像60から人物領域を抽出する方法や、原画像60内の肌色を抽出し、その肌色の領域のある点から同一領域に属すると思われる連結領域に対して順次領域拡張を行い、このようにして抽出された領域の形状が顔の形状か否かによって顔領域を抽出し、同様にして顔領域の上部の髪領域、顔の下部の首及び胸部領域等を抽出することで、人物領域を抽出する方法等がある。なお、原画像60から人物領域を抽出する方法は、種々の方法が考えられ、上記の方法に限定されない。

【0047】

顔領域抽出部54及び顔パーツ抽出部55によって抽出された顔パーツ情報は、画像変換部56に送られる。画像変換部56は、抽出された目領域、鼻領域、口領域など処理の対象領域について、それぞれパラメータデータ記憶部57内の画像処理パラメータを参照して、そのパラメータに従って画像処理を行い、パラメータを反映させた表現の画像を生成する。

【0048】

パラメータデータ記憶部57には、前回の画像処理で使用した画像処理パラメータのデータが保存されており、この保存されている画像処理パラメータがデフォルトのパラメータとして設定される。パラメータデータ記憶部57に過去の画像処理パラメータが記憶されていない場合には、操作部20から所望のパラメータを入力する操作を行う。

【0049】

こうして、画像変換部56においてパラメータを反映させた画像(変換画像62)が生成される。画像変換部56で生成された変換画像62は、ディスプレイ16に表示される。

【0050】

表示された画像が意図するものでない場合、ユーザは操作部20からパラメータの微調整を行う。例えば、十字ボタンなどによって現在の設定パラメータに対する調整値(デフォルトパラメータを基準とする変化量の指定)を入力したり、メニュー画面からパラメータの変更値を選択したりする。こうして、調整されたパラメータに基づいて画像変換部56における画像処理をやり直し、修正後のパラメータを反映させた変換画像62を生成するとともに、ディスプレイ16の表示画像を更新する。こうして、パラメータ調整後の処理結果画像がディスプレイ16に表示される。

【0051】

気に入った画像が得られるまで上記の操作が繰り返される。意図する表現の画像が得られたら画像処理の操作を終了する。このとき、好みの画像が得られた画像処理パラメータの情報がパラメータデータ記憶部57に保存される。

【0052】

次回、別の画像について画像処理を行う場合、パラメータデータ記憶部57に記憶されている前回の画像処理パラメータがデフォルトとして設定されるため、前回と同様の処理結果を簡単に得ることができる。

【0053】

図4は、携帯電話機10における画像処理の手順を示したフローチャートであり、図5は画面例を示す図である。まず、携帯電話機10のディスプレイ16に顔画像を表示させる(図4のステップS110)。表示対象の画像は、カメラ部12で撮影した直後のプレビュー画像、メモリ32に保存されているファイルの再生画像、メールで受信した画像など、多様な態様があり得る。

【0054】

図5(a)に示したように、顔画像の表示と同時に、ディスプレイ16の画面右下に「画像処理」のコマンドメニュー71が表示される。このメニュー表示は、符号72の操作ボタンに「画像処理ボタン」の機能が割り当てられたことを意味している。

【0055】

表示中の顔画像に対して画像処理を施すことを希望する場合、ユーザは画像処理ボタン(操作ボタン72)を押す。「画像処理」のコマンドを選択する操作が行われると(図4のステップS112)、CPU30はこれを検知し、処理パラメータのデータの有無を判定する(ステップS114)。以前に画像処理を実施した実績がある場合には、そのときの処理パラメータの情報がメモリ32に記憶されている。メモリ32内に蓄積されたパラメータデータがあるときは(ステップS114でYES時)、その処理パラメータの設定を反映した画像処理を実行し、変換後の画像(処理結果画像)をディスプレイ16に表示する(ステップS118)。

【0056】

その一方、ステップS114において処理パラメータのデータが記憶されていないと判定した場合(NO判定時)、処理パラメータの設定操作を受け付ける(ステップS116)。

【0057】

図6は画像処理パラメータの例を示した図表である。図6によれば、処理の対象領域として、顔、頭髪、眼部、唇、胴体、衣服、装身具、鼻、背景などが定められ、それぞれの対象領域について、形状、位置、濃度特性、色味特性、テクスチャー特性、空間周波数特性などの画像特徴量を設定することができる。

【0058】

顔の「形状」について左右、上下方向に±1,±2,±3という段階調整率が定義されており、ユーザは好みに応じて+/−ボタン(十字ボタンの上下キーにて兼用)を操作してパラメータを入力することにより、顔の大きさを太くしたり、細くしたりする。同様に、眼部や唇などの形状についても、±1,±2,±3という段階調整率が定義されるものとする。

【0059】

「頭髪」の形状については、予め多様なヘアースタイルを表す頭髪画像(貼り付け合成用のパーツ画像)が複数用意されており、ユーザが好みの頭髪画像を選択することができるようになっている。図6では、タイプ「C」に定義付けられている頭髪画像が選択されていることを示している。「装身具」の形状については、予め複数種類の装身具画像が用意されており、図6ではタイプ「R」に定義付けられている装身具画像が選択されている。「鼻」の形状は、高い鼻、低い鼻など、複数種類のタイプが定義されており、図6ではタイプ「B」が選択されていることを示している。

【0060】

また、形状、位置、濃度特性、色味特性、テクスチャー特性、空間周波数特性に関しては、それぞれの特徴量を段階的に調整するための調整値(例えば、±1,±2,±3)が定義されている。ユーザは十字ボタン24などによって所望の調整値を指定することができる。例えば、眼部の位置を上下方向に+1調整し、鼻の位置を上下方向に+2調整する。

【0061】

こうして、設定された画像処理パラメータに従って画像処理(合成用のパーツ画像を貼り付ける合成処理を含む)が実施され、パラメータを反映した変換画像がディスプレイ16に表示される(図4のステップS118)。このとき、図5(b)のように、変換結果を示す画像の表示と同時に、ディスプレイ16の画面下に「これでOK」のコマンドメニュー74と、「さらに処理」のコマンドメニュー75が表示される。これらメニュー表示は、符号76の操作ボタンに「これでOK」の指令機能が割り当てられ、符号72の操作ボタンに「さらに処理」の指令機能が割り当てられたことを意味している。

【0062】

ディスプレイ16に表示された変換画像が気に入らなければ、「さらに処理」のボタン(操作ボタン72)を押し、パラメータ変更入力画面に移行してパラメータの調整を行う。その一方、ディスプレイ16に表示された変換画像でOKと判断した場合には、「これでOK」のボタン(操作ボタン76)を押して処理を終了させる。

【0063】

すなわち、図4のステップS118において変換画像を表示した状態でユーザからの指示入力が待機され、入力された指示に従って表示中の変換画像で良いか否かの判定を行う(ステップS120)。「さらに処理」のボタンが押された場合には、ステップS120においてNO判定となり、ステップS122に進む。ステップS122では、前の処理で使用したパラメータを基準としてさらに処理パラメータを調整する操作が受け付けられる。例えば、前の処理で使用したパラメータ値が「+2」であった場合には、その値に対してさらに「+1」を加算して「+3」に修正したり、「+2」から−1調整を行って「+1」に修正したりすることができる。

【0064】

ステップS122においてパラメータの調整が行われると、ステップS118に戻り、その変更されたパラメータに基づいて画像処理が行われ、処理後の変換画像がディスプレイ16に表示される。

【0065】

ステップS120において、「これでOK」のボタンが押されると、本シーケンスを終了する。

【0066】

本例の携帯電話機10によれば、ある顔画像Aについて一度画像処理のパラメータを設定して画像処理を実施すると、そのときの画像処理パラメータが記憶され、次回のデフォルトパラメータとなる。したがって、その後、別の顔画像Bについて画像処理をするときに、「画像処理」のボタンを押すと、自動的にデフォルトパラメータが参照され、顔画像Aに施したパラメータを反映した処理がデフォルト処理として実施され、その処理結果がディスプレイ16に表示される。

【0067】

このデフォルト処理の結果が気に入らなければ、その設定に係るパラメータを基準にさらにパラメータを変えて微調整を加えることができるため、毎回オリジナル画像から好みの画像に変換するまでのパラメータ設定の手間を省くことができる。

【0068】

〔変形例〕

どのような表現の画像に仕上げるかという加工目標(意図)は、被写体となっている人物の特徴、性別、年齢、或いは画像の利用目的などによって異なると考えられるため、被写体となっている人物のカテゴリー別に、さらには、各人物別に画像処理パラメータを記憶する態様も好ましい。例えば、被写体の人物の性別によってデフォルトの処理を切り替えることにより、女性に限り美白処理を施すなどの態様が可能である。

【0069】

また、携帯電話機10のメモリ32内に登録されているアドレス帳を活用して、被写体の人物特定を行い、アドレス帳とリンクさせてその人物画像に対する画像処理のパラメータを記憶する態様がある。これにより、人物ごとに異なるデフォルト処理を実施することが可能である。

【0070】

さらには、顔パーツの抽出技術を応用して、目の間隔、鼻の位置、その他、各パーツ座標の比率等の特徴から画像内の人物を自動的に認識し、Aさん用のデフォルト、Bさん用のデフォルトという具合に、人物別にデフォルトパラメータを記憶するという態様も可能である。

【0071】

〔第2の実施形態〕

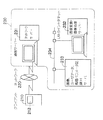

図7は、本発明の第2の実施形態に係る画像処理システムの構成図である。このシステムは、クライアント端末210から人物画像(顔写真)をネットワーク220経由で画像処理センタ230に送り、画像処理センタ230において画像処理を実施して処理結果の画像を利用者に提供するサービスを実現するものである。

【0072】

クライアント端末210は、携帯電話機、PDA、モバイルパソコンなど様々な形態があり得る。クライアント端末210は、ネットワーク220に接続してデータの送受信を行うための通信手段を備えており、好ましくは、被写体の光学像をデジタル画像データに変換する電子カメラが搭載される。なお、撮影機能を有していない端末機器の場合は、USBその他の通信インターフェースを介してデジタルカメラ等の撮影装置(不図示)を接続して外部から画像データを取得したり、予めメモリカードや内部メモリに画像データを格納しておいたりすることにより、処理依頼用の画像を得ることが可能である。

【0073】

ネットワーク220は、例えば、インターネットに代表される広域通信回線網であり、電話回線網、携帯電話回線網、専用回線網など、有線・無線を問わず種々の通信回線網を含む。

【0074】

画像処理センタ230は、通信部サーバ231と、画像処理サーバ232と、データ保管サーバ233とを備え、これらサーバ231〜233はLAN又はイントラネットなどの通信回線234を介して相互に通信可能に接続されている。通信部サーバ231は、ネットワーク220に接続されており、主としてクライアント端末210との通信制御を行う。画像処理サーバ232は、入力された画像(被処理画像)から顔領域を抽出する処理、顔パーツを抽出する処理、処理パラメータに従って対象領域について変形、置換、合成、補正その他の変換処理等を行う手段を備えた処理部である。データ保管サーバ233のストレージには、合成用のパーツ画像、ユーザ(利用者)の登録情報、ユーザ別に管理された画像処理パラメータの設定情報(図6参照)等のデータベースが格納されている。

【0075】

上記の如く構成された画像処理システムの動作は次の通りである。まず、クライアント端末210を用いて画像処理センタ230のホームページにアクセスし、処理を依頼する人物画像(原画像)をアップロードする。

【0076】

通信部サーバ231は、ユーザの認証を行うとともに、受信した画像を画像処理サーバ232に転送する。処理の依頼者であるユーザが特定されると、そのユーザ情報に基づいてデータ保管サーバ233のデータベースが参照される。当該ユーザについて画像処理パラメータの設定情報が保存されていない場合(例えば、本サービスを初めて利用する場合など)は、クライアント端末210に対して、画像処理パラメータを設定する操作が要求される。ユーザがクライアント端末210の操作系を通じて所望のパラメータを指定する入力を行うと、そのパラメータ情報は通信部サーバ231を経由して画像処理サーバ232に送られるとともに、データ保管サーバ233に登録される。

【0077】

画像処理サーバ232は、指定された画像処理パラメータに従って原画像を処理し、パラメータを反映させた変換画像を生成する。画像処理サーバ232で生成された変換画像は通信部サーバ231を介してネットワーク220経由でクライアント端末210に提供され、クライアント端末210のディスプレイ212に表示される。

【0078】

ユーザは、処理結果の画像を確認し、気に入らなければ、現在の設定パラメータを基準としてパラメータの調整操作を行い、再処理を依頼することができる。パラメータの調整操作に応じてデータ保管サーバ233の画像処理パラメータデータベースが更新される。

【0079】

次回、同じユーザが別の画像について処理を依頼すると、データ保管サーバ233に保存されている当該ユーザの画像処理パラメータの情報に基づいて、前回と同様の画像処理が行われ、処理結果画像がクランアント端末210に提供される。

【0080】

このデフォルト処理による結果が気に入らなければ、現在の設定パラメータ(デフォルトパラメータ)を基準としてパラメータの調整操作を行い、再処理を依頼する。パラメータの調整操作に応じてデータ保管サーバ233の画像処理パラメータデータベースが更新される。

【0081】

このようにして、処理実績に基づきユーザごとにデフォルトパラメータを自動設定することで、各ユーザ固有の好ましい画像処理を簡単な操作で効率的に実施することが可能となる。

【0082】

なお、図7では画像処理センタ230の構成に関して、複数のサーバ231〜233で構築されたサーバシステムを例示したが、本発明の実施に際しては画像処理センタ230と同様の機能を一台のコンピュータで実現することも可能であるし、複数台のコンピュータを適宜組み合わせて実現することも可能である。

【0083】

また、図7の例では、画像処理センタ230側のデータ保管サーバ233において画像処理パラメータの情報をユーザ別に管理しているが、本発明の実施に際して、クライアント端末210側で画像処理パラメータの情報を記憶する態様も可能である。この場合、処理を依頼する画像とともにデフォルトパラメータの情報をクライアント端末からサーバ側に送信する。

【0084】

〔他の応用例〕

画像処理の対象は、静止画に限らず、動画でもよい。すなわち、記憶した画像処理のパラメータを他の画像へ適用するという本発明により、動画や連写による一連の静止画のような連続的な画像にも応用が可能である。例えば、動画の一コマについて画像処理パラメータを指定し、画像を変形させることで、その処理パラメータを全体又は一部のコマへ反映させることができる。

【0085】

【発明の効果】

以上説明したように本発明によれば、原画像から顔パーツを抽出し、処理の対象領域を画像処理パラメータに従って画像処理することにより所望の表現の画像に変換する画像処理において、過去に実施した画像処理のパラメータに基づいて次の画像処理におけるデフォルトパラメータを自動的に設定し、デフォルトパラメータに基づく処理の結果が意図するものでなければ、そのパラメータを基準にさらにパラメータを調整することができるようにしたので、簡単な操作で好みの画像を得ることができる。

【図面の簡単な説明】

【図1】本発明の第1の実施形態に係るカメラ付き携帯電話機の一例を示す外観図

【図2】図1に示した携帯電話機の構成を示すブロック図

【図3】本例の携帯電話機に搭載される画像処理装置の要部を示す機能ブロック図

【図4】本例の携帯電話機における画像処理の手順を示したフローチャート

【図5】処理前の原画像の表示例(a)と処理後の変換画像の表示例(b)を示す図

【図6】画像処理パラメータの例を示した図表

【図7】本発明の第2の実施形態に係る画像処理システムの構成図

【符号の説明】

10…携帯電話機、12…カメラ部、16…ディスプレイ、20…操作部、24…十字ボタン、30…CPU、32…メモリ、42…CCD、52…画像処理装置、54…顔領域抽出部、55…顔パーツ抽出部、56…画像変換部、57…パラメータデータ記憶部、210…クライアント端末、220…ネットワーク、230…画像処理センタ、231…通信部サーバ、232…画像処理サーバ、233…データ保管サーバ[0001]

BACKGROUND OF THE INVENTION

The present invention relates to an image processing method and apparatus, and more particularly to a method, apparatus and system suitable for improving operability when processing a face image of a person photographed by a digital camera or a mobile phone with a camera into a favorite image. .

[0002]

[Prior art]

Recently, digital cameras, camera-equipped mobile phones, and the like have become widespread, and are used by many people as one of the easy photographing methods. In addition, conversion to an image of an intended expression is widely performed by performing various image processing on the original image data.

[0003]

[0004]

[Patent Document 1]

JP-A-11-275351

[0005]

[Problems to be solved by the invention]

When a favorite face image is generated by image processing of a person's face photograph, there are a wide variety of setting items such as processing contents and designation of a target part, and parameter setting operations are complicated. In particular, in a small mobile terminal such as a mobile phone, since the operation buttons are small and the number thereof is limited, a more complicated operation is forced.

[0006]

The present invention has been made in view of such circumstances, and an object of the present invention is to provide an image processing method, apparatus, and system capable of realizing complicated processing for a human image with a simple operation.

[0007]

[Means for Solving the Problems]

In order to achieve the above object, an image processing method according to the present invention is an image processing method for extracting a human face part from an original image and performing image processing on the extracted face part to generate an image of a desired expression. The image processing parameters defined for the processing target area can be changed according to the user operation, and the default parameters for the next image processing from the image processing parameters set in the image processing performed until the previous time Is automatically set, and then image processing reflecting the default parameter is performed when image processing is performed, the converted image generated by the processing is displayed on the display means, and further parameters are further set based on the default parameter. When a parameter adjustment operation for changing the parameter is received and the parameter is changed by the parameter adjustment operation, Which comprises carrying out the image processing in accordance with the modified image processing parameter.

[0008]

According to the present invention, at least one (preferably a plurality of) facial parts (facial parts) such as “eyes”, “nose”, and “mouth” are extracted from an original image including a person by image analysis, By performing image processing on the part area in accordance with image processing parameters, an image with a preferable expression can be obtained. A parameter that defines the content of image processing is defined for the region to be processed, and the user can set the image processing parameter through the user interface so that the image has the intended expression.

[0009]

Once the parameters are set and the image processing is performed, the next default parameter is automatically set based on the result, and the image processing is performed based on the default parameter after the next time. Since the converted image generated according to the default parameters is displayed on the display means, the user can confirm the image of the processing result by viewing the display. If the obtained result is not intended, a parameter adjustment operation is performed. This adjustment operation modifies the default parameter, for example, by specifying an increase / decrease value (change amount) based on the current default parameter. By adjusting the parameters based on the default parameters, desired conditions can be easily set.

[0010]

The image processing is performed again according to the parameter thus changed, and a converted image as a processing result is provided. The corrected parameter information is used for setting the next default parameter.

[0011]

As described above, according to the present invention, default parameters in the next image processing are automatically set based on the parameters of image processing performed in the past, and a desired image is obtained by processing based on the default parameters (default processing). If not, since further parameter adjustment is performed based on the parameter, the number of processes until a desired image is obtained can be greatly reduced.

[0012]

Further, according to the present invention, for example, when the processing target area covers the entire person, when the background area is distinguished from the person, or for parts such as hair, lips, torso, clothes, accessories, etc. It is also possible to store processing parameters for processing selected from the position, shape characteristics, density characteristics, color characteristics, texture characteristics, and spatial frequency characteristics and reflect them in subsequent conversions.

[0013]

In order to provide an apparatus that embodies the above method invention, an image processing apparatus according to the present invention is extracted by a facial part extracting unit that extracts a facial part of a person from an input original image, and the facial part extracting unit. Parameter changing operation means for performing an operation of changing the setting of the image processing parameter defined for the processing target area including the face part, and subjecting the target area of the original image to image processing according to the set image processing parameter Image processing means for generating an image of expression reflecting the parameters, and automatic default parameter setting for automatically setting default parameters in the next image processing from the image processing parameters set in the image processing performed until the previous time And default parameters set by the default parameter automatic setting means A display unit that displays the converted image generated by the image processing unit based on the parameter adjustment operation for further changing the parameter with reference to the default parameter, and a parameter adjustment instruction is input from the parameter change operation unit And image processing control means for performing image processing by the image processing means in accordance with the image processing parameter changed according to the instruction.

[0014]

According to one aspect of the present invention, the default parameter automatic setting means includes storage means for storing image processing parameters used in the previous image processing, and the previous image processing parameters are used as default parameters for the next image processing. It is characterized by setting to.

[0015]

In addition to setting the previous parameter as the default for the next time, set the default value for the most frequently used setting from the past processing history, or obtain the average value of the setting value from the past history and set the value. There may be a mode such as setting to default. When the default processing is determined from the accumulated history information, the processing parameters preferred by the user can be accurately reflected in the next data as the number of executions of the image processing increases.

[0016]

An image processing apparatus of the present invention includes a communication unit connected to a communication network, an imaging unit that converts an optical image of a subject into an electrical signal, an image recording unit that records an image captured through the imaging unit, There is a mode mounted on a mobile phone with a camera.

[0017]

A small mobile terminal typified by a camera-equipped mobile phone has a limited operation system such as a small operation button. Therefore, it is very beneficial to improve the operability according to the present invention. The image processing apparatus according to the present invention is not limited to a case where the image processing apparatus is realized by a single device such as a camera-equipped mobile phone, and a plurality of devices (devices) including a part of the image processing device. ) May be combined to realize the image processing apparatus of the present invention as a whole.

[0018]

Still another aspect of the present invention provides an image processing system that achieves the above object. In other words, image processing including a communication terminal including a communication unit that transmits original image data via a network, and an image processing server that processes image data transmitted from the communication terminal via the network. In the system, the image processing server includes a facial part extraction unit that extracts a facial part of a person from an original image acquired from the communication terminal, and a processing target area that includes the facial part extracted by the facial part extraction unit. Image processing means for performing image processing in accordance with set image processing parameters and generating an image of expression reflecting the parameters, and the converted image generated by the image processing means via the network via the communication terminal An image providing unit for providing the image processing parameter to the image processing parameter defined for the target area. Parameter changing operation means for performing an operation for changing the setting of the data, display means for displaying the converted image generated by the image processing means, and parameter information corresponding to an instruction from the parameter changing operation means. Parameter information providing means for providing to the processing server, and the image processing server or the communication terminal automatically receives default parameters for the next image processing from the image processing parameters set in the image processing performed until the previous time. Default parameter automatic setting means for automatically setting is provided, the converted image generated by the image processing means is displayed on the display means according to the default parameter set by the default parameter automatic setting means, and the default parameter is displayed. Further parameters on the basis of When a parameter adjustment operation to be changed is received and a parameter adjustment instruction is input from the parameter change operation means, parameter information corresponding to the instruction is provided to the image processing server, and the image changed according to the adjustment instruction Image processing by the image processing means is performed according to processing parameters.

[0019]

In the case where default parameter automatic setting means is provided on the communication terminal side, default parameter information is provided from the communication terminal to the image processing server when requesting image processing.

[0020]

Further, an aspect in which default parameter automatic setting means is provided on the image processing server side is also possible. In this case, parameter information designated by the operation system of the communication terminal is sent to the image processing server, and the parameter information is stored in the image processing server.

[0021]

DETAILED DESCRIPTION OF THE INVENTION

Hereinafter, preferred embodiments of the present invention will be described in detail with reference to the accompanying drawings.

[0022]

[First Embodiment]

FIG. 1 is an external view showing an example of a camera-equipped mobile phone according to the first embodiment of the present invention. The

[0023]

The

[0024]

As shown in FIG. 1, the

[0025]

FIG. 2 is a block diagram showing the configuration of the

[0026]

The

[0027]

The

[0028]

The

[0029]

When a communication connection with the communication partner is established in the call mode (mode using the telephone function), the voice input from the

[0030]

The signal received by the

[0031]

Further, the

[0032]

The light that has passed through the photographing

[0033]

The subject image formed on the light receiving surface of the

[0034]

The signal charges accumulated in each photosensor of the

[0035]

The

[0036]

The

[0037]

When a photographing button on the operation unit 20 (for example, the

[0038]

When the moving image shooting mode is selected, the recording operation starts when the shooting button is pressed, and then the moving image recording operation stops when the shooting button is pressed again. Note that the recording operation may be performed while the shooting button is continuously pressed, and the recording may be stopped by releasing the pressing.

[0039]

The sound at the time of moving image shooting is detected by the

[0040]

At the time of image reproduction, image file data is read from the

[0041]

FIG. 3 is a functional block diagram showing the main part of the image processing apparatus mounted on the

[0042]

As illustrated, the

[0043]

As shown in FIG. 3, the data of the original image (processed image) 60 including the face image is input to the

[0044]

As a method for extracting a face region from the

[0045]

The position from which the facial parts are extracted is determined as a face, and division processing by color and texture is performed. This is a process of dividing similar color and texture areas together, for example, the skin color area including the eye coordinates is used as the face area, and the black and brown areas that are slightly above the eye coordinates are used as the hair area. To extract a person area. In addition, the human area dictionary data indicating the average positional relationship between the eye position and the boundary line between the person and the background is matched with the boundary line between the person area obtained from the original image and the background area, The boundary line between the background area and the background area

[0046]

Also, a filtering process for extracting a boundary line between a person and a background from a high-frequency component in the

[0047]

The face part information extracted by the face

[0048]

The parameter

[0049]

In this way, an image (converted image 62) reflecting the parameters is generated in the

[0050]

When the displayed image is not intended, the user performs fine adjustment of the parameter from the

[0051]

The above operation is repeated until a favorite image is obtained. When the image of the intended expression is obtained, the image processing operation is terminated. At this time, information on the image processing parameters from which a favorite image is obtained is stored in the parameter

[0052]

When performing image processing for another image next time, the previous image processing parameter stored in the parameter

[0053]

FIG. 4 is a flowchart showing a procedure of image processing in the

[0054]

As shown in FIG. 5A, simultaneously with the display of the face image, an “image processing”

[0055]

When desiring to perform image processing on the displayed face image, the user presses an image processing button (operation button 72). When an operation for selecting an “image processing” command is performed (step S112 in FIG. 4), the

[0056]

On the other hand, if it is determined in step S114 that the process parameter data is not stored (NO determination), a process parameter setting operation is accepted (step S116).

[0057]

FIG. 6 is a chart showing an example of image processing parameters. According to FIG. 6, the face, head hair, eye part, lips, torso, clothes, accessories, nose, background, etc. are determined as the processing target areas, and the shape, position, density characteristics, color, etc. are determined for each target area. Image feature quantities such as characteristics, texture characteristics, and spatial frequency characteristics can be set.

[0058]

A step adjustment rate of ± 1, ± 2, ± 3 is defined for the “shape” of the face in the left / right and up / down directions, and the user can use the +/− buttons (also used with the up / down keys of the cross button) as desired. By operating and inputting parameters, the face size is increased or decreased. Similarly, step adjustment rates of ± 1, ± 2, and ± 3 are defined for the shapes of the eyes and lips.

[0059]

As for the shape of “hair”, a plurality of hair images (part images for pasting and combining) representing various hair styles are prepared in advance, and the user can select a favorite hair image. . FIG. 6 shows that the hair image defined for type “C” is selected. With respect to the shape of the “jewelry”, a plurality of types of clothing accessory images are prepared in advance, and in FIG. 6, a clothing accessory image defined as the type “R” is selected. As the shape of “nose”, a plurality of types such as a high nose and a low nose are defined. FIG. 6 shows that the type “B” is selected.

[0060]

In addition, with regard to shape, position, density characteristics, color characteristics, texture characteristics, and spatial frequency characteristics, adjustment values (for example, ± 1, ± 2, ± 3) for adjusting each feature amount in stages are defined. Has been. The user can designate a desired adjustment value using the

[0061]

In this way, image processing (including synthesis processing for pasting a part image for synthesis) is performed according to the set image processing parameters, and a converted image reflecting the parameters is displayed on the display 16 (step S118 in FIG. 4). At this time, as shown in FIG. 5B, simultaneously with the display of the image indicating the conversion result, a

[0062]

If the user does not like the converted image displayed on the

[0063]

That is, instruction input from the user is waited in a state where the converted image is displayed in step S118 of FIG. 4, and it is determined whether or not the converted image being displayed is acceptable in accordance with the input instruction (step S120). If the “further processing” button is pressed, a NO determination is made in step S120, and the process proceeds to step S122. In step S122, an operation for further adjusting the processing parameters based on the parameters used in the previous processing is accepted. For example, when the parameter value used in the previous processing is “+2”, “+1” is further added to the value to correct it to “+3”, or “−1” is adjusted from “+2”. You can go and correct it to “+1”.

[0064]

When parameter adjustment is performed in step S122, the process returns to step S118, image processing is performed based on the changed parameter, and the converted image after processing is displayed on the

[0065]

In step S120, when the “OK now” button is pressed, this sequence ends.

[0066]

According to the

[0067]

If you don't like the result of this default processing, you can change the parameters further and make fine adjustments based on the parameters related to the settings. This saves you the trouble of setting the parameters every time you convert from the original image to your favorite image. be able to.

[0068]

[Modification]

The processing target (intent) for what kind of image to finish is considered to vary depending on the characteristics, gender, age, or purpose of use of the person who is the subject. An aspect in which image processing parameters are stored for each category and for each person is also preferable. For example, it is possible to perform a whitening process only for women by switching the default process according to the gender of the subject person.

[0069]

In addition, there is an aspect in which the address book registered in the

[0070]

Furthermore, by applying facial part extraction technology, the person in the image is automatically recognized from features such as eye spacing, nose position, and other parts coordinate ratios. It is also possible to store the default parameters for each person, such as the default for personal use.

[0071]

[Second Embodiment]

FIG. 7 is a configuration diagram of an image processing system according to the second embodiment of the present invention. This system realizes a service for sending a person image (face photograph) from the

[0072]

The

[0073]

The network 220 is, for example, a wide area communication line network represented by the Internet, and includes various communication line networks such as a telephone line network, a mobile phone line network, and a dedicated line network regardless of wired or wireless.

[0074]

The

[0075]

The operation of the image processing system configured as described above is as follows. First, the

[0076]

The communication unit server 231 authenticates the user and transfers the received image to the

[0077]

The

[0078]

If the user confirms the image of the processing result and does not like the image, he / she can perform a parameter adjustment operation based on the current setting parameter and request reprocessing. The image processing parameter database of the

[0079]

Next time, when the same user requests processing for another image, the same image processing as the previous time is performed based on the information of the image processing parameter of the user stored in the

[0080]

If the user does not like the result of the default process, the parameter adjustment operation is performed based on the current setting parameter (default parameter), and a re-process is requested. The image processing parameter database of the

[0081]

In this way, by automatically setting the default parameters for each user based on the processing results, it is possible to efficiently perform preferable image processing unique to each user with a simple operation.

[0082]

7 exemplifies a server system constructed by a plurality of servers 231 to 233 with respect to the configuration of the

[0083]

In the example of FIG. 7, the image processing parameter information is managed for each user in the

[0084]

[Other application examples]

The target of image processing is not limited to a still image but may be a moving image. That is, according to the present invention in which the stored image processing parameters are applied to other images, the present invention can be applied to continuous images such as a series of still images by moving images or continuous shooting. For example, by specifying image processing parameters for one frame of a moving image and deforming the image, the processing parameters can be reflected on all or some of the frames.

[0085]

【The invention's effect】

As described above, according to the present invention, face processing is performed in the past in image processing for extracting a facial part from an original image and converting the processing target area into an image of a desired expression by performing image processing according to image processing parameters. Default parameters for the next image processing are automatically set based on the image processing parameters, and if the result of processing based on the default parameters is not intended, the parameters can be further adjusted based on the parameters. Therefore, you can get your favorite image with a simple operation.

[Brief description of the drawings]

FIG. 1 is an external view showing an example of a camera-equipped mobile phone according to a first embodiment of the present invention.

FIG. 2 is a block diagram showing the configuration of the mobile phone shown in FIG.

FIG. 3 is a functional block diagram showing a main part of an image processing apparatus mounted on the mobile phone of the present example.

FIG. 4 is a flowchart showing a procedure of image processing in the mobile phone of this example.

FIG. 5 is a diagram showing a display example (a) of an original image before processing and a display example (b) of a converted image after processing;

FIG. 6 is a chart showing examples of image processing parameters.

FIG. 7 is a configuration diagram of an image processing system according to a second embodiment of the present invention.

[Explanation of symbols]

DESCRIPTION OF

Claims (5)

処理の対象領域に対して定義されている画像処理パラメータをユーザ操作に応じて変更可能な構成とし、

前回までに実施された画像処理において設定された画像処理パラメータから次の画像処理のデフォルトパラメータを自動的に設定し、

その後、画像処理を行う時に前記デフォルトパラメータを反映した画像処理を実施し、

該処理により生成された変換画像を表示手段に表示するとともに、前記デフォルトパラメータを基準としてさらにパラメータを変更するパラメータ調整操作を受け付け、

前記パラメータ調整操作によってパラメータが変更されると、該変更された画像処理パラメータに従って画像処理を実施することを特徴とする画像処理方法。An image processing method for extracting a human face part from an original image and performing image processing on the extracted face part to generate an image of a desired expression,

The image processing parameters defined for the processing target area can be changed according to user operations.

The default parameters for the next image processing are automatically set from the image processing parameters set in the image processing performed until the previous time,

After that, when image processing is performed, image processing reflecting the default parameters is performed,

While displaying the converted image generated by the processing on the display means, accepting a parameter adjustment operation to further change the parameter with reference to the default parameter,

When a parameter is changed by the parameter adjustment operation, image processing is performed according to the changed image processing parameter.

前記顔パーツ抽出手段により抽出される顔パーツを含む処理の対象領域について定義されている画像処理パラメータの設定を変更する操作を行うためのパラメータ変更操作手段と、

設定された画像処理パラメータに従って前記原画像の対象領域に画像処理を施し、該パラメータを反映した表現の画像を生成する画像処理手段と、

前回までに実施された画像処理において設定された画像処理パラメータから次の画像処理におけるデフォルトパラメータを自動的に設定するデフォルトパラメータ自動設定手段と、

前記デフォルトパラメータ自動設定手段によって設定されたデフォルトパラメータに基づいて前記画像処理手段で生成した変換画像を表示する表示手段と、

前記デフォルトパラメータを基準としてさらにパラメータを変更するパラメータ調整操作を受け付け、前記パラメータ変更操作手段からパラメータの調整指示が入力されると、該指示に応じて変更された画像処理パラメータに従って前記画像処理手段による画像処理を実施させる画像処理制御手段と、

を備えたことを特徴とする画像処理装置。A facial part extracting means for extracting a human facial part from the input original image;

A parameter changing operation means for performing an operation of changing the setting of the image processing parameter defined for the processing target region including the facial part extracted by the facial part extracting means;

Image processing means for performing image processing on a target area of the original image according to set image processing parameters, and generating an image of expression reflecting the parameters;

Default parameter automatic setting means for automatically setting default parameters in the next image processing from the image processing parameters set in the image processing performed until the previous time;

Display means for displaying the converted image generated by the image processing means based on the default parameters set by the default parameter automatic setting means;

When a parameter adjustment operation for further changing a parameter is received on the basis of the default parameter and a parameter adjustment instruction is input from the parameter change operation means, the image processing means performs the operation according to the image processing parameter changed according to the instruction. Image processing control means for performing image processing;

An image processing apparatus comprising:

前記画像処理サーバは、前記通信端末から取得した原画像から人物の顔パーツを抽出する顔パーツ抽出手段と、

前記顔パーツ抽出手段により抽出された顔パーツを含む処理の対象領域に対して、設定されている画像処理パラメータに従って画像処理を施し、該パラメータを反映した表現の画像を生成する画像処理手段と、

前記画像処理手段で生成した変換画像を前記ネットワーク経由で前記通信端末に提供する画像提供手段と、

を備え、

前記通信端末は、前記対象領域について定義されている画像処理パラメータの設定を変更する操作を行うためのパラメータ変更操作手段と、

前記画像処理手段により生成された変換画像を表示する表示手段と、

前記パラメータ変更操作手段からの指示に応じたパラメータ情報を前記画像処理サーバに提供するパラメータ情報提供手段と、

を備え、

前記画像処理サーバ又は前記通信端末には、前回までに実施された画像処理において設定された画像処理パラメータから次の画像処理のデフォルトパラメータを自動的に設定するデフォルトパラメータ自動設定手段が設けられており、

前記デフォルトパラメータ自動設定手段によって設定されたデフォルトパラメーに従って前記画像処理手段により生成された変換画像を前記表示手段に表示させるとともに、前記デフォルトパラメータを基準としてさらにパラメータを変更するパラメータ調整操作を受け付け、

前記パラメータ変更操作手段からパラメータの調整指示が入力されると、該指示に応じたパラメータ情報が前記画像処理サーバに提供され、該調整指示に応じて変更された画像処理パラメータに従って前記画像処理手段による画像処理が実施されることを特徴とする画像処理システム。An image processing system comprising: a communication terminal having communication means for transmitting original image data via a network; and an image processing server for processing image data sent from the communication terminal via the network. There,

The image processing server includes a facial part extracting unit that extracts a facial part of a person from an original image acquired from the communication terminal;

Image processing means for performing image processing according to a set image processing parameter on a processing target region including the face part extracted by the face part extracting means, and generating an expression image reflecting the parameter;

Image providing means for providing the converted image generated by the image processing means to the communication terminal via the network;

With

The communication terminal includes a parameter changing operation means for performing an operation of changing the setting of an image processing parameter defined for the target area;

Display means for displaying the converted image generated by the image processing means;

Parameter information providing means for providing parameter information corresponding to an instruction from the parameter change operation means to the image processing server;

With

The image processing server or the communication terminal is provided with default parameter automatic setting means for automatically setting a default parameter for the next image processing from the image processing parameters set in the image processing performed until the previous time. ,

Displaying the converted image generated by the image processing unit according to the default parameter set by the default parameter automatic setting unit on the display unit, and accepting a parameter adjustment operation for further changing the parameter based on the default parameter,

When a parameter adjustment instruction is input from the parameter change operation means, parameter information corresponding to the instruction is provided to the image processing server, and according to the image processing parameter changed according to the adjustment instruction, the image processing means An image processing system, wherein image processing is performed.

Priority Applications (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2003140378A JP2004342003A (en) | 2003-05-19 | 2003-05-19 | Image processing method and apparatus, and image processing system |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2003140378A JP2004342003A (en) | 2003-05-19 | 2003-05-19 | Image processing method and apparatus, and image processing system |

Publications (1)

| Publication Number | Publication Date |

|---|---|

| JP2004342003A true JP2004342003A (en) | 2004-12-02 |

Family

ID=33529118

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2003140378A Pending JP2004342003A (en) | 2003-05-19 | 2003-05-19 | Image processing method and apparatus, and image processing system |

Country Status (1)

| Country | Link |

|---|---|

| JP (1) | JP2004342003A (en) |

Cited By (9)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| EP2023590A3 (en) * | 2007-08-06 | 2009-09-09 | Nikon Corporation | Electronic camera |

| JP2011176536A (en) * | 2010-02-24 | 2011-09-08 | Yamaha Corp | Communication equipment |

| JP2015514525A (en) * | 2012-04-24 | 2015-05-21 | ネステク ソシエテ アノニム | Beverage preparation machine user interface |

| JP2016092430A (en) * | 2014-10-29 | 2016-05-23 | 株式会社リコー | Imaging system, information processing device, imaging method, program and storage medium |

| WO2016110943A1 (en) * | 2015-01-06 | 2016-07-14 | 日立マクセル株式会社 | Image display device, image display method and image display system |

| JP2019121304A (en) * | 2018-01-11 | 2019-07-22 | コニカミノルタ株式会社 | Color adjustment system for color image and color adjustment method for color image |

| CN110806854A (en) * | 2019-10-17 | 2020-02-18 | 武汉天喻教育科技有限公司 | Method and system for web side to process pictures on line |

| CN112970243A (en) * | 2018-10-19 | 2021-06-15 | 索尼集团公司 | Sensor device and parameter setting method |

| WO2024013861A1 (en) * | 2022-07-12 | 2024-01-18 | 株式会社メディア・バックオフィス | Image-processing service system |

-

2003

- 2003-05-19 JP JP2003140378A patent/JP2004342003A/en active Pending

Cited By (15)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| EP2023590A3 (en) * | 2007-08-06 | 2009-09-09 | Nikon Corporation | Electronic camera |

| US8477209B2 (en) | 2007-08-06 | 2013-07-02 | Nikon Corporation | Electronic camera |

| JP2011176536A (en) * | 2010-02-24 | 2011-09-08 | Yamaha Corp | Communication equipment |

| US10007397B2 (en) | 2012-04-24 | 2018-06-26 | Nestec S. A. | User-interface for beverage preparation machines |

| JP2015514525A (en) * | 2012-04-24 | 2015-05-21 | ネステク ソシエテ アノニム | Beverage preparation machine user interface |

| JP2016092430A (en) * | 2014-10-29 | 2016-05-23 | 株式会社リコー | Imaging system, information processing device, imaging method, program and storage medium |

| WO2016110943A1 (en) * | 2015-01-06 | 2016-07-14 | 日立マクセル株式会社 | Image display device, image display method and image display system |

| US10678843B2 (en) | 2015-01-06 | 2020-06-09 | Maxell, Ltd. | Image display device, image display method and image display system |

| US11106723B2 (en) | 2015-01-06 | 2021-08-31 | Maxell, Ltd. | Image display device, image display method and image display system |

| US11829405B2 (en) | 2015-01-06 | 2023-11-28 | Maxell, Ltd. | Image display device and image display system |

| JP2019121304A (en) * | 2018-01-11 | 2019-07-22 | コニカミノルタ株式会社 | Color adjustment system for color image and color adjustment method for color image |

| CN112970243A (en) * | 2018-10-19 | 2021-06-15 | 索尼集团公司 | Sensor device and parameter setting method |

| CN112970243B (en) * | 2018-10-19 | 2023-09-05 | 索尼集团公司 | Sensor device and parameter setting method |

| CN110806854A (en) * | 2019-10-17 | 2020-02-18 | 武汉天喻教育科技有限公司 | Method and system for web side to process pictures on line |

| WO2024013861A1 (en) * | 2022-07-12 | 2024-01-18 | 株式会社メディア・バックオフィス | Image-processing service system |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| US9055276B2 (en) | Camera having processing customized for identified persons | |

| CN113727016A (en) | Shooting method and electronic equipment | |

| US10523820B2 (en) | High-quality audio/visual conferencing | |

| US20130177242A1 (en) | Super-resolution image using selected edge pixels | |

| KR20070117284A (en) | Method for image composition in dual camera having mobile phone | |

| US20230162332A1 (en) | Image Transformation Method and Apparatus | |

| GB2421137A (en) | Image compression using a quantization parameter determined according to a focus value | |

| JP2004342003A (en) | Image processing method and apparatus, and image processing system | |

| JP4247666B2 (en) | Image processing method and image processing system | |

| JP3999091B2 (en) | Image correction processing apparatus and program | |

| KR100642688B1 (en) | Apparatus and method for editing a part of picture in mobile communication terminal | |

| JP4407150B2 (en) | Portable terminal device, network system, and image processing method | |

| JP2020072311A (en) | Information acquisition device, information acquisition method, information acquisition program, and information acquisition system | |

| US10217196B2 (en) | Image processing apparatus having image refocusing function, control method for image processing apparatus, and storage medium | |

| US20040021789A1 (en) | Photographing system | |

| JP5040844B2 (en) | Imaging apparatus, imaging method, and program | |

| CN112422814A (en) | Shooting method and electronic equipment | |

| JPH11341454A (en) | Image information processor, information processor and recording medium | |

| KR100769672B1 (en) | Mobile communication terminal having the function of video communication | |

| KR101080455B1 (en) | Picture compensation method and apparatus for portable terminal | |

| KR20030090889A (en) | Magnification image photographing method and apparatus for hand-held terminal integrated digital camera | |

| JP2006025059A (en) | Electronic camera apparatus and color adjustment method | |

| JP2010022068A (en) | Electron camera device, color control method, and program | |

| KR20090029454A (en) | Apparatus and method for processing video data in a wireless mobile terminal | |

| JP2004326423A (en) | Image processing method and system and image processing server, and terminal equipment |