CN116091288A - 一种基于扩散模型的图像隐写方法 - Google Patents

一种基于扩散模型的图像隐写方法 Download PDFInfo

- Publication number

- CN116091288A CN116091288A CN202211574439.6A CN202211574439A CN116091288A CN 116091288 A CN116091288 A CN 116091288A CN 202211574439 A CN202211574439 A CN 202211574439A CN 116091288 A CN116091288 A CN 116091288A

- Authority

- CN

- China

- Prior art keywords

- image

- model

- diffusion

- noise

- generation model

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Pending

Links

- 238000009792 diffusion process Methods 0.000 title claims abstract description 68

- 238000000034 method Methods 0.000 title claims abstract description 47

- 238000012549 training Methods 0.000 claims abstract description 31

- 238000005070 sampling Methods 0.000 claims description 5

- 208000037170 Delayed Emergence from Anesthesia Diseases 0.000 claims description 4

- 230000007246 mechanism Effects 0.000 claims description 3

- 230000002123 temporal effect Effects 0.000 claims description 2

- 238000000605 extraction Methods 0.000 abstract description 9

- 230000008569 process Effects 0.000 description 13

- 238000013256 Gubra-Amylin NASH model Methods 0.000 description 4

- 238000012986 modification Methods 0.000 description 4

- 230000004048 modification Effects 0.000 description 4

- 238000013528 artificial neural network Methods 0.000 description 3

- 238000013135 deep learning Methods 0.000 description 3

- 238000010586 diagram Methods 0.000 description 3

- 238000005516 engineering process Methods 0.000 description 2

- 230000002441 reversible effect Effects 0.000 description 2

- 241000282326 Felis catus Species 0.000 description 1

- 230000005856 abnormality Effects 0.000 description 1

- 230000003042 antagnostic effect Effects 0.000 description 1

- 238000007630 basic procedure Methods 0.000 description 1

- 230000009286 beneficial effect Effects 0.000 description 1

- 230000000694 effects Effects 0.000 description 1

- 238000011156 evaluation Methods 0.000 description 1

- 238000003062 neural network model Methods 0.000 description 1

- 238000003909 pattern recognition Methods 0.000 description 1

- 238000012545 processing Methods 0.000 description 1

- 238000011160 research Methods 0.000 description 1

- 238000006467 substitution reaction Methods 0.000 description 1

- 238000012360 testing method Methods 0.000 description 1

- 230000009466 transformation Effects 0.000 description 1

- 238000000844 transformation Methods 0.000 description 1

Images

Classifications

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T1/00—General purpose image data processing

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06N—COMPUTING ARRANGEMENTS BASED ON SPECIFIC COMPUTATIONAL MODELS

- G06N3/00—Computing arrangements based on biological models

- G06N3/02—Neural networks

- G06N3/04—Architecture, e.g. interconnection topology

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06N—COMPUTING ARRANGEMENTS BASED ON SPECIFIC COMPUTATIONAL MODELS

- G06N3/00—Computing arrangements based on biological models

- G06N3/02—Neural networks

- G06N3/08—Learning methods

Landscapes

- Engineering & Computer Science (AREA)

- Physics & Mathematics (AREA)

- Theoretical Computer Science (AREA)

- General Physics & Mathematics (AREA)

- Data Mining & Analysis (AREA)

- Evolutionary Computation (AREA)

- Artificial Intelligence (AREA)

- Biomedical Technology (AREA)

- Biophysics (AREA)

- Computational Linguistics (AREA)

- Health & Medical Sciences (AREA)

- Life Sciences & Earth Sciences (AREA)

- General Health & Medical Sciences (AREA)

- Molecular Biology (AREA)

- Computing Systems (AREA)

- General Engineering & Computer Science (AREA)

- Mathematical Physics (AREA)

- Software Systems (AREA)

- Editing Of Facsimile Originals (AREA)

- Image Processing (AREA)

Abstract

本发明提供了一种基于扩散模型的图像隐写方法,包括:利用真实图像样本集对扩散概率模型进行训练,获取图像生成模型;将所述真实图像样本集中的图像嵌入所述图像生成模型,获取含密图像;利用所述图像生成模型对所述含密图像进行提取,获取消息图像,完成图像隐写。本发明首先利用两类数据集分别训练扩散模型,得到两个扩散模型,然后通过将两个扩散模型进行不同的串行组合以实现消息的嵌入和提取,特别是本发明并不需要原始载体用作参考,可将消息图像消息,直接编码成含密载体实现大容量隐写。

Description

技术领域

本发明属于深度学习和信息安全技术领域,尤其涉及一种基于扩散模型的图像隐写方法。

背景技术

图像隐写技术(Image Steganography)将秘密信息隐藏到自然图像中,从而达到隐蔽传递消息的目的。目前,图像隐写方法大多利用某种修改策略将秘密信息嵌入图像中,这主要是因为图像本身具有高度的复杂性和信息冗余,精心设计的修改操作能够尽量保持图像的自然程度,同时降低修改操作对原始自然载体引入的可检测异常。然而,随着基于深度学习技术的隐写分析技术的进步,传统的载体修改隐写面临着日益严重的安全威胁。近几年,深度生成模型越来越成为当前深度学习领域的研究热点,特别是以生成对抗网络、变分自编码器、基于流的生成模型等为代表的深度生成模型在计算视觉领域得到了广泛应用。生成模型构造自然图像能力的显著提升,为实现载体合成式图像隐写方法提供了技术支撑。近几年来,有一些学者利用生成对抗网络技术(Generative adversarial networks,GAN)、变分自编码器(Variational auto-encoder,VAE)、以及基于流的生成模型(Flow-based Model)来实现图像隐写。当前,这些方法主要分为三种,第一类是利用GAN模型的生成器构造原始图像、然后借助传统的隐写方法实现消息的嵌入,通常会通过引入隐写分析器来提高含密图像的抗隐写分析性能。第二类方式是利用GAN模型或变分自编码器的编解码(Encoder-DecoderModel)模型,通过编码或生成的方式直接构造含密载体,然后再单独训练一个消息提取网络来提取含密消息。第三类方法则是利用基于流的生成模型来构造一个可逆神经网络,仅需要训练一个神经网络就可以实现消息的嵌入和消息的提取。以上生成模型中,GAN模型因其对抗性训练特性而被认为具有潜在的训练不稳定和生成差异较小的特点,基于GAN模型的图像隐写技术也具有上述缺点,特别是生成图像质量不高,同时消息提取准确率较低。流模型必须使用专门的设计的模型结构来构造可逆转换,实现起来相对比较复杂。另一方面,基于生成模型的隐写根据嵌入消息的容量的不同,也分为低嵌入量隐写和大容量隐写。在低嵌入量隐写中,消息通常是一串二进制比特,消息长度较短。而在大容量隐写中,通常秘密消息为一幅图像,基于编解码器网络的隐写方法和基于流模型的方法通常可以将一幅图像编码到一幅载体图像中,从而形成一张与载体图像相似的含密图像,然后利用消息提取网络恢复出消息。然而这类大容量方法,通常要求载体图像和含密图像要足够接近,额外需要用一个评价标准去约束含密载体的生成使得在训练的模型时收敛较慢。

发明内容

为解决上述技术问题,本发明提出了一种基于扩散模型的图像隐写方法;该方法首先利用两类数据集分别训练扩散模型,得到两个扩散模型,然后通过将两个扩散模型进行不同的串行组合以实现消息的嵌入和提取,特别是该方法并不需要原始载体用作参考,可将消息图像消息,直接编码成含密载体实现大容量隐写。

为实现上述目的,本发明提供了一种基于扩散模型的图像隐写方法,包括:

利用真实图像样本集对扩散概率模型进行训练,获取图像生成模型;

将所述真实图像样本集中的图像嵌入所述图像生成模型,获取含密图像;

利用所述图像生成模型对所述含密图像进行提取,获取消息图像,完成图像隐写。

可选地,所述图像生成模型包括第一图像生成模型和第二图像生成模型;

获取所述图像生成模型包括:

利用第一真实图像样本集对所述扩散概率模型进行训练,获取第一图像生成模型;其中,所述第一真实图像样本集为,同一类型的图像的样本集,例如人脸图像集;

利用第二真实图像样本集对所述扩散概率模型进行训练,获取第二图像生成模型;其中,所述第二真实图像样本集为与所述第一真实图像样本集不同类型的秘密图像的样本集,例如猫的图像集。

可选地,获取所述含密图像包括:

选取所述第二真实图像样本中的图像作为秘密消息,将作为秘密消息的所述图像转化为第一高斯噪声;

将所述第一高斯噪声输入所述第一图像生成模型,获取所述含密图像。

可选地,获取所述消息图像包括:

将所述含密图像转化为第二高斯噪音;

将所述第二高斯噪音输入所述第二图像生成模型,获取所述消息图像。

可选地,所述扩散概率模型包括:自编码子模型;所述自编码子模型采用U-Net结构;

利用真实图像样本集对扩散概率模型进行训练包括:

采用所述自编码模块对所述真实图像样本集中t时刻的噪声∈进行估计。

可选地,采用所述自编码子模型对所述真实图像样本集中t时刻的噪声∈进行估计包括:

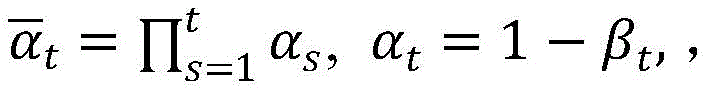

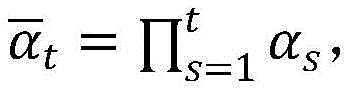

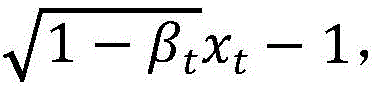

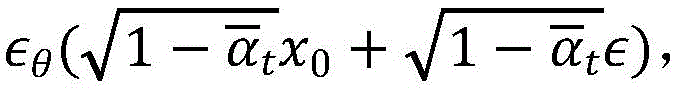

首先在所述真实图像样本集中随机选择一个训练样本x0,然后从1-T中随机抽样一个t,接着随机产生噪声∈~N(0,1),计算当前所产生的噪音并将其输入所述扩散概率模型∈θ中预测噪音,即T为总的迭代最长时间,t表示t时刻,其中βt表示前向扩散过程t时刻的噪声方差,x0表示在t=0时刻的图像数据。

计算产生的噪音和预测的噪音的L2损失,然后计算梯度并更新网络参数θ,直至所述扩散概率模型收敛得到网络参数θ。

可选地,U-Net结构的所述自编码子模型基于双流卷积结构构建,同时引入残差连接;

所述U-Net结构中结合了下采样和上采样,并采用远程跳接;

所述U-Net结构包括残差模块和自注意力机制模块;其中所述残差模块中引入了时间嵌入向量。

可选地,将所述第一高斯噪声输入所述第一图像生成模型包括:

将所述第一高斯噪声输入所述第一图像生成模型,预设迭代步数,对所述第一图像生成模型进行迭代。

可选地,对所述第一图像生成模型进行迭代包括:

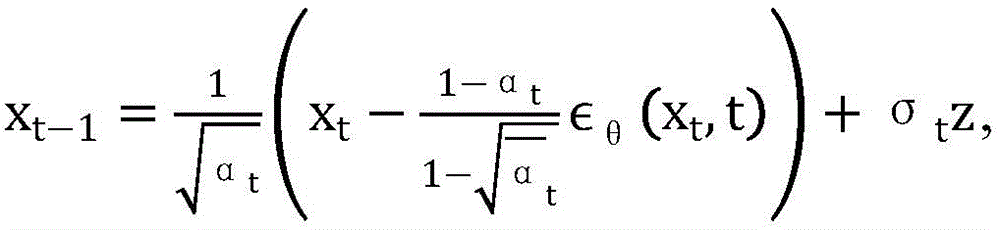

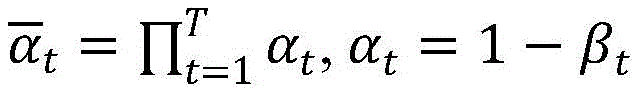

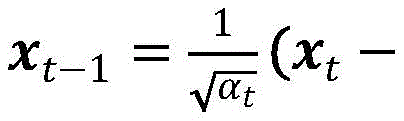

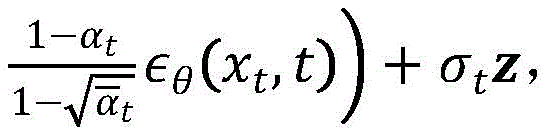

首先利用所述第一图像生成模型进行预测噪音,然后计算条件分布的均值,然后用均值加上标准差乘以一个随机噪音z,其中z~N(0,1),得到数据xt-1,即重复执行所述预设迭代步数,直至t=0完成新样本的生成;其中,αt=1-βt,,其中βt表示前向扩散过程t时刻的噪声方差,xt为t时刻加噪后的图像数据,∈θ为自编码子模型,t为迭代时间,σt为t时刻高斯分布的方差参数。

与现有技术相比,本发明具有如下优点和技术效果:

1本发明实现简单,仅需要训练两个扩散模型,分别作为消息嵌入网络和消息提取网络即可完成训练过程,消息嵌入网络和消息提取网络为相同的结构,只是训练数据不同。

2本发明可实现消息图像到含密载体的直接编码,从而避免了使用原始载体图像作为参考的约束条件,从而简化了消息嵌入过程,可实现消息图像到含密图像夸类别的图像生成。

3本发明直接将图像作为消息,实现了大容量的消息嵌入,同时由于扩散模型训练的稳定性强使得生成的含密图像具有较高的质量。

附图说明

构成本申请的一部分的附图用来提供对本申请的进一步理解,本申请的示意性实施例及其说明用于解释本申请,并不构成对本申请的不当限定。在附图中:

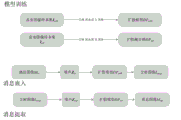

图1为本发明实施例的一种基于扩散模型的图像隐写方法流程示意图;

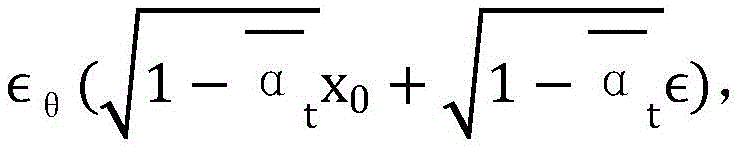

图2为本发明实施例的扩散模型的基本流程框架示意图;

图3为本发明实施例的扩散模型中用Unet网络来模拟噪声∈θ的示意图。

具体实施方式

需要说明的是,在不冲突的情况下,本申请中的实施例及实施例中的特征可以相互组合。下面将参考附图并结合实施例来详细说明本申请。

需要说明的是,在附图的流程图示出的步骤可以在诸如一组计算机可执行指令的计算机系统中执行,并且,虽然在流程图中示出了逻辑顺序,但是在某些情况下,可以以不同于此处的顺序执行所示出或描述的步骤。

实施例

在生成模型领域出现的生成模型-扩散模型(Diffusion Models,DM)。扩散模型受非平衡热力学的启发,首先定义了基于马尔可夫链的扩散过程,即缓慢的向数据中添加随机噪声,直到数据变成高斯噪声位置,然后迭代的逐步学习反(逆)扩散过程,将噪声逐步变换为所需的数据样本。该模型将生成过程看作是逐步迭代的去噪过程,因此只需要每次利用一个简单的神经网络模型去模拟高斯噪声,使得模型训练的稳定性得到了保证。为了进一步提高生成含密载体的生成效率及质量,扩宽基于生成模型的图像隐写技术的实现方式,本发明提出了一种新的基于扩散模型的大容量图像隐写方法,该方法首先利用两类数据集分别训练扩散模型,得到两个扩散模型。然后通过将两个扩散模型进行不同的串行组合以实现消息的嵌入和提取。特别是该方法并不需要原始载体用作参考,可将消息图像消息,直接编码成含密载体实现大容量隐写。

如图1所示,本实施例提供了一种基于扩散模型的图像隐写方法,包括:

S1训练阶段:训练一个扩散概率模型作为消息嵌入过程中的消息嵌入网络。

S11:利用大量真实图像样本集Iemb及对扩散概率模型DMemb进行训练,得到图像生成器DMemb,θ,其中θ为生成模型参数;

S12:利用大量真实图像样本集Iext及对扩散概率模型DMext进行训练,得到图像生成器DMext,ρ,其中ρ为生成模型参数;

S2消息嵌入阶段:将消息图像编码到含密载体中。

S21:从图像样本集Iext中选择一个图像作为秘密消息Min,通过对该消息逐步添加高斯噪声的方法,将其转化为高斯噪声Zin。

S22:将高斯噪声Zin输入到训练好的消息嵌入网络,即扩散模型DOemb中,从而产生含密图像Istego。

S3消息提取阶段:从含密载体中提取消息图像。

S31:从将含密载体Istego通过逐步添加高斯噪声的方法将其转化为高斯噪声Zout。

S32:将高斯噪声Zout输入到训练好的消息提取网络,即扩散模型DMext中,从而产生消息图像Mout。

需要说明的是,第二真实图像样本集即真实图像样本集Iext通常作为秘密消息,例如消息发送者需要发送的一个秘密图像时,可以通过将一个秘密图像通过微小的噪声修改,从而生成多张外观相同的图像,形成第二真实图像样本集,这些图像均能够作为秘密消息。第一样本集即真实图像样本集Iemb仅用于生成某一类样本的训练,可以是任意类型的图像集,但是要求这类图像集通常只包含某一类样本,例如,人脸图像集等。第一真实图像样本训练的扩散模型,将用于将秘密图像转换成一类与第一真实图像集中图片不可区分的图像,例如转换成一个人脸图像。

进一步地,本实施例所述的扩散模型,如参考图2所示,DM模型训练阶段分为正向(加噪)扩散过程和逆向扩散(去噪)过程两部分,在逆向扩散过程中训练模型参数。具体来说,扩散过程是对图像逐渐加噪的过程,它是一个马尔科夫过程,可表示为q(xt|xt-1),即给定xt-1的条件下,xt服从均值方差为βtI的正态分布,其中{βt}是每一步的方差βt∈(0,1)。在逆扩散过程中核心目标是任意一张噪声图片中经过一次次的采样得到一张图片而达成图片生成的目的,但是由于很难估计q(xt-1|xt)。因此,需要用神经网络估计一个分布pθ(xt-1|xt)来近似q(xt-1|xt).在DM模型中,实际则通过采用一个U-Net结构的自编码器(Auto-encoder)∈θ来对t时刻的噪声∈进行估计,其中θ是自编码器的参数。

训练阶段中利用真实图像x0以及一个高斯噪声∈训练模型∈θ的参数θ。基本过程是首先随机选择一个训练样本x0,然后从1-T中随机抽样一个t,接着随机产生噪声∈~N(0,1),计算当前所产生的带噪音数据并将其输入网络∈θ中预测噪音,即其中,计算产生的噪音和预测的噪音的L2损失,然后计算梯度并更新网络参数θ,直至模型收敛得到参数θ。

采样阶段则是在模型训练结束后,通过T步迭代,迭代生成载体图像的。具体来说就是从一个随机噪音开始xT~N(0,1),设定迭代步数T,接着进行逐步迭代,迭代过程是用训练好的网络预测噪音∈θ(xt,t),然后计算条件分布的均值,然后用均值加上标准差乘以一个随机噪音z,其中z~N(0,1),得到数据xt-1,即 重复执行T步迭代,直至t=0完成新样本的生成。在本实施例中设置T=1000,βt被设定为从β1=10-4到βT=0.02的线性递增序列。

具体的,对扩散概率模型预训练使用的数据集为CIFAR10,它是由AlexKrizhevsky和Ilya Sutskever创建的一个用于模式识别的小型图像数据集,这个数据集包含10个类别的RGB彩色图片,每张图像的尺寸为32×32像素,数据集包含50000张训练图像和10000张测试图像。

进一步的,在DM模型中,通过采用一个U-Net结构的自编码器(Auto-encoder)来对该噪声进行估计,如参考图3所示,该模型遵循双流(向下和向下+右)卷积结构,同时引入了残差连接;首先,该体系结构结合了下采样和上采样,这样网络的内部部分在更大的空间尺度上运行,提高了计算效率。第二,该体系结构采用远程跳接,这样每第K层都为第(K-k)层提供直接输入,其中K是网络中的层数总数。该网络被分成六层序列,其中大多数序列由下采样或上采样分开。扩散模型DM中所采用的U-Net每个步骤包含2个残差模块(residualblock),而且一些步骤中还加入了自注意力机制(self-attention)模块来增加网络的全局建模能力。另外,扩散模型其实需要的是T个噪音预测模型,实际处理时通常增加一个时间嵌入向量(time embedding)来将时间序列信息编码到网络中,如图3所示,在各个残差模块(residual block)中都引入了时间嵌入向量,从而只需要训练一个共享的U-Net模型。

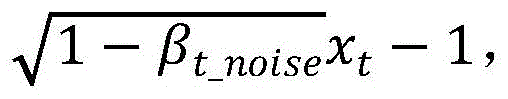

更进一步的,在S21、S31中对消息图像和含密图像的加噪过程也被定义成是一个马尔科夫过程,同样经过T次噪声叠加得到噪声图像,可表示为pnoise(xt|xt-1),即给定xt-1的条件下,xt服从均值方差为βt_noiseI的正态分布。具体的,本方案设置T=1000,βt_noise被设定为从β1=10-4到βT=0.02的线性递增序列。

本实施例的有益效果为:

1本实施例实现简单,仅需要训练两个扩散模型,分别作为消息嵌入网络和消息提取网络即可完成训练过程,消息嵌入网络和消息提取网络为相同的结构,只是训练数据不同。

2本实施例可实现消息图像到含密载体的直接编码,从而避免了使用原始载体图像作为参考的约束条件,从而简化了消息嵌入过程,可实现消息图像到含密图像夸类别的图像生成。

3本实施例直接将图像作为消息,实现了大容量的消息嵌入,同时由于扩散模型训练的稳定性强使得生成的含密图像具有较高的质量。

以上,仅为本申请较佳的具体实施方式,但本申请的保护范围并不局限于此,任何熟悉本技术领域的技术人员在本申请揭露的技术范围内,可轻易想到的变化或替换,都应涵盖在本申请的保护范围之内。因此,本申请的保护范围应该以权利要求的保护范围为准。

Claims (9)

1.一种基于扩散模型的图像隐写方法,其特征在于,包括:

利用真实图像样本集对扩散概率模型进行训练,获取图像生成模型;

将所述真实图像样本集中的图像嵌入所述图像生成模型,获取含密图像;

利用所述图像生成模型对所述含密图像进行提取,获取消息图像,完成图像隐写。

2.根据权利要求1所述的基于扩散模型的图像隐写方法,其特征在于,所述图像生成模型包括第一图像生成模型和第二图像生成模型;

获取所述图像生成模型包括:

利用第一真实图像样本集对所述扩散概率模型进行训练,获取第一图像生成模型;其中,所述第一真实图像样本集为,同一类型的图像的样本集;

利用第二真实图像样本集对所述扩散概率模型进行训练,获取第二图像生成模型;其中,所述第二真实图像样本集为与所述第一真实图像样本集不同类型的秘密图像的样本集。

3.根据权利要求2所述的基于扩散模型的图像隐写方法,其特征在于,获取所述含密图像包括:

选取所述第二真实图像样本中的图像作为秘密消息,将作为秘密消息的所述图像转化为第一高斯噪声;

将所述第一高斯噪声输入所述第一图像生成模型,获取所述含密图像。

4.根据权利要求2所述的基于扩散模型的图像隐写方法,其特征在于,获取所述消息图像包括:

将所述含密图像转化为第二高斯噪音;

将所述第二高斯噪音输入所述第二图像生成模型,获取所述消息图像。

5.根据权利要求1所述的基于扩散模型的图像隐写方法,其特征在于,所述扩散概率模型包括:自编码子模型;所述自编码子模型采用U-Net结构;

利用真实图像样本集对扩散概率模型进行训练包括:

采用所述自编码模块对所述真实图像样本集中t时刻的噪声∈进行估计。

7.根据权利要求5所述的基于扩散模型的图像隐写方法,其特征在于,U-Net结构的所述自编码子模型基于双流卷积结构构建,同时引入残差连接;

所述U-Net结构中结合了下采样和上采样,并采用远程跳接;

所述U-Net结构包括残差模块和自注意力机制模块;其中所述残差模块中引入了时间嵌入向量。

8.根据权利要求5所述的基于扩散模型的图像隐写方法,其特征在于,将所述第一高斯噪声输入所述第一图像生成模型包括:

将所述第一高斯噪声输入所述第一图像生成模型,预设迭代步数,对所述第一图像生成模型进行迭代。

Priority Applications (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| CN202211574439.6A CN116091288A (zh) | 2022-12-08 | 2022-12-08 | 一种基于扩散模型的图像隐写方法 |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| CN202211574439.6A CN116091288A (zh) | 2022-12-08 | 2022-12-08 | 一种基于扩散模型的图像隐写方法 |

Publications (1)

| Publication Number | Publication Date |

|---|---|

| CN116091288A true CN116091288A (zh) | 2023-05-09 |

Family

ID=86211110

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| CN202211574439.6A Pending CN116091288A (zh) | 2022-12-08 | 2022-12-08 | 一种基于扩散模型的图像隐写方法 |

Country Status (1)

| Country | Link |

|---|---|

| CN (1) | CN116091288A (zh) |

Cited By (2)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| CN116456037A (zh) * | 2023-06-16 | 2023-07-18 | 南京信息工程大学 | 一种基于扩散模型的生成式图像隐写方法 |

| CN117376484A (zh) * | 2023-12-05 | 2024-01-09 | 北京邮电大学 | 一种面向电子证照防伪的生成式隐写方法 |

-

2022

- 2022-12-08 CN CN202211574439.6A patent/CN116091288A/zh active Pending

Cited By (4)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| CN116456037A (zh) * | 2023-06-16 | 2023-07-18 | 南京信息工程大学 | 一种基于扩散模型的生成式图像隐写方法 |

| CN116456037B (zh) * | 2023-06-16 | 2023-08-22 | 南京信息工程大学 | 一种基于扩散模型的生成式图像隐写方法 |

| CN117376484A (zh) * | 2023-12-05 | 2024-01-09 | 北京邮电大学 | 一种面向电子证照防伪的生成式隐写方法 |

| CN117376484B (zh) * | 2023-12-05 | 2024-08-20 | 北京邮电大学 | 一种面向电子证照防伪的生成式隐写方法 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| CN111832570B (zh) | 一种图像语义分割模型训练方法及系统 | |

| CN108122197B (zh) | 一种基于深度学习的图像超分辨率重建方法 | |

| CN116091288A (zh) | 一种基于扩散模型的图像隐写方法 | |

| CN109993678B (zh) | 一种基于深度对抗生成网络的鲁棒信息隐藏方法 | |

| Zhang et al. | Generative steganography by sampling | |

| CN109949222B (zh) | 基于语义图的图像超分辨率重建方法 | |

| CN112884758B (zh) | 一种基于风格迁移方法的缺陷绝缘子样本生成方法及系统 | |

| CN116681584A (zh) | 一种多级扩散图像超分辨算法 | |

| CN112419135A (zh) | 水印识别在线训练、制样、去除方法及装置、设备、介质 | |

| CN115131188A (zh) | 一种基于生成对抗网络的鲁棒图像水印方法 | |

| CN116645260B (zh) | 一种基于条件扩散模型的数字水印攻击方法 | |

| CN112288632A (zh) | 基于精简esrgan的单图像超分辨率方法及系统 | |

| CN109903373A (zh) | 一种基于多尺度残差网络的高质量人脸生成方法 | |

| CN111768326A (zh) | 一种基于gan扩增图像前景物体的高容量数据保护方法 | |

| CN116205820A (zh) | 图像增强方法、目标识别方法、设备及介质 | |

| CN116777764A (zh) | 一种基于扩散模型的光学遥感图像去云雾方法及系统 | |

| CN113379606B (zh) | 一种基于预训练生成模型的人脸超分辨方法 | |

| Liu et al. | Hiding functions within functions: Steganography by implicit neural representations | |

| CN116112685A (zh) | 一种基于扩散概率模型的图像隐写方法 | |

| Ma et al. | AFEC: adaptive feature extraction modules for learned image compression | |

| Abdulmunem et al. | Advanced Intelligent Data Hiding Using Video Stego and Convolutional Neural Networks | |

| US11928855B2 (en) | Method, device, and computer program product for video processing | |

| CN115527258A (zh) | 一种基于身份信息响应的人脸交换方法 | |

| Zhang et al. | Pixel-Stega: Generative image steganography based on autoregressive models | |

| CN114037843A (zh) | 一种基于改进生成对抗网络的提高水下图像分辨率方法 |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| PB01 | Publication | ||

| PB01 | Publication | ||

| SE01 | Entry into force of request for substantive examination | ||

| SE01 | Entry into force of request for substantive examination |