CN115599922A - 用于训练知识图嵌入模型的设备、程序和计算机实现方法 - Google Patents

用于训练知识图嵌入模型的设备、程序和计算机实现方法 Download PDFInfo

- Publication number

- CN115599922A CN115599922A CN202210721987.0A CN202210721987A CN115599922A CN 115599922 A CN115599922 A CN 115599922A CN 202210721987 A CN202210721987 A CN 202210721987A CN 115599922 A CN115599922 A CN 115599922A

- Authority

- CN

- China

- Prior art keywords

- training

- query

- knowledge graph

- embedding

- ontology

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Pending

Links

Images

Classifications

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F16/00—Information retrieval; Database structures therefor; File system structures therefor

- G06F16/30—Information retrieval; Database structures therefor; File system structures therefor of unstructured textual data

- G06F16/36—Creation of semantic tools, e.g. ontology or thesauri

- G06F16/367—Ontology

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06N—COMPUTING ARRANGEMENTS BASED ON SPECIFIC COMPUTATIONAL MODELS

- G06N5/00—Computing arrangements using knowledge-based models

- G06N5/04—Inference or reasoning models

- G06N5/042—Backward inferencing

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06N—COMPUTING ARRANGEMENTS BASED ON SPECIFIC COMPUTATIONAL MODELS

- G06N5/00—Computing arrangements using knowledge-based models

- G06N5/02—Knowledge representation; Symbolic representation

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F16/00—Information retrieval; Database structures therefor; File system structures therefor

- G06F16/30—Information retrieval; Database structures therefor; File system structures therefor of unstructured textual data

- G06F16/33—Querying

- G06F16/332—Query formulation

- G06F16/3329—Natural language query formulation or dialogue systems

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F16/00—Information retrieval; Database structures therefor; File system structures therefor

- G06F16/90—Details of database functions independent of the retrieved data types

- G06F16/901—Indexing; Data structures therefor; Storage structures

- G06F16/9024—Graphs; Linked lists

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06N—COMPUTING ARRANGEMENTS BASED ON SPECIFIC COMPUTATIONAL MODELS

- G06N3/00—Computing arrangements based on biological models

- G06N3/02—Neural networks

- G06N3/08—Learning methods

- G06N3/084—Backpropagation, e.g. using gradient descent

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06N—COMPUTING ARRANGEMENTS BASED ON SPECIFIC COMPUTATIONAL MODELS

- G06N5/00—Computing arrangements using knowledge-based models

- G06N5/02—Knowledge representation; Symbolic representation

- G06N5/022—Knowledge engineering; Knowledge acquisition

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06N—COMPUTING ARRANGEMENTS BASED ON SPECIFIC COMPUTATIONAL MODELS

- G06N5/00—Computing arrangements using knowledge-based models

- G06N5/04—Inference or reasoning models

- G06N5/046—Forward inferencing; Production systems

Abstract

提供了用于训练知识图嵌入模型的设备、程序和计算机实现方法。用于训练由本体(202)增强的知识图(200)的知识图嵌入模型(208)的设备、计算机程序、计算机实现方法,其中该方法包括用第一训练查询及其预定回答训练(2)知识图嵌入模型(208),以减小、特别是最小化回答在知识图嵌入模型(208)中的嵌入和第一训练查询在知识图嵌入模型(208)中的嵌入之间的距离,并且减小、特别是最小化在知识图嵌入模型(208)中回答的嵌入和第二训练查询的嵌入之间的距离,其中取决于本体(202)从第一训练查询确定(1)第二训练查询。

Description

技术领域

本发明涉及用于训练知识图嵌入模型的设备、计算机程序和计算机实现方法。

背景技术

知识图嵌入模型可以被训练来提供对查询的回答。合期望的是提供一种方法,其具有回答不完整知识图上的查询的系统方式。

发明内容

一种用于训练由本体增强的知识图的知识图嵌入模型的计算机实现方法包括:用第一训练查询及其预定回答训练知识图嵌入模型,以减小、特别是最小化回答在知识图嵌入模型中的嵌入和第一训练查询在知识图嵌入模型中的嵌入之间的距离,并且减小、特别是最小化在知识图嵌入模型中回答的嵌入和第二训练查询的嵌入之间的距离,其中第二训练查询是取决于本体从第一训练查询确定的。第二训练查询是在知识图中具有回答的预定查询的专门化。这允许训练知识图嵌入模型以用于回答不完整知识图上的合取(conjunctive)查询。训练不仅依赖于原始知识图,而且还依赖于伴随知识图的本体。第二训练查询的嵌入计及用于确定第二训练查询的本体公理(ontological axiom)。

为了对第一训练查询进行采样,该方法可以包括根据本体以及知识图的实体集和关系集来确定一致的可能一元连续查询集,并且从一元连续查询集中选择第一训练查询。提供了一种用于依赖于本体对查询进行策略采样的方法,而不是对用于训练的查询进行随机采样。

该方法可以包括根据预定的查询形状确定第一训练查询。考虑根据预定查询形状的查询,而不是对查询进行随机采样。随机选择的示例可能不包括基于本体彼此相关的任何查询。这利用基于本体的采样来避免。

该方法可以包括对查询进行采样、特别是随机采样,利用本体确定查询的泛化,以及根据泛化、特别是泛化的专门化,确定第二训练查询。泛化描述了多个专门化,并允许根据本体确定与第一训练查询相似的许多不同的训练查询。

该方法可以包括提供泛化深度并确定查询的泛化直到泛化深度,和/或提供专门化深度并确定查询的专门化直到专门化深度。这实际上是为了限制计算努力。

该方法可以包括通过用知识图嵌入模型提供对合取查询的回答。

该方法可以包括训练知识图嵌入以增加、特别是最大化第一训练查询的嵌入和不是第一训练查询的回答的预定实体的至少一个嵌入之间的距离,和/或增加、特别是最大化第二训练查询的嵌入和不是第二训练查询的回答的预定实体的至少一个嵌入之间的距离。这样,训练导致第一训练查询的嵌入相比于到其非回答的嵌入更接近于其回答的嵌入。

用于训练由本体增强的知识图的知识图嵌入模型的设备被配置为执行方法中的步骤。

一种计算机程序包括计算机可读指令,该计算机可读指令当由计算机执行时,使得计算机执行该方法。

附图说明

从下面的描述和附图中可得出另外的有利实施例。在附图中

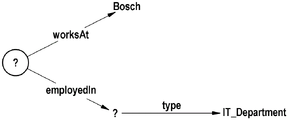

图1描绘了知识图模式,

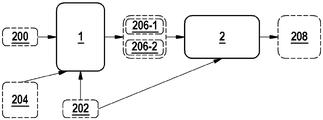

图2描绘了用于训练知识图的知识图嵌入的方法,

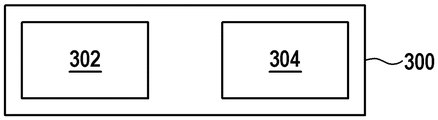

图3描绘了用于训练知识图的知识图嵌入的设备。

具体实施方式

知识图KG包括实体集和关系集。KG描述关于感兴趣的特定域的事实,其通过用实体集中的至少一个实体来表示该事实,该至少一个实体经由关系集中的至少一个关系与实体集中的至少一个其他实体互连。

在KG表示中,实体由KG的节点表示,并且两个实体之间的关系由这些节点之间的KG的边表示。

事实是主语、谓语和宾语的三元组。在KG中,主语是实体,宾语是实体,并且谓语是关系。

在KG的知识图嵌入KGE中,实体由嵌入来表示。在KGE中,关系由嵌入来表示。事实的主语嵌入、谓语嵌入和宾语嵌入的三元组在KGE中表示该事实。

KG可以用于预测第一给定实体和第二给定实体之间的关系。可以取决于得分从关系集中选择该关系。得分可以用得分函数来确定,该得分函数将第一实体在KGE中的嵌入、第二实体在KGE中的嵌入以及关系在KGE中的嵌入映射到得分。

嵌入可以是向量空间中的向量。用得分函数确定得分可以包括确定向量和。确定向量和可以包括将表示关系的向量添加到表示第一实体的向量。确定得分可以包括确定向量和到表示第二实体的向量的距离。

实体的嵌入可以是第一向量空间中的向量。关系的嵌入可以是第二向量空间中的向量。确定得分可以包括确定表示第一向量空间中的第一实体的第一向量到第二向量空间中的第一向量的映射。确定得分可以包括确定表示第一向量空间中的第二实体的第二向量到第二向量空间中的第二向量的映射。用得分函数确定得分可以包括确定向量和。确定向量和可以包括将表示第二向量空间中的关系的向量添加到第一向量。确定得分可以包括确定向量和到第二向量的距离。

在示例中,该距离是欧几里德距离。

为了用KG预测该关系,包括两个给定实体的输入可以被映射到包括该关系的输出。该关系可以从关系集中选择。在示例中,所选择的关系导致比关系集中的至少另一个关系更高的得分。优选地,选择导致关系集中关系最高得分的关系。

可以训练神经网络来表示KGE。可以用包括嵌入三元组的训练数据来训练神经网络。训练数据可以包括表示KG真实事实的三元组。训练数据可以包括表示不是KG真实事实的三元组的三元组。

神经网络可以被训练来将实体集中给定第一实体的第一嵌入和给定第二实体的第二嵌入映射到关系集中每个关系的得分。关系的得分表示对于关系而言该关系是给定第一实体和给定第二实体之间的关系的概率。

神经网络可以被训练来将给定实体的嵌入和关系集中给定关系的嵌入映射到实体集中每个实体的得分。实体的得分表示对于实体而言该实体是与给定实体具有给定关系的实体的概率。

KG被广泛用于自然问答、web搜索和数据分析。KG存储大约数百万个事实的信息。

KG可以自动、半自动或至少部分手动地构造,例如通过使用众包方法。

在训练中,可以用训练数据来训练KG或KGE、特别是神经网络,以表示可用的知识。训练数据可以包括表示真实事实的肯定三元组和表示不正确事实的否定三元组。

KG或KGE、特别是神经网络可以用肯定三元组和否定三元组来训练。

该方法在正确的(即肯定的)和不正确的(即否定的)三元组之间进行区分。

KG表示相互关联的事实信息集合。KG可以被编码为(主语;谓语;宾语)三元组集,例如(john;worksAt;bosch)。这样的三元组的主语或宾语称为实体,并且谓语称为关系。KG的三元组集可以表示为有向图,其顶点和边被标记。KG三元组被称为事实。KG事实可以如下表示为一元或二元基准谓语:man(john),worksAt(john;bosch)。

KGE关注于将KG实体和关系嵌入到具有用户指定的维度n的连续向量空间中。更具体地,KGE模型将KG三元组集取作输入,并且旨在将实体和关系映射到n维向量空间中,使得反映KG结构的一些特征得以保留。这些特征被相应的KGE模型的目标函数捕获。这样,从关系数据中获得数值向量集。

本体是表示为公理集的感兴趣域的概念化。本体反映了KG应该遵循的纲要,例如:

第一个公理声明在公司中工作的人是雇员,而第二个公理指定关系managerAt比关系worksAt更具体。

根据Artale,A.,Calvanese,D.,Kontchakov,R.,Zakharyaschev,M.: The DL-lite family and relations. CoRR abs/1401.3487 (2014),在规则右侧没有存在性的限制的情况下,我们依赖于中的本体。支持的示例性规则形式的概述如下:

对于KG和本体O,对CQ的特定回答是在KG上获得的回答,该回答用从KG和本体O推断的所有事实进行充实。

使用例如在Yahya,M.,Berberich,K.,Elbassuoni,S.,Ramanath,M.,Tresp, V.,Weikum,G.: Deep answers for naturally asked questions on the web of data. In:Proceedings of the 21st World Wide Web Conference, WWW 2012, Lyon, France,April 16-20, 2012 (Companion Volume). pp. 445–449 (2012)中公开的方法,将用户以自然语言表述的信息需求转化成这样的形式CQ。例如,对于存储关于人及其工作地点的信息的KG,用户可能对在Bosch的某个IT部门中工作的所有人感兴趣。形式上,这样的查询应该表述为:

合取查询可以自然地表示为KG模式。图1中描绘了示例性的KG模式,用于对应于上述查询的KG模式。

下面,描述一种用于在不完整的KG上回答CQ的方法。该方法不仅依赖于原始的KG,而且还依赖于KG所伴随的本体O。

该方法包括基于本体的训练策略,并且扩展了损失函数,该损失函数允许计及本体公理并且使用扩展的损失函数。这样的损失函数例如在Ren,H.,Hu,W.,Leskovec,J.:Query2box: Reasoning over knowledge graphs in vector space using boxembedding. In: ICLR. OpenReview.net (2000)中描述。

实体作为点嵌入在d维向量空间中。

查询作为框嵌入。在该上下文中,框是指d维向量空间中的轴对齐的超矩形。

用于的d维嵌入是将映射到并且将映射到的函数F,其中签名是KG G的给定签名,并且Q G 是签名上的一元CQ集,并且cen q 是框的中心,并且off q 是框cen q 的偏移。d维向量空间的到框中心cen q 距离off q 内的任何点都被认为是在该框内部。

该方法旨在以查询框内部的点集对应于CQ的回答实体集为条件来嵌入CQ主语。因为对于每一个本体规则,规则的左手侧和右手侧可以被转变成查询,所以将本体注入到KGE模型中相当于确保将对应于相应查询的框包含到彼此中。

参考图2进一步解释该方法。

至该方法的输入是KG 200和本体202。可选地,如下面将描述的提供查询深度204。

训练基于肯定样本206-1和否定样本206-2。在训练中,KGE模型208被训练。

该方法包括步骤1。

步骤1包括确定肯定样本和否定样本。

肯定样本包括训练查询及其回答。根据下面描述的训练策略来确定训练查询。否定样本如肯定样本那样被结构化,并且特别地从KG中随机采样。

在该示例中,确定了多个肯定样本和多个否定样本。

之后,执行步骤2。

步骤2包括用肯定样本和否定样本训练KGE模型208。在该示例中,用多个肯定样本和多个否定样本来训练KGE模型208。

下面描述训练目标、特别是用于训练KGE模型208的损失函数。

作为步骤2的结果计算的KGE模型可以用于回答CQ。

这意味着,该方法可以包括使用出现在知识图200中的实体集和关系集,从可以由本体(即根据本体)形成的可能的一元连续查询的集Q G 中确定训练查询。

下面,描述了用于以本体引导的方式确定训练查询的三个示例。

基于特定回答的采样:

基于特定回答的采样包括对查询进行随机采样,并在训练中使用它们连同它们的特定回答而不是标准回答。

如果本体包含一种语言中的公理,对于该语言,可以高效地进行查询回答,则生成训练查询连同它们的特定回答在实践中是可行的。在Artale,A.,Calvanese,D.,Kontchakov,R.,Zakharyaschev,M.: The dl-lite family and relations. CoRR abs/1401.3487 (2014)中公开了对于基于特定回答的采样的示例性语言。

作为举例,假设KG 200存储以下事实:

并且本体O包含规则:

以及给出的特定的随机选择的查询:

它的特定回答是:

在示例中,该查询及其特定回答定义了训练步骤2的肯定样本。

基于查询重写的采样:

基于查询重写的采样还向随机采样查询集添加其专门化和泛化。计及本体O而获得查询的专门化。计及本体O而获得查询的泛化。

作为举例,给定公理:

和查询:

第一规则R1产生:

作为查询q的泛化,并且第三规则R3产生:

作为q'的专门化。

该方法可以包括对多个查询连同其泛化和专门化进行随机采样,并使用多个查询及其泛化和专门化来构造训练样本。

为减少计算努力,该方法可以包括提供生成训练查询所达到的泛化深度k g 和/或专门化深度k s 。在该示例中,输入到该方法的查询深度204定义泛化深度k g 和/或专门化深度k s 。

向随机查询添加泛化和专门化允许捕获本体背景知识的一些部分。

基于策略本体的训练:

基于策略本体的训练旨在基于本体O找到相关查询。

该方法可以包括通过依赖于本体O来生成训练查询。

目标查询集借助于有向非循环图(N,E)来形式化,其中N是节点集,并且E是有向边集。这样的有向非循环图DAG捕获查询的形状。该形状可以用来自签名的关系R集和常数来实例化。签名可以进一步包括符号,例如尚要被确定的用于关系R或实体的关系符号或变量。然后,通过应用标记函数f将签名中的符号分配给KG的节点和边,获得目标查询集。

在该示例中,查询形状S是元组(N,E,A,n),使得(N,E)是DAG,并且是S的区别节点,并且标示S中的锚节点集。对于来自签名的给定关系集和常数,标记函数f是从到的映射,其中V是变量集,使得每个锚节点被映射到常数,每个非锚节点被映射到变量或常数,并且每个边映射到签名中的关系符号。

在该示例中,标记函数f用以下集确定:

其中,对于给定的关系p:

这样创建了语义上有意义的查询。

包括多个训练查询的训练集例如通过计算每个查询形状的每个有效标记函数并添加未被本体O捕获的数据模式来构造。在该上下文中,未被本体O捕获的数据模式可以是其泛化或专门化。

在该示例中,给定形状S的在KG上具有回答的所有标记查询是一元CQ的集Q G 。使用本体O,例如利用上述的规则R1到R6来确定每个查询的泛化。在该示例中,所获得的多个训练查询包含在给定本体O和该数据模式集的情况下可以构造的所有查询。

该方法可以包括为每个锚节点、特别是随机地选择一部分有效实体。这意味着对于被选作锚点的每个实体,所得的查询在KG 200上产生特定回答。

Ren, H., Leskovec, J.: Beta embedding for multi-hop logical reasoningin knowledge graphs. In: Advances in Neural Information Processing Systems33: Annual Conference on Neural Information Processing Systems 2020, NeurIPS2020, December 6-12, 2020, virtual (2020)公开了一种用于利用目标函数训练知识图嵌入模型的示例性训练方法。

KGE模型208基于该训练方法。与该方法形成对照,用于训练的目标函数还计及本体公理。

该示例中的方法旨在学习查询的表示,包括它们依赖于本体O的泛化和/或专门化。

该示例中的方法旨在减小、优选地最小化查询的嵌入和表示回答、即肯定样本的嵌入之间的距离,同时增加、特别是最大化查询的嵌入和表示非回答、即否定样本的嵌入之间的距离。

该方法旨在确保如果某个训练查询q是依赖于本体O的另一个查询q'的泛化,则用于训练查询q的框box q 包含用于该另一个训练查询q'的框box q' 。

更一般地,如果a是用于训练查询q的回答实体,则该方法旨在不仅最小化回答a和训练查询q之间的距离,而且还最小化回答a和训练查询q的专门化之间的距离。

在示例中,提供给定查询训练集及其回答,以及查询的多个泛化或查询的所有泛化。

第一损失函数是否定对数似然性:

作为举例,本体O可以包含规则

给定在具有本体O的KG G上对查询q的特定回答为,训练目标是要最小化函数p的嵌入v p 与查询q的嵌入box q 之间的距离,以及嵌入v p 与嵌入空间中对应于查询q的泛化q 1 、q 2 、q 3 的框之间的距离。

依赖于上面定义的两个目标函数中的任一个以及使用上面描述的方法之一生成的肯定和否定查询样本,知识图嵌入模型208被训练。

所获得的知识图嵌入模型208可以用于回答对配备有本体的不完整KG上的合取查询。

知识图200、本体202和/或嵌入模型208可以涉及机器的状态、数字图像中的对象的特性或者对问题的回答。

知识图200可以表示关于机器的状态消息到机器状态的映射的知识。该方法可以包括接收状态消息并取决于状态消息输出机器状态。可以通过用知识图嵌入模型208预测包括表示状态的主语实体和表示机器状态的宾语实体的三元组是否存在来确定状态。该方法可以包括输出机器状态。

对于数字图像处理,知识图200可以是在图像的对象识别中识别的对象的描述。知识图200中的实体可以表示对象和/或其特性。方法可以包括接收对象并取决于对象输出描述。

在街景视图中,对象可以是汽车、人、房屋或基础设施的其他部分。在街景视图中,知识图200、本体202和/或嵌入模型208可以描述对象和/或该对象与特别是数字图像中另一对象的关系。该方法可以包括接收对象并取决于对象输出描述。

该方法可以用于回答用本体增强的不完整KG上的复杂查询。该方法可以应用于例如制造领域中的数字孪生(digital twins)的上下文中。

在图3中,示意性地描绘了用于训练由本体202增强的知识图200的知识图嵌入模型208的设备300的至少一部分。设备300适于执行该方法中的步骤。

设备300包括至少一个存储装置和至少一个处理器。

在该示例中,存储装置302被配置为存储KG 200、KGE模型208、本体202、肯定样本206-1和否定样本206-2。

在该示例中,处理器304被配置为执行上述方法。存储装置302可以存储计算机可读指令,所述计算机可读指令当被处理器304执行时,使得其执行所述方法。处理器304可以被配置为例如从存储装置302或接口(未描绘)接收查询深度204。

Claims (9)

1.一种用于训练由本体(202)增强的知识图(200)的知识图嵌入模型(208)的计算机实现方法,其特征在于,所述方法包括用第一训练查询及其预定回答训练(2)知识图嵌入模型(208),以减小、特别是最小化回答在知识图嵌入模型(208)中的嵌入和第一训练查询在知识图嵌入模型(208)中的嵌入之间的距离,并且减小、特别是最小化在知识图嵌入模型(208)中回答的嵌入和第二训练查询的嵌入之间的距离,其中取决于本体(202)从第一训练查询确定(1)第二训练查询。

2.根据权利要求1所述的方法,其特征在于,根据本体以及知识图(200)的实体集和关系集来确定(1)一致的可能一元连续查询集,并且从一元连续查询集中选择第一训练查询。

3.根据权利要求2所述的方法,其特征在于,所述方法包括根据预定的查询形状确定第一训练查询。

4.根据前述权利要求中的一项所述的方法,其特征在于,所述方法包括对查询进行采样、特别是随机采样,利用本体(202)确定所述查询的泛化,以及根据所述泛化、特别是所述泛化的专门化,确定第二训练查询。

5.根据权利要求4所述的方法,其特征在于,提供泛化深度并确定查询的泛化直到泛化深度,和/或提供专门化深度并确定查询的专门化直到专门化深度。

6.根据前述权利要求中的一项所述的方法,其特征在于,利用知识图嵌入模型(208)提供对合取查询的回答。

7.根据前述权利要求中的一项所述的方法,其特征在于,训练知识图嵌入(208)以增加、特别是最大化第一训练查询的嵌入和不是对第一训练查询的回答的预定实体的至少一个嵌入之间的距离,和/或增加、特别是最大化第二训练查询的嵌入和不是对第二训练查询的回答的预定实体的至少一个嵌入之间的距离。

8.一种用于训练由本体(202)增强的知识图(200)的知识图嵌入模型(208)的设备(300),其特征在于,所述设备(300)适于执行根据权利要求1至7中的一项的方法中的步骤。

9.一种计算机程序,其特征在于,所述计算机程序包括计算机可读指令,所述计算机可读指令当被计算机执行时,使得计算机执行根据权利要求1至7中的一项的方法。

Applications Claiming Priority (2)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| EP21181822.4A EP4109348A1 (en) | 2021-06-25 | 2021-06-25 | A device, a computer program and a computer-implemented method for training a knowledge graph embedding model |

| EP21181822.4 | 2021-06-25 |

Publications (1)

| Publication Number | Publication Date |

|---|---|

| CN115599922A true CN115599922A (zh) | 2023-01-13 |

Family

ID=76623993

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| CN202210721987.0A Pending CN115599922A (zh) | 2021-06-25 | 2022-06-24 | 用于训练知识图嵌入模型的设备、程序和计算机实现方法 |

Country Status (4)

| Country | Link |

|---|---|

| US (1) | US20220414480A1 (zh) |

| EP (1) | EP4109348A1 (zh) |

| JP (1) | JP2023004969A (zh) |

| CN (1) | CN115599922A (zh) |

-

2021

- 2021-06-25 EP EP21181822.4A patent/EP4109348A1/en active Pending

-

2022

- 2022-06-10 US US17/837,206 patent/US20220414480A1/en active Pending

- 2022-06-24 JP JP2022101646A patent/JP2023004969A/ja active Pending

- 2022-06-24 CN CN202210721987.0A patent/CN115599922A/zh active Pending

Also Published As

| Publication number | Publication date |

|---|---|

| US20220414480A1 (en) | 2022-12-29 |

| EP4109348A1 (en) | 2022-12-28 |

| JP2023004969A (ja) | 2023-01-17 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| CN114064918B (zh) | 一种多模态事件知识图谱构建方法 | |

| CN110427461B (zh) | 智能问答信息处理方法、电子设备及计算机可读存储介质 | |

| CN109783666B (zh) | 一种基于迭代精细化的图像场景图谱生成方法 | |

| CN112307351A (zh) | 用户行为的模型训练、推荐方法、装置和设备 | |

| CN110580288A (zh) | 基于人工智能的文本分类方法和装置 | |

| CN112749562A (zh) | 命名实体识别方法、装置、存储介质及电子设备 | |

| CN114419642A (zh) | 一种文档图像中键值对信息的抽取方法、装置及系统 | |

| CN113515632B (zh) | 基于图路径知识萃取的文本分类方法 | |

| Hu et al. | Hierarchical graph semantic pooling network for multi-modal community question answer matching | |

| CN115563327A (zh) | 基于Transformer网络选择性蒸馏的零样本跨模态检索方法 | |

| CN111598252B (zh) | 基于深度学习的大学计算机基础知识解题方法 | |

| CN114625858A (zh) | 一种基于神经网络的政务问答智能回复方法及装置 | |

| CN114372454A (zh) | 文本信息抽取方法、模型训练方法、装置及存储介质 | |

| CN117271724A (zh) | 一种基于大模型和语义图谱的智能问答实现方法及系统 | |

| CN116501877A (zh) | 一种基于因果图谱的多模态注意力谣言检测方法 | |

| CN115599922A (zh) | 用于训练知识图嵌入模型的设备、程序和计算机实现方法 | |

| CN115359486A (zh) | 一种文档图像中自定义信息的确定方法及系统 | |

| Woof et al. | A framework for end-to-end learning on semantic tree-structured data | |

| Mendel | Type-2 Fuzzy sets and systems: How to learn about them | |

| CN114021550A (zh) | 一种基于图卷积神经网络的新闻趋势预测系统及方法 | |

| CN105808522A (zh) | 一种语义联想的方法及装置 | |

| CN112732942A (zh) | 一种面向用户的多轮问答法律文书实体关系抽取方法 | |

| CN115186072A (zh) | 一种基于双过程认知理论的知识图谱视觉问答方法 | |

| CN111831880A (zh) | 一种基于微酒店平台的智能问答方法 | |

| CN116661940B (zh) | 组件识别方法、装置、计算机设备和存储介质 |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| PB01 | Publication | ||

| PB01 | Publication |