CN112970046A - 数字角色混合和生成系统和方法 - Google Patents

数字角色混合和生成系统和方法 Download PDFInfo

- Publication number

- CN112970046A CN112970046A CN201980070137.5A CN201980070137A CN112970046A CN 112970046 A CN112970046 A CN 112970046A CN 201980070137 A CN201980070137 A CN 201980070137A CN 112970046 A CN112970046 A CN 112970046A

- Authority

- CN

- China

- Prior art keywords

- model

- texture

- modifications

- shapes

- texture maps

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Pending

Links

- 238000000034 method Methods 0.000 title claims abstract description 96

- 238000002156 mixing Methods 0.000 title claims description 50

- 230000004048 modification Effects 0.000 claims abstract description 59

- 238000012986 modification Methods 0.000 claims abstract description 59

- 210000003205 muscle Anatomy 0.000 claims description 64

- 210000003128 head Anatomy 0.000 claims description 61

- 230000001815 facial effect Effects 0.000 claims description 28

- 230000000694 effects Effects 0.000 claims description 12

- 210000000887 face Anatomy 0.000 claims description 12

- 230000007935 neutral effect Effects 0.000 claims description 11

- 210000001508 eye Anatomy 0.000 claims description 10

- 210000004279 orbit Anatomy 0.000 claims description 10

- 210000004209 hair Anatomy 0.000 claims description 9

- 238000004891 communication Methods 0.000 claims description 8

- 206010014970 Ephelides Diseases 0.000 claims description 6

- 208000003351 Melanosis Diseases 0.000 claims description 6

- 239000002537 cosmetic Substances 0.000 claims description 6

- 230000009471 action Effects 0.000 claims description 5

- 210000000720 eyelash Anatomy 0.000 claims description 5

- 238000010238 partial least squares regression Methods 0.000 claims description 5

- 210000005252 bulbus oculi Anatomy 0.000 claims description 4

- 208000032544 Cicatrix Diseases 0.000 claims description 3

- 210000004087 cornea Anatomy 0.000 claims description 3

- 210000001061 forehead Anatomy 0.000 claims description 3

- 231100000241 scar Toxicity 0.000 claims description 3

- 230000037387 scars Effects 0.000 claims description 3

- 208000012641 Pigmentation disease Diseases 0.000 claims description 2

- 230000014759 maintenance of location Effects 0.000 claims 2

- 238000004088 simulation Methods 0.000 claims 2

- 238000012413 Fluorescence activated cell sorting analysis Methods 0.000 claims 1

- 239000000049 pigment Substances 0.000 claims 1

- 230000008569 process Effects 0.000 description 13

- 239000000203 mixture Substances 0.000 description 11

- 230000006870 function Effects 0.000 description 7

- 238000010801 machine learning Methods 0.000 description 7

- 230000011218 segmentation Effects 0.000 description 7

- 230000002146 bilateral effect Effects 0.000 description 5

- 230000000875 corresponding effect Effects 0.000 description 5

- 238000009499 grossing Methods 0.000 description 5

- 238000002310 reflectometry Methods 0.000 description 5

- 210000000988 bone and bone Anatomy 0.000 description 4

- 230000014509 gene expression Effects 0.000 description 4

- 230000003068 static effect Effects 0.000 description 4

- 230000009466 transformation Effects 0.000 description 4

- 230000037303 wrinkles Effects 0.000 description 4

- 230000008901 benefit Effects 0.000 description 3

- 238000004422 calculation algorithm Methods 0.000 description 3

- 230000008859 change Effects 0.000 description 3

- 230000007547 defect Effects 0.000 description 3

- 210000004709 eyebrow Anatomy 0.000 description 3

- 239000011159 matrix material Substances 0.000 description 3

- 230000003287 optical effect Effects 0.000 description 3

- 210000000515 tooth Anatomy 0.000 description 3

- 241000282412 Homo Species 0.000 description 2

- 238000004364 calculation method Methods 0.000 description 2

- 239000003086 colorant Substances 0.000 description 2

- 238000004590 computer program Methods 0.000 description 2

- 238000013500 data storage Methods 0.000 description 2

- 238000013136 deep learning model Methods 0.000 description 2

- 238000010586 diagram Methods 0.000 description 2

- 238000013507 mapping Methods 0.000 description 2

- 239000011148 porous material Substances 0.000 description 2

- 238000000513 principal component analysis Methods 0.000 description 2

- 238000005215 recombination Methods 0.000 description 2

- 230000006798 recombination Effects 0.000 description 2

- 238000009877 rendering Methods 0.000 description 2

- 210000003625 skull Anatomy 0.000 description 2

- 210000002105 tongue Anatomy 0.000 description 2

- 238000012546 transfer Methods 0.000 description 2

- 208000002874 Acne Vulgaris Diseases 0.000 description 1

- 238000012935 Averaging Methods 0.000 description 1

- 206010004950 Birth mark Diseases 0.000 description 1

- 208000007256 Nevus Diseases 0.000 description 1

- 206010040954 Skin wrinkling Diseases 0.000 description 1

- 206010000496 acne Diseases 0.000 description 1

- 230000003044 adaptive effect Effects 0.000 description 1

- 230000032683 aging Effects 0.000 description 1

- 238000013459 approach Methods 0.000 description 1

- 238000003491 array Methods 0.000 description 1

- 238000013473 artificial intelligence Methods 0.000 description 1

- 230000006835 compression Effects 0.000 description 1

- 238000007906 compression Methods 0.000 description 1

- 230000001010 compromised effect Effects 0.000 description 1

- 238000010276 construction Methods 0.000 description 1

- 230000001276 controlling effect Effects 0.000 description 1

- 238000013527 convolutional neural network Methods 0.000 description 1

- 230000002596 correlated effect Effects 0.000 description 1

- 238000000354 decomposition reaction Methods 0.000 description 1

- 238000013135 deep learning Methods 0.000 description 1

- 238000006073 displacement reaction Methods 0.000 description 1

- 238000005516 engineering process Methods 0.000 description 1

- 210000000744 eyelid Anatomy 0.000 description 1

- 210000001097 facial muscle Anatomy 0.000 description 1

- 238000001914 filtration Methods 0.000 description 1

- 210000002454 frontal bone Anatomy 0.000 description 1

- 238000005286 illumination Methods 0.000 description 1

- 210000000554 iris Anatomy 0.000 description 1

- 238000012417 linear regression Methods 0.000 description 1

- 238000010606 normalization Methods 0.000 description 1

- 210000002221 olecranon process Anatomy 0.000 description 1

- 230000036544 posture Effects 0.000 description 1

- 238000002360 preparation method Methods 0.000 description 1

- 238000004321 preservation Methods 0.000 description 1

- 238000007639 printing Methods 0.000 description 1

- 238000012545 processing Methods 0.000 description 1

- 201000003004 ptosis Diseases 0.000 description 1

- 230000008521 reorganization Effects 0.000 description 1

- 230000004044 response Effects 0.000 description 1

- 230000036548 skin texture Effects 0.000 description 1

- 238000012549 training Methods 0.000 description 1

- 230000007704 transition Effects 0.000 description 1

- 239000013598 vector Substances 0.000 description 1

- 230000000007 visual effect Effects 0.000 description 1

Images

Classifications

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T13/00—Animation

- G06T13/20—3D [Three Dimensional] animation

- G06T13/40—3D [Three Dimensional] animation of characters, e.g. humans, animals or virtual beings

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T15/00—3D [Three Dimensional] image rendering

- G06T15/04—Texture mapping

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T15/00—3D [Three Dimensional] image rendering

- G06T15/50—Lighting effects

- G06T15/503—Blending, e.g. for anti-aliasing

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T19/00—Manipulating 3D models or images for computer graphics

- G06T19/20—Editing of 3D images, e.g. changing shapes or colours, aligning objects or positioning parts

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T7/00—Image analysis

- G06T7/10—Segmentation; Edge detection

- G06T7/149—Segmentation; Edge detection involving deformable models, e.g. active contour models

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2207/00—Indexing scheme for image analysis or image enhancement

- G06T2207/30—Subject of image; Context of image processing

- G06T2207/30196—Human being; Person

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2219/00—Indexing scheme for manipulating 3D models or images for computer graphics

- G06T2219/20—Indexing scheme for editing of 3D models

- G06T2219/2021—Shape modification

Landscapes

- Engineering & Computer Science (AREA)

- Physics & Mathematics (AREA)

- General Physics & Mathematics (AREA)

- Theoretical Computer Science (AREA)

- Computer Graphics (AREA)

- Software Systems (AREA)

- Computer Hardware Design (AREA)

- General Engineering & Computer Science (AREA)

- Architecture (AREA)

- Computer Vision & Pattern Recognition (AREA)

- Processing Or Creating Images (AREA)

- Image Processing (AREA)

- Image Analysis (AREA)

Abstract

描述了一种用于创建虚拟对象或数字实体的模型的方法,该方法包括:接收用于多个模型的多个基本形状;接收指定将对基本形状进行的修改的多个指定的修改变量;以及将指定的一处或多处修改应用到多个基本形状以生成用于至少一个模型的多个经修改的基本形状。

Description

技术领域

本发明涉及数字角色混合和生成系统和方法。

背景技术

用于在游戏或数字人类AI系统中使用的计算机头像或数字角色的生成是众所周知的。用于生成计算机头像或数字角色的现有技术系统集中于生成符合成本效益但质量可能受到损害的纹理和几何。通常通过整个数字角色的线性组合来执行多个头像的混合。线性组合通常用于几何和纹理。

然而,因为精细的细节丢失了,因此它们用于混合的角色越多,作为结果的纹理越模糊。同样地,对于几何,用于混合的面部越多,作为结果的几何越平滑。面部最终都将看起来是普通的面部模型。

进一步,现有技术系统只混合静态面部,并且不创建动态表情。人口估计通常也基于线性回归。

本发明的目的是提供一种数字角色混合和生成的方法或至少为公众或行业提供一种有用的选择。

发明内容

根据示例实施例,提供了一种用于创建虚拟对象或数字实体的模型的方法,该方法包括:

接收用于多个模型的多个基本形状作为输入;

接收至少一个修改变量作为输入,该至少一个修改变量指定将对基本形状进行的修改;以及

将指定的修改应用到多个基本形状以生成用于至少一个模型的多个经修改的基本形状。

根据其他示例实施例,提供了一种用于创建虚拟对象或数字实体的模型的系统,该系统包括:

至少一个处理器;以及

与至少一个处理器通信的存储器,

其中处理器被编程为:

接收用于多个模型的多个基本形状;

接收至少一个修改变量,该至少一个修改变量指定将对基本形状进行的修改;以及

将指定的修改应用到多个基本形状以生成用于至少一个模型的多个经修改的基本形状。

根据另一示例实施例,提供了用于创建区域掩模以应用到虚拟对象或数字实体的方法,该方法包括:

接收用于多个模型的多个基本形状,基本形状被表示为一组肌肉变形描述符;

基于肌肉变形描述符的影响区域将每个肌肉变形描述符分类成组;以及

基于影响区域针对用于至少一个模型的每个基本形状生成区域掩模。

根据又一示例实施例,提供了一种用于创建区域掩模以应用到虚拟对象或数字实体的系统,该系统包括:

至少一个处理器;以及

与至少一个处理器通信的存储器,

其中处理器被编程为:

接收用于至少一个模型的多个基本形状,基本形状被表示为一组肌肉变形描述符;

基于肌肉变形描述符的影响区域将每个肌肉变形描述符分类成组;以及

基于影响区域针对用于至少一个模型的每个基本形状生成区域掩模。

根据又一示例实施例,提供了一种用于创建纹理模型以应用到虚拟对象或数字实体的方法,该方法包括:

接收用于至少一个模型的一个或多个纹理贴图作为输入;

手动地、半自动地或自动地识别一个或多个纹理贴图中的每个纹理贴图上的多个普遍特征定位符;

将纹理贴图分离成多个层,每个层包括至少一个特征;

接收多个指定的修改变量作为输入,该多个指定的修改变量指定将对纹理贴图进行的修改;

应用指定的修改;以及

混合层以创建用于至少一个模型的一个或多个纹理贴图。

根据又一示例实施例,提供了一种用于创建纹理模型以应用到虚拟对象或数字实体的系统,该系统包括:

至少一个处理器;以及

与至少一个处理器通信的存储器,

其中处理器被编程为:

接收用于至少一个模型的一个或多个纹理贴图;

识别一个或多个纹理贴图中的每个纹理贴图上的多个普遍特征定位符;

将一个或多个纹理贴图中的每个纹理贴图分离成多个层,每个层包括至少一个特征;

接收多个修改变量,该多个修改变量指定将对一个或多个纹理贴图进行的修改;以及

应用指定的修改并且混合层以生成用于至少一个模型的一个或多个纹理贴图。

附图说明

并入并构成本说明书的一部分的附图示出了本发明的实施例,并且,以上给出的本发明的一般描述以及以下给出的实施例的详细描述一起用于解释本发明的原理,其中:

图1是几何混合过程的流程图;

图2是纹理混合过程的流程图;

图3是区域掩模生成过程的流程图;

图4是具有缺失形状的头部模型格网的示例;

图5A是全局几何混合的示例;

图5B是保留了骨骼结构的区域几何混合的示例;

图5C是未保留骨骼结构的区域几何混合的示例;

图6A是具有第一纹理的头部的示例;

图6B是具有第二纹理的头部的示例;

图6C是具有混合的第一纹理和第二纹理的头部的示例;

图7A是示出了额头的肌肉网络的头部的示例;

图7B是示出了左眼窝的肌肉网络的头部的示例;

图7C是示出了右眼窝的肌肉网络的头部的示例;

图7D是示出了鼻子的肌肉网络的头部的示例;

图7E是示出了颈部的肌肉网络的头部的示例;

图7E是示出了下面部的肌肉网络的头部的示例;

图8A是几何控制界面的示例;

图8B是纹理控制界面的示例;

图8C是颜色控制界面的示例;

图9A是示出了原始纹理的头部的示例;

图9B是示出了附加有皮肤缺陷的纹理的头部的示例;

图9C是示出了附加有皱纹和面部毛发的纹理的头部的示例;

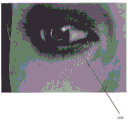

图10A是示出了参考纹理的眼睛的示例;

图10B是具有新的基础层纹理的眼睛的示例;

图10C是具有新的细节层纹理的眼睛的示例;

图11是示出了肌肉网络的手臂的示例;以及

图12是实施例的示例实施系统。

具体实施方式

系统

在一个实施例中,用于混合数字人类的模型(包括头像或数字角色)的系统和方法通常在具有至少一个CPU、存储器和存储物(通常是数据库)的一个或多个计算机系统上实施。进一步,GPU实施可以极大地提高系统的性能。

参考图1212,示出了系统1200的示例实施方式。第一服务器系统1210连接至数据存储1220。数据存储1220可以是数据库。并且第一服务器系统1210包括一个或多个服务器。第一服务器系统1210连接至因特网1240。模型的用户的至少一个其他服务器系统1250连接至第一服务器系统1210。多个用户系统1230、1260、1270连接至各种服务器系统1210、1250。

在一个实施例中,用于混合的数据库优选地包括十个或更多头部模型(M1、M2、……、Mn∈M),这些头部模型跨越不同种族、性别、年龄组和体格。提供的模型越多,混合系统工作得越好。尽管优选十个头部模型,但可以使用更少的数量。参考图4,示出了具有缺失形状的示例头部模型格网410。

优选地,每个头部模型(角色A-D)425需要至少包括中性脸型,其中,中性形状具有相同的网格拓扑并且是可混合的。每个头部模型可以具有任何数量的混合形状,这些混合形状表示一组肌肉变形描述符,例如,由面部动作编码系统(FACS)识别的动作单元(AU)420。动作单元的示例包括“内侧眉毛提升器”、“外侧眉毛提升器”、“唇角拉动器”、“下颌打开”以及“唇角拉动器和下颌打开”。

也可以对肌肉变形描述符进行统计计算。例如,使用主成分分析(PCA)可以计算动画中帧的网格形状变体的主成分。当动画中仅涉及感兴趣的肌肉时,计算的主成分可以被用作肌肉变形描述符。

尽管关于头部进行了讨论,但是系统和方法可以同等地被用于身体、部分身体、上身、面部、面部的一部分或头部的一部分。在身体的其他部分的情况下,这些描述符可以由肌肉驱动骨骼运动、姿态或皮肤表面的变形来表示。

在数据库中,每个肌肉变形描述符优选地由至少一个头部模型表示。对于每个肌肉变形描述符,我们需要使至少一个头部模型表示该肌肉变形描述符。肌肉变形描述符可以来自任何头部模型。在图4中所示出的基于FACS的示例头部模型组中,只有“角色C”具有“外侧眉毛提升器”AU。

进一步,每个头部模型(角色)可以具有任何数量的表情混合形状,这些表情混合形状被表示为肌肉变形描述符的组合或中间点。

每个头部模型(角色)的信息都用元数据标记,元数据包括诸如种族、性别、年龄组和体格之类的人口统计信息或用户希望控制的任何其他信息。元数据还可以描述诸如鼻子形状(例如,鹰钩鼻、肉鼻、朝天鼻等)、眼皮结构(例如,深眼窝、单眼皮、耷拉的眼皮等)、唇部形状(例如,薄唇、厚唇等)的身体特征。元数据还可以包括其他身体特征的信息。

选择包括与头部相关的所有解剖学上的资产(asset)的参考头部模型。解剖学上的资产包括颅骨、牙齿、舌头、眼球、角膜或组成详细且逼真的数字人类/头像的其他重要的网格模型。模型(角色)可以具有它们自己的发型、睫毛样式、面部毛发,并且模型可以包括其他诸如耳环之类的配饰。这些配饰可以具有不同的网格拓扑。

初始数据库可能是稀疏的,其中许多头部模型(角色)具有缺失的混合型状。面部移植可以被用来生成缺失的混合形状以完成混合形状格网,或替代地,格网上的每个混合形状也可以由用户手动造型。

参考图1,从起始库100,系统创建一组稳定的头部模型130。这可以通过生成任何缺失的肌肉变形描述符105或具有由用户造型肌肉变形描述符来完成,从而对于每个模型有完全填充的肌肉变形描述符库。如果有缺失的资产,它们可以被生成115或由用户手动创建。一旦资产完全填充,系统可以将所有头部模型稳定为参考头部模型,从而有一组稳定的头部模型130。

区域分割和重组

区域分割被用来为每个头部模型分离出不同的面部区域。通过基于肌肉的位置对肌肉变形描述符进行分组来分割这些区域掩模,例如,额骨、左眼窝和右眼窝周围、鼻区域周围、颈部区域以及下面部中。下面部肌肉变形描述符进一步分类为移动唇部、脸颊块和颌骨的描述符。忽略横跨不同面部区域的组合肌肉变形描述符。从这些分组中,获得面部区域掩模,并且它们是额区域、左眼窝、右眼窝、鼻区域、左脸颊、右脸颊、嘴、颈部区域以及头部的其余部分。面部区域示出在图7A-7F中。对于每个分组中的每个肌肉变形描述符上的每个顶点,通过将高斯分布拟合到位移量(这里也可以使用变形梯度),可以计算针对每个组的区域掩模,区域可以重叠。使用基于肌肉变形描述符的分割的优势在于:分割是基于肌肉活动和影响的,并且因此,使用这种方法提取的区域在动态可变形的面部(不仅在静态面部上)上具有最佳的覆盖和平滑度。以类似的方式,对于身体的其他部分可以计算区域掩模,诸如选择图11中所示出的手臂1100的肌肉1110。

参考图3,示出了区域分割和重组的过程。该过程开始于具有肌肉变形描述符分解的各种头部模型库310。每个肌肉变形描述符都基于影响区域分类成组。然后基于肌肉变形描述符形状对头部模型进行分组320。对于相对于中性形状的每个肌肉变形描述符形状,系统然后计算每个顶点的变形梯度。计算325变形梯度的分布并且针对每个头部模型(角色)的每个区域组计算变形梯度分布图。使用阈值将分布转换为掩模335,掩模是平滑的。这产生用于每个模型的唯一区域掩模340。

几何模型的混合

使用混合形状等式来重建新的头部:

被强制为保证增量的组合是可行的解决方案。

在优选实施例中,s是用户定义的值,可以被用来改变输出的头部模型的样式。

上述混合过程是头部模型的全局混合步骤,并且将产生表情混合形状格网中的中性形状和所有表情形状。

区域混合

每个区域可以独立于全局混合进行混合并且组合在一起,且应用于全局混合的头部模型以形成最终混合的模型。通过以下方式实现区域的混合和重组。

基于用户提供的混合权重,将头部模型以及静态区域掩模混合在一起。上述相同的凸约束像按照应用于区域混合那样应用于全局混合。

再次参考图1,为了基于区域来混合,系统通过使用前述混合的静态区域掩模140从而生成每个肌肉变形描述符的分割的区域模型145来对每个区域进行分割135。

系统然后执行普式转换150以使每个分割顶点与它们在平均头部模型上的相应位置对齐。在该步骤中,每个顶点基于区域掩模而不同地加权。使用中性形状来计算普式转换并将其应用于中性形状和表情形状,从而表情形状具有与中性形状相同的对齐。

使用有限元法(FEM)将区域155中的每个区域的中性形状结合在一起。FEM的目标是对以下目标函数最小化:

E=α1Eregion+α2Esmooth+α3Ecentroid

其中,Eregion、Esmooth和Ecentroid是区域混合术语、平滑术语和形心约束术语:

其中Wr是区域r的混合掩模权重,R是将要混合的区域的总数,yr是用于对齐的区域分割的目标顶点坐标,并且x是全局混合顶点坐标。Esmooth是二阶Sobolev平滑函数,它确保了从区域到区域的过渡平滑且逼真。

其中,a1和a2是分别控制轮廓和表面曲率的平滑度的平滑参数,并且y是作为结果的顶点坐标。Econtroid引入弱约束,该弱约束确保作为结果的混合的区域在全局混合网格中保持起相应的位置。

Ecentroid=∫||c(x)-c(y)||2dx

其中,c是返回网格中每个元素的形心的形心函数。在有限元设置中,对目标函数E最小化可以是线性化的。求解该问题涉及求解稀疏线性方程组。

为结合表情形状的区域网格,应用上述过程。然而,区域混合术语被改变以作用于变形梯度张量而不是顶点位置。

其中,

是从全局混合表情形状(yg)的每个顶点位置和全局混合中性形状(xg)的对应的顶点位置计算的变形梯度张量。并且

是从区域混合表情形状(yr)的每个顶点位置和区域混合中性形状(xr)的对应的顶点位置计算的变形梯度张量。用于FEM拟合的目标函数变为:

E=α1Eregion_def+α2Esmooth+α3Ecentroid。

或经由RBF插值或通过铆钉装配(rigging,另外,rig在本文中可以指组件)来生成用于结果模型的解剖学上的资产配饰。RBF插值应用在未附接到面部网格(诸如颅骨、牙齿、眼球等)的资产上。而铆钉装配应用在面部网格上具有附接点(诸如睫毛和面部毛发)的资产上。

一旦计算出区域头部模型,则可以压缩170模型并将模型添加到混合模型。以上步骤通常将在准备中预先计算195。混合权重可以在线地198应用到混合模型以实时创建混合的头部模型。一种示例可以是基于数字人类与之交互的用户来创建混合的数字人类。

骨骼结构保留

由于系统将区域分割与全局混合的面部模型对齐,因此系统保持了面部特征的尺寸和不同面部特征之间的相对位置。这等同于在变更身份时保持了面部的骨骼结构(对于全局混合的头部模型)。此外,头部模型的骨骼结构可以通过变更对齐比来改变。基于这种关系,系统可以改变对齐比以变更骨骼结构。参考图5A-5C,示出了混合特征的示例。在所有情况下,示出的起始模型510、530、550是相同的。在图5A中,全局混合已经被应用于模型520。在图5B中,区域混合已经被应用于新的身份,其中保留了骨骼结构。在图5C中,区域混合已经被应用于新的身份,其中未保留骨骼结构。

人口统计预测

系统还能够使用具有二次预测变换的偏最小二乘回归(PLSR),从一组人口统计参数(包括年龄、性别、种族和体格)学习、预测并将人口统计预测167应用到头部模型。

ф(X)=TPT+E

Y=TQT+F

其中X是人口统计参数,并且Y是网格顶点的估计坐标。ф(X)是X的二次变换方程。T=фV是从ф提取的得分向量的矩阵,是通过权重矩阵V获得的,权重矩阵V最大化了ф和Y之间的解释协方差。矩阵P和Q是荷载矩阵。E和F是分别封装X和Y的未解释方差的残差矩阵。

PLSR估计人口统计参数(X)和头部模型中顶点的坐标(Y)之间的最佳关系,同时保留人口统计参数(X)中解释的方差的水平。这是因为通过对ф和Y之间的关系进行建模来提取T,使得其与Y高度相关。在该应用中,PLSR允许使用简单关系(定义在潜在空间中)来对估计几何变化的复杂多变量问题进行建模,这些问题通过对人口统计参数共变引起。例如,衰老的影响可能针对不同的性别、种族或体格而改变。

为确保实时性能,可以预先计算195大量的计算,包括区域混合、变形转移和平滑。混合形状插值系统然后用来对变形实时进行重新插值。

可替代地,还可以训练PLSR模型来仿真混合系统。PLSR可以为混合模型提供最佳压缩并减少实时混合成本和内存占用。

自定义

图8A中所示出的混合系统的用户界面可以允许用户有能力通过操控几何资产来自定义数字人类的与几何相关的特征810、820、830。这可以是实时的。可以被操控的资产包括交换睫毛、虹膜、牙齿、舌头、头发、配饰和衣服。

当混合身体部分时;可以对身体类型、肌肉质量和区域特征(例如,宽肩和大脚)的自定义进行混合。在身体部分或身体上的混合遵循以上概述,包括再次基于肌肉模型的区域混合。

纹理混合

来自每个训练头像的皮肤纹理通过双边高斯滤波器的层级,其中层级的每一层被设计为提取特定类型的纹理细节,诸如面部毛发、皱纹、痣、雀斑和皮肤毛孔。一旦提取了层,则每一层然后可以独立地混合和合成以形成新的纹理贴图。这种分层方法的优势在于,在混合过程期间可以保留皮肤细节。

当混合纹理时,系统可以具有n(n≥2)个数字角色的面部纹理数据库。每组面部纹理定义为根据男演员/女演员的照片重建的纹理贴图(T1,T2,……,Tm)的集合。对于一组中所有数字角色的纹理贴图组应当具有一致的光照条件和色彩空间。

纹理贴图表示空间变化的特征,这些特征可以在光照模型中使用以渲染最终的图像。多个纹理贴图可以表示对象的空间变化的图形质量,阴影模型将该图形质量用于渲染。纹理贴图的示例包括反射率贴图、漫反射贴图、阴影贴图、凹凸贴图或镜面贴图。在另一实施例中,根据诸如深度外观模型(S Lombardi-2018)之类的深度学习模型可以生成渲染纹理贴图。

优选地,一组纹理贴图上的各个像素表征每个数字角色的相同的面部解剖位置。尽管在不同的数字角色中不严格要求点对点对应性,但是面部特征应当在纹理贴图组上占据类似的位置。纹理贴图的尺寸对于所有的数字角色应当是相同的。

参考图2,识别出概述面部特征的普遍特征定位符(p1,p2,……,pn)215。对于每个数字角色,可以手动地、半自动地或自动地识别这些普遍特征定位符(作为反射率贴图上的像素位置)。为使用机器学习算法自动地识别普遍特征定位符,需要在反射率贴图上识别出的普遍特征定位符的多个示例。这些示例被馈送到合适的机器学习算法中以学习反射率贴图的图像特征和普遍特征定位符的位置之间的关系。一旦已经建立这种关系,可以自动地在新的数字角色的反射率贴图上检测出普遍特征定位符的位置。对于每个数字角色的纹理贴图(T1,T2,……,Tm)被分离成包括基础层和I-1特征层的I层。基础层(T11,T21,……,Tm1)包括数字角色的最一般且普遍的特征,例如,肤色和面部特征的全局形状。每个特征层包括不同尺寸和对比度的面部特征(Ti1,Ti2,……,Til,j=2,3,…,l),其中

各个特征层(Tij,j=2,3,…,l)被计算为原始纹理贴图和双边高斯滤波器纹理贴图之间的差/增量,其中已经由其他特征层考虑的特征被移除。对于数字角色的纹理贴图的基础层和所有特征层的总和应当重建原始纹理贴图。

双边高斯滤波器所需要的参数包括域和范围标准偏差。域滤波器的标准偏差由特征的宽度(以像素为单位)确定。较小的特征需要较小的域标准偏差来提取,且较大的特征需要较大的域标准偏差来提取。标准偏差的范围由特征的对比度确定。较大范围的标准偏差将导致具有较大对比度的相邻像素平滑。

对于每个数字角色,计算基于普遍特征定位符215的像素位置计算出的径向基插值的权重矩阵225。

为生成纹理贴图,端用户向系统提供一系列混合权重205(wij,其中i=1,2,…,n并且j=1,2,…,l)。混合权重的数量是数字角色的数量与纹理贴图所分离成的层的数量的乘积。权重限制在0到1之间。对于纹理贴图的基础层(T11,T21,……,Tm1),所有数字角色的混合权重的总和应当是1。对于特征层不需要该约束。

输出的纹理贴图中的普遍特征定位符(q,220)的像素位置被计算210为数字角色的加权普遍特征定位符位置的线性组合。

普遍特征定位符(q)然后被用作混合的普遍特征定位符(q)220。

使用径向基插值,对每个数字角色在q和pi(i=1,2,…,n)之间创建230置换贴图235,并且基于置换贴图,使分离成层的一组纹理贴图翘曲(T’jk,j=1,2,...,l;m=1,2,...,m)250以反映输出的普遍特征定位符q的位置。这可以对每个角色使用RBF来完成。

通过线性地组合加权纹理贴图来生成输出的纹理贴图(S1,S2,…,Sm)270。

为纹理贴图的每个区域创建混合掩模。混合掩模中的权重在0到1之间。对于任何像素,所有区域混合掩模权重的总和是1。对于每个区域,基于混合掩模识别纹理贴图中的相关像素。

使用如以上部分描述的相同的过程来执行生成区域纹理贴图。使用混合掩模将各个区域纹理贴图结合在一起以形成完整的纹理贴图。

作为几何归一化的一部分,可以通过需要基于UV的转移方法的自动过程将纹理转移到新的归一化拓扑。

基于光照强度和色彩空间(包括环境水平)可以对纹理进行归一化,以允许纹理的混合保持一致。这可以使用计算机视觉系统来完成,该计算机视觉系统在添加到库中之前预测对目标纹理的最佳曝光。

在一个实施例中,通过机器学习或深度学习框架(诸如生成对抗网络或变体自动编码器)生成输出纹理贴图。这可以使用下列步骤生成:

1.对于数字角色中的每个,提取一预定义组的纹理贴图。可以使用任何合适的方法从纹理贴图提取特征层,包括双边高斯滤波器或其他手动的或自动的图像特征过滤技术。

2.对于每个特征层,使用来自每个数字角色的对应的特征层来训练机器学习或深度学习模型。这将为每个特征层产生机器学习模型:例如,针对基本音的一个机器学习或深度学习模型,针对皮肤雀斑的另一个模型等。可以使用的机器学习模型的示例是生成对抗网络、变体自动编码器或深度卷积神经网络的变体。

3.在实时纹理重建期间,通过模型推断单独合成每个特征层,结合各个重建的特征层以形成准备渲染的输出纹理贴图。

在其他实施例中,可以被添加化妆层系统以自定义数字人类的外观,该化妆层系统可以在脸和/或身体上应用化妆或移除化妆以加强。还可以操控诸如眼睛颜色、牙齿的白度、皮肤色素、雀斑、纹身和伤疤之类的纹理相关特征以加强数字人类的真实性或所期待的自定义外观。

使用在几何混合过程中所描述的类似的流程,PLSR可以被用来预测纹理贴图中的人口统计变化。

添加或移除皮肤缺陷

在纹理混合的部分中描述的分层流程可以用来移除皮肤的细节和缺陷。例如,通过调整滤波器参数(域和范围标准偏差),可以使用双边高斯滤波器来提取特征,例如,皮肤毛孔、皱纹、雀斑、粉刺或面部毛发,而保留其他细节。对于数字角色,可以减少、放大或完全移除将这些特征封装到一组输出的纹理贴图的层的贡献。

类似地,封装这些特征的层可以被转移到其他数字角色以改变视觉外观。

数字化妆

分层流程的另一应用是应用数字化妆或移除数字化妆。化妆程序的效果(例如,应用皮肤粉底、唇彩、腮红、面部阴影、眼线、眼影和高光)可以从数字角色中提取。可以从数字角色中减少、加强或移除这种效果。数字化妆的效果还可以应用到其他数字角色。

应用数字化妆需要在识别化妆和未化妆的纹理贴图之间的像素对应性方面有高水平的准确性。图像配准算法(例如,光流或模板匹配)可以被用来提高数字角色的纹理贴图中点对点对应性的准确性。

除了普遍特征定位符,还可以包括各个特定特征定位符来提高化妆和未化妆的纹理贴图之间的点对点对应性的准确性。例如,可以创建各个特定特征定位符来标记存在于化妆和未化妆的纹理贴图两者中的皮肤痣。

以与数字化妆类似的方式也可以应用、移除纹身、胎记或其他大的皮肤特征或减少其强度。

图9A-图10C中示出了应用到模型的纹理系统的示例。图9A示出了具有原始纹理的头部模型,图9B示出了附加有具有皮肤缺陷的纹理的头部模型,并且图9C示出了附加有具有皱纹和面部毛发的纹理的头部模型。

纹理系统还可以被应用到其他资产,例如,图10A-10C中所示出的眼睛。图10A示出了示出有参考纹理的眼睛,图10B示出了具有新的基础层纹理的相同的眼睛,并且图10C示出了具有新的细节层纹理的图10A的眼睛。

图8B-8C中所示出的系统的用户界面800可以允许用户有能力通过操控角色纹理和色彩来自定义数字人类的与纹理相关的特征850、860和色彩870。

解释

可以在任何合适的电子计算系统上利用描述的方法和系统。根据以下描述的实施例,电子计算系统使用各种模块和引擎来利用本发明的方法。

电子计算系统可以包括至少一个处理器、一个或多个存储装置或用于连接到一个或多个存储装置的界面、用于连接到外部装置以使得系统能够接收来自一个或多个用户或外部系统的指令并根据该指令操作的输入和输出界面、用于各种部件之间的内部和外部通信的数据总线以及合适的电源。进一步,电子计算系统可以包括用于与外部和内部装置通信的一个或多个通信装置(有线或无线)以及一个或多个输入/输出装置,诸如显示器、指示装置、键盘或打印装置。

处理器被布置为执行作为程序指令存储在存储装置内的程序的步骤。程序指令使得能够执行各种方法,这些方法执行如本文所描述的发明。可以使用任何合适的软件编程语言和工具包(诸如,例如,基于C的语言和编译器)来开发或实现程序指令。进一步,可以以任何合适的方式存储程序指令使得它们可以被转移到存储装置或被处理器读取,诸如,例如,存储在计算机可读介质上。计算机可读介质可以是用于有形地存储程序指令的任何合适的介质,诸如,例如,固态存储器、磁带、光盘(CD-ROM或CD-R/W)、存储卡、闪存、光碟、磁盘或任何其他合适的计算机可读介质。

电子计算系统布置成与数据存储系统或装置(例如,外部数据存储系统或装置)通信以检索相关数据。

应当理解,本文所描述的系统包括被布置为执行如本文所描述的各种功能和方法的一个或多个元件。本文所描述的实施例旨在为读者提供组成系统的元件的各种模块和/或引擎如何可以互连以使得能够实现功能的示例。进一步,说明书的实施例在与系统相关的细节中解释了如何可以执行本文所描述的方法的步骤。提供了概念图以指示读者:各种不同的模块和/或引擎如何在不同阶段处理各种数据元素。

应当理解,模块或引擎的布置和构造可以根据系统和用户要求相应地进行适配,从而与本文所描述的模块或引擎不同的模块或引擎可以执行各种功能,并且某些模块或引擎可以组合成为单个的模块或引擎。

应当理解,可以使用任何合适形式的技术来实现所描述的模块和/或引擎并为其提供指令。例如,可以使用以任何合适的语言编写的任何合适的软件代码来实现或创建模块或引擎,其中,然后编译该代码以产生可以在任何合适的计算系统上运行的可执行的程序。可替代地,或结合可执行的程序,可以使用硬件、固件和软件的任何合适的混合体来实现模块或引擎。例如,可以使用专用集成电路(ASIC)、片上系统(SoC)、现场可编程门阵列(FPGA)或任何其他合适的自适应或可编程的处理装置来实现模块的部分。

可以使用经专门编程为执行所描述的步骤的通用计算系统来实现本文所描述的方法。可替代地,可以使用诸如人工智能计算系统等的专门电子计算机系统来实现本文所描述的方法,其中,已经使该计算机特别适于在从与特定字段关联的环境中捕获的特定数据上执行所描述的步骤。

实时性能和定时控制;代理对用户输入的实时响应。系统的每个部分的时延需要保持在最低,同时需要保证按时执行动作。因此,严格的时序模型是必要的。

以上已经描述了许多方法。应当理解,这些方法中的任何一种都可以由一系列指令体现,这些指令可以形成计算机程序。这些指令或该计算机程序可以存储在计算机可读介质上,该计算机可读介质可以是非暂时性的。当执行时,这些指令或该程序可以使处理器执行所描述的方法。在一些情况中,可以提供装置或系统,该装置或系统提供的模块中每个模块被配置为执行以上记录的步骤中的一个或多个步骤。

尽管以特定顺序已经记录上述方法,但是这应当视为只是说明性的。也就是说,除非上下文另有要求(诸如从属关系),否则可以在不同的实施例中以任何顺序或并行地执行步骤。

此外,在一些情况中,可以从整个方法中省略步骤,除非上下文另有要求。

如本说明书中所使用的术语“包括(comprise)”、“包括(comprises)”和“包括(comprising)”,除非另外指出,否则都旨在具有包含的意思。也就是说,它们将被认为是表示包含用户直接引用的列出的部件或元件,并且还可能包含其他未指定的部件或元件。

对本说明书中的任何文件的引用不构成承认它是现有技术、可以与其他文件有效地组合或它形成公知常识的一部分。

尽管已经通过对本发明的实施例的描述示出了本发明,并且尽管已经详细描述了实施例,但是申请人的意图不是将所附权利要求的范围限制或以任何方式约束到这种细节。其他优点和修改对本领域技术人员将是显而易见的。因此,本发明在其更广泛的方面不限于所示出和描述的具体细节、代表性设备和方法以及说明性示例。因此,可以背离这种细节而不背离申请人的总发明构思的精神或范围。

Claims (78)

1.一种用于创建虚拟对象或数字实体的模型的方法,所述方法包括:

接收用于多个模型的多个基本形状;

接收多个修改变量,所述多个修改变量指定将对所述基本形状进行的一处或多处修改;以及

将指定的一处或多处修改应用到所述多个基本形状,以生成用于至少一个模型的多个经修改的基本形状。

2.根据权利要求1所述的方法,其中指定的修改变量包括用于保留所选特征的保留变量。

3.根据权利要求1或权利要求2所述的方法,还包括:应用所指定的一处或多处修改以分离所述多个基本形状的区域并将所述一处或多处修改混合在一起。

4.根据权利要求1至3中任一项所述的方法,其中所述多个基本形状包括选自由身体、部分身体、上身、面部和面部的一部分组成的组中的至少一个要素。

5.根据权利要求1至4中任一项所述的方法,其中指定的修改变量包括一处或多处人口统计预测修改,并且指定的一处或多处人口统计预测修改包括选自由年龄、性别、种族和体格组成的组中的至少一个要素。

6.根据权利要求5所述的方法,其中一处或多处人口统计预测修改基于预测、使用偏最小二乘回归PLSR、使用至少两个变量来进行。

7.根据权利要求5或权利要求6所述的方法,其中对基本形状的区域进行所述一处或多处人口统计预测修改,并混合所述一处或多处人口统计预测修改。

8.根据权利要求7所述的方法,其中通过基于一组肌肉变形描述符分析肌肉影响来分割区域。

9.根据权利要求8所述的方法,其中手动地、统计地或使用物理模拟来创建所述一组肌肉变形描述符。

10.根据权利要求7所述的方法,其中通过根据基于肌肉的面部动作编码系统FACS分析肌肉影响来分割区域。

11.根据权利要求1至10中任一项所述的方法,其中所述基本形状被表示为一组肌肉变形描述符。

12.根据权利要求11所述的方法,其中生成的多个经修改的基本形状是一整组肌肉变形描述符,所述一整组肌肉变形描述符的组合可以动画化一系列活动。

13.根据权利要求1至10中任一项所述的方法,其中所述基本形状被表示为基于肌肉的面部动作编码系统FACS。

14.根据权利要求13所述的方法,其中所生成的多个经修改的基本形状是全肌肉变形描述符组件。

15.根据权利要求1至14中任一项所述的方法,其中所述多个基本形状是面部或面部的一部分,并且生成所述多个经修改的基本形状包括:生成选自由眼球、角膜、牙齿、舌头和颅骨资产组成的组中的至少一个要素。

16.根据权利要求1至15中任一项所述的方法,其中多个基本形状是面部或面部的一部分,并且生成所述多个经修改的基本形状包括:生成用于所述经修改的基本形状的头发和/或睫毛样式。

17.一种计算机,所述计算机被编程或可操作为实施前述权利要求中任一项所述的方法。

18.一种或多种计算机可读介质,所述一种或多种计算机可读介质存储计算机可用指令,当由计算装置使用时,所述计算机可用指令使得所述计算装置实施根据权利要求1至16中任一项所述的方法。

19.一种几何模型,所述几何模型包括通过根据权利要求1至16中任一项所述的方法生成的多个基本形状。

20.一种用于创建虚拟对象或数字实体的模型的系统,所述系统包括:

至少一个处理器;以及

与所述至少一个处理器通信的存储器,

其中所述处理器被编程为:

接收用于多个模型的多个基本形状;

接收多个指定的修改变量,所述多个指定的修改变量指定将对所述基本形状进行的一处或多处修改;以及

将指定的一处或多处修改应用到所述多个基本形状,以生成用于至少一个模型的多个经修改的基本形状。

21.根据权利要求20所述的系统,其中指定的修改变量包括用于保留所选特征的保留变量。

22.根据权利要求20或权利要求21所述的系统,其中所述处理器还被编程为应用所指定的一处或多处修改以分离所述多个基本形状的区域并将所述一处或多处修改混合在一起。

23.根据权利要求20至22中任一项所述的系统,其中所述多个基本形状包括选自由身体、部分身体、上身、面部和面部的一部分组成的组中的至少一个要素。

24.根据权利要求20至23中任一项所述的系统,其中所述指定的修改变量包括一处或多处人口统计预测修改,并且用户指定的一处或多处人口统计预测修改包括选自由年龄、性别、种族和体格组成的组中的至少一个要素。

25.根据权利要求24所述的系统,其中一处或多处人口统计预测修改基于预测、使用偏最小二乘回归PLSR、使用至少两个变量来进行。

26.根据权利要求24或权利要求25所述的系统,其中对基本形状的区域进行所述一处或多处人口统计预测修改,并混合所述一处或多处人口统计预测修改。

27.根据权利要求22所述的系统,其中通过基于一组肌肉变形描述符分析肌肉影响来分割区域。

28.根据权利要求27所述的系统,其中手动地、统计地或使用物理模拟来创建所述一组肌肉变形描述符。

29.根据权利要求27所述的系统,其中通过根据基于肌肉的面部动作编码系统FACS动作单元AU分析肌肉影响来分割区域。

30.根据权利要求20至27中任一项所述的系统,其中所述基本形状被表示为一组肌肉变形描述符。

31.根据权利要求30所述的系统,其中生成的多个经修改的基本形状是一整组肌肉变形描述符,所述一整组肌肉变形描述符的组合可以动画化一系列活动。

32.根据权利要求20至27中任一项所述的系统,其中所述基本形状被表示为基于肌肉的面部动作编码系统FACS。

33.根据权利要求31所述的系统,其中所生成的多个经修改的基本形状是全肌肉变形描述符组件。

34.根据权利要求20至33中任一项所述的系统,其中所述多个基本形状是面部或面部的一部分,并且生成所述多个经修改的基本形状包括:生成选自由眼球、角膜、牙齿、舌头和颅骨资产组成的组中的至少一个要素。

35.根据权利要求20至34中任一项所述的系统,其中多个基本形状是面部或面部的一部分,并且生成所述多个经修改的基本形状包括:生成用于所述经修改的基本形状的头发和/或睫毛样式。

36.一种几何模型,所述几何模型包括通过根据权利要求20至35中任一项所述的系统生成的多个基本形状。

37.一种用于创建区域掩模以应用到虚拟对象或数字实体的方法,所述方法包括:

接收用于至少一个模型的多个基本形状,所述基本形状被表示为一组肌肉变形描述符,所述一组肌肉变形描述符的组合可以动画化一系列活动;

基于肌肉变形描述符的影响区域将每个肌肉变形描述符分类成组;以及

基于所述影响区域针对用于至少一个模型的每个基本形状生成区域掩模。

38.根据权利要求37所述的方法,其中基于相对于未变形肌肉的形状计算出的变形梯度来生成所述区域掩模。

39.根据权利要求37所述的方法,其中使用面部动作编码系统FACS来表示所述肌肉变形描述符。

40.根据权利要求37或权利要求39所述的方法,其中使用面部动作编码系统FACS动作单元AU来表示所述肌肉变形描述符。

41.根据权利要求39或权利要求40所述的方法,其中基于相对于中性FACS形状计算出的变形梯度来生成所述区域掩模。

42.根据权利要求37至41中任一项所述的方法,其中生成的所述区域掩模包括额区域、左眼窝、右眼窝、鼻区域、左脸颊、右脸颊、嘴、颈部区域和头部的其余部分中的至少一者。

43.一种计算机,所述计算机被编程或可操作为实施根据权利要求37至42中任一项所述的方法。

44.一种或多种计算机可读介质,所述一种或多种计算机可读介质存储计算机可用指令,当由计算装置使用时,所述计算机可用指令使得所述计算装置实施根据权利要求37至42中任一项所述的方法。

45.一种用于创建区域掩模以应用到虚拟对象或数字实体的系统,所述系统包括:

至少一个处理器;以及

与所述至少一个处理器通信的存储器,

其中所述处理器被编程为:

接收用于至少一个模型的多个基本形状,所述基本形状被表示为一组肌肉变形描述符;

基于肌肉变形描述符的影响区域将每个肌肉变形描述符分类成组;以及

基于所述影响区域针对用于至少一个模型的每个基本形状,生成区域掩模。

46.根据权利要求34所述的系统,其中基于相对于未变形肌肉的形状计算出的变形梯度来生成所述区域掩模。

47.根据权利要求45或权利要求46所述的系统,其中生成的所述区域掩模包括额区域、左眼窝、右眼窝、鼻区域、左脸颊、右脸颊、嘴、颈部区域和头部的其余部分中的至少一者。

48.一种用于创建纹理模型以应用到虚拟对象或数字实体的方法,所述方法包括:

接收用于至少一个模型的一个或多个纹理贴图;

识别所述纹理贴图中的每个纹理贴图上的多个普遍特征定位符;

将所述纹理贴图分离成多个层,每个层包括至少一个特征;

接收多个指定的修改变量,所述多个指定的修改变量指定将对所述纹理贴图进行的一处或多处修改;以及

应用指定的一处或多处修改;以及

混合所述层以创建用于至少一个模型的一个或多个经修改的纹理贴图。

49.根据权利要求48所述的方法,其中接收用于至少一个模型的一个或多个纹理贴图还包括:接收用于多个模型的一个或多个纹理贴图,并且混合所述层以创建用于至少一个模型的一个或多个经修改的纹理贴图还包括:混合来自至少两个模型的层以创建用于至少一个模型的一个或多个经修改的纹理贴图。

50.根据权利要求48或权利要求49所述的方法,其中所述纹理贴图具有一致的光条件。

51.根据权利要求48至50中任一项所述的方法,其中用于每个模型的所述多个纹理贴图具有点对点对应性。

52.根据权利要求48至51中任一项所述的方法,其中用于每个模型的所述多个纹理贴图上的各个像素表征相同的面部解剖学位置。

53.根据权利要求48至52中任一项所述的方法,其中用于所述多个模型中的所有模型的所述多个纹理贴图中的所有纹理贴图具有相同的尺寸。

54.根据权利要求48至53中任一项所述的方法,其中指定将对所述纹理贴图进行的修改的所述多个指定的修改变量包括指定用于增加化妆层的修改的修改变量。

55.根据权利要求48至54中任一项所述的方法,其中指定将对所述纹理贴图进行的修改的所述多个指定的修改变量包括选自由眼睛颜色、牙齿的白度、皮肤色素、雀斑、纹身和伤疤组成的组中的至少一个修改变量。

56.根据权利要求48至55中任一项所述的方法,其中所述纹理贴图表示所述虚拟对象或数字实体的空间变化的图形质量,由阴影模型使用所述空间变化的图形质量。

57.根据权利要求48至56中任一项所述的方法,还包括针对所述模型中的每一个模型,将所述多个纹理贴图应用到通过根据权利要求1至12中任一项所述的方法生成的多个经修改的基本形状。

58.根据权利要求48至57中任一项所述的方法,其中手动地、半自动地或自动地识别所述多个普遍特征定位符。

59.根据权利要求48至58中任一项所述的方法,还包括:生成化妆层,并且混合所述层以创建用于至少一个模型的一个或多个经修改的纹理贴图还包括:混合所述化妆层。

60.根据权利要求48至59中任一项所述的方法,还包括:针对所述模型中的每一个模型,将所述多个纹理贴图应用到通过根据权利要求1至16中任一项所述的方法生成的多个经修改的基本形状。

61.一种计算机,所述计算机被编程或可操作为实施根据权利要求48至60中任一项所述的方法。

62.一种或多种计算机可读介质,所述一种或多种计算机可读介质存储计算机可用指令,当由计算装置使用时,所述计算机可用指令使得所述计算装置实施根据权利要求48至60中任一项所述的方法。

63.一种纹理模型,所述纹理模型包括通过根据权利要求48至60中任一项所述的方法生成的多个纹理贴图。

64.一种几何模型,所述几何模型包括通过根据权利要求57所述的方法生成的多个基本形状。

65.一种用于创建纹理模型以应用到虚拟对象或数字实体的系统,所述系统包括:

至少一个处理器;以及

与所述至少一个处理器通信的存储器,

其中所述处理器被编程为:

接收用于至少一个模型的一个或多个纹理贴图;

识别所述一个或多个纹理贴图中的每个纹理贴图上的多个普遍特征定位符;

将所述一个或多个纹理贴图中的每个纹理贴图分离成多个层,每个层包括至少一个特征;

接收多个指定的修改变量,所述多个指定的修改变量指定将对所述一个或多个纹理贴图进行的一处或多处修改;以及

应用指定的一处或多处修改,并且混合所述层以生成用于至少一个模型的一个或多个经修改的纹理贴图。

66.根据权利要求65所述的系统,其中接收用于至少一个模型的一个或多个纹理贴图还包括:接收用于多个模型的一个或多个纹理贴图,并且混合所述层以创建用于至少一个模型的一个或多个经修改的纹理贴图还包括:混合来自至少两个模型的层以创建用于至少一个模型的一个或多个经修改的纹理贴图。

67.根据权利要求65或权利要求66所述的系统,其中所述纹理贴图具有一致的光条件。

68.根据权利要求65至67中任一项所述的系统,其中用于每个模型的所述多个纹理贴图具有点对点对应性。

69.根据权利要求65至68中任一项所述的系统,其中用于每个模型的所述多个纹理贴图上的各个像素表征相同的面部解剖学位置。

70.根据权利要求65至69中任一项所述的系统,其中用于所述多个模型中的所有模型的所述多个纹理贴图中的所有纹理贴图具有相同的尺寸。

71.根据权利要求65至70中任一项所述的系统,其中指定将对所述纹理贴图进行的修改的所述多个指定的修改变量包括指定用于增加化妆层的修改的修改变量。

72.根据权利要求65至71中任一项所述的系统,其中指定将对所述纹理贴图进行的修改的所述多个指定的修改变量包括选自由眼睛颜色、牙齿的白度、皮肤色素、雀斑、纹身和伤疤组成的组中的至少一个修改变量。

73.根据权利要求65至72中任一项所述的系统,其中所述处理器还被编程为生成化妆层,并且所述处理器被编程为在混合所述层以创建用于所述至少一个模型的一个或多个经修改的纹理贴图时混合所述化妆层。

74.根据权利要求65至73中任一项所述的系统,其中所述纹理贴图表示所述虚拟对象或数字实体的空间变化的图形质量,由阴影模型使用所述空间变化的图形质量。

75.根据权利要求65至74中任一项所述的系统,其中手动地、半自动地或自动地识别所述多个普遍特征定位符。

76.根据权利要求65至75中任一项所述的系统,其中所述处理器还被编程为针对所述模型中的每一个模型,将所述多个纹理贴图应用到通过根据权利要求20至35中任一项所述的系统生成的多个经修改的基本形状。

77.一种纹理模型,所述纹理模型包括通过根据权利要求65至75中任一项所述的系统生成的多个纹理贴图。

78.一种几何模型,所述几何模型包括通过根据权利要求76所述的系统生成的多个基本形状。

Applications Claiming Priority (3)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| NZ747626 | 2018-10-26 | ||

| NZ74762618 | 2018-10-26 | ||

| PCT/NZ2019/050142 WO2020085922A1 (en) | 2018-10-26 | 2019-10-25 | Digital character blending and generation system and method |

Publications (1)

| Publication Number | Publication Date |

|---|---|

| CN112970046A true CN112970046A (zh) | 2021-06-15 |

Family

ID=70330525

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| CN201980070137.5A Pending CN112970046A (zh) | 2018-10-26 | 2019-10-25 | 数字角色混合和生成系统和方法 |

Country Status (9)

| Country | Link |

|---|---|

| US (1) | US11354844B2 (zh) |

| EP (1) | EP3871194A4 (zh) |

| JP (1) | JP7555337B2 (zh) |

| KR (1) | KR20210069093A (zh) |

| CN (1) | CN112970046A (zh) |

| AU (1) | AU2019364148A1 (zh) |

| CA (1) | CA3111498A1 (zh) |

| SG (1) | SG11202102961YA (zh) |

| WO (1) | WO2020085922A1 (zh) |

Families Citing this family (3)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US11983834B1 (en) * | 2019-11-14 | 2024-05-14 | Radical Convergence Inc. | Rapid generation of three-dimensional characters |

| US20230260186A1 (en) * | 2022-01-27 | 2023-08-17 | Disney Enterprises, Inc. | Generating a facial-hair-free mesh of a subject |

| JPWO2023148826A1 (zh) * | 2022-02-01 | 2023-08-10 |

Family Cites Families (16)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| EP1039417B1 (en) | 1999-03-19 | 2006-12-20 | Max-Planck-Gesellschaft zur Förderung der Wissenschaften e.V. | Method and device for the processing of images based on morphable models |

| US7039222B2 (en) | 2003-02-28 | 2006-05-02 | Eastman Kodak Company | Method and system for enhancing portrait images that are processed in a batch mode |

| US20050026685A1 (en) | 2003-05-13 | 2005-02-03 | Electronic Arts Inc. | Customizing players in a video game using morphing from morph targets and other elements |

| JP4682373B2 (ja) | 2005-11-01 | 2011-05-11 | 株式会社国際電気通信基礎技術研究所 | 顔画像合成装置、顔画像合成方法および顔画像合成プログラム |

| US20070229498A1 (en) | 2006-03-29 | 2007-10-04 | Wojciech Matusik | Statistical modeling for synthesis of detailed facial geometry |

| WO2008151421A1 (en) | 2007-06-11 | 2008-12-18 | Darwin Dimensions Inc. | User defined characteristics for inheritance based avatar generation |

| GB2450757A (en) | 2007-07-06 | 2009-01-07 | Sony Comp Entertainment Europe | Avatar customisation, transmission and reception |

| US20090153552A1 (en) * | 2007-11-20 | 2009-06-18 | Big Stage Entertainment, Inc. | Systems and methods for generating individualized 3d head models |

| US20130201187A1 (en) * | 2011-08-09 | 2013-08-08 | Xiaofeng Tong | Image-based multi-view 3d face generation |

| US9607441B2 (en) | 2012-10-02 | 2017-03-28 | Autodesk, Inc. | Morphological attractor for creating custom ancestors in inheritance-based character generation |

| JP6662773B2 (ja) | 2013-08-02 | 2020-03-11 | ソウル マシーンズ リミティド | 神経行動学的アニメーションのためのシステム |

| US10095917B2 (en) | 2013-11-04 | 2018-10-09 | Facebook, Inc. | Systems and methods for facial representation |

| US9761032B2 (en) | 2014-07-25 | 2017-09-12 | Intel Corporation | Avatar facial expression animations with head rotation |

| CN106204698A (zh) | 2015-05-06 | 2016-12-07 | 北京蓝犀时空科技有限公司 | 为自由组合创作的虚拟形象生成及使用表情的方法和系统 |

| KR101968437B1 (ko) | 2015-07-09 | 2019-04-11 | 미즈호 죠호 소켄 가부시키가이샤 | 가령화 예측 시스템, 가령화 예측 방법 및 가령화 예측 프로그램 |

| CN105488472B (zh) | 2015-11-30 | 2019-04-09 | 华南理工大学 | 一种基于样本模板的数字化妆方法 |

-

2019

- 2019-10-25 SG SG11202102961YA patent/SG11202102961YA/en unknown

- 2019-10-25 CA CA3111498A patent/CA3111498A1/en active Pending

- 2019-10-25 KR KR1020217013086A patent/KR20210069093A/ko unknown

- 2019-10-25 JP JP2021522403A patent/JP7555337B2/ja active Active

- 2019-10-25 CN CN201980070137.5A patent/CN112970046A/zh active Pending

- 2019-10-25 EP EP19874840.2A patent/EP3871194A4/en active Pending

- 2019-10-25 AU AU2019364148A patent/AU2019364148A1/en active Pending

- 2019-10-25 WO PCT/NZ2019/050142 patent/WO2020085922A1/en active Search and Examination

- 2019-10-25 US US17/288,477 patent/US11354844B2/en active Active

Also Published As

| Publication number | Publication date |

|---|---|

| AU2019364148A1 (en) | 2021-06-03 |

| JP7555337B2 (ja) | 2024-09-24 |

| EP3871194A4 (en) | 2022-08-24 |

| US11354844B2 (en) | 2022-06-07 |

| CA3111498A1 (en) | 2020-04-30 |

| EP3871194A1 (en) | 2021-09-01 |

| SG11202102961YA (en) | 2021-04-29 |

| WO2020085922A1 (en) | 2020-04-30 |

| US20210390751A1 (en) | 2021-12-16 |

| JP2022505746A (ja) | 2022-01-14 |

| KR20210069093A (ko) | 2021-06-10 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| US10535163B2 (en) | Avatar digitization from a single image for real-time rendering | |

| US7804997B2 (en) | Method and system for a three dimensional facial recognition system | |

| KR102241153B1 (ko) | 2차원 이미지로부터 3차원 아바타를 생성하는 방법, 장치 및 시스템 | |

| Ichim et al. | Phace: Physics-based face modeling and animation | |

| US7200281B2 (en) | System and method for image-based surface detail transfer | |

| JP6786497B2 (ja) | 統計的技術を用いて形成されたデジタル歯冠モデルに表面詳細を追加するシステム及び方法 | |

| US20230044644A1 (en) | Large-scale generation of photorealistic 3d models | |

| WO2019050808A1 (en) | SCANNING AVATAR FROM A SINGLE IMAGE FOR REAL TIME REALIZATION | |

| CN112970046A (zh) | 数字角色混合和生成系统和方法 | |

| US9202312B1 (en) | Hair simulation method | |

| CN103208133A (zh) | 一种图像中人脸胖瘦的调整方法 | |

| KR20090081004A (ko) | 모션 픽쳐에서의 표면 캡처링 | |

| CN111833236B (zh) | 产生模拟用户的三维脸部模型的方法及装置 | |

| KR20230153451A (ko) | 역 gan들을 이용한 시도 | |

| JP2024500896A (ja) | 3d頭部変形モデルを生成するための方法、システム及び方法 | |

| KR100900823B1 (ko) | 캐릭터 애니메이션 시 피부의 주름 실시간 표현 방법 및장치 | |

| JP2024503794A (ja) | 2次元(2d)顔画像から色を抽出するための方法、システム及びコンピュータプログラム | |

| Zhang et al. | Anatomy-based face reconstruction for animation using multi-layer deformation | |

| CN117671090A (zh) | 一种表情处理方法、装置、电子设备及存储介质 | |

| Agianpuye et al. | Synthesizing neutral facial expression on 3D faces using Active Shape Models | |

| CN116778107B (zh) | 表情模型的生成方法、装置、设备及介质 | |

| CN118262035A (zh) | 从单个图像重建三维人类头部模型的系统和方法 | |

| CN117994395A (zh) | 数字人面部资产生成方法、装置、电子设备及存储介质 | |

| CN118351230A (zh) | 模型重建方法、模型处理方法及装置、设备、系统、介质 | |

| Zhao | 3D Human Face Reconstruction and 2D Appearance Synthesis |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| PB01 | Publication | ||

| PB01 | Publication | ||

| SE01 | Entry into force of request for substantive examination | ||

| SE01 | Entry into force of request for substantive examination | ||

| REG | Reference to a national code |

Ref country code: HK Ref legal event code: DE Ref document number: 40054269 Country of ref document: HK |