CN112189348B - 空间音频捕获的装置和方法 - Google Patents

空间音频捕获的装置和方法 Download PDFInfo

- Publication number

- CN112189348B CN112189348B CN201980035093.2A CN201980035093A CN112189348B CN 112189348 B CN112189348 B CN 112189348B CN 201980035093 A CN201980035093 A CN 201980035093A CN 112189348 B CN112189348 B CN 112189348B

- Authority

- CN

- China

- Prior art keywords

- microphones

- microphone

- audio signal

- caused

- displacement

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

- 238000000034 method Methods 0.000 title claims description 53

- 230000005236 sound signal Effects 0.000 claims abstract description 229

- 238000006073 displacement reaction Methods 0.000 claims abstract description 82

- 238000012545 processing Methods 0.000 claims abstract description 12

- 238000004590 computer program Methods 0.000 claims abstract description 9

- 239000013598 vector Substances 0.000 claims description 62

- 239000011159 matrix material Substances 0.000 claims description 45

- 230000005540 biological transmission Effects 0.000 claims description 28

- 238000004458 analytical method Methods 0.000 description 33

- 230000015572 biosynthetic process Effects 0.000 description 12

- 238000013461 design Methods 0.000 description 12

- 238000003786 synthesis reaction Methods 0.000 description 12

- 239000000203 mixture Substances 0.000 description 8

- 230000001934 delay Effects 0.000 description 7

- 238000010586 diagram Methods 0.000 description 6

- 238000004891 communication Methods 0.000 description 5

- 230000008569 process Effects 0.000 description 5

- 239000004065 semiconductor Substances 0.000 description 5

- 238000013459 approach Methods 0.000 description 4

- 238000009472 formulation Methods 0.000 description 4

- 230000006870 function Effects 0.000 description 4

- 238000004091 panning Methods 0.000 description 4

- 238000003491 array Methods 0.000 description 3

- 238000005259 measurement Methods 0.000 description 3

- 230000004048 modification Effects 0.000 description 3

- 238000012986 modification Methods 0.000 description 3

- 230000009471 action Effects 0.000 description 2

- 238000007796 conventional method Methods 0.000 description 2

- 230000008878 coupling Effects 0.000 description 2

- 238000010168 coupling process Methods 0.000 description 2

- 238000005859 coupling reaction Methods 0.000 description 2

- 238000009792 diffusion process Methods 0.000 description 2

- 238000009826 distribution Methods 0.000 description 2

- 238000004519 manufacturing process Methods 0.000 description 2

- 238000010606 normalization Methods 0.000 description 2

- 230000003287 optical effect Effects 0.000 description 2

- 238000005457 optimization Methods 0.000 description 2

- 230000008447 perception Effects 0.000 description 2

- 238000009877 rendering Methods 0.000 description 2

- 238000012732 spatial analysis Methods 0.000 description 2

- 101100259947 Homo sapiens TBATA gene Proteins 0.000 description 1

- 230000006978 adaptation Effects 0.000 description 1

- 230000003044 adaptive effect Effects 0.000 description 1

- 230000008901 benefit Effects 0.000 description 1

- 230000001413 cellular effect Effects 0.000 description 1

- 239000004020 conductor Substances 0.000 description 1

- 238000013500 data storage Methods 0.000 description 1

- 230000001419 dependent effect Effects 0.000 description 1

- 230000000694 effects Effects 0.000 description 1

- 238000005516 engineering process Methods 0.000 description 1

- 230000010354 integration Effects 0.000 description 1

- 230000007246 mechanism Effects 0.000 description 1

- 238000003672 processing method Methods 0.000 description 1

- 230000001902 propagating effect Effects 0.000 description 1

- 230000004044 response Effects 0.000 description 1

- 238000010845 search algorithm Methods 0.000 description 1

- 230000007480 spreading Effects 0.000 description 1

- 238000003892 spreading Methods 0.000 description 1

- 238000003860 storage Methods 0.000 description 1

- 239000000758 substrate Substances 0.000 description 1

- 230000002194 synthesizing effect Effects 0.000 description 1

- 230000009466 transformation Effects 0.000 description 1

- 230000000007 visual effect Effects 0.000 description 1

Images

Classifications

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04R—LOUDSPEAKERS, MICROPHONES, GRAMOPHONE PICK-UPS OR LIKE ACOUSTIC ELECTROMECHANICAL TRANSDUCERS; DEAF-AID SETS; PUBLIC ADDRESS SYSTEMS

- H04R3/00—Circuits for transducers, loudspeakers or microphones

- H04R3/005—Circuits for transducers, loudspeakers or microphones for combining the signals of two or more microphones

-

- G—PHYSICS

- G01—MEASURING; TESTING

- G01S—RADIO DIRECTION-FINDING; RADIO NAVIGATION; DETERMINING DISTANCE OR VELOCITY BY USE OF RADIO WAVES; LOCATING OR PRESENCE-DETECTING BY USE OF THE REFLECTION OR RERADIATION OF RADIO WAVES; ANALOGOUS ARRANGEMENTS USING OTHER WAVES

- G01S3/00—Direction-finders for determining the direction from which infrasonic, sonic, ultrasonic, or electromagnetic waves, or particle emission, not having a directional significance, are being received

- G01S3/80—Direction-finders for determining the direction from which infrasonic, sonic, ultrasonic, or electromagnetic waves, or particle emission, not having a directional significance, are being received using ultrasonic, sonic or infrasonic waves

- G01S3/801—Details

-

- G—PHYSICS

- G01—MEASURING; TESTING

- G01S—RADIO DIRECTION-FINDING; RADIO NAVIGATION; DETERMINING DISTANCE OR VELOCITY BY USE OF RADIO WAVES; LOCATING OR PRESENCE-DETECTING BY USE OF THE REFLECTION OR RERADIATION OF RADIO WAVES; ANALOGOUS ARRANGEMENTS USING OTHER WAVES

- G01S3/00—Direction-finders for determining the direction from which infrasonic, sonic, ultrasonic, or electromagnetic waves, or particle emission, not having a directional significance, are being received

- G01S3/80—Direction-finders for determining the direction from which infrasonic, sonic, ultrasonic, or electromagnetic waves, or particle emission, not having a directional significance, are being received using ultrasonic, sonic or infrasonic waves

- G01S3/802—Systems for determining direction or deviation from predetermined direction

-

- G—PHYSICS

- G10—MUSICAL INSTRUMENTS; ACOUSTICS

- G10L—SPEECH ANALYSIS TECHNIQUES OR SPEECH SYNTHESIS; SPEECH RECOGNITION; SPEECH OR VOICE PROCESSING TECHNIQUES; SPEECH OR AUDIO CODING OR DECODING

- G10L19/00—Speech or audio signals analysis-synthesis techniques for redundancy reduction, e.g. in vocoders; Coding or decoding of speech or audio signals, using source filter models or psychoacoustic analysis

- G10L19/008—Multichannel audio signal coding or decoding using interchannel correlation to reduce redundancy, e.g. joint-stereo, intensity-coding or matrixing

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04S—STEREOPHONIC SYSTEMS

- H04S3/00—Systems employing more than two channels, e.g. quadraphonic

- H04S3/02—Systems employing more than two channels, e.g. quadraphonic of the matrix type, i.e. in which input signals are combined algebraically, e.g. after having been phase shifted with respect to each other

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04S—STEREOPHONIC SYSTEMS

- H04S7/00—Indicating arrangements; Control arrangements, e.g. balance control

- H04S7/30—Control circuits for electronic adaptation of the sound field

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04R—LOUDSPEAKERS, MICROPHONES, GRAMOPHONE PICK-UPS OR LIKE ACOUSTIC ELECTROMECHANICAL TRANSDUCERS; DEAF-AID SETS; PUBLIC ADDRESS SYSTEMS

- H04R2201/00—Details of transducers, loudspeakers or microphones covered by H04R1/00 but not provided for in any of its subgroups

- H04R2201/40—Details of arrangements for obtaining desired directional characteristic by combining a number of identical transducers covered by H04R1/40 but not provided for in any of its subgroups

- H04R2201/401—2D or 3D arrays of transducers

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04R—LOUDSPEAKERS, MICROPHONES, GRAMOPHONE PICK-UPS OR LIKE ACOUSTIC ELECTROMECHANICAL TRANSDUCERS; DEAF-AID SETS; PUBLIC ADDRESS SYSTEMS

- H04R2430/00—Signal processing covered by H04R, not provided for in its groups

- H04R2430/03—Synergistic effects of band splitting and sub-band processing

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04R—LOUDSPEAKERS, MICROPHONES, GRAMOPHONE PICK-UPS OR LIKE ACOUSTIC ELECTROMECHANICAL TRANSDUCERS; DEAF-AID SETS; PUBLIC ADDRESS SYSTEMS

- H04R2430/00—Signal processing covered by H04R, not provided for in its groups

- H04R2430/20—Processing of the output signals of the acoustic transducers of an array for obtaining a desired directivity characteristic

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04R—LOUDSPEAKERS, MICROPHONES, GRAMOPHONE PICK-UPS OR LIKE ACOUSTIC ELECTROMECHANICAL TRANSDUCERS; DEAF-AID SETS; PUBLIC ADDRESS SYSTEMS

- H04R2499/00—Aspects covered by H04R or H04S not otherwise provided for in their subgroups

- H04R2499/10—General applications

- H04R2499/11—Transducers incorporated or for use in hand-held devices, e.g. mobile phones, PDA's, camera's

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04S—STEREOPHONIC SYSTEMS

- H04S2400/00—Details of stereophonic systems covered by H04S but not provided for in its groups

- H04S2400/01—Multi-channel, i.e. more than two input channels, sound reproduction with two speakers wherein the multi-channel information is substantially preserved

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04S—STEREOPHONIC SYSTEMS

- H04S2400/00—Details of stereophonic systems covered by H04S but not provided for in its groups

- H04S2400/15—Aspects of sound capture and related signal processing for recording or reproduction

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04S—STEREOPHONIC SYSTEMS

- H04S2420/00—Techniques used stereophonic systems covered by H04S but not provided for in its groups

- H04S2420/03—Application of parametric coding in stereophonic audio systems

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04S—STEREOPHONIC SYSTEMS

- H04S2420/00—Techniques used stereophonic systems covered by H04S but not provided for in its groups

- H04S2420/07—Synergistic effects of band splitting and sub-band processing

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04S—STEREOPHONIC SYSTEMS

- H04S2420/00—Techniques used stereophonic systems covered by H04S but not provided for in its groups

- H04S2420/11—Application of ambisonics in stereophonic audio systems

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04S—STEREOPHONIC SYSTEMS

- H04S2420/00—Techniques used stereophonic systems covered by H04S but not provided for in its groups

- H04S2420/13—Application of wave-field synthesis in stereophonic audio systems

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04S—STEREOPHONIC SYSTEMS

- H04S7/00—Indicating arrangements; Control arrangements, e.g. balance control

- H04S7/30—Control circuits for electronic adaptation of the sound field

- H04S7/302—Electronic adaptation of stereophonic sound system to listener position or orientation

- H04S7/303—Tracking of listener position or orientation

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04S—STEREOPHONIC SYSTEMS

- H04S7/00—Indicating arrangements; Control arrangements, e.g. balance control

- H04S7/30—Control circuits for electronic adaptation of the sound field

- H04S7/302—Electronic adaptation of stereophonic sound system to listener position or orientation

- H04S7/303—Tracking of listener position or orientation

- H04S7/304—For headphones

Landscapes

- Engineering & Computer Science (AREA)

- Physics & Mathematics (AREA)

- Signal Processing (AREA)

- Acoustics & Sound (AREA)

- Health & Medical Sciences (AREA)

- Mathematical Physics (AREA)

- General Physics & Mathematics (AREA)

- Otolaryngology (AREA)

- General Health & Medical Sciences (AREA)

- Multimedia (AREA)

- Human Computer Interaction (AREA)

- Audiology, Speech & Language Pathology (AREA)

- Computational Linguistics (AREA)

- Remote Sensing (AREA)

- Radar, Positioning & Navigation (AREA)

- Theoretical Computer Science (AREA)

- Pure & Applied Mathematics (AREA)

- Mathematical Optimization (AREA)

- Mathematical Analysis (AREA)

- Algebra (AREA)

- Circuit For Audible Band Transducer (AREA)

- Obtaining Desirable Characteristics In Audible-Bandwidth Transducers (AREA)

Abstract

一种用于空间音频信号处理的装置,所述装置包括至少一个处理器和包括计算机程序代码的至少一个存储器,所述至少一个存储器和计算机程序代码被配置为与所述至少一个处理器一起使所述装置至少:从麦克风阵列接收音频信号,该麦克风阵列包括三个或更多个麦克风,所述三个或更多个麦克风形成具有在所述三个或更多个麦克风中的对之间的定义的位移的几何形状;确定在与所述三个或更多个麦克风中的对相关联的音频信号之间的延迟信息;基于具有在所述三个或更多个麦克风中的对之间的定义的位移的几何形状来确定运算符;将所述运算符应用于所述延迟信息,以生成与所述音频信号相关联的至少一个方向参数。

Description

技术领域

本申请涉及用于空间音频捕获的装置和方法,这包括但不仅限于用于在一个或多个轴上没有大量声学阴影的情况下从装置进行空间音频捕获的装置和方法。

背景技术

参数化空间音频捕获和处理是音频信号捕获和处理的一个领域,其中使用一组参数描述声音的空间方面。例如,在从麦克风阵列进行参数化空间音频捕获时,从麦克风阵列信号中估计一组参数是一种典型而有效的选择,该参数例如频带中声音的方向,以及表示频带中所捕获声音的定向和非定向部分的相对能量的比率参数。众所周知,这些参数很好地描述了麦克风阵列位置处的所捕获声音的感知空间特性。这些参数可以相应地用于空间声音的合成,用于双耳式耳机、扬声器或其他格式,例如全景声 (Ambisonics)。

因此,频带中的方向和直接与总体能量比(direct-to-total energy ratio) 是对空间音频捕获特别有效的参数化。

传统的线性空间音频捕获方法可以应用于高端阵列(例如,多麦克风球或一组定向麦克风)。参数化空间音频捕获方法可以应用于高端阵列,也可以应用于中等阵列,例如在移动电话或小型VR摄像机等上的那些阵列。

发明内容

根据第一方面,提供了一种装置,所述装置包括至少一个处理器和至少一个包括计算机程序代码的存储器,所述至少一个存储器和所述计算机程序代码被配置为与所述至少一个处理器一起致使所述装置至少:从麦克风阵列接收音频信号,所述麦克风阵列包括三个或更多个麦克风,所述三个或更多个麦克风形成具有在所述三个或更多个麦克风中的对之间的定义的位移的几何形状;确定在与所述三个或更多个麦克风中的对相关联的音频信号之间的延迟信息;基于具有在所述三个或更多个麦克风中的对之间的定义的位移的几何形状来确定运算符;将所述运算符应用于所述延迟信息以生成与所述音频信号相关联的至少一个方向参数。

所述装置可以被进一步致使:识别所述三个或更多个麦克风中的麦克风对;确定与所述三个或更多个麦克风中的所识别对相关联的音频信号的归一化相干值;以及输出与所述三个或更多个麦克风中的所识别麦克风对相关联的音频信号的归一化相干值,作为与所述音频信号相关联的能量比参数。

被致使识别所述三个或更多个麦克风中的所述麦克风对的装置可以被致使:识别具有最大位移的麦克风对

被致使确定在与所述三个或更多个麦克风中的对相关联的音频信号之间的延迟信息的装置可以被致使:从所述三个或更多个麦克风中的所有对的完整集合中选择所述三个或更多麦克风中的所述对,并且其中,被致使识别具有最大位移的麦克风对的装置可以被致使:仅从所选择的对中识别所述三个或更多麦克风的组中具有所述最大位移的麦克风对。

所述装置可以被进一步致使:从所述音频信号中选择第一部分,所述第一部分包括高于所定义频率的音频信号,所述所定义频率与具有在所述三个或更多个麦克风中的对之间的定义的位移的几何形状相关联,其中被致使确定在与所述三个或更多个麦克风中的对相关联的音频信号之间的延迟信息的装置可以被致使:确定在所述第一部分之间的延迟信息,所述第一部分包括高于与具有在所述三个或更多个麦克风中的对之间的定义的位移的几何形状相关联的所定义频率的音频信号。

所述装置可以被进一步致使:选择第二部分,所述第二部分包括低于与具有在所述三个或更多个麦克风中的对之间的定义的位移的几何形状相关联的所定义频率的音频信号,其中所述装置还可以被致使分析包括低于所述所定义频率的音频信号的第二部分,以确定另外的空间参数。

被致使基于具有在所述三个或更多个麦克风中的对之间的定义的位移的几何形状来确定运算符的装置,可以被致使:公式化(formulate)与所述三个或更多个麦克风中的对之间的位移相关联的位移向量;基于所述公式化的位移向量来公式化位移矩阵;并将矩阵算法应用于位移矩阵以生成矩阵算法。

所述装置可以被进一步致使从位移矩阵的公式化中识别和删除与具有不可靠的延迟信息的麦克风对相关联的任何位移向量。

所述装置可以被进一步致使基于以下中的至少一个来确定所述具有不可靠的延迟信息的麦克风对:对于与该麦克风对相关联的音频信号的相干值小于定义的阈值;以及与所述麦克风对相关联的音频信号的能量比与至少一个另外的麦克风对相关的音频信号的能量小于定义的阈值或比率。

麦克风阵列可以包括以下中的一个:三个或更多个麦克风中,并且与音频信号相关联的至少一个方向参数是单个(方位角或仰角)维方向参数;以及四个或更多个麦克风,并且与音频信号相关联的至少一个方向参数是二维(方位角和仰角)方向参数。

被致使将所述运算符应用于所述延迟信息以生成与所述音频信号相关联的至少一个方向参数的装置可以被致使:通过对所述延迟信息应用所述运算符来确定方向向量;以及从所述方向向量的方向生成所述至少一个方向参数。

该装置可以被进一步致使:基于所述音频信号生成至少一个传输信号;发送和/或存储该至少一个传输信号和定向参数。

被致使发送和/或存储所述至少一个传输信号和定向参数的装置可以被进一步致使发送和/或存储至少一个传输信号、定向参数和能量比。

被致使确定在与所述三个或更多个麦克风中的对相关联的音频信号之间的延迟信息的装置可以被致使:确定在与所述三个或更多个麦克风中的至少两对相关联的音频信号之间的延迟信息。

被致使确定在与所述三个或更多个麦克风中的对相关联的音频信号之间的延迟信息的装置可以被致使:在逐个频带的基础上确定在音频信号之间的延迟信息,并且其中被致使生成与所述音频信号相关联的至少一个方向参数的装置可以被致使:在另外的逐个频带的基础上产生至少一个方向参数。

所述逐个频带的基础可以与所述另外的逐个频带的基础相同。

根据第二方面,提供了一种用于空间音频信号处理的方法,该方法包括:从麦克风阵列接收音频信号,所述麦克风阵列包括三个或更多个麦克风,所述三个或更多个麦克风形成具有在所述三个或更多个麦克风中的对之间的定义的位移的几何形状;确定在与所述三个或更多个麦克风中的对相关联的音频信号之间的延迟信息;基于具有在所述三个或更多个麦克风中的对之间的定义的位移的几何形状来确定运算符;将所述运算符应用于所述延迟信息以生成与所述音频信号相关联的至少一个方向参数。

该方法可以进一步包括:识别所述三个或更多个麦克风中的麦克风对;确定与所述三个或更多个麦克风中的所识别对相关联的音频信号的归一化相干值;以及输出与所述三个或更多个麦克风中的所识别麦克风对相关联的音频信号的归一化相干值,作为与所述音频信号相关联的能量比参数。

识别所述三个或更多个麦克风中的所述麦克风对可以包括识别具有最大位移的麦克风对。

确定在与所述三个或更多个麦克风中的对相关联的音频信号之间的延迟信息可以包括从所述三个或更多个麦克风中的所有对的完整集合中选择所述三个或更多麦克风中的所述对,并且识别所述三个或更多个麦克风中具有最大位移的麦克风对可以包括:仅从所选择的对中识别所述三个或更多个麦克风的组中具有最大位移的麦克风对。

所述方法可以进一步包括:从所述音频信号中选择第一部分,所述第一部分包括高于所定义频率的音频信号,所述所定义频率与具有在所述三个或更多个麦克风中的对之间的定义的位移的几何形状相关联,其中确定在与所述三个或更多个麦克风中的对相关联的音频信号之间的延迟信息可以包括:确定在所述第一部分之间的延迟信息,所述第一部分包括高于与具有在所述三个或更多个麦克风中的对之间的定义的位移的几何形状相关联的所定义频率的音频信号。

所述方法可以进一步包括选择第二部分,所述第二部分包括低于与具有在所述三个或更多个麦克风中的对之间的定义的位移的几何形状相关联的所定义频率的音频信号,其中该方法可以进一步包括分析包括低于所述所定义频率的音频信号的第二部分,以确定另外的空间参数。

基于具有在所述三个或更多个麦克风中的对之间的定义的位移的几何形状来确定运算符可以包括:公式化与所述三个或更多个麦克风中的对之间的位移相关的位移向量;基于公式化的位移向量来公式化位移矩阵;以及将矩阵算法应用于所述位移矩阵以生成矩阵运算符。

所述方法可以还可以包括:从位移矩阵的公式化中识别和移除与具有不可靠的延迟信息的麦克风对相关联的任何位移向量。

该方法可以还可以包括基于以下至少之一来确定具有不可靠的延迟信息的麦克风对:对于与所述麦克风对相关联的音频信号的相干值小于定义的阈值;以及与所述麦克风对相关联的音频信号的能量比与至少一个其他麦克风对相关联的音频信号的能量小定义的阈值或比率。

麦克风阵列可以包括以下之一:三个或更多个麦克风,并且与音频信号相关联的至少一个方向参数是单个(方位角或仰角)维度方向参数;以及四个或更多个麦克风,并且与音频信号相关联的至少一个方向参数是二维(方位角和仰角)方向参数。

将所述运算符应用于所述延迟信息以生成与所述音频信号相关联的至少一个方向参数可以包括:通过运算符应用于延迟信息来确定方向向量;以及从方向向量的方向生成至少一个方向参数。

所述方法可以进一步包括:基于所述音频信号产生至少一个传输信号;以及发送和/或存储所述至少一个传输信号和所述定向参数。

发送和/或存储至少一个传输信号和定向参数可以包括发送和/或存储至少一个传输信号、定向参数和能量比。

确定与所述三个或更多个麦克风中的对相关联的音频信号之间的延迟信息可以包括确定在与所述三个或更多个麦克风中的至少两对相关的音频信号之间的延迟信息。

确定在与所述三个或更多个麦克风中的对相关联的音频信号之间的延迟信息可以包括:在逐个频带的基础上确定在音频信号之间的延迟信息。

生成与所述音频信号相关联的至少一个方向参数可以包括:在另外的逐个频带的基础上生成至少一个方向参数。

所述逐个频带的基础与所述另外的逐个频带的基础相同。

根据第三方面,提供了一种装置,其包括用于以下的模块:从麦克风阵列接收音频信号,所述麦克风阵列包括三个或更多个麦克风,所述三个或更多个麦克风形成具有在所述三个或更多个麦克风中的对之间的定义的位移的几何形状;确定在与所述三个或更多个麦克风中的对相关联的音频信号之间的延迟信息;基于具有在所述三个或更多个麦克风中的对之间的定义的位移的几何形状来确定运算符;将所述运算符应用于所述延迟信息以生成与音频信号相关联的至少一个方向参数。

所述模块可以进一步被配置为:识别所述三个或更多个麦克风中的麦克风对;确定与所述三个或更多个麦克风中的所识别对相关联的音频信号的归一化相干值;以及输出与所述三个或更多个麦克风中的所识别麦克风对相关联的音频信号的归一化相干值,作为与所述音频信号相关联的能量比参数。

用于识别所述三个或更多个麦克风中的所述麦克风对的模块可以被配置为:识别具有最大位移的麦克风对。

用于确定在与所述三个或更多个麦克风中的对相关联的音频信号之间的延迟信息的模块可以被配置为:从所述三个或更多个麦克风中的所有对的完整集合中选择所述三个或更多麦克风中的所述对,并且用于识别所述三个或更多个麦克风中具有最大位移的麦克风对的模块可以被配置为:仅从所选择的对中识别所述三个或更多个麦克风的组中具有最大位移的麦克风对。

所述模块可以进一步被配置为:从所述音频信号中选择第一部分,所述第一部分包括高于所定义频率的音频信号,所述所定义频率与具有在所述三个或更多个麦克风中的对之间的定义的位移的几何形状相关联,其中,用于确定在与所述三个或更多个麦克风中的对相关联的音频信号之间的延迟信息的模块可以被配置为:确定在所述第一部分之间的延迟信息,所述第一部分包括高于与具有在所述三个或更多个麦克风中的对之间的定义的位移的几何形状相关联的所定义频率的音频信号。

所述模块可以进一步被配置为:选择第二部分,所述第二部分包括低于与具有在所述三个或更多个麦克风中的对之间的定义的位移的几何形状相关联的所定义频率的音频信号,其中所述模块可以进一步被配置为:分析包括低于所述所定义的频率的音频信号的第二部分,以确定另外的空间参数。

用于基于具有在所述三个或更多个麦克风中的对之间的定义的位移的几何形状来确定运算符的模块可以被配置为:公式化与所述三个或更多个麦克风中的对之间的位移相关的位移向量;以及基于公式化的位移向量来公式化位移矩阵;以及将矩阵算法应用于位移矩阵以生成矩阵运算符。

所述模块可以进一步被配置为:从位移矩阵的公式化中识别和移除与具有不可靠的延迟信息的麦克风对相关联的任何位移向量。

所述模块可以进一步被配置为:基于以下中的至少一个来确定具有不可靠延迟信息的麦克风对:对于与麦克风对相关联的音频信号的相干值小于定义的阈值;以及与所述麦克风对相关联的音频信号的能量比与至少一个另外的麦克风对相关联的音频信号的能量小定义的阈值或比率。

麦克风阵列可以包括以下之一:三个或更多个麦克风,并且与音频信号相关联的至少一个方向参数是单个(方位角或仰角)维度方向参数;以及四个或更多个麦克风,并且与音频信号相关联的至少一个方向参数是二维(方位角和仰角)方向参数。

用于将所述运算符应用于所述延迟信息以生成与所述音频信号相关联的至少一个方向参数的模块可以被配置为:通过对所述延迟信息应用所述运算符来确定方向向量;以及从所述方向向量的方向生成至少一个方向参数。

所述模块还可以被配置为:基于音频信号生成至少一个传输信号;以及发送和/或存储该至少一个传输信号和定向参数。

用于发送和/或存储至少一个传输信号和定向参数的模块可以被配置为:发送和/或存储至少一个传输信号、定向参数和能量比。

用于确定在与所述三个或更多个麦克风中的对相关联的音频信号之间的延迟信息的模块可以被配置为:确定在与所述三个或更多个麦克风中的至少两对相关联的音频信号之间的延迟信息。

用于确定在与所述三个或更多个麦克风中的对相关联的音频信号之间的延迟信息的模块可以被配置为:在另外的逐个频带的基础上生成至少一个方向参数。

用于生成与所述音频信号相关联的至少一个方向参数的模块可以被配置为:在另一频带的基础上生成至少一个方向参数。

所述逐个频带的基础可以与所述另外的逐个频带的基础相同。

根据第四方面,提供了一种装置,其包括用于:接收电路,被配置为从麦克风阵列接收音频信号,所述麦克风阵列包括三个或更多个麦克风,所述三个或更多个麦克风形成具有在所述三个或更多个麦克风中的对之间的定义的位移的几何形状;延迟确定电路,被配置为确定在与所述三个或更多个麦克风中的对相关联的音频信号之间的延迟信息;运算符确定电路,被配置为基于在所述三个或更多个麦克风中的对之间的定义的位移的几何形状来确定运算符;以及方向参数确定电路,用于将上述运算符应用于所述延迟信息,以生成与所述音频信号相关联的至少一个方向参数。

根据第五方面,提供了一种包括指令的计算机程序[或包括程序指令的计算机可读介质]用于使装置至少执行以下操作的程序指令:从麦克风阵列接收音频信号,所述麦克风阵列包括三个或更多个麦克风,所述三个或更多个麦克风形成具有在所述三个或更多个麦克风中的对之间的定义的位移的几何形状;确定在与所述三个或更多个麦克风中的对相关联的音频信号之间的延迟信息;基于具有在所述三个或更多个麦克风中的对之间的定义的位移的几何形状来确定运算符;将所述运算符应用于所述延迟信息以生成与所述音频信号相关联的至少一个方向参数。

根据第六方面,提供了一种非暂时性计算机可读介质,包括用于使装置至少执行以下操作的程序指令:从麦克风阵列接收音频信号,所述麦克风阵列包括三个或更多个麦克风,所述三个或更多个麦克风形成具有在所述三个或更多个麦克风中的对之间的定义的位移的几何形状;确定在与所述三个或更多个麦克风中的对相关联的音频信号之间的延迟信息;基于具有在所述三个或更多个麦克风中的对之间的定义的位移的几何形状来确定运算符;将所述运算符应用于所述延迟信息以生成与所述音频信号相关联的至少一个方向参数。

根据第七方面,提供了一种包括程序指令的计算机可读介质,用于使装置至少执行以下操作:从麦克风阵列接收音频信号,所述麦克风阵列包括三个或更多个麦克风,所述三个或更多个麦克风形成具有在所述三个或更多个麦克风中的对之间的定义的位移的几何形状;确定在与所述三个或更多个麦克风中的对相关联的音频信号之间的延迟信息;基于具有在所述三个或更多个麦克风中的对之间的定义的位移的几何形状来确定运算符;将所述运算符应用于所述延迟信息以生成与所述音频信号相关联的至少一个方向参数。

一种包括用于执行如上所述的方法的动作的装置。

一种被配置为执行如上所述的方法的动作的装置。

一种计算机程序,包括用于使计算机执行如上所述的方法的程序指令。

存储在介质上的计算机程序产品可以使装置执行本文所述的方法。

电子设备可以包括如本文所述的装置。

芯片组可以包括本文所述的装置。

本申请的实施例旨在解决与现有技术相关的问题。

附图说明

为了更好地理解本申请,现在将通过示例的方式参考附图,其中:

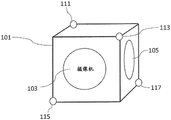

图1a示意性地示出了示例装置的几何形状;

图1b示意性地示出了示例设备摄像机和麦克风的几何形状;

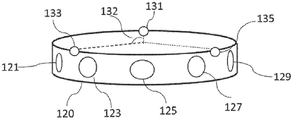

图1c示意性地示出了另一示例设备摄像机和麦克风的几何形状;

图2示意性地示出了在此描述的实施例的系统;

图3示出了图2所示的示例系统的操作流程图;

图4示意性地示出了根据一些实施例在图2中示出的示例分析处理器;

图5示出了图4所示的示例分析处理器的操作的流程图;

图6示意性地示出了根据一些实施例在图4中示出的示例高频分析器;

图7示出了图6所示的示例高频分析器的操作流程图;

图8示出了根据一些实施例的关于图1b中所示出的示例设备摄像机和麦克风几何形状的示例麦克风对;

图9示意性地示出了根据一些实施例在图2中示出的示例合成处理器;

图10示出了图9所示的示例合成处理器的操作的流程图;以及

图11示意性地示出了适于实现所示实施例的示例设备。

具体实施方式

下面进一步详细描述了用于提供声音捕获的合适的装置和可能的机制。

如上所述,参数化空间音频捕获和处理方法可用于使得能够基于实际的麦克风布置来实现感知上准确的空间声音再现。参数化空间音频捕获是指自适应DSP驱动的音频捕获方法,其涵盖以下方面:1)分析频带中感知相关的参数,例如,在记录位置处传播的声音的方向性,以及2)根据估计的空间参数在渲染侧以感知的方式再现空间声音。例如,再现可以用于耳机或多声道扬声器设置。通过估计和再现声场的感知相关的空间特性 (参数),可以再现类似于在原始声场中会发生的那样的空间感知。结果是,听众可以感知多个源、它们的方向和距离以及周围物理空间的属性,以及其他空间声音特征,就像听众位于捕获设备的位置一样。

图1a中显示了一个示例视频捕获设备。该设备被示出具有位于立方体状设备形状的侧面的两个摄像头103和105。此外,在另一侧可以有在图1a中未示出的其他摄像机,以使得设备101能够捕获360度视频。在一些实施例中,所述设备可以被配置为还捕获环绕的或3D音频,使得虚拟现实(VR)媒体内容的用户可以利用听觉提示将视图朝向感兴趣的方向,即使该方向并不在视野中。此外,用户可能需要环绕的或3D音频再现输出来产生整体逼真的空间听觉,其与视觉VR再现一起产生整体的身临其境的体验。

设备101可以不是VR摄像机。例如,所述设备可以是电话会议设备、移动电话、平板计算机。在一些实施例中,所述设备可以包括单个摄像机 (甚至根本不包括摄像机)。在一些实施例中,所述设备可以包括集成扬声器,并且所述设备可以具有与图1a中的设备相似的形状。

为了捕获空间音频,将麦克风定位或安装在设备上。对于如图1a所示的设备,生成合适的3D(方位角+仰角)音频捕获的麦克风的最小数量为 4个。这是因为在所有轴上需要在麦克风阵列的麦克风之间有至少一些间距。2D(方位角或仰角)音频捕获设备可以使用三个麦克风设备。

麦克风的位置可以被尝试定义,以生成用于空间音频捕获的最佳基础。为了在低频处实现最佳性能(由于与设备尺寸有关的音频波长),应将麦克风彼此尽可能地分开放置。

关于图1b,示出了示例设备101,该设备具有以四面体布置的四个麦克风111、113、115、117的示例放置。例如,第一麦克风111位于设备101 的顶面、背面和左侧面的拐角处,第二麦克风113位于设备101的顶面、正面和右侧面的拐角处,第三麦克风115位于设备101的底面、正面和左侧面的拐角处,第四麦克风117位于设备101的底面、背面和右侧面的拐角处。这种布置最大化了针对设备尺寸的麦克风阵列的尺寸,因此最大化在低频的处性能。

在一些实施例中,如果硬件设计的其他方面有影响,则麦克风可能不位于如图1b所示的拐角处,而是可以定位于在任何轴上朝向设备侧面的中心。但是,在这样的示例中,阵列间隔较小。

在一些实施例中,捕获设备的输出信号是全景声学格式(例如一阶全景声学(FOA))。一些VR格式使用FOA作为音频格式来传达空间音频。在此类实施例中,可以合成FOA信号,使得

-低于空间混叠或定义的频率,它们被线性公式化,并且

-高于,空间混叠参数化。

换句话说,在一些实施例中,还需要在麦克风放置方面考虑FOA信号的线性再现,以避免在某些频率下FOA图案形状的偏移。

因此,示例直径为10-30cm的设备可以设计为对于给定的设计约束集具有

1)尽可能均匀分布的麦克风间距,以及

2)尽可能大的阵列。

图1c示出了360度水平环绕捕获设备120及其上的麦克风的放置的示例。该设备形状是圆柱形的,摄像机121、123、125、127、129位于侧面,三个麦克风131、133、135被平衡分布地、并且彼此之间以角度132尽可能远离地放置在设备的顶部基座上。在一些实施例中,麦克风131、133、 135可以朝着中心移动,这可能会导致降低在低频处的性能,这取决于麦克风阵列由于其他设计要求而变得有多小。应当理解,由三个麦克风形成的示例布局在图1c中提供了二维几何形状,并且在其他可选实施例中可以形成任何合适的几何形状,其中二维几何形状可以具有不均匀的形状,并且二维几何形状不必与水平面完全对齐。

以下示例是针对图1b中所示的设备进行描述的。

然而,本文描述的方法也可以应用于针对诸如图1c中的设备的水平环绕捕获以及其他形状的3D和水平环绕捕获布置。

所述概念是以下之一:优化利用麦克风阵列(例如图1b所示)的捕获方式,和使得能够确定在低于空间混叠频率的频率处的到达方向以及在高于空间混叠频率处的到达方向,对于典型的设备尺寸该空间混叠频率可能约为2kHz。在这些频率处,音频波长太短,无法生成FOA信号或者无法利用基于这样的假设的其他分析技术,该假设为麦克风间相位可能明确包含有关到达声音方向的信息。

此外,当形状在关于麦克风布局的一些坐标轴(例如,如图1b中的设备中所示的水平面)上不产生大量声学阴影时,即使对于产品设计形状,也可以采用这些实施例来确定空间参数。声学阴影使得能够采用基于能量的方法来基于麦克风信号能量(或量级)估计到达方向。

图2示出了用于实现一些实施例的示例系统的框图。图2示出了可以在其中实现实施例的示例系统。由麦克风111、113、115、117捕获的麦克风音频信号200可以被存储和稍后处理,或者被直接处理。

分析处理器203可以从捕获设备101接收麦克风音频信号200。分析处理器203可以是例如计算机、VR摄像机或移动电话(运行合适的软件),或者替代地是利用例如现场可编程门阵列(FPGA)或专用集成电路(ASIC) 的特定设备。在一些实施例中,捕获设备101和分析处理器203被实现在同一装置或设备上。

基于麦克风阵列信号,分析处理器创建包括空间元数据204(例如,频带中的方向206和能量比208)的数据流。例如,确定的空间元数据参数包括(但不限于):方向和直接与总体能量比;方向和漫射(diffuseness);声道间电平差、声道间相位差和声道间相干性。在一些实施例中,这些参数是在时-频域中确定的。应该注意的是,除以上给出的参数比,还可以使用其他参数化。一般来说,空间音频参数化典型地描述了声音大致地(例如,使用方向)或相对地(例如,作为某些声道之间的电平差)如何在空间中分布。在图2所示的示例中,元数据204包括方向206和能量比208。

此外,麦克风阵列信号200可以被传递到预处理器201(其可以是可选的)。预处理器201可以被配置为生成合适的传输音频信号202。预处理器201可以被配置为通过从麦克风阵列信号中选择音频信号来生成传输音频信号。在一些实施例中,可以例如通过波束成形方法来组合麦克风阵列音频信号以生成传输音频信号。在一些实施例中,可以通过其他方式处理麦克风阵列信号来获得传输音频信号。

预处理器201可以被配置为生成任何合适数量的传输音频信号(或声道),例如,在一些实施例中,预处理器201被配置为生成两个传输音频信号。在一些实施例中,预处理器还被配置为对音频信号进行编码。例如,一些实施例中,可以使用高级音频编码(AAC)或增强的语音服务(EVS) 编码来编码音频信号。在一些实施例中,预处理器201被配置为均衡音频信号、应用自动噪声控制、动态处理或任何其他合适的处理。

空间元数据204和传输音频信号202可以被发送或存储在例如诸如存储器之类的存储器205中,或者可替换地在同一设备中被直接处理。在一些实施例中,空间元数据204和传输音频信号202可以通过适当的编码和/ 或复用操作被编码或量化或组合或复用为单个数据流。在一些实施例中,编码的音频信号与诸如mp4容器之类的媒体容器中的视频流(例如360 度视频)捆绑在一起,以被发送到接收器。

合成处理器207可以接收空间元数据204和发送音频信号202(或者在一些实施例中为组合数据流)。在接收单个数据流的一些实施例中,可以存在解码器和/或解复用器,用于解码接收到的信号和/或将组合的数据流解复用为分开的空间元数据204和传输音频信号202。此外,在对空间元数据204和/或传输音频信号202中的任一个进行编码或量化的情况下,合成处理器207或预处理器可以进一步对信号进行解码或量化。

合成处理器207可以是例如计算机、具有回放能力的VR回放设备或 VR摄像机、移动电话(运行合适的软件),或者是使用例如FPGA或ASIC 的特定设备。基于数据流(传输音频信号和元数据),可以将合成处理器 207配置为产生输出音频信号。对于耳机收听,输出信号可以是双耳信号 210。对于扬声器渲染,输出信号可以是多声道扬声器信号208。输出也可以是全景声信号212。全景声信号是一种空间音频信号表示,用于解码(例如解码成双耳的)以供收听,这通常意味着处理(使用滤波器和/或混频) 以从全景声信号中获得扬声器或双耳输出。

使用本文所述实施例的示例捕获设备的典型使用情形如下,其中输出是全景声:

捕获设备捕获麦克风信号,并使用如本文所述的这些实施例来确定空间元数据。

在低于空间混叠频率的频率处,捕获设备可以(从所有原始非编码麦克风信号)生成线性立体声输出。

在更高的频率(高于空间混叠频率)处,捕获设备可以使用由本文描述的实施例产生的元数据来参数化(即,非线性地、自适应地)地合成全景声输出。

然后,将输出的全景声信号用作空间音频信号,与合适的视频数据流 (例如360°视频)组合并上传/流式传输到合适的VR服务。在一些实施例中,可以以足够的比特率用AAC对立体声信号进行编码,或者可以使用类似的编解码器。

分析和合成处理器也可以在相同设备内,并且也可以是相同软件的一部分。

可以将合适的输出形式传递给耳机,或者可以将其他回放设备配置为接收合成处理器207的输出并以适合于收听的格式输出音频信号。

关于图3,示出了图2所示设备的操作的示例概要。

初始操作是(直接从捕获设备或以其他方式)接收麦克风阵列音频信号,如图3中步骤301所示。

可以可选地处理所接收的麦克风阵列音频信号,以生成传输音频信号,如图3中步骤303所示。

同样,如图3中的步骤305所示,可以分析麦克风阵列音频信号以生成元数据(例如方向和/或能量比)。

如图3中步骤307所示,可以可选地组合传输音频信号和元数据以形成数据流(步骤307)。

如图3中步骤309所示,于是可以(可选地)发送和接收(或存储和检索)传输音频信号和元数据(或组合数据流)。

在已经接收或检索到传输音频信号和元数据(或数据流)之后,如图 3中步骤311所示,可以至少基于传输音频信号和元数据来合成输出音频信号。

然后可以将合成的音频信号输出信号输出到合适的输出。

关于图4,示出了诸如图2所示的示例分析处理器203。分析处理器 203的输入是麦克风阵列信号200。

分析处理器203可以包括时-频域变换器(T-F域变换器)401。前向滤波器组401被配置为将宽带(时域)信号变换为时-频信号。然后可以将滤波器组的输出分组到频带,并在滤波器组之后可以选择较低频带和较高频带的信号分量。较低频分析器407可以被配置为接收低于空间混叠频率 (或确定的频率)404的音频信号频带,并基于音频信号确定元数据。较低频率分析器407可以被配置为确定任何合适的空间元数据参数。空间混叠频率是这样的频率,对于许多传统方法而言,高于该频率音频波长对于阵列麦克风间距而言变得太小。高于空间混叠频率,许多传统方法(如线性波束成形)无法产生准确的结果。

可以使用任何合适的方法来确定在低于空间混叠频率的频率处的方向参数。例如,可以实现一种称为定向音频编码(DirAC)的方法,该方法对一阶全景声学(FOA)信号或其任何变体进行操作。

可以通过为麦克风阵列信号设计并应用适当的滤波器矩阵(或频带中的复增益矩阵)来产生FOA信号。这样的频带增益可以通过以下来产生:从(近似)均匀分布的点测量或模拟设备的脉冲响应,并使用最小二乘最优化方法来导出一组混合增益,以获得能够针对低于空间混叠频率的每个频带,获得来自频带麦克风阵列信号的频带FOA信号频率的矩阵。

FOA信号具有全向分量w(k,n)和三个正交偶极分量x(k,n)、y (k,n)和z(k,n),其中k是频率索引,n是时间索引。与DirAC中一样,可以根据以下表达式中显示为I的声场强度来确定方向:

其中Re表示实部,*表示复共轭。到达方向就是强度向量的相反方向。注意,强度向量可以在几个频率和/或时间索引(k,n)上取平均。

在一些实施例中,DirAC方法的实现被配置为还估计漫射,该漫射是 0和1之间的比率因子,其确定总声能中的多少是非定向的。换句话说,所接收的音频信号的非定向部分的能量相对于所接收的音频信号的总能量的比率。

在一些其他实施例中,低频分析器407可以被配置为将除DirAC之外的方法应用于立体声学信号。例如,可以使用谐波平面波扩展(Harpex) 及其变体从FOA信号中估计两个同时到达方向。低频分析仪可以采用的另一种示例方法是高阶DirAC(HO-DirAC)。HO-DirAC被配置为从第二或更高阶的全景声信号估计扇区中的多个到达方向。这样的全景声信号需要来自设备的更多麦克风,例如,对于3D的二阶全景声至少需要9个麦克风。

另一种方法可以是应用延迟搜索算法来确定在麦克风阵列音频信号之间产生最大相干性的延迟。

例如,对于处于风景模式的移动电话形式的捕获设备,可以在“左”和“右”麦克风音频信号之间确定延迟参数。可以将延迟归一化,以使最大延迟(从麦克风轴起的声音到达)为-1和1。于是可以将角度参数确定为 acos(d),其中d是估计和归一化的延迟参数。来自一对麦克风音频信号的延迟和角度参数是不明确的,换句话说,例如,如果声音发自30度(在正面)和150度(在背面),则可以观察到相同的延迟。这种歧义可以通过以下来克服:通过针对另一对前后麦克风执行延迟分析确定二元的前后音频信号的方向,以确定声音是来自正面还是来自背面。此方法可能会对诸如移动电话之类的捕获设备产生准确的结果,但对于诸如图1b所示的一般捕获设备形状可能不会产生准确的结果。这样的原因是,该方法应用二元的前后确定来说明设备的细轴,并使用类似移动电话的设备的两个较宽轴上的麦克风来估计剩余(大部分)空间信息。虽然该方法适用于移动电话和其他类似的轻薄设备,但对于图1b中的设备,仍有更多可用信息以利用设备的所有轴。因此,使用这样的装置不可避免地在一个轴上仅具有二元前后选择可能导致不能有效地利用在麦克风信号处可用的信息来进行方向估计。这可能会导致定向估计的性能欠佳,尤其是在要求更高的声学条件(例如存在背景噪声)中。另外,对一个轴仅进行前后确定(并确定来自其他轴的大多数方向信息)会将麦克风放置位置限制为彼此相互依赖的某些轴,这可能会使得更加难以优化麦克风放置,以考虑其他因素,例如优化低频处的线性FOA捕获。该方法和本文描述的方法适用于较低和较高频率二者。本文所述的方法更好地利用了由例如图1b所示设备的麦克风间特性所传达的信息,并提供了麦克风的灵活定位,以实现其他因素的优化,例如在低频处的线性FOA捕获。

较高频率分析器405被配置为在高于空间混叠频率的频带内接收音频信号。在一些实施例中,高频分析器还被配置为从低频/低频分析器接收附加信息。例如,可以存在以低频方向性分析结果为基础的高频方向性分析的空间加权。

在较高频率分析器405中,分析音频信号以确定空间元数据参数。由于在某些捕获设备(例如图1b中所示)中存在更规则的麦克风间距,因此该分析可用于产生准确的方向分析。术语“更规则”表示捕获设备的尺寸比其他捕获设备类型(例如,移动电话)更规则,移动电话可能具有长轴 (移动电话长度可能为10-20cm)、短轴(移动电话宽度可能为5-8厘米)和非常短的轴(移动电话厚度通常小于1厘米)。此外,该分析不太容易受到硬件集成和/或设计折中的麦克风放置的影响。任何实现可选移动电话类型算法的捕获设备都可能需要将麦克风定位或放置在彼此顶部或彼此相邻,如果期望最小化麦克风数量,这可能会导致麦克风位置分布不均匀(位于设备的一侧的麦克风比设备的另一侧多)。例如,实现移动电话类型算法的例如图1b中所示的捕获设备可能需要将麦克风111移动到右下角,以使其正好位于麦克风113下方并与麦克风115和117处于同一平面上。此定位示例将导致在设备的一侧具有更多的麦克风。

如本文所讨论的实施例允许麦克风被灵活地定位(例如,不需要将麦克风定位在彼此顶部)。因此,例如关于图1b所示的捕获设备,麦克风可以被相对均匀地放置在设备周围。此外,在这样的实施例中,更规则或更均匀的麦克风放置也可以改善低频分析性能。例如,与在相同侧放置更多的麦克风时相比,当麦克风被更均匀地放置在设备周围时,在低频处使用线性方法生成立体声输出信号会产生更准确的全景声输出信号。

在一些实施例中实现的较高频率分析器405采用方向分析方法,该方向分析方法利用适合于诸如图1b和1c所示的非平面(即,非移动电话状) 设备形状的修改的延迟分析方法。因此,这些实施例针对较少受约束的麦克风放置产生了更准确的方向分析,其中,能够从所有方向更均匀地捕获声音。

在这些实施例中,较高频率分析器604(图4中的405)被配置为分析高频率的音频信号。在一些实施例中,相同的方法也可以应用于较低频率的分析器中。

换句话说,在一些实施例中,高于空间混叠频率402的频带和低于空间混叠频率404的频带都由较高频率分析器405分析。

在这样的实施例中,提供了可以在所有频率(包括高于空间混叠频率) 和利用没有阴影、部分阴影和/或显著阴影的设备(在任何或所有轴上)使用的方向分析。

较高频率分析器405中的方向分析可以总结为:

选择麦克风阵列中的两个或两个以上麦克风对;

估计所选麦克风对之间的延迟信息;以及

通过将矩阵运算应用于延迟估计来确定到达方向向量,其中矩阵运算基于所选麦克风对的位置。

因此,可以从捕获自在x、y和z方向上具有位移的麦克风阵列的麦克风的音频信号采用方向分析。但是,这些放置不需要将麦克风沿着x、y 或z轴放置(例如,将一个麦克风放在另一个麦克风的顶部)。

另一种可能的分析器方法可以用于将要确定以表达阵列中的每个麦克风的向量,其中该向量的长度是在频带中该麦克风信号的估计能量(或量级)。于是可以将到达方向确定为这些向量之和的方向。然而,该方法要求在所有轴上均具有显著的声学阴影,这在此描述的实施例并非如此。

关于图5,示出了分析处理器203的操作。

初始操作是通过步骤501接收如图5所示的麦克风阵列音频信号。

如图5步骤503所示,在接收到麦克风音频信号后,它们被转换成时- 频域分量和所生成的频带(包括高于或低于空间混叠频率的频带),

此外,对较高频率的麦克风音频信号进行空间分析,以生成高于与空间混叠频率的音频信号关联的元数据,例如图5中步骤505所示的方向和能量比。

此外,对较低频麦克风音频信号进行空间分析,以生成与低于空间混叠频率的音频信号相关的元数据,例如图5中步骤507所示的方向和能量比。

关于图6,示出了较高频分析器的例子。较高频分析器405的输入是来自前向滤波器组的高于空间混叠频率的频带的音频信号。

在一些实施例中,较高频分析器405包括在图6中所示的延迟分析器,作为延迟分析器(麦克风对1)601、延迟分析器(麦克风对2)603和延迟分析器(麦克风对3)605。每个延迟分析器接收一对选定的麦克风音频信号,并确定频带中的延迟参数。在一些实施例中,至少有两个麦克风对用于水平环绕捕获,并且至少三个麦克风对用于3D捕获。

所选择的麦克风对被确定为跨越所需的尺寸,并且可以被确定为尽可能正交(例如:对于3D捕获,麦克风对可能不仅仅在同一平面上)。

在一些实施例中,一个以上延迟分析器被配置为接收相同的麦克风音频信号。换句话说,麦克风可以是多个麦克风对的一部分。

关于图8,示出了示例延迟分析器从图1b中所示的捕获设备中选择的麦克风对。第一对麦克风可以例如是麦克风111和113,它们定义对角地在设备101的“顶”表面上的第一位移801。第二对麦克风可以例如是麦克风113和115,它们定义对角地在设备的“前”表面上的第二位移803。第三对麦克风例如可以是麦克风115和117,它们定义对角地在设备的“底部”表面上的第三位移805。图8还示出了图1b中未示出的背面摄像机891和 893。

对于麦克风对,延迟分析器601、603、605被配置为估计两个麦克风音频信号之间的频带中的延迟。例如,可以通过找到使麦克风音频信号的互相关最大化的延迟参数来估计两个麦克风之间的频带延迟。

对于复值时-频信号A(k,n)和B(k,n),其中k是频率仓(bin) 索引(例如,短时傅立叶变换(STFT)仓索引),n是视-频信号的时间索引。空间分析(空间元数据的确定)可以发生在可能涉及时-频变换的一个或多个频率仓的频带中进行。频带通常被设计成近似与人类空间听力有关的频率分辨率,例如Bark频带。例如,一个频带b可能涉及从kb,bottom到 kb,top的频率仓。通过找到最大化以下的延迟来找到针对频带b的延迟d(b,n):

其中Re是实数部分运算符,*是复共轭,K是STFT中使用的FFT 大小。在一些实施例中,如果滤波器组不是STFT,则可以应用相似但不同的延迟分析公式。

可以通过确定利用介于-Dmax到Dmax之间的延迟ξ集合的相关性来找到提供最大相关性的延迟d(b,n),其中根据麦克风距离确定最大延迟值 Dmax。例如,Dmax可以恰好是与声音在麦克风对之间传播的时间(在样本中)相对应的延迟值。Dmax也可能比对应于声音在麦克风对之间传播的时间(在样本中)的延迟值长一些,因此解释延迟搜索边缘的一些测量噪声。可以用样本的精度来确定该延迟ξ集合,但是也可以使用分数样本延迟 (或任何其他精度)。

在一些实施例中,最大相关参数可以被归一化以提供比率参数,例如以下定义的:

方向向量公式化器607可以配置为接收延迟分析器601、603、605的输出,并基于麦克风对的估计延迟值602确定方向向量608。

在一些实施例中,方向向量公式化器607可以被配置为通过以下矩阵运算来公式化方向向量。

其中M是预先制定的矩阵,d的下标表示麦克风对。延迟值d的数量,即麦克风对的数量可以是两个或更多,并且相应地确定矩阵M的大小。例如,对于3D方向确定和五个延迟值d,矩阵M的大小为3×5。

估计的方向参数则是矢量s的方向。

在一些实施方案中,矩阵M可以通过以下方法来公式化。

首先,为每个麦克风对制定向量。例如,如果麦克风1位于位置(x1, y1,z1),麦克风2位于位置(x2,y2,z2),则它们之间的向量为

此外,方向向量公式化器可以被配置为确定矩阵V

方向向量公式化器可以配置为确定指示假定源的方向的向量(任何长度的任何向量),并将此3×1向量表示为s。于是,方向向量公式化器可以定义向量:

作为假设从向量s的方向到达的声音的结果,向量d包含对于麦克风对的相对延迟值。向量d的整体缩放比例可以是任何合适的缩放比例。此外,向量s或向量v的缩放比例可以是任何合适的缩放比例,只要向量v 具有相同的相互缩放比例。

在一些实施例中,例如实时示例,可以按照一定时-频间隔,为存储在向量d中的延迟值集合(以任何单位或缩放比例)获得。方向向量公式化器607可以估计对应于所估计的延迟d的方向向量s。换句话说,方向向量公式化器607确定矩阵M,对于矩阵M能够从d获得s:

s=Md=MVs

其中公式的结果为M=V-1=,表示包含与麦克风对(从一个麦克风到下一个麦克风)相对应的向量的矩阵的伪逆。在一些示例实施例中,应将理解,可以采用矩阵运算的任何适当的应用。

由于矩阵M是V的伪逆,因此V内的向量应足以表示所有的轴。例如,V中的向量应跨越用于3D捕获的合理的体积,或跨越2D捕获中的合理区域。考虑到3D的情况,向量基越“平坦”,就测量噪声对方向性估计的影响而言,向量V的矩阵逆越不稳定。具有这种平坦向量基的实际示例可能是移动电话,其中一维很小。相反,对于3D设备(或水平捕获的光盘类型设备),本方法在空间分析精度和所有轴处的稳定性方面都非常稳健。

在一些实施例中,可以确定不同的矩阵M,该矩阵M可以应用于从延迟值估计方向向量,其考虑了确定一个或多个延迟估计不可靠时的情况。例如,可以针对相干值来确定可靠性,其中,在相干值小于阈值的情况下,延迟估计不可靠。可以进一步关于相应麦克风对的能量相对于其他麦克风对的能量,来确定可靠性。在一些实施例中,这些不可靠的延迟值可以被省略或丢弃,并且另一个M矩阵被应用于剩余的延迟值。替换矩阵M可以是修改后的矩阵V的伪逆矩阵,该修改后的矩阵V与上述矩阵V相同,而没有对应于省略的麦克风对的行。

方向公式化器609于是可以被配置为接收方向向量608并输出元数据的方向参数206分量。到达方向是这个结果向量s在以下的方向。

在一些实施例中,在较高频率处的直接与总体比率参数208的估计可以通过选择具有最大位移的麦克风对来生成,并且如比率参数那样被设置为在诸如从延迟分析器601、603、605找到的麦克风信号之间的归一化(在0..1之间)的延迟补偿的相关604。

关于图7,示出了“较高”频率分析器的示例操作。

在图7中通过步骤701示出了对滤波器组输出音频信号的接收。

在图7中通过步骤702示出了选择合适的麦克风来分析音频信号。

在图7中通过步骤703示出了对麦克风对1音频信号之间的延迟的分析。

在图7中通过步骤705示出了对麦克风对2音频信号之间的延迟的分析。

在图7中通过步骤707示出了对麦克风对3音频信号之间的延迟的分析。

在图7中通过步骤709示出了通过将确定的麦克风矩阵应用于延迟来公式化方向向量。

基于方向向量的方向参数的确定在图7中由步骤711示出。

方向参数的输出在图7中由步骤713示出。

在图7中通过步骤721示出了对具有最大距离的麦克风对的选择。

在图7中由步骤723示出了延迟补偿的相关的归一化。接收到最大相关的延迟确定是步骤703、705、707和721以及具有最大距离的任何一个的乘积。这些步骤产生并搜索不同的延迟,并产生具有最大相关的延迟,该延迟可以由步骤723归一化。

在图7中通过步骤725示出了归一化的延迟补偿的相关值作为能量比参数的输出。

关于图9,示出了根据一些实施例的示例性合成处理器207(如图2 所示)。

在一些实施例中,解复用器可以被配置为接收数据流并将数据流解复用为传输音频信号202和元数据204,诸如比率或其他漫射性参数208和方向参数206。在一些实施例中,在分析处理器内对传输音频信号进行编码的情况下,解复用器还被致使对音频信号进行解码。在一些实施例中,如果元数据在分析处理器中被编码,则对元数据进行解码。

在其他实施例中,元数据和传输信号被分别接收或输入到合成处理器。

T-F域变换器901可以接收传输音频信号202,并将信号划分为时-频表示。在一些实施例中,使用合适的变换器将传输音频信号202变换到时- 频域。例如,短时傅立叶变换器(STFT)可以对传输音频信号应用短时傅立叶变换,以生成合适的时-频域音频信号。在一些实施例中,可以使用任何合适的时-频变换器,例如复调制正交镜像滤波器组(QMF)。

分频器903可接收T-F变换器901的输出,并基于比率元数据参数208 将信号分为直接部分和环境部分。因此,分频器903可以接收T-F域音频信号和能量比,并且使用能量比r(k,n)将时-频域音频信号划分为环境和直接部分。注意,这里能量比r(k,n)是针对每个频率仓索引k的而不是针对每个频带b的ratio(b,n)。如果ratio(b,n)作为输入被获得,则可以将其映射到该频带内的几个仓,从而获得比率r(k,n)。例如,在一些实施例中,可以通过将输入频带信号乘以因子sqrt(r(k,n))来获得直接部分。可以通过将输入频带信号乘以因子sqrt(1-r(k,n))来获得环境部分。

去相关器905可以被配置为接收环境音频信号部分,并且例如通过遍及音频场景地去相关和扩展环境音频信号部分,对其进行处理以使其被感知为是周围的。

空间处理器907可以被配置为接收直接音频信号部分和方向206,并基于这些方向来定位直接音频信号部分。例如,在一些实施例中,方向206 被用来使用基于向量的振幅平移(VBAP)来确定平移增益,并且通过将平移增益应用于直接部分信号来定位直接音频信号部分。在一些实施例中,增益在被应用于直接音频信号之前可以先被暂时平滑处理。

在输出是全景声信号的实施例中,VBAP处理可以被代替为根据方向参数球形谐波增益公式。在这样的实施例中,去相关的输出也可以利用确定的增益进行处理以适合所选全景声归一化方案。

在一些实施例中,输出音频信号是双耳信号。在那种情况下,VBAP 处理可以被代替为根据方向参数和频带频率的头部相关变换函数(HRTF) 处理。在这样的实施例中,可以处理去相关的信号以具有依赖于频率的双耳声道间相干性,而不是在所有频率下完全不相干。

组合器909可以被配置为接收来自去相关器905的在空间上扩展的环境信号部分,以及来自空间处理器907的所定位的直接音频信号部分,并且组合或合并这些结果音频信号。

可以是合适的短时傅立叶变换器(STFT逆变换器)的逆时域变换器被配置为接收组合的音频信号并应用逆变换以生成多声道音频信号208 (或双耳信号210或全景声信号212),该多声道音频信号208可以被传递给合适的输出设备,例如耳机或多声道扬声器设置。

关于图10,更详细地描述根据一些实施例的图9所示空间合成器的操作。

在一些实施例中,空间合成器被配置为接收传输音频信号和元数据(能量比/方向),如图10中的步骤1001所示。

在一些实施例中,如图10中的步骤1003所示,将接收到的传输音频信号转换成时-频域形式(例如,通过应用适当的时-频域变换)。

然后在一些实施例中,时-频域音频信号可以被划分为环境部分和直接部分(基于能量比),如图10中由步骤1005所示。

如图10中的步骤1007所示,可以将环境音频信号部分去相关。

可以对直接部分进行空间处理,例如确定平移增益并将其应用于直接音频信号部分,如图10中步骤1009所示。

于是,音频信号的位置分量和去相关的环境音频信号可以被组合或合并,如图10的步骤1011所示。

此外,如图10中的步骤1013所示,于是组合音频信号可以被逆时- 频域变换,以生成多声道音频信号/双耳音频信号/全景声音频信号。

这些多声道音频信号/双耳音频信号/全景声音频信号可以如图10所示通过步骤1015输出。

音频信号的合成可以是任何合适的合成,因为来自较低频分析器和较高频分析器的输出可以以类似的格式生成。

在一些实施例中,合成处理器可以被配置成根据协方差矩阵来处理空间声音。在这样的实施例中,输入信号具有协方差矩阵,而输出信号具有由空间元数据确定的另一个“目标”协方差矩阵。这样的方法被配置为制定在频带中的混合方案,当将该方案应用于输入信号时,该混合方案生成用于输出信号的目标协方差矩阵,从而生成预期的感知空间特性。

所提出的实施例的一些优点是,在高于空间混叠频率的频率处,可以将所提出的到达方向分析与在某些轴上没有表现出显著声学阴影的捕获设备(具有麦克风阵列)一起使用。所提出的实施例也可以用于使得能够在所有或一些轴上没有阴影、部分阴影或显著阴影的情况下,实现在所有频率处稳健的到达方向。

关于图11,示出了可以用作分析或合成处理器的示例电子设备。该设备可以是任何合适的电子设备或装置。例如,在一些实施例中,设备1400 是VR摄像机或其他摄像机设备、移动设备、用户设备、平板计算机、计算机、音频回放设备等。

在一些实施例中,设备1400包括至少一个处理器或中央处理单元1407。处理器1407可以被配置为执行各种程序代码,例如本文所述的方法。

在一些实施例中,设备1400包括存储器1411。在一些实施例中,至少一个处理器1407耦合到存储器1411。存储器1411可以是任何合适的存储装置。在一些实施例中,存储器1411包括用于存储可在处理器1407上实现的程序代码的程序代码部分。此外,在一些实施例中,存储器1411 可以进一步包括用于存储数据(例如根据本文所述的实施例已经处理或将要处理的数据)的存储数据部分。只要需要,就可以通过存储器-处理器耦合由处理器1407检索存储在程序代码部分内的已实现程序代码和存储在存储数据部分中的数据。

在一些实施例中,设备1400包括用户接口1405。在一些实施例中,用户接口1405可以耦合到处理器1407。在一些实施例中,处理器1407可以控制用户接口1405的操作并从用户接口1405接收输入。在一些实施例中,用户接口1405可以使用户能够例如经由键盘向设备1400输入命令。在一些实施例中,用户接口1405可以使用户能够从设备1400获得信息。例如,用户接口1405可以包括显示器,该显示器被配置为将来自设备1400 的信息显示给用户。在一些实施例中,用户接口1405可以包括触摸屏或触摸接口,该触摸屏或触摸接口能够使信息能够被输入到设备1400并且还向设备1400的用户显示信息。

在一些实施例中,设备1400包括输入/输出端口1409。在一些实施例中,输入/输出端口1409包括收发器。在这样的实施例中,收发器可以耦合到处理器1407并且被配置为使得能够例如经由无线通信网络实现与其他装置或电子设备进行通信。在一些实施例中,收发器或任何合适的收发器或发射器和/或接收器装置可以被配置为经由有线或有线耦合与其他电子设备或装置通信。

收发器可以通过任何合适的已知通信协议与其他的设备进行通信。例如,在一些实施例中,收发器可以使用合适的通用移动电信系统(UMTS) 协议、无线局域网(WLAN)协议,例如IEEE 802.X,合适的短程射频通信协议,例如蓝牙或红外数据通信路径(IRDA)。

收发器输入/输出端口1409可以被配置为接收信号,并且在一些实施例中,通过使用处理器1407执行合适的代码来确定如本文所述的参数。此外,该设备可以生成合适的传输信号和参数输出以传输到合成设备。

在一些实施方案中,装置1400可以用作合成装置的至少一部分。这样,输入/输出端口1409可以被配置为接收传输信号,以及在一些实施例中在如本文所述的捕获设备或处理设备处确定的参数,并通过使用执行适当代码的处理器1407生成适当的音频信号格式输出。输入/输出端口1409可以耦合到任何合适的音频输出,例如耦合到多声道扬声器系统和/或耳机或类似物。

通常,本发明的各种实施例可以以硬件或专用电路、软件、逻辑或其任何组合来实现。例如,一些方面可以以硬件来实现,而其他方面可以以可以由控制器、微处理器或其他计算设备执行的固件或软件来实现,但是本发明不限于此。尽管可以将本发明的各个方面作为框图、流程图或使用某些其他图形表示进行说明和描述,众所周知,本文所述的这些块、装置、系统、技术或方法可以作为非限制性示例在硬件、软件、固件、专用电路或逻辑、通用硬件或控制器或其他计算设备或其某种组合中实现。

如在本申请中使用的,术语“电路”可以指以下的一个或多个或全部:

(a)仅硬件的电路实现(例如仅在模拟和/或数字电路中的实现)和

(b)硬件电路和软件的组合,例如(如适用):

(i)模拟和/或数字硬件电路与软件/固件的组合,以及

(ii)具有软件(包括数字信号处理器)的硬件处理器的任何部分、软件和存储器,这些部分共同工作以使诸如移动电话或服务器之类的装置执行各种功能)和

(c)需要软件(例如,固件)以用于操作的硬件电路和/或处理器,例如微处理器或微处理器的一部分,但当不需要操作时,该软件可能不存在。

电路的定义适用于该术语在本申请中的所有使用,包括在任何权利要求中。作为另一个的示例,如本申请中所使用的,术语“电路”也仅涵盖仅仅硬件电路或处理器(或多个处理器)、或硬件电路或处理器及其(或它们的)随附软件和/或固件的一部分的实现。例如,如果适用于特定权利要求元素的话,术语“电路”还覆盖用于移动设备的基带集成电路或处理器集成电路或者在服务器、蜂窝网络设备或其他计算或网络设备中的类似集成电路。

本发明的实施例可以由移动设备的数据处理器可执行的计算机软件来实现,例如在处理器实体中,或者由硬件执行,或者由软件和硬件的组合执行。在这方面,应当注意,如图中的逻辑流程的任何块都可以表示程序步骤,或者互连的逻辑电路、块和功能,或者程序步骤和逻辑电路、块和功能的组合。该软件可以存储在诸如存储芯片或在处理器内实现的存储块之类的物理媒体,诸如硬盘或软盘之类的磁性介质,以及诸如DVD及其数据变体、CD之类的光学媒体上。

存储器可以是适合于本地技术环境的任何类型,并且可以使用任何适当的数据存储技术来实现,例如基于半导体的存储设备、磁存储设备和系统、光学存储设备和系统、固定存储器和可移动存储器。作为非限制性示例,数据处理器可以是适合本地技术环境的任何类型,并且可以包括通用计算机、专用计算机、微处理器、数字信号处理器(DSP)、专用集成电路 (ASIC)、门级电路和基于多核处理器架构的处理器的一个或多个。

本发明的实施例可以在诸如集成电路模块的各种组件中实践。集成电路的设计大体上是一个高度自动化的过程。复杂而功能强大的软件工具可用于将逻辑级设计转换成半导体在衬底上蚀刻和形成的半导体电路设计。

程序,例如由加利福尼亚州山景城的Synopsys公司和加利福尼亚州圣何塞的Cadence Design公司提供的程序,可以使用完善的设计规则以及预先存储的模块库自动对导体进行布线并在半导体芯片上定位组件。一旦完成了半导体电路的设计,就可以将标准化电子格式(例如Opus、GDSII 等)的结果设计传输到半导体制造设施或“工厂”进行制造。

前面的描述已经通过示例性和非限制性示例提供了对本发明示例性实施例的完整和信息性的描述。然而,当结合附图和所附权利要求书阅读时,鉴于前面的描述,各种修改和改编对于相关领域的技术人员而言将变得显而易见。但是,本发明的教导的所有这些和类似的修改仍将落入所附权利要求书所限定的本发明的范围内。

Claims (22)

1.一种用于空间音频信号处理的装置,该装置包括至少一个处理器和至少一个包括计算机程序代码的存储器,所述至少一个存储器和所述计算机程序代码被配置为与所述至少一个处理器一起致使所述装置至少:

从麦克风阵列接收音频信号,所述麦克风阵列包括三个或更多个麦克风,所述三个或更多个麦克风形成具有在所述三个或更多个麦克风中的至少两个麦克风对之间的定义的位移的几何形状;

通过使用所述至少两个麦克风对从所述音频信号中选择包括高于所定义频率的音频信号的第一部分,所述所定义频率与所述几何形状相关联;确定与包括高于所定义频率的音频信号的所述第一部分相关联的延迟信息;

基于具有在所述三个或更多个麦克风中的至少两个麦克风对之间的定义的位移的所述几何形状来确定运算符;

将所述运算符应用于所确定的延迟信息以生成至少一个方向参数。

2.如权利要求1所述的装置,进一步被致使:

识别所述三个或更多个麦克风中的麦克风对;

确定与所述三个或更多个麦克风中的所识别麦克风对相关联的音频信号的归一化相干值;以及

输出与所述三个或更多个麦克风中的所识别麦克风对相关联的音频信号的归一化相干值,作为与所述音频信号相关联的能量比参数。

3.如权利要求2所述的装置,其中,被致使识别所述三个或更多个麦克风中的所述麦克风对的装置被致使:识别具有最大位移的麦克风对。

4.如权利要求3所述的装置,其中,被致使确定与包括高于所定义频率的音频信号的第一部分相关联的延迟信息的装置被致使:从所述三个或更多个麦克风中的所有麦克风对的完整集合中选择所述三个或更多麦克风中的麦克风对,并且其中,被致使识别具有最大位移的麦克风对的装置被致使:从所选择的麦克风对中识别所述三个或更多麦克风的组中具有所述最大位移的麦克风对。

5.如权利要求1所述的装置,其中被致使确定与包括高于所定义频率的音频信号的第一部分相关联的延迟信息的装置被致使:确定在所述第一部分之间的延迟信息。

6.如权利要求1所述的装置,进一步被致使从所述音频信号中选择第二部分,所述第二部分包括低于与具有在所述三个或更多个麦克风中的对之间的定义的位移的几何形状相关联的所定义频率的音频信号,其中所述装置还被致使分析包括低于所述所定义频率的音频信号的第二部分,以确定另外的空间参数。

7.如权利要求1所述的装置,被致使基于具有在所述三个或更多个麦克风中的至少两个麦克风对之间的定义的位移的几何形状来确定运算符,被致使:

确定与所述三个或更多个麦克风中的至少两个麦克风对之间的位移相关联的位移向量;

基于所确定的位移向量来确定位移矩阵;以及

基于所确定的位移矩阵来生成矩阵运算符。

8.如权利要求7所述的装置,进一步被致使从所述位移矩阵的确定中识别并从中移除与具有不可靠的延迟信息的麦克风对相关联的位移向量。

9.如权利要求8所述的装置,进一步被致使基于以下中的至少一个来确定所述具有不可靠的延迟信息的麦克风对:

对于与所述麦克风对相关联的音频信号的相干值小于定义的阈值;以及

基于定义的阈值或比率,与所述麦克风对相关联的音频信号的能量小于与至少一个其他麦克风对相关联的音频信号的能量。

10.如权利要求1所述的装置,其中,所述麦克风阵列包括以下之一:

三个或更多个麦克风,并且与音频信号相关联的至少一个方向参数是单个维度方向参数;并且

四个或更多个麦克风,并且与音频信号相关联的至少一个方向参数是二维方向参数。

11.如权利要求10所述的装置,其中,所述单个维度方向参数的单个维度方向是方位角或仰角。

12.如权利要求10或11所述的装置,其中,所述二维方向参数的方向是方位角和仰角。

13.如权利要求1所述的装置,其中,被致使将所述运算符应用于所述所确定的延迟信息以生成所述至少一个方向参数的装置被致使:

通过对所述延迟信息应用所述运算符来确定方向向量;以及

从所述方向向量的方向生成所述至少一个方向参数。

14.如权利要求1所述的装置,进一步被致使:

基于所述音频信号产生至少一个传输信号;

发送和/或存储所述至少一个传输信号和所述至少一个方向参数。

15.如权利要求2所述的装置,进一步被致使:

基于所述音频信号生成至少一个传输信号;

发送和/或存储所述至少一个传输信号、所述至少一个方向参数;和

所述能量比参数。

16.如权利要求1所述的装置,其中,被致使确定与包括高于所定义频率的音频信号的所述第一部分相关联的延迟信息的装置被致使:确定在与所述三个或更多个麦克风中的所述至少两个麦克风对相关联的音频信号之间的延迟信息。

17.如权利要求1所述的装置,其中,被致使确定与包括高于所定义频率的音频信号的第一部分相关联的延迟信息的装置被致使:在逐个频带的基础上确定在音频信号之间的延迟信息,其中,被致使生成所述至少一个方向参数的装置被致使:在另外的逐个频带的基础上生成所述至少一个方向参数。

18.如权利要求17所述的装置,其中所述逐个频带的基础与所述另外的逐个频带的基础相同。

19.一种用于空间音频信号处理的方法,该方法包括:

从麦克风阵列接收音频信号,所述麦克风阵列包括三个或更多个麦克风,所述三个或更多个麦克风形成具有在所述三个或更多个麦克风中的至少两个麦克风对之间的定义的位移的几何形状;

通过使用所述至少两个麦克风对从所述音频信号中选择包括高于所定义频率的音频信号的第一部分,所述所定义频率与所述几何形状相关联;

确定与包括高于所定义频率的音频信号的所述第一部分相关联的音频信号之间的延迟信息;

基于具有在所述三个或更多个麦克风中的至少两个麦克风对之间的定义的位移的所述几何形状来确定运算符;

将所述运算符应用于所确定的延迟信息以生成至少一个方向参数。

20.如权利要求19所述的方法,进一步包括:

识别所述三个或更多个麦克风中的麦克风对;

确定与所述三个或更多个麦克风中的所识别麦克风对相关联的音频信号的归一化相干值;以及

输出与所述三个或更多个麦克风中的所识别麦克风对相关联的音频信号的归一化相干值,作为与所述音频信号相关联的能量比参数。

21.如权利要求20所述的方法,其中识别所述三个或更多个麦克风中的所述麦克风对包括:识别具有最大位移的麦克风对。

22.如权利要求21所述的方法,其中确定与包括高于所定义频率的音频信号的第一部分相关联的延迟信息包括:从所述三个或更多个麦克风中的所有麦克风对的完整集合中选择所述三个或更多麦克风中的麦克风对,并且其中,识别具有最大位移的麦克风对包括:从所选择的麦克风对中识别所述三个或更多麦克风的组中具有所述最大位移的麦克风对。

Applications Claiming Priority (3)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| GB1804938.7 | 2018-03-27 | ||

| GB1804938.7A GB2572368A (en) | 2018-03-27 | 2018-03-27 | Spatial audio capture |

| PCT/FI2019/050239 WO2019185988A1 (en) | 2018-03-27 | 2019-03-22 | Spatial audio capture |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| CN112189348A CN112189348A (zh) | 2021-01-05 |

| CN112189348B true CN112189348B (zh) | 2022-04-08 |

Family

ID=62068134

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| CN201980035093.2A Active CN112189348B (zh) | 2018-03-27 | 2019-03-22 | 空间音频捕获的装置和方法 |

Country Status (5)

| Country | Link |

|---|---|

| US (1) | US11350213B2 (zh) |

| EP (1) | EP3777235A4 (zh) |

| CN (1) | CN112189348B (zh) |

| GB (1) | GB2572368A (zh) |

| WO (1) | WO2019185988A1 (zh) |

Families Citing this family (5)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| GB2572368A (en) * | 2018-03-27 | 2019-10-02 | Nokia Technologies Oy | Spatial audio capture |

| US10735882B2 (en) * | 2018-05-31 | 2020-08-04 | At&T Intellectual Property I, L.P. | Method of audio-assisted field of view prediction for spherical video streaming |

| GB2592388A (en) | 2020-02-26 | 2021-09-01 | Nokia Technologies Oy | Audio rendering with spatial metadata interpolation |

| CN113674751A (zh) * | 2021-07-09 | 2021-11-19 | 北京字跳网络技术有限公司 | 音频处理方法、装置、电子设备和存储介质 |

| EP4164255A1 (en) | 2021-10-08 | 2023-04-12 | Nokia Technologies Oy | 6dof rendering of microphone-array captured audio for locations outside the microphone-arrays |

Citations (5)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US5778082A (en) * | 1996-06-14 | 1998-07-07 | Picturetel Corporation | Method and apparatus for localization of an acoustic source |

| CN101911724A (zh) * | 2008-03-18 | 2010-12-08 | 高通股份有限公司 | 使用多个装置上的多个麦克风进行语音增强 |

| CN101981944A (zh) * | 2008-04-07 | 2011-02-23 | 杜比实验室特许公司 | 麦克风阵列的环绕声产生 |

| CN105210389A (zh) * | 2013-03-19 | 2015-12-30 | 皇家飞利浦有限公司 | 用于确定麦克风的位置的方法和装置 |

| CN107533843A (zh) * | 2015-01-30 | 2018-01-02 | Dts公司 | 用于捕获、编码、分布和解码沉浸式音频的系统和方法 |

Family Cites Families (19)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US7039200B2 (en) | 2003-03-31 | 2006-05-02 | Microsoft Corporation | System and process for time delay estimation in the presence of correlated noise and reverberation |

| EP1524879B1 (en) * | 2003-06-30 | 2014-05-07 | Nuance Communications, Inc. | Handsfree system for use in a vehicle |

| EP2063419B1 (en) * | 2007-11-21 | 2012-04-18 | Nuance Communications, Inc. | Speaker localization |

| US9456289B2 (en) * | 2010-11-19 | 2016-09-27 | Nokia Technologies Oy | Converting multi-microphone captured signals to shifted signals useful for binaural signal processing and use thereof |

| KR20120059827A (ko) | 2010-12-01 | 2012-06-11 | 삼성전자주식회사 | 다중 음원 위치추적장치 및 그 위치추적방법 |

| EP2600637A1 (en) * | 2011-12-02 | 2013-06-05 | Fraunhofer-Gesellschaft zur Förderung der angewandten Forschung e.V. | Apparatus and method for microphone positioning based on a spatial power density |

| US9291697B2 (en) * | 2012-04-13 | 2016-03-22 | Qualcomm Incorporated | Systems, methods, and apparatus for spatially directive filtering |

| US9549253B2 (en) * | 2012-09-26 | 2017-01-17 | Foundation for Research and Technology—Hellas (FORTH) Institute of Computer Science (ICS) | Sound source localization and isolation apparatuses, methods and systems |

| EP2905975B1 (en) * | 2012-12-20 | 2017-08-30 | Harman Becker Automotive Systems GmbH | Sound capture system |

| CN105451151B (zh) | 2014-08-29 | 2018-09-21 | 华为技术有限公司 | 一种处理声音信号的方法及装置 |

| EP3230981B1 (en) * | 2014-12-12 | 2020-05-06 | Nuance Communications, Inc. | System and method for speech enhancement using a coherent to diffuse sound ratio |

| GB2540175A (en) * | 2015-07-08 | 2017-01-11 | Nokia Technologies Oy | Spatial audio processing apparatus |

| US9769563B2 (en) * | 2015-07-22 | 2017-09-19 | Harman International Industries, Incorporated | Audio enhancement via opportunistic use of microphones |

| US10368162B2 (en) * | 2015-10-30 | 2019-07-30 | Google Llc | Method and apparatus for recreating directional cues in beamformed audio |

| US20170188138A1 (en) * | 2015-12-26 | 2017-06-29 | Intel Corporation | Microphone beamforming using distance and enrinonmental information |

| US10045120B2 (en) * | 2016-06-20 | 2018-08-07 | Gopro, Inc. | Associating audio with three-dimensional objects in videos |

| GB2556093A (en) * | 2016-11-18 | 2018-05-23 | Nokia Technologies Oy | Analysis of spatial metadata from multi-microphones having asymmetric geometry in devices |

| US10802107B2 (en) * | 2017-01-23 | 2020-10-13 | United States Of America As Represented By The Administrator Of Nasa | Adaptive algorithm and software for recognition of ground-based, airborne, underground, and underwater low frequency events |

| GB2572368A (en) * | 2018-03-27 | 2019-10-02 | Nokia Technologies Oy | Spatial audio capture |

-

2018

- 2018-03-27 GB GB1804938.7A patent/GB2572368A/en not_active Withdrawn

-

2019

- 2019-03-22 EP EP19776343.6A patent/EP3777235A4/en active Pending

- 2019-03-22 US US16/981,767 patent/US11350213B2/en active Active

- 2019-03-22 CN CN201980035093.2A patent/CN112189348B/zh active Active

- 2019-03-22 WO PCT/FI2019/050239 patent/WO2019185988A1/en unknown

Patent Citations (5)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US5778082A (en) * | 1996-06-14 | 1998-07-07 | Picturetel Corporation | Method and apparatus for localization of an acoustic source |

| CN101911724A (zh) * | 2008-03-18 | 2010-12-08 | 高通股份有限公司 | 使用多个装置上的多个麦克风进行语音增强 |

| CN101981944A (zh) * | 2008-04-07 | 2011-02-23 | 杜比实验室特许公司 | 麦克风阵列的环绕声产生 |

| CN105210389A (zh) * | 2013-03-19 | 2015-12-30 | 皇家飞利浦有限公司 | 用于确定麦克风的位置的方法和装置 |

| CN107533843A (zh) * | 2015-01-30 | 2018-01-02 | Dts公司 | 用于捕获、编码、分布和解码沉浸式音频的系统和方法 |

Non-Patent Citations (2)

| Title |

|---|

| Active Microphone with Parabolic Reflection Board for Estimation of Sound Source Direction;T. Takiguchi, R. Takashima and Y. Ariki;《 2008 Hands-Free Speech Communication and Microphone Arrays》;20080606;第65-68页 * |

| 麦克风阵列二维方向估计聚焦算法研究;居太亮等;《电子科技大学学报》;20080529;第225-228页 * |

Also Published As

| Publication number | Publication date |

|---|---|

| GB2572368A (en) | 2019-10-02 |

| US11350213B2 (en) | 2022-05-31 |

| US20210099795A1 (en) | 2021-04-01 |

| EP3777235A4 (en) | 2022-01-12 |

| EP3777235A1 (en) | 2021-02-17 |

| CN112189348A (zh) | 2021-01-05 |

| WO2019185988A1 (en) | 2019-10-03 |

| GB201804938D0 (en) | 2018-05-09 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| US11950085B2 (en) | Concept for generating an enhanced sound field description or a modified sound field description using a multi-point sound field description | |

| CN111316354B (zh) | 目标空间音频参数和相关联的空间音频播放的确定 | |

| US20220174444A1 (en) | Spatial Audio Signal Format Generation From a Microphone Array Using Adaptive Capture | |

| CN112189348B (zh) | 空间音频捕获的装置和方法 | |

| KR102468780B1 (ko) | DirAC 기반 공간 오디오 코딩과 관련된 인코딩, 디코딩, 장면 처리, 및 다른 절차를 위한 장치, 방법, 및 컴퓨터 프로그램 | |

| US11153704B2 (en) | Concept for generating an enhanced sound-field description or a modified sound field description using a multi-layer description | |

| US20220417692A1 (en) | Spatial Audio Parameters and Associated Spatial Audio Playback | |

| US10313815B2 (en) | Apparatus and method for generating a plurality of parametric audio streams and apparatus and method for generating a plurality of loudspeaker signals | |

| CN112219411B (zh) | 空间声音渲染 | |

| JP2023515968A (ja) | 空間メタデータ補間によるオーディオレンダリング | |

| EP3542546A1 (en) | Analysis of spatial metadata from multi-microphones having asymmetric geometry in devices | |

| CN112513980A (zh) | 空间音频参数信令 | |

| CN116671132A (zh) | 利用空间元数据内插和源位置信息的音频渲染 | |

| CN112133316A (zh) | 空间音频表示和渲染 | |

| KR20240142538A (ko) | 공간 오디오의 렌더링을 가능하게 하기 위한 장치, 방법, 및 컴퓨터 프로그램 |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| PB01 | Publication | ||

| PB01 | Publication | ||

| SE01 | Entry into force of request for substantive examination | ||

| SE01 | Entry into force of request for substantive examination | ||

| GR01 | Patent grant | ||

| GR01 | Patent grant |