CN106295703B - 一种对时间序列进行建模并识别的方法 - Google Patents

一种对时间序列进行建模并识别的方法 Download PDFInfo

- Publication number

- CN106295703B CN106295703B CN201610671152.3A CN201610671152A CN106295703B CN 106295703 B CN106295703 B CN 106295703B CN 201610671152 A CN201610671152 A CN 201610671152A CN 106295703 B CN106295703 B CN 106295703B

- Authority

- CN

- China

- Prior art keywords

- matrix

- dictionary

- time

- training

- time sequence

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

Classifications

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F18/00—Pattern recognition

- G06F18/20—Analysing

- G06F18/21—Design or setup of recognition systems or techniques; Extraction of features in feature space; Blind source separation

- G06F18/214—Generating training patterns; Bootstrap methods, e.g. bagging or boosting

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F18/00—Pattern recognition

- G06F18/20—Analysing

- G06F18/24—Classification techniques

- G06F18/241—Classification techniques relating to the classification model, e.g. parametric or non-parametric approaches

- G06F18/2411—Classification techniques relating to the classification model, e.g. parametric or non-parametric approaches based on the proximity to a decision surface, e.g. support vector machines

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V10/00—Arrangements for image or video recognition or understanding

- G06V10/40—Extraction of image or video features

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V10/00—Arrangements for image or video recognition or understanding

- G06V10/40—Extraction of image or video features

- G06V10/513—Sparse representations

Landscapes

- Engineering & Computer Science (AREA)

- Theoretical Computer Science (AREA)

- Data Mining & Analysis (AREA)

- Physics & Mathematics (AREA)

- General Physics & Mathematics (AREA)

- Bioinformatics & Cheminformatics (AREA)

- Computer Vision & Pattern Recognition (AREA)

- Evolutionary Biology (AREA)

- Evolutionary Computation (AREA)

- Bioinformatics & Computational Biology (AREA)

- General Engineering & Computer Science (AREA)

- Artificial Intelligence (AREA)

- Life Sciences & Earth Sciences (AREA)

- Multimedia (AREA)

- Character Discrimination (AREA)

- Image Analysis (AREA)

Abstract

本发明涉及一种对时间序列进行建模并识别的方法,属于机器学习领域。该方法包括将传感器采集的数据按采集时间先后顺序排列而成的动态数据构成L条时间序列,随机选择L条时间序列中的60%‑80%的N条时间序列作为训练集,剩下的时间序列作为测试集;对训练集中的每一条时间序列采用线性动态系统模型进行建模,并训练集每一条时间序列的特征表示;随机从训练集中抽取J条时间序列作为字典组成字典集,从得到的训练集每一条训练时间序列的特征表示,学习出字典集的每一条时间序列的最优特征表示,同时计算每一条训练时间序列在字典集下的编码系数;用训练集的编码系数训练支持向量机模型,实现对时间序列的识别。本方法大幅降低了数据表示的复杂度,同时显著提高识别精度。

Description

技术领域

本发明涉及一种对时间序列进行建模并识别的方法,属于机器学习领域。

背景技术

近年来,随着摄像机和力传感器等不同传感器感知技术的发展,数据产生和采集的速度越来越快,数据存储量也越来越大,且大部分数据是以时间序列的形态进行传输和存储。所谓时间序列,是指传感器采集的数据按采集时间先后顺序排列而成的动态数据。面对海量的时间序列数据,单纯的人力已经不能有效对其进行分析并提取有用的特征信息。因此,如何设计高效的数据分析算法,对不同传感器采集到的时间序列进行有机提炼,得到富含信息量的有效表征,以及利用有效表征实现目标识别任务,成为大数据环境下开展动态数据挖掘的关键问题。

一方面,传统的目标识别任务大多数是基于静态数据,如通过分析单张图片识别或者检测图片中的目标、基于单个时间节点的触觉力分布来识别机器人所抓取的物体。然而,通常情况下,传感器采集到的是具有特定时间长度的数据流。这需要通过分析一段视频(而不是单张图片)来识别视觉目标、通过分析整个抓取过程的触觉力的变化过程(而不是单个时间节点的力)来识别机器人的抓取目标。另一方面,针对动态数据,当前主流的方法是把输入数据截取(或采样)为时间维度等长的数据块,把这些数据块按时空展开作为高维的静态数据,然后采用传统基于静态数据的方法进行建模和识别。然而,该类方法存在两个主要的问题。首先,不同的识别目标对应于不同的物理过程,其动态数据的自然时间长度通常是不相等的,把所有数据进行等长处理会导致某些数据失真;其次,如果截取的时间长度过短,会丢失大量有用的信息,如果截取的时间长度过长,则导致数据块的维度过大,大幅降低后期识别算法的运行效率。因此,时间序列的识别亟需一种有效的建模工具来提取其有用且精炼的信息,提高识别精度并保证较快的运行效率。

以下为几个相关技术。

线性动态系统模型是对时间序列的每一帧数据以及相邻两帧数据的转化关系进行建模,如公式(1)所示:

其中,已知变量为:时间序列Y=(y(0),y(1),…,y(t),…,y(τ))(τ为正整数,表示时间序列的时间长度);未知变量是:序列状态X=(x(0),x(1),…,x(t),…,x(τ)),测量矩阵C,转移矩阵A,模型的噪声项v(t)和w(t)。

求解式(1)表示的线性动态系统模型分别得到序列状态X、测量矩阵C和转移矩阵A。测量矩阵描述了空间纹理,转移矩阵描述了动态变化。

在机器学习领域中,实现目标识别需把数据分成两部分:训练集和测试集。训练集利用时间序列及其相应的类别标签训练识别模型;测试集用来测试识别模型的性能。常用的识别模型为线性支持向量机,已被广泛应用于图像、语音和文字等静态数据的目标识别任务。

发明内容

本发明的目的是为克服已有技术的不足之处,提出了一种对时间序列进行建模并识别的方法,该方法利用线性动态系统模型对时间序列进行建模得到数据的特征表示,继而引入稀疏编码和字典学习技术对所得的特征进一步编码,快速有效地实现基于时间序列的目标识别。

本发明提出的一种对时间序列进行建模并识别的方法,其特征在于,该方法包括以下步骤:

1)将传感器采集的数据按采集时间先后顺序排列而成的动态数据构成L条时间序列,随机选择L条时间序列中的60%-80%的N条时间序列作为训练集,剩下的时间序列作为测试集;

2)对训练集中的每一条时间序列采用线性动态系统模型进行建模:

其中,已知变量为:时间序列Y=(y(0),y(1),…,y(t),…,y(τ))(τ为正整数,表示时间序列的时间长度);未知变量是:序列状态X=(x(0),x(1),…,x(t),…,x(τ)),描述空间纹理的测量矩阵C,描述动态变化的转移矩阵A,模型的噪声项v(t)和w(t);根据已知变量Y求解未知变量X,C,A,得到训练集每一条时间序列的特征表示;

3)随机从训练集中抽取J条时间序列作为字典组成字典集,由步骤2)得到的训练集每一条训练时间序列的特征表示,学习出字典集的每一条时间序列的最优特征表示,同时计算得到每一条训练时间序列在字典集下的编码系数;

4)用步骤3)得到的训练集的编码系数α1,α2,…,αN训练支持向量机模型,实现对时间序列的识别。

本发明的特点及有益效果:

本发明通过对时间序列建模,并利用模型的参数作为时间序列的初始特征表示,与传统基于截取时空数据块的方法相比,大幅降低了数据表示的复杂度。同时,通过稀疏编码和字典学习对初始特征表示进一步提炼,得到更加精炼的表征,显著提高识别精度。

具体实施方式

本发明提出了一种对时间序列进行建模并识别的方法,包括以下步骤:

1)将传感器采集的数据按采集时间先后顺序排列而成的动态数据构成L条(例如200条)时间序列,随机选择60%-80%的时间序列(设为N条)作为训练集,剩下的时间序列作为测试集(其中,训练集占全体时间序列的百分比越高,识别精度越高,可根据具体操作精度要求选定);

2)对训练集中的每一条时间序列采用线性动态系统模型进行建模:

其中,已知变量为:时间序列Y=(y(0),y(1),…,y(t),…,y(τ)(τ为正整数,表示时间序列的时间长度);未知变量是:序列状态X=(x(0),x(1),…,x(t),…,x(τ)),测量矩阵C(描述空间纹理),转移矩阵A(描述动态变化),模型的噪声项v(t)和w(t);根据已知变量Y求解未知变量X,C,A,(根据Y,X,C,A,可求得模型的噪声项v(t)和w(t),本发明方法不涉及该两项,不再做具体阐述)得到训练集每一条时间序列的特征表示;具体包括:

2-1)对时间序列Y进行矩阵分解,求解Y=USVT,即对Y进行奇异值分解,U为左奇异方向矩阵,S为奇异值矩阵,V为右奇异方向矩阵,奇异值分解可通过MATLAB软件内嵌的数值工具包求解,得到测量矩阵C=U和序列状态X=SVT,其中VT表示对矩阵V进行转置;

2-2)设临时矩阵变量X0和X1,令X0=(x(0),…,x(t),…,x(τ-1)),X1=(x(1),…,x(t),…,x(τ));

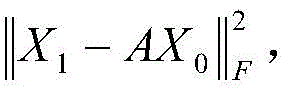

2-3)计算出最优转移矩阵A,使得公式(1)尽可能拟合时间序列在时间维度上的变化规律,即通过最小化得到最优转移矩阵A=X1X0 T(X0X0 T)-1,其中||·||F 2计算输入矩阵的Frobenius范数,即计算矩阵所有元素的平方和;

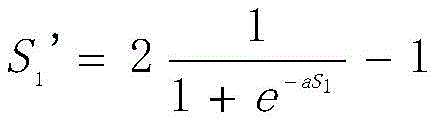

2-4)对步骤2-3)得到的最优转移矩阵A进行平滑化处理(避免计算中出现数值不稳定的问题),即对矩阵A进行奇异值分解,A=U1S1V1 T(对A奇异值分解,定义同2-1),用(其中为自然指数函数,a为规整因子,经验取值2.5)替换矩阵S1,得到新的转移矩阵A=U1S1'V1 T;

2-5)分别利用步骤2-1)和2-4)求解得到的测量矩阵C和最优转移矩阵A,得到观测矩阵O=[C;CA;CA2;…;CAk],(其中,k为正整数,k=1,2,……k;k根据经验取值,本实施例取值为5);

2-7)令R=WWT作为时间序列Y的特征表示,由W计算出WWT;由此可计算出训练集每一条时间序列的特征表示,记为R1,R2,…,RN;

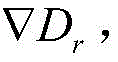

3)随机从训练集中抽取J条时间序列作为字典组成字典集,由步骤2)得到的训练集每一条训练时间序列的特征表示,学习出字典集的每一条时间序列的最优特征表示,同时计算得到每一条训练时间序列在字典集下的编码系数;具体包括:

3-1)已知变量:记训练集中第i条时间序列的特征表示为Ri,需要求解变量:字典集的每条时间序列的观测矩阵为W1,W2,…,WJ(J为字典集时间序列的条数,按经验可为训练集时间序列条数的一半,观测矩阵定义见2-6));字典集中每条时间序列的特征表示为D1,D2,…,DJ;训练集每条时间序列在字典集下的编码系数为αi=(α1,i,α2,i,…,αJ,i)(i为遍历训练集所有时间序列中任意一时间序列),其中,αj,i表示该训练时间序列在字典集的第j条时间序列下的编码系数;

3-2)字典特征表示的初始化:随机从训练集中抽取J条时间序列作为字典组成字典集,即将所随机选取的训练时间序列的观测矩阵和特征表示作为字典时间序列的观测矩阵和特征表示的初始值;

3-3)对3-2)所得的字典特征表示的初始值进行迭代优化,优化目标表达式如式(2)(目的是最小化字典集和编码系数对训练集的重构误差并保证编码系数的稀疏性),同时计算每一条训练时间序列在字典集下的编码系数;

3-3-1)利用步骤3-2)字典集的特征表示的初始值,对训练集的每一条时间序列进行稀疏编码,即求解式(3)的目标函数表达式,得到训练集每一条时间序列在该字典集的编码系数αi;

其中,i∈N遍历训练集的所有时间序列,公式(3)通过MATLAB软件内嵌的数值工具包求解;

Wr=M (6)

其中,I为单位矩阵;

3-3-4)由步骤3-3-3)所得Wr,更新每个字典的特征表示Dr=WrWr T;

3-3-5)重复步骤3-3-1)至3-3-4)直到公式(2)中目标函数值的变化小于设定的阈值(阈值越小精度越高,但是需要的迭代次数就越多,按经验可取0.01),得到了字典集的最优特征表示D1,D2,…,DJ,以及每一条训练时间序列在最优字典集下的编码系数α1,α2,…,αN;

4)用步骤3)得到的训练集的编码系数α1,α2,…,αN,训练支持向量机模型,实现对时间序列的识别;本实施所有时间序列的类别有两类:正样本和负样本;正样本即感兴趣的目标物,如人脸、行人等,负样本是除目标物外的类别,如背景等;该步骤具体包括:

4-1)设支持向量机的模型参数为w,b,则该模型参数通过以下式(7)表示的目标函数求得:

其中,li∈(-1,1)表示第i个训练时间序列的类别(-1代表负样本,1代表正样本),αi是第i个训练时间序列的编码系数,公式(7)的参数w,b可通过MATLAB软件内嵌的数值工具包求解;

4-2)对于测试集的每一条时间序列Rtest,通过3-3-1)的方法求解出其在最优特征表示的字典集下的编码系数,设为αtest;

4-3)计算wTαtest-b的值,若大于0则为正样本,若小于零则为负样本。从而实现了测试时间序列的类别判断,完成了时间序列的识别。

Claims (3)

1.一种对时间序列进行建模并识别的方法,其特征在于,该方法包括以下步骤:

1)将传感器采集的目标识别数据按采集时间先后顺序排列而成的动态数据构成L条时间序列,随机选择L条时间序列中的60%-80%的N条时间序列作为训练集,剩下的时间序列作为测试集;

2)对训练集中的每一条时间序列采用线性动态系统模型进行建模:

其中,已知变量为:时间序列Y=(y(0),y(1),…,y(t),…,y(τ)),τ为正整数,表示时间序列的时间长度;未知变量是:序列状态X=(x(0),x(1),…,x(t),…,x(τ)),描述空间纹理的测量矩阵C,描述动态变化的转移矩阵A,模型的噪声项v(t)和w(t);根据已知变量Y求解未知变量X,C,A,得到训练集每一条时间序列的特征表示;

3)随机从训练集中抽取J条时间序列作为字典组成字典集,由步骤2)得到的训练集每一条训练时间序列的特征表示,学习出字典集的每一条时间序列的最优特征表示,同时计算得到每一条训练时间序列在字典集下的编码系数;

4)用步骤3)得到的训练集的编码系数α1,α2,…,αN训练支持向量机模型,实现对时间序列的识别,所述时间序列的类别有两类:正样本和负样本;正样本即感兴趣的目标物,具体是人脸、行人;负样本是除目标物外的类别,具体是背景;

所述步骤3)具体包括:

3-1)已知变量:记训练集中第i条时间序列的特征表示为Ri;需要求解变量:字典集的每条时间序列的观测矩阵为W1,W2,…,WJ,J为字典集时间序列的条数;字典集中每一条时间序列的特征表示为D1,D2,…,DJ;每条训练时间序列在字典集下的编码系数为αi=(α1,i,α2,i,…,αJ,i),i为遍历训练集任意一时间序列,其中,αj,i表示该训练时间序列在字典集的第j条时间序列下的编码系数;

3-2)字典特征表示的初始化:随机从训练集中抽取J条时间序列作为字典组成字典集,即将所随机选取的训练时间序列的观测矩阵和特征表示作为字典时间序列的观测矩阵和特征表示的初始值;

3-3)对步骤3-2)所得的字典特征表示的初始值进行迭代优化,同时计算每一条训练时间序列在字典集下的编码系数,优化目标表达式如式(2)以最小化字典集和编码系数对训练集的重构误差并保证编码系数的稀疏性:

所述步骤3)中公式(2)求解具体过程如下:

3-3-1)利用步骤3-2)字典集的特征表示的初始值,对训练集的每一条时间序列进行稀疏编码,即求解式(3)的目标函数表达式,得到训练集每一条时间序列在该字典集的编码系数:

i∈N遍历训练集的所有时间序列,公式(3)通过MATLAB软件内嵌的数值工具包求解;

Wr=M (6)

其中,I为单位矩阵;

3-3-4)由步骤3-3-3)所得Wr,更新每个字典的特征表示Dr=WrWr T;

3-3-5)重复步骤3-3-1)至3-3-4)直到公式(2)中目标函数值的变化小于设定的阈值,得到字典集的最优特征表示D1,D2,…,DJ,以及每一条训练时间序列在最优字典集下的编码系数α1,α2,…,αN。

2.如权利要求1所述方法,其特征在于,所述步骤2)计算训练集所有时间序列的特征表示R1,R2,…,RN,其中每一个特征表示的具体计算过程包括:

2-1)对时间序列Y进行矩阵分解,求解Y=USVT,即对Y进行奇异值分解,U为左奇异方向矩阵,S为奇异值矩阵,V为右奇异方向矩阵,奇异值分解可通过MATLAB软件内嵌的数值工具包求解,得到测量矩阵C=U和序列状态X=SVT,其中VT表示对矩阵V进行转置;

2-2)设临时矩阵变量X0和X1,令X0=(x(0),…,x(t),…,x(τ-1)),X1=(x(1),…,x(t),…,x(τ));

2-3)计算出最优转移矩阵A,使得公式(1)尽可能拟合时间序列在时间维度上的变化规律,通过最小化得到最优转移矩阵A=X1X0 T(X0X0 T)-1,其中||·||F 2计算输入矩阵的Frobenius范数,即计算矩阵所有元素的平方和;

2-5)分别利用步骤2-1)和2-4)求解得到的测量矩阵C和最优转移矩阵A,得到观测矩阵O=[C;CA;CA2;…;CAk],其中,k为正整数,k=1,2,…,k;

2-6)对步骤2-5)得到的观测矩阵正交化,求解OTO=U2S2V2 T,得到新的观测矩阵W=OS2 -1/2U2,使得观测矩阵正交化,数值计算更稳定;

2-7)计算R=WWT作为时间序列Y的特征表示。

Priority Applications (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| CN201610671152.3A CN106295703B (zh) | 2016-08-15 | 2016-08-15 | 一种对时间序列进行建模并识别的方法 |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| CN201610671152.3A CN106295703B (zh) | 2016-08-15 | 2016-08-15 | 一种对时间序列进行建模并识别的方法 |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| CN106295703A CN106295703A (zh) | 2017-01-04 |

| CN106295703B true CN106295703B (zh) | 2022-03-25 |

Family

ID=57671889

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| CN201610671152.3A Active CN106295703B (zh) | 2016-08-15 | 2016-08-15 | 一种对时间序列进行建模并识别的方法 |

Country Status (1)

| Country | Link |

|---|---|

| CN (1) | CN106295703B (zh) |

Families Citing this family (3)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| CN109144648B (zh) * | 2018-08-21 | 2020-06-23 | 第四范式(北京)技术有限公司 | 统一地执行特征抽取的方法及系统 |

| CN112699601B (zh) * | 2020-12-28 | 2022-05-31 | 电子科技大学 | 一种传感器网络数据的空时重构方法 |

| CN115661742B (zh) * | 2022-10-13 | 2025-11-21 | 南昌大学 | 基于贪婪深度字典学习的机器人多模态物体识别方法 |

Citations (2)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| CN103440513A (zh) * | 2013-09-17 | 2013-12-11 | 西安电子科技大学 | 基于稀疏非负张量分解的大脑特定视觉认知状态判定方法 |

| CN105005787A (zh) * | 2015-06-24 | 2015-10-28 | 清华大学 | 一种基于灵巧手触觉信息的联合稀疏编码的材质分类方法 |

Family Cites Families (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US9870519B2 (en) * | 2014-07-08 | 2018-01-16 | Nec Corporation | Hierarchical sparse dictionary learning (HiSDL) for heterogeneous high-dimensional time series |

-

2016

- 2016-08-15 CN CN201610671152.3A patent/CN106295703B/zh active Active

Patent Citations (2)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| CN103440513A (zh) * | 2013-09-17 | 2013-12-11 | 西安电子科技大学 | 基于稀疏非负张量分解的大脑特定视觉认知状态判定方法 |

| CN105005787A (zh) * | 2015-06-24 | 2015-10-28 | 清华大学 | 一种基于灵巧手触觉信息的联合稀疏编码的材质分类方法 |

Non-Patent Citations (2)

| Title |

|---|

| Kernel sparse representation for time series classification;Zhihua Chen 等;《Information Science》;20140908;第15-26页 * |

| 视频序列中人体行为的低秩表达与识别方法研究;黄仕建;《中国优秀博硕士学位论文全文数据库(博士)信息科技辑》;20160715;第I138-35页 * |

Also Published As

| Publication number | Publication date |

|---|---|

| CN106295703A (zh) | 2017-01-04 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| CN109190752B (zh) | 基于深度学习的全局特征和局部特征的图像语义分割方法 | |

| CN104408478B (zh) | 一种基于分层稀疏判别特征学习的高光谱图像分类方法 | |

| CN108596203B (zh) | 并联池化层对受电弓碳滑板表面磨耗检测模型的优化方法 | |

| CN113887342A (zh) | 基于多源信号和深度学习的设备故障诊断方法 | |

| CN110309867A (zh) | 一种基于卷积神经网络的混合气体识别方法 | |

| CN109376753B (zh) | 一种三维空谱空间维像元类属概率计算方法 | |

| CN110148104A (zh) | 基于显著性分析与低秩表示的红外与可见光图像融合方法 | |

| CN113627522B (zh) | 基于关系网络的图像分类方法、装置、设备及存储介质 | |

| CN105608690A (zh) | 一种基于图论和半监督学习相结合的图像分割方法 | |

| CN103544499A (zh) | 一种基于机器视觉的表面瑕疵检测的纹理特征降维方法 | |

| CN113435321A (zh) | 一种主轴轴承状态评估方法、系统、设备及可读存储介质 | |

| CN108460400B (zh) | 一种结合多种特征信息的高光谱图像分类方法 | |

| CN117390407A (zh) | 变电站设备的故障识别方法、系统、介质和设备 | |

| CN116468895B (zh) | 一种相似度矩阵引导的少样本语义分割方法及系统 | |

| CN108898269A (zh) | 基于度量的电力图像环境影响评估方法 | |

| CN105930873A (zh) | 一种基于子空间的自步跨模态匹配方法 | |

| CN115937693B (zh) | 一种基于遥感图像的道路识别方法及系统 | |

| Wu et al. | Image edge detection based on local dimension: A complex networks approach | |

| CN109543546B (zh) | 基于深度序分布回归的步态年龄估计方法 | |

| CN106295703B (zh) | 一种对时间序列进行建模并识别的方法 | |

| CN108921170B (zh) | 一种有效的图像噪声检测和去噪方法及系统 | |

| CN117392450A (zh) | 一种基于进化多尺度特征学习的钢铁材料质量解析方法 | |

| CN105550712A (zh) | 基于优化卷积自动编码网络的极光图像分类方法 | |

| CN116975645A (zh) | 一种基于vae-mrcnn的工业过程软测量建模方法 | |

| CN116883393A (zh) | 一种基于无锚框目标检测算法的金属表面缺陷检测方法 |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| C06 | Publication | ||

| PB01 | Publication | ||

| C10 | Entry into substantive examination | ||

| SE01 | Entry into force of request for substantive examination | ||

| GR01 | Patent grant | ||

| GR01 | Patent grant |