CN103608813A - 通过对象位置进行视频导航 - Google Patents

通过对象位置进行视频导航 Download PDFInfo

- Publication number

- CN103608813A CN103608813A CN201280029819.XA CN201280029819A CN103608813A CN 103608813 A CN103608813 A CN 103608813A CN 201280029819 A CN201280029819 A CN 201280029819A CN 103608813 A CN103608813 A CN 103608813A

- Authority

- CN

- China

- Prior art keywords

- image

- navigation

- image sequence

- place

- input

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Pending

Links

- 238000000034 method Methods 0.000 claims abstract description 46

- 238000001514 detection method Methods 0.000 claims description 6

- 230000011218 segmentation Effects 0.000 claims description 5

- 238000010191 image analysis Methods 0.000 claims description 2

- 230000008901 benefit Effects 0.000 description 4

- 238000004458 analytical method Methods 0.000 description 3

- 230000001815 facial effect Effects 0.000 description 3

- 238000010586 diagram Methods 0.000 description 2

- 239000012634 fragment Substances 0.000 description 2

- 238000010801 machine learning Methods 0.000 description 2

- 238000012706 support-vector machine Methods 0.000 description 2

- 241000405217 Viola <butterfly> Species 0.000 description 1

- 238000013459 approach Methods 0.000 description 1

- 230000008859 change Effects 0.000 description 1

- 238000006243 chemical reaction Methods 0.000 description 1

- 230000002860 competitive effect Effects 0.000 description 1

- 230000002708 enhancing effect Effects 0.000 description 1

- 230000006870 function Effects 0.000 description 1

- 230000003993 interaction Effects 0.000 description 1

- 230000002452 interceptive effect Effects 0.000 description 1

- 230000009191 jumping Effects 0.000 description 1

- 230000007246 mechanism Effects 0.000 description 1

- 238000010422 painting Methods 0.000 description 1

- 230000008569 process Effects 0.000 description 1

- 230000035807 sensation Effects 0.000 description 1

Images

Classifications

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

- G06F3/048—Interaction techniques based on graphical user interfaces [GUI]

- G06F3/0484—Interaction techniques based on graphical user interfaces [GUI] for the control of specific functions or operations, e.g. selecting or manipulating an object, an image or a displayed text element, setting a parameter value or selecting a range

- G06F3/04842—Selection of displayed objects or displayed text elements

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F16/00—Information retrieval; Database structures therefor; File system structures therefor

- G06F16/70—Information retrieval; Database structures therefor; File system structures therefor of video data

- G06F16/73—Querying

- G06F16/732—Query formulation

- G06F16/7335—Graphical querying, e.g. query-by-region, query-by-sketch, query-by-trajectory, GUIs for designating a person/face/object as a query predicate

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F16/00—Information retrieval; Database structures therefor; File system structures therefor

- G06F16/70—Information retrieval; Database structures therefor; File system structures therefor of video data

- G06F16/74—Browsing; Visualisation therefor

- G06F16/745—Browsing; Visualisation therefor the internal structure of a single video sequence

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F16/00—Information retrieval; Database structures therefor; File system structures therefor

- G06F16/70—Information retrieval; Database structures therefor; File system structures therefor of video data

- G06F16/78—Retrieval characterised by using metadata, e.g. metadata not derived from the content or metadata generated manually

- G06F16/783—Retrieval characterised by using metadata, e.g. metadata not derived from the content or metadata generated manually using metadata automatically derived from the content

- G06F16/7837—Retrieval characterised by using metadata, e.g. metadata not derived from the content or metadata generated manually using metadata automatically derived from the content using objects detected or recognised in the video content

-

- G—PHYSICS

- G11—INFORMATION STORAGE

- G11B—INFORMATION STORAGE BASED ON RELATIVE MOVEMENT BETWEEN RECORD CARRIER AND TRANSDUCER

- G11B27/00—Editing; Indexing; Addressing; Timing or synchronising; Monitoring; Measuring tape travel

- G11B27/10—Indexing; Addressing; Timing or synchronising; Measuring tape travel

- G11B27/102—Programmed access in sequence to addressed parts of tracks of operating record carriers

- G11B27/105—Programmed access in sequence to addressed parts of tracks of operating record carriers of operating discs

-

- G—PHYSICS

- G11—INFORMATION STORAGE

- G11B—INFORMATION STORAGE BASED ON RELATIVE MOVEMENT BETWEEN RECORD CARRIER AND TRANSDUCER

- G11B27/00—Editing; Indexing; Addressing; Timing or synchronising; Monitoring; Measuring tape travel

- G11B27/10—Indexing; Addressing; Timing or synchronising; Measuring tape travel

- G11B27/19—Indexing; Addressing; Timing or synchronising; Measuring tape travel by using information detectable on the record carrier

- G11B27/28—Indexing; Addressing; Timing or synchronising; Measuring tape travel by using information detectable on the record carrier by using information signals recorded by the same method as the main recording

-

- G—PHYSICS

- G11—INFORMATION STORAGE

- G11B—INFORMATION STORAGE BASED ON RELATIVE MOVEMENT BETWEEN RECORD CARRIER AND TRANSDUCER

- G11B27/00—Editing; Indexing; Addressing; Timing or synchronising; Monitoring; Measuring tape travel

- G11B27/10—Indexing; Addressing; Timing or synchronising; Measuring tape travel

- G11B27/34—Indicating arrangements

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N21/00—Selective content distribution, e.g. interactive television or video on demand [VOD]

- H04N21/40—Client devices specifically adapted for the reception of or interaction with content, e.g. set-top-box [STB]; Operations thereof

- H04N21/47—End-user applications

- H04N21/472—End-user interface for requesting content, additional data or services; End-user interface for interacting with content, e.g. for content reservation or setting reminders, for requesting event notification, for manipulating displayed content

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N21/00—Selective content distribution, e.g. interactive television or video on demand [VOD]

- H04N21/40—Client devices specifically adapted for the reception of or interaction with content, e.g. set-top-box [STB]; Operations thereof

- H04N21/47—End-user applications

- H04N21/472—End-user interface for requesting content, additional data or services; End-user interface for interacting with content, e.g. for content reservation or setting reminders, for requesting event notification, for manipulating displayed content

- H04N21/4728—End-user interface for requesting content, additional data or services; End-user interface for interacting with content, e.g. for content reservation or setting reminders, for requesting event notification, for manipulating displayed content for selecting a Region Of Interest [ROI], e.g. for requesting a higher resolution version of a selected region

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N21/00—Selective content distribution, e.g. interactive television or video on demand [VOD]

- H04N21/80—Generation or processing of content or additional data by content creator independently of the distribution process; Content per se

- H04N21/85—Assembly of content; Generation of multimedia applications

- H04N21/858—Linking data to content, e.g. by linking an URL to a video object, by creating a hotspot

- H04N21/8583—Linking data to content, e.g. by linking an URL to a video object, by creating a hotspot by creating hot-spots

-

- G—PHYSICS

- G11—INFORMATION STORAGE

- G11B—INFORMATION STORAGE BASED ON RELATIVE MOVEMENT BETWEEN RECORD CARRIER AND TRANSDUCER

- G11B27/00—Editing; Indexing; Addressing; Timing or synchronising; Monitoring; Measuring tape travel

- G11B27/10—Indexing; Addressing; Timing or synchronising; Measuring tape travel

-

- G—PHYSICS

- G11—INFORMATION STORAGE

- G11B—INFORMATION STORAGE BASED ON RELATIVE MOVEMENT BETWEEN RECORD CARRIER AND TRANSDUCER

- G11B27/00—Editing; Indexing; Addressing; Timing or synchronising; Monitoring; Measuring tape travel

- G11B27/10—Indexing; Addressing; Timing or synchronising; Measuring tape travel

- G11B27/19—Indexing; Addressing; Timing or synchronising; Measuring tape travel by using information detectable on the record carrier

Landscapes

- Engineering & Computer Science (AREA)

- Multimedia (AREA)

- Theoretical Computer Science (AREA)

- Physics & Mathematics (AREA)

- Databases & Information Systems (AREA)

- General Engineering & Computer Science (AREA)

- Human Computer Interaction (AREA)

- General Physics & Mathematics (AREA)

- Data Mining & Analysis (AREA)

- Signal Processing (AREA)

- Library & Information Science (AREA)

- Computational Linguistics (AREA)

- Mathematical Physics (AREA)

- Television Signal Processing For Recording (AREA)

- Signal Processing For Digital Recording And Reproducing (AREA)

- Indexing, Searching, Synchronizing, And The Amount Of Synchronization Travel Of Record Carriers (AREA)

- Management Or Editing Of Information On Record Carriers (AREA)

- User Interface Of Digital Computer (AREA)

- Information Retrieval, Db Structures And Fs Structures Therefor (AREA)

- Processing Or Creating Images (AREA)

Abstract

本发明涉及一种用于在图像序列中导航的方法。在屏幕上显示图像。根据第一输入选择所显示的图像中第一位置处的第一对象。根据第二输入将第一对象移动到第二位置。识别其中第一对象靠近第二位置的图像序列中的至少一个图像。开始播放起始于所识别的图像之一的图像序列。

Description

技术领域

本发明涉及一种用于在图像序列(例如,电影)中导航以及交互呈现该图像序列的方法,以及用于执行该方法的装置,尤其用于呈现在允许用户比较容易进行交互的便携设备上的视频。

背景技术

对于视频分析,存在不同的技术。本领域中所熟知的一项技术是所谓的“对象分割”,用于基于颜色和纹理信息产生空间图像分割,即对象边界。用户通过使用对象分割技术,只需在对象中选择一个或多个点就可以迅速定义目标对象。已知的对象分割算法为“图形切割”和“分水岭(watershed)”。另一项技术是所谓的“对象跟踪”。在已经使用其空间边界定义对象之后,在随后的图像序列中自动跟踪该对象。为了进行对象跟踪,通常采用其颜色分布描述该对象。用于对象跟踪的一个已知的算法是“均值漂移”。为了更高的精度和鲁棒性,一些算法依赖于对象外观结构。一个已知的用于对象跟踪的描述符是尺度不变特征变换(SIFT)。另一项技术被称为“对象检测”。通用对象检测技术利用机器学习待检测的对象的外观的计算统计模型。这需要许多的对象实例(地面实况)。通过使用这些模型在新的图像上进行自动对象检测。模型通常依赖于SIFT描述符。当前使用的最常见的机器学习技术包括提升(boosting)和支持向量机(SVM)。此外,面部检测是一种特定对象检测的应用。在此情形中,使用的特征通常是滤波器参数,更具体地是“Haar小波”参数。一个众所周知的实现依赖于级联的增强分类器(boostedclassifier),例如Viola和Jone。

观看视频内容如新闻或纪录片的用户可能想要跳过某些片段或直接前往某个时间点来与视频互动。在使用触觉设备(如,用于视频呈现、方便与显示器互动的平板电脑)时,这样的可能性更大。

为了可以进行这种非线性的导航,若干手段在一些系统上是可用的。第一示例是跳过固定的播放时间量,例如在视频中前进10秒或30秒。第二示例是跳转到下一个剪辑片段或下一组画面(GOP)。这两种情况都提供了底层分析的有限的语义层级。根据视频数据而非根据电影内容导向(orient)跳跃机制。用户不清楚在跳转结束时会显示什么图像。并且,跳过的区间长度较短。

第三示例是跳转到下一个场景。场景是电视节目或电影中单个位置的情节的一部分,由一系列镜头组成。当跳过整个场景时,一般来说,这意味着跳跃到在处于电影中不同位置处的、不同情节开始的电影的部分。跳过的视频部分可能会过长。用户可能希望以更精细的步长移动。

在一些深度视频分析可用的系统中,甚至可以为某些对象或人员添加索引。然后,用户可以在这些对象/面部在视频上可见时点击它们,然后,系统可以移动到这些人再次出现的点,或在该特定的对象上显示更多的信息。此方法依赖于系统能够有效索引的对象的数量。到目前为止,与可能在例如普通的新闻视频中遇到的大量的各种各样的对象相比,只有相对较少的几种检测器。

发明内容

本发明的一个目的是提出一种导航方法和用于执行该方法的装置,其能够克服上述限制,并提供更加用户友好和直观的导航。

根据本发明,提出了一种用于在图像序列中导航的方法。该方法包括以下步骤:

-在屏幕上显示图像。

-根据第一输入选择所显示的图像中第一位置处的第一对象。第一输入是用户输入或来自连接到执行该方法的设备的另一个设备的输入。

-根据第二输入将第一对象移动到第二位置。替代性地,第一对象使用符号表示,例如,十字,加号或圆圈,移动该符号而非移动第一对象本身。第二位置是使用例如坐标定义的屏幕上的位置。另一种定义第二位置的方式是相对于图像中的至少一个其他的对象定义第一对象的位置。

-识别其中第一对象靠近第二位置的图像序列中的至少一个图像。

-开始播放起始于所识别的图像之一的图像序列。播放开始于被识别为满足第一对象和第二对象相互靠近的条件的第一图像。另一个解决方案是,该方法识别满足该条件的所有的图像,用户选择满足该条件的图像之一以从该图像开始播放。又一个解决方案是,将图像序列中的一图像用作播放的开始点,此时两个对象之间的距离最小。为了定义对象之间的距离,例如可以使用绝对值。另一种定义一个对象是否靠近另一个对象的方式是只使用X或Y坐标,或使用不同的加权因数加权X和Y方向上的距离。

该方法的优点是,观看图像序列的用户可以根据图像的内容在图像序列(其可以是广播的或记录的电影或者新闻节目)中进行导航,并且不依赖于主要因为技术原因限定的广播流的某些固定结构。导航变得更直观,更用户友好。优选地,实时地执行该方法,以使得用户具有实际移动对象的感觉。通过特定的交互,用户可以要求指定的对象从屏幕上消失的某一时间点。

选择第一对象的第一输入是在对象上点击或在对象周围绘制边界框。因此,用户可以应用公知的人机界面输入方法。如果存在索引,那么用户还能够通过该索引从数据库选取对象。

根据本发明,根据第二输入将第一对象移动到第二位置的步骤包括:

-根据进一步的输入选择所显示的图像第三位置处的第二对象,

-定义第一对象相对于第二对象的移动目的地,

-将第一对象移动到该目的地。

识别步骤进一步包括识别其中第一对象的目的地的相对位置靠近第二对象的位置的图像序列中的至少一个图像。

这具有下述优点,用户不仅可以选取与屏幕的物理坐标相关的屏幕上的某个位置,而且可以选取他希望该对象相对于图像中的其他对象的位置。例如,在记录的足球比赛中,第一对象可能是球,用户可以将球移动到在球靠近球门时他可能感兴趣的场景中他希望的球门方向,因为这可能是在球队得分或球员把球踢向球门之前不久。这种通过对象进行的导航完全独立于屏幕坐标,但依赖于图像中两个对象的相对距离。第一对象的目的地的位置靠近第二对象的位置还包括第二对象准确地位于与目的地相同的位置,或第二对象与被移动的第一对象的目的地重叠。有利地,认为对象的大小和其随时间的变化定义了两个对象彼此的相对位置。进一步的替代性的做法是,用户选择一个对象,例如面部,然后放大面部的边界框以定义面部的大小。之后,在图像序列中搜索以该尺寸或接近该尺寸的尺寸显示该面部的图像。该特征的优点在于,如果例如回放采访,用户对某个特定的人的发言感兴趣,那么假设在此人说话时此人的脸显示为几乎覆盖屏幕的最大部分。因此,本发明的一个优点是,存在一种简单的方法跳至其中对某个特定的人进行采访的记录的一部分。不一定必须在图像序列的相同图像中选择第一和第二对象。

用于选择第二对象的另一输入是在对象上点击或在对象周围绘制边界框。因此,用户可以应用公知的人机界面输入方法。如果存在索引,那么用户还能够通过该索引从数据库选取对象。

为了选择对象,使用对象分割、对象检测或面部检测。当检测到第一对象时,使用对象跟踪技术来跟踪该对象在图像序列的后续图像中的位置。还使用关键点技术选择对象。另外,使用关键点描述来确定图像序列的不同图像中对象的相似性。使用上面提到的技术的组合用于选择、识别和跟踪对象的。分层级分割可以产生其节点和叶与图像的嵌套区域对应的树。这种分割是事先完成的。如果用户通过敲击图像中给定点来选择对象,那么包含该点的最小节点被选中。如果接收到用户进一步的敲击,那么使用第一敲击选择的节点被认为是使用第二敲击选择的节点的父节点。因此,对应的区域被认为定义了对象。

根据本发明,只对图像序列中的一部分图像进行分析来识别其中对象靠近第二位置的至少一个图像。待分析的这部分是实际图像后面的一定数量的图像,该一定数量的图像表示当前显示的图像后面的一定播放时间。实施该方法的另一种方式是分析从当前显示的图像开始的所有之后的图像或从当前显示的图像开始的所有之前的图像。这对用户在图像序列中导航来说是一种熟悉的方式,因为它代表快进或快退导航。根据本发明的另一个实施方式,只对I画面或只对I和P画面或对所有画面进行分析来进行基于对象的导航。

本发明进一步涉及一种根据上述方法用于在图像序列中进行导航的装置。

附图说明

为更好地理解,现在将在下面的描述中参照附图对本发明进行更详细的说明。可以理解的是,本发明不限于此示例性实施例,可以在不脱离本发明的范围的情况下方便地组合和/或修改特定的特征。

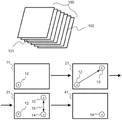

图1示出了用于播放图像序列和用于执行本发明的方法的装置。

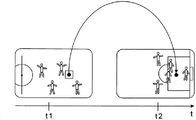

图2示出了用于导航的本发明的方法。

图3示出了图示本发明的方法的流程图。

图4示出了根据本发明的方法的导航的第一示例。

图5示出了根据本发明的方法的导航的第二示例。

具体实施方式

图1示意性地示出了用于显示图像序列的播放设备。播放装置包括屏幕1、电视接收器、作为图像序列来源2的HDD、DVD、BD播放器等,以及人机界面3。播放装置也可以是包括所有功能的装置,例如平板电脑,其中屏幕也用作人机界面(触摸屏),存在用来存储电影或纪录片的硬盘或闪存盘,广播接收器设备也被包括在该设备之中。

图2示出了包括多个图像的例如电影、纪录片或体育赛事的图像序列100。屏幕上当前显示的图像101是本发明的方法的起点。在第一步骤中,屏幕视图11显示此图像101。根据从人机界面接收的第一输入选择第一对象12。然后,通过根据人机界面接收到的第二输入将该第一对象12或表示该第一对象的符号移动(例如进行拖放)到屏幕上的另一个位置13。在屏幕视图21上,图示了第一对象12的新位置13。然后,该方法识别图像序列100中的至少一个图像102,其中第一对象12位于靠近该对象已被移动到的位置13的位置14处。在此图像中,位置14与通过拖放移动指示的期望位置13有一定的距离15。该距离15被用作评估期望位置和被考察的图像中的位置靠近的度量。这在屏幕视图31上图示出。在识别出最佳图像之后,根据用户请求,该图像显示在屏幕视图41上。该图像在图像序列100中具有某个位置,被示为图像102。从该某个位置播放图像序列100。

图3图示了使用该方法执行的步骤。在第一步骤200中,根据第一输入在显示的图像中选择对象。从人机界面接收输入。假设所述选择过程在很短的时间内执行。这保证了对象的外观不会变化太多。为了检测选择的对象,进行图像分析。对当前帧的图像进行分析并提取捕捉存在于图像中的一组关键点的感兴趣点。这些关键点位于存在较强梯度的位置处。使用周围纹理的描述提取这些关键点。当选择图像中的某个位置时,就收集该位置附近的关键点。收集关键点所在的区域的半径是本发明的方法的一个参数。使用其他的方法辅助关键点的选择,例如使用空间分割。提取出来的这组关键点构成所选择的对象的描述。选择第一对象之后,在步骤210中,该对象被移动到第二位置。根据第二输入执行该移动,第二输入是来自人机界面的输入。该移动被实现为拖放。然后,在步骤220中,该方法识别其中第一对象靠近第二位置的图像序列中的至少一个图像,第二位置是用户指定的图像位置。通过比较一组关键点来实现不同的图像中的对象的相似性。在步骤230,该方法跳转到所识别的图像,并开始播放。

图4示出了在观看其中多个人正在讨论所选主题的脱口秀时应用该方法的一个示例。整场秀的播放时间用箭头t表示。在时刻t1,第一图像显示在屏幕上,该图像包括三个面部。用户对显示在屏幕的左手侧的人感兴趣,并通过在该面部周围绘制边界框来选择这个人。然后,用户将所选对象(带有花哨发型的面部)拖到屏幕中间,再放大边界框以表示他想在屏幕中间并且在特写镜头中看到此人。因此,在图像序列中搜索满足这一要求的图像,发现该图像在时刻t2处,显示该图像,并在该时刻t2处开始播放。

图5示出了观看足球比赛时应用该方法的一个示例。在时刻t1,示出了场地中间的比赛场景。有四名球员,其中之一靠近球。用户对某个情况感兴趣,例如对接下来的罚球感兴趣。因此,他使用边界框选择该球,并跟踪对象到罚球点,表示他想看到球恰好在这一点的场景。在时刻t2,满足此要求。显示球停在罚球点并且球员准备踢点球的场景。从这一场景开始向后播放比赛。因此,用户能够方便地导航到他感兴趣的下一个场景。

Claims (14)

1.一种用于在图像序列中导航的方法,包括以下步骤:

-在屏幕上显示图像,

-根据第一输入选择所显示的图像中第一位置处的第一对象,

-根据第二输入将第一对象移动到第二位置,

-识别其中第一对象靠近第二位置的图像序列中的至少一个图像,以及

-开始播放起始于所识别的图像之一的图像序列。

2.如权利要求1所述的导航的方法,其中用于选择第一对象的第一输入是以下之一:在对象上点击、在对象周围绘制边界框或使用索引选取对象。

3.如权利要求1或2所述的导航的方法,其中由不同于第一位置的坐标的屏幕上的坐标定义第二位置。

4.如权利要求1或2所述的导航的方法,其中相对于第二对象定义第二位置。

5.如权利要求1、2或4所述的导航方法,其中根据第二输入将第一对象移动到第二位置的步骤包括:

-根据进一步的输入选择所显示的图像第三位置处的第二对象,

-定义第一对象相对于第二对象的移动目的地,

-将第一对象移动到目的地,并且其中

识别步骤进一步包括识别其中第一对象的目的地的相对位置靠近第二对象的位置的图像序列中的至少一个图像。

6.如权利要求5所述的导航的方法,其中用于选择第二对象的进一步输入是在对象上点击、在对象周围绘制边界框或使用索引选取对象。

7.如权利要求1-6之一所述的导航的方法,其中通过对象分割、对象检测或面部检测来选择对象。

8.如权利要求1-6之一所述的导航的方法,其中识别步骤包括对象跟踪以定义第一对象在图像序列的图像中的位置。

9.如权利要求1-8之一所述的导航的方法,其中使用关键点技术选择对象。

10.如权利要求1-8之一所述的导航的方法,其中使用关键点技术选择对象,并且使用关键点描述来确定图像序列中的不同图像中的对象的相似性。

11.如权利要求1-10之一所述的导航的方法,其中只对图像序列的一部分图像进行分析来识别其中对象靠近第二位置的至少一个图像。

12.如权利要求11所述的导航的方法,所述图像序列中的该部分图像表示以下中的一种:从当前显示的图像开始的某一播放时间、从当前显示的图像开始的所有之后的图像,和从当前显示的图像开始的所有之前的图像。

13.如权利要求11或12所述的导航的方法,所述图像序列中的该部分图像表示I画面、B画面和P画面中的一种。

14.一种用于在图像序列中导航的装置,其中所述装置实施根据权利要求1-14之一所述的方法。

Applications Claiming Priority (3)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| EP11305767 | 2011-06-17 | ||

| EP11305767.3 | 2011-06-17 | ||

| PCT/EP2012/060723 WO2012171839A1 (en) | 2011-06-17 | 2012-06-06 | Video navigation through object location |

Publications (1)

| Publication Number | Publication Date |

|---|---|

| CN103608813A true CN103608813A (zh) | 2014-02-26 |

Family

ID=46420070

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| CN201280029819.XA Pending CN103608813A (zh) | 2011-06-17 | 2012-06-06 | 通过对象位置进行视频导航 |

Country Status (9)

| Country | Link |

|---|---|

| US (1) | US20140208208A1 (zh) |

| EP (1) | EP2721528A1 (zh) |

| JP (1) | JP6031096B2 (zh) |

| KR (1) | KR20140041561A (zh) |

| CN (1) | CN103608813A (zh) |

| CA (1) | CA2839519A1 (zh) |

| MX (1) | MX2013014731A (zh) |

| RU (1) | RU2609071C2 (zh) |

| WO (1) | WO2012171839A1 (zh) |

Cited By (2)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| CN104185086A (zh) * | 2014-03-28 | 2014-12-03 | 无锡天脉聚源传媒科技有限公司 | 一种提供视频信息的方法和装置 |

| CN104270676A (zh) * | 2014-09-28 | 2015-01-07 | 联想(北京)有限公司 | 一种信息处理方法及电子设备 |

Families Citing this family (4)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US9405770B2 (en) * | 2014-03-10 | 2016-08-02 | Google Inc. | Three dimensional navigation among photos |

| JP6142897B2 (ja) * | 2015-05-15 | 2017-06-07 | カシオ計算機株式会社 | 画像表示装置、表示制御方法及びプログラム |

| KR102474244B1 (ko) * | 2015-11-20 | 2022-12-06 | 삼성전자주식회사 | 영상 표시 장치 및 그 동작방법 |

| TWI636426B (zh) * | 2017-08-23 | 2018-09-21 | 財團法人國家實驗研究院 | Method of tracking a person's face in an image |

Citations (3)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| CN1367616A (zh) * | 2001-01-20 | 2002-09-04 | 三星电子株式会社 | 视频序列中产生对象标识图象的装置和方法 |

| DE102007013811A1 (de) * | 2007-03-22 | 2008-09-25 | Fraunhofer-Gesellschaft zur Förderung der angewandten Forschung e.V. | Verfahren zur zeitlichen Segmentierung eines Videos in Videobildfolgen und zur Auswahl von Keyframes für das Auffinden von Bildinhalten unter Einbeziehung einer Subshot-Detektion |

| CN101374206A (zh) * | 2007-08-22 | 2009-02-25 | 奥多比公司 | 用于交互式视频帧选择的系统和方法 |

Family Cites Families (13)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JPH06101018B2 (ja) * | 1991-08-29 | 1994-12-12 | インターナショナル・ビジネス・マシーンズ・コーポレイション | 動画像データベースの検索 |

| JP4226730B2 (ja) * | 1999-01-28 | 2009-02-18 | 株式会社東芝 | 物体領域情報生成方法及び物体領域情報生成装置並びに映像情報処理方法及び情報処理装置 |

| JP2004240750A (ja) * | 2003-02-06 | 2004-08-26 | Canon Inc | 画像検索装置 |

| TW200537941A (en) * | 2004-01-26 | 2005-11-16 | Koninkl Philips Electronics Nv | Replay of media stream from a prior change location |

| US20080285886A1 (en) * | 2005-03-29 | 2008-11-20 | Matthew Emmerson Allen | System For Displaying Images |

| WO2007096003A1 (en) * | 2006-02-27 | 2007-08-30 | Robert Bosch Gmbh | Trajectory-based video retrieval system, method and computer program |

| US7787697B2 (en) * | 2006-06-09 | 2010-08-31 | Sony Ericsson Mobile Communications Ab | Identification of an object in media and of related media objects |

| US8488839B2 (en) * | 2006-11-20 | 2013-07-16 | Videosurf, Inc. | Computer program and apparatus for motion-based object extraction and tracking in video |

| US8239359B2 (en) * | 2008-09-23 | 2012-08-07 | Disney Enterprises, Inc. | System and method for visual search in a video media player |

| US20100281371A1 (en) * | 2009-04-30 | 2010-11-04 | Peter Warner | Navigation Tool for Video Presentations |

| JP5163605B2 (ja) * | 2009-07-14 | 2013-03-13 | パナソニック株式会社 | 動画像再生装置および動画像再生方法 |

| US20110113444A1 (en) * | 2009-11-12 | 2011-05-12 | Dragan Popovich | Index of video objects |

| US9171075B2 (en) * | 2010-12-30 | 2015-10-27 | Pelco, Inc. | Searching recorded video |

-

2012

- 2012-06-06 EP EP12730823.7A patent/EP2721528A1/en not_active Withdrawn

- 2012-06-06 RU RU2014101339A patent/RU2609071C2/ru not_active IP Right Cessation

- 2012-06-06 WO PCT/EP2012/060723 patent/WO2012171839A1/en active Application Filing

- 2012-06-06 US US14/126,494 patent/US20140208208A1/en not_active Abandoned

- 2012-06-06 CN CN201280029819.XA patent/CN103608813A/zh active Pending

- 2012-06-06 CA CA2839519A patent/CA2839519A1/en not_active Abandoned

- 2012-06-06 JP JP2014515137A patent/JP6031096B2/ja not_active Expired - Fee Related

- 2012-06-06 MX MX2013014731A patent/MX2013014731A/es active IP Right Grant

- 2012-06-06 KR KR1020137033446A patent/KR20140041561A/ko not_active Application Discontinuation

Patent Citations (3)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| CN1367616A (zh) * | 2001-01-20 | 2002-09-04 | 三星电子株式会社 | 视频序列中产生对象标识图象的装置和方法 |

| DE102007013811A1 (de) * | 2007-03-22 | 2008-09-25 | Fraunhofer-Gesellschaft zur Förderung der angewandten Forschung e.V. | Verfahren zur zeitlichen Segmentierung eines Videos in Videobildfolgen und zur Auswahl von Keyframes für das Auffinden von Bildinhalten unter Einbeziehung einer Subshot-Detektion |

| CN101374206A (zh) * | 2007-08-22 | 2009-02-25 | 奥多比公司 | 用于交互式视频帧选择的系统和方法 |

Cited By (3)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| CN104185086A (zh) * | 2014-03-28 | 2014-12-03 | 无锡天脉聚源传媒科技有限公司 | 一种提供视频信息的方法和装置 |

| CN104270676A (zh) * | 2014-09-28 | 2015-01-07 | 联想(北京)有限公司 | 一种信息处理方法及电子设备 |

| CN104270676B (zh) * | 2014-09-28 | 2019-02-05 | 联想(北京)有限公司 | 一种信息处理方法及电子设备 |

Also Published As

| Publication number | Publication date |

|---|---|

| JP2014524170A (ja) | 2014-09-18 |

| CA2839519A1 (en) | 2012-12-20 |

| US20140208208A1 (en) | 2014-07-24 |

| MX2013014731A (es) | 2014-02-11 |

| RU2014101339A (ru) | 2015-07-27 |

| RU2609071C2 (ru) | 2017-01-30 |

| WO2012171839A1 (en) | 2012-12-20 |

| JP6031096B2 (ja) | 2016-11-24 |

| EP2721528A1 (en) | 2014-04-23 |

| KR20140041561A (ko) | 2014-04-04 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| KR102290419B1 (ko) | 디지털 컨텐츠의 시각적 내용 분석을 통해 포토 스토리를 생성하는 방법 및 장치 | |

| Pritch et al. | Webcam synopsis: Peeking around the world | |

| US8750681B2 (en) | Electronic apparatus, content recommendation method, and program therefor | |

| AU2015222869B2 (en) | System and method for performing spatio-temporal analysis of sporting events | |

| Rasheed et al. | Scene detection in Hollywood movies and TV shows | |

| US9684818B2 (en) | Method and apparatus for providing image contents | |

| CN105474207B (zh) | 用于搜索多媒体内容的用户界面方法和设备 | |

| Chen et al. | An autonomous framework to produce and distribute personalized team-sport video summaries: A basketball case study | |

| US7802188B2 (en) | Method and apparatus for identifying selected portions of a video stream | |

| US20170201793A1 (en) | TV Content Segmentation, Categorization and Identification and Time-Aligned Applications | |

| US20090116811A1 (en) | Tagboard for video tagging | |

| CN103608813A (zh) | 通过对象位置进行视频导航 | |

| CN103200463A (zh) | 一种视频摘要生成方法和装置 | |

| CN112740713A (zh) | 用于提供多媒体内容中的关键时刻的方法及其电子设备 | |

| Carlier et al. | Combining content-based analysis and crowdsourcing to improve user interaction with zoomable video | |

| US11355158B2 (en) | Asynchronous video collaboration | |

| JP2009201041A (ja) | コンテンツ検索装置およびその表示方法 | |

| US20100209072A1 (en) | Method for creating a new summary of an audiovisual document that already includes a summary and reports and a receiver that can implement said method | |

| JP2021509201A (ja) | 映像前処理方法、装置及びコンピュータプログラム | |

| US20140372424A1 (en) | Method and system for searching video scenes | |

| JP2007200249A (ja) | 映像検索方法及び装置及びプログラム及びコンピュータ読み取り可能な記録媒体 | |

| WO1999005865A1 (en) | Content-based video access | |

| Fassold et al. | Towards automatic cinematography and annotation for 360° video | |

| Del Fabro et al. | Smart video browsing with augmented navigation bars | |

| KR102173858B1 (ko) | 사용자 선호도 입력 기반 인물 중심 장면 생성 및 비디오 요약 장치 및 방법 |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| C06 | Publication | ||

| PB01 | Publication | ||

| C10 | Entry into substantive examination | ||

| SE01 | Entry into force of request for substantive examination | ||

| RJ01 | Rejection of invention patent application after publication | ||

| RJ01 | Rejection of invention patent application after publication |

Application publication date: 20140226 |