JP4999101B2 - 効率的なマルチクラス対象物検出のためにブースト分類器を組み合わせる方法 - Google Patents

効率的なマルチクラス対象物検出のためにブースト分類器を組み合わせる方法 Download PDFInfo

- Publication number

- JP4999101B2 JP4999101B2 JP2007513229A JP2007513229A JP4999101B2 JP 4999101 B2 JP4999101 B2 JP 4999101B2 JP 2007513229 A JP2007513229 A JP 2007513229A JP 2007513229 A JP2007513229 A JP 2007513229A JP 4999101 B2 JP4999101 B2 JP 4999101B2

- Authority

- JP

- Japan

- Prior art keywords

- weak classifiers

- weak

- boosted

- class

- classifiers

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Expired - Fee Related

Links

Images

Classifications

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V10/00—Arrangements for image or video recognition or understanding

- G06V10/70—Arrangements for image or video recognition or understanding using pattern recognition or machine learning

- G06V10/77—Processing image or video features in feature spaces; using data integration or data reduction, e.g. principal component analysis [PCA] or independent component analysis [ICA] or self-organising maps [SOM]; Blind source separation

- G06V10/771—Feature selection, e.g. selecting representative features from a multi-dimensional feature space

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F18/00—Pattern recognition

- G06F18/20—Analysing

- G06F18/21—Design or setup of recognition systems or techniques; Extraction of features in feature space; Blind source separation

- G06F18/211—Selection of the most significant subset of features

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F18/00—Pattern recognition

- G06F18/20—Analysing

- G06F18/21—Design or setup of recognition systems or techniques; Extraction of features in feature space; Blind source separation

- G06F18/214—Generating training patterns; Bootstrap methods, e.g. bagging or boosting

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V10/00—Arrangements for image or video recognition or understanding

- G06V10/70—Arrangements for image or video recognition or understanding using pattern recognition or machine learning

- G06V10/77—Processing image or video features in feature spaces; using data integration or data reduction, e.g. principal component analysis [PCA] or independent component analysis [ICA] or self-organising maps [SOM]; Blind source separation

- G06V10/774—Generating sets of training patterns; Bootstrap methods, e.g. bagging or boosting

- G06V10/7747—Organisation of the process, e.g. bagging or boosting

Landscapes

- Engineering & Computer Science (AREA)

- Theoretical Computer Science (AREA)

- Computer Vision & Pattern Recognition (AREA)

- Artificial Intelligence (AREA)

- Data Mining & Analysis (AREA)

- General Physics & Mathematics (AREA)

- Evolutionary Computation (AREA)

- Physics & Mathematics (AREA)

- Databases & Information Systems (AREA)

- Software Systems (AREA)

- Medical Informatics (AREA)

- General Health & Medical Sciences (AREA)

- Health & Medical Sciences (AREA)

- Multimedia (AREA)

- Computing Systems (AREA)

- Life Sciences & Earth Sciences (AREA)

- Bioinformatics & Cheminformatics (AREA)

- Bioinformatics & Computational Biology (AREA)

- Evolutionary Biology (AREA)

- General Engineering & Computer Science (AREA)

- Image Analysis (AREA)

Description

本出願は2004年5月10日に出願されたアメリカ合衆国暫定特許出願通し番号60/569,552の利益を主張するものであり、該アメリカ合衆国暫定特許出願の全体が参照として本願に取り込まれている。

本発明は、効率的なマルチクラス対象物検出のために、ブースト分類器を組み合わせる方法に、より詳細には、マルチクラス対象物を識別する検出システムをブースト分類器を用いて訓練するためのシステム及び方法に関する。

近年、特に画像対象物検出の分野において、総合的な強分類器を得るために一連の単純又は弱分類器をブーストする技術が強力な解決手段へと発展してきた。画像対象物検出はますます一般的になってきており、多くの異なる検出シナリオにおいて使用することができる。このような用途の例としては、顔検出、歩行者検出、交通標識検出、及び車両検出がある。

H={h1, ... ,hT} (1)

を選択し、組み合わせる。なお、各々の弱分類器は、最終又は強分類器を形成する分類器候補の大きな集合から取ったものである。対象物画像検出の問題においては、Xはすべての画像パッチの集合であり、クラス+1は対象物に対応し、クラス−1は非対象物に対応している。さらに重み係数の集合

α={α1, ... ,αT} (2)

が与えられれば、対象物検出は候補画像パッチx∈X上で強分類器hを評価することで解決される。判別h(x)は弱分類器の判別の加重和から計算される。すなわち、

本発明では、個々の検出器の特徴と分類器設計とを含んだ主要要素を結合して設計することにより、より効率的なマルチクラス検出法及びシステムが案出されている。本発明の1つの実施形態によれば、画像又はビデオシーケンス内のマルチクラス対象物を検出するシステムを訓練するための方法が記載されている。一連の対象物クラスに対する弱分類器の共通アンサンブルが識別される。各対象物クラスについて、それぞれの重み付けスキームを弱分類器のアンサンブルに適応させる。

以下に、本発明の好ましい実施形態をより詳細に説明する。添付した図面において、同じ参照番号は同じエレメントを指している。

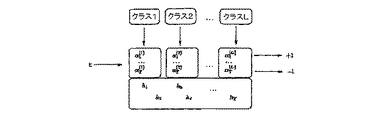

図2は、本発明によるマルチクラス対象物検出のフレームワークを示している。

本発明は、効率的なマルチクラス対象物検出のためにブースト分類器を組み合わせるシステム及び方法に関している。本発明はまたマルチクラス対象物検出のための分類器を訓練する方法にも関している。本発明は、様々な対象物の検出を必要とする多くの用途に使用することができる。このようなシステムは、例えば、人物又は顔貌の検出と追跡のような監視用途に使用されうる。

1.所与のL個の対象物クラスに対して、弱分類器の共通アンサンブルH=H(1)=…=H(L)={h1, ... ,hT}を選ぶ。

2.for l=1, ... ,L

3.AdaBoostを用いてα(l)をクラスlの訓練集合に適合させる。その際、候補となる弱分類器はHにより与えられる。

Claims (7)

- 画像又はビデオシーケンス内のマルチクラス対象物を検出するシステムを訓練するための方法であって、

1.対象物クラスの集合lについて、ブーストされた弱分類器の共通アンサンブルHを以下の3つの技法のいずれかに従って形成するステップであって、その際に各弱分類器h t を重みα t で重み付けするステップ、すなわち、

a.第1の技法に従い、少なくとも1つの対象物が画像又はビデオシーケンス内に高い頻度で出現する対象物クラスl 0 のうちの1つから選択することにより前記共通アンサンブルHを形成し、ここで

であり、

は前記対象物クラスl 0 の弱分類器であるとするか、または

b.第2の技法に従い、すべての訓練集合の合併集合にAdaBoostを適用して、前記対象物クラスのすべてを含んだデータセットから学習することにより前記共通アンサンブルHを形成するか、または

c.第3の技法に従い、第1の訓練ステップで選択されたブーストされた弱分類器の個々の集合を組み合わせることにより、前記ブーストされた弱分類器の共通アンサンブルHを形成し、ここで前記ブーストされた弱分類器の個々の集合はそれぞれ単一対象物クラスから個別に学習されたものである、

ステップと、

2.各対象物クラスについて、AdaBoostを使用して、前記ブーストされた弱分類器の共通アンサンブルの弱分類器の重みを再訓練するステップを有している、

ことを特徴とする訓練方法。 - 正の対象物を負の対象物から区別するために、前記ブーストされた弱分類器の共通アンサンブルを最適化する、請求項1記載の方法。

- 前記組合せは前記弱分類器の複数の集合の数学的な合併である、請求項1記載の方法。

- 前記組合せは前記弱分類器の個々の集合の数学的な共通部分である、請求項1記載の方法。

- 前記弱分類器の個々の集合の組合せは、多数決により決定される部分集合である、請求項1記載の方法。

- 画像又はビデオシーケンス内の複数のクラスの対象物を検出する方法であって、

対象物クラスの集合lについて、ブーストされた弱分類器の共通アンサンブルHを以下の3つの技法のいずれかに従って形成するステップであって、その際に各弱分類器h t を重みα t で重み付けするステップ、すなわち、

a.第1の技法に従い、少なくとも1つの対象物が画像又はビデオシーケンス内に高い頻度で出現する対象物クラスl 0 のうちの1つから選択することにより前記共通アンサンブルHを形成し、ここで

であり、

は前記対象物クラスl 0 の弱分類器であるとするか、または

b.第2の技法に従い、すべての訓練集合の合併集合にAdaBoostを適用して、前記対象物クラスのすべてを含んだデータセットから学習することにより前記共通アンサンブルHを形成するか、または

c.第3の技法に従い、第1の訓練ステップで選択されたブーストされた弱分類器の個々の集合を組み合わせることにより、前記ブーストされた弱分類器の共通アンサンブルHを形成し、ここで前記ブーストされた弱分類器の個々の集合はそれぞれ単一対象物クラスから個別に学習されたものである、

ステップと、

各対象物クラスについて、AdaBoostを使用して、前記ブーストされた弱分類器の共通アンサンブルの弱分類器の重みを再訓練するステップと、

各対象物クラスに、前記再訓練に基づいて重み付けされた弱分類器の組合せにより実現された検出器を割り当てるステップと

を有しており、

前記検出器のすべてが前記弱分類器の共通アンサンブルに基づいている、ことを特徴とする検出方法。 - 前記検出器のスコアを使用して、検出された対象物を前記対象物クラスのうちの1つに分類する、請求項6記載の方法。

Applications Claiming Priority (5)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| US56955204P | 2004-05-10 | 2004-05-10 | |

| US60/569,552 | 2004-05-10 | ||

| US11/111,640 US7769228B2 (en) | 2004-05-10 | 2005-04-21 | Method for combining boosted classifiers for efficient multi-class object detection |

| US11/111,640 | 2005-04-21 | ||

| PCT/US2005/015854 WO2005111918A1 (en) | 2004-05-10 | 2005-05-05 | Method for combining boosted classifiers for efficient multi-class object detection |

Publications (3)

| Publication Number | Publication Date |

|---|---|

| JP2007537542A JP2007537542A (ja) | 2007-12-20 |

| JP2007537542A5 JP2007537542A5 (ja) | 2012-05-31 |

| JP4999101B2 true JP4999101B2 (ja) | 2012-08-15 |

Family

ID=34968880

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2007513229A Expired - Fee Related JP4999101B2 (ja) | 2004-05-10 | 2005-05-05 | 効率的なマルチクラス対象物検出のためにブースト分類器を組み合わせる方法 |

Country Status (4)

| Country | Link |

|---|---|

| US (1) | US7769228B2 (ja) |

| EP (1) | EP1745414B1 (ja) |

| JP (1) | JP4999101B2 (ja) |

| WO (1) | WO2005111918A1 (ja) |

Families Citing this family (30)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US7680324B2 (en) | 2000-11-06 | 2010-03-16 | Evryx Technologies, Inc. | Use of image-derived information as search criteria for internet and other search engines |

| US8224078B2 (en) | 2000-11-06 | 2012-07-17 | Nant Holdings Ip, Llc | Image capture and identification system and process |

| US7565008B2 (en) | 2000-11-06 | 2009-07-21 | Evryx Technologies, Inc. | Data capture and identification system and process |

| US7899243B2 (en) | 2000-11-06 | 2011-03-01 | Evryx Technologies, Inc. | Image capture and identification system and process |

| US9310892B2 (en) | 2000-11-06 | 2016-04-12 | Nant Holdings Ip, Llc | Object information derived from object images |

| US7508979B2 (en) * | 2003-11-21 | 2009-03-24 | Siemens Corporate Research, Inc. | System and method for detecting an occupant and head pose using stereo detectors |

| WO2007107315A1 (de) * | 2006-03-22 | 2007-09-27 | Daimler Ag | Multisensorieller hypothesen-basierter objektdetektor und objektverfolger |

| EP2674324B1 (en) | 2007-04-30 | 2018-12-26 | Mobileye Vision Technologies Ltd. | Rear obstruction detection |

| JP4891197B2 (ja) | 2007-11-01 | 2012-03-07 | キヤノン株式会社 | 画像処理装置および画像処理方法 |

| US8433669B2 (en) * | 2007-11-14 | 2013-04-30 | International Business Machines Corporation | Configuring individual classifiers with multiple operating points for cascaded classifier topologies under resource constraints |

| US8306940B2 (en) * | 2009-03-20 | 2012-11-06 | Microsoft Corporation | Interactive visualization for generating ensemble classifiers |

| CN101853389A (zh) * | 2009-04-01 | 2010-10-06 | 索尼株式会社 | 多类目标的检测装置及检测方法 |

| US8666988B2 (en) * | 2009-05-14 | 2014-03-04 | International Business Machines Corporation | Configuring classifier trees and classifying data |

| EP2397989A1 (en) * | 2010-02-01 | 2011-12-21 | Morpho, Inc. | Object detection device and object detection method |

| EP2681693B1 (en) * | 2011-03-04 | 2018-08-01 | LBT Innovations Limited | Method for improving classification results of a classifier |

| EP2574958B1 (en) * | 2011-09-28 | 2017-02-22 | Honda Research Institute Europe GmbH | Road-terrain detection method and system for driver assistance systems |

| US9269017B2 (en) | 2013-11-15 | 2016-02-23 | Adobe Systems Incorporated | Cascaded object detection |

| US9208404B2 (en) * | 2013-11-15 | 2015-12-08 | Adobe Systems Incorporated | Object detection with boosted exemplars |

| US9710729B2 (en) * | 2014-09-04 | 2017-07-18 | Xerox Corporation | Domain adaptation for image classification with class priors |

| CN105718937B (zh) * | 2014-12-03 | 2019-04-05 | 财团法人资讯工业策进会 | 多类别对象分类方法及系统 |

| IN2015MU01794A (ja) * | 2015-05-05 | 2015-06-19 | Manharlal Shah Bhavin | |

| CN106295666B (zh) * | 2015-05-14 | 2020-03-03 | 佳能株式会社 | 获取分类器、检测对象的方法和装置及图像处理设备 |

| DE112016004109T5 (de) | 2015-09-11 | 2018-08-09 | Intel Corporation | Echtzeit-mehrfach-fahrzeugdetektion und -tracking |

| CN106327527B (zh) * | 2016-08-11 | 2019-05-14 | 电子科技大学 | 基于Online Boosting的目标轮廓跟踪方法 |

| US10482594B2 (en) * | 2016-09-23 | 2019-11-19 | Apple Inc. | Multi-perspective imaging system and method |

| CN108021940B (zh) * | 2017-11-30 | 2023-04-18 | 中国银联股份有限公司 | 基于机器学习的数据分类方法及系统 |

| US10552299B1 (en) | 2019-08-14 | 2020-02-04 | Appvance Inc. | Method and apparatus for AI-driven automatic test script generation |

| US10628630B1 (en) | 2019-08-14 | 2020-04-21 | Appvance Inc. | Method and apparatus for generating a state machine model of an application using models of GUI objects and scanning modes |

| US11636385B2 (en) * | 2019-11-04 | 2023-04-25 | International Business Machines Corporation | Training an object detector using raw and unlabeled videos and extracted speech |

| CN111881764B (zh) * | 2020-07-01 | 2023-11-03 | 深圳力维智联技术有限公司 | 一种目标检测方法、装置、电子设备及存储介质 |

Family Cites Families (7)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| CA2167748A1 (en) * | 1995-02-09 | 1996-08-10 | Yoav Freund | Apparatus and methods for machine learning hypotheses |

| US6453307B1 (en) * | 1998-03-03 | 2002-09-17 | At&T Corp. | Method and apparatus for multi-class, multi-label information categorization |

| US6456993B1 (en) * | 1999-02-09 | 2002-09-24 | At&T Corp. | Alternating tree-based classifiers and methods for learning them |

| US6546379B1 (en) * | 1999-10-26 | 2003-04-08 | International Business Machines Corporation | Cascade boosting of predictive models |

| US7076473B2 (en) * | 2002-04-19 | 2006-07-11 | Mitsubishi Electric Research Labs, Inc. | Classification with boosted dyadic kernel discriminants |

| US7362919B2 (en) * | 2002-12-12 | 2008-04-22 | Eastman Kodak Company | Method for generating customized photo album pages and prints based on people and gender profiles |

| JP5025893B2 (ja) * | 2004-03-29 | 2012-09-12 | ソニー株式会社 | 情報処理装置および方法、記録媒体、並びにプログラム |

-

2005

- 2005-04-21 US US11/111,640 patent/US7769228B2/en active Active

- 2005-05-05 JP JP2007513229A patent/JP4999101B2/ja not_active Expired - Fee Related

- 2005-05-05 EP EP05745708.7A patent/EP1745414B1/en not_active Expired - Fee Related

- 2005-05-05 WO PCT/US2005/015854 patent/WO2005111918A1/en active Application Filing

Also Published As

| Publication number | Publication date |

|---|---|

| US7769228B2 (en) | 2010-08-03 |

| JP2007537542A (ja) | 2007-12-20 |

| EP1745414B1 (en) | 2018-10-17 |

| EP1745414A1 (en) | 2007-01-24 |

| WO2005111918A1 (en) | 2005-11-24 |

| US20050249401A1 (en) | 2005-11-10 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP4999101B2 (ja) | 効率的なマルチクラス対象物検出のためにブースト分類器を組み合わせる方法 | |

| US11393103B2 (en) | Target tracking method, device, system and non-transitory computer readable medium | |

| CN108960080B (zh) | 基于主动防御图像对抗攻击的人脸识别方法 | |

| Sivaraman et al. | A general active-learning framework for on-road vehicle recognition and tracking | |

| JP5259798B2 (ja) | 映像解析方法およびシステム | |

| US8224029B2 (en) | Object matching for tracking, indexing, and search | |

| US20100054540A1 (en) | Calibration of Video Object Classification | |

| Qian et al. | Intelligent surveillance systems | |

| US8515126B1 (en) | Multi-stage method for object detection using cognitive swarms and system for automated response to detected objects | |

| JP2008500640A (ja) | 検出および追跡のためのグラフィカルオブジェクトモデル | |

| Wang et al. | Video object matching across multiple non-overlapping camera views based on multi-feature fusion and incremental learning | |

| Reddy et al. | Tracking people in real time video footage using facial recognition | |

| Loos et al. | Detection and identification of chimpanzee faces in the wild | |

| Santosh et al. | Recent Trends in Image Processing and Pattern Recognition: Third International Conference, RTIP2R 2020, Aurangabad, India, January 3–4, 2020, Revised Selected Papers, Part I | |

| Gazzeh et al. | Deep learning for pedestrian behavior understanding | |

| Hbali et al. | Object detection based on HOG features: Faces and dual-eyes augmented reality | |

| Rani et al. | Recognition and Detection of Multiple Objects from Images: A Review | |

| Balasubramanian et al. | Deep-facial feature-based person reidentification for authentication in surveillance applications | |

| Khel et al. | Realtime Crowd Monitoring—Estimating Count, Speed and Direction of People Using Hybridized YOLOv4 | |

| Snidaro et al. | Fusion of heterogeneous features via cascaded on-line boosting | |

| Bharathi et al. | A Conceptual Real-Time Deep Learning Approach for Object Detection, Tracking and Monitoring Social Distance using Yolov5 | |

| Li et al. | Boosting the performance of scene recognition via offline feature-shifts and search window weights | |

| Gómez Silva | Appearance similarity learning for multi-person tracking and re-identification | |

| Azhari et al. | UAD Lecturers' introductory system through surveillance cameras with eigenface method | |

| Mansour et al. | Speed Sign Recognition using Independent Component Analysis. |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A977 | Report on retrieval |

Free format text: JAPANESE INTERMEDIATE CODE: A971007 Effective date: 20090911 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20090918 |

|

| A601 | Written request for extension of time |

Free format text: JAPANESE INTERMEDIATE CODE: A601 Effective date: 20091215 |

|

| A602 | Written permission of extension of time |

Free format text: JAPANESE INTERMEDIATE CODE: A602 Effective date: 20091222 |

|

| A601 | Written request for extension of time |

Free format text: JAPANESE INTERMEDIATE CODE: A601 Effective date: 20100115 |

|

| A602 | Written permission of extension of time |

Free format text: JAPANESE INTERMEDIATE CODE: A602 Effective date: 20100122 |

|

| A601 | Written request for extension of time |

Free format text: JAPANESE INTERMEDIATE CODE: A601 Effective date: 20100218 |

|

| A602 | Written permission of extension of time |

Free format text: JAPANESE INTERMEDIATE CODE: A602 Effective date: 20100225 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20100316 |

|

| A711 | Notification of change in applicant |

Free format text: JAPANESE INTERMEDIATE CODE: A712 Effective date: 20101111 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20110225 |

|

| A711 | Notification of change in applicant |

Free format text: JAPANESE INTERMEDIATE CODE: A712 Effective date: 20110523 |

|

| A601 | Written request for extension of time |

Free format text: JAPANESE INTERMEDIATE CODE: A601 Effective date: 20110524 |

|

| A602 | Written permission of extension of time |

Free format text: JAPANESE INTERMEDIATE CODE: A602 Effective date: 20110531 |

|

| A711 | Notification of change in applicant |

Free format text: JAPANESE INTERMEDIATE CODE: A711 Effective date: 20110615 |

|

| A601 | Written request for extension of time |

Free format text: JAPANESE INTERMEDIATE CODE: A601 Effective date: 20110623 |

|

| A602 | Written permission of extension of time |

Free format text: JAPANESE INTERMEDIATE CODE: A602 Effective date: 20110630 |

|

| A601 | Written request for extension of time |

Free format text: JAPANESE INTERMEDIATE CODE: A601 Effective date: 20110725 |

|

| A602 | Written permission of extension of time |

Free format text: JAPANESE INTERMEDIATE CODE: A602 Effective date: 20110801 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20110824 |

|

| A072 | Dismissal of procedure [no reply to invitation to correct request for examination] |

Free format text: JAPANESE INTERMEDIATE CODE: A072 Effective date: 20111011 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20111208 |

|

| A601 | Written request for extension of time |

Free format text: JAPANESE INTERMEDIATE CODE: A601 Effective date: 20120308 |

|

| A602 | Written permission of extension of time |

Free format text: JAPANESE INTERMEDIATE CODE: A602 Effective date: 20120315 |

|

| A524 | Written submission of copy of amendment under article 19 pct |

Free format text: JAPANESE INTERMEDIATE CODE: A524 Effective date: 20120409 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20120502 |

|

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20120511 |

|

| R150 | Certificate of patent or registration of utility model |

Ref document number: 4999101 Country of ref document: JP Free format text: JAPANESE INTERMEDIATE CODE: R150 Free format text: JAPANESE INTERMEDIATE CODE: R150 |

|

| FPAY | Renewal fee payment (event date is renewal date of database) |

Free format text: PAYMENT UNTIL: 20150525 Year of fee payment: 3 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| LAPS | Cancellation because of no payment of annual fees |