JP2004127311A - Associative retrieval device of image - Google Patents

Associative retrieval device of image Download PDFInfo

- Publication number

- JP2004127311A JP2004127311A JP2003384488A JP2003384488A JP2004127311A JP 2004127311 A JP2004127311 A JP 2004127311A JP 2003384488 A JP2003384488 A JP 2003384488A JP 2003384488 A JP2003384488 A JP 2003384488A JP 2004127311 A JP2004127311 A JP 2004127311A

- Authority

- JP

- Japan

- Prior art keywords

- video

- information

- scene

- display

- image

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Granted

Links

Images

Abstract

Description

本発明は,映像を連想的に検索し任意の映像を見つけ出す装置及び方法に関する。 The present invention relates to an apparatus and a method for associatively searching for an image and finding an arbitrary image.

近年,計算機の高速化と大容量化を背景にして,従来は扱えなかった映画やビデオなどの映像情報を対象としたデータベースの構築が活発になっている。これに伴い,蓄積された大量の映像の中から,所望のシーンを効率良く選び出す検索技術の実用化が進められている。こうした検索のための方法としては,ユーザが所望のシーンの特徴もしくはキーワード等を指示し,計算機がそれに合致したキーワードが付けられているシーンを見つけ出す方法が,映像データベースの分野で一般的となっている。しかし,シーンの特徴を的確に指定することは,検索に不慣れなユーザにとってはもちろん,熟練者にとっても非常に難しく,思い通りの検索結果が得られないことが多い。 In recent years, with the speeding up and large capacity of computers, the construction of databases for video information such as movies and videos, which could not be handled conventionally, has become active. Along with this, practical use of a search technique for efficiently selecting a desired scene from a large amount of accumulated videos has been promoted. As a method for such a search, a method in which a user designates a feature or a keyword of a desired scene, and a computer finds a scene to which a keyword matching the keyword is attached is generally used in the field of video databases. I have. However, it is very difficult for a user who is unfamiliar with the search, as well as a skilled person, to accurately specify the characteristics of the scene, and often the desired search result cannot be obtained.

古典的な情報である本には,検索の補助情報として,目次と索引が用意されている。目次は,本文のひとまとまりを象徴するキーワードを,本文中における進行順に列挙した情報である。索引は,本文中の重要なキーワードを,五十音順などの見つけやすい順番で整理して列記した情報である。両者に共通する最大の特徴は,そうしたキーワードが一覧表示されていることにある。そして,必ず巻頭もしくは巻末にあると決まっており,探す手間がかからないことである。読者は

,本文中の一節を,目次や索引を用いることで,自らキーワードを考えることなく探し当てることができる。また,目次を見れば,本文の概要を把握でき,その本が読むに値するかどうかも短時間でわかる。

A table of contents and an index are prepared as supplementary information for search in a book that is classic information. The table of contents is information in which keywords symbolizing a group of the text are listed in the order of progress in the text. The index is information in which important keywords in the text are arranged and listed in an easy-to-find order such as the Japanese syllabary. The most common feature of both is that such keywords are listed. And it is decided that it is always at the beginning or end of the book, so there is no need to search for it. Readers can use the table of contents and index to find passages in the text without having to consider keywords themselves. The table of contents also gives a quick overview of the text and whether the book is worth reading.

目次や索引による検索には,表示されているキーワードが多すぎると適当な部分が見つけにくい,逆に少ないと適当なキーワードがそもそも存在しない,という問題点もある。しかし,これらの問題点は,ハイパーテキストやフルテキスト検索との併用で解決できる。すなわち,まず目次・索引の項目数をある程度限定してユーザに提示する。ユーザは,その中から,とりあえず目的の部位に関係しそうな次善のキーワードを使って本文を参照し,その本文中に意中の部位に直接関係ありそうなキーワードがないか探せばよい。見つかれば,ハイパーテキストの機構を使って,意中の部位を参照することで目的は達せられる。これはオンラインマニュアルでの検索などで日常的に行われるテクニックである。ハイパーテキストには,あらかじめキーワードが登録されていることが必要であるが,フルテキスト検索を使えば,登録されていないキーワードでも同様のことができる。このように,キーワードを連想的に辿る機構によって,目次や索引の利用できる範囲が広がり,多くの場合,眼前に現れるキーワードをただ取捨選択していくだけの処理で目的の部位が検索できる(以下,連想検索と呼ぶ)ようになる。 (4) In the search using the table of contents or the index, there is a problem that if there are too many displayed keywords, it is difficult to find an appropriate part, and if there are few displayed keywords, there is no appropriate keyword in the first place. However, these problems can be solved in combination with hypertext and full-text search. That is, first, the number of items in the table of contents / index is limited to some extent and presented to the user. The user may refer to the text using a suboptimal keyword that is likely to be related to the target part, and search for a keyword in the text that is likely to be directly related to the desired part. If found, the goal can be achieved by using the hypertext mechanism to refer to the desired location. This is a technique that is routinely used for searching online manuals. It is necessary that a keyword is registered in the hypertext in advance, but the same can be performed with a keyword that has not been registered by using a full-text search. In this way, the associative tracing mechanism of keywords expands the usable range of the table of contents and index, and in many cases, the target site can be searched by simply selecting keywords that appear in front of the eyes (hereinafter, referred to as (Called associative search).

こうした機構は,映像の検索においても有効と考えられる。映像においては,その中に登場する人や物などの様々な事物が,上記のキーワードに相当するものとして用いることができる。これを用いた連想検索を実現する要素技術としては

,例えば,映像の表示画面中の事物から関連するシーンや情報を参照する方式として,特開平3-52070号公報「動画像の関連情報参照方式」がある。これ

によれば,映像中の各事物の登場する画像区間及び位置を記憶する手段と,対応する関連情報と結び付ける手段とを設けることにより,各事物の表示されている画面上の一点をマウス等によってポイントすることで容易に関連するシーンにジャンプしたり,関連情報を呼び出すことができる。また,画像処理を用いることによって,各事物とその関連情報との対応づけを省力化する手段として,例えば

,発明者らによる特開平5−204990号公報がある。

Such a mechanism is also considered to be effective in video search. In an image, various things such as people and things appearing in the image can be used as corresponding to the above keywords. As an elemental technology for realizing the associative search using this, for example, as a method of referring to a related scene or information from an object on a video display screen, Japanese Patent Application Laid-Open No. 3-52070, "Moving Image Related Information Reference Method" There is. According to this, by providing a means for storing an image section and a position where each thing in a video appears and a means for associating with the related information, one point on the screen on which each thing is displayed can be a mouse or the like. By pointing, the user can easily jump to a related scene or call up related information. Japanese Patent Application Laid-Open No. Hei 5-204990 discloses an example of a means for saving the correspondence between each object and its related information by using image processing.

上記で挙げた先行技術は,専ら各事物とその関連情報との対応づけを行うための手段であって,検索システム全体としての構成やユーザの側の使い勝手については十分検討されているとはいえない。また,あらかじめ関連情報との対応づけが済んでいる事物についてしか連想的に辿ることはできないという問題点がある。 The prior art mentioned above is a means for exclusively associating each thing with its related information, and although the structure of the entire search system and the usability of the user have been sufficiently studied. Absent. In addition, there is a problem that it is possible to associatively trace only an object that has been associated with the related information in advance.

本発明の目的は,映像の検索にあたって,計算機が提示する限定された情報の中から,ただ取捨選択していくだけの操作で,ユーザが記憶を連想的に辿りながら所望のシーンを見つけることができるインタフェースを提供することにある。 An object of the present invention is to allow a user to find a desired scene while associatively tracing a memory by simply selecting the limited information presented by a computer when searching for a video. To provide an interface.

本発明の第二の目的は,あらかじめ対応づけのされていない事物についても連想的に辿ることができるような手段を提供することにある。 The second object of the present invention is to provide a means for associatively tracing an item that has not been previously associated.

本発明は,画面上に任意の映像を表示するための映像表示領域と,映像の再生状態を制御するための操作パネル領域と,映像の目次や索引に相当するインデクス情報を表示する領域とを具備し,それらの表示領域のうち,いずれがポイントされたかを検出する手段と,このポイント情報と別途蓄積してある映像の記述情報とから次に再生すべき映像の状態を定める手段を有する。また,表示中の事物とその位置とを把握して,その事物の関連情報を重畳して表示する手段と,関連情報登録変更手段を設ける。また,これら処理に必要な情報を登録し管理する手段を設ける。 According to the present invention, an image display area for displaying an arbitrary image on a screen, an operation panel area for controlling a reproduction state of an image, and an area for displaying index information corresponding to a table of contents or an index of the image are provided. It has means for detecting which of the display areas is pointed, and means for determining the state of the video to be reproduced next from the point information and the descriptive information of the video separately stored. Further, there are provided a means for grasping the displayed thing and its position, superimposing and displaying related information of the thing, and a related information registration changing means. In addition, means for registering and managing information necessary for these processes is provided.

さらに,表示中のシーンに現れている特定の事物を指定する手段と,その事物の特徴量を抽出するための手段と,その特徴量と合致する特徴量を持つ他の映像シーンを探し出す手段と,見つかった映像シーンに直ちにジャンプする手段とを設ける。 A means for designating a specific thing appearing in the scene being displayed; a means for extracting a feature amount of the thing; a means for searching for another video scene having a feature amount matching the feature amount; Means for immediately jumping to the found video scene.

本発明によれば,所望のシーンを探すとき,映像のインデクス情報の中に所望のシーンに直接関係のある事物の情報がなくても,所望のシーンを連想させる何らかの事物を次々と辿りながら目的のシーンまで到達することができる。このように,インデクス表示と連想検索を有機的に組み合わせることにより,インデクスの利用できる範囲が大幅に広がり,多くの場合,計算機が提示する情報をただ取捨選択していくだけの処理で目的のシーンが検索できるようになる。そのため,目的のシーンを一意に決定づける適切なキーワードもしくは画像特徴量を考えたり指示する必要がなくなり,あやふやな記憶でも検索ができ,初心者にもわかりやすい。また,関連情報重畳手段によって,再生中の映像に現れている事物の関連情報のうち選択された一部または全部の情報を,再生映像中の該事物の位置に重畳,もしくは該事物とその関連情報とが対応していることを明示される形態で表示されるので,連想検索途中で現れた事物に関する情報を即座に,かつ,どの事物の情報なのか混同することなく正確に知ることができる。また,関連情報登録変更手段を設けることにより,再生中の映像に現れている事物の関連情報の一部または全部の情報を,その事物が現れたその場で直ちに登録もしくは変更できる。 According to the present invention, when searching for a desired scene, even if there is no information on an object directly related to the desired scene in the index information of the video, the object is searched for one after another while retrieving some objects reminiscent of the desired scene. Scene can be reached. In this way, by combining the index display and the associative search organically, the range of use of the index is greatly expanded, and in many cases, the target scene is simply processed by simply selecting the information presented by the computer. Be able to search. For this reason, it is not necessary to consider or indicate an appropriate keyword or image feature amount that uniquely determines a target scene, and a search can be performed even with a sloppy memory, so that even a beginner can easily understand. In addition, the related information superimposing means superimposes, on the position of the object in the reproduced video, the selected part or all of the relevant information of the object appearing in the video being reproduced, or the relevant information and the related information. Since the information is displayed in a form that clearly indicates that it corresponds to the information, it is possible to immediately and accurately know the information about the thing that appeared during the associative search without confusing the information about which thing. . Further, by providing the related information registration changing means, a part or all of the related information of the thing appearing in the video being reproduced can be registered or changed immediately on the spot where the thing appears.

また,現在画面に表示されている事物が,関連するシーンにジャンプするための情報を未だ付与されていない場合にも,表示画面から事物についての特徴量を抽出し,特徴量の照合を行う手段によって,その事物が現れている別のシーンをその場で検索して映し出すことができる。 Further, even when the information currently displayed on the screen has not yet been provided with information for jumping to a related scene, a feature amount of the object is extracted from the display screen and the feature amount is compared. Thus, another scene in which the object appears can be searched and projected on the spot.

本発明によれば,所望のシーンを探すときには,インデクス情報から特定しきれなくても,そのシーンに関係する何らかの手掛かりが現れているシーンさえ見つかれば,その手掛かりが現れるシーンを連想的に検索しながら最終的に所望のシーンが得られる,というように,それぞれの表示を融合的に用いた多面的な映像検索ができる。また,再生中の映像中の事物に関する情報を即座に,かつ,どの事物の情報なのか混同することなく正確に知ることができる。また,再生中の映像に現れている事物の関連情報の一部または全部の情報を,該事物が現れたその場で直ちに変更できる。また,本発明のモニタウインドウによれば,再生中のシーンの全映像の中での位置を常に監視することもでき,連想検索でシーンがジャンプしても,ワイプ等の特殊効果と相俟って,そのことが明示的にわかり,通常のシーン変わりと混同することがなくなる。また,重畳表示された関連情報の表示領域をポイントしても,事物をポイントしたのと同じ効果が得られるので,シーンごとに都合のよいポイントの方法を選ぶことができ操作性が向上する。また,表示する関連情報を一覧にすることで,キーを直接入力する手間が省け,またキーを忘れてしまった場合でも,メニューを見て思いだせる。以上のように,本発明によれば,使い勝手のよい連想検索が実現できる。 According to the present invention, when a desired scene is searched for, even if the scene cannot be completely identified from the index information, as long as a scene in which some clue related to the scene appears, the scene in which the clue appears can be searched associatively. However, a desired scene can be finally obtained, so that a multi-faceted video search using the respective displays can be performed. In addition, it is possible to immediately and accurately know information on an object in a video being reproduced without confusing which information the object is. In addition, part or all of the information related to the object appearing in the video being reproduced can be changed immediately at the moment the object appears. Further, according to the monitor window of the present invention, it is possible to constantly monitor the position of the scene being reproduced in the entire video, and even if the scene jumps in the associative search, it is combined with special effects such as wipe. Therefore, it is clearly understood that it is not confused with a normal scene change. In addition, even if the user points at the display area of the related information superimposed and displayed, the same effect as that obtained by pointing the object can be obtained. Therefore, a convenient point method can be selected for each scene, and the operability is improved. Also, by listing the related information to be displayed, the trouble of directly inputting the key can be omitted, and even if the key is forgotten, the menu can be recalled by recalling. As described above, according to the present invention, a user-friendly associative search can be realized.

以下,本発明の1実施例を詳細に説明する。 Hereinafter, one embodiment of the present invention will be described in detail.

図2は,本発明を実現するためのシステム構成例の概略ブロック図である。1はCRT等のディスプレイ装置であり,コンピュータ4の出力画面を表示する。12は,音声を再生するためのスピーカである。コンピュータ4に対する命令は,マウス等の間接的なポインティングデバイス5,タッチパネル等の直接的なポインティングデバイス13,あるいはキーボード11を使って行うことができる。10の映像再生装置は,光ディスクやビデオデッキ等の映像を再生するための装置である。映像再生装置10から出力される映像信号は,逐次,3の映像入力装置によってコンピュータ4の扱えるフォーマット形式に変換され,コンピュータ4に送られる。コンピュータ内部では,映像データは,インタフェース8を介してメモリ9に入り,メモリ9に格納されたプログラムに従って,CPU7によって処理される。10が扱う映像の各フレームには,映像の先頭から順に番号,例えばフレーム番号が付けられている。フレーム番号を制御線2によってコンピュータ4から映像再生装置10に送ることで,フレーム番号に対応する場面の映像が再生される。映像データや各種情報は,外部情報記憶装置6に格納することもできる。メモリ9にはプログラムの他に,以下に説明する処理によって作成される各種のデータが格納され,必要に応じて参照される。

FIG. 2 is a schematic block diagram of a system configuration example for realizing the present invention. A

以下では,まず連想検索システムの概要について説明し,次に各技術の詳細な実行手順について説明する。 Below, the outline of the associative search system is explained first, and then the detailed execution procedure of each technology is explained.

映像の連想検索を実現するシステムの画面例を図1に示す。1はディスプレイ装置であり,12は音声やBGM等を出力するスピーカ,5はマウスやジョイステイツク等の間接的なポインティングデバイス,11はキーボード,13はタッチパネルのような直接的なポインティングデバイスである。 FIG. 1 shows an example of a screen of a system for realizing an associative search for video. 1 is a display device, 12 is a speaker for outputting sound or BGM, 5 is an indirect pointing device such as a mouse or a joystick, 11 is a keyboard, and 13 is a direct pointing device such as a touch panel. .

ディスプレイ装置1中のモニタウインドウ1100は,モニタ画面になっており,VCRと同形式の操作パネル1102があって,映像を自由に再生し視聴することができる。モニタ画面に表示される映像が「本」における「本文」,パネル(ボタン)操作は「頁めくり」に対応する。右下のウインドウ1108は,対象とする映像の各シーンの代表画像のシーン一覧表示,右中のウインドウ1112は,その映像に登場する被写体の一覧表示である。これらの一覧表示を総称して,「インデクス」と呼ぶ。ウインドウ1108のシーン一覧表示は,映像中の各シーンから典型的なフレーム画像を選び,縮小して時間順にアイコン1110として一覧に並べたものである。これらの画像はシーンの「見出し」に相当するものとして考えることができ,それらを時系列に並べたシーン一覧は「本」の「

目次」にあたる。一方,被写体は,シーンの重要な構成要素の一つであり,その意味でテキストにおける「キーワード」に相当する。したがって,ウインドウ1112の被写体の一覧表示は,「索引」に当たる。シーン一覧表示中のアイコン1110がマウスクリックされると,モニタ画面の映像が切り替わり,そのアイコンの示すシーンが再生される。被写体の一覧表示は,被写体が何であるかを示すアイコン1114と,その右側の時間軸表示部(棒グラフ)1116から成る。時間軸表示部(棒グラフ)は,左端が映像の先頭,右端が末尾を示す時間軸になっていて,棒として表示された部分が,その被写体の現れている時間区間を示している。棒の部分をクリックすると,その区間の映像をモニタ画面に表示する。尚,1104は,マウスのようなポインティングデバイスの動きに合わせて移動するカーソル,1106のウインドウは,映像の各種関連情報を表示する汎用入出力ウインドウである。

A

Table of Contents ". On the other hand, the subject is one of the important components of the scene, and in that sense, corresponds to a “keyword” in the text. Therefore, the display of the list of subjects in the

次に,本発明にかかる連想検索の基本的な考え方をシンプルな例で説明する。あるユーザが一連の映像の中から被写体Bが出ている特定のシーンを見つけたいとする。インデクスに表示される代表画像のシーン一覧表示や被写体の一覧表示の中に目的のシーン(被写体Bが出ているシーン)や被写体Bそのもののアイコンが運よく存在すれば,それを直接クリックし,再生することにより所期の目的は達成される。しかし,通常,映像情報は膨大であり,容易に目的のシーンが見つけられないことが多い(例えば,映像中,被写体Bが出ている時間が短かければ,検索が簡単にできないことは容易に理解されよう)。そこで,本発明の連想検索が重要な意味を持ってくる。つまり,目的のシーン(被写体B)は直接探せなくとも,ユーザは目的のシーン(被写体B)に関する何らかの知識を持っていることが多く,本発明ではその知識を利用して連想という名のリンクを施すというものである。例えば,ユーザが,被写体Bと被写体Aが同時に現われていた(シーンがあったはずだ)ということを記憶しているか,若しくは同時に現われている可能性が高いという予測が成り立つと考えているならば,まず被写体Aを検索することを試みる。 Next, the basic concept of the associative search according to the present invention will be described with a simple example. Suppose that a user wants to find a specific scene in which a subject B appears in a series of videos. If the icon of the target scene (the scene in which the subject B appears) or the icon of the subject B exists luckily in the scene list display of the representative image displayed in the index or the list of the subjects, directly click the icon, The intended purpose is achieved by regeneration. However, usually, the video information is enormous, and it is often difficult to find the target scene easily (for example, if the time during which the subject B appears in the video is short, it is not easy to search for. Will be understood). Therefore, the associative search of the present invention has an important meaning. That is, even if the target scene (subject B) cannot be directly searched for, the user often has some knowledge about the target scene (subject B). In the present invention, a link named associative is used by using the knowledge. It is to apply. For example, if the user remembers that the subject B and the subject A appeared at the same time (there should have been a scene), or thinks that the prediction that the possibility that the subject B and the subject A appeared at the same time is high holds. First, an attempt is made to search for the subject A.

図3に本発明の映像の連想検索機能のイメージを示す。図中の3枚の絵(シーン1〜3)は,連想検索を行ったときに,モニタ画面に表示される映像中の1シーンをそれぞれ表したイラストである。例えば,ユーザは,インデクス(ウインドウ1112の被写体のアイコン1114)の中から目的の被写体Bを連想できる被写体Aが写っているシーンを1つ探してモニタ画面に表示する。モニタウインドウ1100のモニタ画面に最左側のシーン1が再生されているときに,登場している被写体A,Cのうちの被写体Aをマウスカーソルでクリックすると,その被写体Aが現れている図中中央のシーン2に画面が切り替わる。このシーン2に一緒に現れている別の被写体Bをクリックすれば,Bが現れている図中右側のシーン3に到達することができる。このシーンが目的のシーンであれば,連想検索は終了する。

FIG. 3 shows an image of the video associative search function of the present invention. The three pictures (

すなわち,被写体Bが出ている特定のシーンを見つける場合,被写体Bが被写体Aと同時に現れるという連想を基に,インデクスに登録されている被写体Aを通して連想的に目的のシーンである被写体Bの特定のシーンまで辿ることができる。このとき,キーワードを考えるといった面倒な操作は不要であり,画面に現れる情報だけを見て,ただ取捨選択すればよい。 That is, when finding a specific scene in which the subject B appears, based on the association that the subject B appears at the same time as the subject A, the identification of the subject B as the target scene is associatively performed through the subject A registered in the index. Can be traced to the scene. At this time, a troublesome operation such as thinking of a keyword is not necessary, and only the information appearing on the screen should be looked at and a selection can be made.

尚,後述するように単に複数の被写体間の連想に限らず,シーン自体や言葉,BGM,字幕といった,映像のあらゆるマルチメディア情報に基づいた連想を用いて検索を行なうことが可能である。 Note that, as will be described later, it is possible to perform a search using not only an association between a plurality of subjects but also an association based on all multimedia information of a video, such as a scene itself, words, BGM, and subtitles.

さて,こうした連想検索の機能を実現するのに必要となる情報は,基本的に,(1)被写体の現れている映像区間(出現区間),(2)被写体の画面上での位置(出現位置),(3)クリックされたときに切り替わるべき他の映像区間(リンク情報)の3つである。これら3つの情報は組にして扱われる。 By the way, information necessary for realizing such an associative search function is basically composed of (1) a video section (appearance section) where the subject appears, and (2) a position of the subject on the screen (appearance position). ), (3) Other video sections (link information) to be switched when clicked. These three pieces of information are handled as a set.

映像再生中にどの被写体がクリックされたかは,(1),(2)の出現区間・出現位置情報から判定され,同じ組に格納された(3)のリンク情報から映像の切り替え先が決定される。ここで,映像は,フレームと呼ばれる静止画が毎秒30枚の割合で連続的に表示されることによって実現されている。これらのフレームに,映像の先頭から順にフレーム番号と呼ばれる連続番号を割り振れば,(1)の出現区間は,その区間の先頭のフレーム番号と末尾のフレーム番号とで表現することができる。(2)の出現位置は,(1)の区間中の各フレームのどの領域に被写体が映されているのかを表す座標情報である。(3)のリンク情報としては,同じ被写体が現れている別のシーンを次々と巡れるようなリンクを施しておく。1本の映像中には,同じ被写体が何度も現れることが多いが,このリンクにより,その被写体が登場する全てのシーンをクリックだけで簡単に呼び出すことができる。 Which subject is clicked during video playback is determined from the appearance section / appearance position information of (1) and (2), and the video switching destination is determined from the link information of (3) stored in the same set. You. Here, the video is realized by continuously displaying still images called frames at a rate of 30 frames per second. If a serial number called a frame number is sequentially assigned to these frames from the beginning of the video, the appearance section of (1) can be represented by the first frame number and the last frame number of the section. The appearance position (2) is coordinate information indicating in which region of each frame in the section (1) the subject is displayed. As the link information of (3), a link is provided so that another scene in which the same subject appears can be cycled one after another. The same subject often appears many times in one video, but with this link, all scenes in which the subject appears can be easily called by just clicking.

上述の構成による連想検索方法は,すでにリンク情報が設定されている被写体にしか用いることができない。しかし,先に挙げた連想検索に必要な3種の情報のうち,被写体の出現区間と出現位置は,例えば,発明者らによる特願平4−261033等の被写体自動検索技術により求めることができる。 (4) The associative search method with the above configuration can be used only for a subject for which link information has already been set. However, among the three types of information necessary for the associative search described above, the appearance section and the appearance position of the subject can be obtained by, for example, an automatic subject search technology such as Japanese Patent Application No. 4-261333 by the inventors. .

被写体自動検索アルゴリズムの概略を図4に示す。探そうとする被写体に固有の色の組み合わせをフレーム中から見つけ出すのが基本である。まずユーザがビデオ映像中からその被写体が現れているフレームを例示画像として一枚だけ選び,その画像中から特徴的な色を抽出する。その後,システムは映像中の全てのフレームについて一枚一枚小さなブロックに分割し,特徴色を含むブロックを探していく。1枚のフレーム中に,特徴色を含むブロックが各色について一定数以上あれば,そのフレームにその被写体があると判定する。フレームにおけるその被写体の出現位置は,上述の被写体検索の処理において,その被写体の特徴色を含むブロックがフレーム中のどの位置に分布しているかを調べることで容易に求められる。 FIG. 4 shows an outline of the subject automatic search algorithm. Basically, a color combination unique to a subject to be searched is found in a frame. First, the user selects only one frame in which the subject appears from the video image as an example image, and extracts a characteristic color from the image. After that, the system divides every frame in the video into smaller blocks one by one, and searches for blocks containing characteristic colors. If the number of blocks including the characteristic color is more than a certain number for each color in one frame, it is determined that the subject exists in that frame. The appearance position of the subject in the frame can be easily obtained by examining where in the frame the block including the characteristic color of the subject is distributed in the above-described subject search processing.

しかし,この被写体検索方法そのものは,例示画像をシステムに提示することを原則とし,探したい被写体が現れている区間を最低1つは手作業によって見つける必要があり,これが面倒な場合が多い。しかし,本発明のような連想検索の場合には,モニタ画面上の被写体を例示画像として直ちに利用することができるため,この被写体検索方法を非常に効果的に活用できる。 However, this subject search method itself basically presents an example image to the system, and it is necessary to manually find at least one section in which the subject to be searched appears, which is often troublesome. However, in the case of the associative search as in the present invention, the subject on the monitor screen can be used immediately as an example image, so that the subject search method can be used very effectively.

更に,映像中の全てのフレームについて,あらかじめブロック分割し,各ブロックごとに含まれる色の種類のリストを記憶装置に格納しておけば,上記被写体検索から毎フレームごとのブロック分割処理が不要になり非常に高速になる。その速度は,現行のワークステーション程度の性能でもリアルタイムの100倍速が可能となっており,1時間の映像の中から30秒程度で全ての被写体出現区間を見つけることができる。現在表示されている映像から最も近い出現区間を1つだけ探せばよいのであれば,平均して数秒程度で見つけることができる。当然ながら,記憶装置に格納された色のリストは,検索する被写体に関わらず同じものを使うことができる。 Furthermore, if all frames in the video are divided into blocks in advance and a list of the types of colors included in each block is stored in the storage device, the above-described subject search eliminates the need for the block division processing for each frame. Become very fast. The speed is 100 times faster than real-time performance even with the performance of the current workstation, and all the object appearing sections can be found in about 30 seconds from a one-hour video. If only one nearest appearing section needs to be searched from the currently displayed video, it can be found in about several seconds on average. Of course, the same color list stored in the storage device can be used regardless of the subject to be searched.

以下では,本発明を実現するシステムの実行手順を,メモリ9に格納されたプログラムに従ってCPU7により実行されるソフトウエアモジュールのブロック図を用いて説明する。ここで説明する各モジュールは,ハードウエア自体で実現することも可能である。

In the following, an execution procedure of the system for realizing the present invention will be described with reference to a block diagram of a software module executed by the

図5は,本発明によるシーンの連想検索を実現するための処理ブロック図の一例である。連想検索の手掛かりとなる映像中の被写体などの事物が,映像中のどの時間にどの位置に現れるかの情報(出現区間,出現位置),並びにその関連情報・飛び先となるシーンの情報(リンク情報)は,後述するオブジェクトと呼ぶデータ構造体の形式で,あらかじめ図2のメモリ9もしくは外部情報記憶装置6に蓄積されているものとする。

FIG. 5 is an example of a processing block diagram for realizing a scene associative search according to the present invention. Information (at what time and in what position in the video an object such as a subject appears in the video as a clue for the associative search), as well as its related information and information on the scene to jump to (link) Information) is stored in advance in the memory 9 or the external

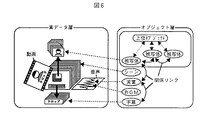

ここで,映像中の被写体などの事物に関する情報は,出現区間ごとに1つずつ作成されるオブジェクト指向型のデータ構造体の中で管理している。図6は,その概念を表す説明図である。これを,以下,映像オブジェクト,もしくは単にオブジェクトと呼ぶ。映像は動画部分と音声部分とに分けられるが,動画については,その全体をフレーム画像を成すxy平面,および時間tの軸からなる3次元空間で表現でき,被写体の出現区間と出現位置は,その部分空間であると考えることができる。この部分空間と1対1に対応づけられるデータ構造体として映像オブジェクトを定義する。(つまり,同一被写体であっても,原則として出現区間ごとにそれぞれの映像オブジェクトとして定義され,それらの映像オブジェクト間(被写体間)にはリンクが施される。)映像オブジェクトには,被写体をは

じめ,字幕やシーンなど映像中の様々な情報を対応づけることができる。言葉やBGMといった音声情報についても,同様に時間軸を持つ音声情報空間の任意の部

分区間と1対1に対応づけられるデータ構造体として映像オブジェクトを定義できる。そして,リンク情報は,映像オブジェクトを相互に参照しあうポインタとして格納する。このように,動画・音声間など,対応するメディアが異なっても共通のデータ構造体の枠組みで管理することで,映像中のあらゆる情報の間に自由にリンクを設定することができる。

Here, information on an object such as a subject in a video is managed in an object-oriented data structure created one by one for each appearance section. FIG. 6 is an explanatory diagram showing the concept. This is hereinafter referred to as a video object or simply an object. The video is divided into a moving image part and an audio part, and the whole moving image can be represented by a three-dimensional space composed of an xy plane forming a frame image and an axis of time t. It can be considered that subspace. A video object is defined as a data structure associated with this subspace on a one-to-one basis. (In other words, even if the subject is the same, in principle, it is defined as a video object for each appearance section, and a link is provided between the video objects (between the subjects).) Various information in the video such as subtitles and scenes can be associated. Similarly, for audio information such as words and BGM, a video object can be defined as a data structure that is associated one-to-one with any partial section of the audio information space having a time axis. Then, the link information is stored as a pointer that mutually references the video object. In this way, even if the corresponding media, such as between moving images and audio, is different, the link can be set freely between all pieces of information in the video by managing them using the common data structure framework.

さて,図5に戻って,処理ブロック図を詳細に説明する。オブジェクト管理部120は,これらオブジェクトを管理するモジュールであり,オブジェクトの登録・変更・削除の処理を行うとともに,他のモジュールから要求があれば,示された条件に合致するオブジェクトの情報122を取り出し,そのモジュールに提示する。100の映像再生表示部は,図1のディスプレイ装置1のモニタ画面であるモニタウインドウ1100に,映像の再生及び表示処理を行うとともに,現在表示している映像の再生位置情報218を102のポイント事物識別部に送る。ポイント位置検出部104は,図1のマウス等の間接的なポインティングデバイス5やタッチパネルのような直接的なポインティングデバイス13を常時監視し,ユーザがポイントの動作を行った表示画面上の位置情報112をポイント事物識別部102に送る。また,併せてその位置情報112はインデクス管理部108,操作パネル部110にも送られる。ポイント事物識別部102は,映像再生表示部100から受け取った再生位置情報218をオブジェクト管理部120に送り,その再生位置に出現しているとして登録されている全ての事物の情報をオブジェクトとして得る。もし該当するオブジェクトがあれば,さらにそれらから事物の位置情報を取得して,ポイント位置検出部104からの位置情報112との照合を行い,どの事物がポイントされたのかを識別する。ポイント事物識別部102は,識別された事物に関する情報114を映像制御部106に送る。映像制御部106は,識別された事物に関する情報114の中でリンク情報に基づき,その事物が現れている別のシーンにジャンプする等の処理を行うため,映像再生表示部100に制御情報208を送る。また,後述するように,事物の関連情報を表示する際には制御情報210を映像再生表示部100に送る。108のインデクス管理部は,登録されている映像の代表的なフレーム画像をアイコン1110として記憶するとともに,それらのアイコンの一覧にしてウインドウ1108に表示する。インデクス管理部108はアイコン1110と一緒にそのフレーム番号も記憶しており,ポイント位置検出部104が,あるアイコンをポイントしていることを検出すると,そのアイコンに対応するシーンを再生するように,制御情報116を映像制御部106に伝える。また,ポイント事物識別部102から,どの事物がポイントされたかの情報124をもらい,その事物がポイントされたことがインデクスからもわかるような表示を行う。また,インデクス管理部108は,図1のウインドウ1112の被写体の一覧表示も管理する。つまり,被写体が何であるかを示すアイコン1114を表示すると共に,その被写体の時間軸表示(棒グラフ表示)を行ない,棒の部分がクリックされるとその区間の映像を再生するように制御情報116を映像制御部106に送る。操作パネル部110は,再生・早送り・巻戻し等の各種再生状態を表す図1の操作パネル1102を表示し,ポイント位置検出部104によって,その操作パネルがポイントされていることが検出されると,ポイントされた操作パネルに対応する再生状態にするよう制御情報118を映像制御部106に送る。

Now, returning to FIG. 5, the processing block diagram will be described in detail. The object management unit 120 is a module for managing these objects. The object management unit 120 performs registration, change, and deletion processing of the objects, and, when requested by another module, extracts object

図7は,映像再生表示部100をより詳しく示した処理ブロック図の一例である。200の映像再生部は,映像制御部106から送られる制御情報208によって,どの映像をどこからどのように再生するか等の指示を受けて映像を再生する。現在表示されている映像の再生位置情報212は,逐次事物有無判定部202に送られる。202は,その再生位置の映像に,あらかじめ登録されている事物が登場しているかどうかをチェックし,あれば,登場している全ての事物の表示画面上での位置情報216を取得して,関連情報表示部204に送る。この位置情報216は,先述のポイント事物識別部102で取得する位置情報と同じものであり,位置情報取得処理の重複を避けるため,事物情報218としてポイント事物識別部102に送ることができる。関連情報表示部204は,再生中の各事物の関連情報を画面上に合わせて表示することができる。制御情報210により,関連情報を表示するのか否か,表示するのならどの関連情報をどのような形態で表示するのか等が決定される。特に,事物の位置情報216によって,表示中のどの位置と対応する情報なのかを明示することができる。この表示方法については後述する。表示方法によっては,映像214に重畳合成処理を行い,その映像を映像表示部206で表示する。

FIG. 7 is an example of a processing block diagram showing the video playback /

図8は,映像オブジェクトのデータ構造を示す一例である。500はデータ構造体の大枠である。502は,オブジェクトのID番号で,他のオブジェクトと識別するための一意な数が与えられる。504は,オブジェクトが,例えば,人を表すのか,字幕であるのか,あるいは音声なのかを示す分類コードである。506は,そのオブジェクトが登場する映像へのポインタである。この例では,後述するように,映像は物理映像600と論理映像900の2階層に分けたデータ構造になっており,506は,物理映像へのポインタである。510は,オブジェクトが表す映像中の事物が登場する区間の始点のフレーム番号,512は終点のフレーム番号である。508は,その事物を代表する映像のフレーム番号であり,オブジェクトを視覚的に扱うインタフェースの下においては,この事物を表すアイコンの絵柄として用いられる。514は,オブジェクトの表す事物の画面上での位置を示すための構造体700へのポインタである。

FIG. 8 is an example showing the data structure of a video object. 500 is a frame of a data structure.

図9に,オブジェクト位置構造体700の一例を示す。この構造体は,事物の動きがないか,あるいは十分小さい区間ごとに1つずつ作成され,それらが数珠つなぎになった連接リストの形をとる。702は,その動きのない区間の始点フレーム番号,704が終点フレーム番号である。706から712は,事物を矩形領域で囲んだときの矩形領域の原点座標と大きさである。516は,より抽象度の高い上位のオブジェクトへのポインタである。全てのオブジェクトは固有の関連情報を持つことができるが,幾つかのオブジェクトで関連情報を共有したほうが都合のいい場合がある。例えば,映像中の人や物などの被写体は,同じ被写体が複数のシーンで現れることが多い。もちろん,現れたときの姿や挙動は各シーンごとに違うため,各シーンごとに固有の関連情報が存在するが,名前であるとか,性別・年齢・職業といった抽象度の高い情報は共有したほうがデータ量が少なくて済み,また,情報が更新されたときにも整合性に破綻をきたすことがない。その意味で,こうした抽象度の高い情報は,より上位のオブジェクトの関連情報にもたせ,そのオブジェクトへのポインタを516に持つデータ構造としている。518は,上位のオブジェクトから下位のオブジェクトを参照するためのポインタである。これは,上位のオブジェクトも下位のオブジェクトも同じ500のデータ構造体を用いるためによる。もちろん,上位のオブジェクトには,始点・終点フレームや位置情報等の映像に直接関係する情報は不要であるので,それらを省いた簡略版の構造体を用いることもできる。

FIG. 9 shows an example of the

520は,事物の関連情報を記憶するディクショナリ800へのポインタである。ディクショナリは,図10に示されるように,関連情報を呼び出すためのキーとなる文字列804へのポインタであるキー802と,そのキー文字列に対応づけて登録する関連情報の文字列808へのポインタである内容806,及び関連するオブジェクトへのポインタを持つリンク810から構成され,登録する関連情報の項目数だけ作られ,それらが数珠つなぎになった連接リスト形式をとる。オブジェクトの関連情報の読み出しは,キーを指定して,そのキーと合致するディクショナリ構造体の内容を返すことで行う。例えば,キーが「名前」で内容が「太郎」の場合には,「名前」というキーを指定すると「太郎」という関連情報が得られる。関連情報表示部204では,どの関連情報を表示するかの選択は

,どのキーに対応する内容を表示するかという処理に帰着する。リンクは,連想検索を行うときのジャンプ先の事物へのポインタであり,内容806には,例えば,「他のシーンに現れている同じ被写体」といったリンクの意味を表す文字列あるいは記号が入り,リンク先810には,その被写体のオブジェクトへのポインタが入る。連想検索でジャンプするときには,映像制御部106は,このオブジェクトの構造体から,その被写体が現れている映像と先頭フレーム番号を読み出して,その映像位置から再生するように映像再生部200を制御する。

図11は,映像再生部200のより詳しい処理ブロック図である。映像は,論理映像と物理映像の2階層構造になっている。論理映像はシーンの集合体としての構造情報だけを持ち,物理映像は映像の実データを持つ。論理映像呼出部300は,映像制御部から送られる再生位置設定情報310から,論理映像のライブラリ304から合致する論理映像を呼び出す。

FIG. 11 is a more detailed processing block diagram of the

図12に論理映像のデータ構造体900の一例を示す。902は,論理映像を一意に特定するID番号である。904は,論理映像を代表するシーンの番号である。906は,構成シーンを表す連接リストで,シーン1000が再生されるべき順番に連なっている。908は,シーン間のデゾルブやワイプといった特殊効果の設定情報である。910には,各種関連情報が入る。

FIG. 12 shows an example of the

図13に,シーン構造体1000の一例を示す。1002がシーンの代表フレーム番号で,1004が始点,1006が終点のフレーム番号である。対応する物理映像へのポインタが1008に入る。1010には,このシーンの中に登場する全ての事物のデータ構造体,すなわちオブジェクトへのポインタが連接リスト形式で入る。シーンは,その映像内容のつながりを単位にまとめることができ,ピラミッド状の階層的な管理を行うことができる。1012の上位シーンは,そうした上位のシーンへのポインタであり,1014の下位シーンは,1段下位にある全てのシーンを連接リストにしたものへのポインタである。1016はシーンの属性情報である。物理映像呼出部302は,フレーム番号に300でシーン情報が加わった情報312によって,物理映像のライブラリ308から呼び出す物理映像と再生するフレーム位置を決定する。

FIG. 13 shows an example of the

図14は,物理映像構造体600の一例である。602は,物理映像を一意に特定するID番号である。604は,レーザーディスクの映像なのか,ビデオテープのものか,あるいは外部情報記憶装置に格納されたデータなのかを識別するための分類コードである。606は代表フレーム番号,608が始点,610が終点フレーム番号である。616には属性情報が入る。他は,映像データが物理映像のデータ構造体の中に持っている場合に必要となる情報である。612が映像の画面幅,614が同高さであり,618は,あるフレーム番号に対応するフレーム画像データが,物理映像のどのアドレスから存在するかを記憶したディレクトリである。620はフレーム番号,622にフレームの画素データ,624に音声データという形式がフレーム数だけ繰り返される。物理映像呼出部は,分類コードにより,レーザディスク等の映像再生装置10を用いる映像であるとわかれば,映像再生装置に制御命令を送って該当する映像を呼び出す処理を行い,物理映像中にある場合には,該当する映像を呼び出す。

FIG. 14 shows an example of the

論理映像を用いるメリットの一つは,大きなデータ量になりがちな物理映像の1本から,その映像を用い,様々に編集された多種多様の映像作品を少ないデータ量で作れることにある。特に,ニュースなど過去の資料映像を頻繁に使い回すような映像ほど,論理映像を用いる利点が大きい。もう一つのメリットは,シーンごとに登場するオブジェクトをあらかじめ記憶しておくことにより,映像再生中にどの事物が現れているのかを,全てのオブジェクトについて調べる必要がなくなり,迅速な処理が期待できる。 One of the merits of using logical video is that from one physical video that tends to have a large amount of data, a wide variety of video works edited in various ways can be created with a small amount of data using the video. In particular, the advantage of using a logical image is greater for an image that frequently uses past material images such as news. Another advantage is that by storing objects appearing for each scene in advance, it is not necessary to check which objects appear during video reproduction for all objects, and rapid processing can be expected.

先に簡単に説明した図1のコンピュータ画面例を用いて,連想検索のインタフェース部分の実行手順について詳細に説明する。モニタウインドウ1100には

,前述の映像再生表示部100により任意の映像が表示される。表示と合わせ,音声もスピーカ12から出力される。1104がカーソルで,マウスやジョイスティク等の間接的なポインティングデバイス5の操作に合わせて画面上を移動しポイント操作を行う。同様のポイント操作はタッチパネルのような直接的なポイティングデバイス13によっても行うことができ,その際はカーソルは不要にできる。前述のポイント位置検出部104は,これらのポインティングデバイスを常時監視し,マウスの移動に合わせてカーソル1104を移動したり,マウスのボタンが押されたときには,ポイント操作があったとして,そのときの画面上のカーソルの位置情報を,その位置情報を必要とする各処理モジュールに送る。タッチパネルの場合には,タッチがあった時点で,そのタッチされた位置を検出し

,その位置情報を送る。1102は,映像の再生状態を制御するための操作パネルであり,操作パネル部110によって,再生・早送りなどの再生状態を示す絵や文字が描かれたボタンと,モードを変更するためのボタン,映像再生表示部からの各種情報を表示するためのディスプレイ領域などが表示される。操作パネルの表示領域がポイントされたことが,ポイント位置検出部104から伝えられると,その位置情報から,さらにどのボタンがポイントされたかを検出し,そのボタンに対応づけられた制御コードが映像再生表示部100に送られる。1106は,汎用入出力ウインドウで,キーボード11等を使って各種情報をコンピュータとやりとりできる。ファイル名を入力することで,連想検索を行う映像の指定をこのウインドウから行うことができる。入力されたファイル名は,再生開始位置を示す先頭フレームの番号と一緒に再生位置設定情報310として映像再生表示部100に送られ,100の中の論理映像呼出部300は,その情報から対応する映像を呼び出し,物理映像呼出部を経由して映像がモニタウインドウ1100に表示される。また,映像の各種関連情報をこの汎用入出力ウインドウ1106に表示することもできる。

The execution procedure of the associative search interface will be described in detail with reference to the computer screen example of FIG. 1 briefly described above. An arbitrary image is displayed on the

ウインドウ1108に表示中のアイコン1110の一つがポイントされたことがポイント位置検出部によって検出されると,インデクス管理部108は,そのアイコンに対応するシーンの先頭フレーム番号を再生位置設定情報として映像再生表示部100に伝える。100は,モニタウインドウ1100にそのシーンの映像を表示する。表示された映像は,1102の操作パネルによって再生や早送りなどの制御ができる。これにより映像の再生が開始されると,論理映像呼出部300が出力する再生位置情報314が,インデクス管理部108に伝えられ,108は,1108のウインドウにおいて,例えば,再生中のシーンのアイコンがハイライトしたり点滅するといった強調表示を行い,現在モニタウインドウ1100で再生されている映像に対応するシーンが一目でわかるようにする。

When the point position detection unit detects that one of the

1108におけるシーンの表示は階層的に行うことができる。まず,ポイントのしかたを,例えば,クリックとダブルクリックとの2種類用意し,クリックを上述の映像呼び出しのためのポイント手段として,ダブルクリックを後述するシーンの階層管理のためのポイント手段に用いる。1108に表示されたアイコンの一つがポイントされたことがポイント位置検出部によって検出されると,インデクス管理部108は,それがダブルクリックかどうかを調べる。ダブルクリックでなければ,上述の映像呼び出しの処理を行い,ダブルクリックならば,ポイントされたシーンに対応するシーン構造体1000の中の下位シーン1014を参照し,1108と同様のウインドウを新たに作成して,それら下位シーンのアイコンを一覧表示する。こうして新たに作成されたウインドウは,1108と同様にポイントを検出する対象となり,このウインドウ上のアイコンがポイントされると,インデクス管理部は,対応するシーンをモニタウインドウに表示したり,さらに下位のシーンがあれば,それら下位のシーンの一覧表示を行うウインドウを新たに作成する。こうした階層的な管理は,映像の選択の際にも用いることができ,1本の映像ごとに,その全てのシーンを束ねる最上位のシーン1個を対応づけておけば,上記の枠組みの範疇で,登録されている映像の中から所望の映像をウインドウから選択したり,さらに下位のシーンの一覧を表示させたりすることができる。

The display of the scene in # 1108 can be performed hierarchically. First, two types of points, for example, a click and a double click, are prepared, and the click is used as a point means for calling the above-mentioned image, and the double click is used as a point means for hierarchical management of a scene described later. When the point position detection unit detects that one of the icons displayed in 1108 is pointed, the

1112は,アイコン1114と時間軸表示部1116からなり,例えば,別々のシーンに現れているが実は同じ被写体である,などといった基準で分類された幾つかの事物をまとめ,代表する一つのアイコン1114を表示して,その横に,映像全体の中でそれらの事物が登場する区間を,横軸を時間軸にとった棒グラフで表示したインデクスである。同じ分類の事物は各々オブジェクト構造体500で管理されており,共通のオブジェクト構造体へのポインタを上位オブジェクト516に持つ。逆に上位オブジェクトは,各事物のオブジェクト構造体へのポインタを下位オブジェクト518に連接リスト形式で持つ。インデクス管理部108は,上位オブジェクトを記憶管理する。アイコンとして表示されるのは,上位オブジェクトの構造体が記憶する代表フレームの縮小画像である。棒グラフは,下位オブジェクトの各々を調べ,その始点・終点フレーム番号から映像全体に占める区間を計算して描画する。この棒グラフにおける事物の登場区間に対応する部分がポイントされたことが検出されると,インデクス管理部108は,その部分の映像をモニタウインドウ1100に表示させる。アイコンをポイントしてオブジェクトを選択し関連情報を付与・変更すれば,上位オブジェクトの関連情報として,すなわち,同じ分類の全ての事物に共通の情報として登録される。

An

一方,モニタウインドウ1100がポイントされたことが検出されると,そのポイント位置の情報から,ポイント事物識別部102によって,映像中のどの事物がポイントされたかを検出する。この処理は,現在再生中のシーンがどれであるかを示す再生位置情報314を論理映像呼出部300から受け,そのシーンに対応するシーン構造体の対応オブジェクト1010に記憶されているオブジェクトのそれぞれについて,その始点・終点を調べて,現在再生中のフレーム番号を示す再生位置情報316と比較し,そのオブジェクトで表される事物が現在画面上に現れているのかどうかを判定する。現れていると判定された事物の各々について,事物の位置,すなわちオブジェクトの位置514と再生位置情報316とから,現在の事物の存在領域を求め,その中にポイントされた位置が含まれているかどうかを判定する。複数合致した場合には,優先順位の高いものを1つだけ選択する。優先順位は,例えば,連接リストの登録順で表現できる。この方法だと,優先順位のために特別なデータ領域を用意する必要がない。ポイントされたと判定された事物がある場合には,その事物のオブジェクト構造体中のオブジェクト属性情報520を調べて,「連想検索のジャンプ先」を意味するキーを持つディクショナリ構造体800を探し,リンク810に登録されたオブジェクトの始点フレーム番号を読みだして,そのフレームにジャンプする。オブジェクト属性情報520に該当するキーがないときには,共通の上位オブジェクトを持つ別の事物が登場しているシーンにジャンプするようにする。これは,ポイントされた事物の1ランク上位のオブジェクトに登録されている下位オブジェクトの連接リストを参照し,その事物に連接する次のオブジェクトの始点フレーム番号を読みだして,そのフレームにジャンプする。

On the other hand, when it is detected that the

以上のように,階層的にシーンを探して当りをつけてから映像をモニタウインドウで確認し,連想検索を行い,またインデクスウインドウで確認するといったことが可能になる。これは,シーンによって構成された論理映像による映像管理手段を導入したことによって達成されている。 As described above, it is possible to hierarchically search for a scene and hit it, then check the video on the monitor window, perform an associative search, and check on the index window. This is achieved by introducing video management means using a logical video composed of scenes.

図15に,モニタウインドウ1100の詳細な画面例を示す。1200が実際に映像が表示される領域で,1202は,映像再生部200から送られる再生中のフレーム番号を表示する。フレーム番号を表示している部分は,数値入力部を兼ねており,キーボード等によって数字を修正すると,修正された数字を新たなフレーム番号と見做して,その番号に対応するシーンから映像を再生することができる。1204は,映像全体中で,現在どの部分を再生しているのかを表示するためのインジケータパネルである。このパネル上のどの位置に指示棒1206があるかによって,再生位置を示す。指示棒の位置は,上述のフレーム番号と,再生中の論理映像の構造体データから計算される。1208の縦棒は,シーンの変わり目を表す線であり,これによって,どのシーンが再生されているのかも直感的に知ることができる。このパネルによって,連想検索によってジャンプしたことが指示棒1206の大きな移動によって明確に知ることができ,映像の中で自然にシーンが変わっただけなのか区別がつかないといった混乱がなくなる。ポイント位置検出部が指示棒1206がポイントされ,ドラッグ操作によって強制的に動かされた場合,操作パネル部110は,ポイント位置検出部104によって得られる移動後確定した位置情報を使って,その位置に対応するシーンとフレーム番号が計算され,その位置に対応する映像部分から再生するように,映像制御部106にこの情報を伝えることができる。1210は,このモニタウインドウを閉じる場合のボタンである。

FIG. 15 shows a detailed screen example of the

図16は,音声にマッピングされたオブジェクトがある場合の映像表示画面の例である。音声は目で見えない情報であるので,ボタン1400及び1402の形で可視化している。音声かどうかの判定は,事物有無判定部202が,オブジェクト分類コード504を調べることで行える。202は,現在再生中のシーンとフレームの情報を用い,どのオブジェクトが現れているかをチェックするとき,現れているオブジェクトの分類コードが音声のものであれば,ボタンを表示する。ボタンの表示位置は,オブジェクトの位置514に登録される。これにより,ポイント事物識別部の処理に変更を加えることなく,このボタンをポイントすることにより,その音声に関連するシーンにジャンプすることができる。ボタンは現在再生中の音声にマッピングされたオブジェクトの種類だけ表示され,ボタン面のタイトルで区別される。

FIG. 16 is an example of a video display screen when there is an object mapped to audio. Since the voice is invisible information, it is visualized in the form of

図17の(a)〜(c)は,連想検索で別のシーンにジャンプするときの表示画面例である。画面上の事物がポイントされると,映像再生表示部100は,映像中の通常のシーンの変わり目と区別がつきやすいように特殊効果を加えた変化をするようにする。例えば,ポイントされた事物の領域の重心から,飛び先のシーンの縮小された映像がみるみる大きくなるようなシーンの変わり方をさせる。これにより,どの事物がポイントされたのかもすぐにわかる。

(A) to (c) of FIG. 17 are examples of display screens when jumping to another scene by associative search. When an object on the screen is pointed, the video playback /

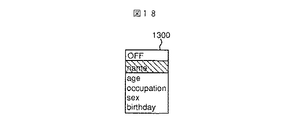

ところで,図15における1212は,事物の関連情報を表示するかどうかを決めるためのボタンである。このボタンをポイントすると,例えば,図18に示す1300のようなメニューが現れる。このメニューには,関連情報を表示をしなくするOFFのほか,現在表示可能な関連情報の種類が表示される。ユーザは,このメニューの中から見たい関連情報の種類を選ぶことができる。この情報は,映像制御部106を通じて,制御信号210として映像再生表示部100の関連情報表示部204に伝えられ,関連情報を表示するのか,するならば,どのキーに対応する情報なのかが決定される。このメニューは1本の映像ごとに作られて,その映像について登録されている全てのオブジェクト構造体500におけるオブジェクト属性情報520のディクショナリ全てのキーを調べ,全種類をメニューに載せている。1214は,モードを変更するためのボタンで,連想検索のモード,関連情報を変更するモードなどを切り替えることができる。これによって,ポイント事物識別部102の内部状態を変化させ,ポイント位置検出部からポイントが伝えられたときの対応処理が各内部状態に応じたものにする。

{Circle around (2)} 1212 is a button for determining whether or not to display the related information of the thing. When this button is pointed, a menu such as 1300 shown in FIG. 18 appears. In this menu, the type of related information that can be displayed at present is displayed in addition to OFF for not displaying the related information. The user can select the type of related information to be viewed from this menu. This information is transmitted as a

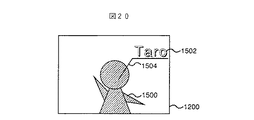

図19は,関連情報を表示する画面の一例である。映像中の事物1500とその関連情報1502との関係が一目でわかるように,事物の上に重畳するように関連情報を表示する。事物有無判定部202が,前述した手順で現在現れている事物を確定したとき,それらの事物についてオブジェクトの位置514を読みだし,その位置情報から重心を求め,また,関連情報の表示に必要となる領域の重心を求めて,その重心が一致するように関連情報の表示位置を定める。但し,複数の事物が密に接している場合には,相互にオフセットをかけて1502の表示が重ならないようにする。関連情報1502は図のようなテキストに限定されるものではなく,アイコンなどの画像であっても一向に構わない。また,連想検索時には,ポイント事物識別部102が,関連情報1502の表示領域をポイントすることでも,対応する事物がポイントされたと識別できるようにし,別のシーンにジャンプできるようにする。これは,一つの事物につき,2つの位置情報を持たせ,そのORで判定することで行う。また,図20に示すように,関連情報1502と事物1500の間を連結線1504で結ぶことでも対応づけのわかりやすい表示を行うことができる。特に,関連情報1502の表示位置を固定にしておき,連結線だけを事物の動きに合わせて変化させることで,事物の動きが激しく事物をポイントすることが困難な場合でも,固定している1502をポイントすることで容易に連想検索を行うことができる。

FIG. 19 shows an example of a screen for displaying related information. The related information is displayed so as to be superimposed on the thing so that the relationship between the

システムの内部状態が関連情報変更モードのときには,図21に示すように,表示されている関連情報のテキスト1502をポイントすると文字修正カーソル1506が現れ,キーボード等を使って,その場で直ちに変更することができる。表示された情報が上位のオブジェクトに格納されている関連情報であれば,この変更により,同じ上位オブジェクトを共有する全ての事物について一斉に関連情報が更新されることになる。表示されている以外の関連情報を変更するときには,図22に示すような関連情報変更ウインドウ1600が現れる。1602は,関連情報のキーのリストである。このリスト中には,その事物の関連情報のほか,その上位オブジェクトの関連情報もある。1604のボタンをポイントすると,文字入力ウインドウが現れて,そこに新しいキーを入力すると登録されて1602のリストに登録される。1602のリストに表示されているキーはポイントによって選択でき,選択されると強調表示される。この状態で,1608の文字入力領域に何か入力すると,それが,その選択されたキーに対応する関連情報として登録される。1606は,キーを抹消するためのボタンで,キーを選択した状態で1606をポイントすると,そのキーに対応する関連情報ごと登録抹消される。1610は,このようにして行った変更を受容して完了する場合にポイントするボタンで,1612は,変更を全てキャンセルして取りやめる場合にポイントするボタンである。

When the internal state of the system is in the related information change mode, as shown in FIG. 21, when the user points to the displayed

また,システムの内部状態が事物複写モードのときには,再生中の映像に現れた事物を複写して,他の映像に貼り付けるといったことも動画間・音声間のそれぞれで可能である。複写は,ポイントされた事物のオブジェクトの構造体をそっくり複製することによって行う。複写されたオブジェクトは,上位オブジェクトを共有し,また,その上位のオブジェクトの下位オブジェクトとして追加される。貼り付けについては,映像中の事物は映像情報の部分空間と対応づけられているので,貼り付け先の映像情報の同じ形状の部分空間と置換することで行える。そして,この複写・貼り付けは,関連情報も合わせて複写・貼り付けが行えるので,関連情報に関する作業量はほとんどない。 と き に は Also, when the internal state of the system is in the object copy mode, it is possible to copy the object that appears in the video being played back and paste it into another video between the moving image and the audio. Copying is performed by duplicating the entire structure of the object of the pointed object. The copied object shares the higher-level object and is added as a lower-level object of the higher-level object. As for the pasting, since the thing in the video is associated with the subspace of the video information, it can be performed by replacing the subspace with the same shape of the pasted video information. In this copying and pasting, since the copying and pasting can be performed together with the related information, there is almost no work regarding the related information.

以上の実施例では,ワークステションレベルのコンピュータを用いて検索を行なう例で説明したが,VTRやTVなどの一機能として実現することも可能である。 In the above embodiment, an example has been described in which a search is performed using a workstation-level computer, but the search may be implemented as a function such as a VTR or TV.

1…ディスプレイ,2…制御信号線,3…映像入力装置,4…コンピュータ,5…ポインティングデバイス,6…外部情報記憶装置,7…CPU,8…接続インタフェース,9…メモリ,10…映像再生装置,11…キーボード,12…スピーカ,13…タッチパネル。

Claims (10)

The state of the video to be reproduced next is determined by pre-registering the thing or sound in the moving image appearing in the video and detecting that the point on the moving image corresponding to the registered thing is pointed. A video associative search method, wherein a video is displayed on a video display means.

Priority Applications (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2003384488A JP3711993B2 (en) | 1993-10-25 | 2003-11-14 | Video associative search device |

Applications Claiming Priority (2)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP26607193 | 1993-10-25 | ||

| JP2003384488A JP3711993B2 (en) | 1993-10-25 | 2003-11-14 | Video associative search device |

Related Parent Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP6260013A Division JPH07175816A (en) | 1993-10-25 | 1994-10-25 | Video associative retrieving device and method |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| JP2004127311A true JP2004127311A (en) | 2004-04-22 |

| JP3711993B2 JP3711993B2 (en) | 2005-11-02 |

Family

ID=32300003

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2003384488A Expired - Lifetime JP3711993B2 (en) | 1993-10-25 | 2003-11-14 | Video associative search device |

Country Status (1)

| Country | Link |

|---|---|

| JP (1) | JP3711993B2 (en) |

Cited By (3)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2009295054A (en) * | 2008-06-06 | 2009-12-17 | Nippon Hoso Kyokai <Nhk> | Video content search device and computer program |

| US8718444B2 (en) | 2010-06-16 | 2014-05-06 | Panasonic Corporation | Video search device, video search method, recording medium, program, and integrated circuit |

| WO2014193161A1 (en) * | 2013-05-28 | 2014-12-04 | 삼성전자 주식회사 | User interface method and device for searching for multimedia content |

Citations (5)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JPH02121058A (en) * | 1988-10-31 | 1990-05-08 | Matsushita Electric Ind Co Ltd | Data file device, method and device for retrieving data associative memory |

| JPH0352070A (en) * | 1989-07-20 | 1991-03-06 | Nippon Telegr & Teleph Corp <Ntt> | Related information reference system for moving image |

| JPH0520366A (en) * | 1991-05-08 | 1993-01-29 | Nippon Telegr & Teleph Corp <Ntt> | Animated image collating method |

| JPH0546682A (en) * | 1991-08-14 | 1993-02-26 | Nippon Telegr & Teleph Corp <Ntt> | Moving image extracting method |

| JPH0554143A (en) * | 1991-08-27 | 1993-03-05 | Matsushita Electric Ind Co Ltd | Moving object contour detector |

-

2003

- 2003-11-14 JP JP2003384488A patent/JP3711993B2/en not_active Expired - Lifetime

Patent Citations (5)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JPH02121058A (en) * | 1988-10-31 | 1990-05-08 | Matsushita Electric Ind Co Ltd | Data file device, method and device for retrieving data associative memory |

| JPH0352070A (en) * | 1989-07-20 | 1991-03-06 | Nippon Telegr & Teleph Corp <Ntt> | Related information reference system for moving image |

| JPH0520366A (en) * | 1991-05-08 | 1993-01-29 | Nippon Telegr & Teleph Corp <Ntt> | Animated image collating method |

| JPH0546682A (en) * | 1991-08-14 | 1993-02-26 | Nippon Telegr & Teleph Corp <Ntt> | Moving image extracting method |

| JPH0554143A (en) * | 1991-08-27 | 1993-03-05 | Matsushita Electric Ind Co Ltd | Moving object contour detector |

Cited By (5)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2009295054A (en) * | 2008-06-06 | 2009-12-17 | Nippon Hoso Kyokai <Nhk> | Video content search device and computer program |

| US8718444B2 (en) | 2010-06-16 | 2014-05-06 | Panasonic Corporation | Video search device, video search method, recording medium, program, and integrated circuit |

| WO2014193161A1 (en) * | 2013-05-28 | 2014-12-04 | 삼성전자 주식회사 | User interface method and device for searching for multimedia content |

| KR20140139859A (en) * | 2013-05-28 | 2014-12-08 | 삼성전자주식회사 | Method and apparatus for user interface for multimedia content search |

| KR102161230B1 (en) | 2013-05-28 | 2020-09-29 | 삼성전자주식회사 | Method and apparatus for user interface for multimedia content search |

Also Published As

| Publication number | Publication date |

|---|---|

| JP3711993B2 (en) | 2005-11-02 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| US6195497B1 (en) | Associated image retrieving apparatus and method | |

| US5532833A (en) | Method and system for displaying selected portions of a motion video image | |

| US10031649B2 (en) | Automated content detection, analysis, visual synthesis and repurposing | |

| JP5372518B2 (en) | Voice and video control of an interactive electronically simulated environment | |

| US5634062A (en) | System for managing hypertext node information and link information | |

| US8174523B2 (en) | Display controlling apparatus and display controlling method | |

| US8250490B2 (en) | Display image control apparatus | |

| EP0555028A2 (en) | An apparatus and method for manipulating digital data relating to motion video images | |

| US5963203A (en) | Interactive video icon with designated viewing position | |

| US7194701B2 (en) | Video thumbnail | |

| JP3372563B2 (en) | Tree structure display editing device | |

| USRE38401E1 (en) | Interactive video icon with designated viewing position | |

| KR20070093084A (en) | Distributed software construction for user interfaces | |

| JPH0778804B2 (en) | Scene information input system and method | |

| JP2003529830A (en) | User interface that provides automatic organization and filters search criteria | |

| JP2001157165A (en) | Method for constructing semantic connection information between segments of multimedia stream and video browsing method using the same | |

| KR20060083254A (en) | Method and apparatus for providing user interface for searching contents | |

| JP2001306599A (en) | Method and device for hierarchically managing video, and recording medium recorded with hierarchical management program | |

| KR100335817B1 (en) | Method for representing abstract/detail relationship among segments in order to provide efficient browsing of video stream and video browsing method using the abstract/detail relationships among segments | |

| JPH07175816A (en) | Video associative retrieving device and method | |

| JP4955179B2 (en) | Search user interface for building and managing user profiles and search criteria | |

| JP2001306579A (en) | Device and method for retrieving information and computer-readable recording medium recorded with program for computer to execute the same method | |

| JPH06309381A (en) | Moving image processor | |

| JP3711993B2 (en) | Video associative search device | |

| JPH07282079A (en) | Linkage displaying method |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20041026 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20050419 |

|

| A521 | Written amendment |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20050613 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20050726 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20050808 |

|

| FPAY | Renewal fee payment (event date is renewal date of database) |

Free format text: PAYMENT UNTIL: 20080826 Year of fee payment: 3 |

|

| FPAY | Renewal fee payment (event date is renewal date of database) |

Free format text: PAYMENT UNTIL: 20090826 Year of fee payment: 4 |

|

| FPAY | Renewal fee payment (event date is renewal date of database) |

Free format text: PAYMENT UNTIL: 20100826 Year of fee payment: 5 |

|

| FPAY | Renewal fee payment (event date is renewal date of database) |

Free format text: PAYMENT UNTIL: 20100826 Year of fee payment: 5 |

|

| FPAY | Renewal fee payment (event date is renewal date of database) |

Free format text: PAYMENT UNTIL: 20110826 Year of fee payment: 6 |

|

| FPAY | Renewal fee payment (event date is renewal date of database) |

Free format text: PAYMENT UNTIL: 20120826 Year of fee payment: 7 |

|

| FPAY | Renewal fee payment (event date is renewal date of database) |

Free format text: PAYMENT UNTIL: 20130826 Year of fee payment: 8 |

|

| S111 | Request for change of ownership or part of ownership |

Free format text: JAPANESE INTERMEDIATE CODE: R313111 |

|

| R350 | Written notification of registration of transfer |

Free format text: JAPANESE INTERMEDIATE CODE: R350 |

|

| S111 | Request for change of ownership or part of ownership |

Free format text: JAPANESE INTERMEDIATE CODE: R313111 |

|

| R350 | Written notification of registration of transfer |

Free format text: JAPANESE INTERMEDIATE CODE: R350 |

|

| EXPY | Cancellation because of completion of term |