JP6682475B2 - Image display device, topic selection method, topic selection program - Google Patents

Image display device, topic selection method, topic selection program Download PDFInfo

- Publication number

- JP6682475B2 JP6682475B2 JP2017120843A JP2017120843A JP6682475B2 JP 6682475 B2 JP6682475 B2 JP 6682475B2 JP 2017120843 A JP2017120843 A JP 2017120843A JP 2017120843 A JP2017120843 A JP 2017120843A JP 6682475 B2 JP6682475 B2 JP 6682475B2

- Authority

- JP

- Japan

- Prior art keywords

- user

- character

- voice

- unit

- display device

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

- 238000010187 selection method Methods 0.000 title 1

- 238000004891 communication Methods 0.000 claims description 116

- 238000001514 detection method Methods 0.000 claims description 27

- 238000000034 method Methods 0.000 claims description 19

- 238000012545 processing Methods 0.000 description 70

- 230000000694 effects Effects 0.000 description 64

- 230000007613 environmental effect Effects 0.000 description 44

- 238000003860 storage Methods 0.000 description 44

- 230000009471 action Effects 0.000 description 40

- 238000004458 analytical method Methods 0.000 description 40

- 230000005540 biological transmission Effects 0.000 description 36

- NJPPVKZQTLUDBO-UHFFFAOYSA-N novaluron Chemical compound C1=C(Cl)C(OC(F)(F)C(OC(F)(F)F)F)=CC=C1NC(=O)NC(=O)C1=C(F)C=CC=C1F NJPPVKZQTLUDBO-UHFFFAOYSA-N 0.000 description 28

- 230000006870 function Effects 0.000 description 24

- 230000033001 locomotion Effects 0.000 description 21

- 230000008451 emotion Effects 0.000 description 18

- 230000008569 process Effects 0.000 description 17

- 230000004044 response Effects 0.000 description 15

- 238000013523 data management Methods 0.000 description 12

- 238000010586 diagram Methods 0.000 description 12

- 230000006399 behavior Effects 0.000 description 9

- 230000008859 change Effects 0.000 description 9

- 238000012544 monitoring process Methods 0.000 description 9

- 230000003287 optical effect Effects 0.000 description 9

- 239000000463 material Substances 0.000 description 8

- 235000013305 food Nutrition 0.000 description 7

- 235000019640 taste Nutrition 0.000 description 7

- 230000001680 brushing effect Effects 0.000 description 6

- 230000008921 facial expression Effects 0.000 description 6

- 238000005286 illumination Methods 0.000 description 6

- 230000035622 drinking Effects 0.000 description 5

- 230000005856 abnormality Effects 0.000 description 4

- 230000004913 activation Effects 0.000 description 4

- 235000021152 breakfast Nutrition 0.000 description 4

- 230000003993 interaction Effects 0.000 description 4

- 230000007704 transition Effects 0.000 description 4

- NIXOWILDQLNWCW-UHFFFAOYSA-N acrylic acid group Chemical group C(C=C)(=O)O NIXOWILDQLNWCW-UHFFFAOYSA-N 0.000 description 3

- 238000004140 cleaning Methods 0.000 description 3

- 238000012790 confirmation Methods 0.000 description 3

- 230000014509 gene expression Effects 0.000 description 3

- 238000010191 image analysis Methods 0.000 description 3

- 238000007726 management method Methods 0.000 description 3

- 238000004519 manufacturing process Methods 0.000 description 3

- 235000012054 meals Nutrition 0.000 description 3

- 239000000126 substance Substances 0.000 description 3

- 230000000007 visual effect Effects 0.000 description 3

- 230000002618 waking effect Effects 0.000 description 3

- 241000282412 Homo Species 0.000 description 2

- 125000002066 L-histidyl group Chemical group [H]N1C([H])=NC(C([H])([H])[C@](C(=O)[*])([H])N([H])[H])=C1[H] 0.000 description 2

- 241000556720 Manga Species 0.000 description 2

- 241001465754 Metazoa Species 0.000 description 2

- 230000004308 accommodation Effects 0.000 description 2

- 238000006243 chemical reaction Methods 0.000 description 2

- 238000010411 cooking Methods 0.000 description 2

- 230000003247 decreasing effect Effects 0.000 description 2

- 230000003111 delayed effect Effects 0.000 description 2

- 235000012489 doughnuts Nutrition 0.000 description 2

- 239000003814 drug Substances 0.000 description 2

- 238000001093 holography Methods 0.000 description 2

- 230000010354 integration Effects 0.000 description 2

- 238000012423 maintenance Methods 0.000 description 2

- 230000006855 networking Effects 0.000 description 2

- 239000002245 particle Substances 0.000 description 2

- 238000002360 preparation method Methods 0.000 description 2

- XLYOFNOQVPJJNP-UHFFFAOYSA-N water Substances O XLYOFNOQVPJJNP-UHFFFAOYSA-N 0.000 description 2

- 208000019901 Anxiety disease Diseases 0.000 description 1

- 206010034719 Personality change Diseases 0.000 description 1

- 210000003489 abdominal muscle Anatomy 0.000 description 1

- 238000009825 accumulation Methods 0.000 description 1

- 238000004378 air conditioning Methods 0.000 description 1

- 230000036506 anxiety Effects 0.000 description 1

- 238000013459 approach Methods 0.000 description 1

- 230000002457 bidirectional effect Effects 0.000 description 1

- 230000004397 blinking Effects 0.000 description 1

- 238000007664 blowing Methods 0.000 description 1

- 230000036760 body temperature Effects 0.000 description 1

- 239000003795 chemical substances by application Substances 0.000 description 1

- 238000004040 coloring Methods 0.000 description 1

- 230000000994 depressogenic effect Effects 0.000 description 1

- 238000011161 development Methods 0.000 description 1

- 238000009826 distribution Methods 0.000 description 1

- 230000005611 electricity Effects 0.000 description 1

- 230000002996 emotional effect Effects 0.000 description 1

- 238000005516 engineering process Methods 0.000 description 1

- 210000000887 face Anatomy 0.000 description 1

- 239000000945 filler Substances 0.000 description 1

- 238000003384 imaging method Methods 0.000 description 1

- 230000010365 information processing Effects 0.000 description 1

- 238000009434 installation Methods 0.000 description 1

- 238000010409 ironing Methods 0.000 description 1

- 238000010295 mobile communication Methods 0.000 description 1

- 230000036651 mood Effects 0.000 description 1

- 239000003973 paint Substances 0.000 description 1

- 238000005192 partition Methods 0.000 description 1

- 230000008447 perception Effects 0.000 description 1

- 230000002093 peripheral effect Effects 0.000 description 1

- 238000001556 precipitation Methods 0.000 description 1

- 230000002265 prevention Effects 0.000 description 1

- 210000001747 pupil Anatomy 0.000 description 1

- 239000004065 semiconductor Substances 0.000 description 1

- 239000007787 solid Substances 0.000 description 1

- 238000005507 spraying Methods 0.000 description 1

- 230000005477 standard model Effects 0.000 description 1

- 238000012546 transfer Methods 0.000 description 1

- 239000012780 transparent material Substances 0.000 description 1

Images

Description

本発明は、キャラクター画像を表示する画像表示装置に関し、ユーザがキャラクターを、より身近に感じることを可能とする画像表示装置に関する。 The present invention relates to an image display device that displays a character image, and relates to an image display device that allows a user to feel a character more familiar.

従来、様々なキャラクター商品が販売され、その中には、デスクトップキャラクターと呼称されるものがある。これは、PC等のモニタ上にキャラクターを表示させ、予め定められたアルゴリズムに従って動作し、特定のセリフを表示したり、音楽を流したりするアプリケーションである。また、ユーザの通信端末上に表示させたキャラクターにチャットシステムを利用して、提供しているサービスの説明をさせるアプリケーションもある(例えば、特許文献1)。 Conventionally, various character products have been sold, and some of them are called desktop characters. This is an application that displays a character on a monitor such as a PC and operates according to a predetermined algorithm to display a specific dialogue or play music. There is also an application that allows a character displayed on a user's communication terminal to explain a service provided by using a chat system (for example, Patent Document 1).

ところで、そのようなキャラクター商品にあっては、キャラクターをより身近に感じられるような商品が望まれている。 By the way, for such character products, products that make the character feel more familiar are desired.

本発明は、特定のキャラクターとのコミュニケーションを実現するとともに、キャラクターをより身近に感じさせることができる画像表示装置を提供することを目的とする。 It is an object of the present invention to provide an image display device that can realize communication with a specific character and can make the character feel closer.

上記目的を達成するため、画像表示装置は、キャラクターを表示する表示部と、キャラクターがユーザと会話を実行する会話部と、キャラクターがユーザの通信端末とチャットを実行するチャット部と、を備え、会話部は、実行した会話の内容及びチャット部が実行したチャットの内容に基づいて次の話題を選択し、チャット部は、実行したチャットの内容及び会話部が実行した会話の内容に基づいて次の話題を選択する。 To achieve the above object, the image display device includes a display unit that displays a character, a conversation unit in which the character performs a conversation with the user, and a chat unit in which the character performs a chat with the communication terminal of the user, The conversation section selects the next topic based on the content of the conversation executed and the content of the chat executed by the chat section, and the chat section selects the next topic based on the content of the executed chat and the content of the conversation executed by the conversation section. Select a topic.

画像表示装置は、特定のキャラクターとのコミュニケーションを、ユーザがキャラクターと行う実会話と、ユーザが自身の通信端末で画像表示装置と行うチャットとで、互いに話題を連動させることで、ユーザにキャラクターをより身近に感じさせることができる。 The image display device communicates with a specific character by linking topics to each other by a real conversation that the user has with the character and a chat that the user has with the image display device at his or her own communication terminal, so that the character is displayed to the user. It can make you feel closer.

以下、本発明の実施形態に係る画像表示装置について図面を参照して説明する。実施形態に係る画像表示装置は、キャラクター画像を表示するとともに、キャラクターの音声を出力するものである。この際、画像表示装置に表示されるキャラクター画像及びキャラクターの音声は、画像表示装置が置かれる環境、当該装置を所有するユーザに関する情報、時刻情報に応じて決定される。 Hereinafter, an image display device according to an embodiment of the present invention will be described with reference to the drawings. The image display device according to the embodiment displays a character image and outputs a character's voice. At this time, the character image and the voice of the character displayed on the image display device are determined according to the environment in which the image display device is placed, information regarding the user who owns the device, and time information.

〈装置構成〉

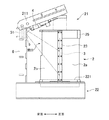

まず、図1乃至図4を用いて、実施形態に画像表示装置1の装置構成について説明する。図1は、画像表示装置1を上方から見た斜視図である。図2は、画像表示装置1を下方から見た斜視図である。

<Device configuration>

First, the device configuration of the

図1,図2に示すように、画像表示装置1は、主に、内部が空洞な円筒状の透明のケース2と、そのケース2の内部にほぼ垂直に立設した透過フィルム(本発明の平状部材)3と、キャラクター画像等を出力するプロジェクタ4と、反射ミラー5等の部品や機器を備える。

As shown in FIGS. 1 and 2, an

このような構成の画像表示装置1において、プロジェクタ4から出力された画像は、反射ミラー5による反射を介して透過フィルム3に投影され、ユーザは、このようにして透過フィルム3に投影された画像を透明なケース2を通して見ることができる。

In the

ケース2は、一部又は全部が透光性部材からなる筐体であり、例えば、アクリル板等によって形成されている。例えば、ケース2は、2つの透明な半円柱状のケース部材2a,2bを、2本の支柱23に組み込むことで全体が透明な一体の円筒体を形成している。ただし、予め成形された円筒体をケース2に用いることもでき、また、弾性又は可撓性を有する矩形状の板材や膜材を半円柱状に湾曲させ、これを支柱23に組み込んで形成した円筒体をケース2として用いることもできる。このように円筒状のケース2を用いることで、左右のどの角度からでも透過フィルム3に投影される画像を適切に視認することができる。なお、支柱23は透明な部材で形成されていてもよく、この場合、ケース2のほぼ全部を透明にすることができる。ただし、支柱23は、不透明や半透明であってもよい。

The

ケース2の正面側上部には、ケース2の表面に沿って湾曲させた帯状の不透明な遮蔽部25を設けている。これにより、ケース2を正面側から見たときに、反射ミラー5は、遮蔽部25の後方にあるため、隠れて見えなくさせることができる。また、図示していないが、ケース2の上底面にあたる円形部には、遮光塗料の塗布等、遮光処理を施している。これにより、透過フィルム3に室内の照明等が入り込むことを防ぐことができ、透過フィルム3に表示される画像を見易くすることができる。また、ケース2の背面側上部(ケース部材2bの上部)は、開口を施しており、反射ミラー5からの画像を形成する光がケース部材2bを介さず、直接透過フィルム3に到達できるようにしている。なお、ケース2は、透明な部材に限らず、乳白色のように半透明の部材を用いてもよい。

On the upper front side of the

このようなケース2の内部には、透過フィルム3が設けられており、また、ケース2の上方、下方、背面側には、後述する上部収容部21、下部収容部22、柱部6が設けられている。

The

透過フィルム3は、本発明の「透光性を有する平状部材」の一実施態様であり、所定の画像が投影される透明なスクリーンとして機能する。本実施形態の透過フィルム3は矩形状であり、これが、ケース2の内部の中央付近にほぼ垂直になるように立設されている。具体的には、透過フィルム3は、台座221の両端に立設された2本の支柱23によって支持され、これにより、表面が正面側(背面側)を向きつつ、台座221の中央に垂直に立設させている。なお、透過フィルム3の代わりに、透明の板材、半透明の板材や膜材等を用いることもできる。

The

下部収容部22は、プラスチック等からなる箱体であり、プロジェクタ4の出力制御を含む種々の制御動作を行う制御ボード701その他の機器(図4(c)参照)を取り付けるスペースを有する。下部収容部22には、着脱可能な下部カバー222が設けてあり、取り付けることで内部を隠すことができ、取り外すことで内部の機器のメンテナンス等を可能としている。下部収容部22の上面の台座221には、透過フィルム3の立設位置の左右の端部に支柱23を立設している。

The

透過フィルム3やケース部材2a,2bは、この支柱23により支持されることで台座221上に一体的に立設される。これにより、円筒状のケース2が台座221上に立設され、透過フィルム3は、側部がケース2の内側に内接しつつ、下部(下端)が台座221の上面(表面)に沿うように設けられる。

The

台座221は、ケース2内に表示されるキャラクター等を仮想的に載置する台としても機能する。すなわち、台座221は、人形や模型を展示可能に収容するディスプレイケースのベース基材のように見せることができる。

The

画像表示装置1では、ミラー取付部51により反射ミラー5の角度や向きを調整することで、透過フィルム3の下端に、キャラクター等の足元を一致させて表示させるようにしている(図1)。このようにすることで、キャラクター等が台座221の上に実際に立っているように見せることができる。

In the

また、台座221は所定の視認性を有する。具体的には、台座221の表面に模様や着色を施したり、形状に特徴を施したりすることで、台座221の存在が目立つようにしている。例えば、本実施形態の台座221は、アクリル板の表面に、レーザー加工等によって、いわゆる魔方陣の模様に沿った溝を施すようにしている。なお、この模様は一例にすぎず、例えば、魔法陣としては、五芒星にしてもよいし、その他の複雑な幾何学模様を施すこととしてもよい。

Further, the

さらに、台座221は、アクリル板の下部に複数の演出用LED706(本発明の発光手段)を分散して配置することで、台座221の全面に演出用LED706からの光が行きわたるようにしている。このようにすると、台座221の表面において、透過フィルム3を跨ぐぞれぞれの領域が強く認識されるため、透過フィルム3に投影されたキャラクター等の前後において台座221の存在をより強調することができる。そうすると、キャラクター等が、台座221の上にしっかりと着地して立っているように見せることができる。

Further, the

上部収容部21は、画像出力を行うプロジェクタ4などの機器(図4(a)参照)を取り付けるスペースを有する。具体的には、上部収容部21は、柱部6の上部に連結された梯子状の上部機器取付部211を設けており、この上部機器取付部211の下面にプロジェクタ4が取り付けられている。

The

上部機器取付部211は、図2や図3に示すように、柱部6との連結部213から正面側上方に傾いた状態で固定されており、これに伴い、上部機器取付部211に取り付けられたプロジェクタ4も斜めに傾いた状態で固定されている。このように、プロジェクタ4を斜めに取り付けることで、画像の出力方向が当該プロジェクタ4の背面側下方に位置する反射ミラー5に向くようにしている。

As shown in FIG. 2 and FIG. 3, the upper

なお、上部機器取付部211は、柱部6との連結において、ボルト等の軸部材を用いて軸支させ、軸を中心に任意の位置まで回動させてナット等の固定部材により固定することもできる。このようにすると、プロジェクタ4の傾きを容易に変更することができ、この変更によって画像の出力を上下方向に調整することができる。

In the connection with the

上部収容部21には、着脱可能な上部カバー212が設けてあり、取り付けることで、上部機器取付部211やプロジェクタ4等の機器を隠すことができ、取り外すことで内部の機器のメンテナンス等を可能としている。

The

プロジェクタ4は、キャラクター画像等の画像の出力を行う画像出力手段である。この種のプロジェクタ4は、通常、いわゆるスクリーンに対し直接映像を投射することで画像を表示するが、本実施形態では、反射ミラー5を介して間接的にスクリーン(透過フィルム3)に画像を投射するようにしている。具体的には、本実施形態のプロジェクタ4は、ケース2の背面側に離間して立設されている柱部6の上部の反射ミラー5に出力画像が向かうように、上部収容部21において傾斜した状態で取り付けられている。

The

ところで、プロジェクタの仕様には、焦点距離(以下、「許容投射距離」という)と投射比(以下、「許容投射角度」という)がある。「許容投射距離」は、画像サイズに対応した必要な投射距離(プロジェクタからスクリーンに至る光路の距離)である。実際の投射距離が許容投射距離に満たないと焦点が合わず画像を鮮明に映し出すことはできない。「許容投射角度」は、スクリーンに投射される画像の光路とスクリーンとの角度の許容値である。実際の投射角度が許容投射角度に満たないと、画像の歪みが大きくなり、また、画像の両端で光量が異なって、画像がぼやけるなど画質が低下する。 By the way, the specifications of the projector include a focal length (hereinafter, referred to as “allowable projection distance”) and a projection ratio (hereinafter, referred to as “allowable projection angle”). The “allowable projection distance” is a necessary projection distance (the distance of the optical path from the projector to the screen) corresponding to the image size. If the actual projection distance is less than the allowable projection distance, the image cannot be displayed clearly because the image is out of focus. The "allowable projection angle" is an allowable value of the angle between the optical path of the image projected on the screen and the screen. If the actual projection angle is less than the permissible projection angle, the distortion of the image becomes large, and the light amount is different at both ends of the image, so that the image is blurred and the image quality deteriorates.

これらの点に鑑み、本実施形態のプロジェクタ4は、比較的、許容投射距離が短く、許容投射角度が小さい仕様のものを用い、さらに、反射ミラー5を用いることで、プロジェクタ4とスクリーン(すなわち、透過フィルム3)とをコンパクトに一体化できるようにしている。

In view of these points, the

柱部6は、下部収容部22の最背部に立設された柱状の部材であり、ケース2の背面側にケース2とは離間して立設されている。このように、柱部6をケース2の背面側に設けることで、透過フィルム3に室内の照明等が入り込むことを防ぎ、透過フィルム3に表示される画像を見易くすることができる。柱部6には、反射ミラー5や各種センサを取り付けている(図2,図3,図4(b)等参照)。

The

反射ミラー5は、柱部6の上部に鏡面がほぼ垂直(すなわち、透過フィルム3の面とほぼ平行)になるように設けられている。これにより、プロジェクタ4から背面側斜め下方向に出力された所定の入射角の画像の光をこれと同角度(反射角)で反射し、その反射光によって画像を透過フィルム3に投影するようにしている。このようにすると、透過フィルム3における画像の上部と下部の投射距離の距離差を抑えることができるため、透過フィルム3に投影される画像のぼやけ等を抑えることができる。

The

図3に示すように、プロジェクタ4から出力された画像の光は、反射ミラー5によって反射され、その反射された画像の光は、正面側斜め下方向に進み、ケース部材2bの開口を通過して、ケース2の内部に設けられた透過フィルム3を背面側から投射する。この状態において、ケース2を通して透過フィルム3に投影されたキャラクター等の画像を見ると、キャラクター等が、より立体的で同じ空間にいる実体物のように視認することができる。

As shown in FIG. 3, the light of the image output from the

このような視認効果を奏する理由について以下に説明する。既述の通り、画像表示装置1は、透明なケース2の内部に透明なフィルム(透過フィルム3)を設け、この透明なフィルムに画像を投影するようにしている。このような画像表示装置1においては、ユーザは、透明なケース2を通して透明なフィルムに表示されるキャラクター等を見ることになる。

The reason for producing such a visual recognition effect will be described below. As described above, the

この場合、ユーザは、ケース2に仕切られることで制限されたケース2内という空間で、その3D環境、すなわち、縦(高さ)・横・奥行きを認識することになる。このため、特に、その空間内に表示されるキャラクター等とケース2との関係から生ずる奥行きを認識することによって、キャラクター等自体も3D(立体的)に見えるといった視覚効果(3D環境効果)を奏する。

In this case, the user recognizes the 3D environment, that is, the vertical (height) / horizontal / depth in the space inside the

すなわち、キャラクター等の奥に透明なケース2を視認することで、閉空間内にキャラクター等とその奥側の仕切りが共に視認されることとなり、この結果、同一の空間におけるキャラクター等と透明なケース2との奥行き感に基づいてキャラクター等が立体的に見える。

That is, by visually recognizing the

これに対し、仮にケース2を無くし、周りに何も無い開放された空間の中で、透明なフィルムに投影されるキャラクター等の画像を見た場合には、周囲の空間が縦・横の認識が強まる一方、奥行きの認識は弱まる。そうすると、このような開放された環境で透明なフィルムに投影されるキャラクター等の画像を見ても、フィルムの存在感が増えるだけで奥行き感を感じにくいことから、既述したような立体的な視覚効果を奏し得ない。

On the other hand, if

また、透明なケース2を通して透明なフィルムを見た場合、透明なフィルムが目立たなくなる。これは、ケース2に透過フィルム3が内接されていることで、透過フィルム3の左右の端部が見えなくなることに起因する。また、透明な物質を含め、前方の物質を通して後方を見ると、当該後方の物質を認識しづらくなる。

Moreover, when the transparent film is seen through the

これを画像表示装置1に当て嵌めると、例えば、ケース2を正面側から見たときに、ケース2(ケース部材2a)の後方にある透過フィルム3は認識しづらくなる。そうすると、平面状の透過フィルム3の存在が認識されないことで、その透過フィルム3に投影されるキャラクター等は、平面ではない立体物が浮遊するように見える。このような理由からも、ケース2がない場合よりもケース2がある方が、キャラクター等の画像をより立体的に見せることができる。

If this is applied to the

また、本実施形態の画像表示装置1は、透過フィルム3の下方(下端)に台座221を設け、キャラクター等の足元を透過フィルム3の下端に一致させて表示するようにしている。このようにすると、あたかもキャラクター等が台座221の上に立っているように見え、キャラクター等がまるで質量がある立体物のように錯覚させることができる。

Further, the

特に、台座221は、表面が視認し易いように模様等を施しているほか、透過フィルム3を跨ぐ正面側の領域と背面側の領域の双方に演出用LED706を配置して発光させるようにしている。これにより、キャラクター等の前後に台座221があることを明確に認識させることができ、ひいては、キャラクター等が、台座221にしっかりと着地した状態で立っているように見せることができる。したがって、このような台座221との関係によっても、透明なケース2内の透過フィルム3に投影されるキャラクター等を実体のある立体物のように見せることができる。

In particular, the

加えて、透過フィルム3に対しては、背面側上部に設けた反射ミラー5からの反射光による投影を行うようにしており、画像の光の一部が透過フィルム3を透過して、台座221上に光の影として映し出されるようにしている。このような影が視認されることによっても、表示対象をより立体的に視認させる効果を奏する。

In addition, projection is performed on the

次に、画像表示装置1に搭載される機器について図4を参照しながら説明する。図4(a)は、上部収容部に設置される機器、図4(b)は、柱部に設置される機器、図4(c)は、下部収容部に設置される機器の模式図である。

Next, devices mounted on the

なお、ケース2の側面は不透明にしたり、側面部に不透明なフィルムを帖着したりするなどして、側面からのキャラクターの視認性を低下させることで、ユーザが正面側からキャラクターを見るようにしてもよい。また、ここでは、透過フィルム3にプロジェクタからの画像を投影することとしているが、これは、例えば、画像表示装置に例えば水滴等を噴霧できる構成を設けて、噴霧された水滴にプロジェクションを行うというような立体ホログラフィーでキャラクターを投影することとしてもよい。立体ホログラフィー技術を応用することで、より立体感のあるキャラクターを表示することができる。

In addition, by making the side surface of the

《下部収容部の設置機器》

図4(c)に示すように、下部収容部22には、制御ボード701、人感センサ702、赤外線LED703、マイク704、スピーカ705、演出用LED706、赤外線受光部707、ステータスLED708、起動ボタン709、USBハブ710のほか、Wi−Fi(登録商標)モジュールやBluetooth(登録商標)モジュール等が設置されている。

《Devices installed in the lower housing part》

As shown in FIG. 4C, in the

制御ボード701は、CPU、ROM、RAM、HDMI(登録商標)ポート、LANポート、USBポート、各種入出力ポートなどが搭載された一又は複数の制御チップが搭載され、各種センサ等から入力された情報に基づき、画像、音声を含む様々な出力動作を所定の機器に実行させる。

The

人感センサ702は、赤外線の変化量を検知して人の所在を検出するセンサであり、正面側の左右に設けている。

The

赤外線LED703は、正面上部に放射状に設けられ、いわゆる赤外線リモコンとして機能する。具体的には、赤外線を周囲に出力することで、テレビや掃除機などの外部の機器の遠隔操作を可能としている。

The

マイク704は、ユーザから発せられる音声を入力する。例えば、マイク704は、正面の下段に1つ設けられる。 The microphone 704 inputs the voice uttered by the user. For example, one microphone 704 is provided in the lower stage of the front.

スピーカ705は、音声や音楽などの音情報を、増幅器を介して出力する。図4(c)に示す例では、スピーカ705は、正面側に設けられているが、後方柱部の左右にステレオ方式で設置されることが好ましい。

The

演出用LED706は、台座221における発光手段である。

The

赤外線受光部707は、正面側に設けられ、テレビや照明器具、エアコン、ロボット掃除機等の家電製品のリモコンから、そのリモコンで用いられるリモコン操作に関する赤外線情報を受信する。 The infrared light receiving unit 707 is provided on the front side, and receives infrared information about remote control operation used by the remote control from a remote control of a home electric appliance such as a television, a lighting fixture, an air conditioner, and a robot cleaner.

ステータスLED708は、画像表示装置1の状態(例えば、電源オン、エラー発生、通信中や、後述する「スリープ状態」、「未召喚状態」、「召喚状態」等)を示す報知手段であって、特定の点滅パターンや発光色等によって各種状態を識別可能に報知する。

The

起動ボタン709は、画像表示装置1本体の電源のオン/オフを行うための操作手段である。

The start button 709 is an operation unit for turning on / off the power of the main body of the

USBハブ710は、USB機器を複数接続するためのハブである。 The USB hub 710 is a hub for connecting a plurality of USB devices.

Wi−Fi(登録商標)モジュールは、USBハブに接続された無線LANモジュールであり、アクセスポイントとして無線LAN子機にインターネット環境を提供したり、無線LAN子機として他のアクセスポイントを通じてインターネットに接続したりすることができる。 The Wi-Fi (registered trademark) module is a wireless LAN module connected to a USB hub and provides an Internet environment to a wireless LAN slave device as an access point or connects to the internet through another access point as a wireless LAN slave device. You can

Bluetooth(登録商標)モジュールは、所定規格に対応したキーボードやマウス、スマートフォン等の通信端末、マイク、スピーカなどの周辺機器と無線通信を可能とする無線通信インタフェースである。

《柱部の設置機器》

The Bluetooth (registered trademark) module is a wireless communication interface that enables wireless communication with peripheral devices such as a keyboard, a mouse, a communication terminal such as a smartphone, a microphone, and a speaker that comply with a predetermined standard.

<< Pillar installation equipment >>

図4(b)に示すように、柱部6には、既述の反射ミラー5に加え、温湿度センサ611、振動センサ612、騒音センサ613が設けられている。

As shown in FIG. 4B, the

温湿度センサ611は、室内の温度及び湿度を測定し、これらの測定値を入力する。 The temperature / humidity sensor 611 measures the temperature and humidity inside the room and inputs these measured values.

振動センサ612は、振動を検知するためのセンサであり、例えば、ピエゾ振動センサが相当する。振動センサ612によって検出される振動としては、地震のような大きな揺れのほか、足音やドアの開け閉めを識別可能な比較的小さな振動がある。 The vibration sensor 612 is a sensor for detecting vibration, and corresponds to, for example, a piezo vibration sensor. Vibrations detected by the vibration sensor 612 include large vibrations such as an earthquake, and relatively small vibrations that can identify footsteps and door opening / closing.

騒音センサ613は、室内の環境音を検出するためのセンサである。騒音センサ613によって検出される環境音としては、例えば、所定の基準音量に基づいて判別されるユーザの生活音(テレビの音を含む)、近所の環境音、騒音がある。

《上部収容部の設置機器》

The noise sensor 613 is a sensor for detecting environmental sound in the room. The environmental sound detected by the noise sensor 613 includes, for example, the user's daily sound (including the sound of the television), which is determined based on a predetermined reference volume, the environmental sound in the neighborhood, and noise.

《Devices installed in the upper housing part》

図4(c)に示すように、上部収容部21には、プロジェクタ4、赤外線LED703、光センサ(照度センサ)721及びカメラ722が設けられている。

As shown in FIG. 4C, the

プロジェクタ4は、既述したように、反射ミラー5を介して透過フィルム3に画像を投射する。プロジェクタ4から出力される画像には、例えば、様々な漫画やアニメに登場する各キャラクターや実在の人物、物品等の2D画像や3D画像、キャラクターの感情表現を演出する演出用の画像がある。

As described above, the

赤外線LED703は、左右にそれぞれ設けられ、上部収容部21に設けられているものと同様、赤外線リモコンとして機能する。

The

光センサ(照度センサ)721は、明るさ(照度)を測定するセンサである。 The optical sensor (illuminance sensor) 721 is a sensor that measures brightness (illuminance).

カメラ722は、前方に設けられ、静止画や動画を撮影する撮像手段である。

The

〈機能〉

次に、既述した各機器によって実現される機能について図5及び図6を参照して説明する。図5は、実施形態に係る画像表示装置1の機能ブロック図である。図5に示すように、画像表示装置1は、表示部700と、会話部717と、チャット部718とを備える。

<function>

Next, the functions realized by the above-described devices will be described with reference to FIGS. 5 and 6. FIG. 5 is a functional block diagram of the

表示部700は、キャラクターを表示する機能を有するものである。例えば、前述のプロジェクタ4にキャラクターに係る画像を透過フィルム3に投影させることで、キャラクターを表示する。表示部700は、例えば、プロセッサやグラフィックエンジンなどによって実現されるが、実現の手法はこれに限られるものではない。キャラクターは、アニメ、漫画、小説、コンピュータゲーム、小説などに登場する人物や動物などであるが、これに限られず、オリジナルの創造上の人物であってもよい。また、人物や動物に限らず、個性を有する無機物もキャラクターとしてあり得る。例えば、ロボットなどである。

The

会話部717は、ユーザと会話する機能を有するものであって、キャラクターがユーザと会話しているように演出する機能を有するものである。会話部717は、例えば、プロセッサにより実現され、予め定められたアルゴリズムに従って、ユーザとの会話を行う。会話部717は、予め記憶している音声の中から、ユーザとの会話の話題を選択して、その音声をスピーカ705から出力し、マイク704から入力されるユーザの音声を解析することで会話を実行する。なお、ここで、キャラクターの音声は予め記憶していることとしたが、これはその限りではなく、キャラクターは音声として合成音声を出力することとしてもよい。

The

チャット部718は、ユーザが保持する通信端末との間で、チャットを実行するものであって、例えば、プロセッサにより実現され、予め定められたアルゴリズムに従って、ユーザとチャットを行う。チャット部718は、ユーザの通信端末と直接無線通信を実行してチャットを行うこととしてもよいし、所定のメッセージングサーバ(チャットサーバ)を介して、チャットを実行することとしてもよい。ここでいうチャットはいわゆるメッセージ(通信文)のやり取りを行うためのものである。チャット部718は、自動で会話の内容を選択して、選択した会話の内容を文字列として、送信するとともに、ユーザの通信端末から送信されたチャットの内容を解析して、解析した内容に応じた話題を選択して応答を生成し、そのメッセージを送信する。

The

ここで、会話部717とチャット部718とは互いに連動する。会話部717とチャット部718とが互いに連動するとは、ユーザとの間で会話部717が実行したキャラクター−ユーザ間の会話がチャット部718が実行するチャットの内容に反映され、チャット部718がユーザの通信端末との間で実行したチャットの内容が、会話部717が実行する会話の内容に反映されることをいう。チャットの内容や、会話の内容とは、発言の内容そのものや話題のことである。そして、会話部717とチャット部718とが連動するとは、例えば、会話部が野球に関する会話をユーザとの間で実行された場合に、チャット部が実行する話題に野球に関する話題を含ませる、より正確には、野球に関する話題を実行する可能性を持たせることをいう。会話部717、チャット部718は、下記における制御部71により実現される。

Here, the

また、画像表示装置1は、図1乃至図3を用いて上述したように少なくとも一部が透光性部材からなるケース2をさらに備えることができる。そして、表示部700は、ケース2内に立設した透光性の平板部材である透過フィルム3と、平板部材である透過フィルム3に、キャラクター画像及び演出用画像を投光する投光装置であるプロジェクタ4と、投光装置であるプロジェクタを介した画像の表示制御する表示処理部713とを有することができる。

Further, the

具体的には、画像表示装置1は、図6に示すように、制御部71と、入力部72と、出力部73と、操作部74と、記憶装置75と、通信部76とを備える。この記憶装置75に記憶される画像表示プログラムP1や、会話プログラムP2、チャットプログラムP3が実行されることで、制御部71が取得処理部711、解析部712、表示処理部713、音声出力部714、送信処理部715及びデータ管理部716としての処理を実行することができる。

Specifically, the

入力部72は、各種センサによって検出された様々な情報が入力される手段である。入力部72に入力されるデータには、例えば、人感センサ702が人を検知したときに人感センサ702から出力される識別情報、マイク704を介して入力された音声情報、温湿度センサ611によって検出される室内の温度や湿度の情報、振動センサ612が検出した振動の大きさや変化を識別可能な情報、騒音センサ613を介して入力された音量情報、光センサ721を介して入力された照度情報、カメラ722によって撮像された静止画・動画の情報等がある。

The

出力部73は、所定の命令にもとづいて信号や情報の出力を行う出力手段である。出力部73によって出力される信号や情報には、例えば、赤外線LED703から出力される外部機器の動作を制御するための赤外線信号、スピーカ705を介して出力される音声情報、演出用LED706から発光される光、プロジェクタ4から出力される画像等がある。

The

操作部74は、ユーザによる操作手段であり、例えば、図示しないキーボードやマウス、画像表示装置1に設けられた操作ボタン(ハードキー)や、タッチパネルが相当する。操作部74によって行われる操作には、例えば、起動ボタン709による装置本体の電源のオン/オフや、画像表示装置1をスリープ状態(非召還状態)とアクティブ状態(召還状態)を切り替えるためのボタン等がある。

The

記憶装置75は、例えば、画像表示装置1を構成するRAMや、EEPROMやフラッシュメモリ等の不揮発性メモリ等により構成され、画像表示装置1の有する各種機能を実行するためのプログラムやデータを記憶する記憶手段である。記憶装置75に記憶されるデータには、キャラクター等の画像データ751や音声データ752、テレビや照明器具などの外部機器を操作する信号データ753、ユーザの属性情報等に関するユーザデータ754、画像表示装置1がユーザとの間で交わした会話の履歴を示す会話履歴データ755、画像表示装置1がユーザの通信端末との間で実行したチャットの履歴を示すチャット履歴データ756、外部機器のリモコンに関するリモコン情報、カレンダーサイトで登録したカレンダー情報、装置本体や各機器の属性情報、センサから入力した情報、音楽情報、言語データ等がある。また、記憶装置75には、記憶されるプログラムには、後述する各種制御動作を実行するための画像表示プログラムP1の他、ユーザとの間で直接会話を交わすための会話プログラムP2や、ユーザの通信端末との間で(チャットサーバを介して)チャットを実行するためのチャットプログラムP3、音声認識プログラムや人工知能プログラム等がある。

The

画像データ751は、画像を表示する表示条件と、当該条件に起因して表示されるキャラクター画像を特定するキャラクター画像情報(第1画像情報)および演出用画像を特定する演出用画像情報(第2画像情報)とが関連付けられるデータである。演出用画像は、キャラクターの感情等を表現するものであって、感情等を表す言葉の文字を含む画像であってもよいし、星型やハート型等のパーティクルを含む画像であってもよい。なお、演出用画像は、必須のものではなく、表示しなくともよい。例えば、所定の確率で表示することとしてもよい。具体的には、例えば、1日で変わるランダムな閾値を設け、演出用画像を表示するタイミングで表示するか否かをその時々でランダム値を算出して、そのランダム値が設定した閾値を超えるか否かで演出用画像を表示してもよい。

The

図7(a)に示す画像データ751の例では、環境信号として「音声A」が検出された場合、「キャラクター画像A」と「演出用画像A」とが表示されることが規定される。例えば、音声Aが「おはよう」という言葉であるとき、キャラクター画像Aとして、キャラクターが「おはよう」と言う様子が表されるような画像が表示されるとともに、演出用画像Aとして、朝のさわやかな演出をする画像が表示される。また、演出用画像Aには、「おはよう」の文字が表示される吹き出しを含んでもよい。

In the example of the

環境信号として「動作C」が検出された場合、「キャラクター画像C」と「演出用画像C」とが表示される。例えば、動作Cが「ユーザの帰宅」であるとき、キャラクター画像Cとして、キャラクターが「おかえり」と言う様子が表されるような画像が表示されるとともに、演出用画像Cとして、帰宅を迎えるような演出をする画像が表示される。また、演出用画像Cには、「おかえり」の文字が表示される吹き出しを含んでもよい。 When "action C" is detected as the environmental signal, "character image C" and "effect image C" are displayed. For example, when the action C is "user's return home", an image showing that the character says "Welcome back" is displayed as the character image C, and as the effect image C, he / she comes home. An image that produces a different effect is displayed. In addition, the effect image C may include a balloon in which the character “Welcome back” is displayed.

「時刻D」のタイミングでは、「キャラクター画像D」と「演出用画像D」とが表示される。例えば、時刻Dとして、目覚ましの時間として「午前6時」がセットされているとき、午前6時になると、キャラクター画像Dとして、キャラクターがユーザを起こすような様子が表される画像が表示されるとともに、演出用画像Dとして、目が覚めるような画像を表示してもよい。また、演出用画像Dには、「朝だよ」の文字が表示される吹き出しを含んでもよい。 At the timing of "time D", "character image D" and "effect image D" are displayed. For example, when "6:00 am" is set as the wake-up time as the time D, at 6:00 am, an image showing that the character awakens the user is displayed as the character image D at the same time. As the effect image D, an image that wakes up may be displayed. In addition, the effect image D may include a balloon in which the character "morning is good" is displayed.

「信号E」を受信したタイミングでは、「キャラクター画像E」と「演出用画像E」とが表示される。例えば、信号Eが、ユーザの通信端末から送信される「ハブラシ」の信号であるとき、この信号Eを受信すると、キャラクター画像Eとして、キャラクターが歯磨きをする様子が表される画像が表示されるとともに、演出用画像Eとして、歯磨きにふさわしい、気分爽快な画像を表示してもよい。また、演出用画像Eには、「はみがき中」の文字を含んでもよい。 At the timing when the "signal E" is received, the "character image E" and the "effect image E" are displayed. For example, when the signal E is a “tooth brush” signal transmitted from the user's communication terminal, when the signal E is received, an image showing how the character brushes teeth is displayed as the character image E. At the same time, a refreshing image suitable for brushing teeth may be displayed as the effect image E. In addition, the effect image E may include a character “in brush”.

また、画像データ751では、環境情報とともに時刻情報を含む表示条件が規定されてもよい。例えば、画像データ751は、環境情報が同一であっても、午前と午後とでは、表示されるキャラクター画像及び演出用画像が異なるように規定することができる。

Further, in the

さらに、画像データ751では、環境情報とともに受信信号を含む表示条件が規定されてもよい。

Further, the

音声データ752は、音声を出力する出力条件と、当該条件に起因して出力される音声を特定する情報とが関連付けられるデータである。

The

図7(b)に示す音声データ752の例では、環境信号として「音声A」が検出された場合、「音声A」が出力されることが規定される。例えば、音声Aが「おはよう」という言葉であるとき、音声Aとして、キャラクターの声で「おはよう」と出力される。

In the example of the

環境信号として「動作C」が検出された場合、「音声C」が出力される。例えば、動作Cが「ユーザの帰宅」であるとき、音声Cとして、キャラクターの声で「おかえり」と出力される。 When "action C" is detected as the environmental signal, "voice C" is output. For example, when the action C is "user's return home", the voice of the character, "welcome back", is output as the voice C.

「時刻D」のタイミングでは、音声Dとして、キャラクターの声で、「6時だよ」と出力される。 At the timing of “time D”, the voice of the character, “6 o'clock” is output as voice D.

「信号E」を受信したタイミングでは、音声Eとして、キャラクターが歯磨きをする音や、うがいをする音が出力される。 At the timing when the “signal E” is received, the sound of the character brushing teeth or the sound of gargle is output as the sound E.

また、音声データ752では、環境情報とともに時刻情報を含む出力条件が規定されてもよい。例えば、音声データ752は、環境情報が同一であっても、午前と午後とでは出力される音声が異なるように規定することができる。

In the

さらに、音声データ752では、環境情報とともに受信信号を含む出力条件が規定されてもよい。

Furthermore, in the

信号データ753は、家電等の外部の電気機器を操作する操作信号を出力する条件と、当該条件に起因して送信される操作信号とが関連付けられるデータである。

The

図7(c)に示す信号データ753の例では、環境信号として「音声F」が検出された場合、「操作信号F」が出力されることが規定される。例えば、音声Fが「テレビ消して」という言葉であるとき、テレビの電源をつける操作信号Fが出力される。

In the example of the

なお、図8に示すように、同一の言葉や行動に対しても、日時に応じて出力される画像や音声は異なっていてもよい。例えば、「おはよう」の音声が検出された場合、平日朝であれば「おはよう 今日も頑張ろうね!」と一日を励ます音声を出力し、休日朝であれば「おはよう 今日はゆっくりできるね」と平日の疲れを労わるような音声を出力する。一方、夜であれば、「なに言ってるの? もうこんな時間だよ」の音声を出力する。したがって、日常生活で不自然な機械的なやり取りを防止することができる。これにより、ユーザはキャラクターをより身近に感じることができる。 Note that, as shown in FIG. 8, even for the same word or action, the output image or sound may be different depending on the date and time. For example, if the voice "Ohayo" is detected, it outputs a voice that encourages the day, "Good morning, let's do our best today!" On weekday mornings, and "Good morning, you can relax today" on holiday mornings. And outputs a sound that makes you tired on weekdays. On the other hand, at night, the voice "What are you talking about? It's about this time" is output. Therefore, it is possible to prevent unnatural mechanical interaction in daily life. As a result, the user can feel the character closer.

ユーザデータ754は、ユーザのプロフィール、属性、嗜好等のユーザに関する種々の情報を有する。ユーザデータ754において、ユーザの氏名を有することで、画像表示装置1は、例えば、ユーザの名前を音声で出力することができる。このとき、氏名だけでなくニックネーム等を登録してもよい。これにより、キャラクターがユーザの名前を呼ぶようにすることが可能となる。したがって、ユーザは、キャラクターに親しみを感じ、また、より身近に感じることができる。

The

ユーザデータ754において、ユーザの住所や会社の住所を入力することで、画像表示装置1は、例えば、ユーザの行動範囲に関する情報をインターネット等を利用して取得し、音声や画像で出力することができる。これにより、キャラクターが、ユーザに様々な情報を知らせてくれるようにすることが可能となる。したがって、ユーザは、キャラクターに親しみを感じ、かつ、より身近に感じることができる。

By inputting the address of the user or the address of the company in the

ユーザデータ754において、ユーザの生年月日を入力することで、画像表示装置1は、例えば、ユーザの誕生日に、誕生日を祝う画像は音声を出力することができる。これにより、キャラクターが、ユーザの誕生日を祝うようにすることが可能となる。これにより、ユーザはキャラクターに親しみを感じ、かつ、より身近に感じることができる。

By inputting the date of birth of the user in the

ユーザデータ754において、ユーザの携帯電話の電話番号を入力することで、画像表示装置1は、例えば、ユーザが外出中に、携帯電話に電話をかけるようにすることができる。これにより、ユーザは外出先において、家で待つキャラクターから電話を受けたような状態とすることが可能となる。これにより、ユーザは、キャラクターに親しみを感じ、かつ、より身近に感じることができる。

By inputting the telephone number of the mobile phone of the user in the

その他、ユーザデータ754は、好きなアニメや漫画、小説、ゲーム、映画、好きなキャラクター、趣味、興味のあるもの、体重、身長、職業等の情報を有することができる。画像表示装置1は、このようなユーザに関する情報に基づいて、ユーザの興味のある話題から画像を表示したり、音声を出力したりすることが可能となる。また、このような情報は、アンケート等の結果や、ユーザが利用したSNS(ソーシャルネットワーキングサービス)の履歴等から生成することができる。ここでいうアンケートとは、画像表示装置1のキャラクターがユーザに対して「○○は好き?」とかいった質問を会話やチャットを通じて行うものであってもよいし、あるいは、時々質問リストのようなデータにユーザが記入するものであってもよい。前者の場合、質問内容とそれに対するユーザからの回答の文字列を対応付けて、ユーザデータ754の一部として、記憶しておくことで、以降においてユーザ好みの話題を選択することができる。

In addition, the

会話履歴データ755は、画像表示装置1のキャラクターがユーザとの間で直接交わした会話の内容に関する履歴情報である。図9は、会話履歴データ755の一具体例を示すデータ概念図である。図9に示すように、会話履歴データ755は、会話を行ったものを示す情報であってキャラクター側の発話かユーザ側の発話かを示す発話者情報901と、発話された日時を示す日時情報902と、会話の具体的内容を示す会話内容情報903と、が対応付けられた情報である。例えば、図9の例で言えば、キャラクターは、「2016年7月10日、18時30分10秒」に、「今日、野球中継があるね」と話しかけているのに対し、ユーザが、「2016年7月10日、18時32分20秒」に、「そうなんだ?教えてくれてありがとう」と答えていることがわかる。なお、ユーザについての会話内容情報903は、入力された音声に対して、解析部712が実行した音声認識の結果のテキストデータが記憶される。なお、会話内容情報903は、会話の内容全てを文字列にした情報であってもよいし、会話の内容から、キーワードをピックアップした情報であってもよい。例えば、図9の例でいえば、「Aチームが好きかな」という会話内容であれば、「Aチーム、好き」というような組み合わせの情報を会話内容情報903として記憶しておいてもよい。この場合、画像表示装置1が選択するキーワードは、会話文中の名詞を基準に選択することとしてもよいし、ユーザの感情を表す語があれば、それをピックアップして記憶することとしてもよい。会話履歴データ755が記憶装置75に記憶されていることにより、画像表示装置1は、過去の会話の内容を認識することができるとともに、その後の会話やチャットの話題に反映することができる。会話履歴データ755は、画像表示装置1が表示するキャラクターとユーザとの間で会話が成されるごとに、制御部71により追加更新される。

The

チャット履歴データ756は、画像表示装置1のキャラクターが、ユーザが保持する通信端末との間で実行したチャットの内容に関する履歴情報である。図10は、チャット履歴データ756の一具体歴を示すデータ概念図である。図10に示すように、チャット履歴データ756は、チャットで発言をした側を示す情報であって、ユーザ側の発言かキャラクター側の発言かを示す発言者情報1001と、チャット上でその発言がされた日時を示す日時情報1002と、発言したチャットの内容を示す文字列であるチャット内容情報1003とが対応付けられた情報である。例えば、図10の例で言えば、キャラクターは、「2016年7月2日、19時39分21秒」に、「今、何してる?」とチャットで質問しているのに対し、ユーザが、「2016年7月2日、19時40分30秒」に、「神宮球場で、野球の試合見てるよ」と答えていることがわかる。なお、チャット内容情報1003は、チャットの内容全てを文字列にした情報であってもよいし、チャットの内容から、キーワードをピックアップした情報であってもよい。例えば、図10の例でいえば、「神宮球場で、野球の試合見てるよ」というチャット内容から、「野球」というキーワードのみを記憶しておいてもよいし、「a選手が好きかな」というチャット内容であれば、「a選手、好き」というような組み合わせのキーワードをチャット内容情報1003として記憶しておいてもよい。この場合、画像表示装置1が選択するキーワードは、チャット文中の名詞を基準に選択することとしてもよいし、ユーザの感情を表す語があれば、それをピックアップして記憶することとしてもよい。チャット履歴データ756が記憶装置75に記憶されていることにより、画像表示装置1は、過去のチャットの内容を認識することができるとともに、その後のチャットや会話の話題に反映することができる。チャット履歴データ756は、画像表示装置1が表示するキャラクターとユーザとの間でチャットが成されるごとに、制御部71により追加更新される。

The

ランダム会話データ757は、キャラクターがランダムに会話またはチャットを実行する場合の話題の選択に係るデータである。図11に示すようにランダム会話データ757は、キーワード1101と、条件1102と、会話orチャット内容1103とが対応付けられた情報である。キーワード1101は、会話のトリガとなるワードであって、制御部71が会話履歴データ755及びチャット履歴データ756に記録されている会話履歴及びチャット履歴中の話題と照合するための情報である。会話履歴とチャット履歴の中に含まれているキーワードが、キーワード1101のいずれかに合致する場合に、会話orチャット内容1103の内容が音声で出力または、チャットの文章として出力される。条件1102は、対応する会話orチャット内容をキャラクターが話す又はチャットするためにクリアしておく必要のある条件のことであり、条件がない場合も含む。条件としては、特定の天候(晴れ、雨、雪、…)であったり、特定の音声が入力されることであったり、特定の情報(例えば、ある番組が放送されること)が入力された情報(例えば、テレビの番組情報)に含まれていることであったり、様々である。会話orチャット内容1103は、会話履歴またはチャット履歴に含まれるキーワードがキーワード1101に一致し、かつ、条件1102が合致する場合に、実行する会話またはチャットの実内容を示す情報である。なお、制御部71により複数の会話orチャット内容が検出できた場合には、その中のいずれかをランダムに選択することとしてもよいし、選択された会話orチャット内容の会話に含まれるキーワードのユーザの嗜好との合致率の高いものを選択することとしてもよいし、その前の1以上の会話との整合性の高いものを選択することとしてもよい。ランダム会話データが記憶されていることにより、制御部71は、会話部またはチャット部として、それぞれの過去の履歴を反映した次の会話又はチャットを行うことができる。

The

通信部76は、有線又は無線により、外部の機器との間で双方向又は片方向のデータ通信処理を行う通信手段である。例えば、インターネットに接続された機器との間で、LANポートに接続されたLANケーブルやWi−Fi(登録商標)モジュールに基づく無線を介して、各種データの送受信が可能である。例えば、通信部76は、ユーザの通信端末から送信される信号を受信することができる。また、通信部76は、天気情報サイトから受信可能な天気情報、カレンダーサイトに登録したカレンダー情報などのインターネットを介して取得可能な情報がある。また、通信部76は、図示していないネットワーク上のチャットサーバを介して、ユーザの通信端末との間でチャット通信を実行することができる。

The

制御部71は、画像表示プログラムP1に従って、取得処理部711、解析部712、表示処理部713、音声出力部714、送信処理部715、データ管理部716、としての制御動作を行うことができる。

The

取得処理部711は、マイク704、カメラ722、人感センサ702、光センサ721、温湿度センサ611、振動センサ612、騒音センサ613等のすくなくともいずれかから検出された信号を取得する。

The

解析部712は、取得処理部711が取得した環境情報を解析する。例えば、解析部712は、取得処理部711がマイク704から検出した環境信号から、ユーザが発した言葉を解析する。解析部712は、例えば、記憶装置75に予め登録される言語モデル及び音声モデルを用いて、マイク704が取得した音声から、ユーザが発した言葉を特定するようにできる。言語モデルとは、画像表示装置1が使用する言語において使用される言語の単語情報の集合や、各種の言い回しを登録したデータである。また、音声モデルは、使用する言語の音声信号のモデルのことであり、例えば、周波数特性を示す信号のことである。具体的には、「あ」、「い」、…、「a」、「b」といった一語一語の音声の標準的なモデルのことである。これにより、入力されたユーザの音声をパターンマッチングにより特定することができる。また、これにより、画像表示装置1は、ユーザが発した言葉に応じて定められる画像を表示し、言葉に応じて定められる音声を出力することができる。ここで、記憶装置75において、画像表示装置1の持ち主であるユーザに関するユーザデータとして声紋情報を有し、持ち主ユーザの声を認識することができるようにしてもよい。

The

なお、解析部712が、ユーザが発した言葉を解析できないとき、画像表示装置1は、「もう一度言って」等、通常の機械的な音声を出力してユーザに繰り返しを要求するのではなく、別の方法で反応する。例えば、画像表示装置1は、「もっと近くでしゃべって」、「優しく言って」の音声を出力して繰り返すことを誘導する。また、画像表示装置1は、「ふーん」、「そっかー」、「なるほどー」等、適当な相槌の音声を出力してもよいし、「んー」、「えっとー」のようなフィラー表現の音声を出力してもよい。

Note that when the

また、解析部712は、取得処理部711がカメラ722から検出した環境信号から、ユーザの位置や動作を解析する。具体的には、解析部712は、画像解析として、画像から人の顔を検出することができる。また、記憶装置75において、持ち主ユーザに関するユーザデータとしてユーザの顔情報を有し、検出した人の顔から、持ち主ユーザの顔を認識することができるようにしてもよい。

Further, the

画像表示装置1は、持ち主ユーザを特定することで、キャラクターが持ち主ユーザに対しては親しげに接するような画像を表示したり音声を出力したりすることが可能となる。また反対に、画像表示装置1は、持ち主以外の者に対しては、よそよそしく接したり、自己紹介等の挨拶をしたりするような画像を表示したり音声を出力したりすることができる。これにより、ユーザは、画像表示装置1で表示されるキャラクターに対し、より親近感を覚えることができる。

By specifying the owner user, the

また、解析部712は、解析されたユーザが発した言葉、ユーザの位置や動作に加え、他のセンサ等で検出された他の環境情報やボタン操作を合わせて一つの環境情報とした結果を生成してもよい。例えば、音声や画像に加え、人感センサの検出結果から、後述する外出や帰宅の判定をすることができる。

Further, the

表示処理部713は、記憶装置75から画像データ751を読み出し、この画像データ751から取得処理部711が取得した環境信号に対応する表示条件と関連付けられるキャラクター画像情報及び演出用画像情報を選択する。また、表示処理部713は、選択したキャラクター画像情報及び演出用画像情報と対応する画像を、出力部73に出力して表示させる。また、表示処理部713は、環境情報及び時刻情報に応じて、キャラクター画像及び演出用画像を表示してもよい。さらに、表示処理部713は、環境情報及び受信信号に応じて、キャラクター画像及び演出用画像を表示してもよい。

The

音声出力部714は、記憶装置75から音声データ752を読み出し、この音声データ752から取得処理部711が取得した環境信号に対応する出力条件と関連付けられる音声情報とを選択する。また、音声出力部714は、選択した音声情報と対応する音声を、出力部73に出力する。また、音声出力部714は、環境情報及び時刻情報に応じて、音声を出力してもよい。さらに、音声出力部714は、環境情報及び受信信号に応じて、音声を出力してもよい。

The

送信処理部715は、記憶装置75から信号データ753を読み出し、この信号データ753から取得処理部711が取得した環境信号と対応付けられる操作信号を選択する。また、送信処理部715は、読み出した操作信号を、出力部73に出力する。

The

データ管理部716は、画像表示装置1に内蔵される時計又は外部の時計から、時刻情報を取得する。時刻に応じて表示する画像や音声が定められるとき、この表示及び出力スケジュールに従い、表示処理部713及び音声出力部714に制御信号を出力する。

The

また、データ管理部716は、画像表示装置1の起動時に天気情報サイトにアクセスして、その日の天気情報を取得して記憶装置75に記憶させる。さらに、データ管理部716は、ユーザのスケジュールが登録されているカレンダーサイトに定期的にアクセスして、これにより得られる最新のカレンダー情報を記憶装置75に記憶させることができる。また、データ管理部716は、テレビや照明などの外部機器のリモコンから当該外部機器に関するリモコン情報(赤外線情報)を赤外線受光部707により受信させて記憶装置75に記憶(学習)させることができ、このリモコン情報に基づいて、外部機器を操作するための赤外線情報を赤外線LED703から発信させることができる。なお、データ管理部716は、様々なネットワーク上のデータにアクセスし、ユーザとの会話やチャットに用いることができる様々なデータを収集することもできる。

The

〈動作〉

画像表示装置1では、「スリープ状態」、「未召喚状態」、「召喚状態」等の各状態に応じて、画像の表示や音声の出力等の処理を実行する。図12に示すように、画像表示装置1は、コンセントが未接続の状態(S1)において、電源ボタン(図示せず)は有効ではないが、コンセントが挿されてコンセントが接続の状態になると(S2)、電源ボタンが有効になる。

<motion>

The

《未召喚状態》

コンセントが接続された状態(S2)で電源ボタンが押下されると、制御部71が起動する(S3)。この起動により、例えば、起動画面が表示され、「未召喚状態」に移行する(S4)。「未召喚状態」は、画像表示装置1に電源は入っており、プロジェクタ4は起動しているものの、キャラクター画像は表示されておらず、未召喚画像が表示される状態である。また、未召喚状態では、プロジェクタ4は起動しているものの、スピーカ705やカメラ722等は起動しておらず、環境信号を検出することはできない。画像表示装置1は、未召喚状態では、ステータスLED708が点灯している。

《召喚状態》

《Unsummoned》

When the power button is pressed while the outlet is connected (S2), the

《Summoned state》

未召喚状態(S4)でタッチボタン26が長押しされると、「召喚状態」に移行する(S5)。タッチボタン26が長押しされるとは、所定時間以上(例えば、3秒以上)、ユーザにタッチボタン26が触れられることをいう。この召喚状態が、画像表示装置1における特徴的な画像の表示や音声の出力の処理が実行される状態である。召喚状態は、画像表示装置1は、プロジェクタ4が起動しておりキャラクター画像が表示されるとともに、スピーカ705、カメラ722等が起動して環境信号の検出が可能な状態である。また、「召喚状態」では、(a)コミュニケーションモード、(b)ライフモード、(c)ケアモード、(d)アピールモード、(e)チャットモード等のモードがあり、これらのモード毎に所定の処理が実行される。

When the

《スリープ状態》

未召喚状態(S4)で電源ボタンが押下されるか、所定時間放置されると、「スリープ状態」に移行する(S6)。「所定時間放置される」とは、例えば、所定時間以上(例えば、20分以上)タッチボタン26が長押しされることがない状態である。スリープ状態は、省電力の待機モードの状態であり、プロジェクタ4も起動しておらず、スピーカ705やカメラ722等も起動していない状態である。画像表示装置1は、スリープ状態では、ステータスLED708が点灯している。

《Sleep state》

When the power button is pressed in the unsummoned state (S4) or left unattended for a predetermined time, the state shifts to the "sleep state" (S6). “Leaving for a predetermined time” means, for example, a state in which the

画像表示装置1は、スリープ状態で、ユーザにより、電源ボタンが押下、又は、タッチボタン26がタッチされると、未召喚状態に移行する。「タッチボタンがタッチされる」とは、所定時間未満(例えば、3秒未満)の時間、ユーザにタッチボタン26が触れられることをいう。

The

次に、召喚状態における、(a)コミュニケーションモード、(b)ライフモード、(c)ケアモード、(d)アピールモード、(e)チャットモードについて説明する。 Next, (a) communication mode, (b) life mode, (c) care mode, (d) appeal mode, and (e) chat mode in the summoned state will be described.

(a)コミュニケーションモード

コミュニケーションモードは、キャラクター画像が表示され、キャラクターとユーザとがコミュニケーションをとることが可能な状態である。具体的には、画像表示装置1は、コミュニケーションモードでは、取得処理部711が取得する環境信号に応じたキャラクター画像を表示する。また、画像表示装置1は、環境信号に応じた演出用画像を表示する。さらに、画像表示装置1は、環境信号に応じて音声を出力する。

(A) Communication Mode In the communication mode, a character image is displayed and the character and the user can communicate with each other. Specifically, in the communication mode, the

画像表示装置1は、未召喚状態から、タッチボタンが長押しされ、召喚状態に移行したとき、まず初めにコミュニケーションモードとなる。また、画像表示装置1は、コミュニケーションモードのタイミングで、所定時間以上(例えば、10分以上)継続して、環境信号が取得されず、また、操作信号等の信号を受信しない場合、ライフモードに移行する。

The

例えば、画像表示装置1では、マイク704によって環境信号であるユーザが発した「今日の天気は?」の言葉が検出されると、これに応じて、データ管理部716によって記憶装置75に記憶された天気情報に基づき、スピーカ705から「今日は晴れだよ」等の音声が出力される。また、画像表示装置1では、透過フィルム3に、晴れに対する喜びを表す動作をするキャラクター画像が表示される。さらに、画像表示装置1では、透過フィルム3に、晴れの天気を演出する演出用画像が表示される。演出用画像としては、図13(a)に示すように、単なる画像だけの他、「今日は晴れだよ」の文字を吹き出しで表示するなどテキストデータとの組み合わせであってもよい。これにより、ユーザは、今日の天気を教えてくれた、キャラクターと暮らすような感覚を覚え、キャラクターをより身近に感じることができる。なお、演出用画像は必須のものではなく、ランダムで表示非表示を切り替えることとしてもよい。

For example, in the

また例えば、画像表示装置1では、ユーザが画像表示装置1に近づき、カメラ722によってユーザの顔が大きく検出されると、これに応じて、スピーカ705から「近すぎだよ」等の音声が出力される。また、画像表示装置1では、透過フィルム3に、ユーザの顔が近くにあることを恥ずかしがる動作をするキャラクター画像が表示される。さらに、画像表示装置1では、キャラクターの恥ずかしがる感情を演出する演出用画像が表示される。演出用画像としては、図13(b)に示すように、単なる画像だけの他、「近すぎだよー」の文字を吹き出して表示するなどテキストデータとの組み合わせであってもよい。これにより、ユーザは、近くによると恥ずかしがるキャラクターと暮らすような感覚を覚え、キャラクターをより身近に感じることができる。

Further, for example, in the

さらに、例えば、画像表示装置1では、ユーザがタッチボタン26を複数回押すことで、複数回呼びかけてキャラクターの行動を邪魔するような動作をすると、これに応じて、スピーカ705から「もう、なんなのー」の音声が出力される。また、画像表示装置1では、透過フィルム3に、ユーザに複数回呼びかけられたことで、邪魔されたような動作をするキャラクター画像が表示される。さらに、画像表示装置1では、透過フィルム3に、ユーザの複数回の呼びかけを問うような演出用画像が表示される。これにより、ユーザは、複数回の呼びかけに対応するキャラクターに対しより身近に感じることができ、キャラクターと暮らすような感覚を覚えることができる。

Further, for example, in the

また例えば、画像表示装置1では、ユーザの通信端末から、キャラクターに物を送るような信号を送信すると、これに応じ、スピーカ705からこれを喜ぶような音声が出力され、また、透過フィルム3で送信された物を使用するキャラクターが表示されたりする。

Further, for example, in the

図14(a)に示すように、ユーザの通信端末を操作し、画像表示装置1のキャラクターに「テレビ」を送信する。そうすると、画像表示装置1において、図14(b)に示すように、演出用画像としてテレビが表示される。また、演出用画像には、例えば、「一緒にテレビみよ」という文字が吹き出しに含まれていてもよい。この場合、画像データ751において、テレビを送信する送信信号には、図14(b)に示すキャラクター画像及び演出用画像が対応付けられる。

As shown in FIG. 14A, the user's communication terminal is operated to transmit “TV” to the character of the

さらに、画像表示装置1において、「一緒にテレビみよ」という音声が出力される。この場合、音声データ752において、テレビを送信する送信信号には、「一緒にテレビみよ」という音声が出力される。

Further, the

そして、対象のテレビ番組が終了すると、図14(b)に示すように、画像表示装置1には、「おもしろかった」という文字を吹き出しに含む演出用画像が表示されてもよい。同時に、画像表示装置1は、「おもしろかった」という音声が出力される。この場合、画像データ751において、テレビを送信する送信信号を受信後所定時間が経過(テレビ番組が終了)したことを条件として、「おもしろかった」を含む演出用画像が対応付けられる。また、音声データ752において、テレビを送信する送信信号を受信後所定時間が経過(テレビ番組が終了)したことを条件として、「おもしろかった」の音声が対応付けられる。なお、テレビ番組の内容として、「面白い」がふさわしくない場合もあるため、その感想としてふさわしい感想の音声を選択して出力するようにしてもよい。

Then, when the target television program ends, as shown in FIG. 14B, the

加えて、ユーザがテレビを視聴の間、ユーザが笑ったりした場合、画像表示装置1は、ユーザの笑い声を検出すると、同時にキャラクターの笑う音声を出力するようにしてもよい。このようなキャラクター画像、演出用画像及び音声を出力することで、ユーザがキャラクターとともにテレビを視聴するような感覚を覚えることができる。

In addition, when the user laughs while watching the television, the

例えば、ユーザの通信端末の入力装置がタッチパネルであるとき、送信操作は、送信する物質の画像を、画像表示装置1の方向に向かって、フリックすることで、実行することができる。

For example, when the input device of the user's communication terminal is a touch panel, the transmission operation can be executed by flicking the image of the substance to be transmitted in the direction of the

図14(d)に示すように、ユーザの通信端末を操作し、画像表示装置1のキャラクターに「コーヒー」を送信する。そうすると、画像表示装置1において、図14(e)に示すように、演出用画像としてコーヒーが表示される。また、演出用画像には、例えば、「コーヒーブレイクしよう」という文字が吹き出しに含まれていてもよい。この場合、画像データ751において、コーヒーを送信する送信信号には、図14(e)に示すキャラクター画像及び演出用画像が対応付けられる。

As shown in FIG. 14D, the user's communication terminal is operated to transmit “coffee” to the character of the

さらに、画像表示装置1において、「コーヒーブレイクしよう」という音声が出力される。この場合、音声データ752において、コーヒーを送信する送信信号には、「コーヒーブレイクしよう」という音声が出力される。

Further, the

そして、所定時間(例えば、10分)が経過すると、図14(f)に示すように、画像表示装置1には、「ごちそうさまでした」という文字を吹き出しに含む演出用画像が表示されてもよい。同時に、画像表示装置1は、「ごちそうさまでした」という音声が出力される。この場合、画像データ751において、コーヒーを送信する送信信号を受信後所定時間が経過したことを条件として、「ごちそうさまでした」を含む演出用画像が対応付けられる。また、音声データ752において、コーヒーを送信する送信信号を受信後所定時間が経過したことを条件として、「ごちそうさまでした」の音声が対応付けられる。

Then, after a predetermined time (for example, 10 minutes) has passed, as shown in FIG. 14 (f), the

加えて、コーヒーを飲む間、画像表示装置1は、キャラクターがコーヒーを飲む動画像を表示したり、「おいしいね」等の音声を出力したりするようにしてもよい。このようなキャラクター画像、演出用画像及び音声を出力することで、ユーザがキャラクターとともにコーヒーを飲むような感覚を覚えることができる。

In addition, while drinking coffee, the

図14(g)に示すように、ユーザの通信端末を操作し、画像表示装置1のキャラクターに「食べ物(図14(g)では、ドーナツ)」を送信する。そうすると、画像表示装置1において、図14(h)に示すように、演出用画像として食べ物が表示される。また、演出用画像には、例えば、「ありがとう」という文字が吹き出しに含まれていてもよい。この場合、画像データ751において、食べ物を送信する送信信号には、図14(h)に示すキャラクター画像及び演出用画像が対応付けられる。

As shown in FIG. 14 (g), the user's communication terminal is operated, and “food (donut in FIG. 14 (g))” is transmitted to the character of the

さらに、画像表示装置1において、「ありがとう」という音声が出力される。この場合、音声データ752において、食べ物を送信する送信信号には、「ありがとう」という音声が出力される。

Further, the

そして、所定時間(例えば、10分)が経過すると、図14(i)に示すように、画像表示装置1には、「おいしかった」という文字を吹き出しに含む演出用画像が表示されてもよい。同時に、画像表示装置1は、「おいしかった」という音声が出力される。この場合、画像データ751において、食べ物を送信する送信信号を受信後所定時間が経過したことを条件として、「おいしかった」を含む演出用画像が対応付けられる。また、音声データ752において、食べ物を送信する送信信号を 受信後所定時間が経過したことを条件として、「おいしかった」の音声が対応付けられる。

Then, when a predetermined time (for example, 10 minutes) has elapsed, as shown in FIG. 14 (i), the

図15(a)に示すようにユーザの通信端末で表示される複数種類の衣類やアクセサリーの中から、図15(b)に示すように、いずれかを選択し、選択した衣類等を送信する操作を可能としてもよい。そうすると、画像表示装置1において、図15(c)に示すように、送信した衣類を身に着けたキャラクターのキャラクター画像が表示される。また、演出用画像には、例えば、「ありがとう」という文字が吹き出しに含まれていてもよい。さらに、画像表示装置1において、「ありがとう」という音声が出力される。

As shown in FIG. 15B, one of the plurality of types of clothing and accessories displayed on the user's communication terminal as shown in FIG. 15A is selected and the selected clothing or the like is transmitted. It may be operable. Then, on the

この場合、画像データ751において、当該送信信号には、図15(c)に示すキャラクター画像及び演出用画像が関連付けられる。また、音声データ752において、当該送信信号には、「ありがとう」という音声が関連付けられる。

In this case, in the

このようなキャラクター画像、演出用画像及び音声を出力することで、ユーザがキャラクターにプレゼントをしたような感覚を覚えることができる。また、ユーザは、キャラクターに好みの服を着せることができる。したがって、ユーザはキャラクターをより身近に感じることができる。 By outputting such a character image, effect image, and voice, it is possible to feel as if the user gave a present to the character. In addition, the user can dress the character in his favorite clothes. Therefore, the user can feel the character closer.

その他、ユーザがハブラシのデータを送信すると、画像表示装置1は、キャラクターが歯磨きをする様子の画像を表示し、ユーザはキャラクターとともに歯磨きできるようにしてもよい。また、ユーザが縄跳びやダンベルのデータを送信すると、画像表示装置1は、運動をする様子の画像を表示し、ユーザはキャラクターとともに運動できるようにしてもよい。

In addition, when the user transmits toothbrush data, the

なお、記憶装置75において、キャラクターの好みに関する嗜好データや過去に送信したアイテムやプレゼントに関する履歴データを記憶していてもよい。この場合、図14及び図15で上述したようなアイテムやプレゼントを送信すると、その嗜好や履歴によって、キャラクターの反応が異なるようにしてもよい。例えば、キャラクターが好きなアイテムを送信した場合、キャラクターの喜びが大きい画像と音声で表現される。これに対し、キャラクターが特に好きではないアイテムを送信した場合、キャラクターの喜びが小さい画像と音声で表現される。また、同じアイテムを送信し続けた場合、喜び方が小さくなるようにしてもよい。さらに、食べ物を送信する頻度が多くなると、「太っちゃうよー」等と画像と音声で表現されるようにしてもよい。このように、キャラクターの反応が常に同一ではないため、ユーザは、キャラクターにより親しみをもつことができる。

It should be noted that the

また、さらには、コミュニケーションモードにおいては、画像表示装置1は、ユーザとする会話の話題を選択するにあたって、取得処理部711が取得する環境信号以外に、所定の確率(予め定められた確率で、過去のコミュニケーションに関連する会話を行うか否かを判定するための確率。この確率は、適宜、変動することとしてもよい)で、過去においてした会話の内容及び後述するチャットモードにおいて画像表示装置1がユーザの通信端末との間で実行したチャットの内容に応じた話題に基づくランダム会話を実行する。

Further, in the communication mode, the

具体的には、制御部71は、人感センサ702が人(ユーザ)を検出しているときに、ランダムなタイミングで、乱数を生成するプログラムに従って生成したランダムな数値(例えば、0〜100の数値)が、所定の閾値を超えるか否かを判定し、この閾値を超えた場合に、制御部71は、会話履歴データ755と、チャット履歴データ256とを記憶装置75から読み出す。そして、会話履歴データ755の会話内容情報903と、チャット履歴データ256のチャット内容情報1003とに含まれる会話の内容からキーワードを選択し、そのキーワードに応じた画像データ751及び音声データ752から読み出して、キーワードと一致するタグを有する画像データと音声データを特定し、表示処理部713が特定した画像データをプロジェクタ4から出力するとともに、音声出力部714が特定した音声データをスピーカ705から出力する。ランダムな会話において、画像表示装置1が過去において実行した会話の話題に関連する会話を行うので、ユーザは、画像表示装置1に表示されるキャラクターにより親近感を覚える。また、ユーザが自身の通信端末でしたチャットの内容に関する話題に基づく会話も行うので、ユーザは、より一層、キャラクターに親近感を覚え、身近に感じることができる。また、ユーザがした会話に対して音声認識処理を行うことで、画像表示装置1は、会話のテキストデータを得て、会話履歴データ755に会話の内容を追加し、以降の会話及びチャットに利用することができる。例えば、チャットでユーザがした「野球の試合を見てるよ」というチャット内容を受けて、キャラクターが「今日、テレビで野球中継をやるよ」というような発言をさせることで、ユーザにキャラクターと行ったチャットの内容を思い出させることができるとともに、キャラクターがそのことを覚えてくれていたことに、ユーザは、親近感を感じることができる。また、画像表示装置1は、音声認識した結果から、出力条件に対応する音声を出力したり、ランダム会話の対応する会話の音声を出力したりすることができる。

Specifically, the

以下、このようなコミュニケーションモードを実現する画像表示装置1の汎用動作を説明する。

Hereinafter, a general-purpose operation of the

図16に示すように、取得処理部711は、各種の環境信号を取得する(S161)。取得処理部711が取得した各種の環境信号は、解析部712に伝達され、解析部712は伝達された環境信号を解析する(S162)。解析結果及び画像データ751、音声データ752、信号データ753等を参照して、制御部71は、キャラクターが実行すべきキャラクター動作が規定された条件のいずれかに合致するかを判定する(S163)。判定の結果、実行すべきキャラクター動作があった場合には(S163:YES)、音声出力部714は、対応する音声を出力するとともに、表示処理部713は対応するキャラクター画像をプロジェクタ4から投影する(S164)。解析の結果、実行すべきキャラクターが動作がない場合には(S164:NO)、制御部71は、ステップS165の処理に移行する。

As illustrated in FIG. 16, the

ステップS165において、制御部71は、例えば、0〜100のランダム値を生成する(S165)。なお、ランダム値は0〜100の範囲に限られない。制御部71は、生成したランダム値と、これと比較するための閾値との間で大小を比較する。ランダム値が閾値よりも大きい場合に(S166:YES)ステップS167に移行し、ランダム値が閾値以下である場合に(S166:NO)、処理を終了する。

In step S165, the

ステップS167において、制御部71は、会話履歴データ755及びチャット履歴データ756を読み出す。読み出した会話履歴データ755の会話内容情報903とチャット履歴データ756のチャット内容情報1003とからキーワードを抽出する。これは、例えば、構文解析等により実現できる。そして、例えば、直近(例えば1日)のキーワードの登場頻度の高いキーワードを選択する。当該キーワードの選択は、ランダムであってもよいし、その他の基準で選択することとしてもよい。

In step S167, the

制御部71は、選択したキーワード及びステップS161で取得した環境信号に合致する会話があるか否かを、ランダム会話データ757を参照して特定する(S168)。そして、音声出力部714は、特定した会話の音声をスピーカ705から出力する。また、このとき、表示処理部713は、対応するキャラクター画像があれば、それを投影し(S169)、処理を終える。例えば、キャラクターがする会話の内容が「野球」に関する内容であれば、キャラクターが野球のユニフォームを着ている画像を表示したり、ボールやバットなどのアイテムを持たせた画像を表示したりする。

The

図16の処理は、コミュニケーションモードにおいて繰り返し実行される。このように、ランダムな会話において、キャラクターは、ユーザと過去に交わした会話内容や、実行したチャットの内容に基づく、会話を行うので、ユーザはキャラクターとの間の歴史の積み重ねを感じて、よりキャラクターを身近に感じることができる。 The process of FIG. 16 is repeatedly executed in the communication mode. In this way, in a random conversation, the character carries out a conversation based on the contents of the conversation with the user in the past and the contents of the chat that was performed, so that the user feels the accumulation of history with the character and You can feel the character close to you.

(b)ライフモード

ライフモードは、キャラクター画像が表示され、このキャラクター画像が環境信号に依存せず、例えば、時刻に応じて変化する状態である。例えば、画像表示装置1では、朝であれば、朝ごはんを作ったり、朝ごはんを食べたり、掃除をしたりする画像が表示される。昼であれば、昼ごはんを作ったり、昼ごはんをたべたり、アイロンをかけたりする画像が表示される。夜であれば、夕ごはんを作ったり、夕ごはんを食べたり、ストレッチをしたりする画像が表示される。

(B) Life Mode The life mode is a state in which a character image is displayed and the character image does not depend on the environmental signal and changes according to time, for example. For example, the

その他、キャラクターが洗濯をしたり、掃除をしたり、歯磨きをしたり、シャワーをしたりする画像であってもよい。また、単に、キャラクターが、椅子に座って足をぶらぶらする画像や、椅子に座ってスマートフォン等の通信端末を操作する画像、椅子に座って絵を書く画像等を表示してもよい。その他、キャラクターがベッドの上で漫画を読む画像、ベッドの上で周りを見回す画像、ベッドの上で寝ている画像等を表示してもよい。 In addition, it may be an image in which the character is doing laundry, cleaning, brushing teeth, or taking a shower. Further, the character may simply display an image of sitting on a chair and hanging out his legs, an image of sitting on a chair and operating a communication terminal such as a smartphone, an image of sitting on a chair and drawing a picture. In addition, an image in which a character reads a cartoon on the bed, an image of looking around the bed, an image of sleeping on the bed, and the like may be displayed.

また、この頻度や確率を管理することが可能であり、日によって、異なる動作をする画像を表示するようにすることも可能であり、また、動作時間は、完全に同一でなくてもよく、ある範囲の中でランダムに選択される。これにより、また、ユーザが興味のある行動については、長い時間表示されるようにしてもよい。例えば、朝ごはんを作っているときにユーザが「かわいいね」ということが多い場合、朝ごはんを作る画像を表示する時間を長くすることができる。 In addition, it is possible to manage the frequency and probability, it is also possible to display images that perform different actions depending on the day, and the operating time does not have to be completely the same, It is randomly selected within a range. Thereby, the behavior in which the user is interested may be displayed for a long time. For example, when the user is often “pretty” while making breakfast, the time for displaying the image for making breakfast can be lengthened.

画像表示装置1は、ライフモードのタイミングで、タッチボタン26が触れられると、コミュニケーションモードに移行する。また、ライフモードにおいて、所定のタイミングで、ケアモードやアピールモードに移行する。

The

(c)ケアモード

ケアモードは、予め登録されたユーザのスケジュールに応じ、所定の各タイミングで、キャラクター画像や演出用画像を表示し、タイングに応じた音声を出力する。例えば、画像表示装置1は、「おはよう」、「いってらっしゃい」、「おはよう」、「おやすみ」等の音声を出力する。

(C) Care Mode In the care mode, the character image and the effect image are displayed at predetermined timings according to the user's pre-registered schedule, and the voice corresponding to the towing is output. For example, the

例えば、ユーザは、通信端末等を利用し、事前に図17(a)に示すような登録画面W1を介して、各時刻入力ボックスb11〜b14に時刻を入力し、日々の行動の「起床時間」、「外出時間」、「帰宅時間」及び「就寝時間」を登録する。 For example, the user uses a communication terminal or the like to input a time in advance in each time input box b11 to b14 via a registration screen W1 as shown in FIG. , "Outing time", "Return time" and "Bed time" are registered.

また、このスケジュールに変更が生じた場合、再度この登録画面W1を利用して更新することもできるが、1日のみ予定を変更したい場合、後述するチャットモードにより、図17(b)に示すようなチャット画面W2を利用して変更してもよい。チャット画面W2は、送信するメッセージを入力する入力部b21と、入力したメッセージを送信する送信部b22と、メッセージ例が表示されるメッセージ表示部b23と、送信されたメッセージが表示されるメッセージ表示部b24とを有する。 When the schedule is changed, the registration screen W1 can be used again to update the schedule. However, if the user wants to change the schedule for only one day, the chat mode described below can be used to change the schedule as shown in FIG. It may be changed using a different chat screen W2. The chat screen W2 includes an input unit b21 for inputting a message to be transmitted, a transmission unit b22 for transmitting the input message, a message display unit b23 for displaying a message example, and a message display unit for displaying the transmitted message. b24.

図18のチャートに示すように、画像表示装置1は、『起床モード』を実行することができる。具体的には、登録された起床時間の所定時間前(例えば、「1時間前」)に、『起床モード』が開始される(S201)。

As shown in the chart of FIG. 18, the

この状態で、解析部712によりユーザの顔が検出される、又は、タッチボタン26がタッチされると、ユーザが起床したと判定される。また、ユーザが起床したことを条件に、表示処理部713により「おはよう」の挨拶をするキャラクター画像及び演出用画像が表示され、音声出力部714により「おはよう」の挨拶が出力される(S202)。

In this state, when the

その他、ユーザの行動に応じた言葉が出力されてもよい。ユーザが登録される起床時間より早く目覚めた場合、「シャキッと目覚めたね」の音声を出力することができる。ユーザが前日に遅刻した場合、「今日は遅刻しないでね」の音声を出力することができる。カーテンが閉まっていることが検出された場合、「カーテン開けようね」の音声を出力することができる。ユーザの前日の就寝時間が遅く、今日の起床時間が遅い場合、「昨日遅くまで起きているからよ」の音声を出力することができる。 In addition, words according to the user's action may be output. When the user wakes up earlier than the registered wake-up time, the sound of "awakening" can be output. If the user is late for the day before, the voice of "Please do not be late today" can be output. When it is detected that the curtain is closed, the sound "Let's open the curtain" can be output. If the user's bedtime is late on the previous day and today's wake-up time is late, the voice of "Because I woke up late yesterday" can be output.

ユーザの起床が判定されると、送信処理部715は操作信号を送信し、所定の家電を操作する(S203)。例えば、起床後に起動する家電として、コーヒーメーカーがセットされている場合、コーヒーメーカーが起動される。

When it is determined that the user gets up, the

また、ユーザの起床が判定されると、朝の情報通知の画像や音声を出力する(S204)。例えば、「日付」、「天気」、「気温」等を通知する画像や音声を出力する。 Further, when it is determined that the user is getting up, the image or sound of the morning information notification is output (S204). For example, it outputs an image or sound notifying "date", "weather", "temperature" and the like.

家電の操作や朝の情報通知に関する画像や音声の出力に対してユーザが発した音声が検出されると、これに対するキャラクターの挨拶の音声が出力される(S205)。例えば、ユーザが発した「ありがとう」が検出されると、キャラクターの音声として「どういたしまして」等の音声が出力される。その後、所定時間が経過すると、ライフモードに移行する(S213)。 When the voice uttered by the user is detected in response to the operation of the home electric appliance or the output of the image or the voice regarding the notification of information in the morning, the voice of the character's greeting is output (S205). For example, when "thank you" issued by the user is detected, a voice such as "you are welcome" is output as the voice of the character. After that, when a predetermined time elapses, the life mode is entered (S213).

また、未召喚状態の場合に、起床時間の所定時間前(例えば、30秒前)までに、解析部712によりユーザの顔が検出されず、又は、タッチボタン26がタッチされていないとき、召喚状態となる(S206)。

In the unsummoned state, when the user's face is not detected by the

未召喚状態から召喚状態となると、送信処理部715は、操作信号を送信し、予め登録される家電を操作する(S207)。

When the unsummoned state is changed to the summoned state, the

また、起床時刻まで解析部712によってユーザの顔検出がされないとき、表示処理部713はユーザを起こす画像を表示し、音声出力部714がユーザを起こす音声を出力し、目覚まし機能を開始する(S208)。例えば、ユーザを起こす音声としては、キャラクターの「朝だよ」等の音声である。

When the user's face is not detected by the

解析部712によりユーザの顔が検出された場合、又は、タッチボタン26がタッチされた場合、ステップS202に移行する。一方、ユーザの顔も検出されず、タッチボタン26のタッチもされないとき、スヌーズ機能として、ユーザを起こす画像と音声の出力を継続する(S209)。例えば、ユーザを起こす音声は、徐々の大きくすることができる。また、画像表示装置1から出力される光の光量を上げてもよい。

When the

解析部712によりユーザの顔が検出された場合、又は、タッチボタン26がタッチされた場合、ステップS202に移行する。一方、ユーザの顔も検出されず、タッチボタン26のタッチもされないとき、送信処理部715が操作信号を送信し、予め登録される家電を操作する(S210)。

When the

さらに、ユーザを起こす画像と音声を最終手段の画像及び音声とする(S211)。例えば、表示処理部713は、キャラクターがフライパンをたたく画像を表示する。また、例えば、音声出力部714は、キャラクターが「起きないとおくれるよー」と言いながらフライパンがたたかれる音を含む音声を出力する。

Further, the image and sound of the user are set as the image and sound of the final means (S211). For example, the

その後、解析部712によりユーザの顔が検出された場合、又は、タッチボタン26がタッチされた場合、ステップS202に移行する。一方、解析部712により顔検出がされず、タッチボタン26の検出もないとき、画像表示装置1は、ユーザの状態を不明とし(S212)、ライフモードに移行する(S213)。

After that, when the

図19のチャートに示すように、画像表示装置1は、『外出モード』を実行することができる。具体的には、登録された外出時間の所定時間前(例えば、「5分前」)に、『外出モード』が開始され、未召喚状態(S301)から召喚状態に移行する(S302)。

As shown in the chart of FIG. 19, the

また、出発時刻になると、アラートの画像及び音声が出力される(S303)。例えば、アラートとは、ユーザを急がせるようなキャラクターの画像とキャラクターの「出発だよ」の音声等である。 At the departure time, the alert image and sound are output (S303). For example, the alert is an image of a character that urges the user and a voice of "departure" of the character.

また、送信処理部715は操作信号を送信し、所定の家電を操作する(S303)。

In addition, the

さらに、表示処理部713は、外出チェックの画像を表示し、音声出力部714は、外出チェックの音声を出力する(S304)。例えば、予定の確認、忘れ物の確認、降水確率が高い場合に傘を持つよう促す確認等を通知する画像や音声を出力する。

Further, the

また、出発時刻になると、表示処理部713は、出発を急がせる画像を出力し、音声出力部714は、出発を急がせる音声を出力する(S305)。例えば、キャラクターが慌ただしく動く動画像と、キャラクターの「もう出発時間!遅刻だよ」等の音声である。

Further, at the departure time, the

解析部712がユーザの「行ってきます」の音声を検出したとき、表示処理部713は、これに応じた画像を表示し、音声出力部714は、これに応じた音声を出力する(S306)。例えば、表示処理部713は、ユーザに手を振るキャラクター画像を表示する。また、音声出力部714は、「いってらっしゃい」等の音声を出力する。また、出力する音声は、登録されるユーザのスケジュールやユーザの行動履歴等に応じて変更してもよい。

When the

その後、送信処理部715は操作信号を送信し、所定の家電を操作する(S307)。

After that, the

ステップS305で出発時刻を通知後、又は、ステップS307で家電を操作後、ライフモードに移行する(S308,S309)。さらに、所定時間(例えば、10分)経過後、人感センサ702によって人が検出されない場合、スリープ状態に移行する(S310)。

After the departure time is notified in step S305 or the home appliance is operated in step S307, the life mode is entered (S308, S309). Furthermore, if a person is not detected by the

図20に示すように、画像表示装置1は、環境信号に応じて「外出・帰宅判定」が可能であり、これに応じて『帰宅モード』を実行することができる。具体的には、図15を用いて上述した『外出モード』において外出が判定された後、画像表示装置1がスリープ状態であるとき(S41)、ユーザの通信端末から帰宅予定のメッセージを受信すると、帰宅準備として、召喚状態に移行する(S42)。

As shown in FIG. 20, the

その後、送信処理部715は操作信号を送信し、所定の家電を操作する(S43)。

After that, the

また、画像表示装置1は、人感センサ702で人を検出したタイミング、家の照明の電源がオンにされたタイミング、ドアが開けられたタイミングで、帰宅をしたと予想する「帰宅予想」と判定する(S44)。ここで、ドアの開閉は、気圧センサ(図示せず)による気圧の変化の検出や、騒音センサ613による音の検出によって判定することができる。また、帰宅予想が判定されると、音声出力部714は、「帰ってきたみたいだー」等の音声を出力してもよい。

Further, the

帰宅予想が判定されると、送信処理部715は操作信号を送信し、所定の家電を操作する(S45)。

When the return-home expectation is determined, the

また、画像表示装置1は、解析部712によりユーザの顔が検出された場合、又は、タッチボタン26がタッチされた場合、「帰宅」と判定される。また、ユーザが帰宅したことを条件に、表示処理部713は、帰宅の挨拶をするキャラクター画像及び演出画像が表示され、音声出力部714により帰宅の挨拶の音声が出力される(S46)。例えば、帰宅の挨拶としては、「おかえり」に限られず、「今日も遅いんだから―」、「今日は早ね」、「今日はおそいね」、「おつかれさま」等、日々のユーザの行動履歴等に基づいて決定される音声を含むことができる。

Further, in the

ユーザが発した音声が検出されると、これに対してキャラクターの返答の音声が出力される(S47)。例えば、キャラクターは、その日にしたこととして、「昨日ドーナツを食べたから、今日は運動したよ」等の音声を出力してもよい。また、家で起きたことを知らせてもよい。例えば、玄関のチャイムが複数回鳴った場合、「今日は誰かが来ていたよ」等の音声を出力してもよい。 When the voice uttered by the user is detected, the voice of the character's reply is output in response to this (S47). For example, the character may output a sound such as "I ate donuts yesterday, so I exercised today" as what I did that day. You may also inform them of what happened at home. For example, when the chime at the entrance rings a plurality of times, a voice such as "Someone came today" may be output.

一方、帰宅予想を判定後、所定時間(例えば30秒間)、帰宅が判定できないとき、帰宅確認をする(S48)。例えば、帰宅確認とは、音声出力部714によって、「帰ってきたの?顔みせなさいよ」等の音声を出力する。また、表示処理部713によって、拗ねたようなキャラクター画像や怒ったようなキャラクター画像と、演出用画像を表示する。

On the other hand, if it is not possible to determine whether to return home for a predetermined time (for example, 30 seconds) after the determination of return home expectation, home return confirmation is performed (S48). For example, to confirm the return home, the

ステップS47でユーザの挨拶に対して返答した後、又は、ステップS48で帰宅確認をした後、ライフモードに移行する(S49)。 After replying to the greeting of the user in step S47 or after returning home in step S48, the life mode is entered (S49).

(d)アピールモード

アピールモードは、時刻やセンサ等で検出される信号等に応じ、各条件に応じたキャラクター画像や演出画像を表示し、各条件に応じた音声を出力する。例えば、画像表示装置1は、時刻に応じて、「もう8時だよ」等の音声を出力することができる。また、画像表示装置1は、温度に応じて、「なんか暑いね」等の音声を出力することができる。これにより、ユーザは思わぬタイミングでキャラクターから話しかけられるため、キャラクターをより身近に感じることができる。

(D) Appeal mode In the appeal mode, a character image or effect image according to each condition is displayed according to the time, a signal detected by a sensor, etc., and a sound according to each condition is output. For example, the

(e)チャットモード

チャットモードは、ユーザが外出中等、画像表示装置1と離れた場所にいる場合、ユーザが保持する通信端末との間でメッセージの送受信を実現する。ユーザが保持する通信端末とは、例えば、スマートフォンや携帯電話機等の携帯通信端末のことである。

(E) Chat Mode In the chat mode, when the user is away from the

チャットモードにおける基本的なアルゴリズムは、ユーザとの会話と同様に行うことができる。ただし、ユーザからの音声入力に代えて、チャット上の文字列を入力として画像表示装置1は、チャットを行う。

The basic algorithm in the chat mode can be performed similarly to the conversation with the user. However, instead of the voice input from the user, the

図21は、チャットモードに画像表示装置1の動作を示すフローチャートであって、チャットモードで動作中のフローチャートである。なお、チャットモードを実行する場合、ユーザは、自身の通信端末で画像表示装置1とのチャットを行うためのチャットアプリケーションを実行する。すると、ユーザの通信端末からチャットアプリケーションの起動信号がネットワークを介して画像表示装置1に送信される。すると、画像表示装置1の制御部71は、チャットモードを起動し、ユーザの通信端末との間のチャットを、チャットサーバを介して開始する。なお、画像表示装置1は、人感センサを用いてユーザが周囲にいないことを検出して、所定の条件のもとで、画像表示装置1側からチャットモードを起動し、ユーザの通信端末にチャットアプリケーションの起動信号を送信してチャットを開始することとしてもよい。当該チャットサーバは、画像表示装置1のための専用サーバであってもよいし、汎用のチャットサーバであってもよい。

FIG. 21 is a flowchart showing the operation of the

図21に示すように、まず、取得処理部711は、各種の環境信号を取得する(S501)。この環境信号は、チャット上でユーザが入力した最新の発言を含んでよい。取得処理部711が取得した各種の環境信号は、解析部712に伝達され、解析部712は伝達された環境信号を解析する(S502)。解析部712は、ユーザのチャット上の発言内容の文字列に対して構文解析を行って、発言内容を認識する。また、解析部712は、その他の環境信号、例えば、天候情報などから状況を判断する。制御部71は、解析結果及び音声データ752、信号データ753等を参照して、キャラクターが実行すべきチャット上の発言が規定された条件のいずれかに合致するかを判定する(S503)。なお、音声データ752は、音声を規定する情報ではあるが、会話という概念においてチャットと共通することから、チャットにおいても利用できる。判定の結果、発言すべき内容があった場合には(S503:YES)、送信処理部715は、特定した発言内容のメッセージをチャットアプリケーションを介して、ユーザの通信端末に送信する(S504)。解析の結果、実行すべきキャラクター発言がない場合には(S504:NO)、制御部71は、ステップS505の処理に移行する。

As shown in FIG. 21, first, the

ステップS505において、制御部71は、例えば、0〜100のランダム値を生成する(S505)。なお、ランダム値は0〜100の範囲に限られない。制御部71は、生成したランダム値と、これと比較するための閾値との間で大小を比較する。ランダム値が閾値よりも大きい場合に(S506:YES)ステップS507に移行し、ランダム値が閾値以下である場合に(S506:NO)、処理を終了する。

In step S505, the

ステップS507において、制御部71は、会話履歴データ755及びチャット履歴データ756を読み出す。読み出した会話履歴データ755の会話内容情報903とチャット履歴データ756のチャット内容情報1003とからキーワードを抽出する(S507)。これは、例えば、構文解析等により実現できる。そして、例えば、直近(例えば1日)のキーワードの登場頻度の高いキーワードを選択する。当該キーワードの選択は、ランダムであってもよいし、その他の基準で選択することとしてもよい。

In step S507, the

制御部71は、選択したキーワード及びステップS501で取得した環境信号に合致する会話があるか否かを、ランダム会話データ757を参照して特定する(S508)。そして、送信処理部715は、特定した発言の内容を示すメッセージを、チャットアプリケーションを介してユーザの通信端末に送信する(S509)。また、このとき、送信処理部715は、対応するキャラクター画像があれば、その画像をチャット上で表示するための画像データをチャットアプリケーションを介して送信し、処理を終える。例えば、キャラクターがする会話の内容が「野球」に関する内容であれば、キャラクターが野球のユニフォームを着た画像を送信したり、ボールやバットなどのアイテムを持たせた画像を送信する。

The

図21の処理は、チャットモードにおいて繰り返し実行される。このように、チャットにおけるランダムな会話において、キャラクターは、ユーザと過去に交わした会話内容や、実行したチャットの内容に基づく、発言を行うので、ユーザはキャラクターとの間の歴史の積み重ねを感じて、よりキャラクターを身近に感じることができる。そして、画像表示装置1は、図16の処理と図21の処理とにより、会話の内容とチャットの内容が互いに連動する構成を実現できている。なお、チャットの内容が以降の会話の内容に反映され、会話の内容が以降のチャットの内容にも反映されるように構成されていれば、画像表示装置1は、本実施の形態に示したアルゴリズム以外のアルゴリズムに従って動作して、同様の構成を実現してもよいことはいうまでもない。

The process of FIG. 21 is repeatedly executed in the chat mode. In this way, in a random conversation in a chat, the character speaks based on the content of the conversation with the user in the past and the content of the chat performed, so the user feels that history has accumulated with the character. , You can feel the character closer to you. Then, the

上述の構成により、例えば、図22(a)に示すようなチャットを行うことができる。図22(a)は、ユーザの通信端末におけるチャット画面の表意例を示している。チャット画面W3には、ユーザとキャラクターとの発言内容が表示される。ユーザは、通信端末のタッチパネル(図示せず)を利用して、入力部b21にメッセージを入力し、送信部b22をタッチしてメッセージを送信する。 With the above configuration, for example, a chat as shown in FIG. 22A can be conducted. FIG. 22A shows an ideographic example of a chat screen on the user's communication terminal. The chat screen W3 displays the content of the statement made by the user and the character. The user uses the touch panel (not shown) of the communication terminal to input a message to the input unit b21 and touches the transmission unit b22 to transmit the message.

また、このチャットにおいては、図22(b)のチャット画面W4に示すように、通常のチャットとは異なり、キャラクターから、質問が投げかけられて、それに対する回答としての選択肢b220を表示することもできる。これは、画像表示装置1との間で専用のチャットアプリケーションをユーザの通信端末にインストールすることで実現することができる。また、この場合、チャットサーバは、この制御を実現するための画像表示装置1からのコマンドをユーザの通信端末に中継する機能を有する。このコマンドには、ユーザが選択した回答のコマンドも含まれる。このような構成にすることで、ユーザにキャラクターとのゲームをしている感覚を与えることもできる。したがって、ユーザは、キャラクターとゲーム感覚でチャットを楽しむこともができる。

Also, in this chat, as shown in the chat screen W4 of FIG. 22 (b), unlike a normal chat, a question may be posed by the character, and an option b220 as an answer thereto may be displayed. . This can be realized by installing a dedicated chat application with the

なお、本実施の形態においては、会話履歴データ755及びチャット履歴データ756を利用した会話やチャットはランダムに実行することとしているが、これはその限りではなく、予め定められた条件が満たされた場合には、必ず実行するようにしてもよいことはいうまでもない。

In the present embodiment, the conversation and the chat using the

《音声に関する動作》

例えば、ユーザがマイク704に向かってキャラクターの名前を呼ぶと、画像表示装置1は、その名前に対応するキャラクターの画像を表示させることができる。また、ユーザが、表示されたキャラクターに特定の話題について話しかけると、画像表示装置1は、ユーザに対して応答した音声を出力することができる。

<Voice-related operations>

For example, when the user calls the name of the character into the microphone 704, the

このため、ユーザは、好きなときに、好きなキャラクターを呼び出すことができ、このキャラクター等をより立体的に見せることが可能な透明なケース2の中に表示させることができる。また、ユーザがキャラクター等に向かって話しかけると、あたかもそのキャラクター等が、ユーザの話しかけに応じた振る舞いをするように動作させることができる。このため、同じ空間にいるキャラクター等と一緒に生活をしているかのような感覚をユーザに与えることができる。

Therefore, the user can call a favorite character when he / she likes, and can display the character or the like in the

また、音声入力に応じて照明の点灯/消灯を制御することもできる。例えば、「電気消して」や「おやすみなさい」の音声がマイク704から入力されると、制御部71は、予めこの文字列に紐付けて記憶装置75に記憶されている照明の消灯に関するリモコン情報を記憶装置75から取り出し、対応する赤外線情報を赤外線LED703から発信させる。これにより、室内の照明を消灯することができる。また、同様に、「おかえり」や「おはよう」に応じて照明を点灯することもできる。

Further, it is also possible to control the turning on / off of the light according to the voice input. For example, when a voice such as “turn off electricity” or “good night” is input from the microphone 704, the

さらに、このような音声入力と、人感センサ702による人の検知を組み合わせた制御動作も可能である。例えば、ユーザの話しかけにより「いってきます」の音声をマイク704から入力すると、制御部71は、この音声により得られる文字列に対応した監視モードに移行する。なお、キャラクター等による「いってらっしゃい」に対応して監視モードに移行することもできる。

Furthermore, a control operation that combines such voice input and detection of a person by the

監視モードは、ユーザが室内に存在しない状態におけるモードである。このため、監視モードは、ユーザの話しかけによる「ただいま」の音声を入力し、この音声により得られる文字列を検出すると解除することができる。なお、キャラクター等による「おかえりなさい」に対応して監視モードを解除することもできる。 The monitoring mode is a mode in which the user is not in the room. Therefore, the monitoring mode can be canceled by inputting the voice of "I'm home" by the user speaking and detecting the character string obtained from this voice. It should be noted that the monitoring mode can be canceled in response to "welcome back" by a character or the like.

監視モード中に、例えば、人感センサ702により人が検知されると、制御部71は、これを異常と判断し、これを報知することができる。具体的には、所定の警報音や警告メッセージをスピーカ705から出力したり、通信部76を介して予め登録した宛先に所定のメッセージを送信することができる。また、このとき、制御部71は、カメラ722に室内を撮影させて、記憶装置75に画像を記憶したり、通信部76を介して予め登録した宛先に画像を送信することもできる。

For example, when a person is detected by the

なお、監視モード中に人感センサ702により人が検知された後、すぐに異常と判断して報知を行ってもよく、また、一定時間内に監視モードの解除がない場合に異常と判断して報知を行うこともできる。

It should be noted that, after a person is detected by the

《赤外線LEDに関する制御動作》

赤外線LED703を用いた制御動作として、以下の動作を行うことができる。具体的には、制御部71は、タイマープログラムによって予めセットされた起床時刻になると、その時刻情報に紐付けられている行動情報に基づき、対応する機器の動作を制御する。

<< Control operation for infrared LED >>

The following operations can be performed as a control operation using the

例えば、起床時(7:00)に「照明点灯」、就寝時(23:00)に「照明消灯」といったタイマープログラムを登録した場合、制御部71は、7:00になると、「照明点灯」のリモコン情報を記憶装置75から取り出し、対応する赤外線情報を赤外線LED703から発信させ、23:00になると、「照明消灯」のリモコン情報を記憶装置75から取り出し、対応する赤外線情報を赤外線LED703から発信させる。このようにすると、所定の日時に所定の機器を自動的に動作させることができる。

For example, when a timer program such as "lighting on" when waking up (7:00) and "lighting off" at bedtime (23:00) is registered, the

このほか、温湿度センサ611により検知される温湿度に応じてエアコン等のオン/オフ制御を行ったり、時間帯に応じてテレビのオン/オフ制御を行うこともできる。 In addition, on / off control of the air conditioner or the like can be performed according to the temperature and humidity detected by the temperature / humidity sensor 611, and on / off control of the television can be performed according to the time zone.

《センサに関する制御動作》

光センサ721を用い、例えば、昼間であるにもかかわらず、カーテンが開いていないことを検知して、ユーザにカーテンを開けるよう促すことができる。

<Control operation related to sensor>

Using the

具体的には、日の出の時刻をカレンダー情報として記憶装置75に記憶しておき、その時刻を過ぎても、光センサ721から入力される照度が所定の照度に満たない場合、制御部71は、予め記憶装置75に記憶している音声データ(「カーテンあけよう」)を、スピーカ705から出力させる。

Specifically, the time of sunrise is stored in the

《騒音センサに関する制御動作》

騒音センサ613を用い、例えば、テレビが長時間つきっぱなしであることをユーザに注意することができる。具体的には、制御部71は、騒音センサ613により入力された音の音量、周波数等に基づき、テレビがつけられたと判断すると、その判断をしたときから計時を開始し、その状態の時間が所定時間を超過した場合に、予め記憶装置75に記憶している音声データ(「テレビ消そうよ」)を取り出し、スピーカ705から出力させる。これにより、省エネに貢献するとともに、あたかも嫁から注意されているかのような感覚をユーザに与えることができる。

<< Control operation for noise sensor >>

The noise sensor 613 can be used to alert the user, for example, that the television has been on for a long time. Specifically, when the

《振動センサに関する制御動作》

振動センサ612を用い、地震の検出やその報知動作を行うことができる。

<< Control operation related to vibration sensor >>

The vibration sensor 612 can be used to detect an earthquake and perform an alarm operation.

例えば、人感センサ702により人がいることが検知されていない状態において、振動センサ612により所定の大きさの揺れを検知した場合には、地震が発生したものと判断して、制御部71は、所定の警報音や警告メッセージをスピーカ705から出力させ、又は、通信部76を介して予め登録した宛先に所定のメッセージを送信することができる。

For example, when the vibration sensor 612 detects a shake of a predetermined magnitude while the

他方、人感センサ702により人がいることが検知されている状態において、振動センサ612により所定の大きさの揺れを検知した場合には、ユーザ等による人為的な行為によるものと判断し、報知を行わない。なお、この場合、例えば、音声メッセージ(「揺らしちゃダメ!」)をスピーカ705から出力させることができる。このようにすると、地震と生活振動とを精度良く区別しつつ、それぞれに対応した動作を行うことができる。

On the other hand, when the vibration sensor 612 detects a predetermined amount of shaking while the

《温湿度センサに関する制御動作》

温湿度センサ611に対応した所定の音声出力制御を行うことができる。例えば、温湿度センサ611により検出された温度が10°C未満の場合、制御部71は、所定のタイミングで「今日は寒いね」といった音声をスピーカ705から出力させることができる。

<< Control operation for temperature and humidity sensor >>

A predetermined audio output control corresponding to the temperature / humidity sensor 611 can be performed. For example, when the temperature detected by the temperature / humidity sensor 611 is lower than 10 ° C., the

また、温湿度センサ611により検出された湿度が40%未満の場合には、所定のタイミングで「乾燥してるよ!風邪ひかないようにね」といった音声をスピーカ705から出力させることができる。

Further, when the humidity detected by the temperature / humidity sensor 611 is less than 40%, the

《画像に関する動作》

カメラ722で撮影された画像に対応した画像表示及び音声出力制御を行うことができる。例えば、カメラ722で取得した画像を利用してフェイストラッキングや表情検出を実行してキャラクターの画像を変更することができる。

<Operations related to images>

Image display and audio output control corresponding to the image taken by the

具体的には、ユーザが移動すると、キャラクターがユーザの方を見るようなキャラクター画像を表示してもよい。また、キャラクターが、たまに目を背けてまた、ユーザの方を見るようなキャラクター画像を表示してもよい。さらに、ユーザが笑うと、笑い返すキャラクター画像を表示してもよい。また、ユーザがキャラクターとは違う方向を見ていた後で目が合うと、目が合ったタイミングでほほ笑むキャラクター画像を表示してもよい。さらに、ユーザが画像表示装置1に登録済みのカップで飲み物を飲んでいると、「私も飲む」という音声を出力して、同じカップで飲み物を飲むキャラクター画像を表示してもよい。さらに、ユーザが画像表示装置1に登録済みの服を着ていると、「かっこいい!」という音声を出力してもよい。

Specifically, a character image may be displayed so that the character looks at the user when the user moves. In addition, the character may display a character image that looks away from the user once in a while. Further, when the user laughs, a character image that laughs back may be displayed. Further, when the user sees a direction different from that of the character and then meets the eyes, a smiling character image may be displayed at the timing when the eyes meet. Furthermore, when the user is drinking a drink in a cup registered in the

この他にも様々な入出力制御が可能である。 Besides this, various input / output controls are possible.

例えば、温湿度や天気情報の入力情報に基づいて、「傘持って行った方がいいよ」といった音声を出力させたり、ユーザからの「何着ていこうかな」といった音声入力に対し、温湿度、天気情報、カレンダー情報等に対応したおすすめの洋服を表示させたりすることができる。 For example, based on input information such as temperature and humidity or weather information, a voice such as "You should bring an umbrella" is output, or a voice input such as "What should I wear?" Recommended clothes corresponding to weather information, calendar information, etc. can be displayed.

《好感度に応じた動作》

画像表示装置1が表示するキャラクターは、キャラクターのユーザに対する好感度に応じて動作を異ならせてもよい。例えば、キャラクターの設定情報として予め、好きな言葉や色などの嗜好や、好みの動作、されてうれしいこと、等のキャラクター情報を設定するとともに、キャラクターのユーザに対する好感度を設定しておく。そして、キャラクターの嗜好に合致する会話やチャット、行動をユーザがとった場合に、キャラクターの好感度値を上げ、合致しない会話やチャット、行動をユーザがとった場合に、キャラクターの好感度を下げることとしてもよい。

<Operation according to liking>

The character displayed by the

そして、記憶装置75においては、さらに、その好感度値に応じたキャラクターの行動を規定する情報を記憶しておいてもよい。例えば、ユーザがキャラクターに近い場合であって、キャラクターが「近すぎるよー」と発言する際に、好感度が低い場合には、怒ったような声色の音声を出力し、好感度が高い場合には、照れたような声色の音声を出力することとしてもよい。したがって、記憶装置75は、好感度に応じた同内容のセリフの音声を複数記憶しておいてもよい。このようにすることで、画像表示装置1のキャラクターにより人間味を持たせることができ、ユーザにより親近感を覚えさせることができる。

Then, the

また、画像表示装置1は、以下のような処理を実現してもよい。

Further, the

《起床判定システム》

制御部71は、例えば、カレンダーサイトで記憶装置75に登録されたユーザの起床時刻を含むカレンダー情報と、データ管理部716が取得する時刻とを利用し、目覚ましの呼びかけをすることができる。その後、例えば、ユーザがベッドから起き上がり、解析部712で検出する顔が一定以上の大きさになると制御部71は、起床と判定し、ユーザが起床後の処理を実行する。例えば、ユーザは、自身の通信端末のスケジュール情報を、画像表示装置1に送信して、画像表示装置1は、受信したスケジュール情報に示される内容にしたがって、動作することとしてもよい。例えば、スケジュール情報に、「23日6時起床」とあった場合に、制御部71は、23日の6時に、キャラクターにユーザを起こす動作をさせることとしてもよい。

<Wake-up determination system>

For example, the

《外出判定システム》

制御部71は、例えば、解析部712が検出するユーザの「いってきます」の音声に加え、取得処理部711が取得するユーザの通信端末の位置情報が、家の外にある場合、ユーザが外出したと判定することができる。また例えば、人感センサ702でユーザの存在が検出されないことに加え、取得処理部711が取得するユーザの通信端末の位置情報が、家の外にある場合、ユーザが外出したと判定することができる。

《Going out system》

For example, when the position information of the user's communication terminal acquired by the

《帰宅判定システム》

制御部71は、例えば、上述の外出判定においてユーザが外出したと判定した後に、人感センサ702でユーザの存在が検出された場合、ユーザが帰宅したと判定することができる。当該検出では、人感センサ702で人を検出することに加え、カメラ722で撮像した画像から、ユーザの顔を判定することとしてもよい。

《Homecoming judgment system》

For example, when the

《寝落ち判定システム》

制御部71は、ユーザが在宅中に、例えば、人感センサ702により、ユーザの動きが1時間検出されず、かつ、光センサ721によって検出される照度が、照明が消されていない程度の明るさであると解析部712で解析されると、ユーザが寝落ちしたと判定することができる。ここでいう、「寝落ち」とはユーザがテレビを見たり、ゲームをしたりする等、何かの作業中に、照明を消すことがなく寝てしまうことをいう。画像表示装置1は、ユーザが寝落ちしたと判定した場合であって、部屋の照明が消灯されていない場合に、部屋の照明を消灯するように証明を制御することとしてもよい。

《Sleeping judgment system》

While the user is at home, the

《起床時刻確認システム》

制御部71は、例えば、翌朝の外出時間か?、普段の朝より早い場合、普段の朝の準備時間を確保すへ?く、翌朝の目覚まし時刻を早くするよう提案することができる。具値的には、翌日目覚まし時刻と翌日の外出予定時刻との時間差が、平均の起床時刻と外出時刻との時間差で求められる外出準備時間よりも短い場合、翌朝の目覚まし時刻より早くするよう提案する。例えば、制御部71は、音声データ752から、「明日は出発時刻か?早いみたいた?けと?、目覚まし時刻早める?」の音声を選択し、出力する。また、制御部71は、ユーザは「YES」の返答か?あった場合、記憶装置75に登録される目覚まし時刻を変更する。

<Wake-up time confirmation system>

For example, when it is the time to go out in the next morning or earlier than the usual morning, the

また例えば、制御部71は、今朝、遅刻した場合、翌朝の目覚まし時刻を早くするよう提案することができる。具体的には、制御部71は、今朝の外出時刻が、外出予定時刻より所定時間(例えば、10分)遅れた場合、目覚まし時間をその所定時刻早めるよう提案することができる。例えば、制御部71は、音声データ752から、「今日遅刻したて?しょ!明日は10分早く起きてみる?」の音声を選択し、出力する。また、制御部71は、ユーザは「YES」の返答か?あった場合、記憶装置75に登録される目覚まし時刻を変更する。

Further, for example, the

《スクワット判定機能》

制御部71は、例えば、解析部712が顔認識の上下運動を検出し、スクワットしている回数を数えるシステムを備えることができる。また、制御部71は、腕立て伏せだけでなく、腹筋の回数や、腕立てふせの回数を数えるシステムにも応用することもできる。これにより、表示処理部713は、ユーザの動作を応援するキャラクター画像や演出用画像を表示することができる。また、音声出力部714は、キャラクターがカウントする音声や応援する音声を出力することができる。

<Squat judgment function>

The

《カメラ自撮りシステム》

制御部71は、例えば、ユーザが、キャラクターと自撮り撮影できるようにしてもよい。この際、ユーザがカメラ722で撮像可能な範囲に移動することで、カメラ722でユーザの画像を撮像すると、制御部71は、撮像画像にキャラクター画像を合成する。また、制御部71は、キャラクター画像が合成された撮影画像を、インターネット等を介してSNS(ソーシャルネットワーキングサービス)等の提供サーバにアップロードしてもよい。

《Camera selfie system》

The

《コーヒーブレイクタイムシステム》

制御部71は、キャラクターがユーザにコーヒーブレイクを提案するようにしてもよい。例えば、データ管理部716が管理する時刻が所定時刻の場合に、送信処理部715が、コーヒーメーカーに、操作信号を送信する。また、表示処理部713は、ユーザにコーヒーブレイクを促す画像を選択して表示し、音声出力部714は、ユーザにコーヒーブレイクを促す音声を選択して出力する。さらに、解析部712が、画像や音声から、ユーザがコーヒーを飲み終わるのを検出すると、制御部71は、コーヒーブレイクを終了する。例えば、制御部71は、解析部712が、ユーザの「おいしかったよ」や「ごちそうさま」の音声を検出することにより、終了することができる。

《Coffee break time system》

The

《コール・レスポンスシステム》

制御部71は、ユーザとキャラクターと名前を呼びあうようにしてもよい。音声出力部713が、ユーザデータ754に登録される名前やニックネームを呼ぶキャラクターの音声を出力する。また、解析部712によってユーザが発したキャラクターの名前やニックネームの音声が検出されると、音声出力部713は、ユーザの名前やニックネームを呼ぶキャラクターの音声を出力することができる。

<Call response system>

The

《着替えレコメンドシステム》

制御部71は、ユーザのコーディネートをレコメンドするようにしてもよい。例えば、解析部712によって、カメラ722が撮像した画像から「顔の上の正方形の帽子」、「顔の下の長い長方形のネクタイ」等のユーザが身につけているものの形状や色を判定する。また、制御部71は、取得処理部711で取得する環境情報から解析されるユーザの表情や気分や、記憶装置75に登録されるユーザのスケジュールや、天気情報、季節等を総合的に判断して、おすすめの色をレコメンドしてもよい。

《Changing recommendation system》

The

《操作依頼》

制御部71は、ユーザから通信端末等の情報処理装置を介し、機器の操作や、スケジュール管理の依頼を受けることができる。例えば、機器の操作が依頼された場合、送信処理部715は、依頼された信号に応じて、操作信号を出力する。また、スケジュールの登録や変更が依頼された場合、データ管理部716は、この信号に応じて、データを登録又は更新する。具体的には、図13(b)を用いて上述したように、チャット機能を用いたり、メモや伝言板のようなものを用いて、制御部71を操作したりすることができる。ユーザは、自身がキャラクターにしてほしいことをキャラクターにお願いするように感じることができるため、人間にお願いしているように感じることができる。

<Operation request>

The

《ふて寝モード》

制御部71は、所定の条件を満たした場合に、怒ってふて寝をするキャラクター画像を表示させてもよい。例えば、画像表示装置1が外部のネットワークに接続されていない場合、又は、画像表示装置1がユーザの通信端末との間でネットワーク接続がされていない場合、怒ってふて寝するような画像を選択し、表示する。これにより、画像表示装置1がユーザに訴えかけるようなキャラクター画像を表示することで、より人間らしく、よりリアルに表現することができる。

《Futtosleep mode》

The

《興味の変遷アルゴリズム》

ユーザデータ754に複数種類の興味や趣味嗜好が登録されているとき、制御部71は、複数の中からいずれかをランダムに選択し、出力する画像や音声に反映させることができる。例えば、このとき、ユーザデータ754では、ユーザの嗜好情報についてそれぞれ重み値が設定され、制御部71は、その重み値を加味して、出力する画像や音声を選択することができる。また、これらの趣味嗜好の重み値は、時間の経過と共に増加させたり、減衰させたりすることができる。さらに、重み値が所定の値以下になったら、他の嗜好の重み値が大きくなることにより、別の趣味嗜好の話題を選択するようにしてもよい。

《Interest transition algorithm》

When a plurality of types of interests and hobbies and preferences are registered in the

《ライフモードのアルゴリズム》

制御部71は、ライフモードにおいて、「ユーザの嗜好情報」や「キャラクター内部の嗜好情報」をもとに、表示する画像や、出力する音声を選択することができる。例えば、ユーザが漫画好きであれば、制御部71は、ライフモードにおいて、漫画を読むキャラクター画像を表示することができ、これに対応する音声を出力することができる。また、ユーザが料理好きであれば、制御部71は、暇な時に料理をするキャラクター画像を表示することができ、これに対応する音声を出力することができる。

《Life mode algorithm》

In the life mode, the

《興味トーク》

制御部71は、ユーザとのインタラクションが発生した一定時間後に、そのインタラクションに関連する話題の画像及び音声を出力することができる。制御部71は、ユーザとのインタラクションが発生した時刻を記憶しておき、そこから、所定時間が経過したか否かを判定することで、当該制御を実現する。

《ユーザー行動分析推定システム》