JP2018207517A - Method to be executed by computer for controlling display in head-mounted device, program for causing computer to execute the same method, and information processing device - Google Patents

Method to be executed by computer for controlling display in head-mounted device, program for causing computer to execute the same method, and information processing device Download PDFInfo

- Publication number

- JP2018207517A JP2018207517A JP2018153742A JP2018153742A JP2018207517A JP 2018207517 A JP2018207517 A JP 2018207517A JP 2018153742 A JP2018153742 A JP 2018153742A JP 2018153742 A JP2018153742 A JP 2018153742A JP 2018207517 A JP2018207517 A JP 2018207517A

- Authority

- JP

- Japan

- Prior art keywords

- user

- hmd

- virtual space

- computer

- comment

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Pending

Links

Images

Abstract

Description

本開示はヘッドマウントデバイスを用いて仮想空間を提供する技術に関し、より特定的には、仮想空間にコメントを提示する技術に関する。 The present disclosure relates to a technique for providing a virtual space using a head-mounted device, and more specifically to a technique for presenting a comment in a virtual space.

動画配信やゲームプログラム等を実行するコンピュータは、実況者のプレイに応じた映像信号を生成する。コンピュータ(または映像信号を受け付けた他の機器)は、ライブ映像を配信サーバに送信する。配信サーバは、当該配信サーバに接続してログインしている一つ以上の他の端末にライブ映像を送信する。配信サーバは、いずれかの端末からコメントの入力を受け付けて、受け付けたコメントを随時他の端末へ送信する。これにより、実況者と視聴者の双方は、実況者がライブ視聴者からのコメントを参照しつつ、プレイの実況をするという相互作用(インタラクション)を楽しむことができる。 A computer that executes moving image distribution, a game program, and the like generates a video signal corresponding to a play by a live player. The computer (or another device that has received the video signal) transmits the live video to the distribution server. The distribution server transmits the live video to one or more other terminals that are connected to the distribution server and logged in. The distribution server receives an input of a comment from one of the terminals, and transmits the received comment to another terminal as needed. Thereby, both the live viewer and the viewer can enjoy the interaction (interaction) in which the live broadcaster plays live while referring to the comments from the live viewer.

動画の配信においてユーザのコメントを表示する技術に関し、例えば、国際公開第2016/039156号(特許文献1)は、「ライブストリーミング配信される動画像を送信する動画像送信装置とは別の端末で当該動画像を配信する動画像配信システムで管理される当該動画像に関する情報を通信する際におけるユーザの手間を軽減できる」技術を開示している。 For example, International Publication No. 2016/039156 (Patent Document 1) relates to a technique for displaying a user's comment in the distribution of a moving image. The technology that can reduce the user's trouble when communicating information related to the moving image managed by the moving image distribution system that distributes the moving image is disclosed.

しかし、動画その他の映像が仮想現実空間(「仮想空間」ともいう。)において提供される場合、ヘッドマウントデバイス(Head Mounted Device:HMD)を装着した実況者が、HMDに提示される映像を見つつ実況をする場合には、当該実況者は、視聴者のコメントを参照することができない。また、HMDを用いて動画が配信される場合、コメントを単に表示すると、仮想空間における没入感が損なわれる可能性もある。したがって、コンテンツの視聴者によって入力されたコメントが仮想空間における没入感を損なうことなく当該コンテンツのユーザに提示される技術が必要とされている。 However, when a video or other video is provided in a virtual reality space (also referred to as “virtual space”), a live wearer wearing a head mounted device (HMD) sees the video presented on the HMD. On the other hand, when the actual situation is performed, the actual person cannot refer to the comment of the viewer. In addition, when a moving image is distributed using the HMD, simply displaying a comment may impair the immersive feeling in the virtual space. Therefore, there is a need for a technique in which a comment input by a viewer of a content is presented to the user of the content without impairing the immersive feeling in the virtual space.

本開示は、上述のような問題点を解決するためになされたものであって、ある局面における目的は、没入感を損なうことなく仮想空間にコメントが提示される技術を提供することである。 The present disclosure has been made to solve the above-described problems, and an object in one aspect is to provide a technique in which comments are presented in a virtual space without impairing the sense of immersion.

ある実施の形態に従うと、仮想空間を提供するヘッドマウントデバイスにおける表示を制御するためにコンピュータで実行される方法が提供される。この方法は、ヘッドマウントデバイスのユーザの操作に応じた映像を表示するための映像信号をヘッドマウントデバイスに送信するステップと、コンピュータと通信可能に接続されている一つ以上の表示端末に映像信号を送信するステップと、映像信号に基づいて一つ以上の表示端末に表示される映像に対して与えられる視聴者応答を一つ以上の表示端末から受信するステップと、ヘッドマウントデバイスに視聴者応答を提示させるステップとを含む。 According to an embodiment, a computer-implemented method is provided for controlling display on a head mounted device that provides virtual space. The method includes a step of transmitting a video signal for displaying a video according to a user operation of the head mounted device to the head mounted device, and a video signal to one or more display terminals connected to be communicable with the computer. Transmitting a viewer response given to the video displayed on the one or more display terminals based on the video signal from the one or more display terminals, and a viewer response to the head mounted device Presenting.

ある実施の形態に従うと、没入感を損なうことなく仮想空間にコメントが提示される。

この発明の上記および他の目的、特徴、局面および利点は、添付の図面と関連して理解されるこの発明に関する次の詳細な説明から明らかとなるであろう。

According to an embodiment, the comment is presented in the virtual space without impairing the immersive feeling.

The above and other objects, features, aspects and advantages of the present invention will become apparent from the following detailed description of the present invention taken in conjunction with the accompanying drawings.

以下、図面を参照しつつ、本発明の実施の形態について説明する。以下の説明では、同一の部品には同一の符号を付してある。それらの名称および機能も同じである。したがって、それらについての詳細な説明は繰り返さない。 Hereinafter, embodiments of the present invention will be described with reference to the drawings. In the following description, the same parts are denoted by the same reference numerals. Their names and functions are also the same. Therefore, detailed description thereof will not be repeated.

[技術思想]

ここに開示される技術思想の概要は、以下の通りである。ここでは、コンテンツの配信者(実況者)が装着したHMDのモニタに、ライブ配信されたコンテンツの視聴者のコメントが提示される場合について説明する。

[Technology]

The outline of the technical idea disclosed here is as follows. Here, a case will be described in which comments of viewers of content distributed live are presented on the monitor of the HMD worn by the content distributor (actual person).

(A)実況者のプレイに応じて実況者のHMDに提示するための映像信号を生成するコンピュータは、当該映像信号をコンテンツの配信サーバに送信する。 (A) A computer that generates a video signal to be presented to the HMD of the live broadcaster according to the play of the live broadcaster transmits the video signal to the content distribution server.

(B)配信サーバは、接続している(ログインしている)他の端末に対し、実況者のプレイに関する映像信号(例えば、動作やコントローラの操作の結果に応じた映像信号)を配信する。このとき、仮想空間を撮影した視界画像を生成するコンピュータ(例えば、上記コンピュータあるいは配信サーバ)は、仮想空間に配置される仮想カメラの配置を制御して、視界画像を更新する。 (B) The distribution server distributes a video signal (for example, a video signal corresponding to the result of the operation or the operation of the controller) to other connected terminals (logged in). At this time, a computer (for example, the computer or the distribution server) that generates a view image obtained by photographing the virtual space controls the placement of the virtual camera placed in the virtual space and updates the view image.

(C)配信サーバに接続している端末は、配信サーバからライブ配信にかかる映像信号を受信して映像を再生するとともに、当該端末のユーザ(視聴者)によるコメントの入力を受け付けて、配信サーバに対し、当該コメントを送信する。 (C) The terminal connected to the distribution server receives a video signal related to live distribution from the distribution server and reproduces the video, and accepts an input of a comment by a user (viewer) of the terminal. In response, the comment is transmitted.

(D)配信サーバは、ライブ映像の配信者(実況者)の装置(例えば、HMDが接続されたコンピュータ)を特定し、端末から入力されたコメントを当該実況者の装置へ送信する。 (D) The distribution server specifies a live video distributor (actual person) device (for example, a computer to which the HMD is connected), and transmits a comment input from the terminal to the actual person device.

(E)実況者が装着したHMDのモニタは、配信サーバから受信したコメントを表示する。このとき、コメントは、映像を妨げないような場所、例えば、表示領域の端部、仮想空間に提示されるオブジェクトの向こう側に表示され得る。あるいは、コメントを表示する文字は、透明な文字で表示され得る。また、当該コメントは、一時的に表示され得る。例えば、コメントは、視界画像が切り換わったタイミングで表示され、あるいは、非表示にされる。 (E) The HMD monitor worn by the live commentator displays the comment received from the distribution server. At this time, the comment can be displayed in a place where the video is not obstructed, for example, at the end of the display area, beyond the object presented in the virtual space. Or the character which displays a comment may be displayed by a transparent character. In addition, the comment can be temporarily displayed. For example, the comment is displayed at the timing when the view field image is switched or is not displayed.

図1を参照して、本開示に係る技術思想の実現例について説明する。図1は、仮想空間を提供するモニタ112に表示される画面の推移を表わす図である。モニタ112は、例えば、HMDに設けられ、あるいは、HMDに装着される。モニタ112は、HMDに接続されているコンピュータ又はHMDに内蔵されるコンピュータによって実行されるプログラムに基づいて、オブジェクトとコメントとを提示する。以下、当該プログラムが、仮想空間を走る馬をロープで捕まえるシーンをモニタ112に提示している場合について説明する。

With reference to FIG. 1, an implementation example of the technical idea according to the present disclosure will be described. FIG. 1 is a diagram illustrating transition of a screen displayed on the

[状態A] ある局面において、モニタ112は、馬オブジェクト101と、馬オブジェクト101を捕まえるためのロープオブジェクト102とを表示する。さらに、モニタ112は、コメント103(“今だ!”)を表示する。コメント103は、当該HMDのユーザ以外の他ユーザが使用するコンピュータから入力される。他ユーザによって使用されるコンピュータは、当該シーンを二次元画像、あるいは、仮想空間における画像のいずれをも表示し得る。

[State A] In a certain situation, the

[状態B] その後、モニタ112のユーザが操作を行ない、ロープオブジェクト102を馬オブジェクト101に投げた場合、モニタ112は、他ユーザによって入力された別のコメント104(“届け!”)を表示する。なお、コメント103を入力したユーザと、コメント104を入力したユーザとは、同一でも別でもよい。ある局面において、コメント103は、モニタ112に表示されるシーンが切り換わるまで、あるいは、予め定められた時間、表示される。当該シーンが次のシーンに切り換わると、あるいは、予め定められた時間が経過すると、コメント103の表示は終了する。

[State B] Thereafter, when the user of the

[状態C] モニタ112のユーザがロープオブジェクト102を馬オブジェクト101に首尾よく引っかけることができると、モニタ112は、コメント105(“やった!”)とコメント106(“成功!”)とを表示する。この場合も、コメント105を入力したユーザと、コメント106を入力したユーザとは、同一でも別でもよい。この場合も、状態Bの場合と同様に、上述のような条件を含む予め定められた条件が成立すると、コメントの表示は終了する。

[State C] When the user of the

複数のコメントが表示される場合、最初のコメントが予め指定された場所に表示され、次のコメントが、最初のコメントから予め設定された間隔だけずれた位置に表示され得る。これにより、ユーザは、各コメントを明確に確認できる。別の局面で、各コメントが順次表示されてもよい。例えば、コンテンツの最後が表示された場合には、各コメントが順次表示され得る。この場合、コンテンツの表示が終了する局面であるため、没入感の阻害という問題も抑制され得る。さらに別の局面において、HMDが装着されたコンピュータは、モニタ112に表示されたコメントに対するコメントの入力をユーザから受け付けて、そのコメントを他の視聴者に送信してもよい。HMDのユーザと視聴者との間でコメントがやり取りされるので、相互の対話が一層促進され得る。

When a plurality of comments are displayed, the first comment can be displayed at a predetermined location, and the next comment can be displayed at a position shifted from the first comment by a preset interval. Thereby, the user can confirm each comment clearly. In another aspect, each comment may be displayed sequentially. For example, when the end of the content is displayed, each comment can be displayed sequentially. In this case, since the display of the content is finished, the problem of immersive feeling can be suppressed. In yet another aspect, the computer equipped with the HMD may receive an input of a comment for the comment displayed on the

コメント103,104,105からも明らかなように、各コメントは、仮想空間に提示される馬オブジェクト101が移動しても、同じ場所に表示される。これにより、仮想空間における没入感が損なわれることなく、コメントの視認性も維持される。なお、各コメントは、予め定められた一定時間表示された後消去され得る。あるいは、各コメントは、映像のシーンが切り換わった時に、別のコメントに切り替わってもよい。

As is clear from the

図2を参照して、本開示に係る技術思想を実現する装置構成について説明する。図2は、仮想空間に提示される画像に対してコメントを付加するための構成の概略を表わす図である。仮想空間は、HMD110によって提供される。HMD110は、周知の構成を有するサーバコンピュータ20に通信可能に接続されている。サーバコンピュータ20は、一つ以上のユーザ端末201A,201B,201N(総称するときは、ユーザ端末201という。)と通信可能に接続されている。ユーザ端末201は、プロセッサ211と、モニタ212とを含む。ユーザ端末201は、ある局面で、例えば、周知の構成を有するコンピュータ、タブレット端末、スマートフォンその他の情報通信端末である。別の局面で、ユーザ端末201は、HMD110と同様に、当該ユーザのコンピュータと当該コンピュータに接続されたHMDによって実現されてもよい。

With reference to FIG. 2, an apparatus configuration that realizes the technical idea according to the present disclosure will be described. FIG. 2 is a diagram showing an outline of a configuration for adding a comment to an image presented in the virtual space. The virtual space is provided by the

HMD110は、サーバコンピュータ20から送られた映像信号に基づいて映像をモニタ112に表示する。ユーザがコントローラを操作すると、HMD110は、その操作を表わす情報をサーバコンピュータ20に送信する。サーバコンピュータ20は、その情報に基づいてHMD110に提示されている画像に含まれるオブジェクトを移動する等の処理を実行し、処理後の画像を表示するための映像信号をHMD110およびログインしているユーザ端末201A,201B,201Nに表示する。なお、HMD110に送信される映像信号の形式と、ユーザ端末201A,201B,201Nに送信される映像信号の形式は同一でも異なってもよい。HMD110に送信される映像信号は、没入感を維持しつつ仮想空間で使用されるための三次元のデータである。他方、ユーザ端末201A、201B,201Cに送信される映像信号は、没入感が求められない場合には、二次元で画像を表示するためのデータであってもよい。

The

ユーザ端末201A,201B,201Nの各ユーザは、HMD110のユーザが見ている画像と同じ画像を視認できる。このとき、各ユーザは、タッチパネル、マウス、音声入力装置その他の入力デバイスを用いて、その画像に対するコメントを入力できる。入力されたコメントは、サーバコンピュータ20に送られる。サーバコンピュータ20は、そのコメントがHMD110に提示される画像を妨げないように、例えば、視界領域の端に重ねて表示する。あるいは、サーバコンピュータ20は、そのコメントを透明色で表示する。HMD110を装着したユーザは、仮想空間に提示される画像を確認しながら、そのコメントを視認できる。

Each user of the

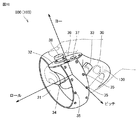

[HMDシステムの構成]

図3を参照して、HMD(Head Mounted Device)システム100の構成について説明する。図3は、ある実施の形態に従うHMDシステム100の構成の概略を表す図である。ある局面において、HMDシステム100は、家庭用のシステムとしてあるいは業務用のシステムとして提供される。なお、本実施の形態において、HMDとは、モニタを備える所謂ヘッドマウントディスプレイと、スマートホンその他のモニタを有する端末を装着可能なヘッドマウント機器のいずれをも含み得る。

[Configuration of HMD system]

The configuration of an HMD (Head Mounted Device)

HMDシステム100は、HMD110と、HMDセンサ120と、コントローラ160と、コンピュータ200とを備える。HMD110は、モニタ112と、注視センサ140とを含む。コントローラ160は、モーションセンサ130を含み得る。

The

ある局面において、コンピュータ200は、インターネットその他のネットワーク19に接続可能であり、ネットワーク19に接続されているサーバ150その他のコンピュータと通信可能である。ユーザ端末201A・・・201Nが、ネットワーク19に接続されている。

In one aspect, the

別の局面において、HMDシステム100がHMDセンサ120を備える代わりに、HMD110がセンサ114を含んでもよい。

In another aspect, instead of the

サーバ150は、プロセッサ151と、メモリ152と、通信インターフェイス153とを含む。サーバ150は、周知の構成を有するコンピュータによって実現される。

The

HMD110は、ユーザの頭部に装着され、動作中に仮想空間をユーザに提供し得る。より具体的には、HMD110は、右目用の画像および左目用の画像をモニタ112にそれぞれ表示する。ユーザの各目がそれぞれの画像を視認すると、ユーザは、両目の視差に基づき当該画像を3次元の画像として認識し得る。

The

モニタ112は、例えば、非透過型の表示装置として実現される。ある局面において、モニタ112は、ユーザの両目の前方に位置するようにHMD110の本体に配置されている。したがって、ユーザは、モニタ112に表示される3次元画像を視認すると、仮想空間に没入することができる。ある実施の形態において、仮想空間は、例えば、背景、ユーザが操作可能なオブジェクト、ユーザが選択可能なメニューの画像を含む。ある実施の形態において、モニタ112は、所謂スマートフォンその他の情報表示端末が備える液晶モニタまたは有機EL(Electro Luminescence)モニタとして実現され得る。

The

ある局面において、モニタ112は、右目用の画像を表示するためのサブモニタと、左目用の画像を表示するためのサブモニタとを含み得る。別の局面において、モニタ112は、右目用の画像と左目用の画像とを一体として表示する構成であってもよい。この場合、モニタ112は、高速シャッタを含む。高速シャッタは、画像がいずれか一方の目にのみ認識されるように、右目用の画像と左目用の画像とを交互に表示可能に作動する。

In one aspect, the

HMDセンサ120は、複数の光源(図示しない)を含む。各光源は例えば、赤外線を発するLED(Light Emitting Diode)により実現される。HMDセンサ120は、HMD110の動きを検出するためのポジショントラッキング機能を有する。HMDセンサ120は、この機能を用いて、現実空間内におけるHMD110の位置および傾きを検出する。

The

なお、別の局面において、HMDセンサ120は、カメラにより実現されてもよい。この場合、HMDセンサ120は、カメラから出力されるHMD110の画像情報を用いて、画像解析処理を実行することにより、HMD110の位置および傾きを検出することができる。

In another aspect,

別の局面において、HMD110は、位置検出器として、HMDセンサ120の代わりに、センサ114を備えてもよい。HMD110は、センサ114を用いて、HMD110自身の位置および傾きを検出し得る。例えば、センサ114が角速度センサ、地磁気センサ、加速度センサ、あるいはジャイロセンサ等である場合、HMD110は、HMDセンサ120の代わりに、これらの各センサのいずれかを用いて、自身の位置および傾きを検出し得る。一例として、センサ114が角速度センサである場合、角速度センサは、現実空間におけるHMD110の3軸周りの角速度を経時的に検出する。HMD110は、各角速度に基づいて、HMD110の3軸周りの角度の時間的変化を算出し、さらに、角度の時間的変化に基づいて、HMD110の傾きを算出する。また、HMD110は、透過型表示装置を備えていても良い。この場合、当該透過型表示装置は、その透過率を調整することにより、一時的に非透過型の表示装置として構成可能であってもよい。また、視野画像は仮想空間を構成する画像の一部に、現実空間を提示する構成を含んでいてもよい。例えば、HMD110に搭載されたカメラで撮影した画像を視野画像の一部に重畳して表示させてもよいし、当該透過型表示装置の一部の透過率を高く設定することにより、視野画像の一部から現実空間を視認可能にしてもよい。

In another aspect, the

注視センサ140は、ユーザ190の右目および左目の視線が向けられる方向(視線方向)を検出する。当該方向の検出は、例えば、公知のアイトラッキング機能によって実現される。注視センサ140は、当該アイトラッキング機能を有するセンサにより実現される。ある局面において、注視センサ140は、右目用のセンサおよび左目用のセンサを含むことが好ましい。注視センサ140は、例えば、ユーザ190の右目および左目に赤外光を照射するとともに、照射光に対する角膜および虹彩からの反射光を受けることにより各眼球の回転角を検出するセンサであってもよい。注視センサ140は、検出した各回転角に基づいて、ユーザ190の視線方向を検知することができる。

The

サーバ150は、コンピュータ200にプログラムを送信し得る。別の局面において、サーバ150は、他のユーザによって使用されるHMDに仮想現実を提供するための他のコンピュータ200と通信し得る。例えば、アミューズメント施設において、複数のユーザが参加型のゲームを行なう場合、各コンピュータ200は、各ユーザの動作に基づく信号を他のコンピュータ200と通信して、同じ仮想空間において複数のユーザが共通のゲームを楽しむことを可能にする。

コントローラ160は、ユーザ190からコンピュータ200への命令の入力を受け付ける。ある局面において、コントローラ160は、ユーザ190によって把持可能に構成される。別の局面において、コントローラ160は、ユーザ190の身体あるいは衣類の一部に装着可能に構成される。別の局面において、コントローラ160は、コンピュータ200から送られる信号に基づいて、振動、音、光のうちの少なくともいずれかを出力するように構成されてもよい。別の局面において、コントローラ160は、仮想現実を提供する空間に配置されるオブジェクトの位置や動きを制御するためにユーザ190によって与えられる操作を受け付ける。

The

モーションセンサ130は、ある局面において、ユーザの手に取り付けられて、ユーザの手の動きを検出する。例えば、モーションセンサ130は、手の回転速度、回転数等を検出する。検出された信号は、コンピュータ200に送られる。モーションセンサ130は、例えば、手袋型のコントローラ160に設けられている。ある実施の形態において、現実空間における安全のため、コントローラ160は、手袋型のようにユーザ190の手に装着されることにより容易に飛んで行かないものに装着されるのが望ましい。別の局面において、ユーザ190に装着されないセンサがユーザ190の手の動きを検出してもよい。例えば、ユーザ190を撮影するカメラの信号が、ユーザ190の動作を表わす信号として、コンピュータ200に入力されてもよい。モーションセンサ130とコンピュータ200とは、有線により、または無線により互いに接続される。無線の場合、通信形態は特に限られず、例えば、Bluetooth(登録商標)その他の公知の通信手法が用いられる。

In one aspect, the

[ハードウェア構成]

図4を参照して、本実施の形態に係るコンピュータ200について説明する。図4は、一局面に従うコンピュータ200のハードウェア構成の一例を表すブロック図である。コンピュータ200は、主たる構成要素として、プロセッサ10と、メモリ11と、ストレージ12と、入出力インターフェイス13と、通信インターフェイス14とを備える。各構成要素は、それぞれ、バス15に接続されている。

[Hardware configuration]

A

プロセッサ10は、コンピュータ200に与えられる信号に基づいて、あるいは、予め定められた条件が成立したことに基づいて、メモリ11またはストレージ12に格納されているプログラムに含まれる一連の命令を実行する。ある局面において、プロセッサ10は、CPU(Central Processing Unit)、MPU(Micro Processor Unit)、FPGA(Field-Programmable Gate Array)その他のデバイスとして実現される。

The

メモリ11は、プログラムおよびデータを一時的に保存する。プログラムは、例えば、ストレージ12からロードされる。データは、コンピュータ200に入力されたデータと、プロセッサ10によって生成されたデータとを含む。ある局面において、メモリ11は、RAM(Random Access Memory)その他の揮発メモリとして実現される。

The

ストレージ12は、プログラムおよびデータを永続的に保持する。ストレージ12は、例えば、ROM(Read-Only Memory)、ハードディスク装置、フラッシュメモリ、その他の不揮発記憶装置として実現される。ストレージ12に格納されるプログラムは、HMDシステム100において仮想空間を提供するためのプログラム、シミュレーションプログラム、ゲームプログラム、ユーザ認証プログラム、他のコンピュータ200との通信を実現するためのプログラムを含む。ストレージ12に格納されるデータは、仮想空間を規定するためのデータおよびオブジェクト等を含む。

The

なお、別の局面において、ストレージ12は、メモリカードのように着脱可能な記憶装置として実現されてもよい。さらに別の局面において、コンピュータ200に内蔵されたストレージ12の代わりに、外部の記憶装置に保存されているプログラムおよびデータを使用する構成が使用されてもよい。このような構成によれば、例えば、アミューズメント施設のように複数のHMDシステム100が使用される場面において、プログラムやデータの更新を一括して行なうことが可能になる。

In another aspect, the

ある実施の形態において、入出力インターフェイス13は、HMD110、HMDセンサ120またはモーションセンサ130との間で信号を通信する。ある局面において、入出力インターフェイス13は、USB(Universal Serial Bus)インターフェイス、DVI(Digital Visual Interface)、HDMI(登録商標)(High-Definition Multimedia Interface)その他の端子を用いて実現される。なお、入出力インターフェイス13は上述のものに限られない。

In some embodiments, the input /

ある実施の形態において、入出力インターフェイス13は、さらに、コントローラ160と通信し得る。例えば、入出力インターフェイス13は、モーションセンサ130から出力された信号の入力を受ける。別の局面において、入出力インターフェイス13は、プロセッサ10から出力された命令を、コントローラ160に送る。当該命令は、振動、音声出力、発光等をコントローラ160に指示する。コントローラ160は、当該命令を受信すると、その命令に応じて、振動、音声出力または発光のいずれかを実行する。

In certain embodiments, the input /

通信インターフェイス14は、ネットワーク19に接続されて、ネットワーク19に接続されている他のコンピュータ(例えば、サーバ150)と通信する。ある局面において、通信インターフェイス14は、例えば、LAN(Local Area Network)その他の有線通信インターフェイス、あるいは、WiFi(Wireless Fidelity)、Bluetooth(登録商標)、NFC(Near Field Communication)その他の無線通信インターフェイスとして実現される。なお、通信インターフェイス14は上述のものに限られない。

The

ある局面において、プロセッサ10は、ストレージ12にアクセスし、ストレージ12に格納されている1つ以上のプログラムをメモリ11にロードし、当該プログラムに含まれる一連の命令を実行する。当該1つ以上のプログラムは、コンピュータ200のオペレーティングシステム、仮想空間を提供するためのアプリケーションプログラム、コントローラ160を用いて仮想空間で実行可能なゲームソフトウェア等を含み得る。プロセッサ10は、入出力インターフェイス13を介して、仮想空間を提供するための信号をHMD110に送る。HMD110は、その信号に基づいてモニタ112に映像を表示する。

In one aspect, the

なお、図4に示される例では、コンピュータ200は、HMD110の外部に設けられる構成が示されているが、別の局面において、コンピュータ200は、HMD110に内蔵されてもよい。一例として、モニタ112を含む携帯型の情報通信端末(例えば、スマートフォン)がコンピュータ200として機能してもよい。

In the example illustrated in FIG. 4, the configuration in which the

また、コンピュータ200は、複数のHMD110に共通して用いられる構成であってもよい。このような構成によれば、例えば、複数のユーザに同一の仮想空間を提供することもできるので、各ユーザは同一の仮想空間で他のユーザと同一のアプリケーションを楽しむことができる。

Further, the

ある実施の形態において、HMDシステム100では、グローバル座標系が予め設定されている。グローバル座標系は、現実空間における鉛直方向、鉛直方向に直交する水平方向、ならびに、鉛直方向および水平方向の双方に直交する前後方向にそれぞれ平行な、3つの基準方向(軸)を有する。本実施の形態では、グローバル座標系は視点座標系の一つである。そこで、グローバル座標系における水平方向、鉛直方向(上下方向)、および前後方向は、それぞれ、x軸、y軸、z軸と規定される。より具体的には、グローバル座標系において、x軸は現実空間の水平方向に平行である。y軸は、現実空間の鉛直方向に平行である。z軸は現実空間の前後方向に平行である。

In an embodiment, in the

ある局面において、HMDセンサ120は、赤外線センサを含む。赤外線センサが、HMD110の各光源から発せられた赤外線をそれぞれ検出すると、HMD110の存在を検出する。HMDセンサ120は、さらに、各点の値(グローバル座標系における各座標値)に基づいて、HMD110を装着したユーザ190の動きに応じた、現実空間内におけるHMD110の位置および傾きを検出する。より詳しくは、HMDセンサ120は、経時的に検出された各値を用いて、HMD110の位置および傾きの時間的変化を検出できる。

In one aspect,

グローバル座標系は現実空間の座標系と平行である。したがって、HMDセンサ120によって検出されたHMD110の各傾きは、グローバル座標系におけるHMD110の3軸周りの各傾きに相当する。HMDセンサ120は、グローバル座標系におけるHMD110の傾きに基づき、uvw視野座標系をHMD110に設定する。HMD110に設定されるuvw視野座標系は、HMD110を装着したユーザ190が仮想空間において物体を見る際の視点座標系に対応する。

The global coordinate system is parallel to the real space coordinate system. Therefore, each inclination of the

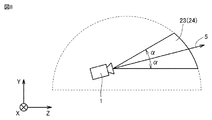

[uvw視野座標系]

図5を参照して、uvw視野座標系について説明する。図5は、ある実施の形態に従うHMD110に設定されるuvw視野座標系を概念的に表す図である。HMDセンサ120は、HMD110の起動時に、グローバル座標系におけるHMD110の位置および傾きを検出する。プロセッサ10は、検出された値に基づいて、uvw視野座標系をHMD110に設定する。

[Uvw visual field coordinate system]

The uvw visual field coordinate system will be described with reference to FIG. FIG. 5 is a diagram conceptually showing a uvw visual field coordinate system set in

図5に示されるように、HMD110は、HMD110を装着したユーザの頭部を中心(原点)とした3次元のuvw視野座標系を設定する。より具体的には、HMD110は、グローバル座標系を規定する水平方向、鉛直方向、および前後方向(x軸、y軸、z軸)を、グローバル座標系内においてHMD110の各軸周りの傾きだけ各軸周りにそれぞれ傾けることによって新たに得られる3つの方向を、HMD110におけるuvw視野座標系のピッチ方向(u軸)、ヨー方向(v軸)、およびロール方向(w軸)として設定する。

As shown in FIG. 5, the

ある局面において、HMD110を装着したユーザ190が直立し、かつ、正面を視認している場合、プロセッサ10は、グローバル座標系に平行なuvw視野座標系をHMD110に設定する。この場合、グローバル座標系における水平方向(x軸)、鉛直方向(y軸)、および前後方向(z軸)は、HMD110におけるuvw視野座標系のピッチ方向(u軸)、ヨー方向(v軸)、およびロール方向(w軸)に一致する。

In a certain situation, when the

uvw視野座標系がHMD110に設定された後、HMDセンサ120は、HMD110の動きに基づいて、設定されたuvw視野座標系におけるHMD110の傾き(傾きの変化量)を検出できる。この場合、HMDセンサ120は、HMD110の傾きとして、uvw視野座標系におけるHMD110のピッチ角(θu)、ヨー角(θv)、およびロール角(θw)をそれぞれ検出する。ピッチ角(θu)は、uvw視野座標系におけるピッチ方向周りのHMD110の傾き角度を表す。ヨー角(θv)は、uvw視野座標系におけるヨー方向周りのHMD110の傾き角度を表す。ロール角(θw)は、uvw視野座標系におけるロール方向周りのHMD110の傾き角度を表す。

After the uvw visual field coordinate system is set to the

HMDセンサ120は、検出されたHMD110の傾き角度に基づいて、HMD110が動いた後のHMD110におけるuvw視野座標系を、HMD110に設定する。HMD110と、HMD110のuvw視野座標系との関係は、HMD110の位置および傾きに関わらず、常に一定である。HMD110の位置および傾きが変わると、当該位置および傾きの変化に連動して、グローバル座標系におけるHMD110のuvw視野座標系の位置および傾きが変化する。

The

ある局面において、HMDセンサ120は、赤外線センサからの出力に基づいて取得される赤外線の光強度および複数の点間の相対的な位置関係(例えば、各点間の距離など)に基づいて、HMD110の現実空間内における位置を、HMDセンサ120に対する相対位置として特定してもよい。また、プロセッサ10は、特定された相対位置に基づいて、現実空間内(グローバル座標系)におけるHMD110のuvw視野座標系の原点を決定してもよい。

In one aspect, the

[仮想空間]

図6を参照して、仮想空間についてさらに説明する。図6は、ある実施の形態に従う仮想空間2を表現する一態様を概念的に表す図である。仮想空間2は、中心21の360度方向の全体を覆う全天球状の構造を有する。図6では、説明を複雑にしないために、仮想空間2のうちの上半分の天球が例示されている。仮想空間2では各メッシュが規定される。各メッシュの位置は、仮想空間2に規定されるXYZ座標系における座標値として予め規定されている。コンピュータ200は、仮想空間2に展開可能なコンテンツ(静止画、動画等)を構成する各部分画像を、仮想空間2において対応する各メッシュにそれぞれ対応付けて、ユーザによって視認可能な仮想空間画像22が展開される仮想空間2をユーザに提供する。

[Virtual space]

The virtual space will be further described with reference to FIG. FIG. 6 is a diagram conceptually showing one aspect of expressing

ある局面において、仮想空間2では、中心21を原点とするXYZ座標系が規定される。XYZ座標系は、例えば、グローバル座標系に平行である。XYZ座標系は視点座標系の一種であるため、XYZ座標系における水平方向、鉛直方向(上下方向)、および前後方向は、それぞれX軸、Y軸、Z軸として規定される。したがって、XYZ座標系のX軸(水平方向)がグローバル座標系のx軸と平行であり、XYZ座標系のY軸(鉛直方向)がグローバル座標系のy軸と平行であり、XYZ座標系のZ軸(前後方向)がグローバル座標系のz軸と平行である。

In one aspect, the

HMD110の起動時、すなわちHMD110の初期状態において、仮想カメラ1が、仮想空間2の中心21に配置される。仮想カメラ1は、現実空間におけるHMD110の動きに連動して、仮想空間2を同様に移動する。これにより、現実空間におけるHMD110の位置および向きの変化が、仮想空間2において同様に再現される。

When the

仮想カメラ1には、HMD110の場合と同様に、uvw視野座標系が規定される。仮想空間2における仮想カメラ1のuvw視野座標系は、現実空間(グローバル座標系)におけるHMD110のuvw視野座標系に連動するように規定されている。したがって、HMD110の傾きが変化すると、それに応じて、仮想カメラ1の傾きも変化する。また、仮想カメラ1は、HMD110を装着したユーザの現実空間における移動に連動して、仮想空間2において移動することもできる。

As with the

仮想カメラ1の向きは、仮想カメラ1の位置および傾きに応じて決まるので、ユーザが仮想空間画像22を視認する際に基準となる視線(基準視線5)は、仮想カメラ1の向きに応じて決まる。コンピュータ200のプロセッサ10は、基準視線5に基づいて、仮想空間2における視界領域23を規定する。視界領域23は、仮想空間2のうち、HMD110を装着したユーザの視界に対応する。

Since the orientation of the

注視センサ140によって検出されるユーザ190の視線方向は、ユーザ190が物体を視認する際の視点座標系における方向である。HMD110のuvw視野座標系は、ユーザ190がモニタ112を視認する際の視点座標系に等しい。また、仮想カメラ1のuvw視野座標系は、HMD110のuvw視野座標系に連動している。したがって、ある局面に従うHMDシステム100は、注視センサ140によって検出されたユーザ190の視線方向を、仮想カメラ1のuvw視野座標系におけるユーザの視線方向とみなすことができる。

The gaze direction of the

[ユーザの視線]

図7を参照して、ユーザの視線方向の決定について説明する。図7は、ある実施の形態に従うHMD110を装着するユーザ190の頭部を上から表した図である。

[User's line of sight]

With reference to FIG. 7, the determination of the user's line-of-sight direction will be described. FIG. 7 is a top view of the head of

ある局面において、注視センサ140は、ユーザ190の右目および左目の各視線を検出する。ある局面において、ユーザ190が近くを見ている場合、注視センサ140は、視線R1およびL1を検出する。別の局面において、ユーザ190が遠くを見ている場合、注視センサ140は、視線R2およびL2を検出する。この場合、ロール方向wに対して視線R2およびL2がなす角度は、ロール方向wに対して視線R1およびL1がなす角度よりも小さい。注視センサ140は、検出結果をコンピュータ200に送信する。

In one aspect, gaze

コンピュータ200が、視線の検出結果として、視線R1およびL1の検出値を注視センサ140から受信した場合には、その検出値に基づいて、視線R1およびL1の交点である注視点N1を特定する。一方、コンピュータ200は、視線R2およびL2の検出値を注視センサ140から受信した場合には、視線R2およびL2の交点を注視点N1として特定する。コンピュータ200は、特定した注視点N1の位置に基づき、ユーザ190の視線方向N0を特定する。コンピュータ200は、例えば、ユーザ190の右目Rと左目Lとを結ぶ直線の中点と、注視点N1とを通る直線の延びる方向を、視線方向N0として検出する。視線方向N0は、ユーザ190が両目により実際に視線を向けている方向である。また、視線方向N0は、視界領域23に対してユーザ190が実際に視線を向けている方向に相当する。

When the

別の局面において、HMDシステム100は、HMDシステム100を構成するいずれかのパーツに、マイクおよびスピーカを備えてもよい。ユーザは、マイクに発話することにより、仮想空間2に対して、音声による指示を与えることができる。

In another aspect, the

また、別の局面において、HMDシステム100は、テレビジョン放送受信チューナを備えてもよい。このような構成によれば、HMDシステム100は、仮想空間2においてテレビ番組を表示することができる。

In another aspect,

さらに別の局面において、HMDシステム100は、インターネットに接続するための通信回路、あるいは、電話回線に接続するための通話機能を備えていてもよい。

In still another aspect, the

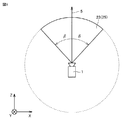

[視界領域]

図8および図9を参照して、視界領域23について説明する。図8は、仮想空間2において視界領域23をX方向から見たYZ断面を表す図である。図9は、仮想空間2において視界領域23をY方向から見たXZ断面を表す図である。

[Visibility area]

The field-of-

図8に示されるように、YZ断面における視界領域23は、領域24を含む。領域24は、仮想カメラ1の基準視線5と仮想空間2のYZ断面とによって定義される。プロセッサ10は、仮想空間おける基準視線5を中心として極角αを含む範囲を、領域24として規定する。

As shown in FIG. 8, the

図9に示されるように、XZ断面における視界領域23は、領域25を含む。領域25は、基準視線5と仮想空間2のXZ断面とによって定義される。プロセッサ10は、仮想空間2における基準視線5を中心とした方位角βを含む範囲を、領域25として規定する。

As shown in FIG. 9, the

ある局面において、HMDシステム100は、コンピュータ200からの信号に基づいて、視界画像26をモニタ112に表示させることにより、ユーザ190に仮想空間を提供する。視界画像26は、仮想空間画像22のうち視界領域23に重畳する部分に相当する。ユーザ190が、頭に装着したHMD110を動かすと、その動きに連動して仮想カメラ1も動く。その結果、仮想空間2における視界領域23の位置が変化する。これにより、モニタ112に表示される視界画像26は、仮想空間画像22のうち、仮想空間2においてユーザが向いた方向の視界領域23に重畳する画像に更新される。ユーザは、仮想空間2における所望の方向を視認することができる。

In one aspect, the

ユーザ190は、HMD110を装着している間、現実世界を視認することなく、仮想空間2に展開される仮想空間画像22のみを視認できる。そのため、HMDシステム100は、仮想空間2への高い没入感覚をユーザに与えることができる。

While wearing the

ある局面において、プロセッサ10は、HMD110を装着したユーザ190の現実空間における移動に連動して、仮想空間2において仮想カメラ1を移動し得る。この場合、プロセッサ10は、仮想空間2における仮想カメラ1の位置および向きに基づいて、HMD110のモニタ112に投影される画像領域(すなわち、仮想空間2における視界領域23)を特定する。

In one aspect, the

ある実施の形態に従うと、仮想カメラ1は、二つの仮想カメラ、すなわち、右目用の画像を提供するための仮想カメラと、左目用の画像を提供するための仮想カメラとを含むことが望ましい。また、ユーザ190が3次元の仮想空間2を認識できるように、適切な視差が、二つの仮想カメラに設定されていることが好ましい。本実施の形態においては、仮想カメラ1が二つの仮想カメラを含み、二つの仮想カメラのロール方向が合成されることによって生成されるロール方向(w)がHMD110のロール方向(w)に適合されるように構成されているものとして、本開示に係る技術思想を例示する。

According to an embodiment, the

[コントローラ]

図10を参照して、コントローラ160の一例について説明する。図10は、ある実施の形態に従うコントローラ160の概略構成を表す図である。ある局面において、コントローラ160は、右コントローラ800と左コントローラとを含み得る。右コントローラ800は、ユーザ190の右手で操作される。左コントローラは、ユーザ190の左手で操作される。ある局面において、右コントローラ800と左コントローラとは、別個の装置として対称に構成される。したがって、ユーザ190は、右コントローラ800を把持した右手と、左コントローラを把持した左手とをそれぞれ自由に動かすことができる。別の局面において、コントローラ160は両手の操作を受け付ける一体型のコントローラであってもよい。以下、右コントローラ800について説明する。

[controller]

An example of the

右コントローラ800は、グリップ30と、フレーム31と、天面32とを備える。グリップ30は、ユーザ190の右手によって把持されるように構成されている。例えば、グリップ30は、ユーザ190の右手の掌と3本の指(中指、薬指、小指)とによって保持され得る。

The

グリップ30は、ボタン33,34と、モーションセンサ130とを含む。ボタン33は、グリップ30の側面に配置され、右手の中指による操作を受け付ける。ボタン34は、グリップ30の前面に配置され、右手の人差し指による操作を受け付ける。ある局面において、ボタン33,34は、トリガー式のボタンとして構成される。モーションセンサ130は、グリップ30の筐体に内蔵されている。なお、ユーザ190の動作がカメラその他の装置によってユーザ190の周りから検出可能である場合には、グリップ30は、モーションセンサ130を備えなくてもよい。

The

フレーム31は、その円周方向に沿って配置された複数の赤外線LED35を含む。赤外線LED35は、コントローラ160を使用するプログラムの実行中に、当該プログラムの進行に合わせて赤外線を発光する。赤外線LED35から発せられた赤外線は、右コントローラ800と左コントローラ(図示しない)との各位置や姿勢(傾き、向き)を検出するために使用され得る。図8に示される例では、二列に配置された赤外線LED35が示されているが、配列の数は図8に示されるものに限られない。一列あるいは3列以上の配列が使用されてもよい。

The

天面32は、ボタン36,37と、アナログスティック38とを備える。ボタン36,37は、プッシュ式ボタンとして構成される。ボタン36,37は、ユーザ190の右手の親指による操作を受け付ける。アナログスティック38は、ある局面において、初期位置(ニュートラルの位置)から360度任意の方向への操作を受け付ける。当該操作は、例えば、仮想空間2に配置されるオブジェクトを移動するための操作を含む。

The

ある局面において、右コントローラ800および左コントローラは、赤外線LED35その他の部材を駆動するための電池を含む。電池は、充電式、ボタン型、乾電池型等を含むが、これらに限定されない。別の局面において、右コントローラ800と左コントローラは、例えば、コンピュータ200のUSBインターフェイスに接続され得る。この場合、右コントローラ800および左コントローラは、電池を必要としない。

In one aspect, the

図11は、右コントローラ800を把持するユーザ190の右手に対応して仮想空間に配置されるハンドオブジェクト810の一例を示す。例えば、ユーザ190の右手に対応するハンドオブジェクト810に対して、ヨー、ロール、ピッチの各方向が規定される。例えば、入力操作が、右コントローラ800のボタン34に対して行なわれると、ハンドオブジェクト810の人差し指を握りこんだ状態とし、入力操作がボタン34に対して行なわれていない場合には、ハンドオブジェクト810の人差し指を伸ばした状態とすることもできる。例えば、ハンドオブジェクト810において親指と人差し指とが伸びている場合に、親指の伸びる方向がヨー方向、人差し指の伸びる方向がロール方向、ヨー方向の軸およびロール方向の軸によって規定される平面に垂直な方向がピッチ方向としてハンドオブジェクト810に規定される。

FIG. 11 shows an example of a

[HMD110の制御装置]

図12を参照して、HMD110の制御装置について説明する。ある実施の形態において、制御装置は周知の構成を有するコンピュータ200によって実現される。図12は、ある実施の形態に従うコンピュータ200をモジュール構成として表わすブロック図である。以下では、サーバコンピュータ20によるコメントの付加機能がコンピュータ200によって実現される場合を説明する。別の局面において、この付加機能は、サーバ150によって実現されてもよい。

[Control device of HMD110]

With reference to FIG. 12, the control apparatus of HMD110 is demonstrated. In one embodiment, the control device is realized by a

図12に示されるように、コンピュータ200は、表示制御モジュール220と、仮想空間制御モジュール230と、メモリモジュール240と、通信制御モジュール250とを備える。表示制御モジュール220は、サブモジュールとして、仮想カメラ制御モジュール221と、視界領域決定モジュール222と、視界画像生成モジュール223と、基準視線特定モジュール224と、コメント付加モジュール225とを含む。仮想空間制御モジュール230は、サブモジュールとして、仮想空間定義モジュール231と、仮想オブジェクト生成モジュール232と、コントローラ管理モジュール233とを含む。

As shown in FIG. 12, the

ある実施の形態において、表示制御モジュール220と仮想空間制御モジュール230とは、プロセッサ10によって実現される。別の実施の形態において、複数のプロセッサ10が表示制御モジュール220と仮想空間制御モジュール230として作動してもよい。メモリモジュール240は、メモリ11またはストレージ12によって実現される。通信制御モジュール250は、通信インターフェイス14によって実現される。

In an embodiment, the

ある局面において、表示制御モジュール220は、HMD110のモニタ112における画像表示を制御する。仮想カメラ制御モジュール221は、仮想空間2に仮想カメラ1を配置し、仮想カメラ1の挙動、向き等を制御する。視界領域決定モジュール222は、HMD110を装着したユーザの頭の向きに応じて、視界領域23を規定する。視界画像生成モジュール223は、決定された視界領域23に基づいて、モニタ112に表示される視界画像26を生成する。

In one aspect, the

基準視線特定モジュール224は、注視センサ140からの信号に基づいて、ユーザ190の視線を特定する。コメント付加モジュール225は、サーバ150を介して受信したコメントを、視界画像生成モジュール223によって生成された視界画像にオーバーラップさせる。

The reference line-of-

仮想空間制御モジュール230は、ユーザ190に提供される仮想空間2を制御する。仮想空間定義モジュール231は、仮想空間2を表わす仮想空間データを生成することにより、HMDシステム100における仮想空間2を規定する。仮想オブジェクト生成モジュール232は、仮想空間2に配置される対象物を生成する。対象物は、例えば、山、木その他の背景を構成するオブジェクト、コンピュータ200によって実現されるプログラムを構成するストーリーに従って提示される動物のオブジェクト(例えば、馬オブジェクト101)、動物のオブジェクトを捕まえるためのオブジェクト(例えば、ロープオブジェクト102)を含む。

The virtual

コントローラ管理モジュール233は、仮想空間2においてユーザ190の動作を受け付けて、その動作に応じてコントローラオブジェクトを制御する。ある実施の形態に従うコントローラオブジェクトは、仮想空間2に配置される他のオブジェクトに対して命令を与えるコントローラとして機能する。ある局面において、コントローラ管理モジュール233は、仮想空間2において制御を受け付けるコントローラオブジェクトを仮想空間2に配置するためのデータを生成する。HMD110がこのデータを受信すると、モニタ112は、コントローラオブジェクトを表示し得る。

The

メモリモジュール240は、コンピュータ200が仮想空間2をユーザ190に提供するために使用されるデータを保持している。ある局面において、メモリモジュール240は、空間情報241と、ユーザ情報242と、コンテンツ243と、コメント244とを保持している。

The

空間情報241は、仮想空間2を提供するために規定された1つ以上のテンプレートを保持している。ユーザ情報242は、HMD110のユーザ190の識別情報、ユーザ190に関連付けられている権限等を含む。当該権限は、例えば、アプリケーションを提供するウェブサイトにアクセスするためのアカウント情報(ユーザID、パスワード)等を含む。コンテンツ243は、例えば、HMD110によって提示されるコンテンツを含む。コメント244は、ユーザ端末201A・・・201Nのいずれかによって入力されたコメントである。

The

通信制御モジュール250は、ネットワーク19を介して、サーバ150その他の情報通信装置と通信し得る。通信制御モジュール250は、無線および有線のいずれであってもよい。

The

ある局面において、表示制御モジュール220および仮想空間制御モジュール230は、例えば、ユニティテクノロジーズ社によって提供されるUnity(登録商標)を用いて実現され得る。別の局面において、表示制御モジュール220および仮想空間制御モジュール230は、各処理を実現する回路素子の組み合わせとしても実現され得る。

In an aspect, the

コンピュータ200における処理は、ハードウェアと、プロセッサ10により実行されるソフトウェアとによって実現される。このようなソフトウェアは、ハードディスクその他のメモリモジュール240に予め格納されている場合がある。また、ソフトウェアは、CD−ROMその他のコンピュータ読み取り可能な不揮発性のデータ記録媒体に格納されて、プログラム製品として流通している場合もある。あるいは、当該ソフトウェアは、インターネットその他のネットワークに接続されている情報提供事業者によってダウンロード可能なプログラム製品として提供される場合もある。このようなソフトウェアは、光ディスク駆動装置その他のデータ読取装置によってデータ記録媒体から読み取られて、あるいは、通信制御モジュール250を介してサーバ150その他のコンピュータからダウンロードされた後、記憶モジュールに一旦格納される。そのソフトウェアは、プロセッサ10によって記憶モジュールから読み出され、実行可能なプログラムの形式でRAMに格納される。プロセッサ10は、そのプログラムを実行する。

Processing in the

コンピュータ200を構成するハードウェアは、一般的なものである。したがって、本実施の形態に係る最も本質的な部分は、コンピュータ200に格納されたプログラムであるともいえる。なお、コンピュータ200のハードウェアの動作は周知であるので、詳細な説明は繰り返さない。

The hardware that constitutes the

なお、データ記録媒体としては、CD−ROM、FD(Flexible Disk)、ハードディスクに限られず、磁気テープ、カセットテープ、光ディスク(MO(Magnetic Optical Disc)/MD(Mini Disc)/DVD(Digital Versatile Disc))、IC(Integrated Circuit)カード(メモリカードを含む)、光カード、マスクROM、EPROM(Electronically Programmable Read-Only Memory)、EEPROM(Electronically Erasable Programmable Read-Only Memory)、フラッシュROMなどの半導体メモリ等の固定的にプログラムを担持する不揮発性のデータ記録媒体でもよい。 The data recording medium is not limited to a CD-ROM, FD (Flexible Disk), and hard disk, but is a magnetic tape, cassette tape, optical disk (MO (Magnetic Optical Disc) / MD (Mini Disc) / DVD (Digital Versatile Disc)). ), IC (Integrated Circuit) card (including memory card), optical card, mask ROM, EPROM (Electronically Programmable Read-Only Memory), EEPROM (Electronically Erasable Programmable Read-Only Memory), flash ROM, etc. It may be a non-volatile data recording medium that carries a fixed program.

ここでいうプログラムとは、プロセッサ10により直接実行可能なプログラムだけでなく、ソースプログラム形式のプログラム、圧縮処理されたプログラム、暗号化されたプログラム等を含み得る。

The program here may include not only a program directly executable by the

[サーバコンピュータの構成]

図13を参照して、サーバコンピュータ20の構成についてさらに説明する。図13は、ある局面にしたがってサーバコンピュータ20により実現される機能の構成を表わすブロック図である。サーバコンピュータ20は、記憶部1310と、信号受信部1320と、映像信号加工部1330と、映像信号送信部1340と、コメント受信部1350と、画像生成部1360と、画像送信部1370とを備える。

[Configuration of server computer]

The configuration of the

記憶部1310は、サーバコンピュータ20に入力されるデータやプログラムを保持する。例えば、記憶部1310は、HMD110から送信されたデータ、ユーザ端末201A,201B,201Nのいずれかによって入力されたコメント、HMD110に表示されているコンテンツの配信先を保持する。記憶部1310は、メモリモジュール240として、例えば、フラッシュメモリ、ハードディスク装置その他の不揮発性メモリと、RAMのような揮発性メモリとによって実現され得る。

The

信号受信部1320は、HMD110またはコンピュータ200から送信された映像信号を受信する。信号受信部1320は、通信制御モジュール250として実現される。

The

映像信号加工部1330は、信号受信部1320によって受信された映像信号の形式をユーザ端末201A,201B,201Nにおける表示に適合した形式の信号に変換する。例えば、HMD110において三次元画像を表示するための映像信号は、各ユーザ端末201において二次元画像を表示するための映像信号に変換される。映像信号加工部1330は、表示制御モジュール220によって実現される。

The video

映像信号送信部1340は、配信先として記憶部1310に登録されているユーザ端末201に対して、映像信号加工部1330によって生成された映像信号を送信する。ユーザ端末201がその映像信号に基づく画像を表示すると、ユーザ端末201のユーザは、HMD110を装着したユーザ190が視認している画像を認識できる。ユーザ端末201のユーザが画像に対するコメントを入力して送信操作を行なうと、そのコメントはサーバコンピュータ20に送信される。このとき、コメントが表示される場所を指定する位置情報もサーバコンピュータ20に送信される。映像信号送信部1340は、通信制御モジュール250によって実現される。

The video

コメント受信部1350は、ユーザ端末201から送信されたコメントと位置情報とを受信する。コメント受信部1350は、例えば、通信制御モジュール250によって実現される。受信されたコメントおよび位置情報は、記憶部1310に保存される。

The

画像生成部1360は、記憶部1310に保存されているコメントおよび位置情報を用いて、HMD110に提示されるコメント画像を生成する。例えば、HMD110の向きや位置に関わらずコメントが視界画像の領域の同じ場所に表示されるように、画像生成部1360は、コメントの画像を生成する。画像生成部1360は、例えば、表示制御モジュール220によって、視界画像生成モジュール223およびコメント付加モジュール225として、実現され得る。

The

画像送信部1370は、画像生成部1360によって生成されたコメント画像をHMD110に送信する。HMD110は、コンテンツの画像とコメント画像とがオーバーラップした画像を視認できる。このとき、コメント画像の位置は、HMD110の位置や向きに関わらず予め定めれた一定場所に定められている。

The

図14を参照して、サーバコンピュータ20のデータ構造について説明する。図14は、記憶部1310におけるデータの格納の一態様を概念的に表す図である。記憶部1310は、テーブル1410,1420,1430を保持している。テーブル1410は、ユーザID1411と、ユーザ名1412と、パスワード1413と、最終ログイン日時1414とを含む。テーブル1420は、ユーザID1421とステータス1422とを含む。テーブル1430は、ユーザID1431と、コメント日時1432と、位置1433と、コメント1434と、フレーム番号1435とを含む。

The data structure of the

テーブル1410は、あるコンテンツを共有しているユーザの情報を管理する。より具体的には、ユーザID1411は、配信サイトに登録されているユーザの識別データを表わす。ユーザ名1412は、当該ユーザの名前を表わす。パスワード1413は、ログインのために必要なパスワードを表わす。最終ログイン日時1414は、前回当該ユーザがログインしたに日時を表わす。

The table 1410 manages information on users who share certain contents. More specifically, the

テーブル1420は、当該コンテンツに対するユーザの状態を管理する。より具体的には、ユーザID1421は、現在ログインしているユーザの識別データを表わす。ステータス1422は、当該ユーザの現在の状態、例えば、コンテンツをプレイしているか否か、当該コンテンツを単に視聴しているか否かを表わす。

The table 1420 manages the user status for the content. More specifically, the

テーブル1430は、各ユーザによって入力されたコメントを管理する。より具体的には、ユーザID1431は、コメントを書き込んだユーザを識別する。コメント日時1432は、当該コメントが書き込まれた日時を表わす。位置1433は、当該コメントが表示される位置を表わす。コメント1434は、コメントの内容を表わす。フレーム番号1435は、コンテンツを構成するフレームの番号である。フレーム番号1435は、コメントが書き込まれた、コンテンツにおける位置情報を表わす。別の局面において、フレーム番号1435の代わりに、コンテンツの再生位置を特定する時間情報が当該位置情報として保存されてもよい。当該コンテンツの再生が終了した後に、別の日時に、同じコンテンツの再生が指定された場合に、サーバコンピュータ20のプロセッサは、テーブル1430を参照することにより、そのコンテンツに対して書き込まれたコメントを読み出して、コンテンツと共にコメントを視聴者に提示できる。

The table 1430 manages comments input by each user. More specifically, the

[制御構造]

図15を参照して、サーバコンピュータ20の制御構造について説明する。図15は、サーバコンピュータ20がコンピュータ200によって実現される場合に実行される処理の一部を表わすフローチャートである。

[Control structure]

A control structure of the

ステップS1510にて、プロセッサ10は、通信制御モジュール250を介して、動画の配信サイトを提供するサーバ150にアクセスし、ログイン情報をサーバ150に送信する。

In step S <b> 1510, the

ステップS1515にて、プロセッサ10は、通信制御モジュール250を介して、ユーザ190によって選択されたコンテンツ(例えば、360度動画、ゲームアプリケーション、チャットアプリケーション)の配信要求をサーバ150に送信する。サーバ150は、その要求に応答して、当該コンテンツを20に送信する。

In step S1515, the

ステップS1520にて、プロセッサ10は、通信制御モジュール250を介して、動画を表示するための映像信号をサーバ150から受信する。

In step S1520,

ステップS1525にて、プロセッサ10は、視界画像生成モジュール223として、映像信号に基づく視界画像を仮想空間に提示するためのデータ(コンテンツ画像データ)を生成する。

In step S1525, the

ステップS1530にて、プロセッサ10は、コンテンツ画像データをHMD110に送信する。

In step S1530,

ステップS1535にて、プロセッサ10は、コントローラ160からの信号に基づいて、ユーザ190の操作に応じた信号を受信したことを検知する。

In step S1535, the

ステップS1540にて、プロセッサ10は、視界画像生成モジュール223として、操作に応じたコンテンツ画像データを生成し、生成したコンテンツ画像データをサーバ150を介して他ユーザのユーザ端末(たとえば、ユーザ端末201A,201B・・・201N)等に送信する。

In step S1540, the

ステップS1545にて、プロセッサ10は、通信制御モジュール250を介して、他ユーザに入力されたコメントとコメントを表示する位置情報とをサーバ150から受信する。

In step S <b> 1545, the

ステップS1550にて、プロセッサ10は、コメントをHMD110に表示するためのデータ(コメント画像データ)を生成する。ある局面において、プロセッサ10は、HMD110に提示される仮想空間を表示するためのアプリケーションに基づく画像データとは別に、当該コメントをHMD110に表示するためのデータを生成する。

In step S1550,

ステップS1555にて、プロセッサ10は、コメント付加モジュール225として、コンテンツ画像データとコメント画像データとを用いて、コンテンツとコメントとがオーバーラップされた視界画像データを生成する。

In step S1555, the

ステップS1560にて、プロセッサ10は、視界画像データをHMD110に出力する。ユーザ190は、モニタ112に表示されたコメントを認識し得る。

In step S1560,

図16を参照して、別の局面におけるサーバコンピュータ20の制御構造について説明する。図16は、サーバコンピュータ20がサーバ150によって実現される場合に実行される処理の一部を表わすフローチャートである。

With reference to FIG. 16, the control structure of

ステップS1610にて、サーバ150のプロセッサ151は、コンピュータ200から送られる信号に基づいて、HMD110を装着したユーザ190のログインを検知し、受信した信号に含まれるユーザIDおよびパスワードと、登録情報として予め保持しているユーザIDおよびパスワードとを用いて、認証処理を実行する。

In step S1610, the

ステップS1620にて、サーバ150のプロセッサ151は、ユーザ190に指定されたアプリケーションプログラムを記憶装置からRAMにロードする。プロセッサ151は、そのロードしたアプリケーションプログラムを実行し、その実行に基づく映像信号をコンピュータ200に送信する。HMD110は、その映像信号に基づき仮想空間2にコンテンツを表示する。ユーザ190は、そのコンテンツを見ながらコントローラ160を操作し得る。捜査情報は、コントローラ160からコンピュータ200に送られ、コンテンツの表示が変わる。

In step S1620,

ステップS1630にて、サーバ150のプロセッサ151は、当該ユーザの操作に基づき画像を表示するための映像信号をコンピュータ200から受信する。

In step S1630,

ステップS1640にて、サーバ150のプロセッサ151は、ユーザ端末201A等から受信した信号に基づいて、他ユーザによるログインを検知し、ユーザIDおよびパスワードを用いて認証処理を実行する。予め登録されている正規のユーザによるログイン要求であることが確認されると、サーバ150は、当該ユーザ端末201A等によるアクセスを受け付ける。

In step S1640,

ステップS1650にて、サーバ150のプロセッサ151は、三次元画像として視認される画像を二次元表示用の画像に変換して、変換により生成された映像信号を他ユーザのユーザ端末201A等に送信する。ユーザ端末201Aは、そのモニタに、ユーザ190が視聴しているコンテンツと同じコンテンツを表示するので、当該他ユーザもそのコンテンツを楽しむことができる。他ユーザは、そのコンテンツを見ながら、ユーザ190に対するコメントを入力装置を用いて入力できる。入力されたコメントは、位置情報と共に、サーバ150に送信される。

In step S1650,

ステップS1660にて、サーバ150のプロセッサ151は、他ユーザのユーザ端末201A,201B・・・201Nのいずれかからのコメントを受信する。

In step S1660,

ステップS1670にて、サーバ150のプロセッサ151は、コメントを視界画像として表示するための映像信号を生成し、生成した映像信号をHMD110を装着したユーザ190のコンピュータ200に送信する。HMD110のモニタ112は、コンテンツの画像にオーバーラップされたコメントを表示し得る。

In step S1670,

図17を参照して、他ユーザの端末の制御構造について説明する。図17は、他ユーザのユーザ端末201Aによって実行される処理の一部を表わすフローチャートである。

With reference to FIG. 17, the control structure of another user's terminal is demonstrated. FIG. 17 is a flowchart showing a part of the processing executed by

ステップS1710にて、プロセッサ211は、他ユーザの操作に基づいて、モニタ212に表示されている配信サイトにログインする。ステップS1720にて、プロセッサ211は、他ユーザの操作に基づいて、配信を希望するコンテンツの選択を受け付ける。例えば、他ユーザは、ユーザ190が視聴しているコンテンツを選択し得る。ステップS1730にて、プロセッサ211は、コンテンツの配信要求をサーバ150に送信する。

In step S1710,

ステップS1740にて、プロセッサ211は、サーバ150から映像信号を受信し、その信号に基づく映像をモニタ212に表示する。ステップS1750にて、プロセッサ211は、マウス、キーボード、タッチパネル等の入力インターフェイスを介して、映像に対するコメントの入力を受け付ける。

In step S1740,

ステップS1760にて、プロセッサ211は、コメントをサーバ150に送信する。サーバ150が、このコメントをHMD110が接続されたコンピュータ200に送信すると、コメントは、モニタ112に表示される。

In step S1760,

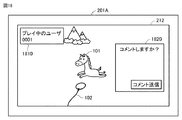

図18を参照して、ユーザ端末201Aにおける画面の表示態様について説明する。図18は、ユーザ端末201Aのモニタ212に表示される画面の一例を表わす図である。ある局面において、モニタ212は、ユーザ190が装着しているHMD110のモニタ112に表示されるコンテンツと同じコンテンツを表示する。さらに、モニタ212は、プレイ中のユーザがユーザ190(=ユーザ0001)であることを表わす画像1810と、コメントその送信を促す画像1820とを表示する。画像1810と画像1820とは、例えば、ポップアップ画像である。

With reference to FIG. 18, the display mode of the screen in

例えば、ユーザ端末201Aが、モニタ112に表示されているコンテンツの表示を開始すると、モニタ212は、予め定められた時間、画像1810を表示する。別の局面において、ユーザ190がコントローラ160を操作すると、その操作に応答して、画像1810が表示される。この場合、ユーザ端末201Aを使用する他ユーザは、当該操作に応答してシーンが移り変わると、プレイ中のユーザを知ることができる。

For example, when the

画像1820は、ある局面において、予め定められた時間ごとに表示される。別の局面において、画像1820は、画像1810と同様に、ユーザ190が何らかの操作を行なったタイミングに応答して表示される。この場合、他ユーザは、ユーザ190の操作に対するコメントの入力タイミングを逸しにくくなるので、例えば図1に示されるように、他ユーザのコメントも速やかにモニタ112に表示される。その結果、ユーザ190もタイムリーなコメントを視認しやすくなる。

The

図19を参照して、モニタ112におけるコンテンツおよびコメントの表示について説明する。図19は、モニタ112に画像を表示するためのデータの生成の流れを概念的に表す図である。

The display of content and comments on the

状態Aに示されるように、ある局面において、メモリ11は、一部のワーク領域に、モニタ112にコンテンツを表示するための描画データ1910を保持している。コンテンツは、馬オブジェクト101およびロープオブジェクト102を含む。

As shown in state A, in one aspect, the

状態Bに示されるように、メモリ11は、上記ワーク領域とは異なる別のワーク領域に、他ユーザによって入力されたコメント1921を表示するための描画データ1920を保持している。描画データ1920は、コメント1921がコンピュータ200において受信された後に生成される。なお、コメント1921が表示される場所は、HMD110の向きや姿勢に関わらず、モニタ112の一定の場所に維持される。したがって、例えば、馬オブジェクト101が仮想空間2において移動することにより、視線方向(仮想カメラ1の方向)が動いた場合であっても、コメント1921は、モニタ112の一定位置に表示されることになる。このような表示のための位置関係は、例えば、モニタ112の表示領域を絶対位置の座標値とし、コメント1921の表示場所を、当該絶対位置の座標値に関連付けて規定することで維持される。

As shown in state B, the

状態Cに示されるように、メモリ11は、さらに別のワーク領域に、描画データ1930を保持する。描画データ1930は、描画データ1910と描画データ1920とを構成することにより生成される。プロセッサ10は、描画データ1930をHMD110に送信すると、モニタ112は、図1の状態Aに示されるような画像を表示する。その他の画像についても同様に、コメントが表示される(図1の状態B、状態C)。

As shown in the state C, the

図20を参照して、ユーザ端末201における画面の表示態様について説明する。図20は、ユーザ190によって入力されたコメントが他ユーザのユーザ端末201のモニタ212に表示される画面の一態様を表わす図である。モニタ212は、HMD110のモニタ112に表示されている仮想空間の画像に加えて、画像2010と、画像2020とを表示する。画像2010は、プレイしているユーザ190を表わす。画像2020は、ユーザ190によって入力されたコメントを表わす。例えば、ユーザ190がコンテンツを楽しんだ後に応答コメントを入力すると、当該応答コメントは、ユーザ190に対してコメントを送った他ユーザに送信される。このように、他ユーザとユーザ190との間でコメントが互いに送られることにより、ユーザ190と他ユーザとの対話が促進され得る。

With reference to FIG. 20, the display mode of the screen in the

以上より、本開示に係る技術的特徴は、以下のように要約され得る。

(第1構成) 仮想空間2を提供するHMD110における表示を制御するためにサーバコンピュータ20で実行される方法は、HMD110のユーザ190の操作に応じた映像を表示するための映像信号をHMD110に送信するステップと、サーバコンピュータ20と通信可能に接続されている一つ以上のユーザ端末201A,201B,201N等に映像信号を送信するステップと、映像信号に基づいて一つ以上のユーザ端末201A,201B,201N等に表示される映像に対して与えられる視聴者応答(例えば、コメント103,104,105,106等)を一つ以上のユーザ端末201A,201B,201N等から受信するステップと、HMD110のモニタ112に視聴者応答を提示させるステップとを含む。

As described above, the technical features according to the present disclosure can be summarized as follows.

(1st structure) The method performed in the

(第2構成) 上記の構成に加えて、一つ以上のユーザ端末201A,201B,201N等に映像信号を送信するステップは、一つ以上のユーザ端末201A,201B,201N等に二次元の画像を表示するための信号を送信することを含む。

(2nd structure) In addition to said structure, the step which transmits a video signal to one or

(第3構成) 上記の構成に加えて、視聴者応答を一つ以上のユーザ端末201A,201B,201N等から受信するステップは、仮想空間2において視聴者応答が提示される場所を指定する位置情報を受信するステップを含む。

(3rd structure) In addition to said structure, the step which receives a viewer response from one or

(第4構成) 上記の構成に加えて、視聴者応答を一つ以上のユーザ端末201A,201B,201N等から受信するステップは、複数のユーザ端末201A,201B,201N等の各々から視聴者応答を受信することを含む。位置情報を受信するステップは、各ユーザ端末201A,201B,201N等の位置情報をそれぞれ受信することを含む。モニタ112に視聴者応答を提示させるステップは、各位置情報が同じ位置を示している場合に各視聴者応答を互いにずらして提示させることを含む。

(Fourth Configuration) In addition to the above-described configuration, the step of receiving a viewer response from one or

(第5構成) 上記のいずれかの構成に加えて、視聴者応答を一つ以上のユーザ端末201A,201B,201N等から受信するステップは、複数の視聴者応答を一つ以上のユーザ端末201A,201B,201N等から受信することを含む。視聴者応答を提示させるステップは、複数の視聴者応答のうちのいずれかの視聴者応答を他の視聴者応答にオーバーレイ表示することを含む。

(Fifth Configuration) In addition to any of the configurations described above, the step of receiving a viewer response from one or

(第6構成)上記方法は、上記のいずれかの構成に加えて、仮想空間2に提示された視聴者応答に対してユーザによって入力されるユーザ応答をサーバコンピュータ20から受信するステップと、ユーザ応答を表示するための信号を一つ以上のユーザ端末201A,201B,201N等に送信するステップとをさらに含む。

(Sixth Configuration) In addition to any of the above configurations, the method receives a user response input by the user from the

(第7構成) 上記方法は、上記のいずれかの構成に加えて、仮想空間2に提示された視聴者応答を消去するステップをさらに含む。

(Seventh Configuration) In addition to any of the above configurations, the method further includes a step of deleting the viewer response presented in the

(第8構成) 上記のいずれかの構成に加えて、視聴者応答を消去するステップは、仮想空間2に提示される画像の変化に応じてコメントを消去するステップを含む。

(8th structure) In addition to one of said structures, the step which erase | eliminates a viewer response includes the step which erase | eliminates a comment according to the change of the image shown in the

(第9構成) 上記方法は、上記のいずれかの構成に加えて、映像信号と視聴者応答とを関連付けて記憶装置に保存するステップをさらに含む。 (Ninth Configuration) In addition to any of the above configurations, the method further includes a step of storing the video signal and the viewer response in a storage device in association with each other.

(第10構成) 上記方法は、上記の第9構成に加えて、映像信号に基づく映像を再生するステップと、映像の再生に応じて、当該映像信号に関連付けられた視聴者応答を仮想空間2に提示させるステップとをさらに含む。 (Tenth Configuration) In addition to the ninth configuration described above, the method includes a step of playing a video based on a video signal, and a viewer response associated with the video signal according to the playback of the video. Further presenting.

(第11構成) 上記方法は、上記のいずれかの構成に加えて、HMD110のユーザ190の動きを検出するステップと、動きに連動して、仮想空間2の視界画像をモニタ112に提示させるステップをさらに含む。視聴者応答を提示させるステップは、動きに連動することなく視聴者応答を提示させることを含む。

(Eleventh Configuration) In addition to any of the configurations described above, the method includes a step of detecting the movement of the

以上のようにして、本開示に係る技術によれば、実況者であるユーザ190によって他のユーザ端末201に提供される映像に対して、ユーザ端末201のユーザ(視聴者)がコメントを入力すると、ユーザ190のHMD110が表示する映像内にそのコメントが表示される。例えば、表示領域の端部に、あるいは、仮想空間2に提示されるオブジェクトの向こう側に表示される。あるいは、コメントは、ポップアップ表示され得る。別の局面では、コメントは、ゲームその他のコンテンツの画面の上にオーバーレイ表示され得る。このようにコメントが表示されると、ユーザ190は、その没入感を阻害されることなく、コメントを確認できる。

As described above, according to the technology according to the present disclosure, when a user (viewer) of the

今回開示された実施の形態はすべての点で例示であって制限的なものではないと考えられるべきである。本発明の範囲は上記した説明ではなくて特許請求の範囲によって示され、特許請求の範囲と均等の意味および範囲内でのすべての変更が含まれることが意図される。 The embodiment disclosed this time should be considered as illustrative in all points and not restrictive. The scope of the present invention is defined by the terms of the claims, rather than the description above, and is intended to include any modifications within the scope and meaning equivalent to the terms of the claims.

本開示に係る技術的特徴は、HMDを用いて仮想空間を提供する技術に適用可能である。 The technical features according to the present disclosure can be applied to a technology that provides a virtual space using an HMD.

1 仮想カメラ、2 仮想空間、5 基準視線、10,151,211 プロセッサ、11,152 メモリ、12 ストレージ、13 入出力インターフェイス、14,153 通信インターフェイス、15 バス、19 ネットワーク、20 サーバコンピュータ、21 中心、22 仮想空間画像、23 視界領域、24,25 領域、26 視界画像、30 グリップ、31 フレーム、32 天面、33,34,36,37 ボタン、38 アナログスティック、100 システム、101 馬オブジェクト、102 ロープオブジェクト、103,104,105,106,244,1434,1921 コメント、112,212 モニタ、114,120 センサ、130 モーションセンサ、140 注視センサ、150 サーバ、160 コントローラ、200 コンピュータ、201,201A,201B,201N ユーザ端末。 1 virtual camera, 2 virtual space, 5 reference line of sight, 10, 151, 211 processor, 11, 152 memory, 12 storage, 13 input / output interface, 14, 153 communication interface, 15 bus, 19 network, 20 server computer, 21 center , 22 virtual space image, 23 field of view, 24, 25 region, 26 field of view image, 30 grip, 31 frame, 32 top surface, 33, 34, 36, 37 buttons, 38 analog stick, 100 system, 101 horse object, 102 Rope object, 103, 104, 105, 106, 244, 1434, 1921 Comment, 112, 212 Monitor, 114, 120 Sensor, 130 Motion sensor, 140 Gaze sensor, 150 Server, 160 Controller, 200 computer, 201,201A, 201B, 201N user terminal.

Claims (13)

前記ヘッドマウントデバイスのユーザの操作に応じた映像を表示するための映像信号を前記ヘッドマウントデバイスに送信するステップと、

前記コンピュータと通信可能に接続されている一つ以上の表示端末に前記映像信号を送信するステップと、

前記映像信号に基づいて前記一つ以上の表示端末に表示される映像に対して与えられる視聴者応答を前記一つ以上の表示端末から受信するステップと、

前記ヘッドマウントデバイスに前記視聴者応答を提示させるステップとを含む、方法。 A computer-implemented method for controlling display in a head-mounted device that provides virtual space,

Transmitting a video signal for displaying a video according to an operation of a user of the head mounted device to the head mounted device;

Transmitting the video signal to one or more display terminals communicably connected to the computer;

Receiving, from the one or more display terminals, a viewer response given to the video displayed on the one or more display terminals based on the video signal;

Causing the head mounted device to present the viewer response.

前記位置情報を受信するステップは、各前記表示端末の位置情報をそれぞれ受信することを含み、

前記モニタに前記視聴者応答を提示させるステップは、各前記位置情報が同じ位置を示している場合に各前記視聴者応答を互いにずらして提示させることを含む、請求項3に記載の方法。 Receiving the viewer response from the one or more display terminals includes receiving a viewer response from each of a plurality of display terminals;

Receiving the position information includes receiving position information of each of the display terminals;

4. The method of claim 3, wherein causing the monitor to present the viewer response includes causing the viewer responses to be presented with a shift relative to each other when the location information indicates the same location.

前記視聴者応答を提示させるステップは、複数の前記視聴者応答のうちのいずれかの視聴者応答を他の視聴者応答にオーバーレイ表示することを含む、請求項1〜4のいずれかに記載の方法。 Receiving the viewer response from the one or more display terminals includes receiving a plurality of the viewer responses from the one or more display terminals;

5. The step of presenting the viewer response includes displaying the viewer response of any one of the plurality of viewer responses as an overlay on another viewer response. Method.

前記ユーザ応答を表示するための信号を前記一つ以上の表示端末に送信するステップとをさらに含む、請求項1〜5のいずれかに記載の方法。 Receiving from the computer a user response input by the user in response to a viewer response presented in the virtual space;

The method according to claim 1, further comprising: transmitting a signal for displaying the user response to the one or more display terminals.

前記映像の再生に応じて、当該映像信号に関連付けられた視聴者応答を前記仮想空間に提示させるステップとをさらに含む、請求項9に記載の方法。 Playing a video based on the video signal;

10. The method of claim 9, further comprising: causing a viewer response associated with the video signal to be presented in the virtual space in response to playback of the video.

前記動きに連動して、前記仮想空間の視界画像を前記モニタに提示させるステップをさらに含み、

前記視聴者応答を提示させるステップは、前記動きに連動することなく前記視聴者応答を提示させることを含む、請求項1〜10のいずれかに記載の方法。 Detecting a movement of a user of the head mounted device;

Further comprising the step of causing the monitor to present a visual field image of the virtual space in conjunction with the movement,

The method according to claim 1, wherein the step of presenting the viewer response includes causing the viewer response to be presented without being interlocked with the movement.

前記プログラムを実行するためのプロセッサとを備える、情報処理装置。 A memory storing the program according to claim 12;

An information processing apparatus comprising: a processor for executing the program.

Priority Applications (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2018153742A JP2018207517A (en) | 2018-08-17 | 2018-08-17 | Method to be executed by computer for controlling display in head-mounted device, program for causing computer to execute the same method, and information processing device |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2018153742A JP2018207517A (en) | 2018-08-17 | 2018-08-17 | Method to be executed by computer for controlling display in head-mounted device, program for causing computer to execute the same method, and information processing device |

Related Parent Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2017108236 Division | 2017-05-31 | 2017-05-31 |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| JP2018207517A true JP2018207517A (en) | 2018-12-27 |

| JP2018207517A5 JP2018207517A5 (en) | 2020-11-12 |

Family

ID=64957473

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2018153742A Pending JP2018207517A (en) | 2018-08-17 | 2018-08-17 | Method to be executed by computer for controlling display in head-mounted device, program for causing computer to execute the same method, and information processing device |

Country Status (1)

| Country | Link |

|---|---|

| JP (1) | JP2018207517A (en) |

Citations (8)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2004272592A (en) * | 2003-03-07 | 2004-09-30 | Matsushita Electric Ind Co Ltd | Information processing system, server device, terminal equipment, information processing program for server device, and information processing program for terminal equipment |

| JP2005038008A (en) * | 2003-07-15 | 2005-02-10 | Canon Inc | Image processing method, image processor |

| JP2009290794A (en) * | 2008-05-30 | 2009-12-10 | Panasonic Corp | Transport stream generating apparatus, transport stream generating method, content distribution server and control method of content distribution server |

| WO2014013689A1 (en) * | 2012-07-20 | 2014-01-23 | パナソニック株式会社 | Moving-image-with-comments generation device and moving-image-with-comments generation method |

| JP2015100039A (en) * | 2013-11-19 | 2015-05-28 | 株式会社ソニー・コンピュータエンタテインメント | Information processor |

| JP2015176274A (en) * | 2014-03-14 | 2015-10-05 | 株式会社コナミデジタルエンタテインメント | Message display control device, message display control system, message display control server, and program |

| WO2016038964A1 (en) * | 2014-09-08 | 2016-03-17 | ソニー株式会社 | Information processing device and information processing method |

| WO2017055910A1 (en) * | 2015-09-30 | 2017-04-06 | Sony Interactive Entertainment Inc. | Methods for optimizing positioning of content on a screen of a head mounted display |

-

2018

- 2018-08-17 JP JP2018153742A patent/JP2018207517A/en active Pending

Patent Citations (8)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2004272592A (en) * | 2003-03-07 | 2004-09-30 | Matsushita Electric Ind Co Ltd | Information processing system, server device, terminal equipment, information processing program for server device, and information processing program for terminal equipment |

| JP2005038008A (en) * | 2003-07-15 | 2005-02-10 | Canon Inc | Image processing method, image processor |

| JP2009290794A (en) * | 2008-05-30 | 2009-12-10 | Panasonic Corp | Transport stream generating apparatus, transport stream generating method, content distribution server and control method of content distribution server |

| WO2014013689A1 (en) * | 2012-07-20 | 2014-01-23 | パナソニック株式会社 | Moving-image-with-comments generation device and moving-image-with-comments generation method |

| JP2015100039A (en) * | 2013-11-19 | 2015-05-28 | 株式会社ソニー・コンピュータエンタテインメント | Information processor |

| JP2015176274A (en) * | 2014-03-14 | 2015-10-05 | 株式会社コナミデジタルエンタテインメント | Message display control device, message display control system, message display control server, and program |

| WO2016038964A1 (en) * | 2014-09-08 | 2016-03-17 | ソニー株式会社 | Information processing device and information processing method |

| WO2017055910A1 (en) * | 2015-09-30 | 2017-04-06 | Sony Interactive Entertainment Inc. | Methods for optimizing positioning of content on a screen of a head mounted display |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| US20190026950A1 (en) | Program executed on a computer for providing virtual space, method and information processing apparatus for executing the program | |

| JP6257827B1 (en) | Method, program, and information processing apparatus executed by computer to provide virtual space | |

| JP6257826B1 (en) | Method, program, and information processing apparatus executed by computer to provide virtual space | |

| US20180348531A1 (en) | Method executed on computer for controlling a display of a head mount device, program for executing the method on the computer, and information processing apparatus therefor | |

| JP2018072604A (en) | Method for suppressing vr sickness, program for causing computer to execute the method, and information processing device | |

| JP6836379B2 (en) | An information processing method, a device, and a program that causes a computer to execute the information processing method. | |

| JP6227732B1 (en) | Method and apparatus for supporting input in virtual space, and program causing computer to execute the method | |

| JP2018125003A (en) | Information processing method, apparatus, and program for implementing that information processing method in computer | |

| JP6495398B2 (en) | Method and program for providing virtual space, and information processing apparatus for executing the program | |

| JP6457446B2 (en) | Method and apparatus for supporting communication in virtual space, and program for causing computer to execute the method | |

| JP2018049629A (en) | Method and device for supporting input in virtual space and program for causing computer to execute the method | |

| JP6382928B2 (en) | Method executed by computer to control display of image in virtual space, program for causing computer to realize the method, and computer apparatus | |

| JP6250779B1 (en) | Method executed by computer to communicate via virtual space, program causing computer to execute the method, and information processing apparatus | |

| JP6368404B1 (en) | Information processing method, program, and computer | |

| JP2018170013A (en) | Method executed by computer to control display of image in virtual space, program for causing computer to achieve the method, and computer device | |

| KR102538480B1 (en) | Computer readable recording medium on which program is recorded, information processing method, and information processing apparatus | |

| JP2018206340A (en) | Method which is executed on computer for providing virtual space, program and information processor | |

| JP2018032384A (en) | Method and device for assisting communication in virtual space and program enabling computer to execute method | |

| JP2018101293A (en) | Method executed by computer to provide head-mounted device with virtual space, program causing computer to execute the same and computer device | |

| JP2018207517A (en) | Method to be executed by computer for controlling display in head-mounted device, program for causing computer to execute the same method, and information processing device | |

| JP2019016358A (en) | Information processing method, program and computer | |

| JP2019015972A (en) | Method for suppressing vr sickness, program for causing computer to execute the method, and information processing device | |

| JP2018142251A (en) | Method for providing virtual reality, program for causing computer to execute method, and information processing apparatus for executing program | |

| JP6318224B1 (en) | A method executed by a computer to display content in a virtual space using a head-mounted device, a program for causing a computer to execute the method, and an information processing apparatus | |

| JP2018147378A (en) | Information processing method, apparatus, and program for implementing that information processing method in computer |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20200420 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20201002 |

|

| A977 | Report on retrieval |

Free format text: JAPANESE INTERMEDIATE CODE: A971007 Effective date: 20210114 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20210224 |

|

| A02 | Decision of refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A02 Effective date: 20210824 |