JP2016139342A - 装置連携による情報入力方法、情報処理装置、コンピュータプログラム - Google Patents

装置連携による情報入力方法、情報処理装置、コンピュータプログラム Download PDFInfo

- Publication number

- JP2016139342A JP2016139342A JP2015014784A JP2015014784A JP2016139342A JP 2016139342 A JP2016139342 A JP 2016139342A JP 2015014784 A JP2015014784 A JP 2015014784A JP 2015014784 A JP2015014784 A JP 2015014784A JP 2016139342 A JP2016139342 A JP 2016139342A

- Authority

- JP

- Japan

- Prior art keywords

- information

- input

- information processing

- screen

- display screen

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Pending

Links

Images

Landscapes

- Studio Devices (AREA)

- User Interface Of Digital Computer (AREA)

Abstract

【課題】デジタルカメラへの情報入力を行うときのユーザの操作負担を軽減させる。

【解決手段】デジタルカメラ51の表示画面53のキャプチャ画像とユーザによってタッチ操作された入力項目などの情報をスマートフォン52に送信し、表示画面54に表示させる。スマートフォン52は、これらの情報の表示を通じて受け付けた入力情報をデジタルカメラ51に送信する。デジタルカメラ51は、入力情報をタッチ操作された入力項目に入力する。

【選択図】図4

【解決手段】デジタルカメラ51の表示画面53のキャプチャ画像とユーザによってタッチ操作された入力項目などの情報をスマートフォン52に送信し、表示画面54に表示させる。スマートフォン52は、これらの情報の表示を通じて受け付けた入力情報をデジタルカメラ51に送信する。デジタルカメラ51は、入力情報をタッチ操作された入力項目に入力する。

【選択図】図4

Description

本発明は、ユーザが保持する複数の情報処理装置の連携により、文字入力などの操作負担を軽減する情報入力方法、情報処理装置およびコンピュータプログラムに関する。

近年、デジタルカメラやビデオカメラなどのデバイスの中には、撮影画像に対してタイトルやファイル名などの任意の文字を操作画面から入力する機能を搭載したものがある。さらに、ユーザの利便性の向上を目的として、ユーザが使い慣れている携帯端末を利用してデジタルカメラなどのデバイスに対して文字入力する従来技術もある(特許文献1参照)。

このような従来技術では、ユーザが機器側で画面上の文字入力領域にフォーカスを合わせ、携帯端末側の動作モードを文字入力モードに切り替えて文字を入力する。文字入力モードに切り替えると、携帯端末側でアプリケーションが起動され、画面に文字入力エリアが表示され、キーボードなどを利用した文字入力が可能となる。

従来技術では、携帯端末側の画面には、デジタルカメラなどのデバイス側の情報が表示されない。そのため、ユーザが携帯端末へ文字などを入力する際に、自分がどのデバイスのどの部分に対して文字を入力しているかなど、デバイス側の画面表示の内容を逐一確認する必要があり、煩雑であった。このような問題は、2つ以上の情報処理装置を連携させて文字などを入力する場合に共通に生じる。

本発明は、2つ以上の情報処理装置を連携させて情報入力を行うときのユーザの操作負担を軽減する技術を提供することを主たる課題とする。

本発明は、それぞれ情報入力用の表示画面を有する複数の情報処理装置を通信路を介して接続し、いずれか一つの第1情報処理装置の前記表示画面の画面情報を他の第2情報処理装置の前記表示画面に表示させ、該画面情報の表示を通じて前記第2情報処理装置で受け付けた入力情報を前記第1情報処理装置に入力する、装置連携による情報入力方法を提供する。

本発明によれば、第1情報処理装置の表示画面の情報が第2情報処理装置の表示画面に表示されるので、第2情報処理装置から第1情報処理装置への情報入力を行う際のユーザの操作負担を軽減することができる。

以下、本発明の実施の形態例について説明する。

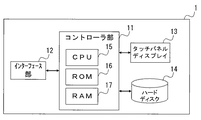

図1は、本実施形態に係る情報処理装置のハードウェア構成図である。後述する複数の情報処理装置に共通となるハードウェア構成例を示してある。情報処理装置1は、コントローラ部11、インターフェース部12、タッチパネルディスプレイ13、ハードディスク14を備えている。コントローラ部11は、CPU15、ROM16、RAM17を含むコンピュータである。CPU(Central Processing Unit)15は、コンピュータプログラムを実行することにより、装置全体の動作を制御する。このコンピュータプログラムは、装置全体の動作を制御するための基本プログラムのほか、タッチセンサ用プログラムなど、個別的な機能を実現するためのアプリケーションプログラムも含まれる。これらのプログラムは、ROM(Read Only Memory)16およびハードディスク14に格納されている。そして、一時記憶領域としてのRAM(Random Access Memory)17に適宜読み出される。すなわち、RAM17は、CPU15が各処理の実行の際に使用される作業領域である。RAM17には、ユーザによって入力されたデータなども一時的に記憶される。ハードディスク14には、上記のコンピュータプログラム(一部)のほか、UI(User Interface)操作を実現するためのUIデータも格納されている。UIデータは、例えばユーザが操作する操作ボタンや入力項目などのUI操作項目、表示画面のレイアウト、文字入力エリア、専用文字入力エリア、ソフトウェアキーボードなどである。ソフトウェアキーボードは、タッチパネルディスプレイ13に表示され、タッチ操作などで文字の入力や変換を行うことが可能な公知の情報入力ツールである。

図1は、本実施形態に係る情報処理装置のハードウェア構成図である。後述する複数の情報処理装置に共通となるハードウェア構成例を示してある。情報処理装置1は、コントローラ部11、インターフェース部12、タッチパネルディスプレイ13、ハードディスク14を備えている。コントローラ部11は、CPU15、ROM16、RAM17を含むコンピュータである。CPU(Central Processing Unit)15は、コンピュータプログラムを実行することにより、装置全体の動作を制御する。このコンピュータプログラムは、装置全体の動作を制御するための基本プログラムのほか、タッチセンサ用プログラムなど、個別的な機能を実現するためのアプリケーションプログラムも含まれる。これらのプログラムは、ROM(Read Only Memory)16およびハードディスク14に格納されている。そして、一時記憶領域としてのRAM(Random Access Memory)17に適宜読み出される。すなわち、RAM17は、CPU15が各処理の実行の際に使用される作業領域である。RAM17には、ユーザによって入力されたデータなども一時的に記憶される。ハードディスク14には、上記のコンピュータプログラム(一部)のほか、UI(User Interface)操作を実現するためのUIデータも格納されている。UIデータは、例えばユーザが操作する操作ボタンや入力項目などのUI操作項目、表示画面のレイアウト、文字入力エリア、専用文字入力エリア、ソフトウェアキーボードなどである。ソフトウェアキーボードは、タッチパネルディスプレイ13に表示され、タッチ操作などで文字の入力や変換を行うことが可能な公知の情報入力ツールである。

タッチパネルディスプレイ13は、表示画面となるGUI(Graphical User Interface)を有する。GUIには、適宜、上記のUI操作項目などが表示される。タッチパネルディスプレイ13は、また、UI操作項目の一つである入力項目への入力操作を受け付ける。すなわち、タッチパネルディスプレイ13はタッチセンサを備えており、このタッチセンサで検出された信号がROM16に格納されたタッチセンサ用プログラムにより処理される。そして、ユーザによるタッチ位置がタッチパネルディスプレイ13上の座標値として算出される。この算出された座標値とタッチパネルディスプレイ13に表示されるUI操作項目の座標値との対応関係から、ユーザが操作したUI操作項目がどのような種別のもので、どのような操作内容であったのかが検出される。また、検出結果に基づいて所要の処理が実行可能になる。

例えば、ユーザが表示画面に表示された入力項目を1回タッチしたとする。この場合、その入力項目と、そこに1回タッチされたという操作内容とが検出される。入力項目のうち文字入力エリアがタッチされると、ソフトウェアキーボードなどの仮想キーボードが自動的に起動する。このように、入力項目に特定の機能が割り当てられている場合、操作内容に応じた機能が実行可能になる。情報処理装置1は、インターフェース部12を介して同種の外部装置と通信路を介して接続され、各種データの送受信を行う。

図2は、複数の情報処理装置のうち通信路で接続可能な2つを連携させて文字入力を行うときの機能構成図である。ここでは、一つの情報処理装置がデジタルカメラに搭載され、他の情報処理装置がスマートフォンに搭載されている場合の例を示す。デジタルカメラに搭載されている情報処理装置を第1情報処理装置2、スマートフォンに搭載されている情報処理装置を第2情報処理装置4とする。デジタルカメラは、それ自体でも文字入力が可能なデバイスであるが、ここでは、文字の入力を情報入力が比較的容易なスマートフォンで行う場合の例を説明する。第1情報処理装置2および第2情報処理装置4は、それぞれ図1に示したハードウェア構成を有するものであり、ネットワーク3を介して相互に接続されている。なお、「文字」とは、狭義の文字のほか、記号、数字、語句などを含む。デジタルカメラおよびスマートフォンに搭載されている他の構成部品については省略してある。

デジタルカメラに搭載される第1情報処理装置2は、そのCPUが、本発明の第1コンピュータプログラムを実行することにより、制御部21および通信部31として動作する。制御部21は、デジタルカメラの機能全体を統括的に制御する制御手段として機能する。制御部21は、また、操作検出部25、接続判断部26、画面キャプチャ部27、操作項目解析部28、仮想キーボード表示部29、及びデータ表示部30として機能する。操作項目とは、上述したUI操作項目である。仮想キーボードとはソフトウェアキーボードなどの情報入力ツールである。一方、スマートフォンに搭載される第2情報処理装置4は、そのCPUが第2コンピュータプログラムを実行することにより、制御部41および通信部48として動作する。制御部41は、スマートフォンの機能全体を統括的に制御する制御手段として機能する。制御部41は、また、情報解析部43、データ表示部44、仮想キーボード表示部45、操作検出部46、及び状態判断部47として機能する。

第1情報処理装置2の各部の機能を詳しく説明する。使用するハードウェアについては、適宜、図1に示したものを参照する。制御部21のうち、操作検出部25は、タッチパネルディスプレイ13の操作内容を検出する検出手段として機能する。具体的には、タッチパネルディスプレイ13の表示画面に表示されている複数の入力項目のいずれかに対する操作内容を表す操作信号を受け取り、操作内容を検出する。操作された入力項目が文字入力エリア(文字入力用のUI操作項目)であれば、文字入力の指示であることを検出する。接続判断部26は、通信路で接続されている外部装置、本例では第2情報処理装置4の有無を判断する。画面キャプチャ部27は、タッチパネルディスプレイ13の表示内容をキャプチャして、キャプチャ画像を生成するキャプチャ手段として機能する。「キャプチャ」とは表示画面を取り込んで画像データとして保存することをいう。操作項目解析部28は、操作検出部25で検出された操作項目および操作内容を解析する。例えばタッチ操作された入力項目が文字入力エリアであった場合、当該文字入力エリアの種別、表示画面のサイズ、表示画面における文字入力エリアの表示位置などを特定する。特定は、ハードディスク14に格納されたUIデータを基に行う。仮想キーボード表示部29は、ソフトウェアキーボードなどを表示する。データ表示部30は、UI部品や文字データなどをタッチパネルディスプレイ13に表示する表示手段として機能する。通信部31は画面キャプチャ部27で生成したキャプチャ画像と、操作項目解析部28の解析結果などを、通信路を形成するネットワーク3を介して第2情報処理装置4へ送信する。通信部31は、また、第2情報処理装置4から送信されてくる情報を取得する取得手段としても機能する。

第2情報処理装置4の各部の構成を詳しく説明する。通信部48は、第1情報処理装置2から送信されたキャプチャ画像および解析結果などの情報を取得する取得手段として機能する。また、入力情報を第1情報処置装置2へ送信する。制御部41のうち、情報解析部43は、第1情報処理装置2から受信した情報を解析する。例えば、第1情報処理装置2でタッチ操作された入力項目が文字入力エリアであった場合、当該文字入力エリアの種別、表示画面のサイズ、文字入力エリアの表示位置などを、予め格納されたUIデータを基に特定する。データ表示部44は、情報解析部43の解析結果に基づいて、キャプチャ画像およびこのキャプチャ画像への文字入力エリアなどの重畳表示などを行う。例えば第2情報処理装置4自体が有する文字入力エリアなどのUI操作項目を、キャプチャ画像に重畳表示する。仮想キーボード表示部45は、ソフトウェアキーボードなどを表示する。操作検出部46は、自装置のタッチパネルディスプレイ13への操作内容を検出する。例えば、ソフトウェアキーボードにおいて選択(入力)された文字を検出する。状態判断部47は、第2情報処理装置4側の動作状態を監視する。例えば文字入力が完了したか否かの判断などを行う。

[情報入力方法]

次に、上記のように構成される各情報処理装置2,4が行う、装置連携による情報入力方法の実施の形態例を説明する。この情報入力方法は、まず、第1情報処理装置2の表示画面の画面情報を第2情報処理装置4に伝達して、第2情報処理装置4の表示画面に表示させる。また、該画面情報の表示を通じて第2情報処理装置4で受け付けた入力情報を、第2情報処理装置4から第1情報処理装置2へ伝達する。つまり、第1情報処理装置2に入力する。第1情報処理装置2は、例えば静止画と動画の少なくとも一方を撮像するデジタルカメラに搭載される。第2情報処理装置4は、情報入力がデジタルカメラよりも比較的容易なスマートフォンに搭載される。通信路は、例えばWifiなどの無線通信により形成される。

以下、情報入力の例として、デジタルカメラで撮影した画像に関連する文字を入力する場合の実施例を説明する。デジタルカメラはサーバ機能も搭載されており、通信路を介してスマートフォンに接続されているものとする。

次に、上記のように構成される各情報処理装置2,4が行う、装置連携による情報入力方法の実施の形態例を説明する。この情報入力方法は、まず、第1情報処理装置2の表示画面の画面情報を第2情報処理装置4に伝達して、第2情報処理装置4の表示画面に表示させる。また、該画面情報の表示を通じて第2情報処理装置4で受け付けた入力情報を、第2情報処理装置4から第1情報処理装置2へ伝達する。つまり、第1情報処理装置2に入力する。第1情報処理装置2は、例えば静止画と動画の少なくとも一方を撮像するデジタルカメラに搭載される。第2情報処理装置4は、情報入力がデジタルカメラよりも比較的容易なスマートフォンに搭載される。通信路は、例えばWifiなどの無線通信により形成される。

以下、情報入力の例として、デジタルカメラで撮影した画像に関連する文字を入力する場合の実施例を説明する。デジタルカメラはサーバ機能も搭載されており、通信路を介してスマートフォンに接続されているものとする。

[第1実施例]

図3は、情報入力方法の第1実施例の手順説明図であり、(a)は第1情報処理装置2側、(b)は第2情報処理装置4側の手順例である。図3(a)を参照すると、第1情報処理装置2の操作検出部25は、タッチパネルディスプレイ13の表示画面の文字入力エリアに対する操作を検出する(S101)。接続判断部26は、操作検出部25で操作が検出されたときに、第2情報処理装置4が通信路を介して接続されているかどうかを判断する(S102)。第2情報処理装置4が接続されている場合(S102:YES)、画面キャプチャ部27が、タッチパネルディスプレイ13の表示内容をキャプチャし、キャプチャ画像として保存する(S103)。次いで、操作項目解析部28が、S1で検出したタッチ操作で指示された文字入力エリア関連の情報を解析する(S104)。「文字入力エリア関連の情報」は、例えば、文字入力エリアの種別(他の文字入力エリアと区別する情報)、表示画面のサイズ、当該文字入力エリアが表示画面のどの位置に配置されているかを示す座標値などである。解析は、これらの情報を特定する処理である。続いて、通信部31がキャプチャ画像とS104による解析結果を画面情報とし、この画面情報を通信路を介して第2情報処理装置4へ送信(伝達)する(S105)。通信部31は、また、第2情報処理装置4側で入力された入力情報、例えば文字データが該装置4から送信されるのを待ち、送信されたらそれを受信(取得)する(S106)。S102において、第2情報処理装置4が接続されていない場合(S102:NO)、仮想キーボード表示部29が、例えば第1情報処理装置2自身が持つソフトウェアキーボードを表示する。そして、第1情報処理装置2自身による文字データの入力を可能にする(S107)。こうしてデータ表示部30が、S106で受信した文字データ、あるいはS107でソフトウェアキーボードより入力された文字データを、文字入力エリアと関連付けてRAM17に記憶する。そしてこの文字データを、表示画面の文字入力エリアに表示し(S108)、処理を終える。

図3は、情報入力方法の第1実施例の手順説明図であり、(a)は第1情報処理装置2側、(b)は第2情報処理装置4側の手順例である。図3(a)を参照すると、第1情報処理装置2の操作検出部25は、タッチパネルディスプレイ13の表示画面の文字入力エリアに対する操作を検出する(S101)。接続判断部26は、操作検出部25で操作が検出されたときに、第2情報処理装置4が通信路を介して接続されているかどうかを判断する(S102)。第2情報処理装置4が接続されている場合(S102:YES)、画面キャプチャ部27が、タッチパネルディスプレイ13の表示内容をキャプチャし、キャプチャ画像として保存する(S103)。次いで、操作項目解析部28が、S1で検出したタッチ操作で指示された文字入力エリア関連の情報を解析する(S104)。「文字入力エリア関連の情報」は、例えば、文字入力エリアの種別(他の文字入力エリアと区別する情報)、表示画面のサイズ、当該文字入力エリアが表示画面のどの位置に配置されているかを示す座標値などである。解析は、これらの情報を特定する処理である。続いて、通信部31がキャプチャ画像とS104による解析結果を画面情報とし、この画面情報を通信路を介して第2情報処理装置4へ送信(伝達)する(S105)。通信部31は、また、第2情報処理装置4側で入力された入力情報、例えば文字データが該装置4から送信されるのを待ち、送信されたらそれを受信(取得)する(S106)。S102において、第2情報処理装置4が接続されていない場合(S102:NO)、仮想キーボード表示部29が、例えば第1情報処理装置2自身が持つソフトウェアキーボードを表示する。そして、第1情報処理装置2自身による文字データの入力を可能にする(S107)。こうしてデータ表示部30が、S106で受信した文字データ、あるいはS107でソフトウェアキーボードより入力された文字データを、文字入力エリアと関連付けてRAM17に記憶する。そしてこの文字データを、表示画面の文字入力エリアに表示し(S108)、処理を終える。

次に、図3(b)を参照して第2情報処理装置4が行う処理の手順例を説明する。第2情報処理装置4は、通信部48が、第1情報処理装置2側から画面情報を取得する。本例ではキャプチャ画像と文字入力エリア関連の情報を画面情報として受信し、これをRAM17に記憶する(S109)。そして、情報解析部43が、受信した画面情報を解析する(S110)。具体的には、文字入力エリアの種別、表示画面のサイズ、当該文字入力エリアが表示画面のどの位置に配置されているかを示す座標値などを特定する。続いて、データ表示部44が、S110で解析した情報を基に、キャプチャ画像を表示画面に表示するとともに、文字入力エリアの位置に、第2情報処理装置4側で用意された文字入力エリアを重ねて表示する(S111)。例えば、背景画像となるキャプチャ画像のうち文字入力エリアの部分に、文字入力用のHTML部品である<input type=”text”>要素を指定して重ねる。これにより、第2情報処理装置4側での当該文字入力エリアへの文字入力が可能となる。その後、仮想キーボード表示部45が、第2情報処理装置4自身のソフトウェアキーボードなどを表示する(S112)。そして、操作検出部46が、ユーザによるソフトウェアキーボードに対するタッチ操作を検出し、文字入力を受け付ける(S113)。状態判断部47は、第2情報処理装置4側のユーザによる文字入力が完了したか否かの判断を行う(S114)。文字入力が完了していない場合(S114:NO)、S113の処理に戻る。一方、文字入力が完了している場合(S114:YES)、通信部48は、第2情報処理装置4側で入力された文字データを第1情報処理装置2に送信し(S115)、処理を終える。

このように、第1実施例では、第1情報処理装置2の表示画面の画面情報を第2情報処理装置4の表示画面に表示させ、この表示を通じて第2情報処理装置4側で受け付けた入力情報を第1情報処理装置2側の表示画面に入力する。そのため、第2情報処理装置4側では、第1情報処理装置2側のどの部分に対する情報入力なのかを直感的に把握できるので、装置連携による情報入力の際の操作負担を軽減することができる。

図4に、第1実施例による情報入力の様子を具体的に説明する。デジタルカメラ51の背面には表示画面53が設けられている。この表示画面53には、撮影画像(Photo01)のほか、この撮影画像に関するタイトル、コメント、タグなどの文字入力エリアが表示されている。つまり、デジタルカメラ51では、撮像された画像に対するタイトル、コメント又はタグの入力を受け付けることができる。ここで文字入力エリアの一つであるコメントの入力項目53aに対してタッチ操作が行われたとする。すると、デジタルカメラ51は、表示画面53のキャプチャ画像およびコメントの入力項目53aへの文字入力が指示されたことを表す指示情報を接続先のスマートフォン52へ送信する(#1)。なお、画像のタイトル、コメント、タグはデジタルカメラ51で入力可能な文字情報の一例であって、これに限定されない。画像に属性情報として関連付けられる文字情報であれば、例えば画像データのファイル名、その他の識別情報などを入力可能であってもよい。

スマートフォン52は、Webブラウザおよびアプリケーションプログラムなどを起動し、デジタルカメラ51から受信した情報を表示画面54に表示する。そして、受信した情報をもとに、キャプチャ画像の中で文字入力が指示されている位置を解析し、自身の文字入力用のUI部品(文字入力エリア)54aを重ねて表示する。また、ソフトウェアキーボード55も表示し、ユーザからの文字入力を受け付ける。デジタルカメラ51側で、コメントではなく、タイトル、タグの文字入力エリアへの入力を受け付けた場合、スマートフォン52でもこれらの文字データも入力を受け付ける。入力が完了したら、入力情報を表示画面54と関連付けて記憶する。また、この入力情報をデジタルカメラ51に向けて送信する(#2)。入力情報(文字データなど)を受信したデジタルカメラ51は、この入力情報を表示画面53と関連付けて記憶する。また、コメントの入力項目53aに文字データを表示する。これにより、デジタルカメラ51に対して情報(文字データ)を入力する際の操作負荷を軽減することができる。

[第2実施例]

次に、情報入力方法の第2実施例について説明する。第2実施例では、第1情報処理装置2が、第2情報処理装置4が有する表示画面のサイズ又は解像度を取得し、取得した情報に基づいて自装置の表示画面からキャプチャする領域を決定する場合の例を説明する。なお、第1実施例と重複する部分の説明を省略する。また、便宜上、第1情報処理装置2の動作をデジタルカメラの動作、第2情報処理装置4の動作をスマートフォンの動作として説明する。

次に、情報入力方法の第2実施例について説明する。第2実施例では、第1情報処理装置2が、第2情報処理装置4が有する表示画面のサイズ又は解像度を取得し、取得した情報に基づいて自装置の表示画面からキャプチャする領域を決定する場合の例を説明する。なお、第1実施例と重複する部分の説明を省略する。また、便宜上、第1情報処理装置2の動作をデジタルカメラの動作、第2情報処理装置4の動作をスマートフォンの動作として説明する。

図5は、デジタルカメラ(第1情報処理装置2)側で行う処理の手順説明図である。デジタルカメラ側では、表示画面の文字入力エリアに対するタッチ操作を検出する(S201)。タッチ操作は、本例では文字入力の指示を表す操作である。デジタルカメラ側では、また、スマートフォンが接続されているかどうかを判断する(S202)。接続されている場合(S202:YES)、そのスマートフォンの表示画面の画面情報を取得して解析する(S203)。「画面情報」は、例えば表示画面の縦横サイズ、解像度などの情報であり、スマートフォンへの接続時にデジタルカメラ側(画面キャプチャ部27)から要求される。なお、この情報は、予め取得して記憶しておいてもよい。続いて、デジタルカメラは、スマートフォン側の画面情報に応じたキャプチャ画像を生成する(S204)。例えば、スマートフォンの表示画面の縦横サイズに適合するように、文字入力が指示された文字入力エリアを中心に画面を切り出し、これをキャプチャ画像とする。このとき、縦横サイズのほか、解像度をも考慮して、スマートフォン側でより見やすいキャプチャ画像としてもよい。その後のS205〜S209までの処理は図3のS104〜S108の処理と同様である。

次に、図6を参照して、第2実施例による装置連携の情報入力の様子を詳しく説明する。図6(a)はスマートフォン52側の様子を示している。エリア61は、表示画面54のうちデジタルカメラ51からのキャプチャ画像を表示できる範囲であり、「表示画面の情報」の一例として、デジタルカメラ51へ送信される。表示画面54には、ソフトウェアキーボード62も表示される。図6(b)はデジタルカメラ51の様子を示している。エリア61の情報を受信したデジタルカメラ51では、表示画面54のどの領域を切り取ってキャプチャしたらよいかを解析する。本例では、タッチ箇所63を中心として、エリア61と同じサイズであるエリア64をキャプチャ領域とし、キャプチャ画像を生成する。図6(c)はデジタルカメラ51で生成されたキャプチャ画像65の例を示している。図6(d)は、スマートフォン52側で、キャプチャ画像65に基づく情報入力用の画像66を表示画面54に表示した例である。図示の例では、キャプチャ画像65に対して文字入力エリアのUI操作部品を重ねて表示し、文字入力を受け付ける。

このように、第2実施例では、デジタルカメラ51が、スマートフォン52の表示画面の情報(サイズ、解像度)を取得し、この情報に応じて自身の表示画面のキャプチャ領域を決定する。そのため、スマートフォン52に対して、必要最小限の情報量のキャプチャ画像が送信され、画面全体のキャプチャ画像に比べて通信時の負荷を削減することができる。

[第3実施例]

次に、情報入力方法の第3実施例について説明する。第3実施例では、第2情報処理装置4を搭載したスマートフォン側で、情報入力が指示された部分を文字入力エリアとして予め認識できるようにする場合の例を示す。第1実施例と重複する部分の説明を省略する。また、第1情報処理装置2の動作をデジタルカメラの動作、第2情報処理装置4の動作をスマートフォンの動作として説明する。

次に、情報入力方法の第3実施例について説明する。第3実施例では、第2情報処理装置4を搭載したスマートフォン側で、情報入力が指示された部分を文字入力エリアとして予め認識できるようにする場合の例を示す。第1実施例と重複する部分の説明を省略する。また、第1情報処理装置2の動作をデジタルカメラの動作、第2情報処理装置4の動作をスマートフォンの動作として説明する。

図7は、スマートフォン側の処理の手順説明図である。スマートフォンは、デジタルカメラからキャプチャ画像と文字入力エリア関連の情報を受信する(S301)。また、受信した画面情報を解析する(S302)。その後、キャプチャ画像のうち、情報入力が指示された文字入力エリアを示す指標、例えば矢印などのマークを重ねて表示する(S303)。これにより、スマートフォンでは、指標により特定される入力項目への情報入力を可能にする。具体的には、スマートフォン自身のソフトウェアキーボードと、専用文字入力エリアを表示する(S304)。専用文字入力エリアとは、例えばアプリケーションに関わらず、常に同じ位置に表示される文字入力用エリアである。S305〜S307の処理は、図3(b)のS113〜S115と同様である。

次に、図8を参照して、第3実施例による情報入力の様子を詳しく説明する。図6と重複する部分の説明は省略する。スマートフォン52は、キャプチャ画像を含む画面情報を受信し、表示画面54に表示する。また、専用文字入力エリア81を表示し、さらに、キャプチャ画像のどの入力項目に対する文字入力かを示す指標(矢印)82を表示する。そのため、スマートフォン52を使用して文字入力を行うユーザは、指標82を参照することで、キャプチャ画像上のどの入力項目に対する文字入力を行っているかを直感的に把握することができる。

このように、第3実施例によれば、専用文字入力エリア81と指標82とを設けることで、デジタルカメラに対し、スマートフォンを利用して外部装置から文字入力を行う場合の操作負荷を更に軽減させることができる。

[第4実施例]

次に、情報入力方法の第4実施例について説明する。第4実施例では、デジタルカメラで生成するキャプチャ画像に、第3実施例で説明した指標により特定される入力項目以外の入力項目の画像が含まれている場合の例を説明する。この場合、スマートフォンでは指標により特定される入力項目のほか、それ以外の入力項目への情報入力を可能にする。なお、第1乃至第3実施例と重複する部分の説明は省略する。また、第1情報処理装置2の動作をデジタルカメラの動作、第2情報処理装置4の動作をスマートフォンの動作として説明する。

次に、情報入力方法の第4実施例について説明する。第4実施例では、デジタルカメラで生成するキャプチャ画像に、第3実施例で説明した指標により特定される入力項目以外の入力項目の画像が含まれている場合の例を説明する。この場合、スマートフォンでは指標により特定される入力項目のほか、それ以外の入力項目への情報入力を可能にする。なお、第1乃至第3実施例と重複する部分の説明は省略する。また、第1情報処理装置2の動作をデジタルカメラの動作、第2情報処理装置4の動作をスマートフォンの動作として説明する。

図9は第4実施例の処理手順説明図であり、(a)はデジタルカメラ側、(b)はスマートフォン側の処理例である。図9(a)において、S401ないしS404までは、図3(a)のS101〜S104の処理と同じである。第4実施例では、これらの処理の後、デジタルカメラが、キャプチャ画像の中に、情報入力が指示されていない他の文字入力エリアが含まれるかどうかを判断する(S405)。含まれる場合(S405:YES)、デジタルカメラは、当該他の文字入力エリア関連の情報も解析する(S406)。「文字入力エリア関連の情報」は、例えば、当該他の文字入力エリアの種別、当該他の文字入力エリアが表示画面のどの位置に配置されているかを示す座標値などである。こうしてデジタルカメラは、情報入力が指示されていない他の文字入力エリア関連の情報を、文字入力を指示された文字入力エリア関連に含めて、スマートフォン側へ送信する(S407)。S405において、他の文字入力エリアが含まれていないと判断した場合(S405:NO)、直ちにS407の処理に移行する。その後のS408〜S410の処理は、図3(b)のS106〜S108の処理と同様である。

図9(b)において、スマートフォン側では、S411〜S415は図7のS301〜S305の処理と同様である。第4実施例では、これらの処理の後、キャプチャ画像の中に複数の文字入力エリアが含まれているかどうかを判断する(S416)。含まれている場合(S416:YES)、スマートフォンは、他の文字入力エリアへのタッチ操作があるかどうかを判断する(S417)。他の文字入力エリアへのタッチ操作である場合(S417:YES)、S413の処理に戻る。S416において複数の文字入力エリアが含まれていない場合(S416:NO)およびS417においてタッチ操作がない場合(S417:NO)の処理は、図7のS306〜S307と同様となる(S418,S419)。

このように、第4実施例によれば、デジタルカメラ側で情報入力が指示されていない文字入力エリアに対してもスマートフォン側で文字を入力することが可能となる。そして、スマートフォンから、デジタルカメラに向けて、スマートフォンにて入力された全ての文字データを送信できるので、文字入力時のユーザの操作負担が軽減される。

[第5実施例]

次に、情報入力方法の第5実施例について説明する。第5実施例では、スマートフォン側の専用文字入力エリアを使用して文字入力を行う場合の例を示す。なお、第1乃至第3実施例と重複する部分の説明は省略する。また、第1情報処理装置2の動作をデジタルカメラの動作、第2情報処理装置4の動作をスマートフォンの動作として説明する。

次に、情報入力方法の第5実施例について説明する。第5実施例では、スマートフォン側の専用文字入力エリアを使用して文字入力を行う場合の例を示す。なお、第1乃至第3実施例と重複する部分の説明は省略する。また、第1情報処理装置2の動作をデジタルカメラの動作、第2情報処理装置4の動作をスマートフォンの動作として説明する。

図10は、第5実施例におけるスマートフォン側の処理手順説明図である。S501〜S502の処理は、図7のS301〜S302の処理と同じである。第5実施例では、これらの処理の後、スマートフォンが、文字入力をユーザに行わせる際に、専用文字入力エリアを使用して文字入力をさせるかどうかを判断する(S503)。専用文字入力エリアとは、例えば、図8のエリア81のようなものである。専用文字入力エリアを使用して文字入力をさせる場合(S503:YES)、図7のS303〜S304と同様の処理を行う(S504,S505)。専用文字入力エリアを使用して文字入力をさせない場合(S503:NO)は、図3(b)のS111〜S112と同様の処理を行う(S506,S507)。その後のS508〜S510の処理は、図7のS305〜S307の処理と同様となる。

このように、第5実施例によれば、スマートフォン側において、専用文字入力エリアを使用して文字入力させるかどうかによって処理の内容を切り替えることができる。そのため、入力方式の選択の自由度が高まる。

[第6実施例]

次に、情報入力方法の第6実施例について説明する。第6実施例では、デジタルカメラ側で、キャプチャする領域の縦サイズと横サイズとを比較するとともに、キャプチャ画像を表示する際に推奨する表示画面の向きを表す推奨画面向き情報を比較結果に応じて決定する場合の例を説明する。この場合、決定した推奨画面向き情報を画面情報に含めてスマートフォンへ送信する。なお、第1実施例の処理と重複する部分の説明は省略する。

次に、情報入力方法の第6実施例について説明する。第6実施例では、デジタルカメラ側で、キャプチャする領域の縦サイズと横サイズとを比較するとともに、キャプチャ画像を表示する際に推奨する表示画面の向きを表す推奨画面向き情報を比較結果に応じて決定する場合の例を説明する。この場合、決定した推奨画面向き情報を画面情報に含めてスマートフォンへ送信する。なお、第1実施例の処理と重複する部分の説明は省略する。

図11は、第6実施例の処理手順説明図であり、(a)はデジタルカメラ側、(b)はスマートフォン側の例である。図11(a)において、S601〜603の処理は図9(a)のS401〜S403の処理と同様である。第6実施例では、これらの処理の後、デジタルカメラが、キャプチャ画像の縦横サイズを取得する(S604)。そして、取得したキャプチャ画像の縦サイズと横サイズとを比較する(S605)。横のサイズが縦のサイズ以上の場合(S605:YES)、スマートフォンの推奨画面向きを横に決定する(S606)。横のサイズが縦のサイズ以上でない場合(S605:NO)、推奨画面向きを縦に決定する(S607)。その後、情報入力が指定された文字入力エリア関連の情報を解析する(S608)。また、キャプチャ画像、文字入力エリア関連の情報および決定した推奨画面向きの情報をスマートフォンへ送信する(S609)。その後のS610〜S612の処理は、図9(a)のS408〜S410と同様である。

スマートフォン側では、図11(b)に示される手順で処理を行う。すなわち、キャプチャ画像、文字入力エリア関連の情報および推奨画面向きの情報を受信する(S613)。続いて、受信したキャプチャ画像と、文字入力エリア関連の情報および推奨画面向きの情報を解析する(S614)。例えば、文字入力エリアの種別、当該文字入力エリアが表示画面のどの位置に配置されているかなどを示す座標値、推奨画面向きが縦か横かなどである。そして、スマートフォン自身の現在の画面の向きと、S614で解析した推奨画面向きが異なるか否かを判断する(S615)。推奨画面向きが異ならない場合(S615:NO)、S618の処理に進む。異なる場合(S615:YES)、例えば回転方向を示す矢印(変更を促す情報)を現在画面に表示されている情報に重ねて表示させ、ユーザにスマートフォンの向きを推奨画面向きへ変更するように促す(S616)。なお、変更の促し方は上記例に限定されない。そして、スマートフォン自身の現在の画面の向きと解析した推奨画面向きが同じになったか否かを判断する(S617)。推奨画面向きが同じになっていない場合(S617:NO)、S616の処理に戻る。推奨画面向きが同じになった場合(S617:YES)、S618の処理に進む。S618〜S622の処理は、図10のS506〜S510と同様である。

このように、第6実施例によれば、デジタルカメラ側でキャプチャ画像の縦横サイズを比較し、横のサイズが縦のサイズ以上の場合は、推奨画面向き情報を横に決定する。横のサイズが縦のサイズ以上でない場合は、推奨画面向き情報を縦に決定する。そして、キャプチャ画像と解析した文字入力用の操作項目に関する情報と共に推奨画面向き情報を関連づけてスマートフォン側に送信する。一方、スマートフォン側では、推奨画面向き情報に基づいて自身の向き推奨画面向きの方向へ変更することを促す情報を表示する。そのため、デジタルカメラから文字入力指示の通知を受け取ったときに、キャプチャ画像がスマートフォン側でより大きく表示されるため見易くなり、文字入力時の利便性が向上する。

[変形例]

本実施形態および実施例では、第1情報処理装置2と第2情報処理装置4とをネットワーク3で接続した場合の例を説明した。しかし、本発明は、それぞれ情報入力用の表示画面を有する複数の情報処理装置を通信路を介して接続し、いずれか一つの情報処理装置の表示画面の画面情報を他の情報処理装置の表示画面に表示させる態様でも実施が可能である。

また、第1〜第6実施例では第1情報処理装置2がデジタルカメラに搭載され、第2情報処理装置4がスマートフォンに搭載されている場合の例を説明したが、搭載するデバイスはこれらの例に限定されない。デジタルカメラはタブレット端末や携帯端末であってもよい。スマートフォンもまた、タブレット端末やパーソナルコンピュータであってもよい。

本実施形態および実施例では、第1情報処理装置2と第2情報処理装置4とをネットワーク3で接続した場合の例を説明した。しかし、本発明は、それぞれ情報入力用の表示画面を有する複数の情報処理装置を通信路を介して接続し、いずれか一つの情報処理装置の表示画面の画面情報を他の情報処理装置の表示画面に表示させる態様でも実施が可能である。

また、第1〜第6実施例では第1情報処理装置2がデジタルカメラに搭載され、第2情報処理装置4がスマートフォンに搭載されている場合の例を説明したが、搭載するデバイスはこれらの例に限定されない。デジタルカメラはタブレット端末や携帯端末であってもよい。スマートフォンもまた、タブレット端末やパーソナルコンピュータであってもよい。

なお、本発明は、本発明のコンピュータプログラムを、ネットワーク又は可搬性の記憶媒体を介して、情報処理装置に供給し、そのCPUがコンピュータプログラムを読出し、実行する形態でも実施が可能である。本発明は、また、1以上の機能を実現する回路(例えば、ASIC)によっても実現が可能である。

Claims (15)

- それぞれ情報入力用の表示画面を有する複数の情報処理装置を通信路を介して接続し、いずれか一つの第1情報処理装置の前記表示画面の画面情報を他の第2情報処理装置の前記表示画面に表示させ、該画面情報の表示を通じて前記第2情報処理装置で受け付けた入力情報を前記第1情報処理装置に入力する、

装置連携による情報入力方法。 - 前記画面情報は、前記第1情報処理装置の表示画面をキャプチャしたキャプチャ画像と、前記表示画面のうち情報入力が指示された入力項目を表す指示情報とを含む、

請求項1に記載の情報入力方法。 - 前記画面情報は、前記入力項目を特定するための指標をさらに含み、

前記第2情報処理装置は、前記指標により特定される入力項目への情報入力を可能にする、

請求項2に記載の情報入力方法。 - 前記キャプチャ画像には、前記指標により特定される入力項目以外の入力項目の画像が含まれており、

前記第2情報処理装置は、前記指標により特定される入力項目のほか、それ以外の入力項目への情報入力を可能にする、

請求項3に記載の情報入力方法。 - 前記第2情報処理装置は、前記入力項目に対応する文字入力エリアを自装置の表示画面に表示させ、該表示を介して入力された情報を当該入力項目に関連付けて記憶する、

請求項3又は4に記載の情報入力方法。 - 前記第2情報処理装置は、前記入力項目に対応する文字入力エリアを、前記キャプチャ画像のうち、前記情報入力が指示された入力項目に重ねて表示させる、

請求項5に記載の情報入力方法。 - 前記第1情報処理装置は、前記第2情報処理装置が有する表示画面のサイズを取得し、取得したサイズに基づいて自装置の表示画面からキャプチャする領域を決定する、

請求項2ないし6のいずれかの1項に記載の情報入力方法。 - 前記第1情報処理装置は、前記第2情報処理装置の前記表示画面の解像度を取得し、取得した解像度に基づいて自装置の表示画面からキャプチャする領域を決定する、

請求項2ないし7のいずれか1項に記載の情報入力方法。 - 前記第1情報処理装置は、前記キャプチャする領域の縦サイズと横サイズとを比較するとともに、前記キャプチャ画像を表示する際に推奨する表示画面の向きを表す推奨画面向き情報を前記比較結果に応じて決定し、決定した推奨画面向き情報を前記画面情報に含めて第2情報処理装置へ送信する、

請求項5ないし7のいずれか1項に記載の情報入力方法。 - 前記第2情報処理装置は、受信した前記推奨画面向き情報により特定される推奨画面向きと自身の表示画面の向きとが異なるかどうかを判断し、異なる場合は自身の表示画面の向きを推奨画面向きの方向への変更をユーザに促す情報を当該表示画面に表示させる、

請求項9に記載の情報入力方法。 - 前記第1情報処理装置が静止画又は動画を撮像するデジタルカメラに搭載されており、

前記第2情報処理装置は、前記デジタルカメラで撮像された画像に付与される属性情報の入力を受け付ける、

請求項1ないし10のいずれか1項に記載の情報入力方法。 - 外部装置と通信路を介して接続可能な情報処理装置であって、

情報入力用の第1表示画面を表示する表示手段と、

前記第1表示画面において情報入力が指示された入力項目を検出する検出手段と、

前記入力項目が検出されたときの前記第1表示画面の表示内容をキャプチャするキャプチャ手段と、

前記表示内容と前記入力項目とを含む画面情報を前記外部装置に伝達するとともに、伝達した画面情報を通じて前記外部装置で入力された入力情報を当該外部装置から取得し、取得した入力情報を前記検出された入力項目と関連付けて記憶する制御手段と、

を備えた情報処理装置。 - 情報入力用の第1表示画面を有する外部装置と通信路を介して接続可能な情報処理装置であって、

前記第1表示画面の表示内容と当該第1表示画面において情報入力が指示された入力項目とを含む画面情報を前記外部装置から取得する取得手段と、

取得した画面情報のうち前記表示内容を自装置における情報入力用の第2表示画面に表示するとともに、前記入力項目に対応する部分に自装置の情報入力用のUI操作項目を表示し、該表示に基づいて入力された入力情報を前記外部装置へ伝達する制御手段と、

を備える情報処理装置。 - コンピュータを、外部装置と通信路を介して接続可能な情報処理装置として動作させるコンピュータプログラムであって、

前記コンピュータを、

情報入力用の第1表示画面を表示する表示手段、

前記第1表示画面において情報入力が指示された入力項目を検出する検出手段、

前記入力項目が検出されたときの前記第1表示画面の表示内容をキャプチャするキャプチャ手段、

前記表示内容と前記入力項目とを含む画面情報を前記外部装置に伝達するとともに、伝達した画面情報を通じて前記外部装置で入力された入力情報を当該外部装置から取得し、取得した入力情報を前記検出された入力項目と関連付けて記憶する制御手段、

として機能させるコンピュータプログラム。 - コンピュータを、情報入力用の第1表示画面を有する外部装置と通信路を介して接続可能な情報処理装置として動作させるためのコンピュータプログラムであって、

前記コンピュータを、

前記第1表示画面の表示内容と当該第1表示画面において情報入力が指示された入力項目とを含む画面情報を前記外部装置から取得する取得手段、

取得した画面情報のうち前記表示内容を自装置における情報入力用の第2表示画面に表示するとともに、前記入力項目に対応する部分に自装置の情報入力用のUI操作項目を表示し、該表示に基づいて入力された入力情報を前記外部装置へ伝達する制御手段、

として機能させるコンピュータプログラム。

Priority Applications (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2015014784A JP2016139342A (ja) | 2015-01-28 | 2015-01-28 | 装置連携による情報入力方法、情報処理装置、コンピュータプログラム |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2015014784A JP2016139342A (ja) | 2015-01-28 | 2015-01-28 | 装置連携による情報入力方法、情報処理装置、コンピュータプログラム |

Publications (1)

| Publication Number | Publication Date |

|---|---|

| JP2016139342A true JP2016139342A (ja) | 2016-08-04 |

Family

ID=56559251

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2015014784A Pending JP2016139342A (ja) | 2015-01-28 | 2015-01-28 | 装置連携による情報入力方法、情報処理装置、コンピュータプログラム |

Country Status (1)

| Country | Link |

|---|---|

| JP (1) | JP2016139342A (ja) |

Cited By (3)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| KR20210041815A (ko) * | 2019-10-08 | 2021-04-16 | 한양대학교 산학협력단 | 모바일을 조작하기 위한 입력 장치 |

| JPWO2020045616A1 (ja) * | 2018-08-30 | 2021-08-26 | 株式会社アスタリスク | ウェアラブルデバイス |

| JP2023162231A (ja) * | 2019-07-01 | 2023-11-08 | ソニーグループ株式会社 | プログラム |

-

2015

- 2015-01-28 JP JP2015014784A patent/JP2016139342A/ja active Pending

Cited By (5)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JPWO2020045616A1 (ja) * | 2018-08-30 | 2021-08-26 | 株式会社アスタリスク | ウェアラブルデバイス |

| JP2023162231A (ja) * | 2019-07-01 | 2023-11-08 | ソニーグループ株式会社 | プログラム |

| JP7574891B2 (ja) | 2019-07-01 | 2024-10-29 | ソニーグループ株式会社 | プログラム |

| KR20210041815A (ko) * | 2019-10-08 | 2021-04-16 | 한양대학교 산학협력단 | 모바일을 조작하기 위한 입력 장치 |

| KR102316514B1 (ko) * | 2019-10-08 | 2021-10-22 | 한양대학교 산학협력단 | 모바일을 조작하기 위한 입력 장치 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| US9485450B2 (en) | Contents display device, contents display method, and computer readable medium for storing contents display program | |

| JP5798532B2 (ja) | ユーザインタフェース装置、ユーザインタフェース方法及びプログラム | |

| US20180136806A1 (en) | Display control apparatus, display control method, and program | |

| US20140096052A1 (en) | Image display control apparatus, image display apparatus, non-transitory computer readable medium, and image display control method | |

| US9582172B2 (en) | Display control apparatus and method, image display apparatus, and non-transitory computer readable medium | |

| KR20130080179A (ko) | 휴대용 단말기에서 아이콘 관리 방법 및 장치 | |

| US20140092291A1 (en) | Image display control apparatus, image display apparatus, non-transitory computer readable medium, and image display control method | |

| US9560224B2 (en) | Remote control device, remote operation device, screen transmission control method, and non-transitory computer-readable recording medium encoded with screen display control program | |

| US9386174B2 (en) | Image forming apparatus, method for guidance on operation method by image forming apparatus, and system | |

| JP2015046058A (ja) | 画像形成システムおよび出力指示プログラム | |

| US20140298205A1 (en) | Program, Communication Apparatus and Control Method | |

| JP2014081789A (ja) | 情報処理装置、情報処理装置の制御方法、及びプログラム | |

| US12049015B2 (en) | Screen image transition information generation device, screen image transition information generation method, screen image transition information generation program, and screen image transition information generation system | |

| CN106293563B (zh) | 一种控制方法和电子设备 | |

| KR20120140291A (ko) | 단말기 및 그 단말기에서 데이터 표시 방법 | |

| US8949934B2 (en) | Communication device, communication method, and program | |

| JP2016139342A (ja) | 装置連携による情報入力方法、情報処理装置、コンピュータプログラム | |

| US9432526B2 (en) | Image forming system, image forming apparatus, remote control apparatus, and recording medium for displaying an input screen | |

| US9036194B2 (en) | Operation input apparatus, image forming system, and storage medium for operation input program | |

| US9258442B2 (en) | Image processing system, image processing apparatus and portable terminal configured to display an effect of performing image adjustment processing to image data in the image processing apparatus | |

| US9319600B2 (en) | Information processing apparatus, information processing method and computer program product | |

| US20160307349A1 (en) | Communication support system, information processing apparatus, control method, and storage medium | |

| JP2015122124A (ja) | 仮想マウスによるデータ入力機能を有する情報装置 | |

| JP6704608B2 (ja) | 端末装置、診断システムおよびプログラム | |

| US9860395B2 (en) | Data input system, data input apparatus, data input method, and non-transitory computer-readable recording medium encoded with data input program |